L'assaut des « hackers IA », comment l'IA agente devient-elle le nouveau gardien ?

TechFlow SélectionTechFlow Sélection

L'assaut des « hackers IA », comment l'IA agente devient-elle le nouveau gardien ?

Avec la lance de l'IA, attaquer le bouclier de l'IA.

Auteur :Lafeng de Geek

01 L'essor de l'IA : la guerre secrète de la sécurité à l'ère de la technologie double tranchant

Avec le développement rapide des technologies d'intelligence artificielle (IA), les menaces pesant sur la cybersécurité deviennent de plus en plus complexes. Les méthodes d'attaque sont non seulement plus efficaces et discrètes, mais ont également donné naissance à une nouvelle forme de « hacker IA », provoquant diverses crises inédites en matière de cybersécurité.

Premièrement, l'IA générative redéfinit la « précision » de l'hameçonnage numérique.

En termes simples, il s'agit d'intelligenter les attaques traditionnelles par hameçonnage. Par exemple, dans des scénarios ciblés précis, les attaquants utilisent des données sociales publiques pour entraîner des modèles d’IA afin de générer massivement des e-mails personnalisés, imitant le style d’écriture ou les habitudes linguistiques spécifiques d’un utilisateur, mettant ainsi en œuvre des escroqueries « sur mesure » capables de contourner les filtres anti-spam classiques et augmentant considérablement leur taux de réussite.

Ensuite vient la falsification profonde (Deepfake) et l'usurpation d'identité, désormais bien connue du grand public. Avant que la technologie IA ne mûrisse, les attaques traditionnelles de type « usurpation d’identité », appelées BEC (Business Email Compromise), consistaient à faire croire qu’un e-mail provenait d’un supérieur hiérarchique, d’un collègue ou d’un partenaire commercial afin d’obtenir frauduleusement des informations commerciales, de l’argent ou d’autres données sensibles.

Aujourd'hui, cette « transformation » est devenue réalité. Grâce aux technologies d’IA permettant de modifier les visages et la voix, il est possible de falsifier l’identité de personnalités publiques ou de proches, à des fins d’escroquerie, de manipulation d’opinion voire d’ingérence politique. Il y a deux mois à peine, le directeur financier d'une entreprise shanghaienne a reçu une invitation à une vidéoconférence prétendument émanant du PDG. Ce dernier, grâce à un Deepfake, affirmait avoir besoin d’un paiement urgent relatif à une « caution pour coopération internationale ». Suivant ces instructions, le directeur a transféré 3,8 millions de yuans vers un compte désigné avant de découvrir qu’il s’agissait d’un gang criminel étranger utilisant la technologie Deepfake.

Troisièmement, l’automatisation des attaques et l’exploitation des vulnérabilités. L’évolution de l’IA pousse de nombreux domaines vers l’intelligence et l’automatisation, et les attaques cybernétiques n’y échappent pas. Les attaquants peuvent utiliser l’IA pour scanner automatiquement les failles système, générer dynamiquement des codes malveillants et lancer rapidement des attaques massives sans discrimination. Par exemple, une attaque « zéro jour » pilotée par l’IA peut immédiatement rédiger et exécuter un programme malveillant dès la découverte d’une vulnérabilité, rendant impossible une réponse en temps réel pour les systèmes de défense traditionnels.

Ce printemps, le site officiel de DeepSeek a subi une attaque DDoS d’envergure massive de 3,2 Tbps. Simultanément, les pirates ont infiltré via l’API des échantillons adverses, altérant les poids du modèle et provoquant l’arrêt complet des services principaux pendant 48 heures, causant des pertes économiques directes de plusieurs dizaines de millions de dollars. Une enquête ultérieure a révélé des traces d'infiltration de longue date attribuées à la NSA américaine.

La pollution des données et les failles de modèles constituent également une menace nouvelle. En injectant intentionnellement de fausses informations dans les données d'entraînement de l'IA (empoisonnement de données), ou en exploitant les propres vulnérabilités des modèles, les attaquants peuvent induire des erreurs critiques – menaçant directement la sécurité dans des domaines clés et pouvant même entraîner des catastrophes en chaîne. Par exemple, un système de conduite autonome pourrait interpréter un panneau « interdit » comme un « limite de vitesse », ou une IA médicale diagnostiquer à tort une tumeur bénigne comme maligne.

02 Lutter contre l’IA avec l’IA

Faire face aux nouvelles menaces de cybersécurité induites par l’IA rend obsolètes les modes de protection traditionnels. Alors, quelles solutions avons-nous ?

Il est clair que le consensus actuel dans le secteur pointe vers une approche « contrer l’IA par l’IA » – non seulement une mise à niveau technique, mais aussi un changement fondamental du paradigme de sécurité.

Les tentatives existantes se divisent globalement en trois catégories : les technologies de protection de sécurité des modèles d’IA, les applications sectorielles de défense, et la collaboration gouvernementale et internationale à un niveau plus large.

Le cœur des technologies de protection de sécurité des modèles d’IA réside dans le renforcement intrinsèque de la sécurité du modèle.

Prenez l’exemple de la faille « jailbreak » des grands modèles linguistiques (LLM). Le mécanisme de sécurité échoue souvent face à des stratégies générales de contournement : les attaquants parviennent systématiquement à outrepasser les couches de protection intégrées pour inciter l’IA à produire du contenu violent, discriminatoire ou illégal. Pour prévenir ces « jailbreaks », les entreprises spécialisées expérimentent différentes solutions. Anthropic a par exemple lancé en février dernier son « Classificateur constitutionnel ».

Cette « Constitution » fait référence à des règles linguistiques naturelles inviolables, servant de mesure de protection entraînée sur des données synthétiques. En définissant précisément les contenus autorisés et interdits, elle surveille en temps réel les entrées et sorties. Dans des tests standardisés, le modèle Claude3.5 a vu son taux de blocage réussi contre des tentatives avancées de jailbreak passer de 14 % à 95 % sous ce classificateur, réduisant drastiquement les risques de jailbreak.

Au-delà des mesures générales basées sur les modèles, les applications verticales de défense sectorielle méritent également attention. La protection contextualisée dans des cas d’usage spécifiques devient un point de rupture clé : le secteur financier construit des barrières antifraude via des modèles d’analyse des risques pilotés par IA et l’analyse multimodale des données ; l’écosystème open source répond rapidement aux menaces zéro jour grâce à des techniques intelligentes de chasse aux vulnérabilités ; la protection des informations sensibles en entreprise repose sur un système dynamique de contrôle piloté par IA.

Par exemple, la solution présentée par Cisco lors de la Semaine internationale de cybersécurité de Singapour permet d’intercepter en temps réel les requêtes d’employés soumettant des données sensibles à ChatGPT, tout en générant automatiquement des rapports d’audit conformes pour optimiser la boucle de gestion.

Au niveau macro, la collaboration transfrontalière entre gouvernements et organisations internationales s’accélère. L’Agence de cybersécurité de Singapour a publié des « Directives de sécurité pour les systèmes d’IA », imposant le déploiement local et le chiffrement des données pour limiter les abus de l’IA générative, notamment en établissant des normes de détection contre l’usurpation d’identité par IA dans les attaques d’hameçonnage. Les États-Unis, le Royaume-Uni et le Canada ont lancé conjointement le « Programme d’agents réseau IA », axé sur le développement de systèmes fiables et l’évaluation en temps réel des attaques persistantes avancées (APT), renforçant leurs capacités de défense collective via un système commun de certification de sécurité.

Quelles méthodes permettent alors de mieux utiliser l’IA pour relever les défis de cybersécurité à l’ère de l’IA ?

« À l’avenir, nous aurons besoin d’un centre intelligent de sécurité IA qui servira de pivot pour construire un nouveau système », a souligné Zhang Fu, fondateur de QingTeng Cloud Security, lors du deuxième Forum d’innovation de cybersécurité de Wuhan. « D’ici trois ans, l’IA bouleversera l’industrie de la sécurité et tous les secteurs B2B. Les produits seront reconstruits, offrant une efficacité et des capacités sans précédent. Les futurs produits seront conçus pour être utilisés par l’IA, pas par les humains. »

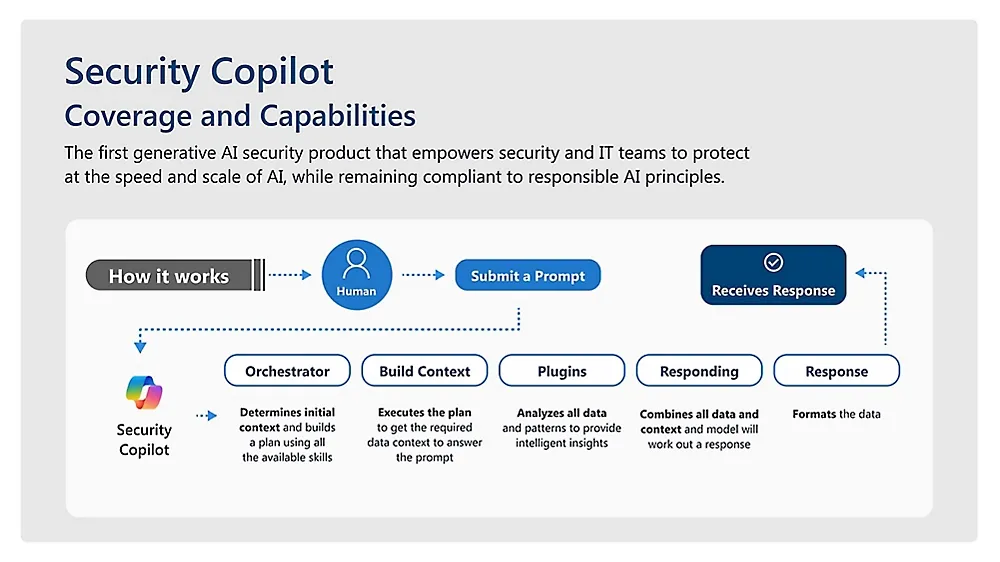

Dans ce paysage, le modèle Security Copilot illustre parfaitement l’idée que « les futurs produits seront destinés à l’IA » : il y a un an, Microsoft lançait Microsoft Security Copilot, un assistant intelligent aidant les équipes de sécurité à détecter, enquêter et répondre rapidement et précisément aux incidents ; il y a un mois, l’entreprise a dévoilé de nouveaux agents IA capables d’assister automatiquement dans des domaines clés comme l’hameçonnage, la sécurité des données et la gestion des identités.

Microsoft a ajouté six agents IA maison pour étendre les fonctionnalités de Security Copilot. Trois d’entre eux aident les analystes de cybersécurité à trier les alertes : l’agent de classification des hameçonnages examine les alertes liées au phishing et filtre les faux positifs ; deux autres analysent les notifications Purview pour détecter les cas d’utilisation non autorisée des données professionnelles par les employés.

L’agent d’optimisation de l’accès conditionnel collabore avec Microsoft Entra pour identifier les règles d’accès utilisateur non sécurisées, puis génère une solution de correction en un clic que l’administrateur peut appliquer. L’agent de correction des vulnérabilités s’intègre à l’outil de gestion des appareils Intune pour localiser rapidement les terminaux vulnérables et appliquer les correctifs du système d’exploitation. L’agent de synthèse des renseignements sur les menaces produit des rapports sur les cybermenaces susceptibles d’affecter les systèmes de l’organisation.

03 Wuxiang : la protection assurée par un agent intelligent de niveau L4

Parallèlement, en Chine, pour atteindre un niveau de protection véritablement « autonome » comparable à celui de la conduite autonome, QingTeng Cloud Security a lancé « Wuxiang », un agent intelligent de sécurité full-stack. Premier produit de sécurité IA au monde à franchir le pas d’un « assistant IA » à un « agent autonome » (Autopilot), sa percée essentielle réside dans la rupture avec le modèle traditionnel de « réponse passive », lui conférant autonomie, automatisation et intelligence.

En combinant apprentissage automatique, graphe de connaissances et prise de décision automatisée, « Wuxiang » accomplit de manière indépendante l’ensemble du cycle fermé allant de la détection des menaces à l’évaluation des impacts et à la réponse, réalisant une prise de décision véritablement autonome et orientée objectif. Son architecture « Agentic AI » imite la logique collaborative d’une équipe humaine de sécurité : un « cerveau » intègre une base de connaissances en cybersécurité pour assurer la planification ; des « yeux » perçoivent finement la dynamique de l’environnement réseau ; des « mains et pieds » mobilisent de façon flexible une variété d’outils de sécurité ; plusieurs agents collaborant ensemble forment un réseau efficace d’analyse partageant les informations, avec répartition des tâches et coopération fluide.

Sur le plan technique, « Wuxiang » adopte le « mode ReAct » (cycle Agir-Observer-Penser-Agir) et une architecture à double moteur « Plan AI + Action AI », garantissant une capacité d’autocorrection dynamique dans les tâches complexes. En cas d’anomalie lors de l’appel d’un outil, le système bascule automatiquement vers une solution de secours sans interrompre le processus. Par exemple, lors d’une analyse d’attaque APT, Plan AI agit comme un « coordinateur » en décomposant les objectifs, tandis qu’Action AI joue le rôle d’« expert enquêteur » exécutant l’analyse des journaux et la modélisation des menaces, les deux avançant en parallèle grâce à un graphe de connaissances partagé en temps réel.

Au niveau des modules fonctionnels, « Wuxiang » a construit un écosystème complet de prise de décision autonome : les agents simulent la pensée itérative et réflexive d’un analyste de sécurité, optimisant dynamiquement les chemins décisionnels ; les appels d’outils intègrent l’interrogation des journaux de sécurité hôtes, la recherche d’informations sur les menaces réseau et l’analyse de code malveillant pilotée par LLM ; la perception environnementale capture en continu les actifs hôtes et les informations réseau ; le graphe de connaissances stocke dynamiquement les relations entre entités pour soutenir la décision ; la collaboration multi-agents exécute en parallèle des tâches via la décomposition des missions et le partage d’information.

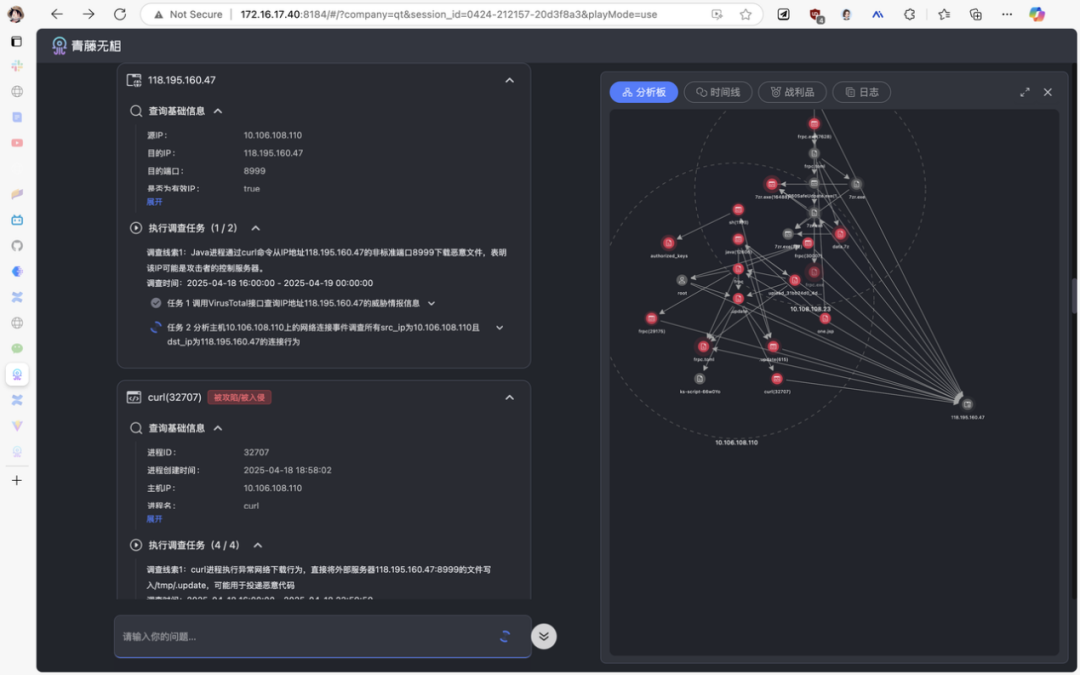

Actuellement, « Wuxiang » excelle particulièrement dans trois scénarios clés : l’analyse des alertes, l’enquête de traçabilité et la production de rapports de sécurité.

Dans les opérations de sécurité traditionnelles, distinguer le vrai du faux parmi les innombrables alertes prend beaucoup de temps. Prenons une alerte de privilège local : l’agent d’analyse des alertes de Wuxiang analyse automatiquement les caractéristiques de la menace, utilise des outils comme l’analyse des permissions de processus, la traçabilité du processus parent et la vérification de signature du programme, et conclut qu’il s’agit d’un faux positif – sans aucune intervention humaine. Lors des tests effectués par QingTeng, le système a atteint 100 % de couverture des alertes et 99,99 % de précision d’analyse, réduisant le travail humain de plus de 95 %.

Faisant face à une menace réelle comme une attaque Webshell, l’agent confirme en quelques secondes l’efficacité de l’attaque via une corrélation multidimensionnelle incluant l’extraction des caractéristiques du code et l’analyse des permissions des fichiers. Des enquêtes approfondies nécessitant auparavant plusieurs jours et la collaboration de multiples départements (comme la reconstruction du chemin de propagation ou l’évaluation de l’impact latéral) sont désormais automatisées : le système relie automatiquement les flux de données tels que les journaux hôtes, le trafic réseau et les bases comportementales, générant un rapport complet de la chaîne d’attaque, réduisant le cycle de réponse de « jours » à « minutes ».

« Notre cœur de cible est d’inverser la relation de collaboration entre l’IA et l’humain. On peut désormais travailler avec l’IA comme avec une personne, réalisant ainsi le passage du niveau L2 au niveau L4, c’est-à-dire du pilote assisté à l’autopilote avancé », a partagé Hu Jun, cofondateur et vice-président produit de QingTeng. « Plus l’IA s’adapte à davantage de scénarios et obtient des taux de réussite élevés, plus elle peut assumer de responsabilités, transformant ainsi la répartition des rôles entre humains et IA. »

Dans le scénario d’enquête de traçabilité, une alerte Webshell déclenche la collaboration d’une équipe multi-agents de sécurité pilotée par « Wuxiang AI » : l’« expert analytique » localise le fichier one.jsp à partir de l’alerte, puis crée simultanément des tâches parallèles telles que l’analyse du contenu du fichier, la traçabilité de l’auteur, l’inspection du répertoire et le suivi du processus, que l’agent « enquêteur de sécurité » exécute en appelant des outils de journalisation de fichiers, identifiant rapidement le processus java (12606) comme source d’écriture. Ce processus et l’hôte associé 10.108.108.23 (détecté par des interactions fréquentes dans les journaux d’accès) sont ensuite intégrés à l’enquête.

L’agent élargit dynamiquement les indices via un graphe de menaces, remontant progressivement d’un simple fichier au processus, puis à l’hôte. L’expert analytique compile les résultats des tâches pour évaluer globalement le risque. Ce processus réduit à quelques dizaines de minutes une investigation qui prenait auparavant plusieurs heures ou jours, restituant la chaîne complète de l’attaque avec une précision supérieure à celle d’un expert humain confirmé, traquant sans faille les mouvements latéraux, comme le montrent des évaluations par des équipes rouges incapables d’échapper à cette enquête exhaustive.

« Les grands modèles surpassent les humains parce qu’ils inspectent chaque recoin, plutôt que d’exclure des possibilités jugées peu probables par expérience », explique Hu Jun. « Cela signifie une meilleure largeur et une meilleure profondeur. »

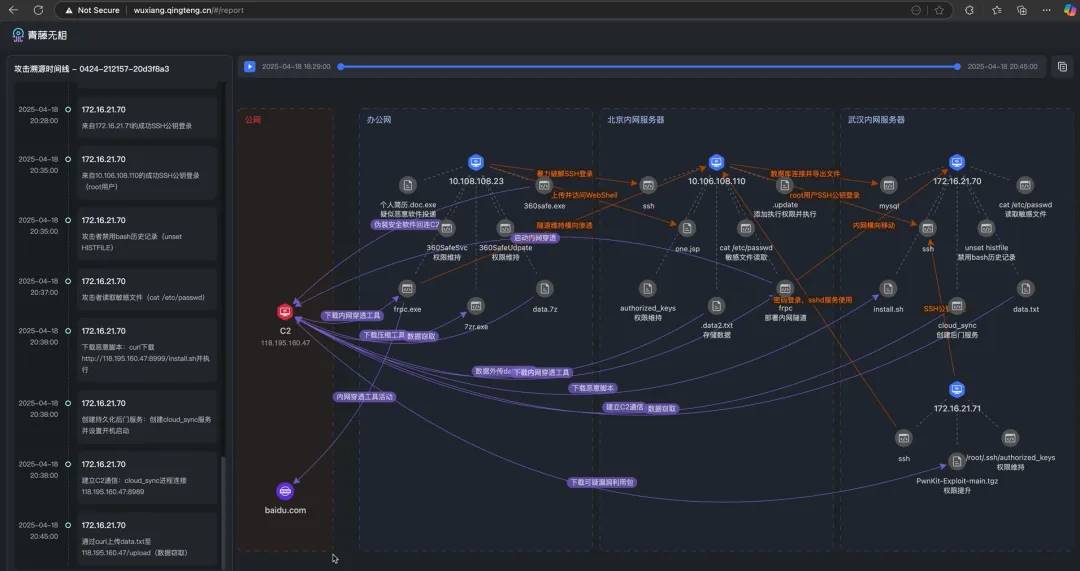

Après avoir mené une enquête complexe sur un scénario d’attaque, rassembler les alertes et les indices d’enquête pour produire un rapport était autrefois long et fastidieux. L’IA permet désormais un résumé instantané, présentant clairement le processus d’attaque sous forme de chronologie visuelle, comme un film montrant de façon continue les nœuds clés – le système organise automatiquement les preuves clés pour générer les images-clés de la chaîne d’attaque, les combine avec le contexte environnemental, et produit finalement un graphe dynamique de la chaîne d’attaque, rendant toute la trajectoire visible, intuitive et tridimensionnelle.

04 Conclusion

Il est évident que le développement des technologies d’IA pose un défi double à la cybersécurité.

D’un côté, les attaquants exploitent l’IA pour automatiser, personnaliser et dissimuler leurs attaques ; de l’autre, les défenseurs doivent accélérer l’innovation technologique, renforçant leurs capacités de détection et de réponse grâce à l’IA. À l’avenir, la compétition technologique entre attaque et défense déterminera la situation globale de la cybersécurité, et l’amélioration des agents intelligents de sécurité sera la clé pour équilibrer risque et développement.

L’agent intelligent de sécurité « Wuxiang » apporte des changements significatifs tant au niveau de l’architecture que de la cognition en matière de sécurité.

« Wuxiang » transforme fondamentalement la manière dont on utilise l’IA. Sa percée consiste à intégrer de façon organique la perception multidimensionnelle des données, la génération de politiques de protection et l’explicabilité des décisions – passant d’un usage de l’IA comme simple outil à un modèle où l’on dote l’IA de capacités autonomes et automatisées.

En corrélant journaux, textes, trafic et autres données hétérogènes, le système peut détecter les moindres indices d’activités APT avant que l’attaquant n’achève sa chaîne d’attaque. Plus important encore, ses explications visuelles du raisonnement décisionnel rendent caduques les alertes « boîte noire » des outils traditionnels, qui « savent ce qui se passe mais pas pourquoi » – les équipes de sécurité ne voient plus seulement la menace, elles comprennent désormais sa logique d’évolution.

Cette innovation marque un saut de paradigme, passant d’une approche réactive « après coup » à une stratégie proactive « préventive », redéfinissant ainsi les règles mêmes du jeu offensif-défensif.

« Wuxiang » agit comme un chasseur doté d’un instinct numérique : en modélisant en temps réel des caractéristiques microscopiques telles que les opérations en mémoire, il peut extraire d’immenses masses de bruit des chevaux de Troie personnalisés en sommeil ; son moteur de gestion dynamique de la surface d’attaque évalue continuellement le poids des risques des actifs, garantissant que les ressources de protection soient précisément dirigées vers les systèmes critiques ; son mécanisme intelligent de traitement des renseignements sur les menaces transforme des milliers d’alertes quotidiennes en instructions défensives actionnables, allant jusqu’à prédire l’évolution probable des variantes d’attaques – alors que les solutions traditionnelles luttent encore pour répondre aux intrusions passées, « Wuxiang » anticipe déjà et bloque les prochaines manœuvres de l’attaquant.

« La naissance d’un système central d’intelligence de sécurité IA (agent intelligent de haut niveau) va radicalement transformer le paysage de la cybersécurité. Et tout ce que nous devons faire, c’est saisir pleinement cette opportunité », affirme Zhang Fu.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News