테더(Tether), 로컬 AI 출시 — 소형 모델이 클라우드 기반 대형 모델과 정면 승부

글쓴이: Liam Akiba Wright

번역·정리: Luffy, Foresight News

테더(Tether)의 신규 프로젝트 QVAC은 안정화 코인 기업들 사이에서는 매우 이례적인 철학으로 시작한다. 이 회사는 자사의 QVAC Psy를 ‘심리사학(Psychohistory) 원리에 기반한’ 일련의 기초 대형 모델이라고 설명한다.

‘심리사학’이라는 개념은 아이작 아시모프(Isaac Asimov)의 고전 SF 시리즈 『파운데이션(Foundation)』에서 유래했다. 작품 속 주인공 하리 쉴든(Hari Seldon)은 수학·통계학·사회 역학을 활용해 대규모 집단의 행동 방향을 예측함으로써, 은하제국 붕괴 후 도래할 암흑 시대를 단축시키려 한다.

『SF 백과사전(The Encyclopedia of Science Fiction)』은 아시모프가 창조한 심리사학을 ‘허구의 과학’으로 정의하며, 하리 쉴든의 전체 계획은 미래 사건을 예측하고 사회 체계 붕괴 시기에도 인류의 지식 문명을 보존하는 데 초점을 맞춘다고 설명한다.

테더의 이번 표현은 사실상 공상과학적 언어를 통해 자사의 기업 미션을 포장한 것이다.

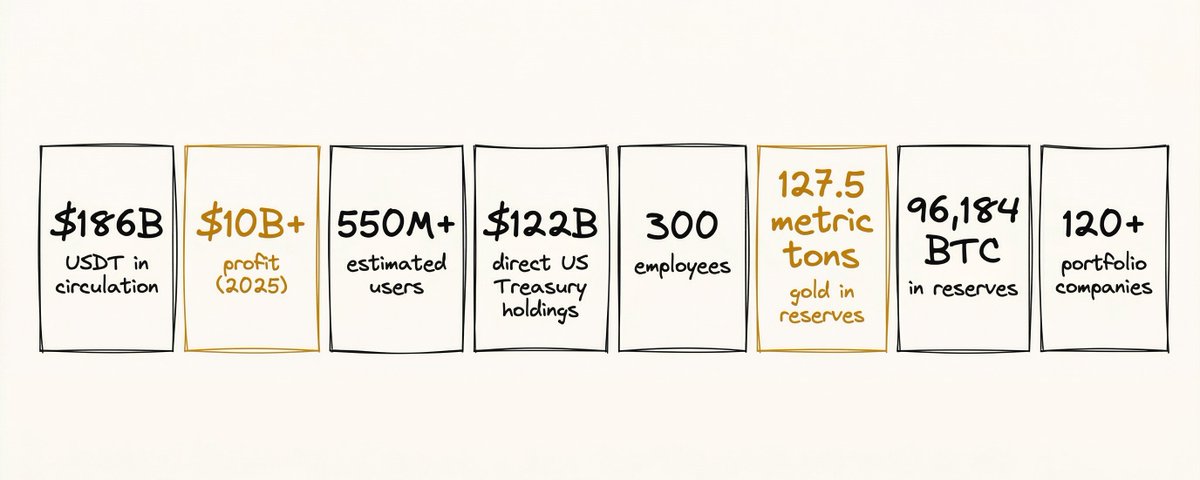

보유 자산, 유동성, 유통 채널 능력을 바탕으로 테더는 암호화폐 산업 내 최대 규모의 안정화 코인 시스템을 구축해 왔다. 이제 이 핵심 로직을 인공지능 분야로 확장하고 있다.

USDT 안정화 코인은 테더의 첫 번째 주요 보유 자산 기반이다. 반면 연산 능력(컴퓨팅 파워), AI 모델, 데이터셋, 중앙집권 클라우드 없이도 독립적으로 작동 가능한 지능형 기능은 테더의 두 번째 주요 보유 자산이 되고 있다.

달러 보유 자산에서 지능형 자산 보유 자산으로

테더의 인공지능 진출은 핵심 사업 운영 로직을 그대로 계승한다. USDT는 전 세계 오프쇼어 달러 수요를 단기 주권 채권 중심의 보유 자산 포트폴리오로 전환시킨다.

테더의 2026년 1분기 보유 자산 감사 보고서에 따르면, 회사 순이익은 10.4억 달러, 보유 자산 버퍼 규모는 82.3억 달러, 토큰 관련 부채는 약 1830억 달러이며, 직접 및 간접 보유 미국 단기 국채 규모는 약 1410억 달러이다.

탄탄한 보유 자산 기반은 테더에게 지속적인 수익 창출과 여유 있는 재무 상태를 제공하며, 동시에 경영 이익을 장기 인프라 분야에 투자할 수 있는 여력을 부여한다.

CryptoSlate는 이전에 테더가 방대한 안정화 코인 규모를 바탕으로 보유 자금을 전략적으로 배치할 수 있다고 분석한 바 있다. 올해 1월 테더는 비트코인 8,888개를 매입했는데, 이는 이자 수익과 경영 이익을 장기 비트코인 보유 수요로 전환할 수 있음을 입증한 사례다. 한편 QVAC 프로젝트는 이러한 자산 배치 로직을 인공지능이라는 새로운 분야로 확장한 것이다.

현재 테더는 비트코인, 금, 스타트업, 에너지 산업, 암호화폐 채굴, 통신 인프라 등에 더해 인공지능 자체에 본격적으로 투자하고 있다. 이는 테더를 단순한 민간 달러 유동성 발행기관에서 민간 디지털 인프라 건설자로 전환시키는 전략적 포지셔닝이다.

‘심리사학’이라는 공상과학 서사가 바로 이러한 전략 방향과 완벽하게 부합한다. 테더는 인공지능을 일반 소프트웨어 분야가 아닌, 문명 차원의 근간 인프라로 간주한다. QVAC 공식 자료는 자사 플랫폼을 ‘무한히 안정적인 지능형 플랫폼(Infinite Stable Intelligence Platform)’으로 정의하며, 중앙집권형 AI를 대체하기 위해 우선적으로 로컬에서 실행되는 탈중앙화 지능형 시스템을 표방한다.

QVAC의 비전 문서는 모든 지능형 상호작용을 중앙서버에 맡기는 것이 단순히 속도가 느리고 안정성이 낮을 뿐 아니라, 검열 및 제한 위험까지 내포한다고 지적한다. 대신 QVAC는 사용자 개인의 지능형 시스템을 위한 엣지 단(Edge-tier) 근간 인프라가 되기를 목표로 한다.

이러한 철학은 테더의 안정화 코인 철학과도 정확히 호응한다. 즉, 자금 이체는 허가 없이 가능해야 하고, 사용자 데이터는 사용자 스스로 관리해야 하며, 인공지능 역시 사용자 가까이, 로컬에서 실행되어야 한다는 것이다.

아시모프의 공상과학 개념 뒤에는 테더의 더 진지한 판단이 숨어 있다. 인공지능이 인프라 수준의 탄력성과 리스크 저항성을 확보할 때 비로소 그 가치가 진정으로 고착화될 수 있다는 것이다.

클라우드 기반 대형 모델은 종합 능력 면에서 우수하지만, 플랫폼 리스크, 가격 책정 리스크, 정책 규제 리스크, 네트워크 지연 리스크, 데이터 라우팅 리스크를 내재하고 있다. 반면 로컬 AI 모델은 일부 성능을 희생하더라도 소유권, 프라이버시, 그리고 지속 가능한 안정성을 확보한다.

이러한 선택 로직은 암호화폐 산업의 철학과 높은 수준에서 일치한다. 자기 관리(Self-custody)는 거래소 관리보다 편의성이 떨어질 수 있지만, 거래소의 폭락 리스크가 현실화될 때야 그 가치를 깨닫게 된다. 마찬가지로 로컬 AI는 클라우드 기반 모델보다 사용이 다소 복잡할 수 있지만, 네트워크 중단, API 인터페이스 변경, 계정 정지, 데이터 유출 제한 등의 상황이 발생하면 로컬 배포의 강점이 명확히 드러난다.

QVAC: 엣지 AI 아키텍처라는 차별화된 신규 분야 개척

QVAC의 핵심 차별점은 하위 아키텍처에 있다. OpenAI, Anthropic, 구글 딥마인드(Google DeepMind), xAI 등 최정상급 대형 모델은 모두 일반적 능력, 코딩 능력, 멀티모달 상호작용, 초장문 컨텍스트 추론, 에이전트 기반 애플리케이션, 기업용 클라우드 배포 등에서 경쟁하고 있다.

그러나 QVAC은 완전히 다른 분야를 선택했다. 즉, 배포 가능성(Deployability), 프라이버시 보호, 저지연성, 조합성(Composability), 단일 플랫폼에 의존하지 않는 독립적 생존 능력이다.

QVAC 공식 입문 문서는 이 프로젝트를 오픈소스·크로스플랫폼 생태계로 정의하며, 로컬 우선 실행 및 P2P 기반 AI 애플리케이션을 핵심으로 한다. Linux, macOS, Windows, 안드로이드, iOS 등 모든 운영체제를 지원한다. 사용자는 로컬에서 대규모 언어 모델(LLM), 음성 인식, 검색 강화 생성(RAG) 등 다양한 AI 작업을 실행할 수 있으며, 내장된 P2P 기능을 통해 추론 작업을 다른 기기 노드에 위임할 수도 있다.

이는 QVAC의 비교 기준이 최정상급 클라우드 AI 대형 모델과 근본적으로 다르다는 것을 의미한다. 선두 AI는 중앙화 서비스가 제공할 수 있는 최강의 일반적 모델 능력을 추구하는 반면, QVAC은 추론이 일어나는 위치, 실행 제어권, 데이터가 기기 내부에 남는지 여부, 중앙화 서비스가 중단되었을 때 애플리케이션이 지속적으로 작동할 수 있는지 여부에 집중한다.

테더는 2026년 4월 QVAC 소프트웨어 개발 키트(SDK)를 출시했다. 이 SDK는 통합 개발 툴킷을 제공하여 개발자가 임의의 기기에서 AI 애플리케이션을 구축·실행·마이크로튜닝(micro-tuning)할 수 있도록 지원하며, 코드 수정 없이 모든 플랫폼 시스템에 적합하다.

QVAC SDK는 통합 추상 계층을 기반으로 다양한 로컬 추론 엔진을 호환한다. 여기에는 자사 개발 QVAC Fabric, llama.cpp의 분기 버전뿐 아니라 whisper.cpp, Parakeet, Bergamot 등 음성 및 번역 도구도 포함된다.

이 SDK는 단순한 모델 출시를 넘어, 인공지능의 하위 운영체제(OS)에 가까운 존재이다. 현재 오픈소스 AI 생태계는 이미 Llama, Qwen, Mistral, Gemma, DeepSeek, Hugging Face, llama.cpp, Ollama 등 다수의 성숙한 로컬 추론 프로젝트를 갖추고 있다.

QVAC의 핵심 베팅은 개발자들이 로컬 모델 로딩, 추론 연산, 음성 인식, OCR(광학문자인식), 번역, 텍스트-이미지 생성, RAG, P2P 기반 모델 배포, 위임 추론, 로컬 마이크로튜닝 등 전 과정을 단일 인터페이스로 통합할 수 있는 완전한 엣지 단 프레임워크를 절실하게 필요로 한다는 것이다.

QVAC는 지능형 연산 능력의 배포 인프라가 되고자 하며, 지속적으로 개선되는 중급 로컬 모델을 기반으로 엣지 AI 생태계의 진입점을 선점하려 한다.

QVAC Fabric은 전체 기술 아키텍처의 핵심이다. 테더는 Fabric이 Vulkan 및 Metal 백엔드를 활용해 주류 소비자용 하드웨어에서 모델 마이크로튜닝을 수행할 수 있다고 밝혔다. 이는 퀄컴 아드레노(Adreno), ARM 말리(Mali) GPU가 탑재된 안드로이드 기기, 애플 자체 칩 기기, AMD·인텔·엔비디아 하드웨어가 장착된 Windows 및 Linux PC 등 다양한 환경을 지원한다.

또한 모바일 기기의 VRAM 제약을 고려해 동적 블록 분할(Dynamic Chunking) 기술을 적용하였으며, GPU 가속 LoRA 마이크로튜닝 및 마스크 손실 지시어 튜닝(Masked Loss Instruction Tuning)도 지원한다.

만약 이 워크플로우가 외부 개발자들에 의해 실증 검증된다면, 그 가치는 단순한 오픈소스 모델 출시를 훨씬 넘어서게 될 것이다. 모델 가중치(Weights)는 단지 기초 계층일 뿐이며, 로컬에서의 개인화된 마이크로튜닝 및 적응이 진정한 핵심 부가가치이다.

MedPsy: QVAC의 첫 번째 실력 검증 시험대

MedPsy는 QVAC이 첫 번째로 실제 구현한 벤치마크급 모델 제품이다. 5월 7일 허깅페이스(Hugging Face)에 공개된 기술 보고서에 따르면, QVAC MedPsy는 엣지 단 배포를 위해 특화된 의료 건강 분야 언어 모델로, 17억 파라미터와 40억 파라미터 두 가지 버전으로 출시되었다.

공식 발표는 매우 혁신적인 주장을 담고 있다. 엄격한 의료 분야 전용 사후 학습을 거친 소형 모델이 대형 의료 벤치마크 모델을 능가할 수 있으며, 동시에 노트북, 고사양 모바일 기기, 심지어 스마트폰에서도 실행 가능하다는 것이다.

QVAC에 따르면, MedPsy-1.7B는 7개의 폐쇄형 의료 벤치마크 테스트에서 평균 62.62점을 기록해, 파라미터 규모가 두 배 이상 큰 구글 MedGemma-1.5-4B-it(51.20점)을 크게 앞섰다. 또 MedPsy-4B는 평균 70.54점을 기록해 MedGemma-27B-text-it(69.95점)을 소폭 상회했으며, 파라미터 규모는 상대의 1/7에 불과하다.

HealthBench 및 고난이도 HealthBench Hard 테스트에서는 격차가 더욱 벌어졌다. MedPsy-4B는 각각 74.00점, 58.00점을 획득한 반면, MedGemma-27B-text-it은 65.00점, 42.67점에 그쳤다.

만약 이러한 벤치마크 결과가 제3자에 의해 재현된다면, QVAC의 핵심 철학—즉, 특정 고부가가치 수직 분야에서는 경량화된 엣지 모델이 초대형 클라우드 시스템을 도전할 수 있다는 주장—이 직접적으로 입증되는 것이다.

훈련 프로세스 역시 QVAC의 경쟁 전략을 잘 보여준다. MedPsy는 퉁이첸(Tongyi Qwen) 3를 골격 모델로 삼았으며, 다단계 감독 학습 마이크로튜닝과 의료 질의응답 강화학습을 통해 반복적으로 최적화하였다. 실험 과정에서 3,000만 개 이상의 합성 데이터가 생성되었고, 2단계 커리큘럼 학습이 적용되었으며, 장문 추론 감독 교사 모델로 백촨(Baichuan) M3-235B 대형 모델이 활용되었다.

현재 훈련 데이터셋은 공개되지 않았으며, 이것이 핵심 논란점이다. 현재 눈에 띄는 벤치마크 성적은 모두 QVAC 내부 평가에서 나온 것으로, 훈련 데이터 오염 여부, 커버리지 범위, 프롬프트 구성 방식, 교사 모델의 영향 등 핵심 요소는 여전히 외부 검증이 필요하다.

양자화 배포 측면에서는 뚜렷한 이점이 있다. 공식적으로 llama.cpp 및 QVAC SDK에 호환되는 GGUF 양자화 버전이 출시되었으며, Q4_K_M 양자화를 적용하면 모델 크기를 69% 줄일 수 있고, 평균 점수 손실은 1점 미만이다. 용량과 성능을 동시에 고려한 최적의 솔루션에서, 40억 파라미터 모델은 단 2.72GB, 17억 파라미터 모델은 1.28GB에 불과해 로컬 기기에 쉽게 배포할 수 있다.

QVAC 공식 입장은 MedPsy가 텍스트 상호작용만 지원하며, 영문만 지원하며, 임상 응급 상황에는 사용할 수 없으며, 대형 언어 모델 고유의 환각(Hallucination) 문제가 존재하며, 개발자가 애플리케이션 전체 아키텍처에서 사용자 프라이버시 보안을 책임져야 한다고 명시하고 있다.

의료 분야 자체가 로컬 추론에 대한 강력한 수요를 지니고 있으므로, MedPsy의 전망은 기대를 모으고 있다. 그러나 그 진정한 실력을 입증하려면 외부 연구자들의 벤치마크 재현과 실제 임상 프로세스에서의 실사용 테스트가 반드시 이루어져야 한다.

편의성 vs 통제권: AI 산업의 궁극적 경쟁

로컬 AI와 클라우드 AI 간 논쟁은 종종 프라이버시와 성능 사이의 이분법으로 단순화되곤 한다. 그러나 QVAC은 이 논리를 재구성하며, 본질적으로 ‘편의성’과 ‘자율적 통제권’ 사이의 선택 문제임을 드러낸다.

클라우드 AI는 극도의 편의성에서 우위를 점한다. 사용자는 애플리케이션을 열고 명령어를 입력하면 결과를 즉시 얻을 수 있으며, 모델 가중치, 기기 VRAM, 양자화 파라미터, 벡터 임베딩, 실행 환경 호환성 등 복잡한 기술적 문제를 고민할 필요가 없다. 플랫폼이 모든 기술적 복잡성을 대신 처리해주기 때문이다. 극단적인 편의성은 바로 중앙집권형 AI 플랫폼이 급성장할 수 있었던 핵심 이유이며, 사용자는 최소한의 진입 장벽으로 최첨단 지능을 누릴 수 있다.

반면 QVAC은 개발자와 사용자에게 더 많은 운영 책임을 요구한다. 그 대가로 새로운 보안 아키텍처를 제공한다. 즉, 로컬 오프라인 실행, 네트워크 단절 시에도 작동 가능, 데이터 외부 유출 최소화, API 의존도 해소, 그리고 P2P 기반 추론 및 모델 배포 채널 확보 등이다.

테더 SDK 소개에 따르면, QVAC을 탑재한 애플리케이션은 약한 네트워크 환경에서도 안정적으로 작동하며, 심지어 네트워크가 완전히 끊긴 상태에서도 인공지능이 정상 작동한다. 2025년 QVAC 초기 공고에서는 AI 에이전트를 직접 로컬 기기에 배포하고, 기기 간 P2P 네트워크를 통해 협업 상호작용을 수행하도록 계획했으며, WDK 툴킷을 활용하면 AI 에이전트가 비트코인 및 USDT 자산 거래를 자율적으로 수행할 수 있도록 설계되었다.

이것이 바로 테더의 완전한 최상위 전략 로직이다. 자금, 연산 능력, 지능형 에이전트—all이 동일한 자율 주권(autonomous sovereignty) 설계 패러다임을 따르는 것이다.

물론, 이 탈중앙화 서사는 결함 없이 완벽하지 않다. 사용자가 모델을 직접 다운로드하고 로컬에서 실행하며 민감한 데이터를 기기에 보관한다는 점에서, QVAC은 추론 계층에서 높은 수준의 탈중앙화를 달성했다. 이는 호스팅형 API와 달리, 매번의 상호작용 명령어가 플랫폼에 의해 통제되지 않음을 의미한다. Holepunch 네트워크 아키텍처를 기반으로 QVAC은 위임 추론 및 탈중앙화 모델 배포 등 P2P 하위 기능도 지원하며, 아키텍처 설계 측면에서 실질적인 혁신을 보여준다.

그러나 거버넌스 측면에서는 여전히 중앙집권적 속성이 존재한다. QVAC은 테더가 전액 출자하고, 명명·총괄·마케팅을 주도하며, 플래그십 애플리케이션, 모델 체계, SDK 로드맵, ‘안정적인 지능’ 철학 등 전부 단일 기업이 주도한다.

이 현상은 QVAC의 ‘로컬 우선’ 핵심 가치와 모순되지 않지만, 탈중앙화 이점을 가장 탄탄한 증거가 있는 추론 실행 계층에 한정시킨다는 점을 의미한다. 전체 생태계는 여전히 기본 등록 노드, 버전 배포 채널, 보안 규범, 모델 승인 기준, 장기 커뮤니티 거버넌스 등 다양한 측면에서 분산형 관리 메커니즘을 단계적으로 구축해 나가야 한다.

재현 테스트가 QVAC의 최종 위상을 결정한다

현재 QVAC의 신뢰도는 전적으로 제3자 재현 결과에 달려 있다. 만약 MedPsy의 벤치마크 점수가 외부 평가 환경에서 재현된다면, 테더는 비로소 ‘지능형 자산 보유’ 철학을 실제로 구현하게 된다. 즉, 경량화·오픈소스·로컬 배포 가능한 수직 분야 모델이 고민감 분야에서 클라우드 초대형 모델과 어깨를 나란히 할 수 있다는 것을 입증하게 되는 것이다.

비록 제3자 테스트에서 벤치마크 점수가 축소되거나 오히려 역전되더라도, QVAC의 인프라 가치는 여전히 유효하다. 다만 모델 성능에 관한 서사가 약화될 뿐이다. 산업의 궁극적 질문은 여전히 기술의 오랜 법칙으로 돌아간다. 즉, 극단적인 편의성은 권력의 집중을 낳고, 자율적 통제권은 운영 비용을 치러야 한다는 것이다.

이것이 바로 아시모프의 공상과학 철학이 지닌 가치이다. 『파운데이션』의 심리사학은 압박 상황 하에서 복잡한 대규모 시스템의 진화 법칙을 연구한다. 테더는 이 개념에 새로운 함의를 부여하며, 인프라가 어떻게 중앙집권적 독점에 저항할 수 있는지를 집중 조명한다.

공상과학 서사는 거대한 구도를 지니고 있지만, 기술 실현은 아직 초기 단계에 불과하다. 그럼에도 전체 전략 로직은 명확하고 내재적으로 일관성을 갖춘다. 테더는 전 세계 최대 안정화 코인에서 발생하는 지속적인 현금 흐름을 바탕으로, 로컬 실행, P2P 네트워크, 오픈소스 도구, 엣지 경량화 모델을 핵심으로 하는 AI 아키텍처를 구축하고 있으며, 안정화 코인의 자율 주권 철학을 통화 분야에서 지능 분야로 확장시키고 있다.

이제 업계는 안정화 코인 거대 기업이 AI 분야에 진출할 역량이 있는지 여부를 더 이상 의문시하지 않는다. 그 답변은 명백하다.

진짜 핵심 질문은, QVAC이 충분히 강력한 모델과 인프라를 구축해, 사용자들이 로컬에서의 자율 통제를 위해 약간의 운영 장벽을 기꺼이 감수하겠느냐는 것이다.

MedPsy는 바로 그 첫 번째 측정 가능한 장벽이다. 제3자 재현 결과는 QVAC의 심리사학 서사가 결국 공상과학적 은유에 머무를 것인지, 아니면 주류 엣지 AI 분야에 진정으로 진입해 완전한 운영 로직을 갖춘 하위 인프라 아키텍처로서 자리매김할 것인지를 결정할 것이다.

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News