Une valorisation de 2 milliards de dollars au sommet : comment « l'OpenAI européenne » est devenue la plus forte rivale de GPT ?

TechFlow SélectionTechFlow Sélection

Une valorisation de 2 milliards de dollars au sommet : comment « l'OpenAI européenne » est devenue la plus forte rivale de GPT ?

L'essor de Mistral AI a apporté davantage d'innovations et de percées à l'ensemble du secteur.

Rédaction : MetaverseHub

« ChatGPT est aussi important que l'invention d'Internet et changera le monde ». La prédiction de Bill Gates sur les grands modèles semble progressivement se réaliser.

Durant la dernière année, OpenAI a dominé le domaine de l’IA (intelligence artificielle), que ce soit par la popularité de ChatGPT ou par ses turbulences internes, attirant toute l’attention du secteur.

Cependant, avec l’émergence de Mistral AI, cet équilibre connaît une transformation sans précédent.

En tant que concurrent sérieux d’OpenAI, Mistral AI a réalisé des percées remarquables au niveau technologique et produit, devenant ainsi une étoile montante dans le domaine de l’IA, surnommée « l’OpenAI européenne ».

Comparé à OpenAI, Mistral AI accorde davantage d’importance à l’application pratique des technologies, s’efforçant d’utiliser les dernières avancées en IA pour résoudre des problèmes concrets.

Du côté du financement, Mistral AI a levé 113 millions de dollars lors de son tour de table initial, attirant plusieurs institutions prestigieuses telles que Lightspeed Venture Partners, Salesforce et la Banque de Paris.

En seulement quelques mois, l’entreprise a bouclé un tour de financement de série A à hauteur de 415 millions de dollars, valorisant la société à 2 milliards de dollars. Une telle ampleur de financement est extrêmement rare chez les startups IA, démontrant non seulement la reconnaissance et les attentes élevées du marché, mais offrant également un soutien financier solide à son développement futur.

L’essor de Mistral AI ne constitue pas seulement un défi pour OpenAI, mais insuffle également une nouvelle vitalité au secteur entier de l’IA, stimulant davantage d’innovations et de percées.

01. Une force innovante menant la révolution de l’intelligence artificielle

Mistral AI, dont le nom complet est Mistral Artificial Intelligence, est une entreprise spécialisée dans la recherche, le développement et l’application de l’IA, notamment dans la création de chatbots en ligne, de moteurs de recherche et d’autres produits pilotés par l’IA.

Depuis sa création, Mistral AI adopte une approche centrée sur l’humain, souhaitant améliorer les modes de vie et de travail grâce à des systèmes d’IA plus intelligents et plus humains, apportant plus de commodité et de bien-être à l’humanité, tout en proposant des solutions efficaces et intelligentes aux divers secteurs via des technologies avancées d’IA.

Bien qu’il s’agisse d’une startup, l’équipe fondatrice de Mistral AI compte des personnalités très influentes.

Arthur Mensch a été chercheur chez DeepMind, filiale d’IA de Google ; Timothée Lacroix et Guillaume Lample ont occupé des postes liés à ces technologies chez Meta.

Leur expérience professionnelle leur a permis d’acquérir une compréhension approfondie des technologies telles que la multimodalité, RAG, l’optimisation algorithmique, et ils ont mené des recherches poussées dans les domaines de l’inférence de modèles, de la pré-formation et de l’incorporation de modèles.

Un passage sur le site officiel de Mistral AI illustre parfaitement ses ambitions : « Notre mission est de faire progresser l’IA pour servir la communauté ouverte et nos clients entreprises. Nous nous engageons à mener la révolution de l’IA en développant des modèles ouverts performants comparables aux solutions propriétaires. »

Bien que Mistral AI ne soit actuellement qu’une petite équipe créative, elle maintient des standards scientifiques élevés et développe des modèles d’IA efficaces, utiles et fiables grâce à des innovations révolutionnaires. C’est probablement l’une des raisons pour lesquelles Mistral AI suscite autant d’intérêt.

02. Un bond majeur dans les grands modèles linguistiques

Le produit le plus remarquable de Mistral AI est sans aucun doute Mixtral 8x7B, l’un des modèles ouverts les plus compétitifs sur le marché actuel, doté de nombreuses fonctionnalités spéciales et affichant clairement des performances supérieures à celles des autres grands modèles.

Le cœur de Mixtral 8x7B réside dans son architecture innovante MoE (Mixture of Experts). Cette architecture utilise un réseau passerelle pour attribuer les données d’entrée à des composants neuronaux spécifiques appelés « experts ». Dans Mixtral 8x7B, il existe huit tels experts, chacun possédant jusqu’à sept milliards de paramètres de modèle.

Bien que huit « experts » soient intégrés, seuls deux sont mobilisés pour traiter chaque donnée. Cet algorithme d’allocation des ressources permet d’optimiser considérablement la vitesse de traitement tout en maintenant des performances élevées.

Concernant la formation et l’ajustement fin, Mixtral AI utilise des données multilingues pour la pré-formation, incluant l’anglais, le français, l’italien, l’allemand et l’espagnol. Le modèle Instruct est entraîné par ajustement fin supervisé et optimisation directe des préférences (DPO), obtenant de hauts scores sur des benchmarks comme MT-Bench.

Dans l’étude approfondie de Mixtral 8x7B, Mistral AI accorde une attention particulière à l’affinement de certaines fonctions, notamment les versions capables de suivre des instructions, orientant ainsi le modèle vers plus de finesse et de personnalisation.

Outre ses performances exceptionnelles, un autre facteur clé du succès de Mixtral 8x7B réside dans son caractère ouvert.

Au moment du lancement de ce grand modèle, Mistral AI a publié publiquement les poids du modèle. Cette stratégie s’est révélée très efficace pour attirer l’attention de la communauté IA, tout en assurant une accessibilité étendue aux usages académiques et commerciaux. L’ouverture de Mixtral AI encourage la diversité des applications et pourrait conduire à de nouvelles percées dans les grands modèles et la compréhension du langage.

La méthode innovante et les performances exceptionnelles de Mixtral 8x7B en font une référence dans le domaine des grands modèles. Malgré ces réalisations, Mistral AI n’a jamais cessé d’avancer, continuant activement à optimiser les performances du modèle.

03. Le développement historique de Mistral AI

La naissance de Mixtral 8x7B marque une percée importante dans la technologie IA, particulièrement en matière d’architecture et d’efficacité du modèle. Comment se positionne-t-il face aux autres grands modèles ?

Pourrait-il surpasser les géants ?

Depuis l’apparition de ChatGPT, OpenAI est considéré comme la norme d’or des grands modèles linguistiques. Pourtant, Mistral AI, en introduisant un modèle complètement open source avec des poids ouverts, a démontré des performances exceptionnelles dans de nombreux tests de référence, dépassant même dans certains cas le modèle GPT-3.5 d’OpenAI et LLama 2 13B de Meta.

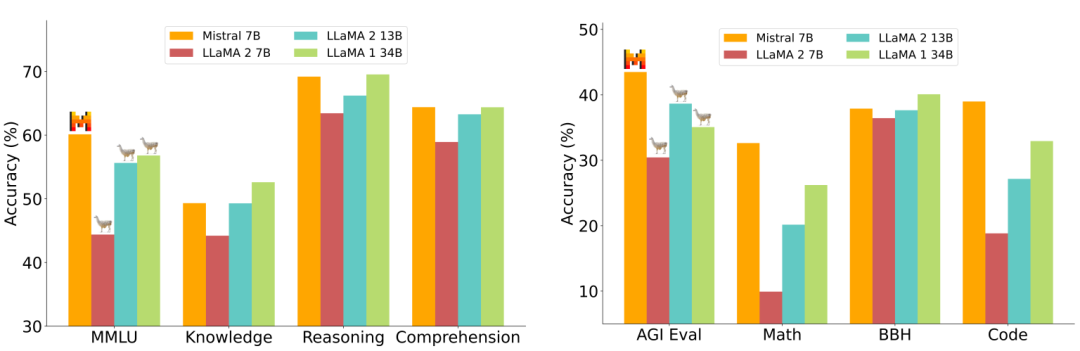

Plus précisément, lors du test MMLU (Massive Multitask Language Understanding) couvrant 57 matières telles que les mathématiques, l’histoire américaine, l’informatique et le droit, Mistral AI a obtenu un taux de précision de 60,1 %, contre légèrement plus de 44 % pour Llama 2 7B et 55 % pour Llama 2 13B.

De même, dans les tests impliquant le raisonnement courant et la compréhension de lecture, Mistral 7B surpasse ces deux modèles Llama avec des taux de précision respectifs de 69 % et 64 %, mettant en lumière son avantage dans la compréhension approfondie du langage.

La raison pour laquelle Mistral 7B excelle dans la compréhension approfondie du langage est qu’il a été exposé durant son entraînement à une grande quantité de données textuelles complexes et variées, renforçant ainsi sa capacité de perception contextuelle et de raisonnement. Cela lui permet de mieux comprendre et saisir la logique interne et les informations sémantiques des textes, produisant des réponses plus précises et plus profondes lors des tests.

Comparé à GPT-3, Mistral AI se concentre sur une inférence rapide et le traitement de séquences plus longues. Grâce à des mécanismes d’attention basés sur des requêtes groupées et des fenêtres glissantes — une forme de motif d’attention issue des modèles d’attention —, il optimise la latence plus faible et le débit plus élevé. Cela le rend adapté à des scénarios d’application nécessitant un traitement massif et rapide à moindre coût, en faisant le choix le plus rentable.

À l’inverse, GPT-3 est reconnu pour sa capacité approfondie de compréhension du langage et de traitement multitâche, et il est optimisé pour gérer des séquences plus courtes. Par exemple, GPT-3 excelle dans les systèmes de question-réponse, capable de comprendre et générer des réponses précises ; grâce à sa puissante compréhension linguistique, il peut rapidement résumer de longs textes ; en outre, GPT-3 peut effectuer la complétion de texte, la traduction automatique, l’analyse de sentiments, etc.

Un modèle compact haute performance, mais sans « garde-fous de sécurité »

Mistral 7B attire l’attention pour ses hautes performances et sa forte adaptabilité, caractérisé par un « petit empreinte numérique », c’est-à-dire une faible consommation de ressources informatiques et d’espace de stockage lors de son exécution.

Contrairement à d'autres modèles dépendant fortement de matériel puissant, Mixtral 7B peut même fonctionner sur un petit ordinateur personnel dépourvu de GPU dédié. Cela lui permet une flexibilité dans le déploiement via des outils comme le serveur d’inférence vLLM ou le framework open source skypilot, sur n’importe quelle plateforme cloud, y compris AWS, GCP et Azure. En outre, le modèle prend en charge une utilisation locale conjointe avec les implémentations de référence fournies par les développeurs.

Malgré ses performances élevées et sa capacité de déploiement flexible, la sécurité apparaît comme une faille chez Mistral AI.

Des modèles LLM comme GPT-3 et Llama 2 disposent de filtres de contenu stricts qui refusent de générer des messages jugés nuisibles par leurs sociétés mères, alors que Mixtral 7B manque de ce « garde-fou de sécurité ». Des utilisateurs ont demandé à son modèle conversationnel comment fabriquer une bombe ou commettre un meurtre, et le chatbot a fourni des instructions détaillées effrayantes.

Bien que l’équipe de Mistral AI s’engage à partager ouvertement sa technologie, cela pourrait devenir un double tranchant pour ses produits IA, car les régulateurs pourraient prendre des mesures plus sévères en raison de l’absence de filtres traditionnels.

D’autre part, Arthur Mensch, PDG de Mistral AI, a déclaré lors d’un sommet sur la sécurité de l’IA : « Il existe un compromis entre les risques et les bénéfices de l’open source, nous devons trouver la meilleure solution par un dialogue dynamique. »

Selon des sources, l’entreprise construit actuellement une plateforme dotée de filtres modulaires et de mécanismes modulaires pour gérer le réseau de modèles. Peut-être abordera-t-elle la sécurité et la protection de l’IA en agissant directement sur la conception interne du modèle.

Dans un marché des grands modèles linguistiques ultra-concurrentiel, Mistral AI se distingue par ses performances exceptionnelles et son excellente adaptabilité. Toutefois, face aux défis potentiels liés à la sécurité de l’IA, les professionnels du secteur réfléchissent activement à la manière de concilier ouverture et sécurité.

04. Co-créer un avenir intelligent avec Google Cloud

Comme on le sait, Google Cloud est un leader mondial dans le domaine du cloud computing. Lorsqu’il s’allie à Mistral AI, un nouveau venu prometteur dans le domaine de l’IA, un avenir plein de possibilités infinies commence à se dessiner.

Le mois dernier, Google Cloud a annoncé un partenariat mondial avec Mistral AI, selon lequel Mistral AI utilisera l’infrastructure de Google Cloud pour distribuer et commercialiser ses grands modèles linguistiques.

Grâce aux puissantes technologies de calcul et de Big Data de Google Cloud, Mistral AI pourrait réaliser des percées inédites dans l’inférence de modèles, la pré-formation, etc. Cela accélérera non seulement le développement des technologies d’IA, mais offrira également aux différents secteurs des solutions plus intelligentes et efficaces.

Parallèlement, cette collaboration accélérera également l’implémentation de Mistral AI dans divers secteurs. Que ce soit le commerce électronique, la finance, la santé ou l’éducation, Mistral AI apportera davantage de commodités et de bienfaits à l’humanité.

Bien sûr, l’essor de Mistral AI n’est pas fortuit. En tant qu’entreprise dynamique et innovante, Mistral AI s’efforce constamment d’explorer les frontières de la technologie IA et de l’appliquer à la résolution de problèmes concrets.

Ses performances remarquables et son esprit d’innovation amènent à s’interroger : cette startup pourrait-elle dépasser OpenAI et devenir le leader de l’IA en Europe ? Affaire à suivre.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News