AI 에이전트를 직접 만들고 싶으신가요? 대규모 언어 모델 가이드를 잘 챙기세요

저자: superoo7

번역: TechFlow

나는 거의 매일 비슷한 질문을 받는다. 20개 이상의 AI 에이전트를 구축하고 수많은 테스트 모델에 막대한 비용을 투입한 후, 나는 실제로 효과 있는 경험들을 정리할 수 있었다.

다음은 적합한 LLM을 선택하는 방법에 대한 완전한 가이드이다.

현재 대규모 언어 모델(LLM) 분야는 매우 빠르게 변화하고 있다. 거의 매주 새로운 모델이 출시되며, 각각 자신이 "최고"라고 주장한다.

하지만 현실은 이렇다. 모든 요구사항을 만족시키는 단 하나의 모델은 존재하지 않는다.

각 모델은 고유한 사용 사례가 있다.

나는 수십 가지의 모델을 직접 테스트했으며, 내 경험을 통해 여러분이 시간과 돈을 낭비하는 것을 막고자 한다.

명확히 밝히자면, 이 글은 실험실 기준 벤치마크나 마케팅 자료에 근거한 것이 아니다.

지난 2년간 직접 AI 에이전트와 생성형 AI(GenAI) 제품을 구축하며 얻은 실제 경험을 공유하는 것이다.

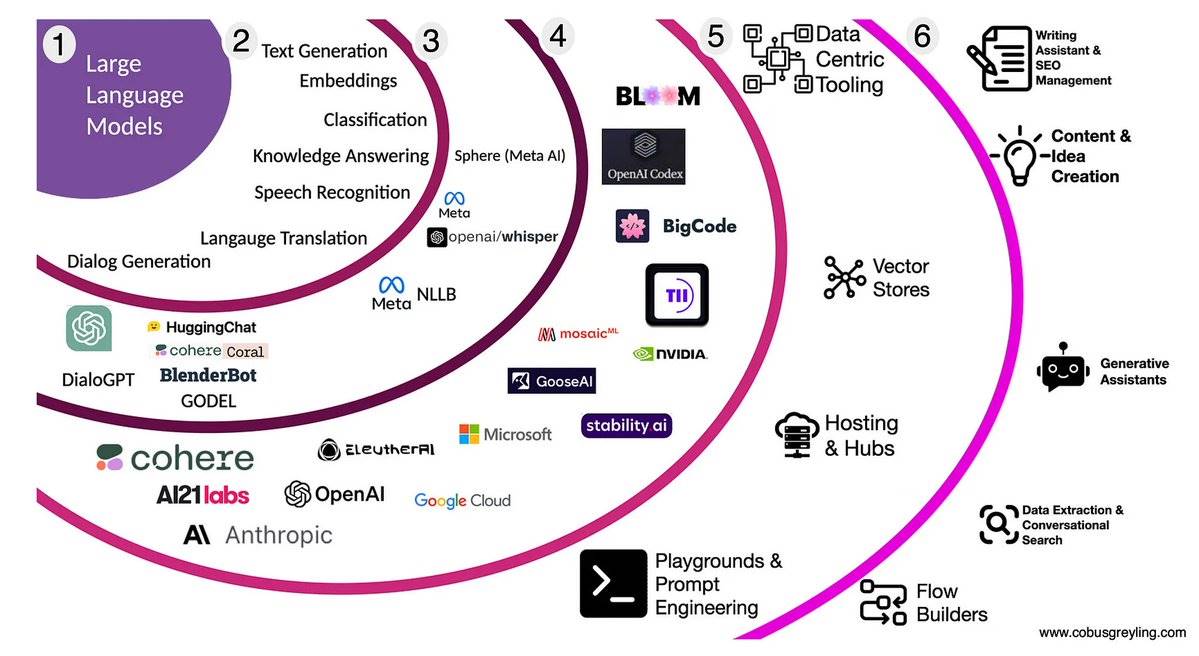

우선, LLM이 무엇인지 이해해야 한다.

대규모 언어 모델(LLM)은 컴퓨터에게 '사람처럼 말하기'를 가르치는 것과 같다. 입력된 내용을 바탕으로 다음에 가장 가능성이 높은 단어를 예측한다.

이 기술의 시작점은 바로 이 고전 논문이다: Attention Is All You Need

기초 지식 — 폐쇄형 소스와 개방형 소스 LLM:

-

폐쇄형 소스: 예를 들어 GPT-4와 Claude로, 일반적으로 사용량 기반 과금이며 제공업체가 호스팅하여 운영한다.

-

개방형 소스: 예를 들어 메타(Meta)의 Llama와 Mixtral로, 사용자가 직접 배포하고 운영해야 한다.

처음 접하면 이러한 용어들이 혼란스러울 수 있지만, 두 시스템의 차이를 이해하는 것은 매우 중요하다.

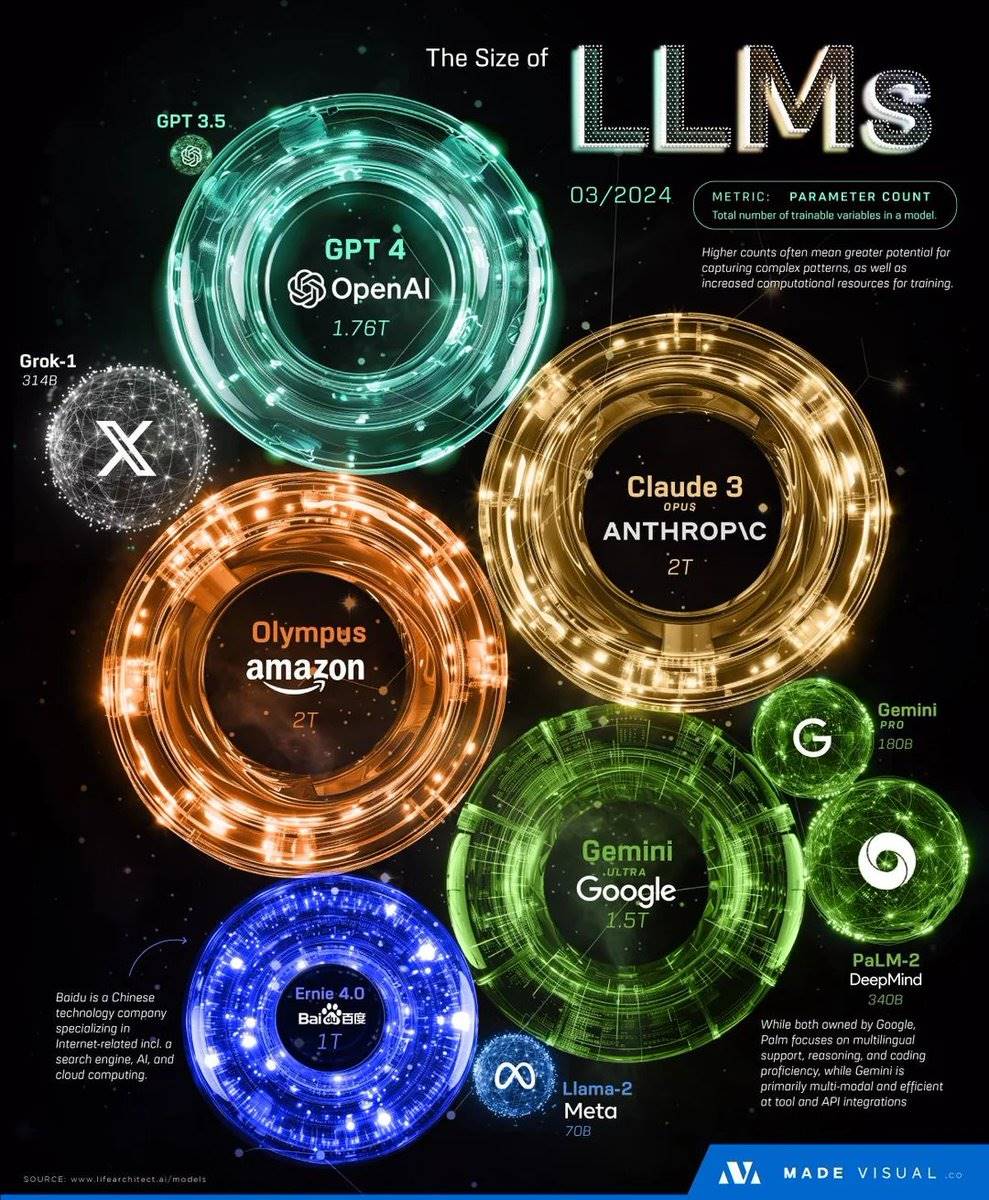

모델 크기가 곧 더 나은 성능을 의미하지는 않는다:

예를 들어 7B는 모델이 70억 개의 파라미터를 가졌다는 의미이다.

하지만 더 큰 모델이 항상 더 좋은 성능을 내는 것은 아니다. 핵심은 자신의 구체적인 요구에 맞는 모델을 선택하는 것이다.

X/Twitter 봇이나 소셜 AI를 구축하려는 경우:

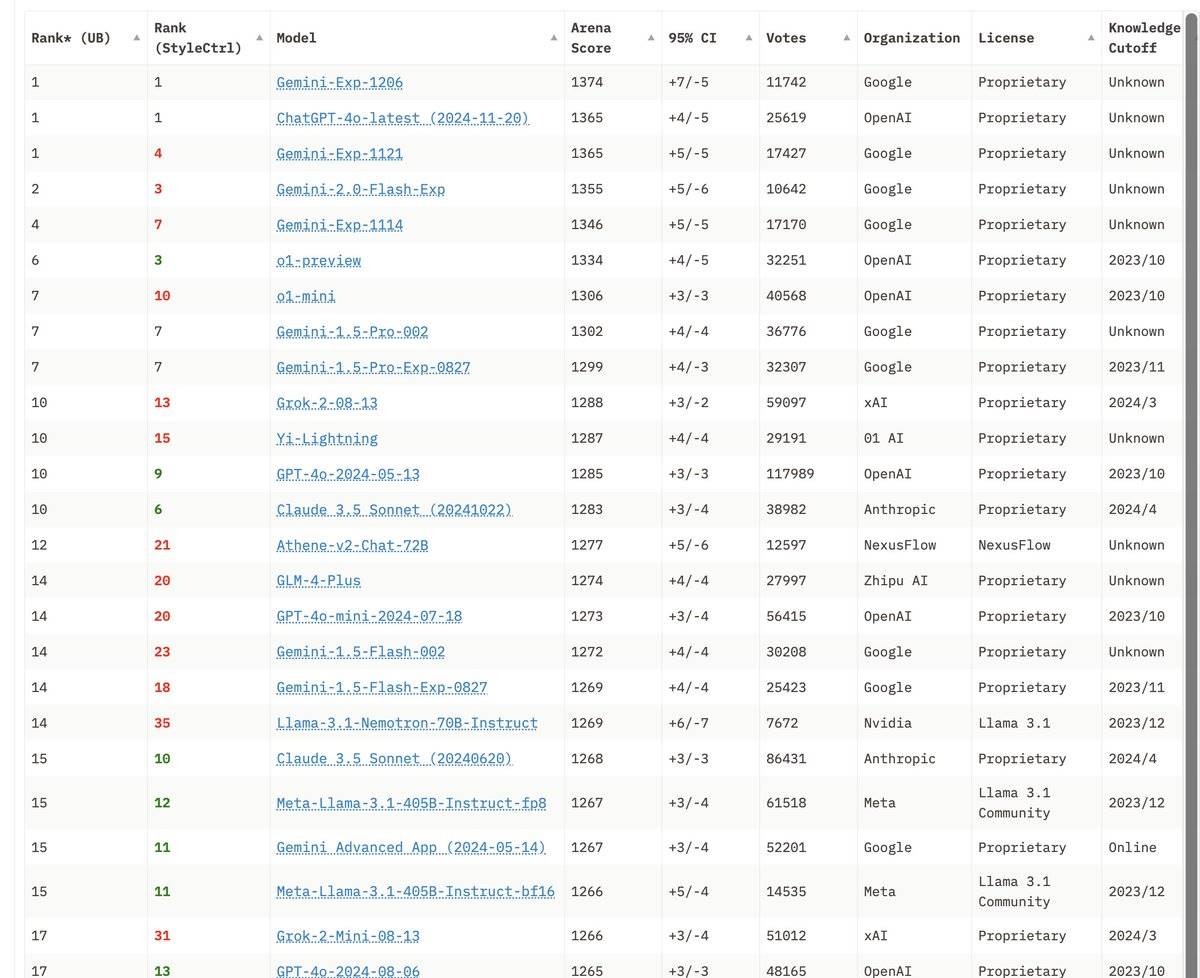

@xai의 Grok는 매우 훌륭한 선택이다:

-

여유 있는 무료 이용 한도 제공

-

소셜 맥락 이해 능력이 뛰어남

-

폐쇄형 소스이지만 시도해볼 가치가 큼

입문 개발자에게 강력히 추천한다! (내부 정보:

@ai16zdao의 Eliza 기본 모델은 현재 XAI Grok을 사용 중이다)

다국어 콘텐츠를 처리해야 하는 경우:

@Alibaba_Qwen의 QwQ 모델은 우리의 테스트에서 특히 아시아 언어 처리 분야에서 매우 뛰어난 성능을 보였다.

단, 이 모델의 학습 데이터는 주로 중국 본토에서 수집되었으므로 일부 콘텐츠에서 정보 누락 현상이 발생할 수 있음을 유의해야 한다.

범용 목적 또는 추론 능력이 뛰어난 모델이 필요한 경우:

@OpenAI의 모델은 여전히 업계의 선두주자이다:

-

성능이 안정적이고 신뢰할 수 있음

-

광범위한 실사용 테스트를 거침

-

강력한 보안 메커니즘 보유

이는 대부분의 프로젝트에 이상적인 출발점이다.

개발자이거나 콘텐츠 제작자인 경우:

@AnthropicAI의 Claude는 내가 일상적으로 사용하는 주요 도구이다:

-

코딩 능력이 매우 탁월함

-

응답 내용이 명확하고 상세함

-

창의적 작업 처리에 매우 적합함

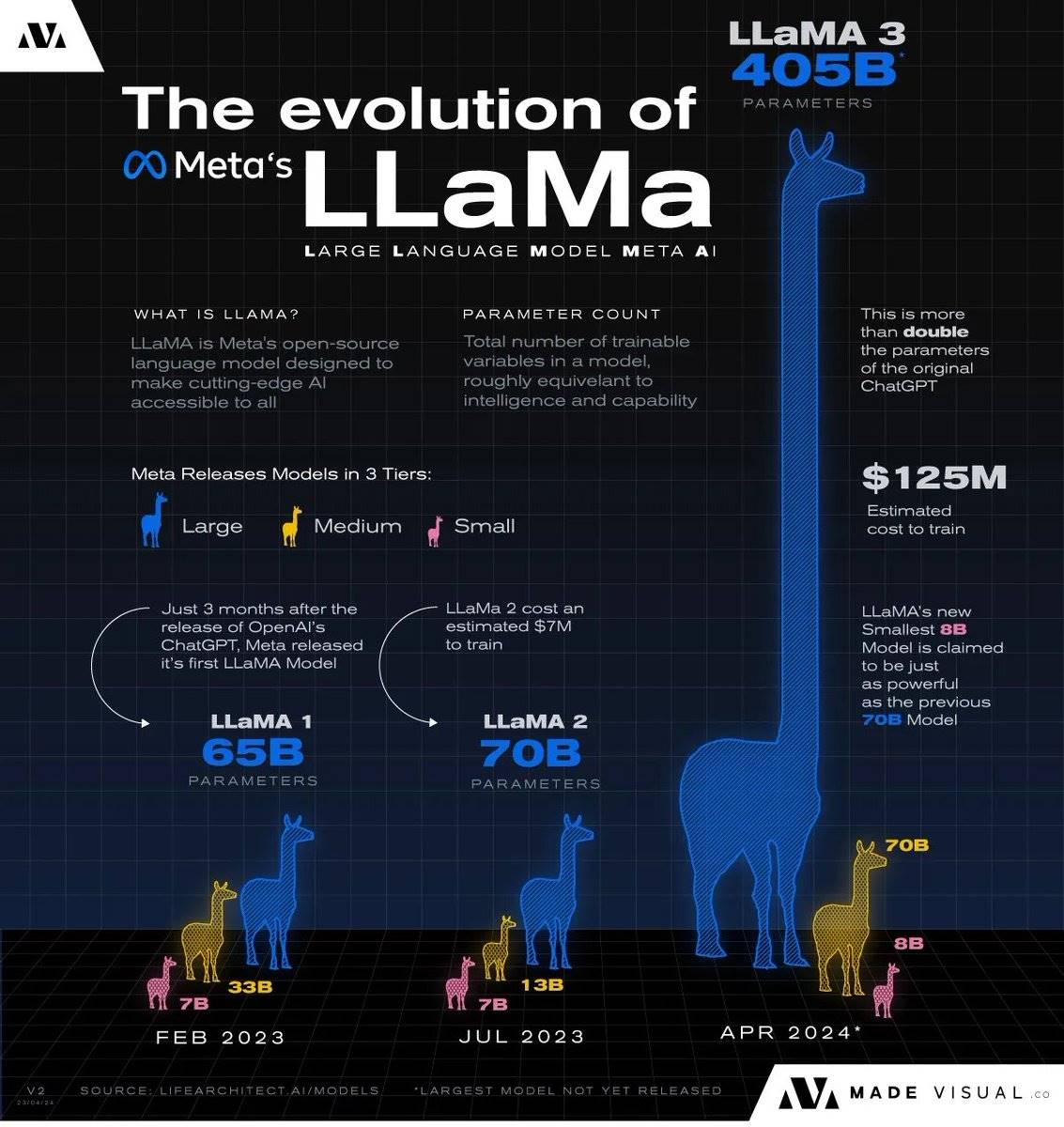

메타(Meta)의 Llama 3.3이 최근 큰 주목을 받고 있다:

-

성능이 안정적이고 신뢰할 수 있음

-

오픈소스 모델로 유연하고 자유로움

-

@OpenRouterAI 또는 @GroqInc를 통해 체험 가능

예를 들어, @virtuals_io 같은 암호화폐 x AI 프로젝트들이 이를 기반으로 제품을 개발하고 있다.

캐릭터 역할 수행(RP)용 AI가 필요하다면:

@TheBlokeAI의 MythoMax 13B는 현재 역할극 분야의 최강자로, 수개월 동안 관련 순위에서 꾸준히 상위권을 유지하고 있다.

Cohere의 Command R+는 과소평가된 훌륭한 모델이다:

역할극 작업에서 뛰어난 성능을 발휘함

복잡한 작업도 쉽게 처리 가능

최대 128,000 토큰의 긴 컨텍스트 윈도우를 지원하여 더 오랜 '기억력'을 가짐

Google의 Gemma 모델은 경량이면서도 강력한 선택지이다:

-

특정 작업에 특화되어 뛰어난 성능을 발휘함

-

예산 친화적임

-

비용에 민감한 프로젝트에 적합함

개인적인 경험: 나는 종종 작은 Gemma 모델을 AI 프로세스 내에서 '편향 없는 심판'으로 활용하는데, 검증 작업에서 매우 탁월한 효과를 보인다!

@MistralAI의 모델 또한 주목할 만하다:

-

오픈소스이면서도 고급 수준의 품질 제공

-

Mixtral 모델의 성능이 매우 강력함

-

특히 복잡한 추론 작업에 뛰어남

커뮤니티로부터 널리 호평받고 있으며, 반드시 시도해볼 가치가 있다.

전문 조언: 혼합 사용을 시도하라!

-

각 모델마다 장점이 다르다

-

복잡한 작업을 위해 AI '팀'을 구성할 수 있다

-

각 모델이 가장 잘하는 부분에 집중하게 하라

꿈의 팀을 구성하듯, 각 멤버가 고유한 역할과 기여를 할 수 있도록 하라.

빠르게 시작하는 법:

@OpenRouterAI 또는 @redpill_gpt를 사용해 모델을 테스트할 수 있다. 이 플랫폼들은 암호화폐 결제도 지원하여 매우 편리하다.

서로 다른 모델들의 성능을 비교하기 위한 훌륭한 도구이다.

비용을 절약하면서 로컬에서 모델을 실행하고 싶다면, @ollama를 사용해 자신의 GPU로 실험해보는 것도 좋다.

속도를 우선시한다면, @GroqInc의 LPU 기술은 매우 빠른 추론 속도를 제공한다:

-

모델 선택지는 제한적이지만

-

성능은 프로덕션 환경 배포에 매우 적합함

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News