TetherがローカルAIを発表——小規模モデルがクラウド上の大規模モデルと直接対決

TechFlow厳選深潮セレクト

TetherがローカルAIを発表——小規模モデルがクラウド上の大規模モデルと直接対決

計算能力、AIモデル、データセット、およびクラウド中心部から独立して実行可能な知能機能が、Tetherの第2の準備資産となりつつある。

執筆:Liam Akiba Wright

翻訳・編集:ルフィー、Foresight News

テザー(Tether)の新プロジェクト「QVAC」は、安定コイン企業としては極めて稀なコンセプトで幕を開けました。同社は、自社の「QVAC Psy」を、「心理史学(Psychohistory)の原理に基づく」一連の基盤大規模言語モデルと位置づけています。

「心理史学」という概念は、アイザック・アシモフの古典的SFシリーズ『ファウンデーション』に由来します。物語の主人公ハリー・シェルトンは、数学・統計学・社会力学を駆使して、大規模な集団の行動動向を予測し、銀河帝国崩壊後の「暗黒時代」の期間を短縮しようと試みます。

『SF百科事典』では、アシモフが描いた心理史学を「フィクション上の科学」と定義しています。シェルトンの全体構想は、未来の出来事を予測し、社会システムの崩壊時に人類の知識文明を保存することを目的としています。

テザーの今回の主張は、実質的に自社の企業使命をSF的な修辞で包んだものです。

準備資産・流動性・流通チャネルの強みを活かし、テザーは暗号資産業界最大規模の安定コインシステムを築きました。今やその基盤的なロジックを、人工知能(AI)分野へと転用しようとしています。

USDT安定コインは、テザーの第一の準備資産基盤を構成します。一方、計算能力(算力)、AIモデル、データセット、そしてクラウドへの依存を排除したローカル環境での自律的知能機能——これらが、テザーの第二の準備資産となりつつあります。

米ドル準備から「知能資産」準備へ

テザーのAI参入は、そのコア事業の運営ロジックを踏襲しています。USDTは、世界中のオフショア米ドル需要を、短期米国主権債を中心とする準備資産ポートフォリオへと変換しています。

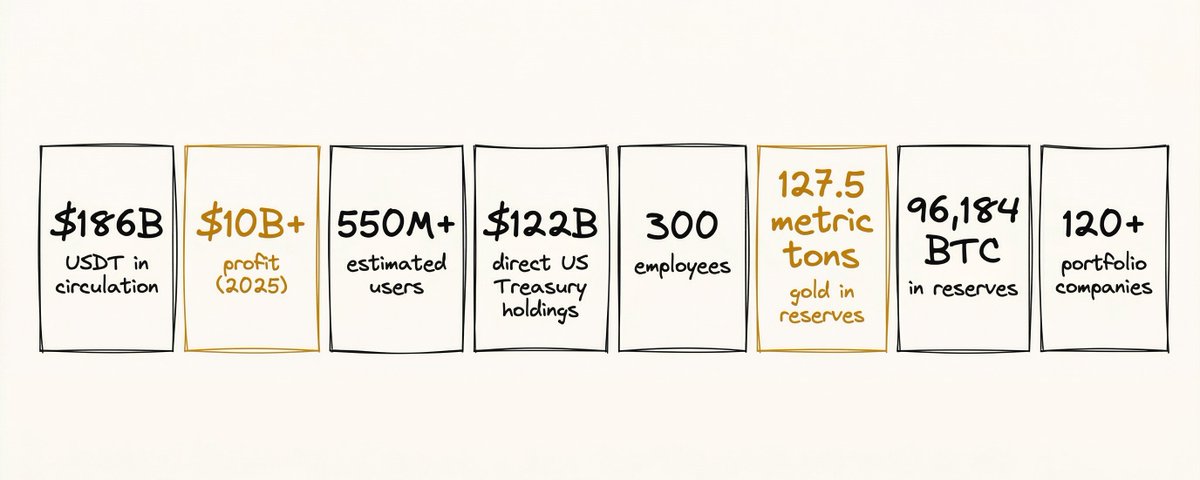

テザーの2026年第一四半期準備資産監査報告書によると、同社の純利益は10.4億米ドル、準備バッファーは82.3億米ドル、トークン関連負債は約1830億米ドル、直接および間接保有する米国短期国債は約1410億米ドルに達しています。

この豊かな準備基盤は、テザーに持続的な収益と十分な貸借対照表の余裕をもたらすとともに、事業利益を活用して長期インフラストラクチャー分野への投資を行う余力を与えています。

CryptoSlateは以前、テザーが膨大な安定コイン発行量を背景に、準備資金を戦略的に配分できることを分析しました。今年1月、同社は8888BTCを購入したことが明らかになり、利息収入と事業利益を長期的なビットコイン保有へと転換できる能力を示しました。QVACプロジェクトは、こうした資産配分のロジックを、AIという新たな分野へと拡張したものなのです。

現在、テザーはビットコイン、ゴールド、スタートアップ企業、エネルギー産業、暗号資産マイニング、通信インフラなどに加え、AIそのものに本格的に投資を開始しました。この戦略により、テザーは単なる民間米ドル流動性供給者から、民間デジタルインフラストラクチャー建設者へと進化しています。

「心理史学」というSF的ナラティブは、まさにこの戦略的方向性に合致しています。テザーはAIを、単なるソフトウェアではなく、文明レベルの基盤的インフラストラクチャーと見なしています。QVACの公式資料では、自身を「無限に安定した知能プラットフォーム」と位置付け、ローカル優先の分散型知能システムを提供し、中央集権型AIに対抗・代替することを目指しています。

QVACのビジョンによれば、すべての知能インタラクションを中央サーバーに依存させるのは、遅延・不安定性のみならず、検閲・制限リスクを伴う。これに対し、QVACはユーザー固有の知能システムを支えるエッジ端末向け基盤となることを目指しています。

この考え方は、テザーの安定コイン哲学とも呼応します。すなわち、資金の流れは許諾不要、ユーザーのデータは自己管理、AIは可能な限りローカルで実行されるべきである、という原則です。

アシモフのSF概念の裏には、テザーのより真剣な判断があります。すなわち、AIがインフラストラクチャー級のレジリエンス(回復力・耐障害性)とリスク耐性を備えたときこそ、その価値が真に定着するという認識です。

クラウド上の大規模モデルは総合的な能力に優れていますが、同時にプラットフォームリスク、価格設定リスク、政策・規制リスク、ネットワーク遅延リスク、データ経路リスクといった諸リスクを内包しています。一方、ローカルAIモデルは性能の一部を犠牲にすることで、所有権・プライバシー保護・継続的可用性といった安定性を獲得します。

こうしたトレードオフのロジックは、暗号資産業界の理念と極めて一致しています。たとえば、自己管理(セルフカストディ)は取引所管理に比べて利便性に劣りますが、取引所の破綻リスクが顕在化して初めてその価値が理解されます。同様に、ローカルAIはクラウドホスティング型モデルほど使いやすくはありませんが、ネットワーク切断、API仕様変更、アカウント停止、データ流出制限といった事象が発生した際に、その優位性が明確に浮かび上がります。

QVAC:エッジAI向けに特化した別次元のアーキテクチャ

QVACの核心的差別化ポイントは、その基盤アーキテクチャにあります。OpenAI、Anthropic、Google DeepMind、xAIといった最先端大規模モデルは、汎用性・コード生成能力・マルチモーダル対応・超長文脈推論・エージェント応用・企業向けクラウド展開などを競い合っています。

一方、QVACはまったく異なる道を選択しました。すなわち、「展開容易性」「プライバシー保護」「低遅延」「組み合わせ可能性」「単一プラットフォームへの依存からの独立存続性」です。

QVACの公式入門ドキュメントでは、本プロジェクトをオープンソース・クロスプラットフォーム型のエコシステムと定義し、「ローカル優先実行」および「ピアツーピア(P2P)型AIアプリケーション」を特徴としています。Linux、macOS、Windows、Android、iOSの全OSに対応しており、ユーザーは大規模言語モデル(LLM)、音声認識、検索拡張生成(RAG)などのAIタスクをローカルで実行できます。また、内蔵されたP2P機能を通じて、推論タスクを他のデバイスノードへ委託することも可能です。

これはすなわち、QVACの評価基準が、最先端クラウドAI大規模モデルとは根本的に異なっていることを意味します。最先端AIは、中央集権的サービスが提供できる最も強力な汎用モデル能力を追求します。一方、QVACは、推論がどこで行われるか、誰が実行を制御するか、データがデバイス上に留まるか、そして中央集権的サービスが停止した後でもアプリケーションが継続して動作するか、という点に焦点を当てています。

テザーは2026年4月にQVACソフトウェア開発キット(SDK)をリリースし、統一された開発環境を提供しています。これにより、開発者は任意のデバイス上でAIアプリケーションの構築・実行・微調整(ファインチューニング)が可能となり、コード変更なしに全プラットフォームに対応できます。

QVAC SDKは、統一抽象層を介して各種ローカル推論エンジン(自社開発のQVAC Fabric、llama.cppの派生版など)と互換性を持ち、whisper.cpp、Parakeet、Bergamotなどの音声・翻訳ツールも統合されています。

QVACはもはや単一モデルのリリースを超え、むしろAIの基盤的オペレーティングシステムに近い存在です。現在のオープンソースAIエコシステムには、Llama、Qwen、Mistral、Gemma、DeepSeek、Hugging Face、llama.cpp、Ollamaなど、多数の成熟したローカル推論プロジェクトが百花繚乱の状態です。

QVACの核心的賭けは、開発者が、モデル読み込み・推論演算・音声認識・OCR(画像文字認識)・翻訳・テキストから画像生成・検索拡張生成・P2Pモデル配信・委託推論・ローカル微調整といった全プロセスを統一インターフェースで統合する、完全なエッジ向けフレームワークを必要としている、という判断に基づいています。

QVACは、知能計算リソースの配信基盤となることを目指しており、継続的に改善される中規模ローカルモデルを活用して、エッジAIエコシステムの入口を確保しようとしています。

QVAC Fabricは、この技術アーキテクチャ全体の核です。テザーによれば、FabricはVulkanおよびMetalバックエンドを活用し、主流のコンシューマー向けハードウェア上でモデルの微調整を実行可能であり、Qualcomm AdrenoやARM Mali GPUを搭載したAndroid端末、Apple自社チップ搭載端末、AMD・Intel・NVIDIA製ハードウェアを搭載したWindows/Linux PCなど、幅広いデバイスに対応しています。

さらに、モバイル端末のメモリ制限に対応するため、動的ブロッキング技術を採用。GPU加速によるLoRA微調整プロセスやマスク損失指令最適化(masked loss instruction tuning)もサポートしています。

もし、このワークフローが外部開発者によって実証されれば、その価値は単なるオープンソースモデル公開を大きく凌駕します。モデル重み(ウェイト)は単なる基盤層にすぎず、ローカルにおける個別最適化(パーソナライズド・ファインチューニング)こそが、真の付加価値となるのです。

MedPsy:QVACが直面する初の本格的実力試験

MedPsyは、QVACが最初にリリースした旗艦モデル製品です。5月7日にHugging Faceで公開された技術報告書によると、QVAC MedPsyはエッジ端末向けに最適化された医療・ヘルスケア分野専用言語モデルであり、17億パラメータ版と40億パラメータ版の2種類が用意されています。

公式発表では、極めて革新的な主張がなされています。すなわち、厳密な医療分野限定のファインチューニングを施した小型モデルが、大型医療ベンチマークモデルの性能を上回り、ノートPC、ハイエンドモバイル端末、さらにはスマートフォンといったリソース制約のあるデバイスでも実行可能である、というものです。

QVACによれば、MedPsy-17Bは7つの閉じられた医療ベンチマークテストにおいて平均62.62点を記録し、GoogleのMedGemma-1.5-4B-it(51.20点)を大幅に上回っています。なお、MedPsy-17Bのパラメータ数は相手の半分未満です。また、MedPsy-40Bは平均70.54点を記録し、MedGemma-27B-text-it(69.95点)をわずかに上回りましたが、そのパラメータ数は相手の約7分の1に過ぎません。

HealthBenchおよび高難度版HealthBench Hardのテストでは、その差はさらに顕著になります。MedPsy-4Bはそれぞれ74.00点および58.00点を獲得したのに対し、MedGemma-27B-text-itは65.00点および42.67点にとどまっています。

これらのベンチマーク結果が第三者によって再現されれば、QVACの核心思想——すなわち、特定の高価値垂直領域において、軽量エッジモデルが超大規模クラウドシステムに挑むことができる——が直接的に立証されることになります。

訓練プロセスにもQVACの競争戦略が反映されています。MedPsyは通義千問3(Qwen3)をベースモデルとし、多段階の教師ありファインチューニングおよび医療QA強化学習による反復最適化を実施。実験過程で3000万件以上の合成データが生成され、二段階のカリキュラム学習が採用されました。また、長文脈推論の教師モデルとして、百川(Baichuan)のM3-235B大規模モデルが選ばれました。

現時点では訓練データセットは公開されておらず、これが重要な懸念点です。現在公表されている優れたベンチマークスコアはすべてQVAC社内の評価によるものであり、訓練データの汚染の有無、カバレッジ範囲、プロンプト設計、教師モデルの影響など、多くの重要な疑問点は、依然として第三者による検証を待っています。

量子化デプロイの観点からは、すでにllama.cppおよびQVAC SDKに対応したGGUF量子化版が公式公開されています。Q4_K_M量子化を適用すれば、モデルサイズを69%削減しつつ、平均スコアの低下は1点未満に抑えられます。体積と性能のバランスを最適化した場合、40億パラメータ版は2.72GB、17億パラメータ版は1.28GBと、いずれもローカルデバイスへの導入が容易です。

QVAC公式サイトでは、MedPsyに関するリスク警告も明記されています。すなわち、現時点ではテキストインタラクションのみをサポート、英語のみ対応、臨床現場での緊急対応には使用不可、大規模言語モデル固有の「幻覚(ハルシネーション)」問題を抱えており、開発者はアプリケーション全体のアーキテクチャにおいてユーザーのプライバシー保護を担保する責任がある、とのことです。

医療分野自体がローカル推論に対して非常に強いニーズを有しており、MedPsyの将来性は極めて期待されます。しかし、その実力を真正に証明するには、第三者研究者によるベンチマーク再現と、実際の臨床プロセスにおける実地検証が不可欠です。

利便性 vs コントロール:AI業界の究極の選択

ローカルAIとクラウドAIの論争は、しばしば「プライバシー vs 性能」という二者択一の構図で語られがちです。しかし、QVACはこのロジックを再構築し、本質的には「利便性」と「自主的コントロール権」の間のトレードオフであると位置づけています。

クラウドAIの強みは、極限まで簡素化されたユーザーエクスペリエンスにあります。ユーザーはアプリを開き、指示を入力し、即座に結果を得ることができます。モデルの重み、デバイスのGPUメモリ、量子化パラメータ、ベクトル埋め込み、実行環境の互換性など、複雑な技術課題はすべてプラットフォーム側が引き受けます。この極限の利便性こそが、中央集権型AIプラットフォームが急速に台頭した根本的理由であり、ユーザーは極めて低いハードルで最先端の知能能力を享受できるのです。

一方、QVACは、開発者およびユーザーがより多くの運用管理責任を負うことを要求します。その代わりに、新しいセキュリティアーキテクチャ——ローカル・オフライン実行、ネットワーク切断時でも動作可能、データの外部流出を最小限に抑制、API依存からの脱却、そしてP2Pによる推論委託・モデル配信の実現——を提供します。

テザーのSDK説明によれば、QVACを搭載したアプリケーションは弱いネットワーク環境下でも安定して動作し、ネットワークが切断された状況でもAIが正常に機能します。2025年のQVAC初期公告ではさらに、AIエージェントをローカルデバイスに直接デプロイし、デバイス間をP2Pネットワークで連携させ、WDKキットを活用してAIエージェントがビットコインやUSDTなどの資産取引を自律的に行えるようにする計画が示されています。

これはまさにテザーの完全なトップダウン戦略であり、資金・計算能力・知能エージェントのすべてが、同一の「自律的主権(autonomous sovereignty)」設計パラダイムに則って構築されています。

もちろん、その分散化のナラティブは完璧ではありません。ユーザーがモデルを自由にダウンロード・ローカル実行でき、機密データがデバイス上に留まるという点から、QVACは推論層において高度な分散化を実現しています。これは、インタラクションの各ステップをプラットフォームが掌握するホスティング型APIとは根本的に異なります。Holepunchネットワークアーキテクチャを活用することで、QVACは推論委託・分散型モデル配信といったP2P基盤機能をサポートしており、アーキテクチャ設計には実質的な革新性が認められます。

しかし、ガバナンス(統治)の観点では依然として中央集権的属性を有しています。QVACはテザーが全額出資し、命名・統括・マーケティングを一手に担っており、旗艦アプリケーション、モデル体系、SDKのロードマップ、そして「安定知能(Stable Intelligence)」という理念も、単一企業によって主導されています。

この状況は、QVACの「ローカル優先」という核心価値と矛盾するものではなく、むしろ分散化のメリットを、最も実証が確かな「推論実行層」に限定しているだけです。エコシステム全体としては、デフォルト登録ノード、バージョン公開チャネル、セキュリティ規範、モデル承認基準、長期的なコミュニティガバナンスなど、さまざまな側面で、段階的に分散型管理メカニズムを構築していく必要があります。

再現テストがQVACの最終的到達点を決める

現時点でQVACの信頼性は、完全に第三者による再現結果にかかっています。もしMedPsyのベンチマークスコアが外部評価環境で再現できたならば、テザーは「知能資産準備」という理念を真に実現したことになります。すなわち、軽量・オープンソース・ローカルデプロイ可能な垂直領域モデルが、高感度分野においてクラウド上の超大規模モデルと肩を並べる能力を有している、という主張が立証されるのです。

仮に第三者テストでスコア差が縮小あるいは逆転したとしても、QVACのインフラストラクチャー的価値は依然として成立します。ただ、モデル性能に関するナラティブはやや弱まります。業界の究極命題は、結局のところ、テクノロジーの永続的な法則へと帰結します。すなわち、極限の利便性は権力の集中を招き、自主的コントロールは運用コストを伴う、というトレードオフです。

これこそがアシモフのSF思想の真価です。『ファウンデーション』における心理史学は、圧力下における複雑巨大システムの進化法則を研究するものでした。テザーはこれを新たな解釈で捉え直し、インフラストラクチャーがいかにして中央集権的独占に対抗・耐え抜くかに焦点を当てています。

SF的ナラティブは壮大ですが、技術の実装はまだ初期段階にあります。しかしながら、全体の戦略的ロジックは明確かつ整合性があります。テザーは、世界最大の安定コインが生み出す継続的なキャッシュフローを基盤として、ローカル実行・P2Pネットワーク・オープンソースツール・エッジ軽量モデルを核とするAIアーキテクチャを構築し、安定コインにおける自律的主権の理念を、貨幣領域から知能領域へと拡張しようとしています。

今や業界が疑問視しているのは、「安定コイン大手がAI分野に進出する実力はあるのか?」という問いではありません。その答えは明白です。

真に重要な問いは、「QVACは、ユーザーがローカルでの自律的コントロールを求めて、ある程度の運用ハードルを受け入れるに足る、十分に強力なモデルとインフラストラクチャーを構築できるのか?」という一点に集約されます。

MedPsyはまさに、その第一の定量的ハードルです。第三者による再現結果が、QVACの「心理史学」的ナラティブを、単なるSF的比喩に留めるのか、それとも、本格的なエッジAI分野の主要プレイヤーとして、完全な運用ロジックを備えた基盤アーキテクチャーへと昇華させるのかを決定づけるでしょう。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News