Vitalikの新記事:AIと暗号化がプライバシーをどのように変えているか?

TechFlow厳選深潮セレクト

Vitalikの新記事:AIと暗号化がプライバシーをどのように変えているか?

プライバシーとは自由である。

執筆:Vitalik Buterin、イーサリアム創設者

翻訳:白水、金色財経

特別にBalviボランティアのPaul Dylan-Ennis、pcaversaccio、vectorized、Bruce Xu、Luozhu Zhangによる議論とフィードバックに感謝します。

最近、私はますますイーサリアムエコシステムのプライバシー状況の改善に注目しています。プライバシーは分散化の重要な保証です。情報を持つ者が権力を握るため、情報の集中制御を避ける必要があります。現実世界では、人々が中央集権的な技術インフラに対して抱く懸念の多くは、運営者が意図せずルールを変更したりユーザーを排除したりすることへの恐れですが、同様に一般的なのはデータ収集への懸念です。暗号通貨分野はChaumのEcashのようなプロジェクトから始まり、デジタル金融におけるプライバシー保護を最優先にしていましたが、近年ではプライバシーを軽視する傾向があります。その根本的な理由は単純で、ZK-SNARK技術が登場するまでは、分散型の方法でプライバシーを提供できなかったため、私たちはプライバシーの重要性を低め、当時提供可能な他の保証に焦点を当てました。

しかし今や、プライバシーは無視できなくなっています。人工知能(AI)は中央集権的なデータ収集・分析能力を飛躍的に向上させると同時に、私たちが自発的に共有するデータの範囲も大幅に拡大しています。将来、脳機械インターフェース(BCI)といった新技術によりさらなる課題が生じるでしょう。実際に「AIが人間の思考を読む」時代が来るかもしれません。一方で、1990年代の暗号パンクたちが想像した以上に強力なプライバシー保護手段、特にデジタル領域においては、すでに手にしています。効率的なゼロ知識証明(ZK-SNARK)を使えば、信頼されていることを証明しつつ身元を守ることができ、完全準同型暗号(FHE)を使えばデータを見ることなく計算を実行でき、obfuscation技術も近い将来さらに多くの機能を提供する可能性があります。

プライバシーとは互いを隔てることではなく、団結することを意味する。

ここで改めて問うべきは、「なぜ私たちはプライバシーを必要とするのか?」という問題です。人それぞれ答えは異なりますが、この記事では私が考える理由を三つの柱に分けて説明します。

-

プライバシーとは自由である:プライバシーは、自分の行動がさまざまな政治的・社会的駆け引きの中でどのように評価されるかを常に気にせずに済む空間を与えてくれる。

-

プライバシーとは秩序である:社会の基本的な機能を支える多くの仕組みは、プライバシーがあってこそ正しく機能する。

-

プライバシーとは進歩である:情報を選択的に共有しつつ悪用を防ぐ新たな手段を見つけられれば、莫大な価値を解放し、技術的・社会的進歩を加速できる。

プライバシーとは自由である

21世紀初頭、David Brinが1998年に出版した『The Transparent Society』で要約されたような考え方が広く流行しました。すなわち、技術によって世界中の情報がより透明になるが、これは多少の弊害を伴いつつも全体としては非常に良いことであり、政府監視(正確には市民による政府監視)を可能にすることで公平性を高められるというものです。1999年、Sun MicrosystemsのCEOスコット・マクニリーは「プライバシーは死んだ、それを受け入れろ」という有名な発言をしました。こうした考え方の名残は、Facebookの初期構想や発展期にも見られ、フェイスブックは当初、本名以外のアカウント使用を禁止していました。個人的には2015年、深センのHuawei主催イベントで、ある(西洋人の)講演者が「プライバシーは死んだ」と何気なく言及する場面を目撃し、まさにこの風潮の終焉を感じました。

「透明社会」は、「プライバシーの終焉」イデオロギーが提示できる最も楽観的かつ明るい未来像でした。政府に責任を負わせるために透明性を利用し、個人や少数派を抑圧するのではなく、より良き、公正で公平な世界を実現すると約束したものでした。しかし後になってみると、この理念はグローバルな協力と平和、そして「歴史の終焉」への熱狂が頂点に達していた時代の産物であり、人間性について過度に楽観的な前提に依存していることが明らかです。具体的には:

-

世界的な政治的指導層は概ね善意かつ合理的であり、そのため縦方向のプライバシー(権力を持つ者や機関に情報を開示しないこと)は次第に不要になる。権力の乱用は特定地域に限られるため、それを「光のもとに晒す」ことで対処すべきだ。

-

文化は継続的に進歩し、横方向のプライバシー(一般市民に情報を開示しないこと)も不要になる。オタク、LGBTQ+、そして最終的には誰もが「クローゼットの中」に隠れる必要がなくなる。社会は人々の個性に対して厳しい判断を下さず、よりオープンで包摂的になるからだ。

今日、どの主要国も最初の仮定が正しいとは普遍的に認められていません。逆に、多くの大国ではそれが誤りだと広く認識されています。第二の点に関しても、文化的包摂性は急速に後退しています。Twitterで「いじめは良いこと」といったフレーズを検索するだけでその証拠になりますし、他にも容易に多くの例を挙げられます。

私は不幸にも「透明社会」の弊害を頻繁に体験しており、外出先での私のあらゆる行動がメディア報道に偶然取り上げられる可能性があります。

最悪だったのは、チェンマイでノートパソコンを使っている私の様子を撮影した1分間の動画が、小紅書に投稿され、瞬く間に数万のいいねとシェアを獲得したことです。もちろん、私の状況は一般の人々とは大きく異なります。しかし、プライバシーとは常にそうした存在意義を持っています。生活状況が平均に近い人はプライバシーをあまり必要としませんが、そうでない人々(どのような形であれ)は強く必要とします。すべての重要な側面を合計すれば、真にプライバシーを必要とする人々の数は非常に多くなります。いつ自分自身がその一人になるかは誰にもわかりません。これがプライバシーがしばしば過小評価される大きな理由の一つでもあります。それは今日のあなたの状況や情報だけでなく、それらの情報が将来どうなるか(そしてあなたにどう影響するか)という不確実性に関わるからです。

現在、AI推進派の間でも企業の価格設定におけるプライバシーはマイナーな問題ですが、AIベースの分析ツールの台頭とともに、これはますます深刻な問題となる可能性があります。企業があなたについてどれだけ多くの情報を得ているかに応じて、彼らはあなたに個別に価格を提示し、あなたから搾取できる利益と支払い可能性の積を最大化しようとします。

「プライバシー=自由」に関する私の一般的な主張を一文で表すなら次の通りです。

プライバシーがあれば、個人の目標やニーズに最も適した方法で生活する自由が得られ、常に「プライベートゲーム」(自分のニーズ)と「パブリックゲーム」(ソーシャルメディアの連鎖反応、商業的インセンティブ、政治、制度など、さまざまなメカニズムを通じて他人が自分の行動をどう見るか、どう反応するか)の間でバランスを取る必要がなくなるのです。

プライバシーがなければ、あらゆる行為が「他人(およびロボット)が私の行動をどう見るか」という絶え間ない闘争に変わります。それは権力者であろうと、企業であろうと、同僚であろうと、現在であろうと未来の人々であろうと関係ありません。プライバシーがあれば、バランスを保てるのです。しかし今、このバランスは急速に侵食されており、特に物理的領域において顕著です。現代のテクノロジー資本主義のデフォルトの道筋は、ユーザーに明示的な支払いを求めずに価値を得ようとするビジネスモデルを求めており、このバランスをさらに侵食しています(極めて機微な領域、最終的には私たち自身の思考にまで浸透する可能性がある)。そのため、この影響に対抗し、特に私たちが現実的に実行可能な領域、つまりデジタル領域において、より明確にプライバシーを支持する必要があります。

だが、政府に裏口(バックドア)を許してはいけないのか?

上記の議論に対するよくある反論があります。「あなたが述べるプライバシーの弊害は、主に一般大衆が私たちの私生活を過剰に知ってしまうことに起因している。権力の乱用が問題になるとしても、それは企業、上司、政治家が過剰に知ることによるものだ。しかし、一般大衆や企業、上司、政治家にそのようなデータを渡すわけではない。代わりに、訓練され厳密に審査された少数の法執行官プロに、街中の監視カメラやインターネットケーブル、チャットアプリの盗聴データを閲覧させ、厳格な説明責任を確保するのである。そうすれば、他の者は知ることができない。」

これは静かに、しかし広く保持されている立場であり、明確に議論することが不可欠です。たとえ善意を持って高品質に実施されたとしても、このような戦略には以下のような内在的な不安定性があります。

-

政府だけでなく、さまざまな企業もデータ漏洩のリスクに直面しており、その品質はまちまちです。伝統的金融システムでは、KYC情報や支払い情報は決済処理業者、銀行、その他の中間機関が握っています。メールプロバイダーは膨大な量のデータを閲覧可能です。通信会社はあなたの位置情報を把握しており、定期的に違法に再販しています。これらすべての機関を十分に厳格に規制し、本当にユーザーのデータを重視させるには、監視者・被監視者の双方にとって巨額のコストがかかり、競争的な自由市場との両立が困難です。

-

アクセス権を持つ個人は常にデータの濫用(第三者への売却を含む)の誘惑にさらされます。2019年、複数のTwitter従業員がサウジアラビアに異見者の個人情報を売ったとして起訴・有罪判決を受けました。

-

データは常にハッキングの危険にさらされています。2024年、米国の通信会社が法的に収集を義務付けられたデータがハッキングされ、中国政府のハッカーによるものとされています。2025年、ウクライナ政府が保持する大量の機微な個人データがロシアのハッカーに攻撃されました。一方で、中国の極めて機微な政府・企業データベースもハッキングされており、その中に米国政府も含まれています。

-

政権が交代する可能性があります。今日信頼できる政府も、明日には信頼できなくなるかもしれません。今日権力を握っている者も、明日には迫害される対象になるかもしれません。今日、完璧な礼儀と品位を保っている警察組織も、10年後には冷笑的な残酷行為の巣窟になっているかもしれません。

個人の視点からは、自分のデータが盗まれた場合、それが将来どのように悪用されるか、いつ悪用されるか予測できません。これまでに、大規模なデータを安全に扱う最も安全な方法は、初めからデータの集中収集を最小限に抑えることです。データは最大限にユーザー自身が保持し、暗号化技術を使って個人のプライバシーを損なうことなく有用な統計情報を集計すべきです。

政府は令状があれば何でも取得できるべきだという意見がありますが、これは重要な点を見落としています。歴史的に、令状で取得できた情報量は今日のそれよりもはるかに少なく、また、最も厳格なインターネットプライバシー保護策が普遍的に採用された場合に得られる情報量よりもずっと少なかったのです。19世紀には、一般人が一度だけ行った音声会話が、誰にも記録されることなく終わりました。したがって、「情報のプライバシー」に対する道徳的パニックは歴史的常識に反しています。普通の会話、あるいは金融取引さえも、完全かつ無条件に秘匿されてきたことが数千年にわたる歴史的通常状態なのです。

1950年のごく普通の会話。会話をしている当事者以外の誰も、その会話を記録、監視、「合法的傍受」、AI分析、または他の方法で見たことはない。

中央集権的なデータ収集を最小限に抑えるもう一つの重要な理由は、グローバルな通信と経済的やりとりの大部分が本質的に国際的であることにある。もし全員が同じ国にいれば、「政府」が彼らのやりとりのデータにアクセスする権利を持つべきだと言えるかもしれない。しかし、人々が異なる国にいる場合はどうでしょうか?理論上は、「銀河系レベルの知性」的解決策を試みて、各個人のデータを責任を持つ法的アクセス主体にマッピングすることは可能かもしれませんが、それでも多数の人物に関わる境界事例を処理しなければなりません。しかし、それが現実のデフォルト結果になるわけではありません。政府の裏口の現実的デフォルト結果は、アプリケーションを支配している管轄区域にデータが集中し、すべての人々のデータを掌握するという、本質的にグローバルな技術的覇権です。強固なプライバシーこそが、これに代わる最も安定した代替案です。

プライバシーとは秩序である

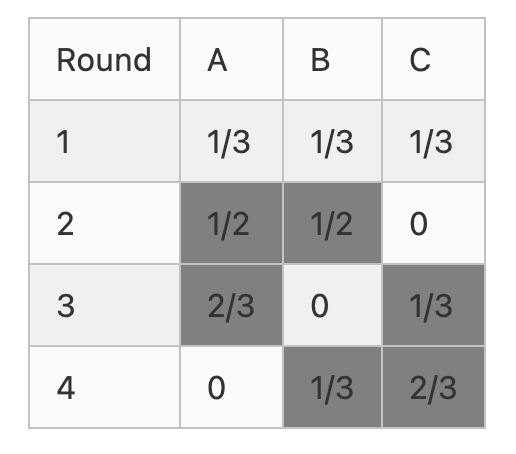

1世紀以上前から、民主主義制度が機能するための鍵となる技術的要素は秘密投票であることが認識されています。誰が誰に投票したかは誰にもわかりません。そして、実際に自分が誰に投票したかを証明したいと思っても、誰にも証明できないのです。秘密投票がデフォルトでなければ、有権者は賄賂、過去の報酬の約束、社会的圧力、脅迫などの付随的インセンティブに影響され、投票行動が左右されます。

簡単な数学的議論でわかるように、このような付随的インセンティブは民主主義を完全に破壊します。N人の参加者がいる選挙で、あなたが結果に影響を与える確率はおよそ1/Nしかありません。したがって、どちらの候補がより良く、どちらが劣るかという考慮はすべてNで割られます。一方、付随的ゲーム(たとえば、有権者の賄賂、強要、社会的圧力)は、あなたの投票方法(全体の投票結果ではなく)に基づいて直接あなたに影響を与えるため、Nで割られません。したがって、付随的ゲームが厳格に管理されない限り、デフォルトではそれらが主要なゲームを圧倒し、どの候補の政策が実際に優れているかという考察はすべて掻き消されてしまいます。

これは国家規模の民主主義にのみ適用されるわけではありません。理論的には、ほぼすべての企業や政府における委任代理問題に適用されます。

-

裁判官がどのように判決を下すか

-

政府官僚がどの企業と契約や助成金を出すか

-

移民官がビザを発給するか拒否するか

-

ソーシャルメディア企業の従業員がコンテンツモデレーション方針をどう実行するか

-

企業の従業員がビジネス意思決定(たとえば、どのサプライヤーから調達するか)に参加するか

すべての場合の根本的な問題は同じです。代理人が誠実に行動すれば、その行動から代表する組織に得られる利益はわずかに過ぎません。しかし、ある種の付随的ゲームのインセンティブに従えば、その利益をすべて得ることができます。したがって、今日でも、私たちのすべての機関が相互に破壊する付随的ゲームの混沌とした渦に完全に飲み込まれないよう保つには、大量の道徳的善意が必要です。もしプライバシーがさらに弱まれば、これらの付随的ゲームはさらに強力になり、社会を正常に機能させるために必要な道徳的善意は非現実的に高くなるでしょう。

社会システムを再設計してこの問題を回避できるでしょうか?残念ながら、ゲーム理論はほとんど明確に不可能であると示しています(唯一の例外:完全な独裁)。個人の選択に注目するゲーム理論のバージョン(すなわち、各参加者が独立して意思決定を行い、複数の主体が共通の利益のために協力する可能性を認めない)では、メカニズムデザイナーは特定の結果を実現するためにゲームを「設計」する上で非常に大きな自由度を持っています。実際、任意のゲームには少なくとも一つの安定したナッシュ均衡が存在することが数学的に証明されており、このようなゲームの分析は扱いやすいものになります。しかし、連合の協力(すなわち「共謀」)の可能性を認めるゲーム理論のバージョン、すなわち協力ゲーム理論では、安定した結果(「コア」)を持たないゲームが多数存在することが証明できます。このようなゲームでは、現在の状況がいかなるものであれ、常にいくつかの連合がそこから利益を得ることが可能です。

数学を真剣に受け止めれば、安定した社会構造を築く唯一の方法は、参加者間で起こり得る調整の量に何らかの制限を設けること、すなわち高度なプライバシー(否認可能性を含む)であると結論づけざるを得ません。数学そのものを真剣に受け止めないとしても、現実世界を観察するか、あるいは上述の委任代理の状況のうちいくつかが周辺ゲームに支配されたらどうなるかを考えるだけで、同じ結論に至ります。

注意すべきは、ここから政府の裏口がなぜ危険かという別の論点が導かれることです。もし誰もがすべての事柄について他の人と無制限に調整できるならば、結果は混乱です。しかし、少数の人だけが特権的に情報を得られるためにそれができるならば、結果は彼らが支配的になることです。ある政党が他の政党の通信に裏口を持つことは、多党制の実現可能性の終焉を簡単に意味します。

共謀を制限することで機能する社会秩序のもう一つの重要な例は、知識活動と文化活動です。知識・文化活動への参加は本質的に内的動機によって駆動される公共財の活動です。社会に積極的な貢献をするという外的インセンティブを設計するのは難しいのです。なぜなら、知識・文化活動自体が、社会の中でどのような行動が肯定的であるかを決める一環だからです。正しい方向へ導くための商業的・社会的インセンティブの近似を作ることはできますが、それには内的動機の強力な補完も必要です。しかし、これは同時に、こうした活動が外部的動機の不均衡、特に社会的圧力や強要といった周辺ゲームの影響を受けやすいことを意味します。こうした不均衡な外部的動機の影響を制限するために、再びプライバシーが不可欠になります。

プライバシーとは進歩である

公開鍵暗号や共通鍵暗号がまったく存在しない世界を想像してください。この世界では、遠距離で安全にメッセージを送信することは本質的により困難になります(不可能ではありませんが、非常に困難です)。これにより国際的な協力が大幅に減少し、より多くの協力が対面のオフラインチャネルに留まることになります。その結果、世界はより貧しく、より不平等になります。

私は、仮想的な未来世界と比較すれば、私たちが今いる世界はちょうどこのような状態にあると考えます。その未来では、より強力な暗号技術(特にプログラマブル暗号)が広く普及し、さらに強固なフルスタックセキュリティと形式的検証が補完されることで、これらの暗号技術が正しく使われていることを確実にする強力な保証が得られるのです。

エジプト神プロトコル:データを完全に秘匿したまま計算を可能にする、強力で極めて汎用性の高い三つの構造。

医療は良い例です。過去10年間、長寿、疫病対策、その他の健康分野で働いた人々に話を聞いてみてください。誰もが一致して言うでしょう。将来の治療や予防はパーソナライズされる。効果的な対応策は、個人データや環境データを含む高品質なデータに強く依存する。空気感染症から人々を効果的に守るには、どの地域の空気質が高いか低いか、そして特定の時期に病原体がどこに出現しているかを知る必要があります。最先端の長寿クリニックでは、あなたの体、食事の好み、ライフスタイルのデータに基づいて、カスタマイズされたアドバイスや治療法を提供します。

しかし、これらすべては同時に巨大なプライバシーリスクを伴います。個人的には、ある会社が「電話で帰宅する」従業員に空気モニターを配布し、そのデータから従業員がいつ性行為を行ったかを特定できるほどだったという事例を知っています。同様の理由から、最も価値のあるデータの多くは、プライバシーのリスクを恐れてデフォルトで収集されないと予想しています。データが実際に収集されたとしても、研究者に広く共有されることはほとんどありません。商業的理由もあるものの、プライバシー上の懸念も同程度に一般的です。

同じパターンは他の分野でも繰り返されています。私たちが作成した文書、さまざまなアプリで送信したメッセージ、ソーシャルメディアでの行動には、私たち自身に関する大量の情報が含まれており、これらは私たちの日常生活で必要とするものをより効果的に予測・提供するために利用できます。また、医療とは無関係な、物理的環境との相互作用に関する大量の情報もあります。現在、私たちはこれらの情報を有効活用するツールを持ち合わせていません。その一方で、ディストピア的なプライバシー地獄を招かないようにする手段もありません。しかし将来的には、そうしたツールを手にできるかもしれません。

これらの課題を解決する最良の方法は、データ共有のメリットを得つつ、その副作用を回避できる強力な暗号技術を使うことです。AI時代において、データ(個人データを含む)を取得する必要性はさらに重要になります。ローカルで「デジタルツイン」をトレーニング・実行し、私たちの嗜好の高忠実度近似に基づいて意思決定を代行させることで、大きな価値が生まれます。最終的には、脳機械インターフェース(BCI)技術を使って、私たちの脳からの高帯域幅の入力を読み取ることにもつながります。高度に集中したグローバルな覇権を回避するためには、プライバシーを尊重しつつこれを実現する方法を見つけなければなりません。プログラマブル暗号は、最も信頼できる解決策です。

私のAirValent空気質モニター。空気質データを収集し、集計された統計情報をオープンデータマップに公開し、データ提供に対して報酬を与えるような装置を想像してください。すべてプログラマブル暗号技術を使って、個人の位置情報は漏らさず、データの真正性を検証します。

プライバシーは社会的安全性の進歩を促進できる

ゼロ知識証明などのプログラマブル暗号技術は非常に強力です。まるで情報の流れにおけるレゴブロックのようです。誰がどの情報を閲覧できるかを精緻に制御できるだけでなく、重要なのは「どの情報が閲覧可能か」を制御できることです。例えば、私は18歳以上であることを証明するカナダのパスポートを持っていることを証明できますが、その他の個人情報を一切開示しません。

これにより、さまざまな興味深い組み合わせが可能になります。いくつか例を挙げます。

-

ゼロ知識人格証明:独自の人物であることを証明する(パスポート、生体認証、分散型ソーシャルグラフに基づくIDなど様々な形式で)、他の身元情報を開示することなく。これは「ロボットではないことを証明する」ことや、「1人あたり最大N回」といったユースケースに使え、ルール違反がないことを証明しつつ完全にプライバシーを保護できます。

-

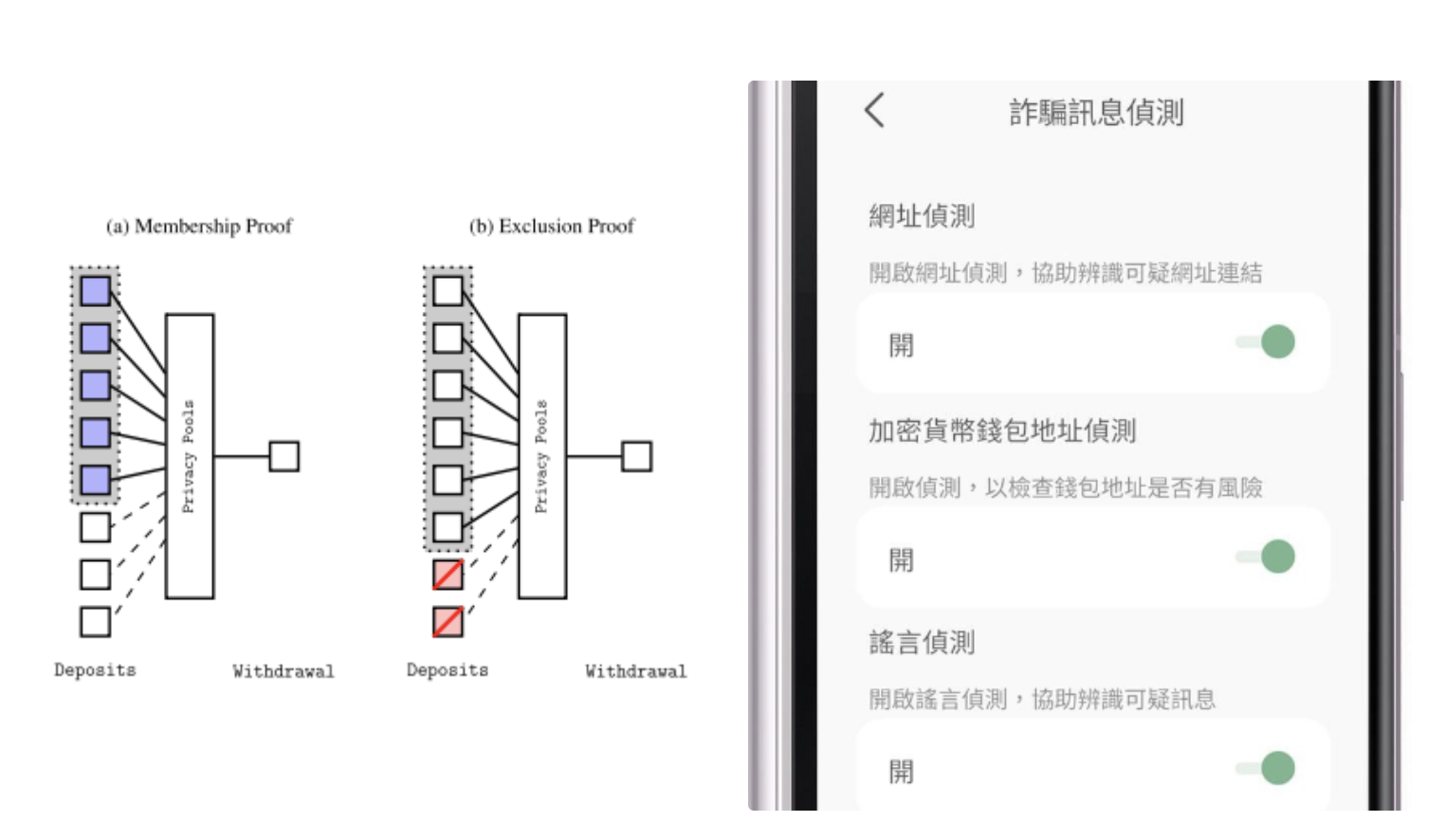

プライバシープール(Privacy Pools):悪意ある行動者を除外する金融プライバシーの解決策で、裏口を必要としません。消費時に、ユーザーは自分のトークンの資金源が公にリストされたハッカー・盗難リストに含まれていないことを証明できます。ただし、ハッカー・盗難者本人はそのような証明を生成できないため、隠蔽できません。Railgunやprivacypools.comが現在このようなスキームを使用しています。

-

端末内不正防止スキャン:ゼロ知識証明(ZKP)には依存しませんが、このカテゴリに属すると感じます。端末内に組み込まれたフィルター(LLMを含む)を使って着信メッセージをチェックし、潜在的な偽情報や詐欺を自動的に識別できます。端末内で実行すればユーザーのプライバシーを損なわず、ユーザーの承認のもとで、各ユーザーがどのフィルターを購読するか選択できます。

-

物品由来証明:ブロックチェーンとゼロ知識証明を組み合わせ、製造チェーン内の物品のさまざまな属性を追跡できます。例えば、サプライチェーンを公開せずに環境的外部性に価格を付けることができます。

左:プライバシープールの概念図。右:Message Checkerアプリ、ユーザーは複数のフィルターをオン・オフ可能。上から順に:URLチェック、暗号通貨アドレスチェック、噂チェック

プライバシーと人工知能

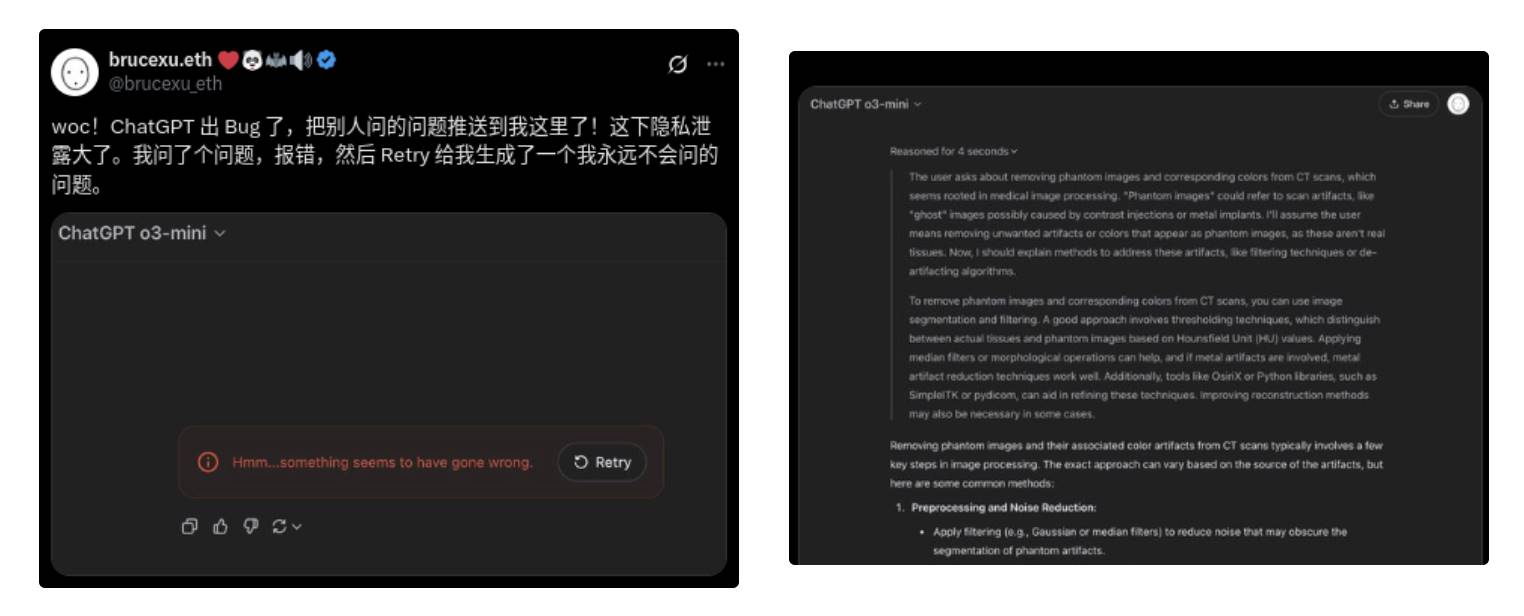

最近、ChatGPTは過去の会話をAIに入力し、将来の会話の背景情報とする方針を発表しました。この傾向は避けられない方向に向かっています。AIが過去の会話を見直して洞察を得ることは、根本的に非常に有用だからです。近い将来、インターネットの閲覧履歴、メール、チャット記録、生体データなどを受動的に収集する、さらにプライバシー侵害の深いAI製品が開発されるかもしれません。

理論的には、あなたのデータはあなたにとって私的なものです。しかし実際には、必ずしもそうとは言えません。

わあ!ChatGPTにバグがあって、他人が質問した内容を私にプッシュしてくる!これは重大なプライバシー漏洩だ。私が質問してエラーが出たあと、「再試行」で私が絶対にしないような質問が生成された。

プライバシー保護メカニズムがうまく機能している可能性もありますが、このケースではAIが幻覚を起こし、Bruceが決してしていない質問を生成して回答したと考えられます。しかし、現時点では検証できません。また、私たちの会話がトレーニングに使われているかどうかの検証もできません。

これらすべては非常に憂慮すべきことです。さらに不安なのは、ユーザーの同意なしに、ユーザーの(物理的・デジタル的)データを大規模に収集・分析するAIの明示的な監視用途です。顔認識技術はすでに専制政権が政治的異見者を大規模に弾圧するのを助けています。そして最も懸念されるのは、AIによるデータ収集・分析の究極のフロンティア:人間の思考です。

理論的には、脳機械インターフェース(BCI)技術は人類の潜在能力を驚異的に高める力を持っています。昨年のNeuralink初の患者、Noland Arbaugh氏の例を見てみましょう。

この実験的デバイスにより、現在30歳のArbaugh氏は自立感を得ました。以前は口棒を使い、誰かが彼を支えて立たせなければなりませんでした。口棒が落ちれば、誰かが拾ってあげなければなりませんでした。長時間使用すると潰瘍ができ、使用時間を制限されていました。Neuralinkデバイスを使えば、彼はほぼ完全にコンピュータを制御できます。ウェブブラウジングやPCゲームをいつでも楽しめ、Neuralinkによれば、彼は脳機械インターフェース(BCI)でカーソルを制御する人間として史上最高の記録を樹立しました。

現在、これらのデバイスは傷病者の支援に十分なほど強力です。将来、完全に健康な人々もコンピュータと協力し、想像を絶する効率で心電感覚的にコミュニケーションできるようになるでしょう(!!)。しかし、このコミュニケーションを可能にするために脳信号を真に解読するには、人工知能が必要です。

これらの傾向が交差すれば、自然と暗い未来が生まれるかもしれません。シリコン製のスーパー・エージェントが、人々の文章、行動、思考様式のすべての情報を吸収・分析する世界です。しかし、同時に、こうした技術の恩恵を享受しつつ、プライバシーを守ることができるより明るい未来も存在します。

これはいくつかの技術を組み合わせることで実現可能です。

-

できるだけローカルで計算を行う:基本的な画像解析、翻訳、文字起こし、BCIの基本的な脳波解析など、多くのタスクはローカルでの計算で十分に実行可能です。実際、ローカル実行はレイテンシの低減や検証可能性の向上という利点もあります。インターネットへのアクセス、ソーシャルメディアアカウントへのログインなどの中間ステップを含む計算も、ローカルで行えるならそうすべきです。

-

暗号技術を使ってリモート計算を完全に秘匿する:完全準同型暗号(FHE)を使えば、リモートサーバーがデータや結果を閲覧できない状態でAI計算をリモート実行できます。過去にはFHEは非常に高価でしたが、(i) 最近その効率が急速に向上しており、(ii) LLMは独特な構造を持ち、漸近的にほぼすべてが線形演算であるため、超効率的なFHE実装に非常に適しています。複数の個人データを含む計算はマルチパーティ計算(MPC)で行えます。一般的な二人の場合、obfuscated circuitなどの技術で極めて効率的に処理できます。

-

ハードウェア検証によって保証を物理世界に拡張する:私たちの思考を読み取るハードウェア(頭蓋骨の内部・外部問わず)は、オープンで検証可能であるべきだと主張できます。IRISなどの技術で検証を行うべきです。他の分野でも同様にできます。例えば、ローカルの法学修士(LLM)が身体的暴力や医療緊急事態と判断した場合にのみ、ビデオストリームを保存・転送し、それ以外の場合は削除するセキュリティカメラを設置できます。IRISを使ってコミュニティ主導のランダムチェックを行い、カメラが正しく実装されていることを検証します。

未完の未来

2008年、リバタリアン哲学者のDavid Friedmanは『The Future of Freedom』という本を書きました。彼は新技術が社会にもたらす変化を概説しましたが、すべての変化が彼にとって(あるいは私たちにとって)良いものではありませんでした。その中のある章では、プライバシーと監視の間に複雑な相互作用が生まれる潜在的な未来を描写しています。デジタルプライバシーの増加が、現実世界の監視の増加を相殺するのです。

もし壁にビデオ蚊が止まって私のタイプミスを見ていたら、メールを強力に暗号化しても意味がありません。したがって、透明社会では、現実空間の肉体とサイバー空間の間のインターフェースを保護する何らかの方法が、強力なプライバシーには必要です……低技術的な解決策は、頭巾をかぶってタイプすることです。高技術的な解決策は、指や、外部の観察者が見えるチャネルを介さずに、思考とマシンの間に何らかの接続を確立することです。

現実空間の透明性とサイバー空間のプライバシーの衝突は、逆方向にも現れます……私のポケットコンピュータはあなたの公開鍵で私のメッセージを暗号化し、あなたのポケットコンピュータに送信します。あなたのコンピュータはそれを復号し、VRゴーグルを通して表示します。肩越しにゴーグルを覗き見されないようにするため、ゴーグルは画面ではなく、微細なレーザーであなたの網膜に画像を書き込みます。幸運であれば、あなたの眼球の内部はまだプライベート空間のままです。

私たちは最終的に、身体的な活動は完全に公開され、情報取引は完全に秘匿された世界に住むかもしれません。これには魅力的な特徴があります。一般市民は依然として強力なプライバシーを利用して殺人者を特定できますが、殺人者を雇うコストは彼らの負担能力を超えてしまうかもしれません。十分に透明な世界では、すべての殺人事件が解明され、殺人者は任務完了後すぐに投獄されるからです。

では、こうした技術とデータ処理の相互作用はどうなるでしょうか?一方で、現代のデータ処理技術は透明社会を脅威に変えます。データ処理技術がなければ、世界中で起きているすべてを録画しても意味がありません。毎日生成される数百万マイルのビデオテープの中から、誰もが欲しい6インチの映像を見つけられないからです。他方で、強力なプライバシーを支援する技術は、現代のデータ処理技術を持つ世界でもプライバシーを再構築する可能性を提供します。取引情報を誰にも取得されないよう保護すれば、彼らは何もできないからです。

こうした世界は、あり得るすべての世界の中で最も良いものかもしれません。すべてがうまくいけば、ほぼ肢体的暴力のない未来が見えます。同時に、ネットワークの自由が守られ、社会における政治的、市民的、文化的、思想的プロセスの基本的な運営が維持されます。これらのプロセスの持続的運営は、完全な情報透明性に対するある程度の制限に依存しています。

それが理想的でなくても、物理的・デジタル的プライバシーがゼロになり、最終的には私たち自身の思考のプライバシーさえ失われる世界よりははるかに良いです。2050年代半ばには、「合法的に傍受される思考を期待するのは当然非現実的だ」と主張する評論記事が登場するでしょう。それに答えるコメントには、最近の出来事を指すリンクが添えられます。あるAI企業の法学修士(LLM)が悪用され、1年間で3000万人の個人的な内面の独白がインターネット全体に漏洩した事件です。

社会は常にプライバシーと透明性のバランスに依存しています。ある場面では、私もプライバシーの制限を支持します。人々が通常この点で主張するのとは全く異なる例を挙げると、私は米国政府が雇用契約における競業避止条項を禁止する措置を支持します。これは主に従業員への直接的影響のためではなく、企業に隠れたノウハウを部分的にオープンソース化させることを強いるためです。企業が望むよりもオープンになることを強いるのはプライバシーの制限ですが、私はこれを純利益だと考えます。しかし、大局的に見れば、近い将来の技術がもたらす最も切実なリスクは、プライバシーが歴史的最低水準に近く、極めて不均衡な形で、最も権力を持つ個人と最も強力な国家がすべての人々の大量のデータを手に入れ、他の人々はほとんど何も得られない状態になることです。したがって、すべての人々のプライバシーを支持し、必要なツールをオープンソースで、普遍的で、信頼でき、安全なものにすることが、我々の時代の重要な課題の一つです。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News