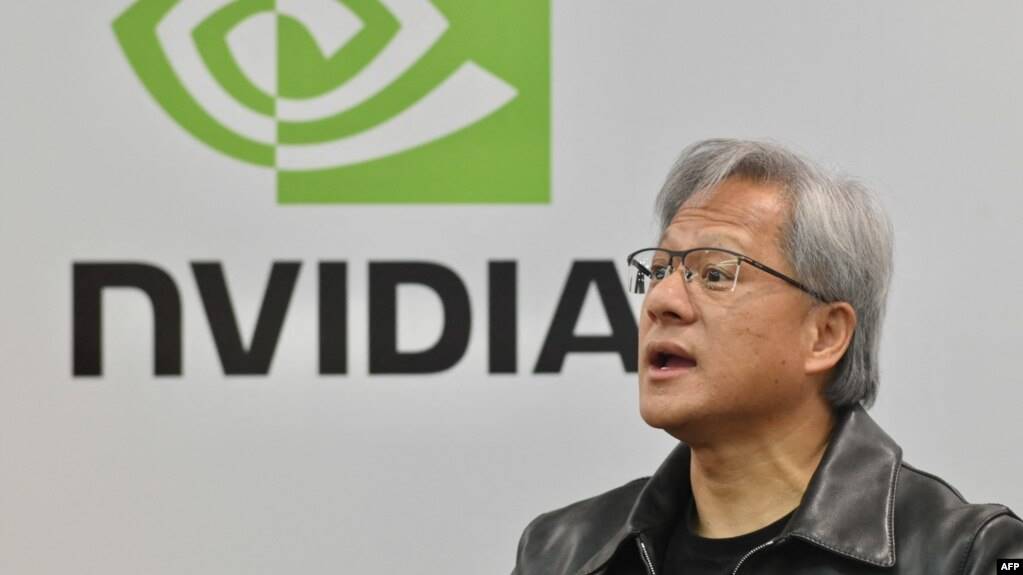

Dernière interview de Jensen Huang : forcer DeepSeek et Huawei à nouer un partenariat étroit – cela effraie grandement les États-Unis

TechFlow SélectionTechFlow Sélection

Dernière interview de Jensen Huang : forcer DeepSeek et Huawei à nouer un partenariat étroit – cela effraie grandement les États-Unis

Concernant les exportations vers la Chine, il a critiqué sévèrement la politique extrême de contrôle des exportations, la qualifiant d’« infantile ».

Rédaction : Xiao Xiao, NetEase Intelligent

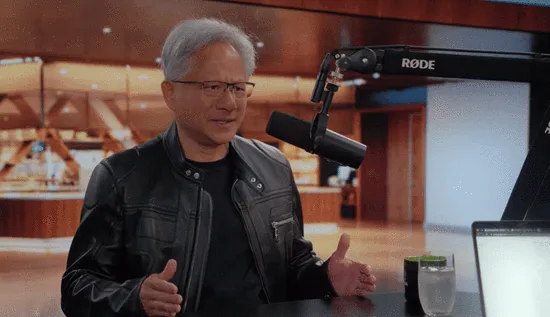

Jensen Huang, PDG de NVIDIA, a récemment accordé une interview exclusive à Dwarkesh Patel, animateur renommé d’un podcast technologique américain, y répondant de façon exhaustive aux questions clés portant sur la « moats » (avantages concurrentiels durables) de l’entreprise, la concurrence avec les TPU de Google et les exportations de puces vers la Chine.

Il a souligné que la « moat » de NVIDIA s’étend désormais profondément dans la chaîne d’approvisionnement, grâce à des engagements d’achat de plusieurs centaines de milliards de dollars pris auprès de TSMC et de fournisseurs de mémoire.

Concernant la concurrence avec les TPU, Huang a précisé que le cas d’Anthropic constitue un exemple unique de croissance des ASIC, non pas une tendance générale. Le calcul accéléré de NVIDIA couvre des domaines bien plus vastes que l’IA seule, tels que la dynamique moléculaire, le traitement des données ou la mécanique des fluides ; par ailleurs, la grande programmabilité de CUDA permet chaque année des gains de performance allant de 10 à 50 fois.

Il a également expliqué pourquoi NVIDIA ne devient pas elle-même un fournisseur de services cloud à très grande échelle. Bien que disposant de trésoreries abondantes, NVIDIA reste fidèle à son principe fondamental : ne faire que ce qui est strictement nécessaire, et le moins possible. Elle choisit donc de soutenir son écosystème via des investissements dans des entreprises telles que CoreWeave, OpenAI et Anthropic, plutôt que de rivaliser directement avec ses propres clients. Il a reconnu, en outre, avoir commis une erreur en n’ayant pas investi massivement plus tôt dans Anthropic. Enfin, il a insisté sur le fait que, même si la révolution IA n’avait jamais eu lieu, NVIDIA serait devenue une entreprise majeure grâce au calcul accéléré dans des domaines tels que la physique, la chimie ou le traitement des données.

Sur les exportations vers la Chine, il a critiqué sévèrement les politiques restrictives extrêmes, qu’il juge « naïves ». Huang a rappelé que la puissance de calcul IA résulte de la combinaison entre puces et énergie : bien que limitée par l’absence de machines de lithographie EUV, la Chine dispose d’une capacité de fabrication massive de puces en nœud 7 nm. Comme les grands modèles actuels sont principalement entraînés sur l’architecture Hopper, la Chine peut parfaitement compenser l’écart de performance unitaire par une abondance d’énergie électrique et un agrandissement de ses grappes de puces.

En outre, l’immense communauté chinoise de chercheurs en IA améliore activement les performances des modèles grâce à des avancées plus efficaces en informatique. Huang a cité DeepSeek comme exemple concret, soulignant qu’il ne s’agit en aucun cas d’un progrès anodin. Si ces excellents modèles open source étaient contraints de s’optimiser profondément et exclusivement pour du matériel local tel que celui d’Huawei — et fonctionnaient alors de façon optimale uniquement sur cette plateforme — cela affaiblirait objectivement l’avantage mondial de la pile technologique américaine. Selon lui, abandonner délibérément le deuxième plus grand marché mondial pousserait la Chine à construire une architecture de calcul fondamentale indépendante des États-Unis. À mesure que ces technologies basées sur des standards ouverts se diffuseraient progressivement vers les pays du Sud global, les États-Unis risqueraient fortement de perdre leur avantage dans la compétition à long terme pour les normes de l’écosystème IA.

Voici l’intégralité de l’interview de Jensen Huang :

Le contrôle de la chaîne d’approvisionnement constitue-t-il la plus grande « moat » de NVIDIA ?

Patel : De nombreuses entreprises logicielles voient leur valorisation baisser, car on estime que l’IA va transformer le logiciel en une simple marchandise. Certains pensent que NVIDIA envoie simplement ses fichiers de conception à TSMC, qui fabrique les puces logiques et les commutateurs, puis utilise les mémoires HBM de SK Hynix, Micron et Samsung pour l’emballage, avant d’envoyer l’ensemble à des fabricants d’OEM taïwanais pour l’assemblage en racks. Fondamentalement, NVIDIA ne ferait que du logiciel, tandis que le matériel serait produit par d’autres. Si le logiciel devient une marchandise, NVIDIA ne subirait-elle pas le même sort ?

Huang : Quelqu’un doit inévitablement transformer des électrons en tokens. Ce processus de transformation est extrêmement difficile à totalement banaliser. Rendre un token plus précieux qu’un autre revient à rendre une molécule plus précieuse qu’une autre : cela exige une immense quantité de technologie, d’ingénierie, de science et d’invention. Ces travaux ne sont ni entièrement compris, ni achevés. Je ne crois pas qu’une telle banalisation puisse se produire.

Mais nous rendons ce processus de plus en plus efficace. La manière dont vous formulez votre question reflète précisément mon modèle de réflexion sur l’entreprise : entrée = électrons, sortie = tokens, et NVIDIA se situe au cœur. Notre principe est de faire uniquement ce qui est indispensable, et le moins possible. « Le moins possible » signifie que tout ce que je n’ai pas besoin de faire moi-même sera confié à des partenaires, afin d’en faire partie intégrante de notre écosystème.

Aujourd’hui, NVIDIA est probablement l’entreprise disposant du plus vaste écosystème de partenaires, couvrant l’ensemble de la chaîne d’approvisionnement — amont et aval — ainsi que tous les constructeurs d’ordinateurs, développeurs d’applications et fabricants de modèles. L’IA ressemble à un gâteau à cinq étages : nous avons bâti notre propre écosystème à chaque niveau. Nous faisons le minimum, mais cette part minimale que nous devons impérativement réaliser est extrêmement complexe — et je ne pense pas qu’elle puisse être banalisée.

Par ailleurs, je ne crois pas non plus que les entreprises de logiciels professionnels soient vouées à la banalisation. La plupart d’entre elles sont aujourd’hui des fournisseurs d’outils — Excel, PowerPoint, Cadence, Synopsys, etc. Contrairement à beaucoup, je pense que le nombre d’agents intelligents (« intelligent agents ») augmentera exponentiellement, tout comme le nombre d’utilisateurs de ces outils. Le nombre d’instances de ces outils pourrait exploser.

Prenons l’exemple du compilateur de conception de Synopsys : de nombreux agents intelligents l’utiliseront pour effectuer le placement et la vérification des règles de conception. Aujourd’hui, ce qui limite notre capacité, c’est le nombre d’ingénieurs disponibles ; demain, chaque ingénieur sera assisté par une multitude d’agents intelligents. Nous pourrons explorer l’espace de conception de façons sans précédent, avec les mêmes outils d’aujourd’hui. Une utilisation intensive de ces outils fera décoller les entreprises logicielles. Cela ne s’est pas encore produit parce que les agents intelligents ne maîtrisent pas encore suffisamment ces outils. Soit ces entreprises logicielles développeront elles-mêmes leurs propres agents, soit les agents deviendront suffisamment performants pour utiliser aisément ces outils — je pense que les deux scénarios se réaliseront.

Patel : Dans vos derniers documents, j’ai vu des engagements d’achats proches de 100 milliards de dollars en faveur des fondeurs, des mémoires et des services d’emballage. Le cabinet de recherche SemiAnalysis estime que ce chiffre atteindra 250 milliards de dollars. Une interprétation courante est que la « moat » de NVIDIA réside dans sa capacité à verrouiller, pour plusieurs années, des composants rares. D’autres peuvent certes concevoir des accélérateurs, mais ils ne parviennent pas à obtenir les mémoires ou les puces logiques nécessaires. S’agit-il là de notre principale « moat » pour les années à venir ?

Huang : C’est l’un des domaines où nous sommes capables de réussir, alors que d’autres peinent fortement. Nous avons pris d’importants engagements vis-à-vis de nos fournisseurs amont : certains sont explicites, comme ceux que vous mentionnez ; d’autres sont implicites, par exemple des investissements amont massifs motivés par mes discussions avec les PDG concernés, lors desquelles je leur ai exposé, avec des raisonnements solides, l’ampleur future du secteur et les raisons de cette croissance — ce qui les a convaincus d’investir.

Pourquoi acceptent-ils d’investir pour moi, et non pour d’autres ? Parce qu’ils savent que je suis capable d’absorber toute leur production, puis de la commercialiser via mes clients aval. La demande et la chaîne d’approvisionnement aval de NVIDIA sont tellement vastes qu’ils acceptent volontiers d’investir en amont.

Regardez la conférence GTC : tous sont ébahis devant son ampleur et son dynamisme. C’est la communauté IA tout entière qui se rassemble, car elle a besoin d’échanger et d’être vue. J’ai organisé ce rassemblement afin que les clients aval voient les fournisseurs amont, et vice versa, et que chacun prenne conscience des progrès réalisés. Ils y rencontrent aussi toutes les startups natives de l’IA. Ainsi, ils peuvent vérifier personnellement les affirmations que je leur ai faites. Je consacre une énorme quantité de temps — directement ou indirectement — à faire comprendre à la chaîne d’approvisionnement, aux partenaires et à l’écosystème l’opportunité qui s’offre à eux.

Certains disent que mes discours d’ouverture ressemblent à des cours magistraux, parfois même pénibles. C’est exactement mon intention : je dois faire comprendre à toute la chaîne d’approvisionnement — amont, aval, écosystème — ce qui va se produire, pourquoi, quand, à quelle échelle, et comment penser systématiquement, comme moi.

Notre « moat » consiste en réalité à anticiper l’avenir. Si nous devions réellement atteindre une capitalisation de mille milliards de dollars dans les années à venir, nous serions naturellement capables de bâtir une chaîne d’approvisionnement à la hauteur. Mais cela suppose déjà une activité substantielle, une influence considérable et une rotation rapide de nos opérations — tout comme la trésorerie, la chaîne d’approvisionnement possède sa propre vitesse de rotation. Si l’activité était trop lente, personne ne voudrait construire une chaîne d’approvisionnement pour une coquille vide. Le fait que nous maintenions aujourd’hui une telle échelle repose fondamentalement sur une demande aval extrêmement forte. Lorsqu’ils voient, entendent et comprennent que tout cela se produit réellement, cela nous permet d’accomplir, à notre échelle actuelle, tout ce que nous réalisons aujourd’hui.

Patel : J’aimerais examiner plus précisément la capacité des fournisseurs amont à suivre le rythme. Vos revenus doublent depuis plusieurs années consécutives, et la puissance de calcul que vous fournissez au monde augmente chaque année de plus de deux fois.

Huang : Doubler à une telle échelle est effectivement remarquable.

Patel : Mais examinez les puces logiques. Vous êtes le plus gros client de TSMC sur le nœud N3, et l’un des plus importants sur le nœud N2. SemiAnalysis constate que l’IA représentera 60 % de la capacité N3 cette année, et 86 % l’année prochaine. Si vous occupez déjà la plus grande part, comment pouvez-vous continuer à doubler chaque année ? Sommes-nous entrés dans une phase où la croissance de la puissance de calcul IA doit ralentir en raison de limitations amont ? Voyez-vous une solution ? En définitive, comment pouvons-nous doubler chaque année la capacité des usines de semi-conducteurs ?

Huang : À tout instant, la demande ponctuelle peut excéder l’offre globale, tant amont qu’aval. Même le nombre de plombiers peut constituer une limitation — cela s’est déjà produit.

Patel : Les plombiers devraient être invités à la prochaine édition de GTC.

Huang : Excellente idée. Mais c’est en réalité un bon signe. On souhaite que la demande ponctuelle d’un secteur dépasse son offre totale ; l’inverse serait problématique. Si un composant manque gravement, toute l’industrie se mobilise pour résoudre le problème. Vous remarquerez qu’on parle peu aujourd’hui de CoWoS. Car nous y avons travaillé intensément ces deux dernières années, et la situation s’est nettement améliorée. TSMC sait désormais que la capacité CoWoS doit suivre celle des puces logiques et des mémoires. Ils étendent CoWoS et les futures technologies d’emballage à la même vitesse que les puces logiques. C’est excellent, car CoWoS et les mémoires HBM étaient auparavant des technologies de niche, et sont désormais des technologies centrales du calcul.

Nous pouvons désormais influencer une chaîne d’approvisionnement bien plus large. Dès le début de la révolution IA, j’ai formulé ces mêmes analyses — il y a cinq ans. Certains y ont cru et ont investi, notamment Sanjay Mehrotra, PDG de Micron, et son équipe. Je me souviens parfaitement de cette réunion : j’y avais décrit avec précision ce qui allait se produire, pourquoi, et comment la situation se présente aujourd’hui. Ils ont effectivement doublé leurs investissements. Nous collaborons sur les mémoires LPDDR et HBM, et leurs investissements massifs ont porté leurs fruits. D’autres sont arrivés plus tard, mais ils sont tous désormais présents.

Chaque goulot d’étranglement attire une attention massive. Nous prévoyons ces goulots plusieurs années à l’avance. Par exemple, nos investissements passés dans Lumentum, Coherent et l’écosystème de la photonique silicium ont redéfini la chaîne d’approvisionnement. Nous avons bâti une chaîne d’approvisionnement complète autour de TSMC, avec qui nous développons conjointement la plateforme d’intégration photonique silicium COUPE, inventant de nombreuses technologies et octroyant des licences de brevets à l’ensemble de la chaîne d’approvisionnement, dans un esprit d’ouverture.

Nous renforçons la chaîne d’approvisionnement en inventant de nouvelles technologies, de nouveaux procédés, de nouveaux équipements de test (comme le test double-face), en investissant dans des entreprises pour les aider à étendre leur capacité. Nous façonnons activement l’écosystème afin qu’il puisse supporter cette échelle.

Patel : Certains goulots semblent plus faciles à résoudre que d’autres, comme l’extension de la capacité CoWoS.

Huang : Nous nous chargeons des plus difficiles.

Patel : Lesquels ?

Huang : Les plombiers et les électriciens. C’est ce qui m’inquiète chez les « apocalyptiques ». Ils annoncent la disparition des emplois, la fin des métiers. Si nous empêchons les gens de devenir ingénieurs logiciels, nous épuiserons rapidement cette profession. Ce genre de prédiction existait déjà il y a dix ans. Certains « apocalyptiques » affirmaient qu’il ne fallait surtout pas devenir radiologue — vous pouvez encore trouver sur Internet des vidéos affirmant que la radiologie serait le premier métier à disparaître, que le monde n’aurait plus jamais besoin de radiologues. Devinez ce dont nous manquons aujourd’hui ? De radiologues.

Patel : Certaines choses sont évolutives, d’autres non. Comment fabriquez-vous chaque année deux fois plus de puces logiques ? En fin de compte, les mémoires et les puces logiques dépendent toutes deux des machines de lithographie EUV. Comment obtenez-vous chaque année deux fois plus de machines EUV ?

Huang : Ces capacités peuvent être rapidement étendues : cela prend deux ou trois ans. Il suffit d’envoyer un signal de demande à la chaîne d’approvisionnement. Si l’on peut en fabriquer un, on peut en fabriquer dix ; si l’on peut en fabriquer dix, on peut en fabriquer un million. Leur duplication n’est pas difficile.

Patel : Jusqu’où irez-vous dans la chaîne d’approvisionnement ? Allez-vous directement voir ASML pour leur dire : « Dans trois ans, NVIDIA atteindra un chiffre d’affaires annuel de deux mille milliards de dollars, et nous aurons besoin de bien plus de machines EUV ? »

Huang : Certains points doivent être abordés directement, d’autres indirectement. Si l’on convainc TSMC, ASML sera également convaincue. Il faut identifier les points critiques de blocage. Mais une fois TSMC convaincue, vous disposerez dans les quelques années qui suivent de suffisamment de machines EUV.

Mon point de vue est qu’aucun goulot ne persiste plus de deux ou trois ans. Parallèlement, nous augmentons l’efficacité du calcul de 10 à 20 fois, et de 30 à 50 fois entre Hopper et Blackwell. Grâce à la grande flexibilité de CUDA, nous inventons continuellement de nouveaux algorithmes et technologies, augmentant simultanément la capacité et l’efficacité. Rien de tout cela ne m’inquiète. Ce qui m’inquiète, ce sont les éléments aval : les politiques énergétiques qui freinent l’expansion énergétique, car sans énergie, on ne peut créer aucune nouvelle industrie. Sans énergie, on ne peut développer aucune nouvelle industrie manufacturière.

Nous devons relancer l’industrialisation des États-Unis. Nous devons ramener la fabrication de puces, d’ordinateurs et d’emballages. Nous devons fabriquer des véhicules électriques, des robots, des « usines IA ». Rien de tout cela ne peut être construit sans énergie, or celle-ci prend beaucoup de temps à déployer. La capacité de fabrication de puces est un problème résoluble en deux ou trois ans. La capacité CoWoS l’est aussi.

Les TPU vont-elles briser le contrôle de NVIDIA sur la puissance de calcul IA ?

Patel : Parmi les trois meilleurs modèles mondiaux, deux — Claude et Gemini — sont entraînés sur les TPU de Google. Que signifie cela pour NVIDIA ?

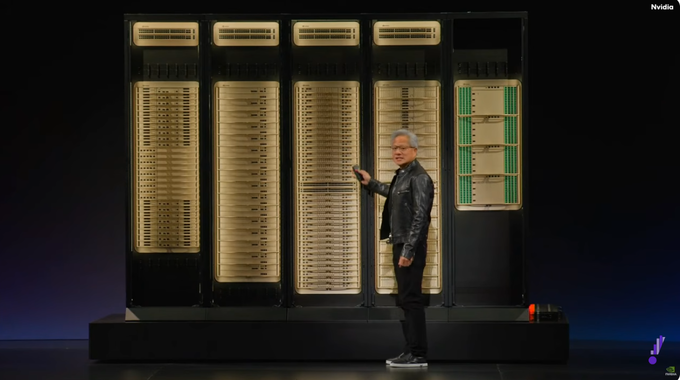

Huang : Ce que nous faisons est très différent. NVIDIA développe le calcul accéléré, pas seulement une unité de traitement de tenseurs. Le calcul accéléré s’applique à de nombreux domaines : dynamique moléculaire, chromodynamique quantique, traitement des données, données structurées et non structurées, mécanique des fluides, physique des particules — et aussi l’IA.

Le calcul accéléré est bien plus vaste. Bien que l’IA soit aujourd’hui le sujet central, et manifestement essentielle et influente, le calcul va bien au-delà. NVIDIA a transformé la façon de calculer, en passant du calcul généraliste au calcul accéléré. Notre marché est bien plus vaste que celui de tout TPU ou ASIC, et nous sommes la seule entreprise capable d’accélérer toutes sortes d’applications. Nous disposons d’un écosystème gigantesque, où tous les frameworks et algorithmes peuvent fonctionner sur NVIDIA.

Comme nos ordinateurs sont conçus pour être manipulés par autrui, n’importe quel exploitant peut acheter nos systèmes. En revanche, la plupart des systèmes internes exigent que vous soyez vous-même l’exploitant, car leur manque de flexibilité empêche toute exploitation externe. Comme n’importe qui peut installer et exploiter nos systèmes, nous sommes présents dans tous les clouds — y compris ceux de Google, Amazon, Azure et Oracle.

Si vous souhaitez louer des ressources, vous avez besoin d’un vaste bassin de clients issus de multiples secteurs pour garantir la demande. Si vous souhaitez les utiliser vous-même, nous pouvons bien entendu vous aider à les exploiter — comme nous l’avons fait pour xAI et Elon Musk. Et nous pouvons doter tout exploitant, dans n’importe quelle entreprise ou secteur, des compétences nécessaires : vous pouvez ainsi construire un supercalculateur pour Eli Lilly destiné à la recherche scientifique et à la découverte de médicaments, et nous pouvons l’exploiter pour l’ensemble de la recherche pharmaceutique et des sciences biologiques.

Il existe une foule d’applications impossibles à exécuter sur des TPU. CUDA est certes une excellente unité de traitement de tenseurs, mais elle traite aussi tous les aspects du traitement des données, les calculs, l’IA, etc. Nos opportunités commerciales sont bien plus vastes, et notre champ d’application bien plus étendu. Comme nous supportons toutes les applications mondiales actuelles, vous pouvez déployer des systèmes NVIDIA partout, en sachant qu’il y aura toujours des clients. C’est une situation radicalement différente.

Patel : Vos revenus sont impressionnants, mais ils ne proviennent pas de la pharmacie ni de la physique quantique — ils proviennent presque entièrement de l’IA. Cette technologie inédite connaît une croissance sans précédent. La question devient alors : quelle architecture est la plus favorable à l’IA elle-même ? Le TPU est essentiellement un vaste réseau pulsé, particulièrement performant pour les multiplications matricielles. Le GPU est plus flexible, adapté aux tâches comportant de nombreuses instructions conditionnelles ou des accès mémoire irréguliers. Mais que fait réellement l’IA ? En somme, l’IA effectue sans cesse des multiplications matricielles très prévisibles. Pourquoi alors réserver de la surface sur la puce à des fonctions générales telles que les planificateurs de thread ou les commutateurs entre threads et banques mémoire ? Cette surface pourrait être entièrement dédiée aux multiplications matricielles. Or le TPU est justement conçu spécifiquement pour la partie du calcul qui explose actuellement. Que pensez-vous de cela ?

Huang : La multiplication matricielle est une composante essentielle de l’IA, mais pas la totalité. Si vous inventez un nouveau mécanisme d’attention, adoptez une autre méthode de décomposition, ou créez une architecture entièrement nouvelle — comme les modèles hybrides d’état-espace (SSM) — vous avez besoin d’une architecture universellement programmable. Si vous créez un modèle combinant diffusion et auto-régression, vous avez également besoin d’une architecture universellement programmable. Nous pouvons exécuter tout ce que vous imaginez. Voilà notre avantage. Sa programmabilité rend bien plus facile l’invention de nouveaux algorithmes.

C’est justement cette capacité à inventer de nouveaux algorithmes qui explique la rapidité des progrès de l’IA. Les TPU, comme tout le reste, obéissent à la loi de Moore, progressant d’environ 25 % par an. Pour réaliser chaque année des bonds de 10 ou 100 fois, la seule méthode consiste à changer radicalement chaque année les algorithmes et les méthodes de calcul.

C’est là que réside l’avantage fondamental de NVIDIA. Blackwell est 50 fois plus économe en énergie que Hopper. Lorsque j’ai annoncé pour la première fois un gain de 35 fois, personne ne m’a cru. Puis quelqu’un a écrit un article affirmant que j’avais sous-estimé la performance réelle, qui atteindrait en fait 50 fois. La loi de Moore ne permettrait pas un tel bond : nous y parvenons grâce à de nouveaux modèles, comme les modèles d’experts mixtes (MoE), qui sont parallélisés, décomposés et distribués sur l’ensemble du système de calcul. Sans CUDA, ni la capacité réelle d’écrire de nouveaux noyaux en profondeur, cela serait extrêmement difficile.

C’est la combinaison d’une architecture programmable et de la capacité de conception collaborative extrême de NVIDIA. Nous pouvons même décharger certaines opérations sur la structure réseau elle-même — comme NVLink ou Spectrum-X. Nous pouvons modifier simultanément le processeur, le système, la structure réseau, les bibliothèques et les algorithmes. Sans CUDA, je ne sais même pas par où commencer.

Patel : Cela soulève une question intéressante sur les clients de NVIDIA. 60 % de vos revenus proviennent de cinq fournisseurs cloud à très grande échelle. Autrefois, vos clients étaient des professeurs menant des expériences : ils avaient besoin de CUDA et ne pouvaient pas utiliser d’autres accélérateurs ; ils se contentaient d’exécuter PyTorch sur CUDA, et tout était déjà optimisé. Mais ces géants du cloud ont la capacité d’écrire eux-mêmes leurs propres noyaux. En effet, pour tirer les 5 % ultimes de performances d’une architecture spécifique, ils y sont contraints. Anthropic et Google utilisent principalement leurs propres accélérateurs — respectivement les TPU et Trainium. Même OpenAI, qui utilise des GPU, a développé Triton, car il a besoin de ses propres noyaux. Il n’utilise pas cuBLAS ni NCCL, mais sa propre pile logicielle, pouvant aussi être compilée pour d’autres accélérateurs. Si la majorité de vos clients peuvent — et font effectivement — créer des alternatives à CUDA, dans quelle mesure CUDA reste-t-elle un facteur critique pour faire tourner les IA de pointe sur le matériel NVIDIA ?

Huang : CUDA est un écosystème extrêmement riche. Si vous souhaitez développer sur n’importe quel ordinateur, choisir CUDA est une décision très judicieuse. Son écosystème est si vaste que nous supportons tous les frameworks. Si vous souhaitez écrire des noyaux personnalisés, notre contribution à Triton est considérable, et le backend de Triton intègre de nombreuses technologies NVIDIA.

Nous sommes ravis d’aider chaque framework à s’améliorer. Il en existe de nombreux — Triton, vLLM, SGLang. De nouveaux frameworks d’apprentissage par renforcement apparaissent aussi, comme verl et NeMo RL. La phase de post-entraînement et l’apprentissage par renforcement connaissent une explosion. Ainsi, si vous développez sur une architecture donnée, choisir CUDA est le plus pertinent, car vous savez que son écosystème est excellent.

Vous savez que si quelque chose ne fonctionne pas, le problème viendra plus probablement de votre propre code que de la masse colossale de systèmes sous-jacents. N’oubliez pas l’ampleur du code impliqué. Lorsque le système ne fonctionne pas, vous devez vous demander : « Est-ce moi qui me suis trompé, ou est-ce l’ordinateur ? » Vous espérez naturellement vous être trompé à chaque fois, car seul ce scénario vous permet de faire pleinement confiance à l’ordinateur. Bien sûr, nous avons encore de nombreux bogues. Mais l’essentiel est que notre système a été éprouvé des milliers de fois, et que vous pouvez y construire en toute confiance. C’est le premier point que je veux souligner : richesse, programmabilité et puissance de l’écosystème.

Deuxièmement, si vous êtes développeur, ce que vous désirez le plus, c’est une base installée massive. Vous souhaitez que votre logiciel puisse fonctionner sur de nombreux autres ordinateurs. Vous ne développez pas uniquement pour vous, mais pour votre cluster, ou pour celui d’autrui — car vous êtes développeur de framework. L’écosystème CUDA de NVIDIA est, en fin de compte, sa plus grande richesse.

Nous avons aujourd’hui des centaines de millions de GPU déployés dans le monde, dans tous les clouds. Des A10, A100, H100, H200 aux séries L, P, et bien d’autres tailles et formes. Si vous êtes une entreprise de robotique, vous souhaitez que la pile CUDA fonctionne directement à l’intérieur du robot. Nous sommes presque omniprésents. Cette base installée signifie que, dès que vous développez un logiciel ou un modèle, il fonctionnera partout. Cette valeur est inestimable.

Enfin, nous sommes présents dans tous les clouds, ce qui nous rend véritablement uniques. Si vous êtes une entreprise IA ou un développeur, vous ne savez pas encore avec quel fournisseur cloud vous allez collaborer, ni où vous allez déployer vos charges de travail. Peu importe : nous sommes partout, y compris dans votre propre salle informatique. La richesse de l’écosystème, l’étendue de la base installée et la diversité des lieux de déploiement font de CUDA une ressource inestimable.

Patel : Cela semble logique. Mais je voudrais savoir dans quelle mesure ces avantages sont cruciaux pour vos plus gros clients. Pour beaucoup, CUDA peut être très précieuse. Mais la majeure partie de vos revenus provient en réalité de ces gros clients capables de construire eux-mêmes leur pile logicielle. En particulier, si l’IA pénètre à l’avenir des domaines où l’apprentissage par renforcement permet une validation rigoureuse, la question devient : qui saura écrire les noyaux de multiplication matricielle et d’attention les plus rapides sur de grands clusters ? Il s’agit d’un problème d’optimisation parfaitement vérifiable.

Ces géants du cloud ont pleinement la capacité d’écrire eux-mêmes ces noyaux personnalisés. Certes, le rapport coût-performance de NVIDIA peut rester meilleur, ce qui les incitera à continuer de choisir NVIDIA. Mais cela conduit alors à la question suivante : ne s’agira-t-il plus que d’une course aux spécifications matérielles, et à qui offrira le plus de puissance de calcul et de bande passante par dollar ?

Historiquement, NVIDIA a pu maintenir des marges supérieures à 70 % sur le matériel et le logiciel IA grâce à sa « moat » CUDA. Mais la question est désormais : si vos plus gros clients peuvent contourner cette « moat », pourrez-vous maintenir de telles marges ?

Huang : Le nombre d’ingénieurs que nous affectons à ces laboratoires IA est stupéfiant : nous travaillons avec eux pour optimiser leur pile logicielle. La raison en est simple : personne ne connaît mieux notre architecture que nous-mêmes. Ces architectures ne sont pas aussi universelles que les CPU. Un CPU ressemble un peu à une Cadillac : facile à conduire, sans pousser les limites, accessible à tous, avec un régulateur de vitesse, tout est simple. En revanche, les GPU et accélérateurs NVIDIA ressemblent davantage à des F1. Je peux imaginer que tout le monde puisse atteindre 160 km/h, mais pousser la machine à ses limites exige une expertise considérable. Nous utilisons une grande quantité d’IA pour écrire des noyaux.

Je suis convaincu que, pendant une longue période encore, nous resterons indispensables. Notre expertise permet souvent à nos partenaires laboratoires IA d’obtenir facilement un gain de performance de 2 fois. Après avoir optimisé un noyau ou l’ensemble de la pile logicielle, il est courant de voir la vitesse des modèles augmenter de 50 %, 2 fois, ou même 3 fois. Compte tenu de la taille de leurs clusters Hopper et Blackwell, ce chiffre est colossal. Un gain de 2 fois équivaut directement à un doublement des revenus.

La pile de calcul NVIDIA offre le meilleur coût total de possession (TCO) au monde — personne ne peut faire mieux. Aucune plateforme ne peut me montrer un meilleur rapport performance/TCO que le nôtre. Le benchmark InferenceMAX de Dylan est là pour le prouver, et tout le monde peut l’utiliser. Mais les TPU ne viennent pas le passer, ni les Trainium. Je les encourage vivement à utiliser InferenceMAX pour démontrer leur prétendu coût d’inférence ultra-faible. Mais c’est difficile, car personne ne veut venir le faire.

Il en va de même pour MLPerf : j’aimerais beaucoup que Trainium montre leur avantage de 40 % qu’ils vantent constamment. J’aimerais aussi entendre leur démonstration de l’avantage coût de TPU. Mais selon moi, ces avantages invoqués ne tiennent pas debout sur des principes premiers. Je pense donc que notre succès est tout simplement dû à notre TCO exceptionnel.

Deuxièmement, vous dites que 60 % de nos clients sont les cinq plus grands fournisseurs cloud, mais la majeure partie de ces activités est orientée vers l’extérieur. Par exemple, la plupart des puces NVIDIA utilisées sur AWS sont destinées à des clients externes, pas à un usage interne. Les clients d’Azure sont évidemment externes, tout comme ceux d’Oracle. Ils nous privilégient parce que notre influence est immense : nous leur apportons les meilleurs clients du monde, tous construits sur NVIDIA. Et ces entreprises sont construites sur NVIDIA parce que notre influence et notre polyvalence sont exceptionnelles.

Je pense donc que ce cercle vertueux repose sur la base installée, la programmabilité de l’architecture et la richesse de l’écosystème, complétée par des milliers d’entreprises IA dans le monde. Si vous êtes une startup IA, quelle architecture choisirez-vous ? Vous choisirez la plus riche — et nous sommes la plus riche. Vous choisirez celle ayant la base installée la plus vaste — et c’est la nôtre. Vous choisirez celle disposant de l’écosystème le plus complet. C’est ce cercle vertueux.

En combinant tous ces éléments, notre performance par dollar est la meilleure au monde, et le coût par token pour nos clients est le plus bas. Notre performance par watt est la plus élevée au monde, donc si un partenaire construit un centre de données de 1 GW, ce centre doit générer le maximum de revenus et de tokens — ce qui équivaut directement aux revenus. Vous souhaitez qu’il produise le plus de tokens possible pour maximiser les revenus, et nous sommes l’architecture offrant le plus de tokens par watt au monde. En outre, si votre objectif est de louer des infrastructures, nous disposons du plus grand nombre de clients au monde. Voilà pourquoi ce cercle vertueux fonctionne.

Patel : Intéressant. Je pense que la question fondamentale est : quelle est la structure réelle du marché ? Car même si d’autres entreprises existent, on pourrait imaginer un monde où des milliers d’entreprises IA se partagent à peu près équitablement la puissance de calcul. Mais la réalité est que, même via ces cinq fournisseurs cloud, la puissance de calcul utilisée sur Amazon provient en fait d’Anthropic, d’OpenAI et de ces grands laboratoires fondamentaux. Ces grands acteurs ont eux-mêmes la capacité et les ressources pour faire fonctionner différents accélérateurs.

Si tout ce que vous dites sur le rapport coût-performance, la performance par watt, etc., est vrai, pourquoi Anthropic, il y a quelques jours, a-t-elle annoncé un accord avec Broadcom et Google portant sur plusieurs gigawatts de TPU, plaçant la majeure partie de sa puissance de calcul dessus ? Pour Google, les TPU représentent aussi la majeure partie de sa puissance de calcul. Donc, si l’on observe ces grandes entreprises IA, on constate que leur puissance de calcul était autrefois entièrement fournie par NVIDIA, ce qui n’est plus le cas. Je suis curieux de savoir pourquoi, si ces avantages théoriques sont réels, ils ont choisi d’autres accélérateurs ?

Huang : Anthropic est un cas particulier, pas une tendance générale. Réfléchissez-y : sans Anthropic, d’où viendrait la croissance des TPU ? À 100 % d’Anthropic. De même, sans Anthropic, d’où viendrait la croissance de Trainium ? À 100 % d’Anthropic. C’est pratiquement un secret de polichinelle. Ce n’est pas qu’il y ait soudain une multitude d’opportunités pour les ASIC — il n’y a tout simplement qu’Anthropic.

Patel : Mais OpenAI a un accord avec AMD, et développe elle-même son accélérateur Titan.

Huang : Oui, mais tout le monde reconnaît qu’une très grande partie de leur puissance de calcul tourne encore sur NVIDIA. Nous continuons à collaborer étroitement. Je n’ai rien contre l’utilisation d’autres technologies, ou les essais d’autres solutions. Si elles n’essaient pas, comment sauraient-elles à quel point les nôtres sont bonnes ? Parfois, il faut un rappel. Nous devons constamment conquérir et conserver notre position actuelle.

Des promesses extravagantes sont souvent faites. Regardez combien de projets ASIC ont été annulés. Juste parce que vous décidez de construire un ASIC, cela ne signifie pas que vous pouvez facilement le rendre meilleur que NVIDIA. En fait, cela n’est pas raisonnable, sauf si NVIDIA comporte nécessairement une faille. Or notre échelle et notre vitesse sont là : nous sommes la seule entreprise au monde à lancer chaque année de nouveaux produits, avec des progrès spectaculaires.

Patel : Je suppose que leur raisonnement est qu’il n’a pas besoin d’être meilleur que NVIDIA, à condition de ne pas être trop inférieur — disons, pas plus de 30 % moins performant — car ils vous paient une marge de 70 %.

Huang : Non, n’oubliez pas que la marge des ASIC est aussi très élevée. Supposons que la marge de NVIDIA soit de 70 %, et celle des ASIC de 65 %. Que sauvez-vous réellement ?

Patel : Vous parlez de sociétés comme Broadcom ?

Huang : Exactement. Vous devez payer quelqu’un d’autre. À ma connaissance, la marge des ASIC est très élevée ; ils le reconnaissent eux-mêmes, et en sont même fiers.

Alors pourquoi ? Il y a longtemps, nous n’en avions tout simplement pas la capacité. Je n’avais pas pleinement conscience, à l’époque, de la difficulté extrême à créer un laboratoire IA fondamental comme OpenAI ou Anthropic, ni du fait qu’ils nécessitaient des investissements colossaux de la part de leurs fournisseurs. Nous n’étions pas capables d’investir des dizaines de milliards de dollars dans Anthropic en échange de leur utilisation de notre puissance de calcul. Mais Google et AWS en avaient la capacité. Ils ont investi massivement dès le départ, et en retour, Anthropic a utilisé leur puissance de calcul. Nous n’étions tout simplement pas capables de le faire.

Mon erreur a été de ne pas pleinement réaliser qu’ils n’avaient réellement pas d’autre choix : aucun fonds de capital-risque ne consentirait 5 à 10 milliards de dollars à un laboratoire IA dans l’espoir qu’il devienne Anthropic. C’est là mon erreur. Mais même si j’avais compris cela à l’époque, je ne pense pas que nous aurions eu la capacité de le faire. Je ne commettrai plus cette erreur.

Je serais ravi d’investir dans OpenAI, et de les aider à s’étendre — je crois que c’est nécessaire. Plus tard, lorsque j’ai acquis cette capacité, Anthropic est venue nous voir, et j’ai été ravi de devenir investisseur et de les aider à s’étendre. Nous n’étions tout simplement pas capables de le faire à l’époque. Si je pouvais tout recommencer, si NVIDIA avait aujourd’hui la taille qu’elle a maintenant, je le ferais très volontiers.

Pourquoi NVIDIA ne devient-elle pas un fournisseur cloud à très grande échelle ?

Patel : Depuis des années, NVIDIA est l’entreprise qui gagne de l’argent — et beaucoup — dans le domaine de l’IA. Vous investissez aujourd’hui, par exemple, vous avez investi, selon les rapports, 30 milliards de dollars dans OpenAI et 10 milliards dans Anthropic. Leur valorisation a augmenté, et je crois qu’elle continuera à grimper. Donc, si vous leur fournissez depuis des années de la puissance de calcul, si vous voyez clairement leur direction, et qu’il y a un ou deux ans, leur valeur n’était qu’un dixième de ce qu’elle est aujourd’hui — ou même un dixième il y a un an — et que vous disposez de tant de liquidités, alors soit NVIDIA devrait elle-même devenir un laboratoire fondamental, en y investissant massivement, soit vous auriez dû conclure ces transactions plus tôt, à cette valorisation actuelle. Vous avez les liquidités. Alors pourquoi ne l’avez-vous pas fait plus tôt ?

Huang : Nous avons agi dès que cela nous a été possible, et dès que nous avons eu la capacité de le faire. Si j’avais pu, je l’aurais fait plus tôt. Au moment où Anthropic avait besoin de nous, nous n’étions tout simplement pas capables de le faire — cela ne faisait même pas partie de nos considérations à l’époque.

Patel : Comment cela ? Est-ce une question d’argent ?

Huang : Oui, c’est-à-dire l’ampleur de l’investissement. Nous n’avions jamais réalisé d’investissements externes à l’entreprise, encore moins à une telle échelle. Nous ne nous étions pas rendu compte que cela était nécessaire. J’ai toujours pensé qu’ils pourraient aller chercher du financement auprès des fonds de capital-risque, comme toutes les entreprises. Mais ce qu’ils voulaient faire était au-delà des capacités des fonds de capital-risque. Ce qu’OpenAI voulait faire était au-delà des capacités des fonds de capital-risque. Je le comprends aujourd’hui, mais je ne le savais pas à l’époque.

Mais c’est justement là leur génie — leur intelligence réside précisément là. Ils ont compris très tôt qu’il fallait agir ainsi. Je suis heureux qu’ils l’aient fait. Même si cela a conduit Anthropic à se tourner vers d’autres, je suis heureux que cela se soit produit. L’existence d’Anthropic est une bonne chose pour le monde, et j’en suis heureux.

Patel : Je pense que vous continuez à gagner beaucoup d’argent, et que vos bénéfices augmentent chaque trimestre. Puisque vous disposez de tant d’argent, que devrait faire NVIDIA ? Une réponse est qu’un écosystème entier d’intermédiaires s’est constitué, transformant les dépenses en capital en dépenses opérationnelles pour ces laboratoires, afin qu’ils puissent louer de la puissance de calcul. Car les puces sont coûteuses, mais elles génèrent beaucoup de revenus sur leur cycle de vie, car les modèles IA s’améliorent constamment. La valeur des tokens qu’ils produisent augmente, mais leur déploiement est coûteux. NVIDIA a les moyens de faire des dépenses en capital. En effet, selon les rapports, vous soutenez déjà CoreWeave à hauteur de 6,3 milliards de dollars, et vous avez déjà investi 2 milliards. Pourquoi NVIDIA ne deviendrait-elle pas elle-même un fournisseur de services cloud ? Pourquoi ne deviendrait-elle pas un fournisseur cloud à très grande échelle, louant elle-même de la puissance de calcul ?

Huang : C’est la philosophie de notre entreprise, et je la considère comme sage. Nous devons faire ce qui est nécessaire, mais le moins possible. Cela signifie que, dans la construction de notre plateforme de calcul, si nous ne le faisions pas, je crois sincèrement que personne ne le ferait. Si nous n’assumions pas les risques que nous assumons, si nous ne développions pas NVLink à notre façon, si nous ne construisions pas toute la pile logicielle à notre façon, si nous ne créions pas l’écosystème à notre façon, si nous n’investissions pas 20 ans dans CUDA — en perdant de l’argent la plupart du temps — personne ne le ferait.

Si nous ne créions pas toutes les bibliothèques CUDA-X, orientées vers des domaines spécifiques, nous l’avons fait il y a quinze ans, car nous avons compris que, si nous ne créions pas ces bibliothèques spécialisées — que ce soit pour le lancer de rayons, la génération d’images, les premiers travaux d’IA, les modèles, le traitement des données, le traitement des données structurées ou vectorielles — personne ne le ferait. J’en suis absolument convaincu. Nous avons créé une bibliothèque pour la photolithographie computationnelle appelée cuLitho, et personne ne l’aurait faite sans nous. C’est donc grâce à ces actions que le calcul accéléré a pu progresser autant.

Nous devons donc accomplir cette tâche, y consacrer toute notre énergie et tout notre engagement. Or, il existe de nombreux clouds dans le monde : si je ne le fais pas, quelqu’un d’autre le fera. C’est pourquoi nous appliquons la philosophie « faire ce qui est nécessaire, mais le moins possible », qui imprègne chaque jour de notre entreprise. Chaque action que je mène est examinée à travers ce prisme.

En ce qui concerne les clouds, si nous n’avions pas soutenu CoreWeave, ces nouveaux clouds, ces clouds IA, n’existeraient pas. Si nous n’avions pas aidé CoreWeave, ils n’existeraient pas. Si nous n’avions pas soutenu Nscale, ils n’auraient pas connu leur succès actuel. Si nous n’avions pas soutenu Nebius, ils ne seraient pas ce qu’ils sont aujourd’hui. Maintenant, ils réussissent très bien.

C’est un modèle économique. Nous

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News