Entrevue approfondie avec Jensen Huang : « L’économie des jetons » explose, les 10 000 milliards de dollars d’NVIDIA sont inévitables

TechFlow SélectionTechFlow Sélection

Entrevue approfondie avec Jensen Huang : « L’économie des jetons » explose, les 10 000 milliards de dollars d’NVIDIA sont inévitables

Les ordinateurs sont passés d’un « entrepôt de stockage » non rentable à une usine génératrice de revenus produisant des « biens tokenisés ».

Rédaction : Long Yue

Source : Wall Street Insights

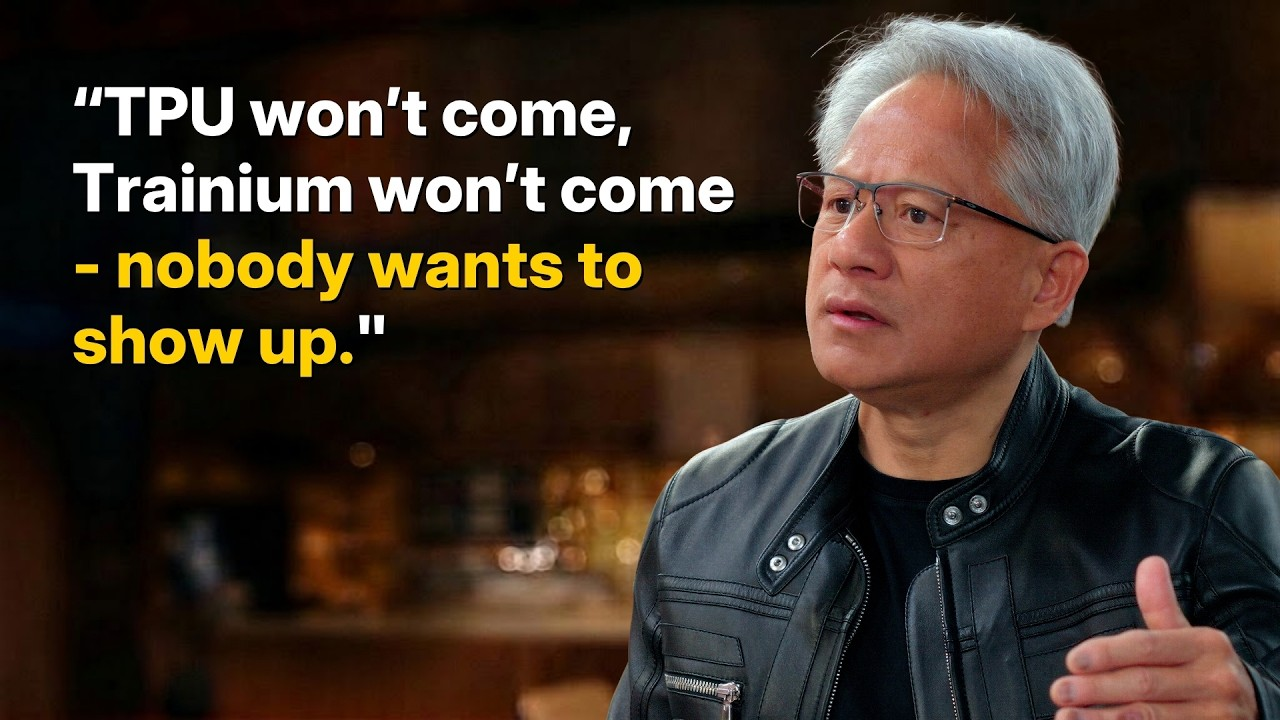

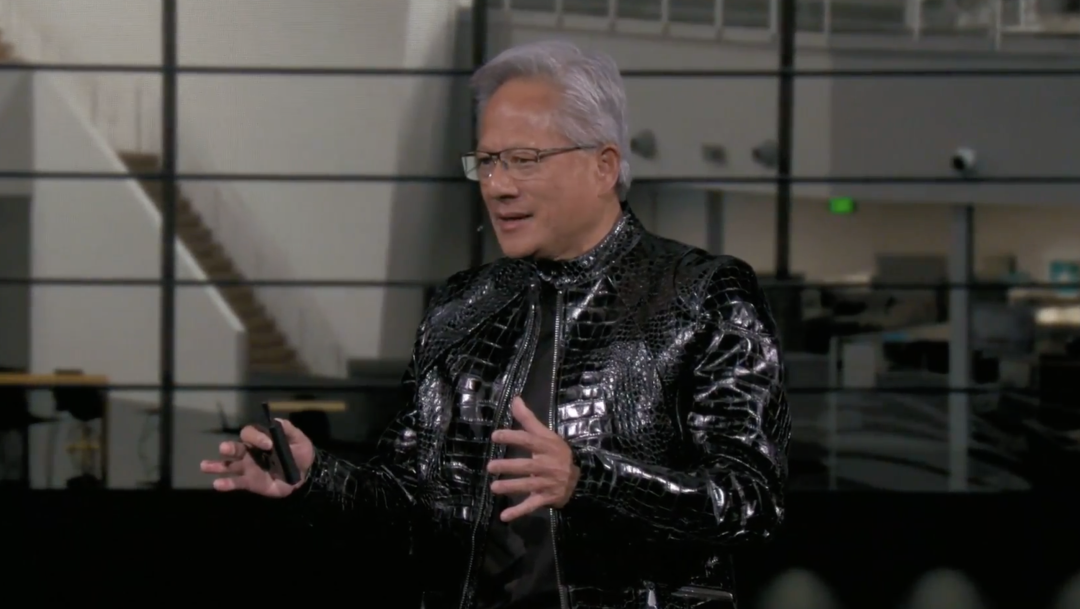

Récemment, Jensen Huang, PDG de NVIDIA, a été invité sur le célèbre podcast technologique Lex Fridman Podcast pour une conversation approfondie de plus de deux heures portant sur les lois d’échelle de l’IA (Scaling Laws), les goulots d’étranglement liés à la puissance de calcul et à l’approvisionnement énergétique, les « usines IA », les perspectives futures de l’entreprise ainsi que l’impact de l’IA sur la société humaine.

Le token est devenu une marchandise entièrement nouvelle : la part du PIB mondial consacrée au calcul devrait être multipliée par cent

L’un des points centraux défendus par Jensen Huang est que la nature même du calcul a connu une transformation fondamentale : il s’est déplacé d’un ancien système de « stockage » où les contenus étaient préenregistrés par l’humain et simplement récupérés par l’ordinateur, vers un système « génératif » doté d’une capacité de perception du contexte.

Plus important encore, le rôle joué par l’ordinateur dans l’économie réelle a changé. Autrefois, les ordinateurs constituaient des systèmes de recherche principalement destinés au stockage de fichiers. Huang les compare à des « entrepôts », dont la valeur ajoutée directe reste limitée.

Aujourd’hui, les ordinateurs dotés d’IA sont devenues des « usines », directement liées à la génération de revenus pour les entreprises. Selon lui, les « usines IA » fabriquent désormais une marchandise baptisée « token », déjà segmentée et tarifée.

« Nous ne constatons pas seulement que ces usines produisent des biens que les consommateurs souhaitent utiliser, mais aussi que les tokens qu’elles génèrent revêtent une valeur extrême pour de nombreux publics différents — au point qu’ils commencent déjà à se hiérarchiser comme l’iPhone : vous avez des tokens gratuits, des tokens premium et des tokens intermédiaires », affirme Huang. « Certains sont prêts à payer 1 000 dollars pour un million de tokens. Cette idée n’est plus une question de “si”, mais de “quand”. »

Grâce à ce modèle d’« usine à tokens », les équipements informatiques ont franchi le cap de la simple unité de coût pour devenir une véritable source de profit.

Huang développe avec conviction cette tendance macroéconomique : « Si la productivité augmente considérablement, la croissance du PIB mondial s’accélérera. Je suis absolument convaincu que la part du PIB mondial consacrée au calcul sera cent fois supérieure à celle d’autrefois. »

Vers une capitalisation boursière de 10 000 milliards de dollars ? Huang : la croissance est inévitable

Partant de cette théorie économique centrée sur le « token », Huang répond à la question de savoir si NVIDIA peut atteindre une nouvelle apogée de capitalisation boursière à 10 000 milliards de dollars.

Il déclare : « Ce chiffre (10 000 milliards) n’est qu’un nombre. » Toutefois, il précise clairement : « La croissance de NVIDIA est très probable, voire inévitable, selon moi. » Atteindre un chiffre d’affaires de 3 000 milliards de dollars n’est pas une hypothèse irréaliste.

Solution au goulot d’étranglement énergétique : « valoriser l’électricité inutilisée » et concevoir des centres de données capables de « dégradation élégante »

Concernant les freins à l’expansion de l’IA, Huang affirme sans détour : « L’énergie est une préoccupation, mais pas la seule. » Il propose deux voies complémentaires : premièrement, poursuivre l’amélioration de l’efficacité énergétique ; deuxièmement, trouver des moyens d’accéder à davantage d’électricité.

En matière d’efficacité énergétique, il insiste sur l’indicateur « nombre de tokens par seconde et par watt », et met en avant l’« intégration extrême » comme levier principal : « Le prix de nos ordinateurs augmente, mais leur efficacité de génération de tokens augmente encore plus vite — ce qui fait baisser le coût par token… chaque année d’un ordre de grandeur. »

Quant à l’« accès à l’électricité », il avance une piste concrète : les réseaux électriques sont conçus pour supporter des pics extrêmes, alors qu’ils fonctionnent à un niveau inférieur pendant la majeure partie du temps. Huang explique que les réseaux actuels sont dimensionnés sur la base des pics extrêmes associés aux conditions météorologiques les plus sévères (avec une marge de sécurité supplémentaire). « Pendant 99 % du temps, notre réseau électrique ne connaît pas ces scénarios les plus défavorables », précise-t-il. « Dans la plupart des cas, il fonctionne à environ 60 % de sa capacité maximale. »

Pour tirer parti de cette électricité inutilisée, il estime nécessaire de repenser les contrats rigoureux liant les fournisseurs de services cloud et les sociétés d’électricité, en renonçant à la quête aveugle d’une disponibilité absolue garantie à « six neuf » (99,9999 %).

« Nous devons concevoir des centres de données capables de “dégradation élégante” (gracefully degrade) », explique Huang. « Lorsque le réseau nous demande de réduire notre consommation électrique à 80 %, le centre de données peut transférer ses charges critiques ou ralentir son rythme de calcul. La qualité du service informatique diminue légèrement, mais notre consommation énergétique baisse. »

Chaîne d’approvisionnement et mémoire : mobilisation de 200 fournisseurs, anticipation stratégique de trois ans sur la mémoire HBM

Face aux inquiétudes du marché concernant des maillons critiques tels que les machines à photolithographie EUV d’ASML ou le procédé d’empilement avancé CoWoS de TSMC, Huang exprime un calme total. « Je leur dis ce dont j’ai besoin, ils me disent comment ils comptent y répondre, et je leur fais confiance », déclare-t-il.

Sur le plan de l’ingénierie système, NVIDIA transforme profondément le mode de fabrication des infrastructures. Huang révèle qu’un seul rack Vera Rubin intègre entre 1,3 et 1,5 million de composants, issus de la technologie fournie par 200 fournisseurs distincts.

Pour répondre à cette densité interconnectée extrême (ex. : NVLink-72), la méthode traditionnelle consistant à assembler sur site les composants dans les centres de données est désormais obsolète. NVIDIA a déplacé l’assemblage des supercalculateurs vers la phase de « fabrication de supercalculateurs » au sein même de la chaîne d’approvisionnement. Désormais, les racks doivent être entièrement assemblés dans la chaîne d’approvisionnement et expédiés en bloc, pesant chacun deux à trois tonnes. Cela signifie que la chaîne d’approvisionnement doit, dès la phase de test avant livraison, disposer elle-même d’une réserve énergétique gigantesque (de l’ordre du gigawatt, GW).

Dans le domaine de la mémoire — souvent identifié comme le maillon le plus critique — Huang révèle qu’il y a environ trois ans, l’utilisation de la mémoire à bande passante élevée (HBM) était quasi nulle, apparaissant uniquement dans quelques supercalculateurs isolés. Pourtant, il avait déjà réussi à convaincre les PDG de plusieurs grands fabricants de mémoires de la nécessité future de l’HBM dans les centres de données, les incitant à investir massivement dans sa production.

Par ailleurs, il a rompu avec les pratiques conventionnelles en poussant ses fournisseurs à adapter la mémoire basse consommation (LPDDR), initialement réservée aux smartphones, pour l’intégrer dans les supercalculateurs.

« L’inférence, c’est penser » : passage de l’entraînement et des tests à l’« extension par agents »

Concernant les lois d’échelle de l’IA (Scaling Laws), Huang distingue quatre axes d’extension : l’entraînement préalable (pré-entraînement), l’entraînement postérieur (post-entraînement), l’extension lors des tests (test-time scaling), et l’extension par agents (agentic scaling).

En réponse aux craintes d’une « pénurie de données », il déclare : « Nous continuerons à augmenter le volume de données utilisées pour l’entraînement… Une grande partie sera synthétique. » Et il ajoute : « L’entraînement n’est plus limité par les données ; celles-ci seront désormais limitées par la puissance de calcul. »

À propos de l’intensité énergétique requise pour l’inférence, il est encore plus catégorique : « L’inférence, c’est penser, et je pense que penser est difficile… Comment pourrait-ce être une opération peu gourmande en calcul ? » Il précise que l’extension lors des tests englobe « l’inférence, la planification et la recherche », ce qui fera monter la demande en puissance de calcul pour l’inférence.

La plus solide des douves, les défis du calcul spatial et son appréciation d’Elon Musk

Interrogé sur la plus forte barrière à l’entrée pour NVIDIA, Huang désigne sans ambiguïté l’immense base installée de CUDA et l’écosystème de confiance qui l’entoure.

« Ce n’est pas l’œuvre de trois personnes, mais bien celle des 43 000 employés de NVIDIA », souligne Huang. Cette barrière repose sur la confiance de millions de développeurs envers NVIDIA, qui croient fermement dans la poursuite de l’optimisation continue de la pile logicielle, renforcée par une intégration transversale étendue dans tous les fournisseurs de services cloud, constructeurs OEM et dispositifs périphériques.

En ce qui concerne les recherches de pointe en infrastructure informatique, notamment la proposition de déplacer les centres de données dans l’espace afin de résoudre les problèmes de distribution énergétique, Huang confirme que les GPU NVIDIA sont déjà présents dans l’espace, mais sont actuellement utilisés principalement pour le filtrage en périphérie d’images satellites haute résolution.

Concernant la construction de vastes centres de données spatiaux, Huang identifie sans détour un obstacle physique fondamental : « Dans l’espace, il n’y a ni conduction ni convection, seulement le rayonnement pour dissiper la chaleur. Bien qu’on dispose de soleil 24 heures sur 24 aux pôles, on aurait besoin de radiateurs immenses. » La solution la plus pragmatique aujourd’hui demeure donc d’exploiter pleinement l’électricité inutilisée disponible sur Terre.

Enfin, toute mise en œuvre concrète d’un projet de calcul exige une exécution d’ingénierie extrême. Concernant le centre de supercalcul Colossus mis en place par xAI d’Elon Musk en seulement quatre mois, avec 100 000 GPU, Huang offre une évaluation très positive sur le plan de l’infrastructure industrielle.

Il attribue le succès de Musk à une pensée fondée sur les principes premiers et à un minimalisme radical. « Il remet tout en question : cela est-il vraiment nécessaire ? Faut-il absolument procéder ainsi ? Est-ce indispensable de prendre autant de temps ? »

Huang ajoute : « Elon possède une expertise remarquable dans de nombreux domaines différents, et il est également un excellent penseur systémique. » Il poursuit ainsi : « Il remet en cause tout ce qui existe jusqu’à ce qu’il ne reste plus rien à éliminer, jusqu’à atteindre le strict minimum indispensable… Il intervient personnellement sur le terrain, en première ligne. Lorsqu’on agit avec une telle urgence et en personne, cela pousse automatiquement tous les autres à agir avec la même intensité. »

Recrutera-t-on à l’avenir uniquement des candidats sachant utiliser l’IA ? « Le nombre mondial de programmeurs passera de 30 millions à 1 milliard »

Face aux angoisses des travailleurs du monde entier face aux technologies de l’IA, Huang formule un critère très pragmatique. Il affirme clairement que, s’il devait choisir aujourd’hui entre deux diplômés, il embaucherait systématiquement celui qui maîtrise l’IA, et non celui qui en ignore totalement l’existence.

Huang insiste sur le fait que ce critère ne se limite pas aux postes techniques, mais s’étend aux comptables, avocats, commerciaux, responsables de la chaîne logistique, pharmaciens, électriciens ou menuisiers. Selon lui, aucun métier ni aucun niveau hiérarchique n’est épargné : ceux qui savent exploiter l’IA démontrent une valeur ajoutée nettement supérieure.

Il clarifie ensuite la frontière de la « substitution » : si le travail d’une personne consiste essentiellement en une suite de « tâches » (Task), c’est-à-dire si la valeur qu’elle apporte réside exclusivement dans l’exécution de ces tâches, alors sa substitution par l’IA est presque inévitable. En revanche, si son travail implique un objectif plus profond (Purpose), il peut utiliser l’IA pour automatiser les tâches répétitives, et passer ainsi du statut d’« exécutant » à celui d’« innovateur » dans son secteur.

Pour ceux qui n’ont pas encore commencé, Huang donne un conseil particulièrement rassurant : « Si vous ne savez pas comment utiliser l’IA, demandez-lui simplement : “Comment dois-je vous utiliser ?” Elle vous guidera étape par étape depuis le début. » Selon lui, le seuil d’entrée est désormais nul ; le seul obstacle réside dans votre décision de commencer. Car, dans cette ère, le coût de l’attente augmente jour après jour à mesure que l’IA progresse.

Concernant les programmeurs, Huang formule une affirmation fracassante : « Le nombre d’ingénieurs logiciels chez NVIDIA va augmenter, non diminuer… Si programmer signifie “décrire une spécification permettant à l’ordinateur de construire”, alors le nombre de personnes capables de le faire vient de passer de 30 millions à potentiellement 1 milliard. À l’avenir, chaque menuisier sera un programmeur, et chaque plombier en deviendra fou. »

Lorsqu’on aborde la question de l’horizon temporel de l’AGI (Intelligence Générale Artificielle), Huang propose la définition suivante : un système capable de développer et de rentabiliser une application de manière autonome. Il répond alors : « Je pense que c’est maintenant. Je pense que nous avons déjà réalisé l’AGI. » Il imagine un service web ou une application numérique créée entièrement par une IA, soudain adoptée par des milliards d’utilisateurs et générant des profits — une réalisation techniquement possible dès aujourd’hui.

Transcription complète de l’entretien :

Entretien avec Jensen Huang, PDG de NVIDIA — Une entreprise valorisée à 4 000 milliards de dollars et au cœur de la révolution de l’IA | Podcast Lex Fridman #494

Introduction

Lex Fridman

(00:00:00) Voici maintenant une conversation avec Jensen Huang, PDG de NVIDIA. NVIDIA est l’une des entreprises les plus importantes et influentes de l’histoire de la civilisation humaine, moteur de la révolution de l’IA. Le succès phénoménal de NVIDIA est largement dû à la volonté farouche de Jensen Huang, ainsi qu’à ses nombreuses décisions et paris exceptionnels en tant que leader, ingénieur et innovateur. Bienvenue sur le podcast Lex Fridman. Chers amis, je vous présente maintenant Jensen Huang.

Conception intégrée extrême et ingénierie au niveau du rack

Lex Fridman

(00:00:33) Vous avez propulsé NVIDIA vers une nouvelle ère de l’IA, en recentrant l’attention de la conception au niveau de la puce vers la conception au niveau du rack.

Lex Fridman

(00:00:42) On peut dire sans exagérer que, longtemps, l’avantage compétitif de NVIDIA reposait sur la création de GPU aussi parfaits que possible. Vous continuez à le faire, mais vous étendez désormais cette démarche à la conception intégrée extrême de GPU, CPU, mémoire, réseau, stockage, alimentation, refroidissement, logiciel, rack lui-même, les « pods » de calcul annoncés, voire de centres de données entiers. Parlons-en : quelle est la difficulté majeure dans la conception intégrée extrême d’un système aussi complexe, comportant autant de composants et de variables de conception ?

Jensen Huang

(00:01:11) Merci pour cette excellente question. La conception intégrée extrême est nécessaire parce que les problèmes que nous cherchons à résoudre ne peuvent plus tenir dans un seul ordinateur ni être accélérés par un seul GPU. Ce que nous voulons, c’est que la vitesse de calcul augmente plus rapidement que le nombre d’ordinateurs que nous ajoutons. Supposons que nous ajoutions 10 000 ordinateurs, mais que nous souhaitions une accélération d’un million de fois. Soudain, il faut extraire l’algorithme, le décomposer, le restructurer, fragmenter le pipeline, fragmenter les données, fragmenter le modèle. Lorsqu’on traite ainsi un problème de façon distribuée, on ne se contente pas d’augmenter sa taille, on le décompose — et tous les éléments deviennent alors des goulots d’étranglement.

Jensen Huang

(00:02:03) C’est précisément le problème posé par la loi d’Amdahl : le gain d’accélération d’une tâche dépend de la proportion qu’elle représente dans le travail total. Si le calcul représente 50 % du problème, même une accélération infinie du calcul (par exemple un million de fois) ne doublera la vitesse globale que d’un facteur deux. Du coup, non seulement il faut répartir la charge de calcul et fragmenter le pipeline d’une certaine manière, mais il faut aussi résoudre le problème du réseau, car tous ces ordinateurs sont interconnectés. À notre échelle, le calcul distribué pose problème pour le CPU, le GPU, le réseau, les commutateurs — tous ces éléments sont des points critiques. Répartir la charge de travail sur l’ensemble de ces ordinateurs est lui-même un problème critique.

Jensen Huang

(00:02:57) C’est un problème informatique extrêmement complexe. Nous devons exploiter toutes les technologies disponibles. Sinon, nous ne pourrons étendre notre capacité que de façon linéaire, ou en comptant sur la loi de Moore — or celle-ci stagne fortement depuis le ralentissement de la loi de Dennard.

Comment Jensen Huang dirige NVIDIA

Lex Fridman

(00:03:16) Il y a forcément des compromis à faire. Et vous intervenez dans des disciplines totalement différentes. Je suis sûr que vous avez des experts dans chacun de ces domaines : mémoire à bande passante élevée (HBM), réseau et NVLink, cartes réseau, connexions optiques et cuivrées, alimentation, refroidissement, etc. Ce sont tous des experts de niveau mondial. Comment les réunissez-vous dans une même salle pour déterminer —

Jensen Huang

(00:03:34) C’est pourquoi mon équipe de direction est si vaste.

Lex Fridman

(00:03:37) Quel est le processus de collaboration entre spécialistes et généralistes ? Lorsque vous savez exactement quels composants doivent entrer dans un rack, comment assemblez-vous ce rack ? Comment concevez-vous l’ensemble de ces éléments ensemble ?

Jensen Huang

(00:03:51) Premièrement, demandons-nous : qu’est-ce que la conception intégrée extrême ? Nous optimisons l’ensemble de la pile logicielle, de l’architecture à la puce, au système, au logiciel système, puis aux algorithmes et aux applications. Voilà le premier niveau. Le deuxième niveau, dont nous parlions précédemment, dépasse le CPU, le GPU, les puces réseau, les commutateurs « scale-up » et « scale-out ». Bien entendu, il faut aussi inclure l’alimentation et le refroidissement, car tous ces ordinateurs consomment énormément d’énergie. Ils accomplissent beaucoup de travail avec une efficacité énergétique très élevée, mais leur consommation globale reste importante. La première question est donc : qu’est-ce que c’est ?

Jensen Huang

(00:04:34) Deuxièmement : pourquoi en avons-nous besoin ? Nous venons d’en expliquer la raison. Nous voulons répartir la charge de travail de façon à obtenir des gains supérieurs à ceux procurés par une simple augmentation du nombre d’ordinateurs. Troisièmement : comment y parvenir ? Comment réaliser cela ?

Jensen Huang

(00:04:51) C’est là que réside le miracle de cette entreprise. Lorsque vous concevez un ordinateur, vous devez avoir un système d’exploitation. Lorsque vous concevez une entreprise, vous devez d’abord réfléchir à ce que vous voulez qu’elle produise. J’ai vu de nombreux organigrammes d’entreprises, et ils se ressemblent tous. Organigrammes en forme de sandwich, en forme de galette, ou encore ceux des constructeurs automobiles — ils sont tous identiques. Cela n’a aucun sens pour moi. L’objectif d’une entreprise est d’être une machine, un mécanisme et un système productif. Ce produit est ce que nous voulons créer. L’organisation de l’entreprise doit refléter l’environnement dans lequel elle évolue.

Jensen Huang

(00:05:36) Cela détermine presque directement la façon dont vous devez structurer votre organisation. Mon équipe de direction, qui me rend compte directement, compte 60 personnes. Je ne peux pas avoir de réunions individuelles avec elles, car cela serait impossible. Si vous voulez accomplir du travail, vous ne pouvez pas avoir une équipe de 60 personnes avec laquelle vous auriez des entretiens un-à-un —

Lex Fridman

(00:05:51) Mais vous avez tout de même 60 personnes qui vous rendent compte directement, et cela couvre —

Jensen Huang

(00:05:53) Et encore plus.

Lex Fridman

(00:05:54) Encore plus. Et la plupart des talents vedettes interviennent au moins dans le domaine de l’ingénierie.

Jensen Huang

(00:05:59) Presque tous. Il y a des experts en mémoire, en CPU, en optique.

Lex Fridman

(00:06:06) Incroyable.

Jensen Huang

(00:06:06) Et aussi des experts en GPU, architecture, algorithmes, conception, etc.

Lex Fridman

(00:06:11) Vous surveillez donc constamment toute la pile technologique et devez mener des discussions très animées sur toute la pile ?

Jensen Huang

(00:06:18) Jamais une discussion ne se fait à sens unique. C’est pourquoi je ne fais pas d’entretiens individuels. Nous posons un problème, puis nous le résolvons collectivement. Parce que nous faisons une conception intégrée extrême. Sans exagérer, l’entreprise pratique constamment une conception intégrée extrême.

Lex Fridman

(00:06:33) Même lorsque vous discutez d’un composant spécifique, comme le refroidissement ou le réseau, tout le monde écoute ?

Jensen Huang

(00:06:40) Exactement.

Lex Fridman

(00:06:41) Et ils peuvent intervenir : « Cela ne convient pas à la distribution électrique. Cela ne convient pas à — »

Jensen Huang

(00:06:45) Exactement.

Lex Fridman

(00:06:45) « …cela ne convient pas à la mémoire. Cela ne convient pas à cela. »

Jensen Huang

(00:06:49) Exactement. Celui qui ne veut pas écouter n’est pas obligé de le faire. La raison en est que les membres de l’équipe savent quand concentrer leur attention. Si quelqu’un aurait pu contribuer à une discussion sans le faire, je le rappellerai à l’ordre. Je dirai donc : « Hé, venez, rejoignez la discussion. »

Lex Fridman

(00:07:07) Comme vous l’avez dit, NVIDIA est une entreprise adaptée à son environnement. À quel moment pouvez-vous dire que l’environnement a changé, et que l’entreprise s’y est adaptée discrètement ? Du GPU initial destiné aux jeux vidéo, à la révolution de l’apprentissage profond, puis à notre vision actuelle d’une « usine IA » ? Que fait NVIDIA ? Elle produit de l’IA — créons donc une usine pour produire de l’IA.

Jensen Huang

(00:07:32) Je peux raisonner systématiquement sur ce processus. Nous étions initialement une entreprise d’accélérateurs. Or le problème des accélérateurs est que leur domaine d’application est trop étroit. Leur avantage réside dans une optimisation extrême pour une tâche spécifique. Tout expert possède cet avantage. Le problème de la spécialisation extrême est que le marché visé est plus restreint — ce qui n’est pas grave en soi. Le vrai problème est que la taille du marché détermine également votre capacité de R&D, et que cette capacité détermine finalement votre influence dans le domaine du calcul. Lorsque nous avons démarré comme accélérateur très spécifique, nous savions déjà que ce n’était que notre première étape.

Jensen Huang

(00:08:23) Nous devions trouver un moyen de devenir une entreprise de calcul accéléré. Or, lorsqu’on devient une entreprise de calcul, l’objectif devient trop général, ce qui affaiblit la spécialisation. J’ai délibérément juxtaposé ces deux termes, qui sont fondamentalement contradictoires. Plus nous réussissons en tant qu’entreprise de calcul, moins nous sommes performants en tant qu’experts. Plus nous sommes experts, moins nous sommes capables de calcul global. En les juxtaposant, j’exprime que l’entreprise doit progresser pas à pas sur une voie extrêmement étroite : élargir notre champ de calcul sans sacrifier notre capacité spécialisée la plus précieuse. Notre premier pas au-delà de l’accélérateur fut l’invention du shader de pixel programmable.

Jensen Huang

(00:09:13) Ce fut la première étape vers la programmabilité. Ce fut notre premier voyage vers le monde du calcul. Notre deuxième action fut d’introduire le format virgule flottante simple précision (FP32) dans nos shaders. Le support de la norme IEEE pour le FP32 fut un grand pas vers le calcul. C’est pourquoi tous ceux qui travaillaient sur les processeurs de flux et autres types de processeurs de données ont découvert notre technologie. Ils se sont dit : « Soudain, nous pourrions utiliser ce GPU, extrêmement intensif en calcul et compatible avec la norme IEEE. »

Jensen Huang

(00:09:55) Je pouvais prendre des logiciels écrits auparavant sur CPU et voir s’ils pouvaient fonctionner sur GPU. Cela nous a poussés à ajouter des fonctionnalités C au-dessus du FP32, que nous avons appelées Cg. Le développement de Cg nous a conduit progressivement à CUDA. Pas à pas, nous avons introduit CUDA dans GeForce, une décision stratégique extrêmement audacieuse, car elle a absorbé une grande partie des bénéfices de l’entreprise, que nous ne pouvions alors pas nous permettre. Pourtant, nous l’avons faite, car nous voulions devenir une entreprise de calcul. Une entreprise de calcul doit posséder une architecture de calcul. Cette architecture doit être compatible avec toutes les puces que nous concevons.

Lex Fridman

(00:10:42) Pourriez-vous détailler cette décision ? Intégrer CUDA dans GeForce, alors que cela semblait financièrement impossible ? Pouvez-vous expliquer cette décision ? Pourquoi avez-vous osé un tel choix ?

Jensen Huang

(00:10:53) Ce fut la première décision stratégique presque vitale.

Lex Fridman

(00:11:06) Pour ceux qui ne connaissent pas cette histoire, sachez que cette décision s’est révélée par la suite l’une des plus brillantes et judicieuses de l’histoire de l’entreprise. CUDA est devenue la base de calcul incroyablement puissante de l’infrastructure IA mondiale. Donc, pour contextualiser, cela s’est avéré être une excellente décision.

Jensen Huang

(00:11:27) Oui, cela s’est révélé être une excellente décision. Voici comment cela s’est passé. Nous avons inventé CUDA, ce qui a élargi la gamme d’applications que nos accélérateurs pouvaient accélérer. Le problème était : comment attirer les développeurs vers CUDA ? Car la plateforme de calcul repose sur les développeurs. Les développeurs ne viennent pas sur une plateforme juste parce qu’elle peut effectuer des opérations intéressantes. Ils choisissent une plateforme de calcul parce qu’elle est largement déployée. Car les développeurs, comme tout le monde, veulent développer des logiciels qui touchent un large public. L’adoption massive est en effet la composante la plus importante de l’architecture. L’architecture elle-même peut susciter de nombreuses critiques.

Jensen Huang

(00:12:18) Par exemple, aucune architecture n’a été plus critiquée que l’x86, jugée peu élégante, mais elle est devenue l’architecture de référence actuelle. C’est un exemple. En réalité, de nombreuses architectures RISC extrêmement élégantes, conçues par les informaticiens les plus brillants du monde, ont largement échoué. J’ai cité ces deux exemples — l’un élégant, l’autre à peine fonctionnel — or l’x86 a survécu, justement parce que —

Lex Fridman

(00:12:58) L’adoption massive est tout.

Jensen Huang

(00:12:59) L’adoption massive définit l’architecture. Tout le reste est secondaire, compris ? Il existait d’autres architectures à l’époque, CUDA est arrivé, OpenCL aussi. Il y avait plusieurs architectures concurrentes. Notre bonne décision fut de dire : « Écoutez, au final, tout repose sur l’adoption massive. Quelle est la meilleure façon de diffuser notre nouvelle architecture de calcul dans le monde ? » À ce moment-là, GeForce avait déjà connu un grand succès.

Jensen Huang

(00:13:29) Nous vendions déjà des millions de GPU GeForce chaque année. Nous avons dit : « Nous devrions intégrer CUDA dans GeForce, le placer dans chaque PC, peu importe que le client l’utilise ou non, et en faire le point de départ pour développer notre base installée. » Parallèlement, nous devions attirer les développeurs, aller dans les universités, écrire des manuels, donner des cours, intégrer CUDA partout. Peu à peu, les gens l’ont découvert. À l’époque, le PC était l’outil de calcul principal, il n’y avait pas encore le cloud, et nous pouvions mettre une supercalculatrice entre les mains de chaque chercheur, scientifique, étudiant en ingénierie, dans chaque laboratoire universitaire. Un jour, le miracle arriverait inévitablement.

Jensen Huang

(00:14:15) Le problème était que CUDA augmentait considérablement le coût du GPU grand public, absorbant totalement la marge brute de l’entreprise. À l’époque, la capitalisation boursière de l’entreprise était d’environ 8 milliards de dollars ? Ou de 6 à 7 milliards ? Après le lancement de CUDA, j’ai pris conscience que cela augmenterait beaucoup les coûts, mais c’était une conviction profonde. Notre capitalisation boursière est tombée brièvement à environ 1,5 milliard de dollars. Nous sommes restés un certain temps au creux de la vague, puis nous avons lentement remonté, mais nous avons maintenu CUDA sur GeForce. Je dis toujours que NVIDIA est un temple bâti sur GeForce, car c’est GeForce qui a amené CUDA à tout le monde.

Jensen Huang

(00:15:10) Les chercheurs, les scientifiques, ont découvert CUDA sur GeForce parce que beaucoup d’entre eux sont aussi des joueurs. Beaucoup d’entre eux montent eux-mêmes leurs PC. Dans les laboratoires universitaires, beaucoup utilisent des composants PC pour monter leurs propres grappes. C’est ainsi que nous avons commencé.

Lex Fridman

(00:15:31) Puis cela est devenu la plateforme et la base de la révolution de l’apprentissage profond.

Jensen Huang

(00:15:35) C’est aussi une observation remarquable.

Lex Fridman

(00:15:38) À ce moment critique, vous souvenez-vous de l’atmosphère des réunions ? Comment une entreprise prend-elle le risque de tout miser sur une décision ? Quelle était l’ambiance des discussions ?

Jensen Huang

(00:15:48) Je devais expliquer au conseil d’administration ce que nous voulions faire, et l’équipe de direction savait que notre marge brute serait écrasée. Imaginez un monde où GeForce porte le coût de CUDA, mais où aucun joueur ne l’apprécie ni ne veut le payer. Ils ne paient qu’un prix fixe, indifférent à vos coûts. Nous avons augmenté les coûts de 50 %, alors que nous étions une entreprise avec une marge brute de 35 %. Prendre cette décision était extrêmement difficile. Mais vous pouvez imaginer que, un jour, cela entrera dans les stations de travail, dans les supercalculateurs, et que, dans ces domaines, nous pourrons obtenir des marges plus élevées.

Jensen Huang

(00:16:36) Vous pouvez donc vous convaincre rationnellement que ce coût est supportable, mais cela a tout de même pris dix ans.

Lex Fridman

(00:16:45) Il s’agit donc surtout de convaincre le conseil d’administration, mais psychologiquement, à mesure que NVIDIA prend des paris audacieux sur l’avenir, et qu’elle le définit, en partie, aujourd’hui. Je voudrais vous demander un peu de sagesse sur votre capacité à prendre ces décisions et à conduire l’entreprise à travers ces sauts qualitatifs.

Jensen Huang

(00:17:14) Premièrement, je suis extrêmement curieux. À un moment donné, un système de raisonnement très clair me convainc fermement que ce résultat se produira. Cela se produira inévitablement. Dans mon esprit, j’en suis absolument convaincu, et vous savez ce que cela signifie. Je visualise un avenir dans mon esprit, un avenir si convaincant qu’il ne peut pas ne pas se produire. Bien sûr, il y aura de nombreuses épreuves en chemin, mais vous devez maintenir votre foi.

Lex Fridman

(00:17:52) Vous imaginez donc l’avenir, et, d’un point de vue technique, vous le rendez réel ?

Jensen Huang

(00:17:59) Oui. Vous raisonnez sur la façon d’y parvenir. Vous raisonnez sur pourquoi cela doit exister. Nous raisonnons ici ensemble. L’équipe de direction raisonne aussi. Je passe beaucoup de temps à raisonner. La partie suivante relève peut-être d’une compétence managériale. Habituellement, dans les cercles dirigeants, les leaders gardent le silence, ou bien ils découvrent quelque chose, puis font une déclaration : « C’est une nouvelle année, d’ici la fin de l’année, nous aurons un nouveau plan. » Ici, on licencie massivement, là, on restructure massivement, on énonce une nouvelle mission, on dessine un nouveau logo, etc.

Jensen Huang

(00:18:43) Je ne fais jamais cela. Lorsque j’apprends quelque chose qui commence à influencer ma réflexion, je le dis clairement à tous ceux qui m’entourent : « Cela est intéressant. Cela entraînera un changement. Cela affectera cela. » Je raisonne pas à pas. Souvent, j’ai déjà pris une décision, mais j’utilise chaque opportunité possible — informations externes, nouvelles prises de conscience, nouvelles découvertes, nouvelles révélations techniques, nouveaux jalons — pour façonner le système de croyances des autres. Je le fais presque quotidiennement. Je le fais avec le conseil d’administration, avec l’équipe de direction, avec les employés.

Jensen Huang

(00:19:33) J’essaie de façonner leur système de croyances, afin que, le jour où je dirai « Hé, achetons Mellanox », tout le monde le trouve évident et soit absolument convaincu que nous devons l’acheter. Lorsque je dis « Messieurs, engageons-nous pleinement dans l’apprentissage profond » et que j’en explique les raisons, j’ai déjà posé les fondations internes dans chaque organisation. Chaque organisation, chaque personne, a entendu certaines parties, la plupart ont entendu des fragments. Le jour de l’annonce, chacun a déjà accepté bon nombre de ces éléments.

Jensen Huang

(00:20:19) À bien des égards, le jour de l’annonce, je peux imaginer les employés se dire : « Jensen, pourquoi avoir attendu si longtemps ? » En réalité, j’ai façonné leur système de croyances. Ainsi, le leadership, parfois, semble être une conduite en arrière-plan, mais vous façonnez constamment les autres jusqu’au jour de l’annonce, où tout le monde adhère à 100 %. C’est exactement ce que vous voulez. Vous voulez emmener tout le monde avec vous. Sinon, si nous annoncions soudainement un plan sur l’apprentissage profond, tout le monde dirait : « De quoi parlez-vous ? » Si vous annoncez un engagement total sur un sujet, votre équipe de direction, votre conseil d’administration, vos employés, vos clients diront : « D’où sort cela ? »

Jensen Huang

(00:21:02) « C’est fou. » Si vous regardez les conférences GTC passées, vous verrez que, dans mes discours, j’ai aussi façonné le système de croyances de nos partenaires de l’industrie, et que j’ai utilisé cela pour façonner le système de croyances de mes employés. Ainsi, le jour de l’annonce d’un événement, comme Groq, j’ai en réalité parlé des fondations correspondantes pendant deux ans et demi. En regardant en arrière, vous constatez : « Mon Dieu, ils en parlent depuis deux ans et demi. » J’ai posé les fondations pas à pas, donc, le jour venu, tout le monde dit : « Pourquoi avoir mis si longtemps ? »

Lex Fridman

(00:21:44) Mais ce n’est pas seulement à l’intérieur de l’entreprise. Vous façonnez l’industrie entière et, plus largement, le paysage global de l’innovation. En lançant ces idées, vous rendez la réalité tangible.

Jensen Huang

(00:21:53) Nous ne fabriquons pas d’ordinateurs. En fait, nous ne construisons pas de cloud. Nous étions initialement une entreprise de plateformes de calcul. Personne ne peut donc acheter directement un produit fini auprès de nous. C’est fascinant. Nous effectuons une intégration verticale pour concevoir et optimiser, mais à chaque niveau, nous ouvrons entièrement la plateforme afin qu’elle puisse être intégrée dans les produits, services, clouds, supercalculateurs et ordinateurs OEM d’autres entreprises. Ce qui est remarquable, c’est que je ne pourrais pas accomplir ce que je fais aujourd’hui sans d’abord les avoir convaincus. La majeure partie de la conférence GTC sert à montrer l’avenir, afin que, lorsque nos produits seront prêts, ils disent : « Pourquoi avez-vous mis si longtemps ? »

Les lois d’échelle de l’IA

Lex Fridman

(00:22:39) Oui. Depuis longtemps, vous êtes un fervent partisan des lois d’échelle générales (Scaling Laws). Y croyez-vous encore aujourd’hui ?

Jensen Huang

(00:22:49) Oui. Maintenant, nous disposons de davantage de lois d’échelle.

Lex Fridman

(00:22:51) Je crois que vous avez résumé quatre phases de lois d’échelle : pré-entraînement, post-entraînement, extension lors des tests (inférence) et extension par agents (Agentic). Lorsque vous réfléchissez à l’avenir, à long terme et à court terme, quel est le frein qui vous inquiète le plus, qui vous empêche de dormir, et que vous devez impérativement surmonter pour poursuivre l’expansion ?

Jensen Huang

(00:23:12) Nous pouvons revenir sur les obstacles que les gens considéraient autrefois comme tels. Au stade initial des lois d’échelle du pré-entraînement, on supposait naturellement que la quantité de données de haute qualité dont nous disposions limiterait le niveau d’intelligence que nous pourrions atteindre. Cette loi d’échelle est très importante. Plus le modèle est grand, plus l’ajout de données amène une IA plus intelligente. C’est le pré-entraînement. Ilya Sutskever disait alors : « Nous avons épuisé nos données » ou quelque chose de similaire. « Le pré-entraînement est terminé. » Tout le secteur a paniqué, pensant que c’était la fin de l’IA. Or ce n’était manifestement pas le cas.

Jensen Huang

(00:23:57) Nous continuerons à augmenter la quantité de données utilisées pour l’entraînement. Une grande partie de ces données pourra être synthétique, ce qui trouble beaucoup les gens. Les gens ne réalisent pas, ou oublient, que la plupart des données que nous utilisons pour nous enseigner mutuellement, pour nous informer mutuellement, sont aussi « synthétiques ». Elles sont synthétiques, car elles ne proviennent pas directement de la nature. Vous les créez. Je les consomme. Je les modifie, les améliore, les régénère, d’autres les consomment. Nous sommes désormais arrivés à un stade où l’IA peut saisir la vérité fondamentale (Ground Truth), l’améliorer… et générer massivement des données synthétiques.

Jensen Huang

(00:24:47) Le post-entraînement se poursuit, donc la quantité de données générées par l’humain que nous utilisons continuera de diminuer. La quantité de données utilisées pour entraîner les modèles continuera d’augmenter, jusqu’à ce que nous ne soyons plus limités par les données… L’entraînement est désormais limité par la puissance de calcul. La raison en est que la majeure partie des données est synthétique. Ensuite vient l’étape des tests (inférence), et je me souviens qu’on me disait : « L’inférence ? Oh, c’est simple. Le pré-entraînement est difficile. C’est un système gigantesque. L’inférence sera forcément simple. Les puces d’inférence ne seront donc que de petites puces — »

Jensen Huang

(00:25:32) « Elles ne seront pas comme les puces de NVIDIA. Elles seront trop complexes, trop coûteuses. À l’avenir, l’inférence sera le plus gros marché, elle deviendra simple, nous la transformerons en produit standardisé. Tout le monde pourra fabriquer sa propre puce. » Cela m’a toujours semblé illogique, car l’inférence, c’est penser, et je pense que penser est difficile. Penser est bien plus difficile que lire.

Jensen Huang

(00:25:59) Le pré-entraînement ne consiste qu’en mémorisation et généralisation, à trouver des motifs dans les relations. Vous ne faites que lire sans cesse. L’extension lors des tests (inférence) implique la pensée, le raisonnement, la résolution de problèmes. Décomposer des expériences inexplorées, de nouvelles expériences, en fragments résolvables, puis les résoudre par raisonnement fondamental, ou à partir d’exemples antérieurs et d’expériences passées. Ou simplement explorer, rechercher, essayer différentes méthodes. Tout le processus d’extension lors des tests est en fait une activité de pensée. Il s’agit de raisonnement, de planification et de recherche.

Jensen Huang

(00:26:50) Comment cela pourrait-il être une opération peu gourmande en calcul ? Nous avions parfaitement raison. L’extension lors des tests est extrêmement gourmande en calcul. Ensuite, nous nous trouvons à l’étape de l’inférence et de l’extension lors des tests. Quelle est la suite ? Manifestement, nous créons aujourd’hui un « agent humain », doté du grand modèle linguistique que nous avons développé. Mais durant les tests, ce système d’agents explore des bases de données, utilise divers outils, et fait surtout une chose essentielle : il génère et produit une multitude de sous-agents. Cela signifie que nous constituons des équipes massives. Étendre NVIDIA en embauchant davantage d’employés est plus facile que de m’étendre moi-même.

Jensen Huang

(00:27:44) Ainsi, la prochaine loi d’échelle est la loi d’échelle par agents (Agentic Scaling Law). C’est comme dupliquer l’IA. Nous pouvons générer des agents à volonté, très rapidement. J’ai donc résumé quatre dimensions de lois d’échelle. Lorsque nous utilisons des systèmes d’agents, ils créent davantage de données, davantage d’expériences. Pour certaines d’entre elles, nous disons : « Wow, c’est vraiment bien. Nous devrions nous en souvenir. »

Jensen Huang

(00:28:12) Ces données retournent alors à l’étape de pré-entraînement. Nous les mémorisons et les généralisons. Puis nous les affinons et les perfectionnons lors du post-entraînement. Ensuite, nous les renforçons davantage grâce aux tests et aux systèmes d’agents, puis nous les diffusons dans l’industrie. Ce cycle se poursuit indéfiniment. En fin de compte, l’intelligence s’étendra via un seul facteur : la puissance de calcul.

Lex Fridman

(00:28:41) Mais il y a un problème délicat : vous devez prédire l’avenir, car certains composants nécessitent des types de matériel différents pour fonctionner de façon optimale. Vous devez donc anticiper la direction prise par l’innovation IA. Par exemple, les modèles d’experts mixtes (MoE) —

Jensen Huang

(00:28:57) Tout à fait.

Lex Fridman

(00:28:58) Des modèles avec sparsité.

Jensen Huang

(00:28:59) Exactement.

Lex Fridman

(00:29:00) Le matériel ne peut pas changer en une semaine. Vous devez prédire la forme future. Cela paraît terrifiant et extrêmement difficile, n’est-ce pas ?

Jensen Huang

(00:29:09) Par exemple, les architectures de modèles IA sont mises à jour environ tous les six mois. L’architecture système et l’architecture matérielle sont mises à jour environ tous les trois ans. Vous devez donc prédire ce qui pourrait se produire dans deux ou trois ans. Il existe plusieurs façons de le faire. Premièrement, nous menons des recherches internes, c’est pourquoi nous avons à la fois des recherches fondamentales et appliquées.

Jensen Huang

(00:29:40) Nous créons nos propres modèles. Nous avons donc une expérience pratique directe. C’est une partie de la conception intégrée dont je parlais. Nous sommes aussi la seule entreprise IA au monde qui collabore presque avec toutes les entreprises IA. Dans la mesure du possible, nous essayons de percevoir les défis auxquels les gens sont confrontés.

Lex Fridman

(00:29:59) Vous écoutez donc les murmures de toute l’industrie, des grands laboratoires IA.

Jensen Huang

(00:30:02) Exactement. Vous devez écouter et apprendre de tout le monde. La dernière partie est d’avoir une architecture flexible, capable de s’adapter au vent. L’un des atouts de CUDA est qu’il est à la fois un accélérateur extrêmement puissant et très flexible. Cet équilibre remarquable entre spécialisation (sinon il ne pourrait pas accélérer le CPU) et universalité (pour s’adapter aux algorithmes en constante évolution) est extrêmement important. C’est aussi pourquoi CUDA est à la fois très robuste et que nous pouvons continuellement l’améliorer.

Jensen Huang

(00:30:44) Nous en sommes maintenant à CUDA 13.2. Nous faisons évoluer l’architecture si rapidement que nous pouvons suivre le rythme des algorithmes modernes. Par exemple… Lorsque les modèles d’experts mixtes (MoE) sont apparus

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News