Huang Renxun est Satoshi Nakamoto

TechFlow SélectionTechFlow Sélection

Huang Renxun est Satoshi Nakamoto

Deux jetons, un même nom et une même structure sous-jacente : de la puissance de calcul entre, des éléments à valeur ajoutée sortent.

Auteur : Luo Yihang

En janvier 2009, une personne anonyme a inventé un concept appelé « token » : vous consacrez de la puissance de calcul, vous obtenez des tokens, et ces tokens circulent, sont valorisés et échangés au sein d’un réseau basé sur le consensus. C’est ainsi que l’économie cryptographique est née. Plusieurs dizaines d’années se sont écoulées, et les débats continuent encore aujourd’hui sur la question de savoir si ces tokens possèdent réellement une valeur.

En mars 2025, un homme vêtu d’un blouson en cuir a redéfini un autre type de « token ». Vous consacrez de la puissance de calcul, vous produisez des tokens, et ceux-ci sont immédiatement consommés dans un processus d’inférence et de raisonnement (inference & reasoning) : réflexion, raisonnement, écriture de code, prise de décision. C’est ainsi que l’économie de l’IA s’accélère. Personne ne débat plus de la valeur de ce type de token — vous en avez tout simplement utilisé plusieurs millions ce matin même.

Deux types de tokens partagent le même nom et la même structure fondamentale : de la puissance de calcul entre, quelque chose de valeur sort.

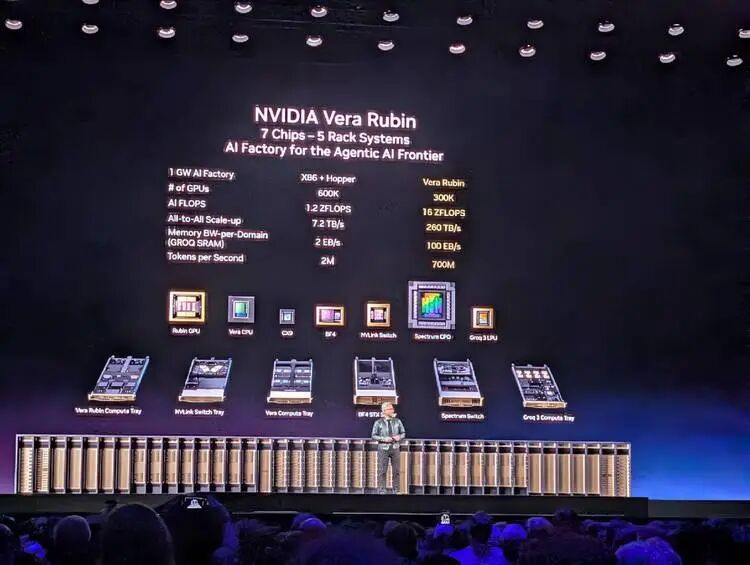

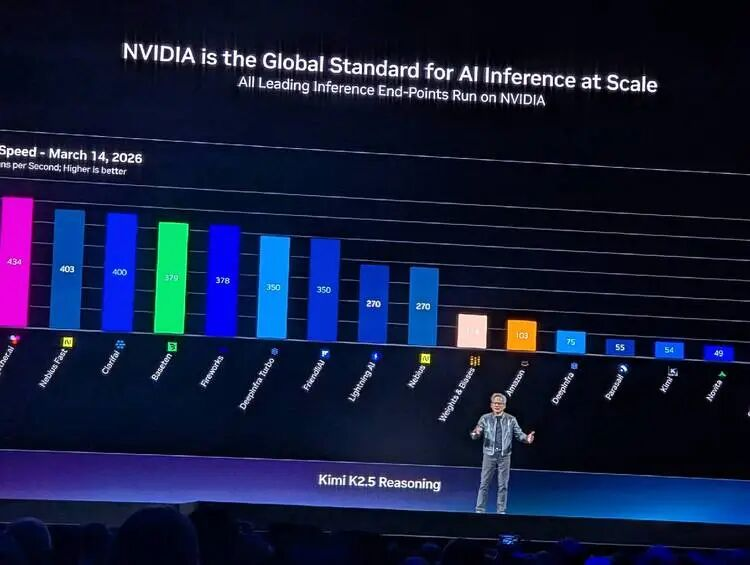

En mars 2026, j’étais assis dans l’enceinte du salon GTC organisé par NVIDIA, écoutant un discours principal de Jensen Huang qui, à l’exception notable d’une présentation quasi absente de produits commerciaux, a marqué une rupture radicale. Oui, il a présenté Vera Rubin, un produit combinant CPU et GPU. Mais cette fois, il n’a pas parlé des caractéristiques techniques des puces ni des procédés de fabrication. Il a exposé une économie complète autour de la production, de la valorisation et de la consommation des tokens :

Quel modèle correspond à quelle vitesse de génération de tokens ? Quelle vitesse de génération de tokens correspond à quelle fourchette tarifaire ? Et quelle fourchette tarifaire requiert quel niveau de matériel pour être soutenue ?

Il a même préparé, à l’intention des PDG et des décideurs détenant les chèques d’entreprise, un plan d’allocation de la puissance de calcul dans les centres de données : 25 % pour la couche gratuite, 25 % pour la couche intermédiaire, 25 % pour la couche haut de gamme, et 25 % pour la couche à forte marge.

Oui, cette fois, il ne commercialisait pas explicitement telle ou telle série de GPU, comme il l’avait fait deux ans plus tôt avec Blackwell. Cette fois, il vendait quelque chose de bien plus vaste. Au bout de deux heures, j’ai eu la conviction que la phrase qu’il souhaitait surtout faire passer était celle-ci : « Bienvenue dans l’ère de la consommation de tokens — et seule l’usine de NVIDIA peut les produire. »

À cet instant précis, j’ai pris conscience que cet homme accomplissait, structurellement parlant, exactement la même chose que celle réalisée, il y a dix-sept ans, par cet anonyme qui avait extrait le premier token.

Une même règle de transformation

L’anonyme connu sous le pseudonyme de « Satoshi Nakamoto » a rédigé, en 2008, un livre blanc de neuf pages définissant une règle précise : consacrer de la puissance de calcul afin de résoudre une preuve mathématique (Proof of Work), et recevoir en récompense un token cryptographique.

La subtilité de cette règle réside dans le fait qu’elle ne repose sur aucune confiance préalable entre les parties — dès lors que vous acceptez cette règle, vous devenez automatiquement un participant actif à cette économie. Cette règle fonctionne, puisqu’elle a réussi à rassembler tant de personnes méfiantes les unes envers les autres.

Or, sur la scène du GTC 2026, Jensen Huang a accompli exactement la même chose, structurellement parlant.

Il a présenté un graphique illustrant la relation et la tension entre l’efficacité de l’inférence et la consommation de tokens : l’axe Y représente le débit (le nombre de tokens produits par mégawatt consommé), tandis que l’axe X représente l’interactivité (la vitesse perçue de génération des tokens par chaque utilisateur). Sous l’axe X, il a indiqué cinq niveaux tarifaires : Gratuit (avec Qwen 3, à 0 $ le million de tokens) ; Intermédiaire (avec Kimi K2.5, à 3 $ le million de tokens) ; Haut de gamme (avec GPT MoE, à 6 $ le million de tokens) ; Premium (avec GPT MoE doté d’un contexte de 400 000 tokens, à 45 $ le million de tokens) ; Ultra (à 150 $ le million de tokens).

Ce graphique pourrait presque servir de couverture du « livre blanc » de l’économie des tokens selon Jensen Huang.

Satoshi Nakamoto a défini « ce qu’est un calcul ayant de la valeur » — réussir une collision de hachage SHA-256 constitue un calcul utile. Jensen Huang, quant à lui, définit « ce qu’est un raisonnement ayant de la valeur » — produire des tokens à une vitesse donnée, dans un scénario spécifique, sous une contrainte de consommation énergétique donnée, constitue un raisonnement utile.

Ni Satoshi Nakamoto ni Jensen Huang ne produisent directement des tokens ; ils définissent tous deux les règles de production et les mécanismes de valorisation des tokens.

Une phrase prononcée par Jensen Huang sur scène pourrait presque être reprise telle quelle dans le résumé du livre blanc de l’économie des tokens :

« Tokens are the new commodity, and like all commodities, once it reaches an inflection, once it becomes mature, it will segment into different parts. »

Le token est la nouvelle matière première. Une fois qu’une matière première atteint sa maturité, elle se segmente naturellement. Il ne décrit pas un état de fait, mais anticipe une structure de marché, puis aligne précisément sa gamme de produits matériels sur chacune de ses couches.

Même sur le plan sémantique, les processus de production des deux types de tokens s’opposent symétriquement : l’extraction s’appelle « mining », l’inférence s’appelle « inference ».

L’extraction minière et l’inférence ont toutes deux pour essence de transformer l’électricité en argent. Les mineurs dépensent de l’électricité pour extraire des tokens cryptographiques, puis les revendent. Les modèles d’IA et les agents IA dépensent de l’électricité pour générer des tokens IA, puis les vendent aux développeurs au million d’unités. Les étapes intermédiaires diffèrent, mais les extrémités restent identiques : à gauche, le compteur électrique ; à droite, les revenus.

Deux façons d’écrire la rareté

La décision de conception la plus importante prise par Satoshi Nakamoto n’était pas le Proof of Work, mais la limite maximale fixée à 21 millions de bitcoins. Il a créé une rareté artificielle via le code — peu importe le nombre de machines minières qui rejoignent le réseau, l’offre totale de bitcoins ne dépassera jamais les 21 millions d’unités. Cette rareté constitue l’ancrage de valeur de toute l’économie cryptographique.

Jensen Huang, quant à lui, crée une rareté naturelle fondée sur les lois physiques. Il déclare :

« You still have to build a gigawatt data center. You still have to build a gigawatt factory, and that one gigawatt factory for 15 years amortized... is about $40 billion even when you put nothing on it. It's $40 billion. You better make for darn sure you put the best computer system on that thing so that you can have the best token cost. »

Un centre de données de 1 GW ne deviendra jamais un centre de 2 GW. Ce n’est pas une limitation imposée par le code, c’est une loi physique.

Le terrain, l’électricité, le refroidissement — chacun de ces facteurs connaît une limite physique intrinsèque. Le montant de 40 milliards de dollars investi dans la construction de cette usine, sur une durée de vie de 15 ans, déterminera entièrement le volume de tokens pouvant y être produits — en fonction exclusivement de l’architecture de calcul que vous y intégrez.

La rareté créée par Satoshi Nakamoto peut être « forkée ». Si vous n’appréciez pas la limite de 21 millions, rien ne vous empêche de créer une nouvelle chaîne, de modifier la limite à 200 millions, de l’appeler Ethereum ou n’importe quoi d’autre, et d’en rédiger aussitôt un livre blanc. Et c’est effectivement ce que les gens ont fait, avec enthousiasme.

En revanche, la rareté créée par Jensen Huang ne peut pas être « forkée ». Vous ne pouvez pas « fork » la deuxième loi de la thermodynamique, vous ne pouvez pas « fork » la capacité du réseau électrique d’une ville, vous ne pouvez pas « fork » la surface physique d’un terrain.

Mais que ce soit Satoshi Nakamoto ou Jensen Huang, la rareté qu’ils créent conduit au même résultat : une course aux armements matérielle.

L’histoire de l’extraction minière suit ce parcours : CPU → GPU → FPGA → ASIC. Chaque nouvelle génération de matériel spécialisé rend obsolète la précédente. L’histoire de l’entraînement et de l’inférence IA est en train de se répéter : Hopper → Blackwell → Vera Rubin → Groq LPU. On commence avec des processeurs généralistes, puis on finit avec des circuits intégrés spécialisés. Le Groq LPU présenté par Jensen Huang cette année au GTC — un processeur à flux de données déterministe issu de l’acquisition de Groq — illustre parfaitement cette évolution. Compilation statique, ordonnancement par le compilateur, aucun ordonnancement dynamique, 500 Mo de SRAM embarquée : philosophiquement, son architecture est celle d’un ASIC dédié à l’inférence. Il ne fait qu’une seule chose, mais la fait de façon optimale.

Ce qui est intéressant, c’est que le GPU joue un rôle clé dans les deux vagues successives.

Vers 2013, les mineurs ont découvert que les GPU étaient plus adaptés que les CPU à l’extraction de tokens cryptographiques, provoquant une pénurie de cartes graphiques NVIDIA. Dix ans plus tard, les chercheurs ont constaté que les GPU constituaient l’outil idéal pour entraîner et exécuter des modèles IA, entraînant une nouvelle pénurie de cartes NVIDIA destinées aux centres de données. En tant que catégorie de processeurs, les GPU ont ainsi successivement servi deux générations d’économies de tokens.

La différence réside dans le fait que, la première fois, NVIDIA en a bénéficié passivement, sans suite particulière. La deuxième fois, lorsque le cœur de la consommation de puissance de calcul IA s’est déplacé de l’entraînement préliminaire vers l’inférence, NVIDIA a rapidement saisi l’opportunité pour concevoir activement l’ensemble du jeu, devenant ainsi le rédacteur des règles du jeu IA.

La pelle la plus rentable au monde

Pendant la ruée vers l’or, ce n’étaient pas les chercheurs d’or qui gagnaient le plus, mais Levi Strauss, le vendeur de pelles. Pendant la vague d’extraction minière, ce n’étaient pas les mineurs qui gagnaient le plus, mais Bitmain et Wu Jihan, les vendeurs de machines minières. Dans la vague actuelle d’entraînement et d’inférence IA, ce ne sont pas les modèles de base ou les agents IA qui gagnent le plus, mais NVIDIA, le vendeur de GPU.

Mais soyons honnêtes : le rôle occupé par Bitmain dans son secteur industriel n’est plus comparable à celui de NVIDIA dans le sien.

Bitmain ne vendait que des machines minières ; NVIDIA était même, à une époque, l’un de ses fournisseurs. Une fois que vous achetez une machine minière, vous décidez librement de miner quelle crypto-monnaie, sur quel pool minier, et à quel prix vous la revendez — aucune de ces décisions ne concerne Bitmain. Il s’agit d’un simple fournisseur matériel, dont les profits proviennent uniquement de la vente initiale des équipements.

NVIDIA est différent. Il ne vend pas seulement du matériel. Aujourd’hui, surtout depuis l’explosion de l’IA orientée inférence en 2025, il définit en profondeur comment utiliser tel GPU pour extraire quel type de token, comment valoriser les tokens, à qui les vendre, et comment allouer la puissance de calcul dans les centres de données… Tout cela figure dans les diapositives de Jensen Huang : il divise le marché en cinq niveaux, chacun correspondant à un modèle particulier, une longueur de contexte donnée, une vitesse d’interaction spécifique et une fourchette tarifaire précise… NVIDIA normalise et structure le futur marché, entièrement piloté par l’inférence IA.

Vers 2018, la puissance de calcul mondiale était concentrée dans quelques grands pools miniers — F2Pool, Antpool, BTC.com — qui se faisaient concurrence pour la part de puissance de calcul, mais dont les machines minières provenaient massivement de Bitmain.

De la même manière, aujourd’hui, 60 % des revenus de NVIDIA proviennent de « hyperscalers » concurrents tels qu’AWS, Azure, GCP, Oracle et CoreWeave, tandis que les 40 % restants proviennent de startups IA, de projets nationaux d’IA souveraine et de clients entreprises. Les grands « pools » génèrent la majeure partie des revenus, tandis que les petits « mineurs » apportent résilience et diversification.

Les structures des deux écosystèmes sont identiques. Mais Bitmain a ensuite rencontré des concurrents — MicroBT, Innosilicon, Canaan — qui ont progressivement grignoté sa part de marché. Les machines minières étant des ASIC relativement simples, les nouveaux entrants avaient une chance. En revanche, contester la position de NVIDIA semble devenir de plus en plus difficile : 20 ans d’écosystème CUDA, des centaines de millions de GPU installés, la technologie NVLink dans sa sixième génération, l’architecture décomposée d’inférence issue de l’intégration de Groq — la complexité technique et les barrières d’entrée de l’écosystème NVIDIA rendent inefficaces la plupart des outils concurrentiels.

Cela pourrait durer encore 20 ans.

La bifurcation fondamentale entre les deux types de tokens

Ce qui distingue fondamentalement les tokens cryptographiques des tokens IA utilisés pour l’entraînement et l’inférence, ce sont les motivations et les états d’esprit qui président à leur utilisation.

La demande côté tokens cryptographiques est spéculative. Personne « n’a besoin » de bitcoin pour accomplir une tâche concrète. Tous les livres blancs affirmant que les jetons blockchain peuvent résoudre vos problèmes sont rédigés par des escrocs. Vous détenez des tokens cryptographiques parce que vous croyez qu’une personne les achètera un jour à un prix supérieur. La valeur du bitcoin découle d’une prophétie autoréalisatrice : si suffisamment de personnes croient qu’il a de la valeur, alors il en a effectivement. C’est une économie de la foi.

La demande côté tokens IA est liée à la productivité. Nestlé a besoin de tokens pour prendre des décisions concernant sa chaîne logistique — ses données logistiques passent d’un rafraîchissement toutes les 15 minutes à toutes les 3 minutes, réduisant ainsi ses coûts de 83 %, une valeur directement reflétée dans le compte de résultats. 100 % des ingénieurs de NVIDIA utilisent désormais des tokens pour écrire du code, plutôt que de le faire manuellement ; leurs équipes de recherche ont besoin de tokens pour mener leurs travaux scientifiques. Vous n’avez pas besoin de croire en la valeur des tokens, vous avez juste besoin de les utiliser — leur valeur s’atteste alors d’elle-même, dans l’usage même.

Voilà la distinction la plus fondamentale entre les deux types de tokens. Les tokens cryptographiques sont produits pour être détenus et échangés — leur valeur réside précisément dans le fait qu’ils ne sont pas utilisés. Les tokens IA sont produits pour être immédiatement consommés — leur valeur réside dans l’instant même où ils sont utilisés.

L’un est de l’or numérique, dont la valeur augmente à mesure qu’on l’accumule ; l’autre est de l’électricité numérique, produite pour être immédiatement consommée.

Cette différence implique que l’économie des tokens IA ne connaîtra pas la bulle spéculative que connaît l’économie des tokens cryptographiques. Le bitcoin connaît des hausses et des baisses brutales, car le prix des actifs spéculatifs est dicté par les émotions. En revanche, le prix des tokens est déterminé par leur volume d’utilisation et par leur coût de production. Tant que l’IA restera utile — tant que les gens continueront d’utiliser Claude Code pour écrire du code, ChatGPT pour rédiger des rapports, ou des agents pour automatiser des processus métiers — la demande de tokens ne s’effondrera pas. Elle ne repose pas sur la foi, mais sur l’indispensabilité.

En 2008, le livre blanc du bitcoin devait démontrer de façon répétée pourquoi un système monétaire électronique décentralisé avait de la valeur. Dix-sept ans plus tard, les débats persistent encore.

En 2026, l’économie des tokens ne suscite aucun débat, et n’a même pas besoin d’être justifiée pour devenir un consensus. Lorsque Jensen Huang déclare sur scène au GTC que « tokens are the new commodity », personne ne remet cela en question. Car chacun des spectateurs présents dans la salle a, ce matin même, consommé plusieurs millions de tokens avec Claude Code ou ChatGPT. Ils n’ont pas besoin qu’on leur prouve la valeur des tokens — leur relevé de carte bancaire l’a déjà fait.

En ce sens, Jensen Huang est véritablement la copie conforme de Satoshi Nakamoto — cette copie qui, après avoir laissé derrière lui Satoshi Nakamoto, a monopolisé la production des machines minières, défini les scénarios d’utilisation des tokens et leurs normes d’emploi, et organise chaque année, au SAP Center de San Jose, un spectacle grandiose pour annoncer la puissance des prochaines « machines minières » capables de soutenir l’entraînement et l’inférence IA.

Satoshi Nakamoto possède un charme discret et prudent : il conçoit les règles, les confie au code, puis disparaît. C’est là toute la romance du mouvement cypherpunk. Jensen Huang, quant à lui, ressemble plus à un homme d’affaires qu’à n’importe quel scientifique : il conçoit les règles, les maintient personnellement, les enrichit sans cesse, et renforce méthodiquement sa propre ligne de défense.

Le token que vous perceviez auparavant parce que vous y croyiez, vous pouvez désormais le voir sans avoir besoin d’y croire. Il est le suivant, après le watt, l’ampère et le bit.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News