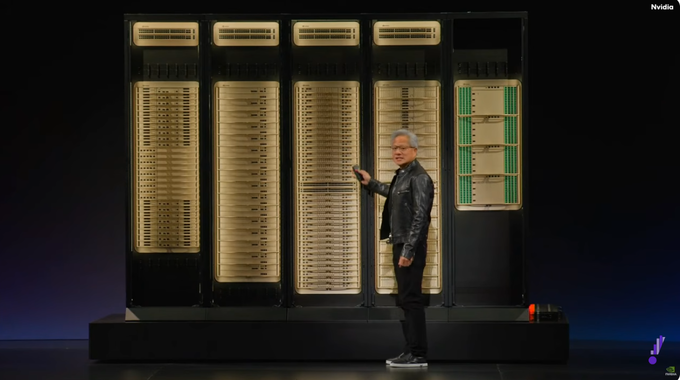

Entrevue complète la plus récente de Jensen Huang : « Renoncer au marché chinois, c’est adopter une mentalité de perdant » – L’interdiction des puces de calcul ne peut pas freiner l’IA chinoise

TechFlow SélectionTechFlow Sélection

Entrevue complète la plus récente de Jensen Huang : « Renoncer au marché chinois, c’est adopter une mentalité de perdant » – L’interdiction des puces de calcul ne peut pas freiner l’IA chinoise

« Ce que nous faisons pour construire des plates-formes de calcul, personne d’autre ne le fera si nous ne le faisons pas. »

Rédaction & traduction : TechFlow

Invité : Jensen Huang, fondateur et PDG de NVIDIA

Animateur : Dwarkesh Patel

Source du podcast : Dwarkesh Patel

Titre original : Jensen Huang – La « moat » de NVIDIA perdurera-t-elle ?

Date de diffusion : 16 avril 2026

Résumé des points clés

Cet article explore, à travers un entretien avec Jensen Huang, PDG de NVIDIA, plusieurs questions cruciales : l’impact potentiel des unités de traitement tensoriel (TPU) sur la position dominante de NVIDIA dans le domaine du calcul IA ; le contrôle exercé par la société sur la chaîne d’approvisionnement avancée des puces ; la question de savoir si NVIDIA devrait vendre des puces IA à la Chine ; pourquoi NVIDIA ne devient pas directement un fournisseur de services cloud à très grande échelle (hyperscaler) ; ainsi que les choix stratégiques de la société en matière d’architecture de puces et d’investissement.

Résumé des idées marquantes

Sur l’essence même de NVIDIA et sa « moat »

- « Au fond, quelque chose doit toujours transformer des électrons en tokens. Ce processus de transformation — et le fait que ces tokens gagnent progressivement en valeur au fil du temps — n’est pas facilement standardisable. Notre rôle consiste à accomplir autant que possible les tâches indispensables, et aussi peu que possible celles qui ne le sont pas, afin de réaliser cette transformation. »

- « Pourquoi nos partenaires de la chaîne d’approvisionnement acceptent-ils d’investir pour nous, et non pour d’autres ? Parce qu’ils savent que NVIDIA est capable d’absorber leurs volumes de production et de les écouler via notre chaîne d’approvisionnement aval. L’ampleur colossale de notre chaîne d’approvisionnement aval et de la demande qu’elle génère justifie leur pari en amont. »

- « Aucun goulot d’étranglement ne persiste plus de deux ou trois ans — sans exception. Ce qui m’inquiète, ce sont les contraintes en aval — par exemple, les politiques qui entravent le développement énergétique. Sans énergie, on ne peut pas bâtir une industrie ; sans énergie, on ne peut pas relancer l’industrialisation. »

Sur la bataille entre CUDA et les circuits intégrés spécifiques (ASIC)

- « NVIDIA ne fabrique pas des unités de traitement tensoriel : elle développe du calcul accéléré. Le champ couvert par le calcul accéléré est bien plus vaste… Nous sommes la seule entreprise à accélérer toutes sortes d’applications, dotée d’un écosystème gigantesque. »

- « Les GPU de NVIDIA sont des accélérateurs, comparables à des voitures de Formule 1. Tout le monde peut conduire à cent km/h sans problème, mais pousser la machine à ses limites exige une maîtrise approfondie. Nous utilisons massivement l’IA pour générer nos propres kernels. »

- « La pile logicielle et matérielle de calcul de NVIDIA est, sans conteste, la plus rentable au monde. Aucune autre plateforme ne m’a jamais démontré aujourd’hui un meilleur rapport performance/coût total de possession. »

Sur la philosophie d’entreprise et les investissements

- « Nous devons faire autant que possible les choses nécessaires, et aussi peu que possible celles qui ne le sont pas. Cela signifie : tout ce que nous construisons sur notre plateforme de calcul, si nous ne le faisions pas, personne d’autre ne le ferait vraiment. En revanche, les services cloud ne manquent pas dans le monde — s’il ne s’agissait pas de nous, quelqu’un d’autre le ferait. »

- « Mon erreur a été de ne pas percevoir pleinement qu’ils n’avaient tout simplement pas d’autre choix — aucun fonds de capital-risque n’aurait jamais investi 5 à 10 milliards de dollars dans un laboratoire IA. C’était une lacune dans ma vision. Si je pouvais revenir en arrière, et si NVIDIA avait eu alors l’envergure qu’elle a aujourd’hui, j’aurais volontiers agi ainsi. »

Sur le marché chinois et la géopolitique (le sujet le plus suivi)

- « Quelle est la meilleure façon de créer un monde sûr ? Transformer les autres en victimes ou en ennemis est probablement la pire réponse. Ce sont des adversaires, et nous voulons que les États-Unis l’emportent — mais maintenir le dialogue et les échanges scientifiques reste, selon moi, la démarche la plus sûre. »

- « Cette mentalité de perdant, ce présupposé de défaite, ne signifie rien pour moi. Abandonner un marché sur la base d’un tel postulat est inacceptable. Cela n’a aucun sens, car je ne considère ni les États-Unis ni notre secteur comme des perdants. Cette vision de la défaite est totalement dénuée de sens à mes yeux. »

- « Lorsque vous disposez d’une énergie abondante, celle-ci peut compenser les insuffisances des puces. Si votre puissance électrique est largement disponible — voire quasi gratuite — pourquoi vous soucier de la performance par watt ? Vous pouvez tout simplement empiler des puces anciennes. Une puce en technologie 7 nm est, en pratique, équivalente à la génération Hopper : elle suffit pleinement. »

- « Le jour où DeepSeek a lancé son modèle sur les puces Huawei fut un mauvais résultat pour notre pays… Si tous les modèles IA fonctionnent mieux sur des piles technologiques étrangères, vous devrez alors expliquer pourquoi cela serait bénéfique pour les États-Unis. »

Sur les logiciels, les agents (agents) et l’avenir

- « Aujourd’hui, nous sommes limités par le nombre d’ingénieurs disponibles. Demain, ceux-ci seront soutenus par une multitude d’agents, nous permettant d’explorer l’espace de conception de manière inédite… L’utilisation d’outils fera exploser la taille des entreprises logicielles — cela ne s’est pas encore produit parce que les agents ne maîtrisent pas encore suffisamment ces outils. »

- « Une chose sur laquelle vous pouvez compter chez NVIDIA : cette année, Vera Rubin sera remarquable ; l’année prochaine viendra Vera Rubin Ultra ; et l’année suivante, Feynman. Vous pouvez nous faire confiance chaque année, comme à une horloge. »

Sur l’architecture et les charges de travail

- « Nous pourrions certes développer plusieurs architectures différentes — seulement, nous n’avons pas d’idées meilleures. Nous avons simulé toutes les options, et les résultats étaient systématiquement inférieurs : nous n’opterons donc pas pour cette voie. »

- « Par le passé, un débit élevé était toujours préférable. Mais nous pensons qu’un monde pourrait émerger où les tokens atteignent une valeur unitaire très élevée : même avec un débit d’usine moindre, cette valeur unitaire compenserait largement l’écart. C’est précisément pour étendre la frontière de Pareto que nous avons pris cette décision. »

La suprématie de NVIDIA sur la chaîne d’approvisionnement constitue-t-elle sa « moat » la plus importante ?

Animateur Dwarkesh : Nous observons une chute brutale des valorisations de nombreuses entreprises logicielles, car le marché anticipe que l’IA va banaliser les logiciels. Une logique apparemment simple suggère ceci : NVIDIA envoie ses fichiers GDS2 à TSMC, qui fabrique les puces logiques et les commutateurs ; celles-ci sont ensuite assemblées avec les mémoires HBM de SK Hynix, Micron et Samsung, puis envoyées aux fabricants OEM taïwanais pour l’intégration finale. Selon cette lecture, NVIDIA serait essentiellement une entreprise logicielle, dont la fabrication est externalisée — si les logiciels deviennent banalisés, NVIDIA ne subira-t-elle pas le même sort ?

Jensen Huang :

Au fond, quelque chose doit toujours transformer des électrons en tokens, et ce processus de transformation — ainsi que la croissance continue de la valeur des tokens au fil du temps — n’est pas aisément banalisable. Faire en sorte qu’un token soit plus précieux qu’un autre revient à rendre une molécule plus précieuse qu’une autre : cela implique un art, une ingénierie, une science et des inventions dont nous sommes actuellement les témoins. La transformation, le traitement et la science sous-jacents à la création d’un token restent mal compris, et ce voyage est loin d’être achevé. Je ne crois pas qu’il puisse être banalisé. Le cadre que vous décrivez correspond exactement à mon propre modèle mental de l’entreprise : l’entrée est constituée d’électrons, la sortie de tokens, et NVIDIA occupe le milieu. Notre mission consiste à accomplir autant que possible les tâches indispensables, et aussi peu que possible celles qui ne le sont pas, afin de réaliser cette transformation. « Aussi peu que possible » signifie que toute tâche que je n’ai pas besoin d’accomplir moi-même est confiée à un partenaire, qui devient ainsi partie intégrante de mon écosystème. Si vous regardez NVIDIA aujourd’hui, vous constaterez que nous disposons probablement du plus vaste écosystème de partenaires au monde : chaîne d’approvisionnement amont, constructeurs informatiques aval, développeurs d’applications, créateurs de modèles — tous y sont inclus.

L’IA forme un « gâteau à cinq couches » (applications, modèles, infrastructures, puces, énergie), et nous cultivons un écosystème à chaque niveau. Nous faisons le minimum nécessaire, mais cette part indispensable est extrêmement difficile. Je ne crois pas qu’elle puisse être banalisée, et je ne crois pas non plus que les entreprises logicielles ou les éditeurs d’outils puissent l’être. La plupart des sociétés logicielles sont aujourd’hui des fabricants d’outils, mais je vois l’inverse de ce que la majorité perçoit : le nombre d’agents IA va croître exponentiellement, tout comme celui des utilisateurs d’outils. Le nombre d’instances de Synopsys Design Compiler va probablement exploser, tout comme le nombre d’agents utilisant des outils de placement ou des vérificateurs de règles de conception. Aujourd’hui, nous sommes limités par le nombre d’ingénieurs ; demain, ces derniers seront assistés par une multitude d’agents, nous permettant d’explorer l’espace de conception de façon inédite — en utilisant précisément les mêmes outils d’aujourd’hui. L’adoption massive des outils fera croître rapidement la taille des entreprises logicielles — ce phénomène ne s’est pas encore produit parce que les agents ne maîtrisent pas encore suffisamment les outils. Soit ces entreprises construiront elles-mêmes des agents, soit les agents deviendront assez performants pour utiliser ces outils — je pense que les deux scénarios se produiront.

Animateur Dwarkesh : Votre dernier rapport financier mentionne des engagements d’achat d’environ cent milliards de dollars, couvrant les fonderies, la mémoire et l’emballage. Le rapport de SemiAnalysis estime ce chiffre à 250 milliards de dollars. Une interprétation courante est que la véritable « moat » de NVIDIA réside dans le verrouillage de capacités rares sur plusieurs années — d’autres peuvent disposer d’accélérateurs, mais peuvent-ils obtenir la mémoire ? Peuvent-ils obtenir les puces logiques ? S’agit-il là de la plus grande « moat » de NVIDIA pour les prochaines années ?

Jensen Huang :

C’est l’une des choses que nous pouvons faire, et que d’autres peinent à reproduire. Nous avons pris d’importants engagements en amont, certains explicites, d’autres implicites. Par exemple, de nombreux investissements en amont sont initiés spontanément par nos partenaires de la chaîne d’approvisionnement, car je leur ai dit à leurs PDG : « Permettez-moi de vous décrire l’ampleur de ce marché, de vous expliquer pourquoi, de vous accompagner dans une projection conjointe, et de vous montrer ce que je vois. » Grâce à ce processus continu d’information, d’inspiration et de collaboration avec les PDG, ils ont accepté de s’engager. Pourquoi investissent-ils pour nous, et non pour d’autres ? Parce qu’ils savent que NVIDIA peut absorber leurs volumes de production et les écouler via notre chaîne d’approvisionnement aval. L’ampleur colossale de notre chaîne d’approvisionnement aval et de la demande qu’elle génère justifie leur pari en amont. Observez la conférence GTC : les participants s’y émerveillent devant son ampleur et la qualité des intervenants — l’ensemble de l’univers IA y est représenté, dans une couverture à 360 degrés, car ils ont besoin de se rencontrer. Je les rassemble, je fais en sorte que l’aval voie l’amont, que l’amont voie l’aval, et que chacun prenne connaissance des dernières avancées de l’IA. Ce qui compte, c’est qu’ils puissent constater de visu ce que font les entreprises natives de l’IA et les startups IA, confirmant ainsi ce que je leur dis depuis longtemps. J’ai consacré beaucoup de temps — directement ou indirectement — à faire comprendre à la chaîne d’approvisionnement, aux partenaires et à l’écosystème les opportunités qui s’offrent à nous.

Dans nos discours d’ouverture, une partie semble toujours un peu lourde, presque didactique — c’est exactement mon intention. Je dois m’assurer que toute la chaîne d’approvisionnement, en amont comme en aval, comprenne ce qui arrive, pourquoi cela arrive, quand cela arrivera, à quelle échelle — et qu’elle soit capable, comme moi, de procéder à des projections systématiques. Concernant cette « moat », nous sommes capables de construire pour l’avenir. Si la taille du marché atteint plusieurs milliers de milliards de dollars dans les prochaines années, nous disposons d’une chaîne d’approvisionnement capable de la supporter. Sans notre couverture, la vitesse de notre activité — comme celle des flux de trésorerie — ne serait pas viable : personne ne construirait une chaîne d’approvisionnement pour une architecture à faible rotation. Nous maintenons cette échelle uniquement parce que notre demande aval est si forte que nos partenaires la voient, l’entendent, et la constatent concrètement.

Animateur Dwarkesh : Je voudrais aborder plus précisément la capacité de production en amont. Pendant des années, vous avez doublé vos volumes annuels, tandis que l’offre de puissance de calcul augmentait de plus de trois fois par an — doubler à cette échelle est véritablement remarquable. Vous êtes le plus gros client de TSMC sur le nœud N3, et l’un des principaux clients sur le nœud N2. Cette année, l’IA représentera 60 % de la production N3, et selon les prévisions de SemiAnalysis, ce chiffre atteindra 86 % l’année prochaine. Comment pouvez-vous doubler lorsque vous détenez déjà la majorité du marché — et ce, année après année ?

Jensen Huang :

À un certain niveau, la demande instantanée mondiale dépasse l’offre globale en amont et en aval. C’est précisément ce qu’on souhaite dans un secteur : une demande instantanée supérieure à l’offre totale du secteur. L’inverse serait manifestement problématique ; si l’écart est trop important, un goulot d’étranglement spécifique attire immédiatement l’attention de l’ensemble du secteur pour être résolu. Ainsi, les discussions autour de CoWoS se sont nettement atténuées, car nous avons forcé ce goulot d’étranglement pendant deux ans, multipliant sa capacité par plusieurs facteurs. TSMC a désormais compris que la capacité CoWoS doit suivre le rythme de la demande en puces logiques et en mémoire : ils étendent actuellement CoWoS et leurs futures technologies d’emballage à la même vitesse que les puces logiques. Pendant longtemps, CoWoS et HBM étaient considérés comme des produits spécialisés, mais ce n’est plus le cas — on reconnaît désormais qu’il s’agit de technologies informatiques grand public. Nous pouvons aujourd’hui influencer une chaîne d’approvisionnement bien plus large. Dès le début de la révolution IA, j’ai formulé les mêmes propos que ceux que je tiens aujourd’hui. Certains y ont cru et investi, comme Sanjay et l’équipe de Micron — je me souviens clairement de cette réunion, où j’ai exposé avec précision ce qui allait se produire, pourquoi, et mes prévisions. Ils ont réellement parié sur cette vision, et nous collaborons étroitement avec eux sur les mémoires LPDDR et HBM, ce qui leur a valu des résultats excellents. D’autres sont arrivés plus tard, mais ils sont désormais tous en place. Chaque goulot d’étranglement suscite une attention intense, et nous anticipons désormais ces goulots plusieurs années à l’avance. Par exemple, nos collaborations passées avec Lumentum, Coherent et l’ensemble de l’écosystème des photonic silicon ont profondément remodelé la chaîne d’approvisionnement. Nous avons bâti une chaîne d’approvisionnement complète autour de TSMC, travaillant avec eux sur COUPE, inventant une série entière de technologies, et leur accordant des licences sur nos brevets afin de maintenir un écosystème ouvert. Nous aidons nos partenaires à accroître leur capacité grâce à l’invention de nouvelles technologies, de nouveaux flux de travail, de nouveaux équipements de test (comme les sondes bidirectionnelles), et grâce à des investissements directs.

Si nous décourageons les gens de devenir ingénieurs logiciels, nous ferons face à une pénurie d’ingénieurs logiciels. Ce même scénario catastrophe s’est produit il y a dix ans. Certains prophètes de l’apocalypse affirmaient alors : « Quoi qu’il arrive, ne devenez surtout pas radiologue. » Vous pouvez encore trouver ces vidéos en ligne, affirmant que la radiologie serait le premier métier à disparaître, que le monde n’aurait plus besoin de radiologues. Devinez ce qui fait défaut aujourd’hui ? Des radiologues.

Animateur Dwarkesh : Comment parvenez-vous à doubler chaque année la quantité de puces logiques fabriquées ? À terme, tant la mémoire que les puces logiques dépendent de la lithographie EUV.

Jensen Huang :

Aucun de ces éléments ne nécessite des délais impossibles à raccourcir. Tout peut être résolu en deux ou trois ans, dès lors qu’un signal de demande est émis — rien n’est difficile à reproduire. Quant à la profondeur à laquelle nous devons intervenir dans la chaîne d’approvisionnement — certaines actions sont directes, d’autres indirectes, d’autres encore reposent sur une influence stratégique : si je convaincs TSMC, ASML suivra naturellement. Nous devons identifier les nœuds critiques, mais une fois TSMC convaincue, des machines EUV en nombre suffisant seront disponibles dans les deux ou trois ans. Le point essentiel est que aucun goulot d’étranglement ne persiste plus de deux ou trois ans — sans exception. Parallèlement, l’efficacité de calcul de chaque nouvelle génération augmente de 10 à 20 fois ; entre Hopper et Blackwell, ce gain atteint 30 à 50 fois. Nous exploitons la flexibilité de CUDA pour inventer continuellement de nouveaux algorithmes, améliorant ainsi l’efficacité tout en développant la capacité de production. Rien de tout cela ne m’inquiète. Ce qui m’inquiète, ce sont les contraintes en aval — par exemple, les politiques qui entravent le développement énergétique. Sans énergie, on ne peut pas bâtir une industrie ; sans énergie, on ne peut pas relancer l’industrialisation, ramener aux États-Unis la fabrication de puces, d’ordinateurs ou d’emballages, ni produire de véhicules électriques, de robots ou d’usines IA. Accroître la capacité de production de puces, ou celle de CoWoS, est un défi résoluble en deux ou trois ans.

Les TPU vont-elles briser la domination de NVIDIA dans le calcul IA ?

Animateur Dwarkesh : Si l’on examine les TPU, une opinion courante veut que deux des trois plus grands modèles mondiaux — Claude et Gemini — soient entraînés sur des TPU. Que signifie cela pour NVIDIA ?

Jensen Huang :

Nous faisons quelque chose de radicalement différent. NVIDIA développe du calcul accéléré, pas des unités de traitement tensoriel. Le calcul accéléré est utilisé dans de nombreux domaines : dynamique moléculaire, chromodynamique quantique, traitement de données, dataframes, données structurées et non structurées, mécanique des fluides et physique des particules — et aussi l’IA. Le champ couvert par le calcul accéléré est bien plus vaste. Certes, tout le monde parle aujourd’hui d’IA, et celle-ci est effectivement cruciale, mais le calcul dépasse largement l’IA. NVIDIA a redéfini la façon de calculer, en passant du calcul généraliste au calcul accéléré. Notre marché est bien plus étendu que celui de n’importe quelle TPU ou ASIC. Regardez notre position sur le marché — nous sommes la seule entreprise à accélérer toutes sortes d’applications, dotée d’un écosystème immense, où tous les frameworks et algorithmes tournent sur les puces NVIDIA. Comme nos ordinateurs sont conçus pour être utilisés par des opérateurs externes, n’importe qui peut acheter nos systèmes. La plupart des systèmes internes doivent être gérés par leurs concepteurs, car ils n’ont jamais été conçus pour être suffisamment flexibles pour une exploitation externe. Précisément parce que n’importe qui peut exploiter nos systèmes, nous sommes présents sur tous les nuages — Google, Amazon, Azure et OCI. Si vous voulez louer des ressources, vous devez impérativement disposer d’un vaste écosystème de clients issus de tous les secteurs. Si vous voulez les utiliser vous-même, nous pouvons également vous aider, comme nous l’avons fait pour xAI d’Elon. Et parce que nous permettons à n’importe quelle entreprise, de n’importe quel secteur, d’exploiter nos systèmes, vous pouvez les utiliser pour construire un supercalculateur dédié à la recherche scientifique et à la découverte de médicaments pour Lilly, et les exploiter vous-même pour répondre aux besoins variés de la découverte pharmaceutique et des sciences de la vie. Il existe bien trop d’applications que les TPU ne couvrent pas. NVIDIA a transformé CUDA en un excellent processeur tensoriel, tout en lui permettant de traiter chaque étape du cycle de vie des données — traitement, calcul, IA — et bien plus encore. Notre opportunité de marché est plus grande, notre couverture plus large. Parce que nous soutenons toutes les applications mondiales, vous savez que n’importe quel système NVIDIA que vous installez sera utilisé par des clients — une réalité totalement différente.

Animateur Dwarkesh : Voici une question longue. Vous enregistrez des revenus impressionnants, de 60 milliards de dollars par trimestre, mais ce n’est pas grâce à la pharmacie ou à la physique quantique — c’est parce que l’IA est une technologie sans précédent, qui connaît une croissance inédite. La question est : quelle est l’architecture optimale pour l’IA elle-même ?

J’ai échangé avec des chercheurs en IA, qui m’ont dit que les TPU sont des matrices pulsantes énormes, spécifiquement optimisées pour la multiplication matricielle ; tandis que les GPU sont flexibles, adaptés aux scénarios comportant de nombreuses branches ou des accès mémoire irréguliers. Or, qu’est-ce que l’IA ? C’est avant tout une multiplication matricielle extrêmement prévisible, répétée indéfiniment. Les TPU n’ont pas besoin de sacrifier de surface de puce à des planificateurs de warps ou à la gestion des commutations entre threads et banques mémoire — elles sont profondément optimisées pour le cas d’usage principal de la croissance actuelle de la puissance de calcul. Quelle est votre analyse ?

Jensen Huang :

La multiplication matricielle est une composante essentielle de l’IA, mais pas l’ensemble. Si vous souhaitez inventer un nouveau mécanisme d’attention, expérimenter de nouvelles méthodes de découpage, ou concevoir une architecture entièrement nouvelle — par exemple, un modèle hybride SSM — vous avez besoin d’une architecture universellement programmable. Si vous créez un modèle fusionnant les techniques de diffusion et d’autorégression, vous avez également besoin d’une architecture universellement programmable. Nous pouvons exécuter tout ce que vous imaginez — c’est là notre avantage. La programmabilité rend bien plus facile l’invention de nouveaux algorithmes, et c’est précisément cette capacité qui explique la rapidité fulgurante des progrès de l’IA. Les TPU, comme tout le reste, sont soumises à la loi de Moore — qui apporte environ 25 % d’amélioration annuelle. Pour réaliser des bonds de 10 ou 100 fois, la seule voie est de transformer fondamentalement chaque année les algorithmes et les modes de calcul. C’est précisément là que réside l’avantage central de NVIDIA. Lorsque j’ai annoncé pour la première fois que l’efficacité énergétique de Blackwell serait 35 fois supérieure à celle de Hopper, personne ne m’a cru. Puis Dylan a publié un article affirmant que j’avais sous-estimé ce ratio, qui serait en réalité de 50 fois — une amélioration impossible à obtenir uniquement grâce à la loi de Moore. Notre solution repose sur de nouvelles conceptions de modèles — comme MoE, la parallélisation transversale des systèmes informatiques, le découpage et le déploiement distribué. Sans CUDA pour générer de nouveaux kernels, je ne sais même pas par où commencer. C’est la combinaison d’une architecture programmable et de la capacité de conception collaborative extrême de NVIDIA. Nous pouvons décharger une partie des calculs sur le réseau NVLink, ou sur la couche réseau de Spectrum-X. Nous pouvons innover simultanément au niveau du processeur, du système, du réseau, des bibliothèques et des algorithmes. Sans CUDA, je ne sais pas par où commencer.

Animateur Dwarkesh : 60 % de vos revenus proviennent des cinq plus grands hyperscalers. Dans l’ère des clients académiques — comme les professeurs qui réalisent des expériences — ils ont besoin de CUDA, et ne peuvent pas utiliser d’autres accélérateurs : ils doivent passer par PyTorch et CUDA. Mais ces hyperscalers disposent des ressources nécessaires pour écrire leurs propres kernels — et ils doivent effectivement le faire pour extraire les 5 % de performance supplémentaires sur une architecture donnée. Anthropic et Google utilisent majoritairement leurs propres accélérateurs ou des TPU et Trainium ; OpenAI, même en utilisant des GPU, recourt à Triton, car elle a besoin de ses propres kernels, descendant jusqu’au CUDA C++ et contournant cuBLAS et NCCL pour construire sa propre pile logicielle, pouvant même être compilée vers d’autres accélérateurs.

Si la plupart de vos clients peuvent, dans une certaine mesure, remplacer CUDA, CUDA reste-t-il réellement le facteur décisif qui fait que les avancées de l’IA se produisent sur les plateformes NVIDIA ?

Jensen Huang :

CUDA est un écosystème extrêmement riche. Si vous souhaitez développer une application sur n’importe quelle architecture, commencer par CUDA est une décision très judicieuse, car l’écosystème est particulièrement fourni, et nous soutenons tous les frameworks existants. Si vous souhaitez créer des kernels personnalisés, nous avons contribué massivement à Triton — dont le backend intègre de nombreuses technologies NVIDIA. Nous sommes ravis d’aider chaque framework à atteindre son plein potentiel. De nombreux frameworks existent : Triton, vLLM, SGLang, et maintenant une explosion de frameworks dédiés au post-entraînement et à l’apprentissage par renforcement, comme verl et NeMo RL. Dans l’ensemble de ce domaine du post-entraînement et de l’apprentissage par renforcement, tout explose littéralement. Ainsi, si vous souhaitez développer sur une architecture donnée, choisir CUDA est la décision la plus judicieuse, car vous savez que l’écosystème est riche, et que si un problème survient, il est bien plus probable que le problème vienne de votre code que de la montagne de code sous-jacente. Lorsqu’un problème survient, est-ce votre faute ou celle de la machine ? Vous voulez toujours que ce soit votre faute, et que vous puissiez faire confiance à la machine. Bien sûr, nous avons aussi nos bugs, mais notre système est suffisamment éprouvé pour que vous puissiez au moins y construire quelque chose. Ensuite, en tant que développeur de logiciels fonctionnant partout, la chose la plus importante est de disposer d’une base installée suffisamment vaste pour que vos logiciels tournent sur un grand nombre d’autres machines. Vous ne programmez pas pour vous-même, mais pour l’ensemble de votre parc, ou pour celui de tous les autres, car vous êtes concepteur de framework — et l’écosystème CUDA de NVIDIA est véritablement le trésor central. Nous avons aujourd’hui des centaines de millions de GPU déployés dans le monde — A10, A100, H100, H200, séries L et P, dans toutes les tailles et configurations. Si vous êtes une entreprise de robotique, vous souhaitez que cette pile technologique CUDA s’exécute directement sur le robot lui-même — et nous sommes omniprésents. Une base installée colossale signifie que, dès que vous développez un logiciel ou un modèle, il est utile partout. Cette valeur est irremplaçable. Enfin, le fait que nous soyons présents sur tous les nuages nous rend véritablement uniques. Si vous êtes une entreprise IA ou un développeur, vous ne savez pas encore quel fournisseur de nuage vous choisirez, ni où vous exécuterez vos applications. Nous sommes exécutables partout — y compris sur vos propres déploiements privés. La richesse de l’écosystème, l’étendue de la base installée et la diversité de nos déploiements, combinées, confèrent à CUDA une valeur exceptionnelle.

Animateur Dwarkesh : Mais je me demande si ces avantages sont tout aussi importants pour vos principaux clients. Beaucoup d’entre eux peuvent construire leur propre pile logicielle. En particulier, à mesure que l’IA devient de plus en plus puissante dans des domaines nécessitant des boucles de validation rigoureuses, la question devient : tous les hyperscalers peuvent-ils réellement écrire leurs propres kernels ? NVIDIA reste excellente en termes de rapport coût-performance, ils peuvent donc encore préférer NVIDIA — mais cela risque-t-il de se réduire à une simple course aux spécifications, à un concours de puissance de calcul et de bande passante mémoire par dollar dépensé ? Historiquement, la marge brute de NVIDIA dépasse 70 %, précisément grâce à la « moat » de CUDA. Si la plupart des clients peuvent effectivement remplacer CUDA, cette marge pourra-t-elle être maintenue ?

Jensen Huang :

Nous affectons un nombre stupéfiant d’ingénieurs à nos laboratoires IA, spécifiquement pour collaborer avec eux et optimiser leur pile technologique. La raison est simple : personne ne connaît mieux notre architecture que nous-mêmes. Ces architectures ne sont pas aussi universelles que les CPU — un CPU ressemble à une Cadillac : une berline luxueuse stable, pas très rapide, mais que tout le monde peut conduire, avec régulateur de vitesse, tout est fluide. Les GPU NVIDIA sont des accélérateurs, comparables à des voitures de Formule 1. Tout le monde peut conduire à cent km/h sans problème, mais les pousser à leurs limites exige une maîtrise approfondie. Nous utilisons massivement l’IA pour générer nos propres kernels. Je suis convaincu que, pendant une longue période encore, nous resterons indispensables. Notre expertise permet à nos partenaires laboratoires IA d’extraire encore 2 fois plus de performance de leur pile technologique — souvent très facilement. Lorsque nous optimisons un kernel spécifique, ou l’ensemble de leur pile, il est tout à fait normal que leurs modèles accélèrent de 2, 3 ou 50 %. C’est un chiffre énorme, surtout lorsqu’on parle de leur base installée massive de puces Hopper et Blackwell — si l’efficacité double, cela se traduit directement par un doublement des revenus. La pile de calcul NVIDIA est, sans exception, la plus rentable au monde. Aucune autre plateforme ne m’a jamais démontré aujourd’hui un meilleur rapport performance/coût total de possession. Aucune. Le benchmark InferenceMAX est là, accessible à tous — les TPU ne s’y présentent pas, les Trainium non plus. J’invite tout le monde à démontrer avec InferenceMAX leur prétendue avantage de coût de 40 % — personne ne veut venir. Ensuite, vous dites que 60 % de nos clients sont parmi les cinq premiers, mais la majeure partie de ces ventes concerne des activités externes — une grande partie des NVIDIA sur AWS sont destinées à des clients externes, pas à une utilisation interne par AWS ; les clients d’Azure sont tous externes ; il en va de même pour OCI. Ils nous préfèrent parce que notre couverture est exceptionnellement vaste, et que nous attirons les meilleurs clients de tous les secteurs. Ces clients construisent sur NVIDIA parce que notre couverture et notre flexibilité sont inégalées. La dynamique circulaire est la suivante : base installée, programmabilité de l’architecture, richesse de l’écosystème, et des dizaines de milliers d’entreprises IA dans le monde. Si vous êtes une startup IA, quelle architecture choisirez-vous ? Celle qui offre l’écosystème le plus riche. Celle qui dispose de la base installée la plus vaste. Celle qui possède l’écosystème le plus riche. C’est ainsi que fonctionne la dynamique circulaire, associée au rendement unitaire le plus élevé en puissance de calcul et à la performance par watt la plus élevée — si votre partenaire construit un centre de données d’un GW, ce centre doit produire le plus de tokens et générer le plus de revenus possible : nous sommes l’architecture offrant le plus haut rendement en tokens par watt au monde. Si votre objectif est de louer des infrastructures, nous disposons du plus grand nombre de clients dans le monde. C’est pourquoi la dynamique circulaire fonctionne.

Animateur Dwarkesh : Anthropic vient d’annoncer une commande massive de TPU, d’un niveau multi-GW, en partenariat avec Broadcom et Google, et la majeure partie de sa puissance de calcul provient désormais des TPU. Si l’on observe ces grandes entreprises IA, une part importante de leur puissance de calcul semble migrer hors de NVIDIA. Comment expliquer ce phénomène ?

Jensen Huang :

Anthropic est une exception, pas une tendance. Sans Anthropic, d’où viendrait la croissance des TPU ? Elle provient à 100 % d’Anthropic. Sans Anthropic, d’où viendrait la croissance de Trainium ? Également à 100 % d’Anthropic. C’est une information largement connue, et pratiquement tout le monde la comprend. Il ne s’agit pas d’une prolifération d’opportunités ASIC — il ne s’agit que d’Anthropic.

Je ne suis pas contrarié par le fait que d’autres utilisent des solutions alternatives ou expérimentent de nouvelles directions. S’ils ne testaient pas d’autres solutions, comment sauraient-ils à quel point nous sommes bons ? Parfois, un point de comparaison est nécessaire pour se rappeler de notre propre valeur. Nous devons continuellement conquérir notre position sur le marché. De nombreuses déclarations ambitieuses ont été faites — mais combien de projets ASIC ont été annulés ? Construire quelque chose de meilleur que NVIDIA n’est pas une mince affaire. Où NVIDIA aurait-elle échoué, pour que cela paraisse crédible ? À cause de notre échelle, de notre vitesse d’itération, nous sommes la seule entreprise au monde à progresser par bonds chaque année.

La marge brute des ASIC est assez élevée — celle de NVIDIA est de 70 %, celle des ASIC de 65 %. La marge brute des ASIC est, d’après ce que je peux observer, très satisfaisante — ils la jugent eux-mêmes excellente, et en sont fiers. Alors, pourquoi cela ? Il y a longtemps, nous n’avions tout simplement pas la capacité de le faire. À l’époque, je ne comprenais pas pleinement la difficulté de créer des laboratoires IA fondamentaux comme OpenAI ou Anthropic, ni le montant colossal d’investissements requis de la part des fournisseurs. Nous n’avions pas la capacité d’investir des milliards de dollars dans Anthropic pour qu’ils utilisent notre puissance de calcul. Google et AWS avaient cette capacité, et ont massivement financé Anthropic en phase initiale, ce qui a conduit Anthropic à utiliser leur puissance de calcul. À l’époque, nous n’avions pas cette possibilité. Mon erreur a été de ne pas percevoir pleinement qu’ils n’avaient tout simplement pas d’autre choix — aucun fonds de capital-risque n’aurait jamais investi 5 à 10 milliards de dollars dans un laboratoire IA, en espérant qu’il devienne l’Anthropic d’aujourd’hui. C’était une lacune dans ma vision. Mais même si je l’avais comprise à l’époque, nous n’aurions probablement pas eu les moyens d’agir — néanmoins, je ne commettrai plus cette erreur. Je suis ravi d’avoir investi dans OpenAI, et heureux de les avoir aidés à s’agrandir — je considère cela comme une obligation. Lorsque nous avons acquis cette capacité, et qu’Anthropic est venue nous voir, j’ai été ravi de devenir investisseur, et heureux de les aider à s’agrandir. Simplement, nous n’avions pas pu le faire auparavant. Si je pouvais revenir en arrière, et si NVIDIA avait eu alors l’envergure qu’elle a aujourd’hui, j’aurais volontiers agi ainsi.

Pourquoi NVIDIA ne devient-elle pas directement un fournisseur de services cloud à très grande échelle ?

Animateur Dwarkesh : Pendant des années, NVIDIA a été l’entreprise qui gagnait de l’argent dans le domaine de l’IA — beaucoup, beaucoup d’argent. Aujourd’hui, vous commencez à investir : vous auriez investi 30 milliards de dollars dans OpenAI, et 10 milliards dans Anthropic, selon les rapports. Leur valorisation a fortement augmenté, et continuera probablement de grimper. Depuis des années, vous leur fournissez de la puissance de calcul, vous voyez la direction prise, et leur valeur était il y a un an seulement le dixième de ce qu’elle est aujourd’hui — et vous disposiez déjà alors d’importantes liquidités.

Une hypothèse consiste à dire que NVIDIA aurait pu soit créer son propre laboratoire de modèles fondamentaux, soit effectuer ces investissements à une valorisation bien plus basse. Vous avez les liquidités nécessaires — pourquoi ne pas l’avoir fait plus tôt ?

Jensen Huang :

Nous l’avons fait dès que cela nous a été possible. Si j’avais pu le faire plus tôt, je l’aurais fait. Au moment où Anthropic en avait besoin, nous n’avions tout simplement pas les moyens, ni la conscience ni le mode de pensée requis.

Il s’agit d’un problème d’échelle d’investissement. À l’époque, nous n’avions jamais réalisé d’investissements externes, et encore moins d’un montant aussi élevé. Nous ne percevions pas la nécessité de le faire. J’imaginais qu’ils pourraient, comme toutes les entreprises, chercher du financement auprès de fonds de capital-risque. Mais ce qu’ils voulaient accomplir était impossible à réaliser via des fonds de capital-risque. Ce qu’OpenAI voulait faire était également impossible via des fonds de capital-risque. C’est précisément cela qui les rendait brillants, et intelligents — ils avaient compris très tôt qu’ils devaient emprunter une voie différente. Je suis ravi qu’ils l’aient fait. Même si, en raison de notre absence, Anthropic a dû se tourner vers d’autres, je suis heureux que cela se soit produit. L’existence d’Anthropic est une bonne chose pour le monde, et j’en suis heureux.

Animateur Dwarkesh : Vous continuez à engranger d’énormes profits, et vos bénéfices trimestriels augmentent encore. La question est désormais : que devrait faire NVIDIA de cet argent ? Une réponse possible est qu’il existe aujourd’hui tout un écosystème de sociétés intermédiaires qui transforment des dépenses en capital (CapEx) en dépenses d’exploitation (OpEx), en louant de la puissance de calcul à ces laboratoires — car les puces sont coûteuses, mais à mesure que les modèles IA s’améliorent, la valeur qu’ils génèrent au cours de leur cycle de vie augmente considérablement. NVIDIA dispose des liquidités nécessaires pour réaliser des CapEx, et vous auriez, selon les rapports, garanti jusqu’à 6,3 milliards de dollars pour CoreWeave et investi 2 milliards. Pourquoi NVIDIA ne devient-elle pas elle-même un fournisseur de services cloud, un hyperscaler, en louant cette puissance de calcul ? Vous disposez des liquidités nécessaires.

Jensen Huang :

C’est une question de philosophie d’entreprise, et je la considère comme sage. Nous devons faire autant que possible les choses nécessaires, et aussi peu que possible celles qui ne le sont pas. Cela signifie : tout ce que nous construisons sur notre plateforme de calcul, si nous ne le faisions pas, personne d’autre ne le ferait vraiment. Si nous n’assumions pas les risques que nous assumons — si nous n’avions pas conçu NVLink à notre façon, si nous n’avions pas construit toute la pile technologique, si nous n’avions pas cultivé l’écosystème à notre façon, si nous n’avions pas concentré nos efforts sur CUDA pendant 20 ans — souvent à perte — personne d’autre ne l’aurait fait. Si nous n’avions pas créé toutes ces bibliothèques spécialisées CUDA-X, qu’il s’agisse de traçage de rayons, de génération d’images, ou des premiers travaux en IA, de traitement de données, de données structurées ou vectorielles, personne d’autre ne l’aurait fait. Par exemple, nous avons créé cuLitho pour la lithographie computationnelle — personne d’autre ne l’aurait fait.

Ainsi, le calcul accéléré ne se serait pas développé tel qu’il l’est aujourd’hui, sans notre intervention. Nous devons donc le faire. Nous devons y consacrer toutes nos forces, en concentrant tous nos efforts sur cette mission. Mais les services cloud ne manquent pas dans le monde — s’il ne s’agissait pas de nous, quelqu’un d’autre le ferait. Selon la philosophie « faire autant que possible les choses nécessaires, aussi peu que possible les choses inutiles », si nous n’avions pas soutenu l’existence de CoreWeave, ces nouveaux fournisseurs de services IA n’auraient pas vu le jour. Sans notre aide à CoreWeave, ils n’existeraient pas. Sans notre soutien à Nscale, ils n’existeraient pas aujourd’hui. Sans notre soutien à Nebius, ils n’existeraient pas aujourd’hui. Aujourd’hui, ils se portent tous très bien. Est-ce là une stratégie commerciale ? — Nous devons faire autant que possible les choses nécessaires, aussi peu que possible les choses inutiles. Nous investissons donc dans l’écosystème, car je souhaite qu’il prospère. Je souhaite que cette architecture et l’IA puissent se connecter à autant de secteurs et de pays que possible, permettant au monde entier de se construire sur l’IA, et sur la pile technologique américaine — c’est la vision que nous poursuivons.

Lors de sa création, NVIDIA comptait parmi 60 entreprises de graphismes 3D — et nous étions la moins susceptible de survivre. L’architecture graphique de NVIDIA à l’époque était précisément erronée — pas légèrement, mais diamétralement opposée, et les développeurs ne pouvaient tout simplement pas la soutenir. Partant de bonnes premières lois, nous en avons déduit une réponse erronée, et n’importe qui nous aurait éliminés. Mais nous sommes ici aujourd’hui, donc j’ai suffisamment d’humilité pour reconnaître ceci : ne pariez pas sur les gagnants. Soit laissez-les s’affronter seuls, soit donnez à tous une chance.

Animateur Dwarkesh : Mais vous venez de citer une série de nouveaux fournisseurs de services cloud qui n’existeraient pas sans NVIDIA — comment cela est-il compatible avec « ne pas parier sur les gagnants » ?

Jensen Huang :

Tout d’abord, ils doivent venir nous demander de l’aide. Lorsqu’ils veulent exister, qu’ils disposent d’un plan commercial, de compétences professionnelles et de passion — bien entendu, ils doivent aussi avoir une certaine force intrinsèque. Mais s’ils ont besoin, au final, d’un investissement pour démarrer, nous serons là pour les soutenir. Une fois que leur dynamique circulaire est lancée, nous espérons qu’ils deviendront rapidement autonomes. Votre question est « voulons-nous faire du financement ? » — la réponse est non. Il existe des entreprises spécialisées dans le financement, et nous préférons collaborer avec tous ces financeurs, plutôt que de devenir nous-mêmes des financeurs. Notre objectif est de nous concentrer sur ce que nous faisons, de garder notre modèle commercial aussi simple que possible, et de soutenir notre écosystème. Lorsqu’une entreprise comme OpenAI a besoin, avant son introduction en bourse, d’un investissement de 30 milliards de dollars, et que nous sommes convaincus qu’elle deviendra une entreprise remarquable — elle l’est déjà aujourd’hui, elle sera incroyable demain, le monde a besoin qu’elle existe, le monde veut qu’elle existe, je veux qu’elle existe, et son vent souffle fort — nous la soutenons, nous la faisons grandir. Nous ferons ce genre d’investissements, car ils ont besoin que nous les fassions. Mais nous ne voulons pas faire autant que possible — nous voulons faire aussi peu que possible.

Animateur Dwarkesh : Le sujet de l’allocation des GPU — nous vivons depuis longtemps dans une situation de pénurie. NVIDIA allouerait, dit-on, sa capacité rare selon des critères autres que la simple enchère — garantissant par exemple que de nouveaux fournisseurs de services cloud comme CoreWeave, Crusoe ou Lambda obtiennent une part. Pourquoi cela profite-t-il à NVIDIA ? Premièrement, reconnaissez-vous cette description de « partage de parts de marché » ?

Jensen Huang :

Non, votre présupposé est erroné — nous réfléchissons très soigneusement à ces questions. Tout d’abord, sans bon de commande (PO), aucune parole ne compte. Avant d’avoir un PO, que pouvons-nous faire ? La première chose que nous faisons, c’est travailler très dur avec tout le monde pour établir des prévisions, car ces équipements prennent beaucoup de temps à construire, tout comme les centres de données. Nous coordonnons l’offre et la demande via ces prévisions — c’est la priorité absolue. Ensuite, nous essayons de faire ces prévisions avec le plus grand nombre possible de parties, mais à la fin, il faut passer une commande.

Peut-être, pour une raison quelconque, que vous n’avez pas passé votre commande à temps — que pouvez-vous faire ? Le principe est « premier arrivé, premier servi ». Si vous n’êtes pas prêt — si votre centre de données n’est pas prêt, ou si certains composants ne sont pas encore disponibles pour le mettre en service — nous pouvons décider de servir un autre client, simplement pour maximiser l’efficacité de production de nos usines, et procéder à des ajustements de ce type. En dehors de cela, le principe de priorité est « premier arrivé, premier servi », et seul un PO valide compte. Les histoires sur

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News