Delphi Digital : Un aperçu des perspectives d'avenir de DeAI

TechFlow SélectionTechFlow Sélection

Delphi Digital : Un aperçu des perspectives d'avenir de DeAI

La vision finale de DeAI, un calcul véritablement composable, pourrait finalement justifier l'existence même de la blockchain.

Rédaction : PonderingDurian, chercheur chez Delphi Digital

Traduction : Pzai, Foresight News

Étant donné que les cryptomonnaies sont essentiellement des logiciels open source dotés d'incitations économiques intégrées, et que l'IA bouleverse radicalement la manière dont les logiciels sont développés, l'IA exercera un impact majeur sur l'ensemble du secteur blockchain.

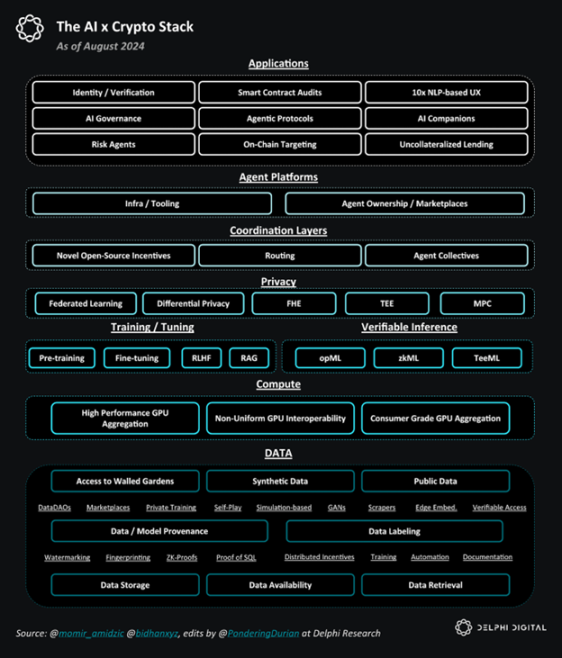

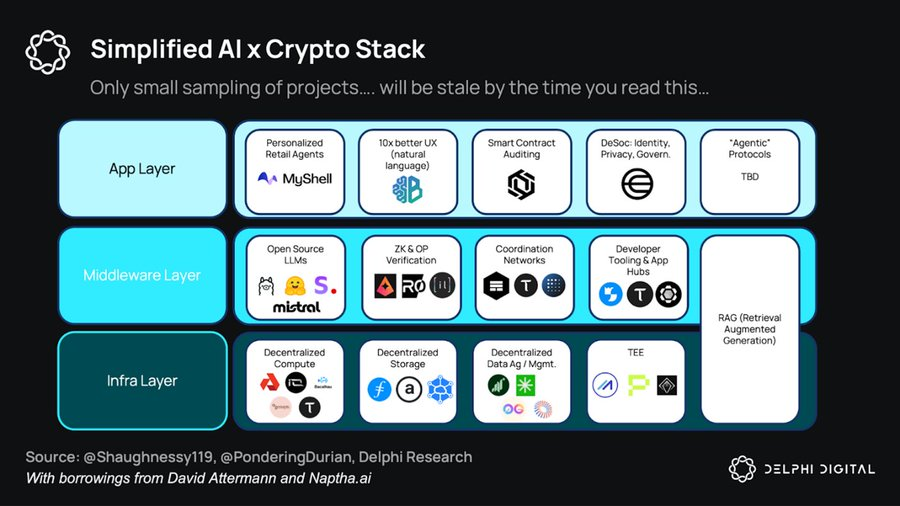

Pile technologique globale AI x Crypto

DeAI : Opportunités et défis

À mon avis, le plus grand défi auquel DeAI fait face réside au niveau de la couche infrastructurelle, car la construction de modèles fondamentaux exige d'importants investissements, tandis que les rendements d'échelle liés aux données et au calcul sont très élevés.

Compte tenu des lois d'échelle, les géants technologiques bénéficient d'un avantage naturel : à l’ère Web2, ils ont accumulé de substantiels profits issus du monopole sur la demande des consommateurs, qu'ils ont réinvestis durant une décennie à bas prix dans leurs infrastructures cloud. Aujourd'hui, ces géants tentent de dominer le marché de l'IA en s'appropriant ses éléments clés — données et puissance de calcul :

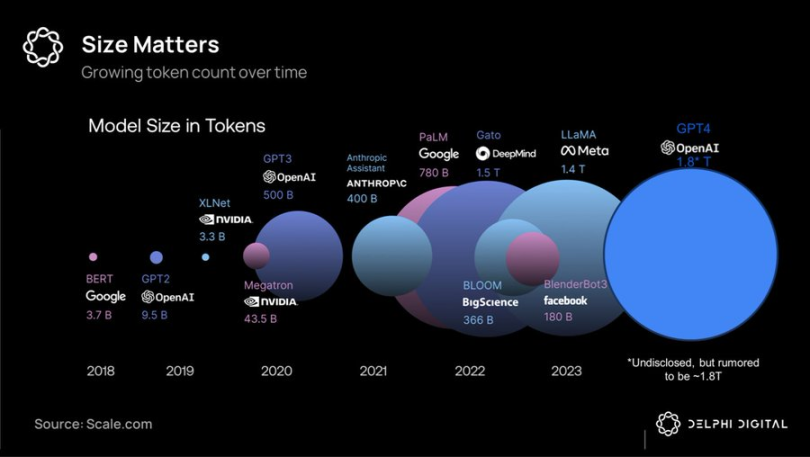

Comparaison des tailles de jetons des grands modèles

En raison de l'intensité capitalistique de l'entraînement à grande échelle et des exigences élevées en bande passante, les super-grappes centralisées restent la solution optimale — fournissant aux géants technologiques des modèles fermés hautement performants qu'ils prévoient de louer avec des marges monopolistiques, puis de réinvestir les revenus générés dans chaque nouvelle génération de produits.

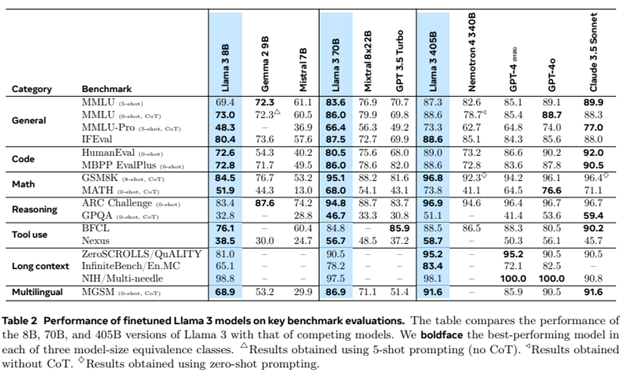

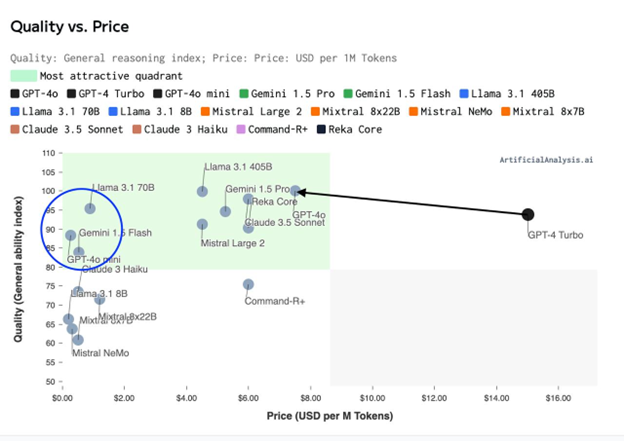

Cependant, il s'avère que les fossés protecteurs dans le domaine de l'IA sont plus étroits que les effets de réseau Web2 : les modèles de pointe perdent rapidement leur avantage concurrentiel par rapport au reste du secteur, notamment depuis que Meta a adopté une « politique de terre brûlée », investissant des dizaines de milliards de dollars dans le développement de modèles ouverts comme Llama 3.1, dont les performances atteignent désormais des niveaux SOTA (State-of-the-Art).

Note des grands modèles Llama 3

À ce stade, combiné à l'émergence de recherches sur des méthodes d'entraînement distribué à faible latence, cela pourrait conduire à la marchandisation (partielle) de certains modèles commerciaux dominants — au fur et à mesure que le coût de l'intelligence baisse, la concurrence devrait se déplacer (au moins partiellement) du matériel (super-grappes), qui favorise les géants technologiques, vers l'innovation logicielle, qui bénéficie légèrement à l'open source / aux cryptomonnaies.

Répartition capacité (qualité) - prix d'entraînement

Compte tenu de l'efficacité computationnelle des architectures « Mixture of Experts » et de la composition / routage des grands modèles, nous risquons fort de ne pas vivre dans un monde limité à 3-5 géants modèles, mais plutôt dans un univers composé de millions de modèles aux compromis coûts/performance variés — un réseau imbriqué d'intelligences (une ruche).

Cela pose un problème massif de coordination : les mécanismes d'incitation offerts par la blockchain et les cryptomonnaies pourraient jouer ici un rôle crucial.

Principaux domaines d'investissement DeAI

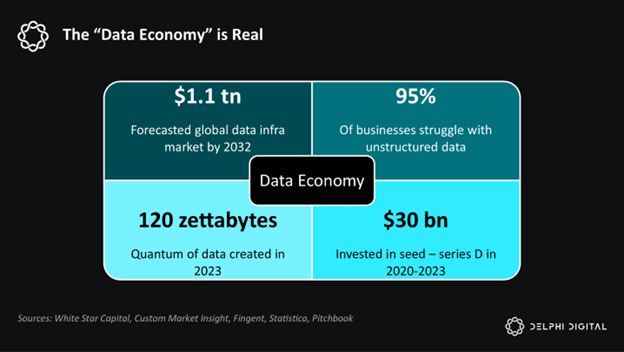

Le logiciel dévore le monde. L'IA dévore le logiciel. Et l'IA, c'est fondamentalement des données et du calcul.

Delphi est positif sur les différents composants de cette pile :

Pile simplifiée AI x Crypto

Infrastructure

Étant donné que l'IA repose sur les données et le calcul, l'infrastructure DeAI vise à approvisionner ces deux ressources de manière aussi efficace que possible, utilisant souvent des incitations cryptographiques. Comme mentionné précédemment, c'est la partie la plus difficile de la compétition, mais aussi celle qui pourrait offrir les retours les plus élevés compte tenu de l'ampleur du marché final.

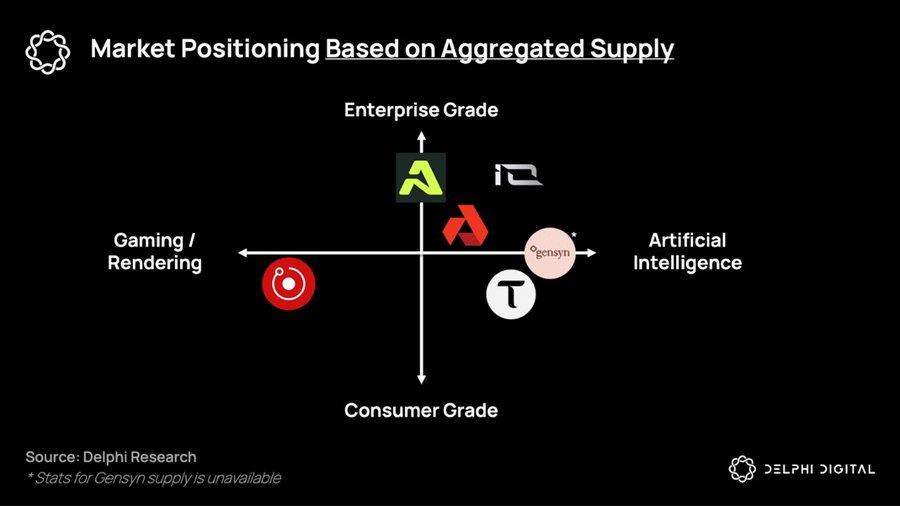

Calcul

Jusqu'à présent, les protocoles d'entraînement distribué et les marchés de GPU ont été freinés par la latence, mais leur objectif est de coordonner un matériel potentiellement hétérogène afin d'offrir des services de calcul à la demande, moins coûteux, destinés à ceux exclus par les solutions intégrées des géants. Des entreprises comme Gensyn, Prime Intellect et Neuromesh poussent sur l'entraînement distribué, tandis qu'io.net, Akash et Aethir permettent une inférence peu coûteuse, proche de l'intelligence périphérique.

Répartition des niches des projets basés sur l'agrégation de l'offre

Données

Dans un monde d'intelligence omniprésente basé sur des modèles plus petits et plus spécialisés, la valeur et la monétisation des actifs de données augmentent fortement.

Jusqu'ici, DePIN a surtout été salué pour sa capacité à construire des réseaux matériels moins coûteux comparés aux entreprises intensives en capital comme les opérateurs télécoms. Toutefois, son plus grand potentiel de marché résidera probablement dans la collecte de nouveaux types de jeux de données destinés à alimenter les systèmes intelligents sur chaîne : les protocoles agents (discutés plus loin).

Dans ce monde, le plus grand marché potentiel — la main-d'œuvre — est progressivement remplacé par les données et le calcul. Ici, l'infrastructure DeAI offre aux non-spécialistes un moyen de s'approprier les moyens de production et de contribuer à l'économie numérique émergente.

Middlewares

L'objectif ultime de DeAI est d'atteindre une computation efficacement composable. À l'image des Lego financiers de la DeFi, DeAI compense la performance absolue actuelle insuffisante grâce à la composable sans permission, stimulant ainsi un écosystème ouvert de logiciels et de primitives computationnelles qui capitalisent progressivement — espérant ainsi surpasser les solutions existantes.

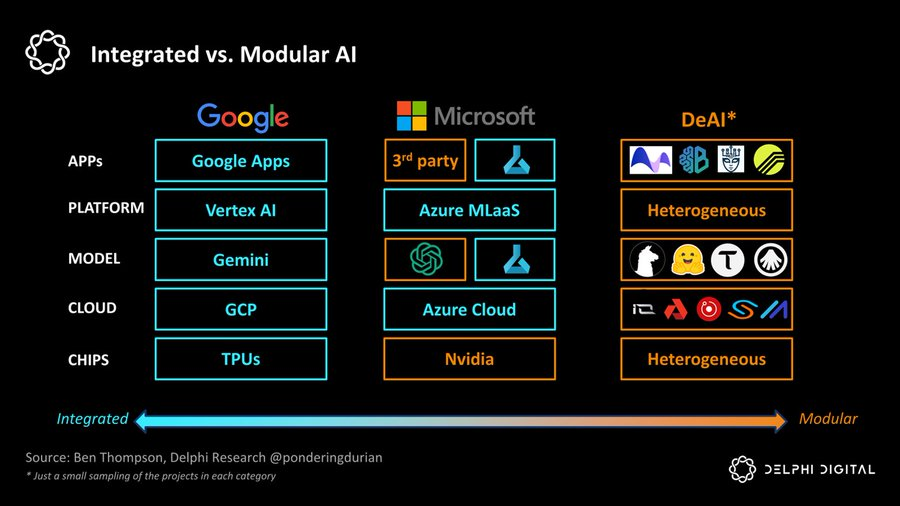

Si Google représente l'extrême de l’intégration, alors DeAI incarne l'extrême de la modularité. Comme Clayton Christensen le rappelle, dans les industries naissantes, les approches intégrées prennent souvent l'avantage en réduisant les frictions dans la chaîne de valeur, mais à mesure que le secteur mûrit, les chaînes modulaires s'imposent grâce à une concurrence accrue et à une meilleure efficacité des coûts entre les couches de la pile :

IA intégrée vs IA modulaire

Nous sommes particulièrement positifs sur plusieurs catégories cruciales pour réaliser cette vision modulaire :

Routage

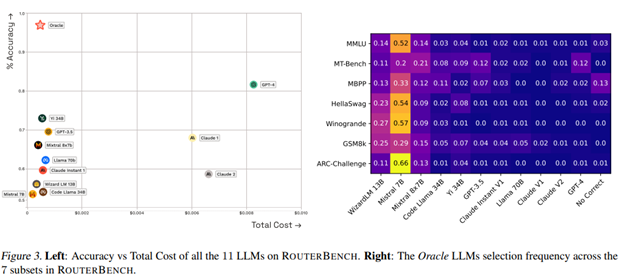

Dans un monde où l'intelligence est fragmentée, comment choisir le bon modèle au meilleur prix et au bon moment ? Les agrégateurs côté demande captent traditionnellement la valeur (voir la théorie de l'aggrégation), et les fonctions de routage sont essentielles pour optimiser la courbe de Pareto entre performance et coût dans un monde d'intelligence réseau :

Bittensor a longtemps dominé la première génération, mais de nombreux concurrents spécialisés apparaissent.

Allora organise des compétitions entre différents modèles selon divers « thèmes », de façon « contextuellement sensible » et auto-améliorante au fil du temps, alimentant les prévisions futures à partir de l’exactitude historique sous conditions spécifiques.

Morpheus vise à devenir le « routeur côté demande » pour les cas d'usage Web3 — une sorte d’« Apple Intelligence » open source locale, capable de comprendre le contexte utilisateur et de router efficacement les requêtes via les nouvelles briques d’infrastructure de « calcul composable » DeFi ou Web3.

Les protocoles d'interopérabilité des agents, comme Theoriq et Autonolas, poussent encore plus loin la modularité, permettant un écosystème composable et composite d'agents ou composants flexibles, transformés en services complets sur chaîne.

En résumé, dans un monde d'intelligence rapidement fragmentée, les agrégateurs côté offre et demande exerceront une influence extrêmement forte. Si Google est une entreprise valorisée 2 billions de dollars pour indexer l'information mondiale, alors le gagnant du routage côté demande — qu'il s'agisse d'Apple, Google ou d'une solution Web3 — qui indexe l'intelligence des agents, pourrait atteindre une échelle encore supérieure.

Co-processeurs

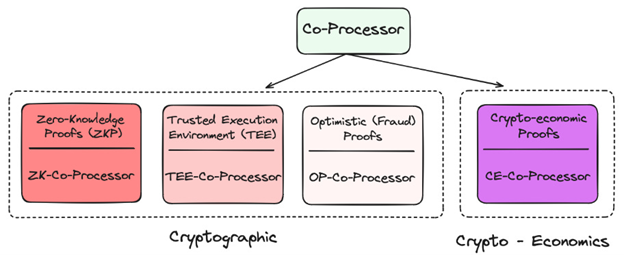

En raison de leur nature décentralisée, les blockchains sont fortement limitées en termes de données et de calcul. Comment intégrer des applications blockchain nécessitant une IA intensive en calcul et en données ? Grâce aux co-processeurs !

Application des co-processeurs dans la couche applicative Crypto

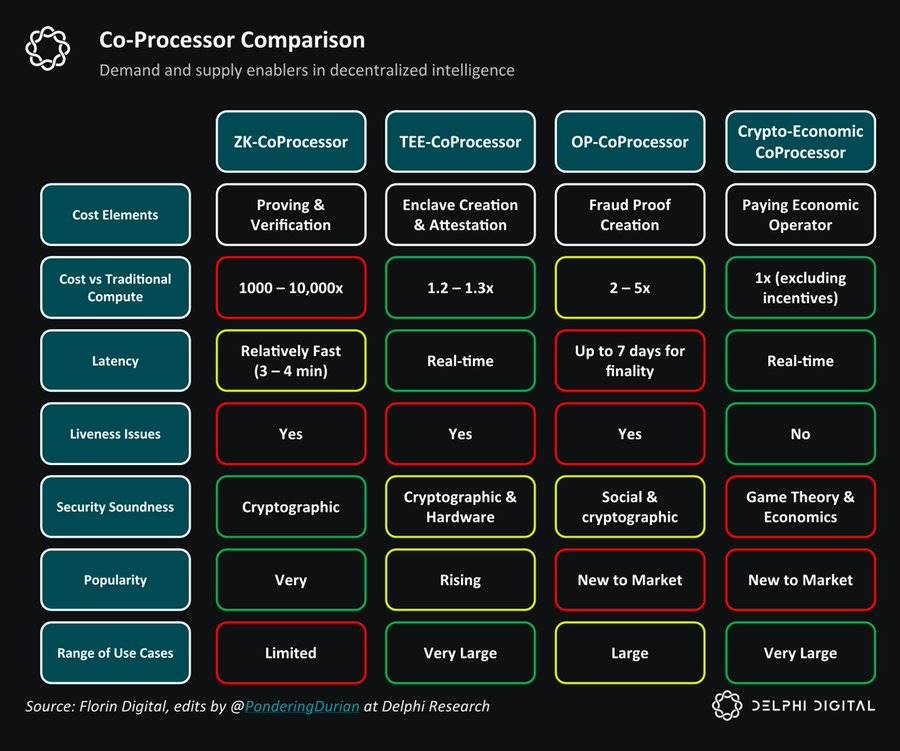

Ils fonctionnent tous comme des oracles proposant différentes méthodes pour « vérifier » la validité des données ou modèles de base utilisés, minimisant ainsi les nouvelles hypothèses de confiance hors chaîne tout en augmentant considérablement leurs capacités. Plusieurs projets ont déjà exploré zkML, opML, TeeML et des approches crypto-économiques, chacune ayant ses forces et faiblesses :

Comparaison des co-processeurs

À un niveau supérieur, les co-processeurs sont essentiels à l’intelligence des contrats intelligents — offrant des solutions similaires à des « entrepôts de données » permettant des requêtes personnalisées pour des expériences sur chaîne plus individualisées, ou validant qu’un raisonnement donné a bien été exécuté correctement.

Les réseaux TEE (exécution fiable), comme Super, Phala et Marlin, gagnent en popularité récemment grâce à leur praticité et à leur capacité à supporter des applications à grande échelle.

Dans l'ensemble, les co-processeurs sont cruciaux pour combiner les blockchains à haute déterminisme mais faible performance avec des agents intelligents à haute performance mais probabilistes. Sans eux, l'IA n'existerait pas sur les blockchains actuelles.

Incitations aux développeurs

L'un des principaux problèmes du développement open source en IA est le manque d'incitations capables d'en assurer la durabilité. Le développement IA est hautement intensif en capital, et le coût d'opportunité du calcul et du travail intellectuel en IA est très élevé. En l'absence d'incitations appropriées pour récompenser les contributions open source, ce domaine sera inévitablement dominé par les supercalculateurs ultra-capitalistes.

Des projets comme Sentiment, Pluralis, Sahara AI et Mira visent à créer des réseaux permettant à des individus dispersés de contribuer à l'intelligence collective tout en étant justement rémunérés.

En comblant ce déficit de modèle économique, la croissance exponentielle de l'open source devrait s'accélérer — offrant aux développeurs et chercheurs en IA une alternative mondiale aux grandes entreprises technologiques, avec la possibilité d'être grassement récompensés selon la valeur créée.

Si cela reste extrêmement difficile et que la concurrence s'intensifie, le marché potentiel ici est énorme.

Modèles GNN

Alors que les grands modèles linguistiques analysent des motifs dans de vastes bibliothèques textuelles et apprennent à prédire le mot suivant, les réseaux neuronaux graphiques (GNN) traitent, analysent et apprennent à partir de données structurées en graphe. Étant donné que les données sur chaîne consistent principalement en des interactions complexes entre utilisateurs et contrats intelligents — autrement dit, un graphe — les GNN apparaissent comme un choix naturel pour soutenir les cas d'usage IA sur chaîne.

Des projets comme Pond et RPS tentent de construire des modèles fondamentaux pour le web3, applicables aux transactions, à la DeFi ou même aux usages sociaux, tels que :

-

Prévision des prix : modélisation du comportement sur chaîne pour prédire les prix, élaborer des stratégies automatiques de trading, analyse des sentiments

-

Finance IA : intégration avec les applications DeFi existantes, stratégies avancées de rendement et d'utilisation de liquidités, meilleure gestion des risques / gouvernance

-

Marketing sur chaîne : airdrops / ciblage plus précis, moteurs de recommandation basés sur le comportement on-chain

Ces modèles utiliseront largement des solutions d'entrepôt de données comme Space and Time, Subsquid, Covalent et Hyperline, que je suis également très favorable.

Les GNN pourraient s'avérer être des outils complémentaires indispensables aux grands modèles blockchain et aux entrepôts de données Web3, fournissant ainsi une fonction OLAP (traitement analytique en ligne) au Web3.

Applications

À mon sens, les agents sur chaîne pourraient être la clé pour résoudre le problème bien connu de l'expérience utilisateur en cryptomonnaie. Mais surtout, pendant la dernière décennie, nous avons injecté des milliards de dollars dans les infrastructures Web3, mais l'utilisation côté demande reste dérisoire.

Pas de panique, les agents arrivent…

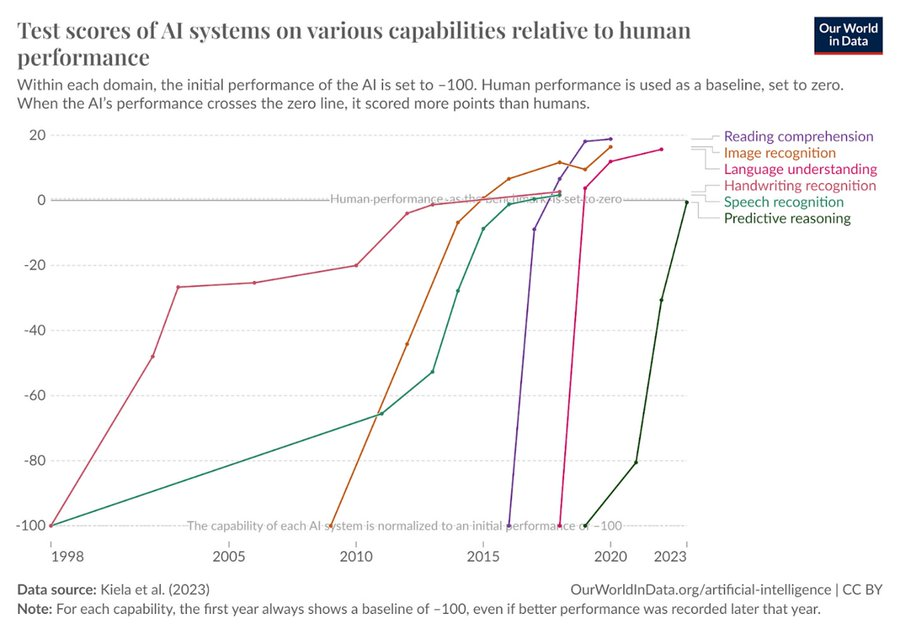

Progression des scores des tests d'IA sur divers aspects du comportement humain

Ces agents exploitent une infrastructure ouverte et sans permission — combinant paiements et calcul composable pour atteindre des objectifs finaux plus complexes, ce qui semble logique. Dans l'économie intelligente et interconnectée à venir, le flux économique pourrait ne plus être B → B → C, mais plutôt utilisateur → agent → réseau de calcul → agent → utilisateur. Ce flux aboutit aux protocoles agents. Les applications ou entreprises de services auraient des frais limités, utilisant principalement des ressources sur chaîne, satisfaisant les besoins des utilisateurs finals (ou entre eux) à un coût bien inférieur aux entreprises traditionnelles. Comme la couche application Web2 a capté la majorité de la valeur, je suis partisan de la théorie du « protocole agent gras » dans DeAI. Avec le temps, la capture de valeur devrait migrer vers les couches supérieures de la pile.

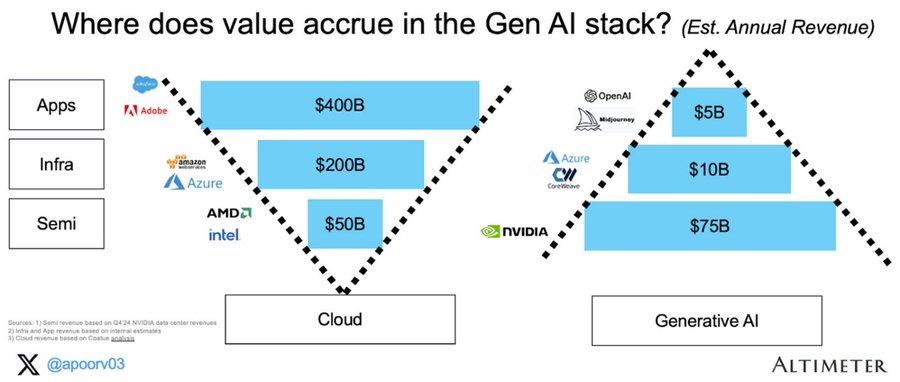

Accumulation de valeur dans l'IA générative

Le prochain Google, Facebook ou Blackrock sera probablement un protocole agent, et les composants permettant de réaliser cela sont en train d'émerger.

La fin ultime de DeAI

L'IA transformera notre forme économique. Aujourd'hui, les marchés anticipent que cette capture de valeur restera concentrée entre quelques grandes entreprises de la côte ouest américaine. DeAI incarne une vision différente : celle d'un réseau intelligent ouvert et composable, récompensant même les plus petites contributions, avec une propriété et une gouvernance plus collectives.

Même si certaines promesses de DeAI sont exagérées, et que de nombreux projets sont valorisés bien au-dessus de leurs réalisations actuelles, l'ampleur de l'opportunité est indéniable. Pour ceux qui ont patience et vision, la vision finale d'une computation véritablement composable de DeAI pourrait justifier à elle seule l'existence même de la blockchain.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News