De l'IA vérifiable à l'IA composable : réflexions sur les cas d'utilisation du ZKML

TechFlow SélectionTechFlow Sélection

De l'IA vérifiable à l'IA composable : réflexions sur les cas d'utilisation du ZKML

Les applications d'IA ne peuvent pas effectuer l'intégralité du calcul sur la chaîne, donc elles utilisent des preuves zk ou des preuves optimistes pour connecter les services d'IA au système de la blockchain publique de manière plus décentralisée et fiable.

Rédaction : Turbo Guo

Relecture : Mandy, Joshua

TLDR :

Modulus Labs a mis en œuvre une IA vérifiable en exécutant des calculs d'apprentissage automatique (ML) hors chaîne et en générant des preuves à connaissance nulle (zkp) associées. Cet article réexamine cette solution du point de vue applicatif, analyse les cas où elle répond à un besoin essentiel et ceux où la demande est plus faible, puis explore deux modèles possibles d'écosystèmes IA basés sur les blockchains publiques. Les points principaux sont les suivants :

-

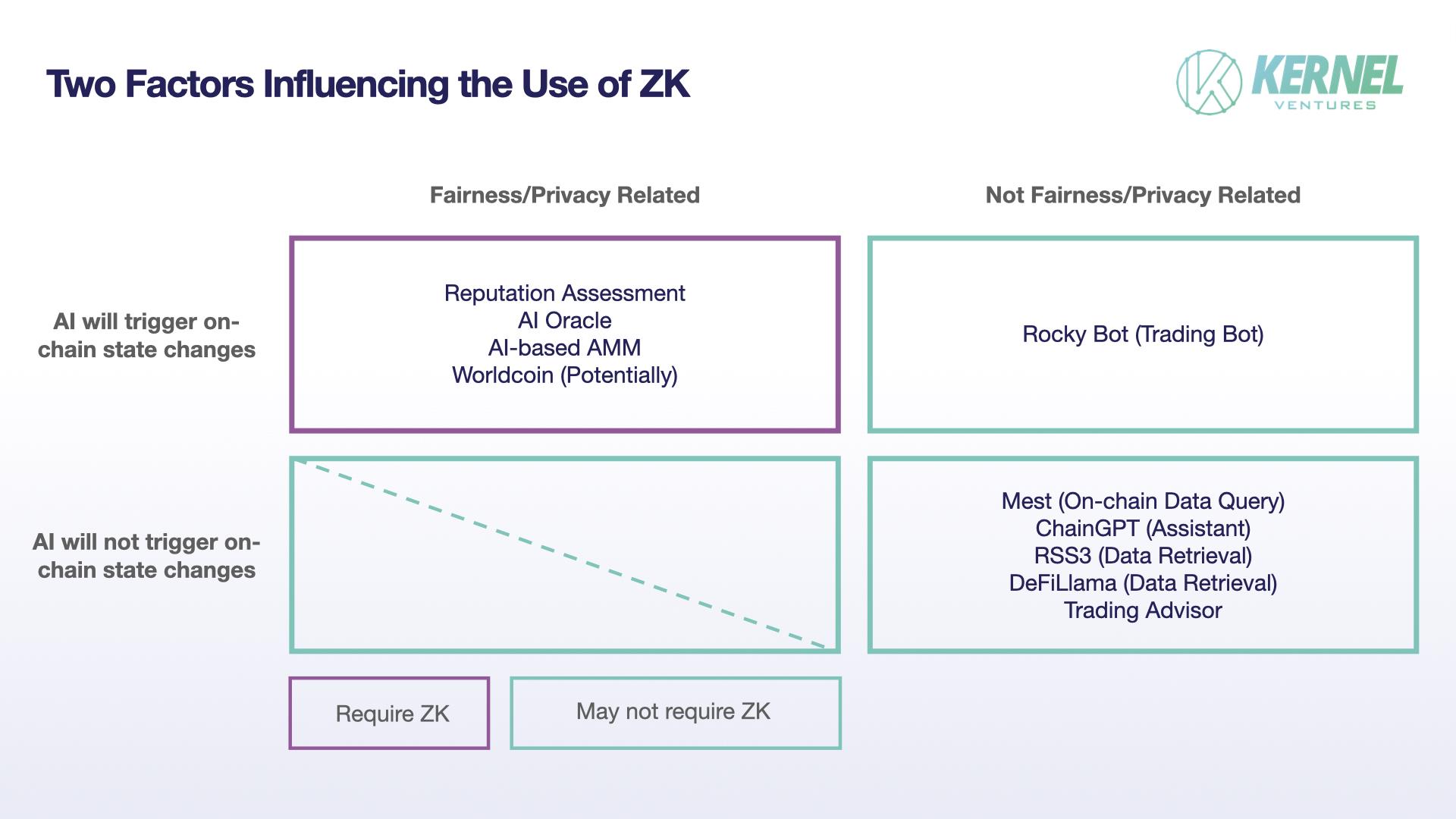

Le besoin d'une IA vérifiable dépend de deux critères : la modification ou non des données sur chaîne, ainsi que les questions d'équité et de confidentialité.

-

Lorsque l'IA n'affecte pas l'état sur chaîne, elle peut jouer le rôle de conseiller. Les utilisateurs peuvent évaluer la qualité du service selon ses résultats concrets, sans avoir besoin de vérifier le processus de calcul.

-

Lorsque l'IA modifie l'état sur chaîne mais que le service concerne uniquement un individu sans impact sur la vie privée, l'utilisateur peut encore juger directement de la qualité du service sans vérification du calcul.

-

Quand la sortie de l'IA affecte l'équité entre plusieurs personnes ou touche à la vie privée — par exemple attribuer des récompenses aux membres d'une communauté via une IA, optimiser un AMM avec une IA, ou traiter des données biologiques — les utilisateurs souhaitent alors pouvoir auditer les calculs de l'IA. Ce sont ces cas d'usage où l'IA vérifiable pourrait trouver son PMF (Product-Market Fit).

-

Écosystème vertical d'applications IA : Étant donné qu'une extrémité de l'IA vérifiable est un contrat intelligent, il devient envisageable que différentes applications d'IA, voire entre IA et dapps natives, s'appellent mutuellement sans confiance. Cela ouvre la voie vers un écosystème d'applications IA potentiellement composable.

-

Écosystème horizontal d'applications IA : Le système blockchain peut gérer pour les fournisseurs de services IA les paiements, la résolution des litiges, ainsi que la mise en relation entre besoins utilisateurs et offres de services, offrant ainsi aux utilisateurs une expérience de service IA décentralisé avec une liberté accrue.

1. Présentation de Modulus Labs et cas d’application

1.1 Présentation et solution clé

Modulus Labs est une entreprise spécialisée dans l'« IA sur chaîne ». Elle considère que l'IA peut considérablement renforcer les capacités des contrats intelligents, rendant les applications web3 plus puissantes. Toutefois, une contradiction existe lorsque l'on applique l'IA au web3 : l'exécution de l'IA nécessite une grande puissance de calcul, mais effectuer ces calculs hors chaîne en fait une « boîte noire », ce qui va à l'encontre des principes fondamentaux du web3 tels que la non-confiance et la vérifiabilité.

C'est pourquoi Modulus Labs s'inspire de l'architecture des zk rollups (prétraitement hors chaîne + validation sur chaîne) pour proposer une architecture d'IA vérifiable : le modèle ML s'exécute hors chaîne, et simultanément, une preuve zkp est générée pour attester du processus de calcul. Cette preuve permet de vérifier l'architecture du modèle, ses poids et ses entrées (inputs). La preuve zkp peut également être publiée sur chaîne et validée par un contrat intelligent. Ainsi, l'IA et le contrat sur chaîne peuvent interagir de manière plus fiable, réalisant ainsi une « IA sur chaîne ».

S'appuyant sur ce concept d'IA vérifiable, Modulus Labs a lancé à ce jour trois applications d'« IA sur chaîne », tout en proposant de nombreux autres cas d'usage potentiels.

1.2 Cas d’application

-

Le premier produit lancé est Rocky Bot, un robot de trading automatisé. Entraîné sur les données historiques du couple wETH/USDC, Rocky analyse l'historique pour prédire l'évolution future du wETH, prend une décision de trading, génère une preuve zkp de ce processus de calcul, puis envoie un message à la L1 pour déclencher l'opération.

-

Le second est un jeu d'échecs sur chaîne intitulé « Leela vs the World ». L'affrontement oppose une IA à des joueurs humains. L'état du jeu est stocké dans un contrat. Les joueurs interagissent via leur portefeuille (avec le contrat). L'IA lit la nouvelle position, décide de son coup, et génère une preuve zkp du calcul complet — ces deux étapes se déroulant sur le cloud AWS. La preuve zkp est ensuite envoyée au contrat sur chaîne pour validation ; une fois validée, le contrat joue le coup de l'IA.

-

Le troisième est un artiste IA « sur chaîne », ayant lancé la série NFT zkMon. L'IA génère un NFT et le publie sur chaîne, tout en produisant une preuve zkp. Les utilisateurs peuvent utiliser cette preuve pour vérifier que leur NFT a bien été généré par le modèle IA correspondant.

En outre, Modulus Labs mentionne plusieurs autres cas d’usage :

-

Utiliser une IA pour évaluer les données chaines d’un utilisateur et lui attribuer un score de réputation, accompagné d’une preuve zkp que l’utilisateur peut vérifier ;

-

Optimiser le fonctionnement d’un AMM grâce à une IA, et publier une preuve zkp pour que les utilisateurs puissent vérifier ;

-

Utiliser une IA vérifiable pour aider des projets de confidentialité à faire face aux régulateurs sans compromettre la vie privée (par exemple, prouver via ML qu’une transaction n’est pas du blanchiment, sans révéler l’adresse de l’utilisateur) ;

-

Oracle IA, publiant une preuve zkp permettant à tous de vérifier la fiabilité des données hors chaîne ;

-

Compétition de modèles IA : les participants soumettent leur architecture et leurs poids, puis exécutent leur modèle sur un input test standard, génèrent une preuve zkp du calcul, et le contrat distribue automatiquement le prix au vainqueur ;

-

Worldcoin prévoit que les utilisateurs pourraient télécharger localement un modèle générant un code à partir de l’iris, exécuter le modèle sur leur appareil et générer une preuve zkp. Le contrat sur chaîne pourrait alors valider via la preuve que le code iris a bien été généré par le bon modèle et à partir d’un iris valide, tout en gardant les données biométriques sur l’appareil de l’utilisateur ;

1.3 Analyse des différents cas d’application selon le besoin d’IA vérifiable

1.3.1 Scénarios où l’IA vérifiable pourrait ne pas être nécessaire

Dans le cas de Rocky Bot, les utilisateurs pourraient ne pas ressentir le besoin de vérifier le calcul ML. Premièrement, ils manquent souvent des compétences techniques nécessaires pour réaliser une véritable vérification. Même s'ils disposent d'outils de vérification, cela se résume à « appuyer sur un bouton, voir une fenêtre pop-up indiquant que le service AI provient bien d'un modèle spécifique », sans garantie réelle de véracité. Deuxièmement, les utilisateurs n'ont pas forcément besoin de vérifier, car leur principal critère est le taux de rendement du bot. S’il est faible, ils migreront vers un autre service, choisissant toujours celui qui donne les meilleurs résultats. En résumé, lorsque les utilisateurs cherchent uniquement l'efficacité finale de l'IA, vérifier le processus de calcul perd de son importance, car il suffit de migrer vers le meilleur service disponible.

Une solution possible serait que l’IA agisse uniquement comme conseiller, l’utilisateur exécutant lui-même les transactions. Après avoir saisi ses objectifs de trading dans l’IA, celle-ci calcule hors chaîne un bon chemin ou direction de transaction, que l’utilisateur choisit d’exécuter ou non. Il n’est alors pas nécessaire de vérifier le modèle sous-jacent : il suffit de choisir le service donnant les meilleurs rendements.

Un autre scénario, risqué mais probable, est que les utilisateurs se moquent complètement du contrôle de leurs actifs et du processus de calcul de l’IA. Dès lors qu’un robot générant automatiquement des profits apparaît, beaucoup seraient prêts à lui confier directement leurs fonds, comme ils le font en déposant des jetons sur un CEX ou dans une banque traditionnelle. Les utilisateurs ne s’intéressent pas aux mécanismes internes, seulement au montant final perçu — voire simplement au montant affiché par le projet. De tels services pourraient rapidement acquérir une large base d'utilisateurs, voire évoluer plus vite que des projets utilisant une IA vérifiable.

Par ailleurs, si l’IA ne modifie jamais l’état sur chaîne, mais se contente d’extraire et prétraiter des données pour les utilisateurs, alors il n’y a pas besoin de générer une preuve ZKP du calcul. Nous appelons ces applications des « services de données ». Voici quelques exemples :

-

La chatbox de Mest est un exemple typique de service de données : l’utilisateur pose des questions sur ses données on-chain, par exemple combien il a dépensé en NFT ;

-

ChainGPT est un assistant IA multifonction : il peut analyser un contrat avant une transaction, vous dire si vous interagissez avec le bon pool, ou s’il y a risque de sandwich attack ou de frontrunning. ChainGPT prévoit aussi des recommandations d’actualité IA, la génération automatique d’images à partir de prompts, et leur publication en NFT ;

-

RSS3 propose AIOP, permettant aux utilisateurs de sélectionner les données on-chain qu’ils veulent, les prétraiter, et ainsi faciliter l’entraînement d’IA sur des données spécifiques ;

-

DefiLlama et RSS3 ont développé des plugins ChatGPT, permettant aux utilisateurs d’obtenir des données on-chain par dialogue ;

1.3.2 Scénarios nécessitant une IA vérifiable

Cet article estime que les cas impliquant plusieurs parties, des questions d’équité ou de confidentialité requièrent une vérification via ZKP. Examinons ici quelques applications mentionnées par Modulus Labs :

-

Lorsqu'une communauté attribue des récompenses basées sur une évaluation de réputation générée par IA, les membres exigeront inévitablement de pouvoir auditer le processus de décision — c’est-à-dire le calcul ML ;

-

Dans l’optimisation d’un AMM par IA, les intérêts de multiples parties sont en jeu, ce qui impose une vérification régulière du calcul ;

-

Pour concilier confidentialité et conformité réglementaire, le ZK est aujourd’hui l’une des meilleures solutions. Si un fournisseur utilise du ML pour traiter des données sensibles, il doit générer une preuve ZKP du processus complet ;

-

Étant donné l’impact étendu des oracles, si une IA les pilote, des preuves ZKP doivent être régulièrement produites pour vérifier son bon fonctionnement ;

-

Dans une compétition, le public et les concurrents doivent pouvoir vérifier que le calcul ML respecte les règles ;

-

Dans l’usage potentiel de Worldcoin, la protection des données biométriques personnelles constitue également un besoin fort ;

En résumé, lorsque l’IA agit comme un décideur dont la sortie a un impact large et implique des questions d’équité entre plusieurs parties, les utilisateurs exigent une vérification du processus décisionnel — ou tout du moins une garantie que ce processus est correct. La protection de la vie privée constitue quant à elle un besoin direct et évident.

Ainsi, deux critères permettent de déterminer la nécessité d’une IA vérifiable : 1) la sortie de l’IA modifie-t-elle l’état sur chaîne ? 2) Affecte-t-elle l’équité ou la vie privée ?

-

Si la sortie de l’IA ne modifie pas l’état sur chaîne, l’IA peut jouer le rôle de conseiller. Les utilisateurs évaluent la qualité du service par ses résultats, sans besoin de vérifier le calcul ;

-

Si la sortie modifie l’état sur chaîne mais concerne un seul utilisateur sans impact sur la vie privée, l’utilisateur peut encore juger directement du service sans vérification ;

-

Lorsque la sortie de l’IA affecte directement l’équité entre plusieurs personnes et modifie automatiquement les données sur chaîne, la communauté et le public exigent alors de pouvoir vérifier le processus décisionnel ;

-

Lorsque les données traitées par ML concernent la vie privée individuelle, le recours au ZK est nécessaire pour protéger cette confidentialité et répondre aux exigences réglementaires.

2. Deux modèles d’écosystèmes IA basés sur les blockchains publiques

Quoi qu’il en soit, la solution de Modulus Labs offre une forte inspiration sur la manière dont l’IA peut s’intégrer au crypto pour créer de la valeur pratique. Mais l’écosystème blockchain ne se limite pas à améliorer un service IA isolé : il a le potentiel de construire un nouvel écosystème d’applications IA. Cet écosystème introduit des relations nouvelles entre services IA, entre IA et utilisateurs, ainsi que des modes de collaboration inédits entre chaque maillon de la chaîne. On peut regrouper ces modèles potentiels en deux catégories : vertical et horizontal.

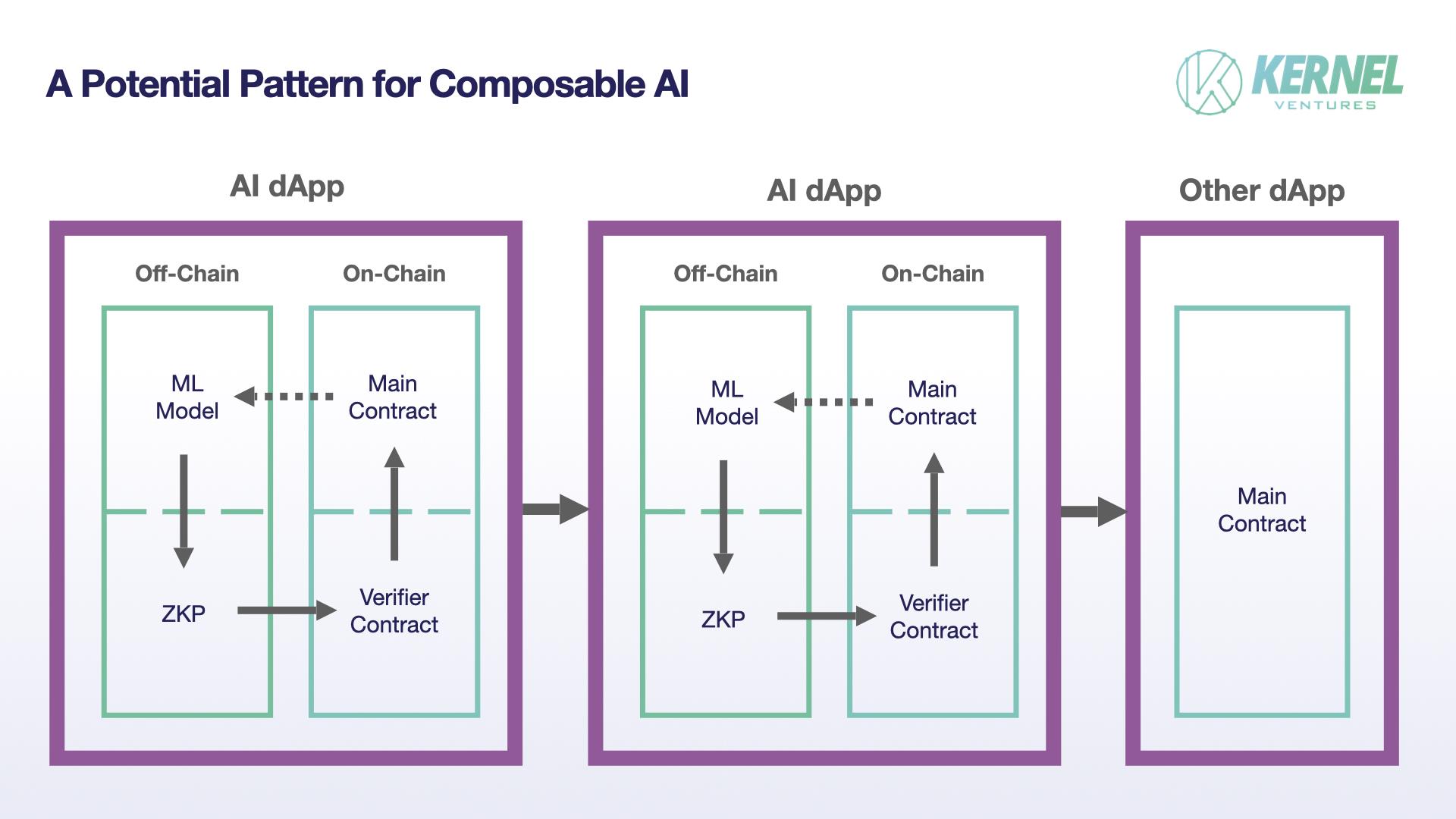

2.1 Modèle vertical : accent sur la composable entre IAs

Le cas « Leela vs the World » présente une particularité : les utilisateurs peuvent parier sur l’humain ou sur l’IA, et les jetons sont distribués automatiquement après la partie. Ici, la preuve zkp ne sert pas seulement à vérifier le calcul de l’IA, mais aussi à garantir la transition d’état sur chaîne. Grâce à cette garantie de confiance, les services IA entre eux, ou entre IA et dapps natives, pourraient atteindre un niveau de composable similaire à celui des dapps.

L’unité de base d’une IA composable est : [modèle ML hors chaîne – génération de zkp – contrat de vérification sur chaîne – contrat principal]. Cette structure s’inspire du cadre de « Leela vs the World », bien que l’architecture réelle d’un dapp IA puisse différer. Premièrement, le jeu d’échecs nécessite un contrat pour l’état du jeu, mais dans d’autres cas, une IA pourrait ne pas en avoir besoin. Pour la composable, toutefois, si le cœur de l’activité est géré par un contrat, cela facilitera les interactions avec d’autres dapps. Deuxièmement, le contrat principal n’a pas forcément à influencer le modèle ML de l’IA : certains dapps IA peuvent être unidirectionnels — une fois le modèle exécuté, il déclenche un contrat lié à son activité, qui peut ensuite être appelé par d’autres dapps.

En élargissant la perspective, l’appel entre contrats représente l’interaction entre différentes applications web3 — échanges d’identité, d’actifs, de services financiers ou d’informations sociales. Imaginons une combinaison concrète d’applications IA :

-

Worldcoin utilise un modèle ML pour générer un code iris à partir des données biométriques, ainsi qu’une preuve zkp ;

-

Une application de notation de réputation vérifie d’abord que ce DID correspond bien à une personne physique (via la preuve du code iris), puis attribue un NFT en fonction de la réputation on-chain ;

-

Un service de prêt ajuste le montant empruntable en fonction du NFT détenu par l’utilisateur ;

Les interactions entre IA dans un cadre blockchain ne sont pas un sujet inédit. Loaf, contributeur de l’écosystème Realms (jeu omnichaîne), a proposé que les PNJ IA puissent commercer entre eux comme les joueurs, permettant au système économique de s’auto-optimiser et de fonctionner automatiquement. AI Arena a développé un jeu d’affrontements automatisés entre IA : l’utilisateur achète d’abord un NFT représentant un robot de combat (associé à un modèle IA), joue lui-même, puis entraîne l’IA sur ses données. Une fois l’IA assez performante, il la lance dans l’arène contre d’autres IA. Modulus Labs note qu’AI Arena souhaite transformer ces IA en IA vérifiables. Ces deux cas illustrent la possibilité pour les IA d’interagir entre elles et de modifier directement l’état sur chaîne.

Toutefois, la mise en œuvre concrète de l’IA composable soulève encore de nombreuses questions, notamment sur la manière dont les différents dapps peuvent exploiter les zkp ou contrats de vérification des uns et des autres. Cependant, le domaine du ZK dispose déjà de nombreux projets prometteurs : RISC Zero, par exemple, progresse dans l’exécution de calculs complexes hors chaîne et la publication de preuves sur chaîne. Un jour, une combinaison efficace pourrait émerger.

2.2 Modèle horizontal : accent sur une plateforme décentralisée de services IA

Sur ce point, nous présentons SAKSHI, une plateforme décentralisée d’IA, proposée par des chercheurs de Princeton, Tsinghua, UIUC, HKUST, Witness Chain et Eigen Layer. Son objectif central est de permettre aux utilisateurs d’accéder aux services IA de façon plus décentralisée, rendant l’ensemble du processus plus fiable et automatisé.

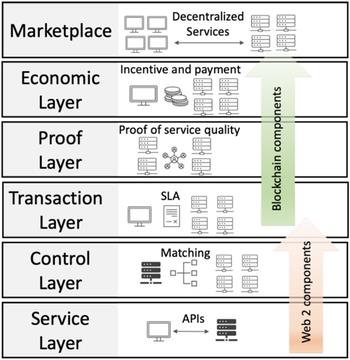

L’architecture de SAKSHI comporte six couches : Service Layer, Control Layer, Transaction Layer, Proof Layer, Economic Layer et Marketplace.

Le marché est la couche la plus proche de l’utilisateur. Des agrégateurs y représentent différents fournisseurs d’IA pour offrir des services. L’utilisateur passe commande via un agrégateur et conclut un accord (SLA - Service Level Agreement) sur la qualité du service et le prix.

La couche Service fournit une API côté client. Le client envoie une requête d’inférence ML à l’agrégateur, qui la transmet à un serveur fournisseur via une route appartenant à la Control Layer, chargée de la mise en relation.

La SLA est déployée sur chaîne sous forme de contrat intelligent (dans ce cas, sur Witness Chain), faisant partie de la Transaction Layer. Cette couche enregistre également l’état courant de chaque commande et coordonne l’utilisateur, l’agrégateur et le fournisseur, notamment en cas de litige de paiement.

Pour que la Transaction Layer puisse trancher les litiges, la Proof Layer vérifie que le fournisseur a bien utilisé le modèle conforme à la SLA. Toutefois, SAKSHI ne choisit pas de générer une preuve zkp du calcul ML, mais adopte une approche par preuve optimiste : un réseau de nœuds challengers vérifie les services, rémunérés par Witness Chain.

Bien que la SLA et le réseau de challengers soient sur Witness Chain, celle-ci ne compte pas utiliser son propre jeton natif pour assurer sa sécurité. Elle s’appuiera plutôt sur Eigen Layer pour bénéficier de la sécurité d’Ethereum. Ainsi, toute la couche économique repose indirectement sur Eigen Layer.

On voit donc que SAKSHI s’intercale entre fournisseurs IA et utilisateurs, organisant de manière décentralisée divers services IA. Il s’agit d’une approche horizontale. L’innovation de SAKSHI réside dans le fait qu’elle permet aux fournisseurs de se concentrer sur leurs calculs hors chaîne, tandis que la mise en relation, le paiement et la vérification de la qualité du service sont gérés par des protocoles sur chaîne, avec une tentative d’automatisation de la résolution des litiges. Bien sûr, SAKSHI en est encore au stade théorique, et de nombreux détails pratiques restent à définir.

3. Perspectives futures

Que ce soit l’IA composable ou les plateformes décentralisées d’IA, les modèles d’écosystèmes IA basés sur les blockchains publiques semblent partager des traits communs. Par exemple, les fournisseurs de services IA n’interagissent plus directement avec les utilisateurs : ils se contentent de fournir un modèle ML et d’effectuer les calculs hors chaîne. Les paiements, la résolution des litiges, et la mise en relation entre besoins utilisateurs et services peuvent être gérés par des protocoles décentralisés. La blockchain, en tant qu’infrastructure sans confiance, réduit les frictions entre fournisseurs et utilisateurs, augmentant ainsi l’autonomie de ces derniers.

Bien que cet avantage de la blockchain comme base applicative soit souvent mentionné, il s’applique effectivement aux services IA. La différence avec les dapps classiques est que l’IA ne peut pas exécuter tous ses calculs sur chaîne. Il faut donc recourir au ZK ou aux preuves optimistes pour intégrer les services IA au système blockchain de manière plus fiable.

Avec l’arrivée de solutions d’amélioration de l’expérience utilisateur comme l’abstraction de compte, les utilisateurs pourraient ne plus percevoir les mots de passe, les chaînes ou le gas. L’expérience de l’écosystème blockchain deviendrait alors proche du web2, tout en offrant aux utilisateurs plus de liberté et de composable que les services web2 — un attrait fort. L’émergence d’un écosystème d’applications IA basé sur la blockchain est donc hautement prometteuse.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News