Muốn tự làm AI Agent? Hãy lưu lại hướng dẫn mô hình ngôn ngữ lớn này

Tuyển chọn TechFlowTuyển chọn TechFlow

Muốn tự làm AI Agent? Hãy lưu lại hướng dẫn mô hình ngôn ngữ lớn này

Hướng dẫn đầy đủ về cách chọn LLM phù hợp.

Tác giả: superoo7

Biên dịch: TechFlow

Gần như mỗi ngày tôi đều nhận được những câu hỏi tương tự. Sau khi hỗ trợ xây dựng hơn 20 tác nhân AI và chi rất nhiều tiền để thử nghiệm các mô hình, tôi đã đúc kết được một số kinh nghiệm thực sự hiệu quả.

Dưới đây là hướng dẫn đầy đủ về cách lựa chọn mô hình LLM phù hợp.

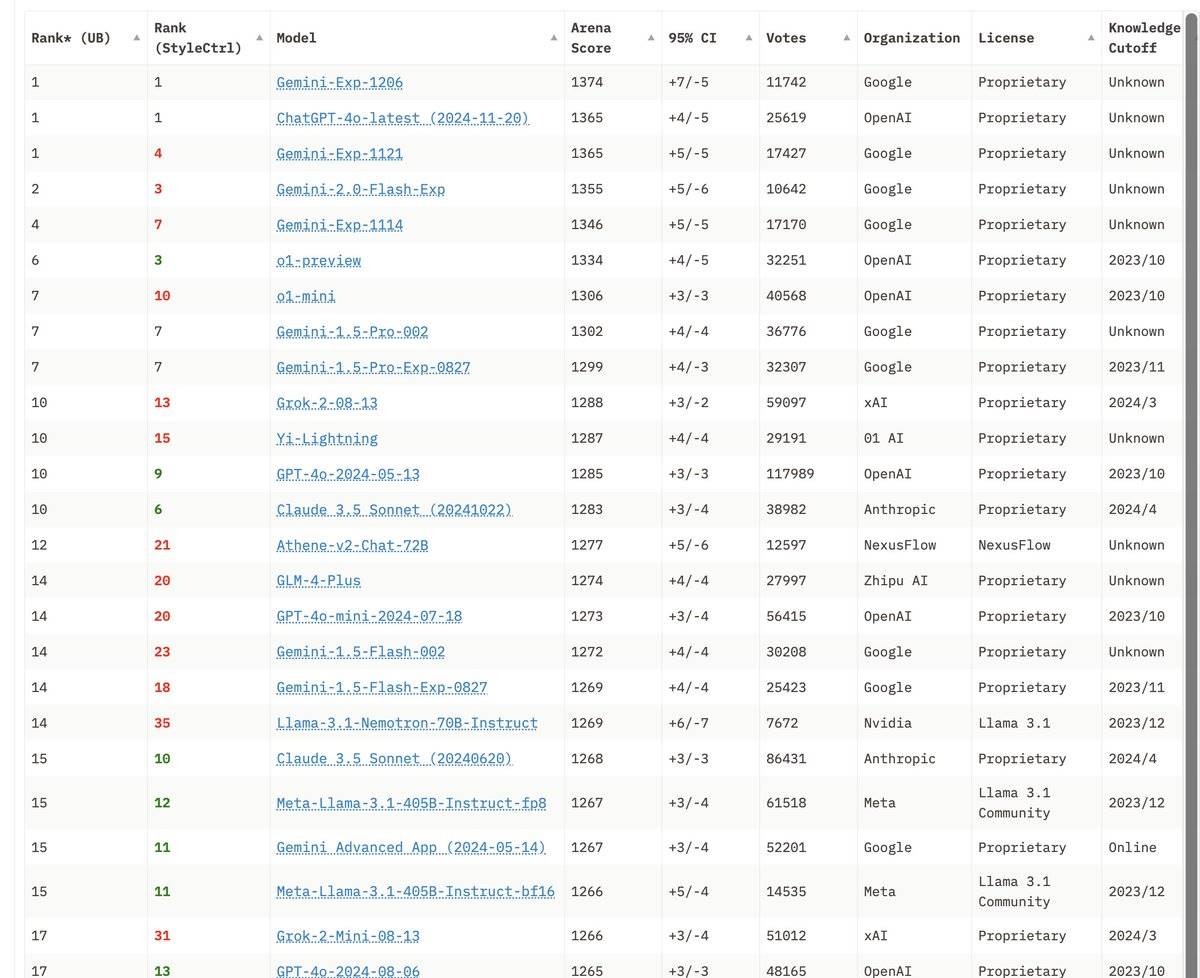

Lĩnh vực mô hình ngôn ngữ lớn (LLM) hiện nay thay đổi rất nhanh chóng. Gần như mỗi tuần lại có mô hình mới ra mắt, và mô hình nào cũng tuyên bố mình là "tốt nhất".

Nhưng thực tế là: không có mô hình nào có thể đáp ứng mọi nhu cầu.

Mỗi mô hình đều có những trường hợp sử dụng riêng biệt.

Tôi đã thử nghiệm hàng chục mô hình, hy vọng rằng qua kinh nghiệm của mình, bạn sẽ tránh được việc lãng phí thời gian và tiền bạc một cách không cần thiết.

Cần lưu ý: bài viết này không dựa trên các bài kiểm tra chuẩn trong phòng thí nghiệm hay quảng cáo tiếp thị.

Tôi sẽ chia sẻ những kinh nghiệm thực tế từ việc trực tiếp xây dựng các tác nhân AI và sản phẩm AI tạo sinh (GenAI) trong hai năm qua.

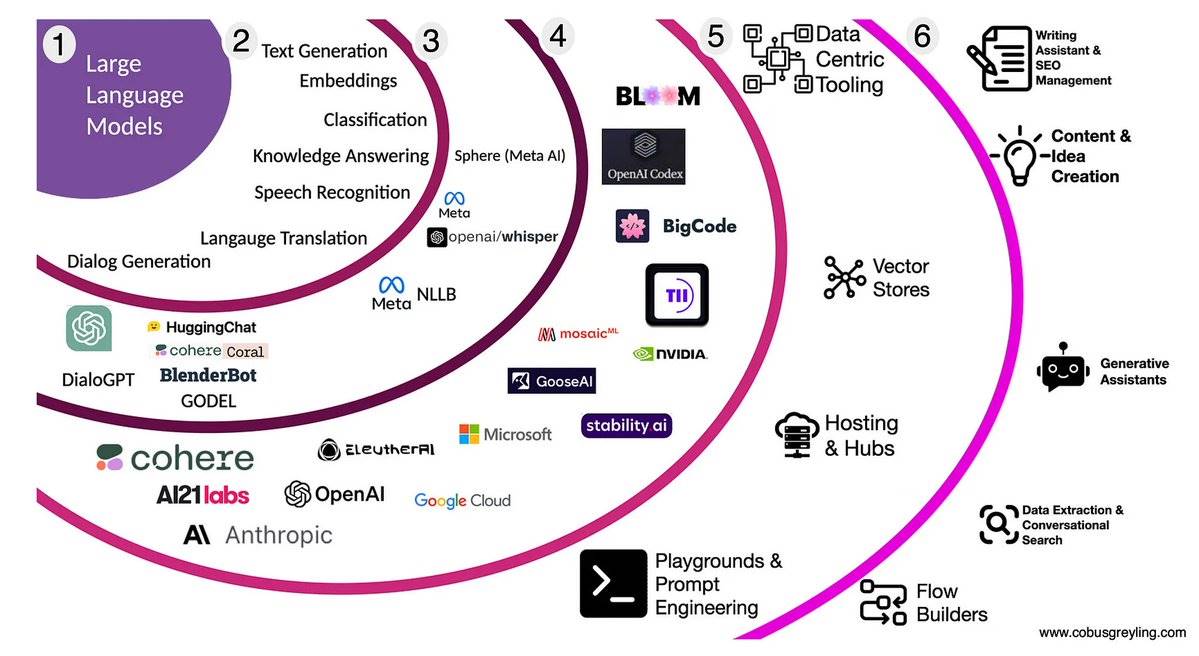

Trước tiên, chúng ta cần hiểu LLM là gì:

Mô hình ngôn ngữ lớn (LLM) giống như dạy máy tính "nói chuyện như con người". Nó dự đoán từ tiếp theo có khả năng xuất hiện cao nhất dựa trên nội dung bạn nhập vào.

Công nghệ này bắt nguồn từ bài báo kinh điển: Attention Is All You Need

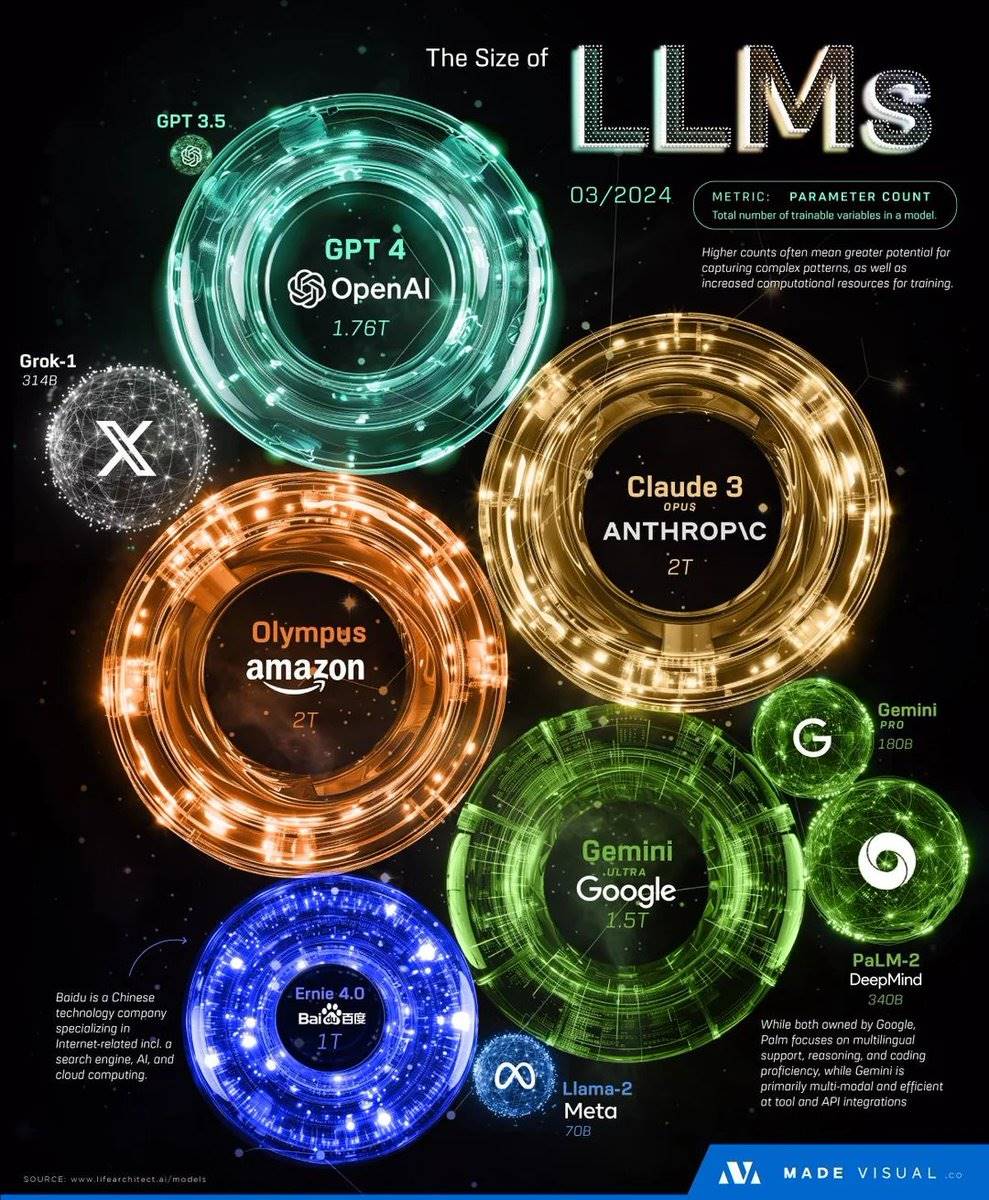

Kiến thức cơ bản — LLM mã nguồn đóng và mã nguồn mở:

-

Mã nguồn đóng: ví dụ như GPT-4 và Claude, thường tính phí theo mức sử dụng và do nhà cung cấp vận hành.

-

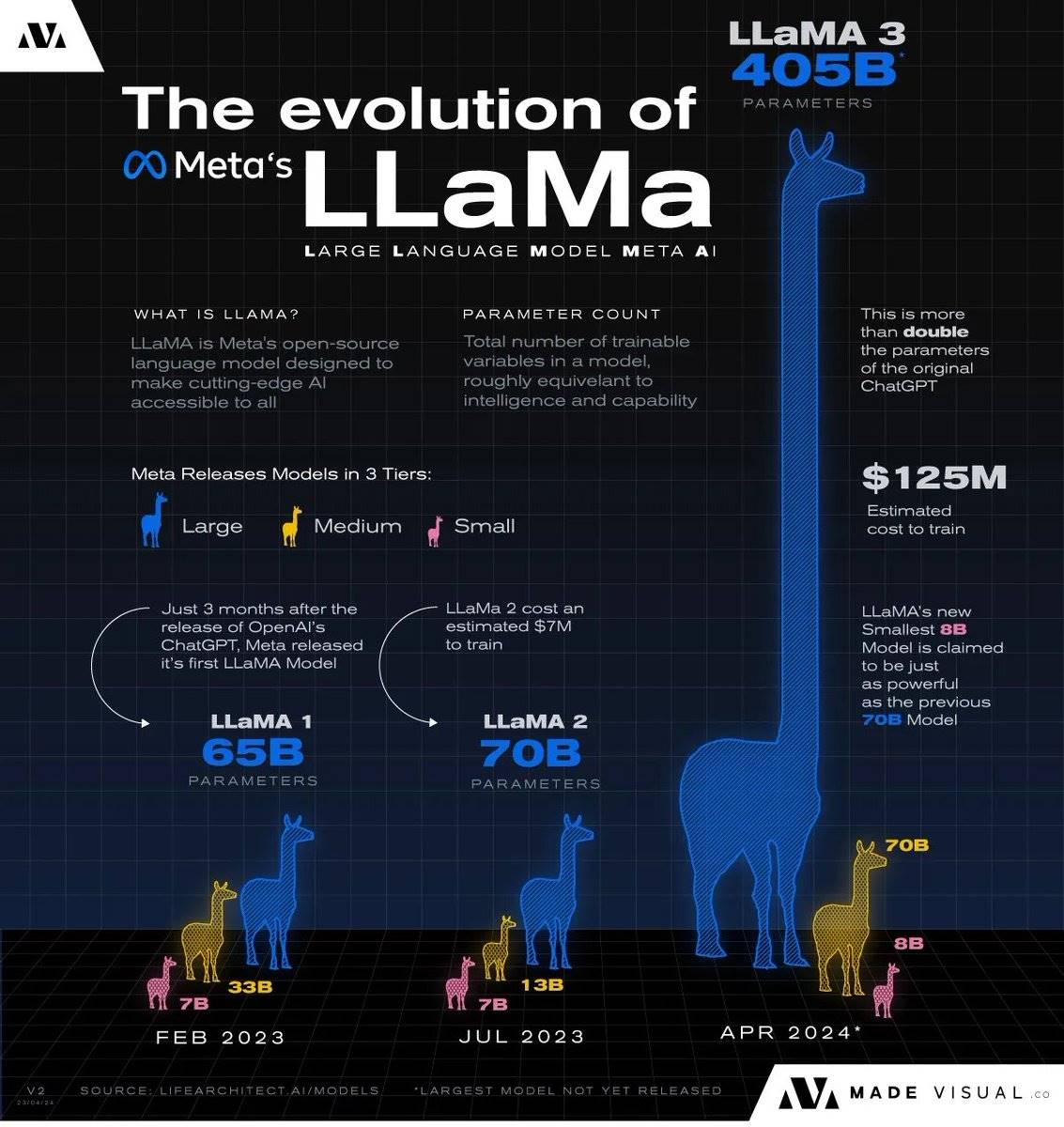

Mã nguồn mở: ví dụ như Llama của Meta và Mixtral, người dùng cần tự triển khai và vận hành.

Khi mới bắt đầu, bạn có thể cảm thấy bối rối với các thuật ngữ này, nhưng việc hiểu rõ sự khác biệt giữa chúng rất quan trọng.

Quy mô mô hình không đồng nghĩa với hiệu suất tốt hơn:

Ví dụ, 7B có nghĩa là mô hình có 7 tỷ tham số.

Nhưng mô hình lớn hơn không phải lúc nào cũng hoạt động tốt hơn. Chìa khóa là chọn mô hình phù hợp với nhu cầu cụ thể của bạn.

Nếu bạn muốn xây dựng robot X/Twitter hoặc AI xã hội:

Grok của @xai là một lựa chọn rất tốt:

-

Cung cấp hạn mức miễn phí hào phóng

-

Khả năng hiểu ngữ cảnh xã hội xuất sắc

-

Dù là mã nguồn đóng nhưng rất đáng để thử

Hết sức khuyến nghị các nhà phát triển mới bắt đầu sử dụng mô hình này! (tin đồn nhỏ: mô hình mặc định của Eliza của @ai16zdao đang dùng XAI Grok)

Nếu bạn cần xử lý nội dung đa ngôn ngữ:

Mô hình QwQ của @Alibaba_Qwen thể hiện rất tốt trong các thử nghiệm của chúng tôi, đặc biệt trong xử lý ngôn ngữ châu Á.

Lưu ý rằng dữ liệu huấn luyện của mô hình chủ yếu đến từ Trung Quốc đại lục, do đó một số nội dung có thể bị thiếu thông tin.

Nếu bạn cần một mô hình đa dụng hoặc có khả năng suy luận mạnh:

Các mô hình của @OpenAI vẫn là những cái tên dẫn đầu ngành:

-

Hiệu suất ổn định và đáng tin cậy

-

Đã được kiểm chứng rộng rãi trong thực tế

-

Có cơ chế an toàn mạnh mẽ

Đây là điểm khởi đầu lý tưởng cho phần lớn các dự án.

Nếu bạn là nhà phát triển hoặc người sáng tạo nội dung:

Claude của @AnthropicAI là công cụ chính mà tôi sử dụng hàng ngày:

-

Khả năng lập trình rất xuất sắc

-

Phản hồi rõ ràng và chi tiết

-

Rất phù hợp để xử lý các công việc sáng tạo

Llama 3.3 của Meta gần đây đang thu hút nhiều sự chú ý:

-

Hiệu suất ổn định và đáng tin cậy

-

Mô hình mã nguồn mở, linh hoạt và tự do

-

Có thể dùng thử qua @OpenRouterAI hoặc @GroqInc

Ví dụ, các dự án x AI trong lĩnh vực tiền mã hóa như @virtuals_io đang phát triển sản phẩm dựa trên mô hình này.

Nếu bạn cần AI cho mục đích đóng vai:

MythoMax 13B của @TheBlokeAI hiện đang là lựa chọn hàng đầu trong lĩnh vực đóng vai, liên tục đứng đầu các bảng xếp hạng chuyên biệt trong nhiều tháng.

Command R+ của Cohere là một mô hình tuyệt vời nhưng bị đánh giá thấp:

Thể hiện xuất sắc trong các nhiệm vụ đóng vai

Có thể dễ dàng xử lý các nhiệm vụ phức tạp

Hỗ trợ cửa sổ ngữ cảnh lên đến 128000, mang lại khả năng "ghi nhớ" lâu hơn

Mô hình Gemma của Google là lựa chọn nhẹ nhưng mạnh mẽ:

-

Tập trung vào các nhiệm vụ cụ thể, hiệu suất vượt trội

-

Thân thiện với ngân sách

-

Phù hợp với các dự án nhạy cảm về chi phí

Kinh nghiệm cá nhân: tôi thường dùng các mô hình Gemma nhỏ làm "trọng tài vô tư" trong quy trình AI, hiệu quả rất tốt trong các nhiệm vụ xác minh!

Các mô hình của @MistralAI rất đáng chú ý:

-

Mã nguồn mở nhưng chất lượng cao cấp

-

Hiệu suất của mô hình Mixtral rất mạnh mẽ

-

Đặc biệt nổi bật trong các nhiệm vụ suy luận phức tạp

Nó được cộng đồng đánh giá rất cao, chắc chắn đáng để thử.

Lời khuyên chuyên môn: hãy thử kết hợp linh hoạt!

-

Các mô hình khác nhau có ưu điểm riêng

-

Có thể tạo ra "đội ngũ" AI cho các nhiệm vụ phức tạp

-

Để mỗi mô hình tập trung vào phần nó giỏi nhất

Giống như xây dựng một đội hình trong mơ, mỗi thành viên đều có vai trò và đóng góp riêng biệt.

Cách nhanh chóng để bắt đầu:

Sử dụng @OpenRouterAI hoặc @redpill_gpt để thử nghiệm mô hình, các nền tảng này hỗ trợ thanh toán bằng tiền mã hóa, rất tiện lợi

Là công cụ tuyệt vời để so sánh hiệu suất giữa các mô hình khác nhau

Nếu bạn muốn tiết kiệm chi phí và chạy mô hình cục bộ, hãy thử dùng @ollama, thí nghiệm bằng GPU của riêng bạn.

Nếu bạn theo đuổi tốc độ, công nghệ LPU của @GroqInc cung cấp tốc độ suy luận cực nhanh:

-

Mặc dù lựa chọn mô hình còn hạn chế

-

Nhưng hiệu suất rất phù hợp để triển khai trong môi trường sản xuất

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News