Lối thoát cho cơ sở hạ tầng AI đồng nhất nằm ở đâu?

Tuyển chọn TechFlowTuyển chọn TechFlow

Lối thoát cho cơ sở hạ tầng AI đồng nhất nằm ở đâu?

Nghiên cứu này nhằm mục đích tìm hiểu lĩnh vực trí tuệ nhân tạo nào quan trọng nhất đối với các nhà phát triển, cũng như cơ hội bùng nổ tiếp theo có thể nằm ở đâu trong lĩnh vực Web3 và trí tuệ nhân tạo.

Tác giả: IOSG Ventures

Cảm ơn phản hồi từ Zhenyang@Upshot, Fran@Giza, Ashely@Neuronets, Matt@Valence, Dylan@Pond.

Nghiên cứu này nhằm tìm hiểu lĩnh vực trí tuệ nhân tạo (AI) nào quan trọng nhất đối với nhà phát triển, cũng như cơ hội bùng nổ tiếp theo trong lĩnh vực Web3 và AI là gì.

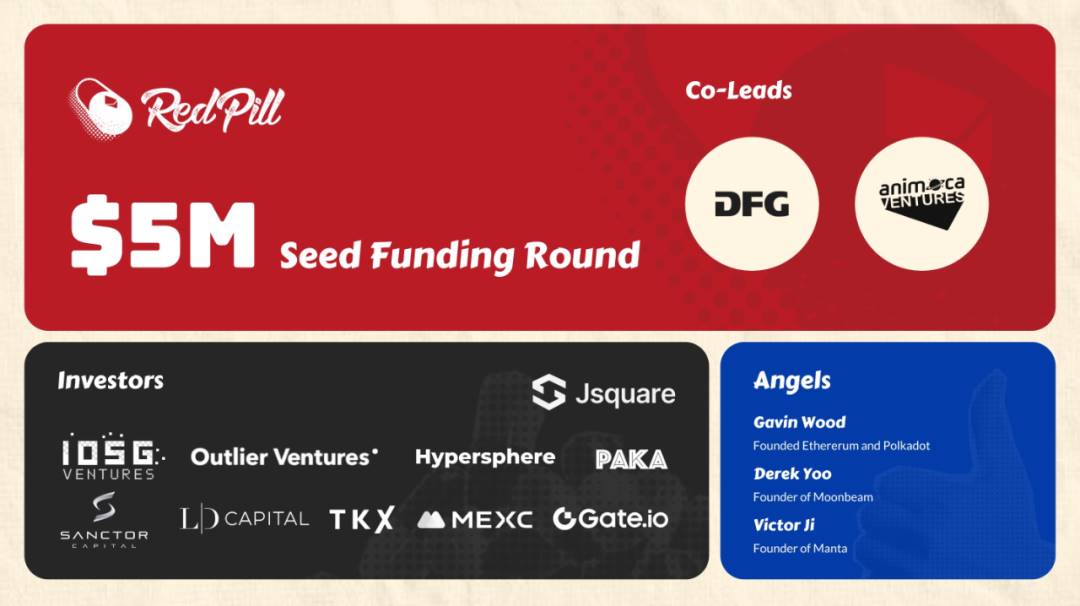

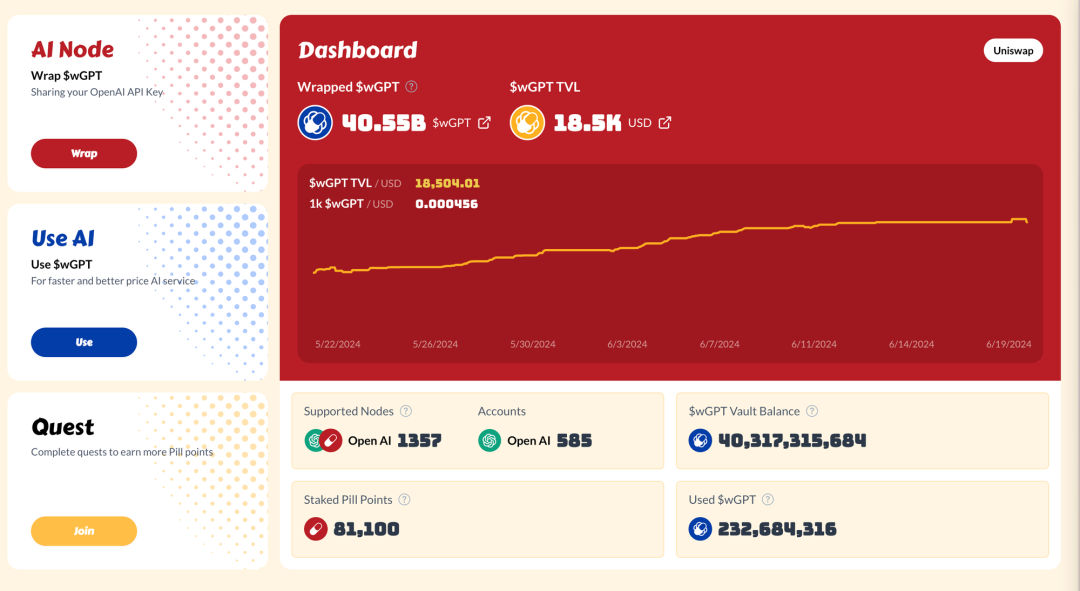

Trước khi chia sẻ các quan điểm nghiên cứu mới, chúng tôi rất vui mừng khi đã tham gia vòng gọi vốn đầu tiên trị giá 5 triệu USD của RedPill, đồng thời rất háo hức được đồng hành cùng RedPill trong chặng đường sắp tới!

Tóm tắt nhanh (TL;DR)

Khi sự kết hợp giữa Web3 và AI trở thành chủ đề nổi bật trong giới tiền mã hóa, cơ sở hạ tầng AI trong không gian mã hóa đang phát triển mạnh mẽ. Tuy nhiên, số lượng ứng dụng thực sự tận dụng hoặc xây dựng cho AI vẫn còn ít, và vấn đề đồng nhất hóa cơ sở hạ tầng AI dần lộ rõ. Việc chúng tôi gần đây tham gia vòng tài trợ đầu tiên của RedPill đã giúp hình thành những nhận thức sâu sắc hơn.

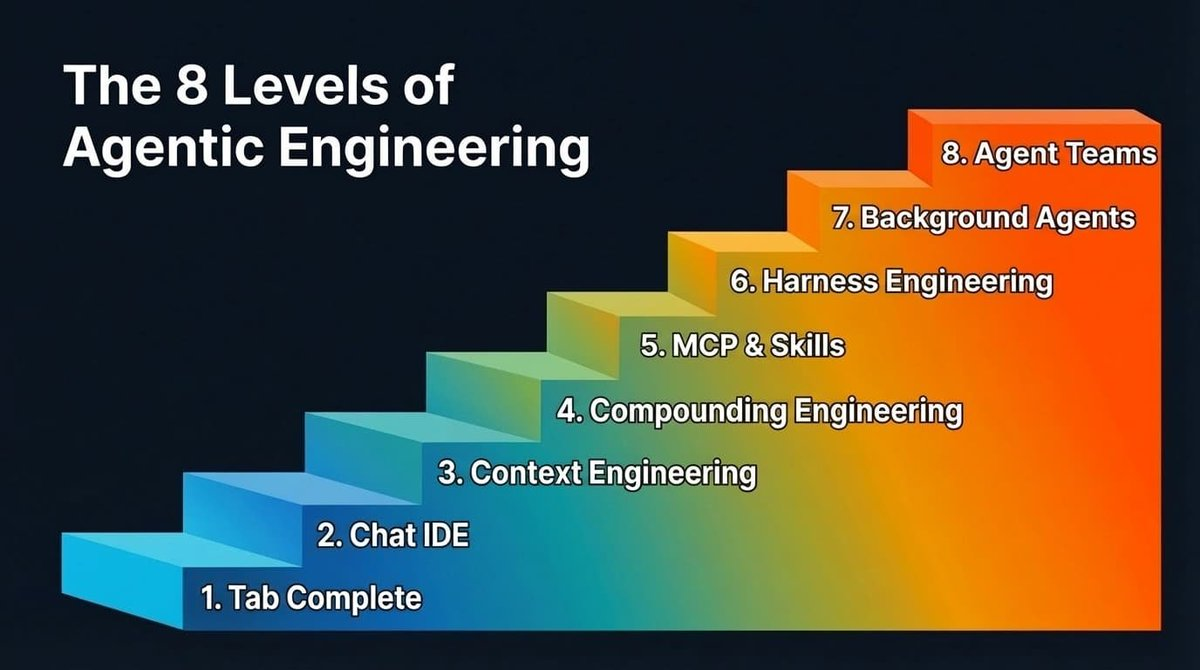

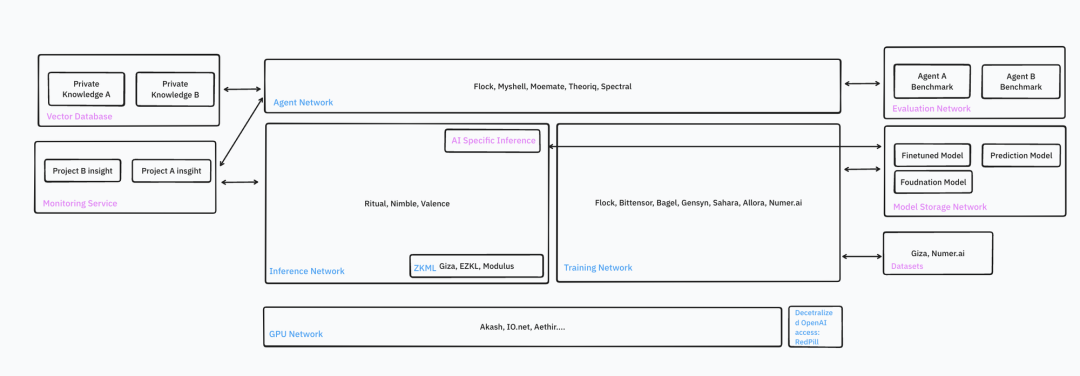

Các công cụ chính để xây dựng AI Dapp gồm: truy cập OpenAI phi tập trung, mạng GPU, mạng suy luận và mạng tác nhân (agent).

Lý do mạng GPU nóng hơn cả "thời kỳ khai thác Bitcoin" là vì: thị trường AI lớn hơn, tăng trưởng nhanh và ổn định; AI hỗ trợ hàng triệu ứng dụng mỗi ngày; AI cần nhiều loại GPU và vị trí máy chủ đa dạng; công nghệ hiện đại hơn trước; đối tượng khách hàng rộng hơn.

Mạng suy luận và mạng tác nhân có cơ sở hạ tầng tương tự nhưng hướng tiếp cận khác nhau. Mạng suy luận chủ yếu phục vụ nhà phát triển có kinh nghiệm triển khai mô hình riêng, trong khi chạy mô hình không phải LLM không nhất thiết cần GPU. Ngược lại, mạng tác nhân tập trung vào LLM, nhà phát triển không cần mang theo mô hình mà chú trọng vào kỹ thuật prompt và cách nối các tác nhân với nhau. Mạng tác nhân luôn yêu cầu GPU hiệu suất cao.

Các dự án cơ sở hạ tầng AI hứa hẹn rất lớn và liên tục ra mắt tính năng mới.

Phần lớn các dự án gốc mã hóa vẫn ở giai đoạn testnet, độ ổn định kém, cấu hình phức tạp, chức năng bị hạn chế và cần thêm thời gian để chứng minh tính bảo mật và riêng tư.

Giả sử AI Dapp trở thành xu hướng lớn, sẽ còn nhiều lĩnh vực chưa được khai phá như giám sát, cơ sở hạ tầng liên quan RAG, mô hình bản địa Web3, tác nhân phi tập trung tích hợp sẵn API và dữ liệu bản địa mã hóa, mạng đánh giá, v.v.

Xu hướng tích hợp dọc (vertical integration) đang nổi bật. Các dự án cơ sở hạ tầng cố gắng cung cấp dịch vụ trọn gói, đơn giản hóa công việc cho nhà phát triển AI Dapp.

Tương lai sẽ là mô hình lai ghép. Một phần suy luận diễn ra ở frontend, một phần được tính toán trên chuỗi, để cân nhắc yếu tố chi phí và khả năng kiểm chứng.

Nguồn: IOSG

Giới thiệu

Sự kết hợp giữa Web3 và AI là một trong những chủ đề nổi bật nhất hiện nay trong lĩnh vực mã hóa. Những nhà phát triển tài năng đang xây dựng cơ sở hạ tầng AI cho thế giới mã hóa, mang trí tuệ vào các hợp đồng thông minh. Việc xây dựng AI dApp là nhiệm vụ cực kỳ phức tạp, đòi hỏi nhà phát triển phải xử lý dữ liệu, mô hình, sức mạnh tính toán, vận hành, triển khai và tích hợp với blockchain. Để đáp ứng nhu cầu này, các nhà sáng lập Web3 đã phát triển nhiều giải pháp ban đầu như mạng GPU, cộng đồng gắn nhãn dữ liệu, mô hình huấn luyện cộng đồng, suy luận và huấn luyện AI có thể xác minh, cũng như cửa hàng tác nhân.

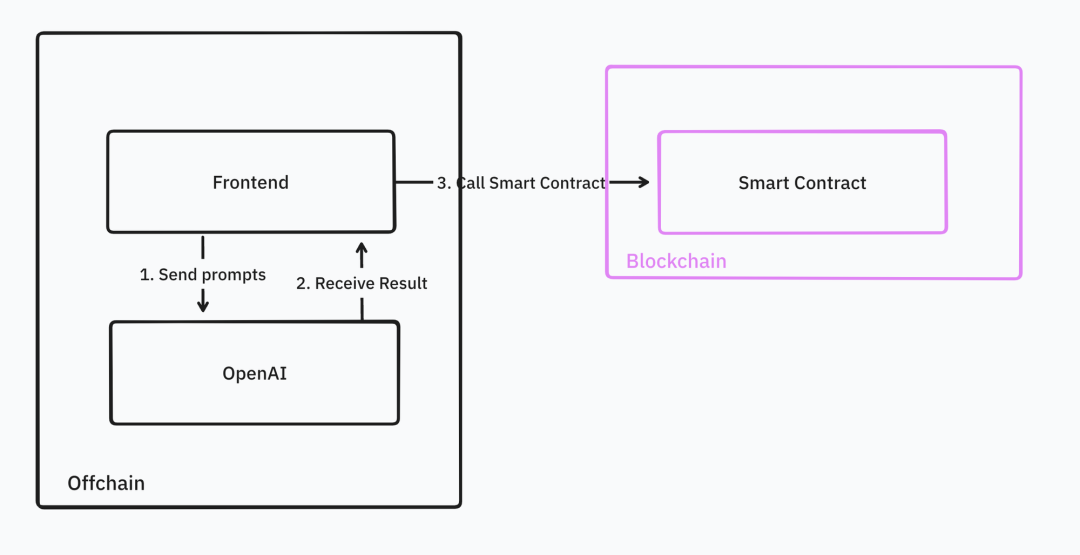

Dù cơ sở hạ tầng đang phát triển mạnh, nhưng số lượng ứng dụng thực sự tận dụng hoặc xây dựng cho AI vẫn còn rất ít. Khi nhà phát triển tìm kiếm hướng dẫn xây dựng AI dApp, họ thấy rằng các tài liệu hướng dẫn liên quan đến cơ sở hạ tầng AI gốc mã hóa còn thiếu, phần lớn chỉ tập trung vào việc gọi API OpenAI ở frontend.

Nguồn: IOSG Ventures

Các ứng dụng hiện tại chưa tận dụng đầy đủ chức năng phi tập trung và khả năng kiểm chứng của blockchain, nhưng tình trạng này sẽ sớm thay đổi. Hiện tại, phần lớn cơ sở hạ tầng AI chuyên về mã hóa đã khởi chạy testnet và dự kiến hoạt động chính thức trong 6 tháng tới.

Nghiên cứu này sẽ đi sâu vào các công cụ chính sẵn có trong cơ sở hạ tầng AI mã hóa. Hãy cùng chuẩn bị đón khoảnh khắc GPT-3.5 của thế giới mã hóa!

1. RedPill: Cấp quyền truy cập phi tập trung cho OpenAI

RedPill – dự án chúng tôi vừa đầu tư – là một điểm khởi đầu tốt.

OpenAI sở hữu một số mô hình mạnh hàng đầu thế giới như GPT-4-vision, GPT-4-turbo và GPT-4o, là lựa chọn hàng đầu để xây dựng các AI Dapp tiên tiến.

Nhà phát triển có thể gọi API OpenAI qua oracle hoặc giao diện frontend để tích hợp vào dApp.

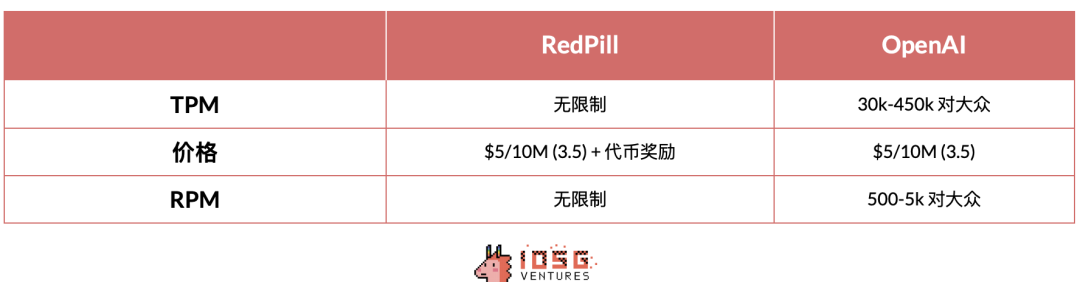

RedPill tập hợp các API OpenAI từ nhiều nhà phát triển khác nhau dưới một giao diện duy nhất, cung cấp dịch vụ AI nhanh chóng, tiết kiệm chi phí và có thể kiểm chứng cho người dùng toàn cầu, từ đó dân chủ hóa việc truy cập các nguồn lực mô hình AI hàng đầu. Thuật toán định tuyến của RedPill sẽ chuyển yêu cầu của nhà phát triển đến một người đóng góp phù hợp. Các yêu cầu API được thực hiện thông qua mạng phân phối của nó, giúp vượt qua mọi hạn chế tiềm tàng từ OpenAI, giải quyết một số vấn đề phổ biến mà nhà phát triển mã hóa gặp phải như:

Hạn mức TPM (token mỗi phút): Tài khoản mới bị giới hạn sử dụng token, không đủ đáp ứng nhu cầu của các dApp phổ biến phụ thuộc vào AI.

Giới hạn truy cập: Một số mô hình giới hạn truy cập với tài khoản mới hoặc ở một số quốc gia nhất định.

Bằng cách giữ nguyên mã yêu cầu nhưng thay đổi tên máy chủ, nhà phát triển có thể truy cập các mô hình OpenAI với chi phí thấp, khả năng mở rộng cao và không bị giới hạn.

2. Mạng GPU

Ngoài việc sử dụng API OpenAI, nhiều nhà phát triển chọn tự lưu trữ mô hình tại nhà. Họ có thể dựa vào các mạng GPU phi tập trung như io.net, Aethir, Akash để tự xây dựng cụm GPU và triển khai, vận hành các mô hình nội bộ hoặc mã nguồn mở mạnh mẽ.

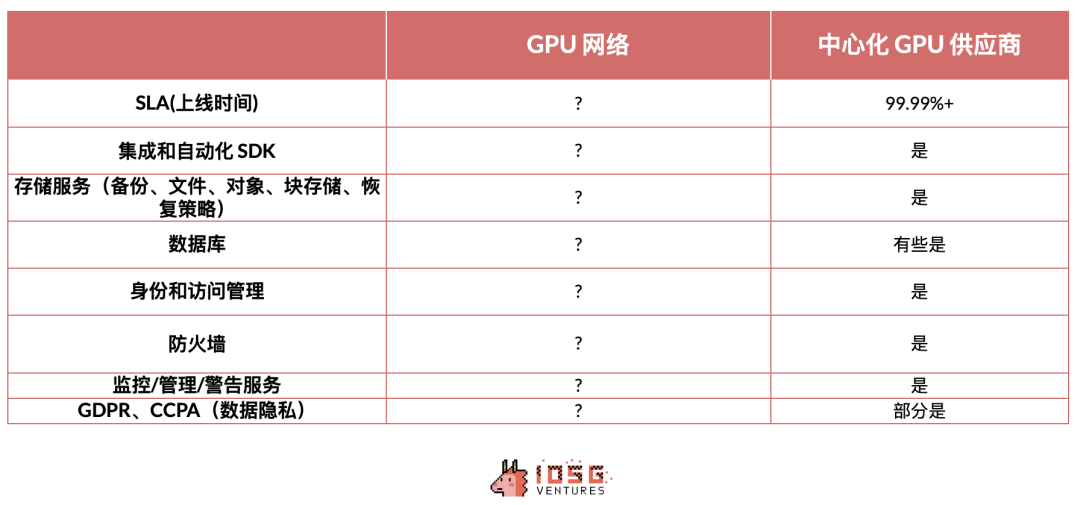

Các mạng GPU phi tập trung này tận dụng sức mạnh tính toán từ cá nhân hoặc trung tâm dữ liệu nhỏ, cung cấp cấu hình linh hoạt, nhiều lựa chọn vị trí máy chủ và chi phí thấp hơn, giúp nhà phát triển dễ dàng thử nghiệm AI trong ngân sách hạn chế. Tuy nhiên, do đặc tính phi tập trung, các mạng GPU này còn tồn tại hạn chế về chức năng, khả dụng và bảo mật dữ liệu.

Trong vài tháng qua, nhu cầu về GPU bùng nổ, vượt xa thời kỳ khai thác Bitcoin. Nguyên nhân bao gồm:

Khách hàng mục tiêu ngày càng tăng, mạng GPU hiện phục vụ các nhà phát triển AI – nhóm đông đảo và trung thành hơn, không bị ảnh hưởng bởi biến động giá tiền mã hóa.

So với thiết bị khai thác chuyên dụng, GPU phi tập trung cung cấp nhiều mẫu mã và thông số kỹ thuật hơn, đáp ứng tốt hơn nhu cầu đa dạng. Đặc biệt, xử lý mô hình lớn cần VRAM cao hơn, trong khi các tác vụ nhỏ có thể chọn GPU phù hợp hơn. Đồng thời, GPU phi tập trung có thể phục vụ người dùng cuối gần hơn, giảm độ trễ.

Công nghệ ngày càng trưởng thành, mạng GPU dựa vào blockchain tốc độ cao như Solana để thanh toán, công nghệ ảo hóa Docker và cụm tính toán Ray.

Về lợi nhuận đầu tư, thị trường AI đang mở rộng, cơ hội phát triển ứng dụng và mô hình mới nhiều, tỷ suất hoàn vốn kỳ vọng của mô hình H100 đạt 60-70%, trong khi khai thác Bitcoin phức tạp hơn, thiên về "người thắng tất cả", sản lượng có hạn.

Các công ty khai thác Bitcoin như Iris Energy, Core Scientific và Bitdeer bắt đầu hỗ trợ mạng GPU, cung cấp dịch vụ AI và tích cực mua GPU chuyên dụng cho AI như H100.

Gợi ý: Đối với các nhà phát triển Web2 không quá coi trọng SLA, io.net cung cấp trải nghiệm đơn giản, dễ dùng và là lựa chọn có tỷ lệ giá thành hiệu quả cao.

3. Mạng suy luận

Đây là xương sống của cơ sở hạ tầng AI bản địa mã hóa. Nó sẽ hỗ trợ hàng tỷ thao tác suy luận AI trong tương lai. Nhiều nền tảng AI layer1 hoặc layer2 cung cấp khả năng gọi suy luận AI trực tiếp trên chuỗi cho nhà phát triển. Các nhà dẫn đầu thị trường gồm Ritual, Valence và Fetch.ai.

Các mạng này khác nhau ở các khía cạnh sau:

Hiệu suất (độ trễ, thời gian tính toán)

Mô hình được hỗ trợ

Khả năng kiểm chứng

Giá cả (chi phí trên chuỗi, chi phí suy luận)

Trải nghiệm phát triển

3.1 Mục tiêu

Trong hoàn cảnh lý tưởng, nhà phát triển có thể dễ dàng truy cập dịch vụ suy luận AI tùy chỉnh ở bất cứ đâu, dưới mọi hình thức chứng minh, với rào cản tích hợp gần như bằng không.

Mạng suy luận cung cấp toàn bộ hỗ trợ cơ bản cần thiết cho nhà phát triển, bao gồm: tạo và xác minh bằng chứng theo yêu cầu, thực hiện tính toán suy luận, trung chuyển và xác minh dữ liệu suy luận, cung cấp giao diện Web2 và Web3, triển khai mô hình một cú nhấp, giám sát hệ thống, thao tác xuyên chuỗi, tích hợp đồng bộ và thực thi định kỳ.

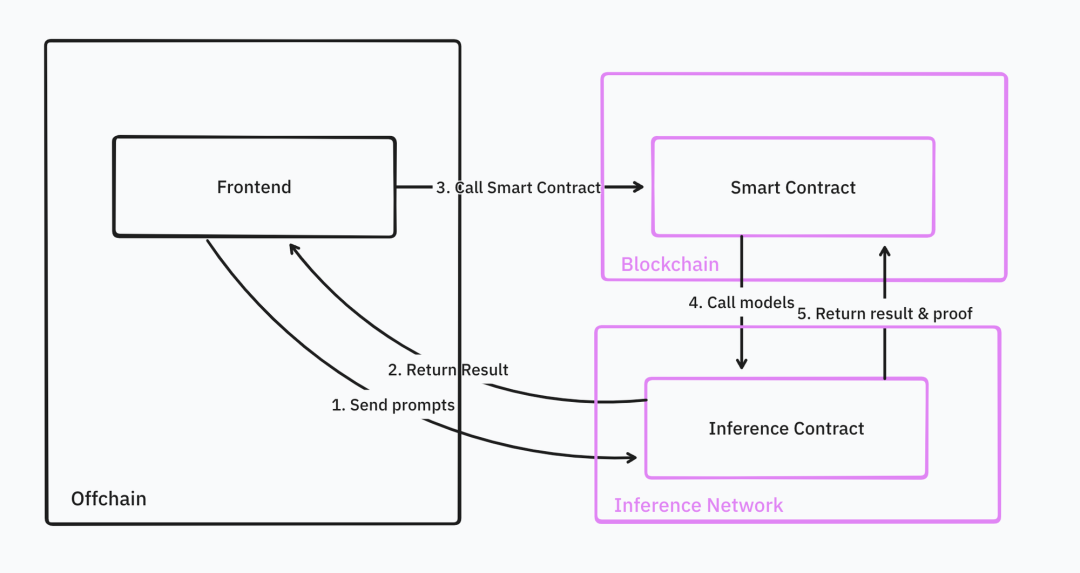

Nguồn: IOSG Ventures

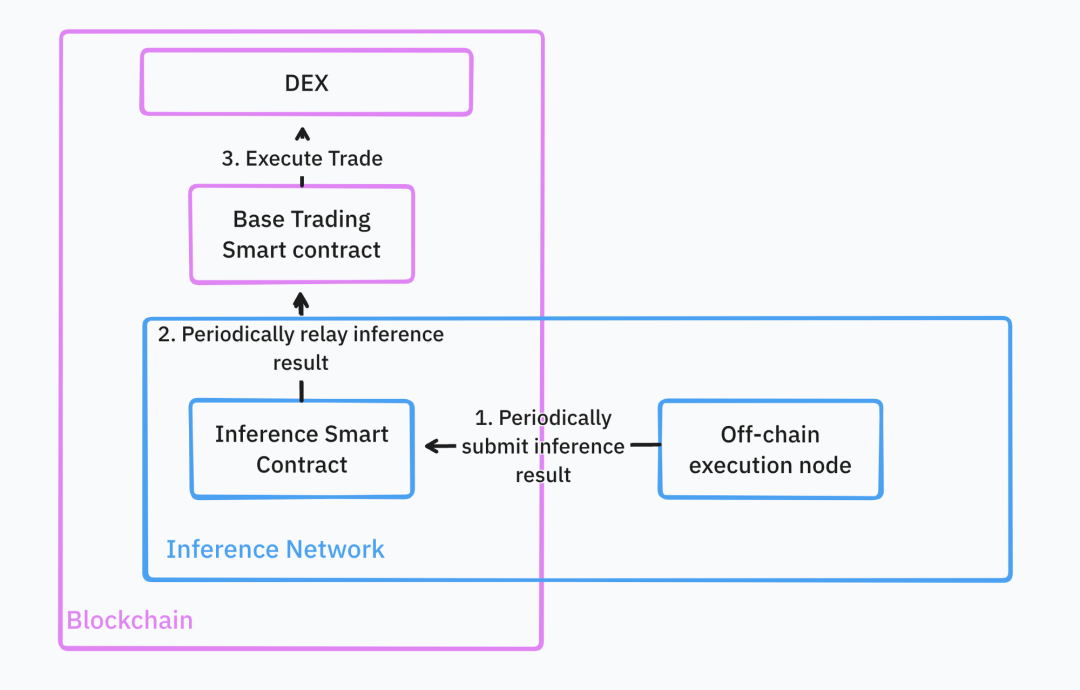

Nhờ các chức năng này, nhà phát triển có thể tích hợp liền mạch dịch vụ suy luận vào các hợp đồng thông minh hiện có. Ví dụ, khi xây dựng robot giao dịch DeFi, các robot này sẽ dùng mô hình học máy để tìm thời điểm mua/bán cặp giao dịch cụ thể, rồi thực hiện chiến lược giao dịch tương ứng trên nền tảng cơ bản.

Trong trạng thái lý tưởng hoàn toàn, mọi cơ sở hạ tầng đều được lưu trữ đám mây. Nhà phát triển chỉ cần tải lên mô hình chiến lược giao dịch dưới định dạng phổ biến như torch, mạng suy luận sẽ lưu trữ và cung cấp mô hình cho truy vấn Web2 và Web3.

Sau khi hoàn tất mọi bước triển khai mô hình, nhà phát triển có thể trực tiếp gọi suy luận mô hình qua API Web3 hoặc hợp đồng thông minh. Mạng suy luận sẽ liên tục thực hiện các chiến lược giao dịch này và phản hồi kết quả về hợp đồng thông minh cơ bản. Nếu nhà phát triển quản lý lượng vốn cộng đồng lớn, họ cần cung cấp xác minh kết quả suy luận. Khi nhận được kết quả, hợp đồng thông minh sẽ thực hiện giao dịch dựa trên đó.

Nguồn: IOSG Ventures

3.1.1 Bất đồng bộ và đồng bộ

Về mặt lý thuyết, thực thi suy luận bất đồng bộ có thể mang lại hiệu suất tốt hơn; tuy nhiên, cách này có thể gây bất tiện trong trải nghiệm phát triển.

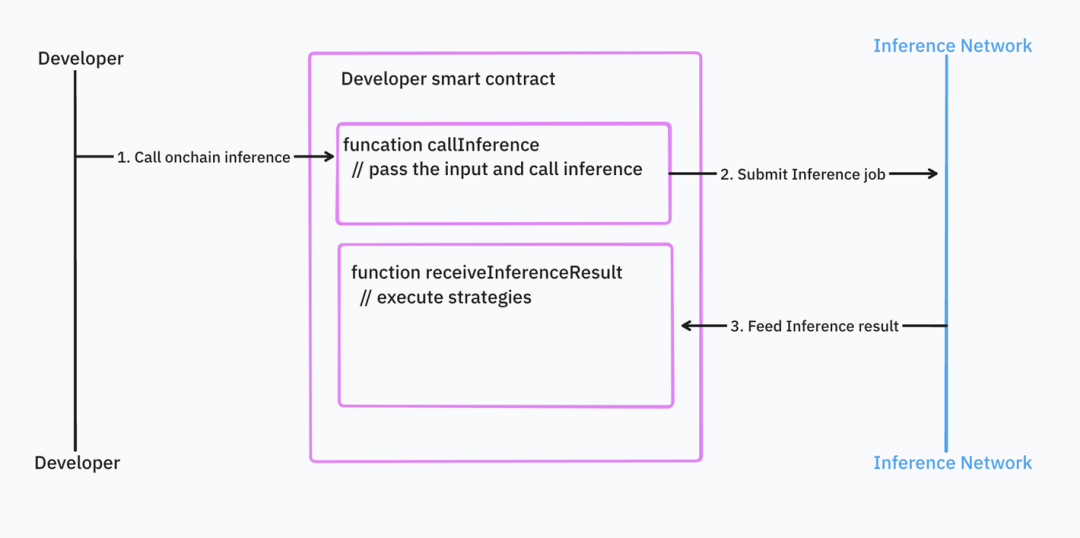

Khi dùng cách bất đồng bộ, nhà phát triển cần gửi tác vụ vào hợp đồng thông minh của mạng suy luận trước. Khi hoàn tất suy luận, hợp đồng thông minh mạng suy luận sẽ trả kết quả lại. Trong mô hình lập trình này, logic bị chia thành hai phần: gọi suy luận và xử lý kết quả suy luận.

Nguồn: IOSG Ventures

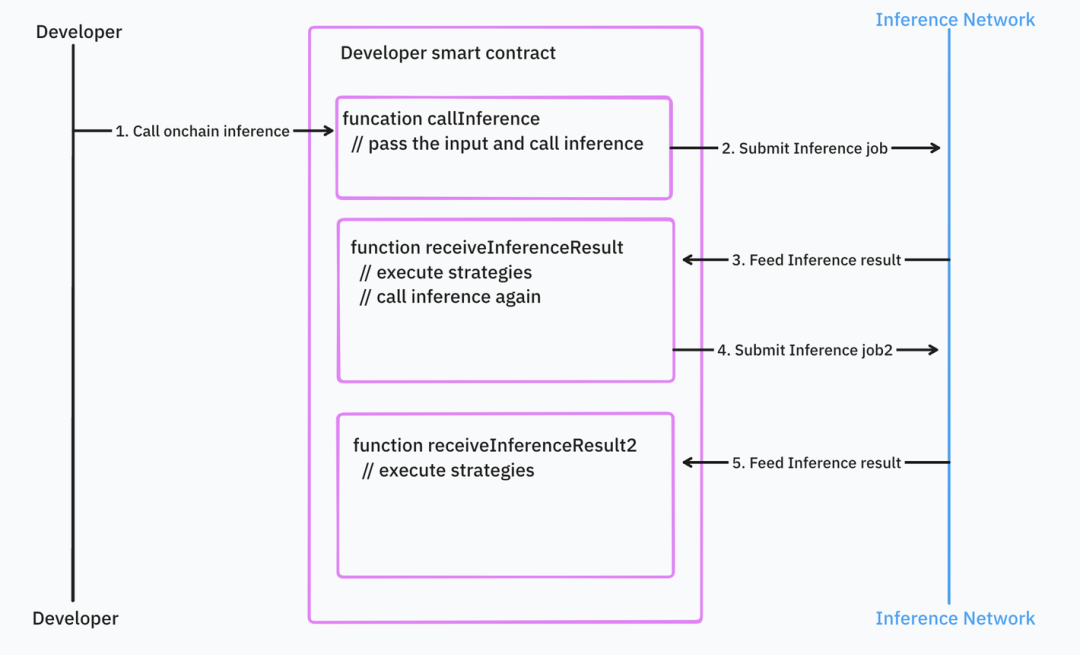

Nếu nhà phát triển có các lời gọi suy luận lồng nhau và nhiều logic điều khiển, tình hình sẽ tệ hơn.

Nguồn: IOSG Ventures

Mô hình lập trình bất đồng bộ khiến việc tích hợp với các hợp đồng thông minh hiện có trở nên khó khăn. Điều này buộc nhà phát triển phải viết nhiều mã bổ sung, xử lý lỗi và quản lý phụ thuộc.

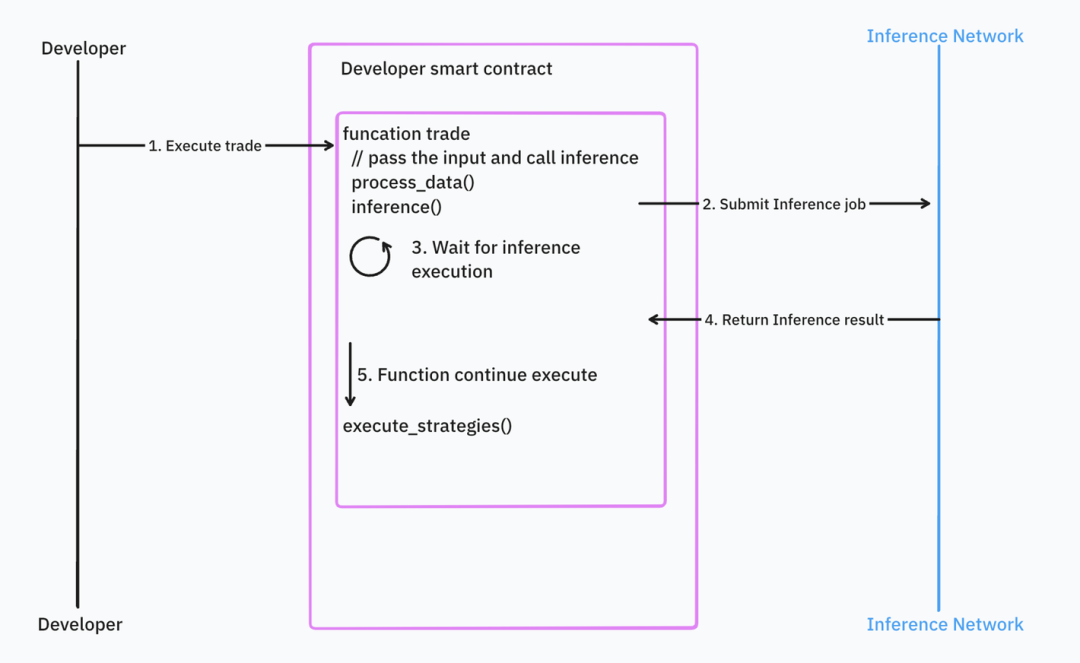

Ngược lại, lập trình đồng bộ trực quan hơn với nhà phát triển, nhưng lại gây ra vấn đề về thời gian phản hồi và thiết kế blockchain. Ví dụ, nếu dữ liệu đầu vào là thời gian khối hoặc giá cả – những thứ thay đổi nhanh – thì khi suy luận hoàn tất, dữ liệu đã lỗi thời, có thể khiến việc thực thi hợp đồng thông minh phải hoàn tác. Hãy tưởng tượng bạn dùng một mức giá đã cũ để giao dịch.

Nguồn: IOSG Ventures

Hầu hết cơ sở hạ tầng AI dùng xử lý bất đồng bộ, nhưng Valence đang cố gắng giải quyết các vấn đề này.

3.2 Thực tế

Thực tế, nhiều mạng suy luận mới vẫn ở giai đoạn thử nghiệm, như mạng Ritual. Theo tài liệu công khai, các mạng này hiện chức năng còn hạn chế (ví dụ chức năng xác minh, chứng minh chưa ra mắt). Họ hiện không cung cấp cơ sở hạ tầng đám mây để hỗ trợ tính toán AI trên chuỗi, mà chỉ cung cấp một khuôn khổ để tự lưu trữ tính toán AI và truyền kết quả lên chuỗi.

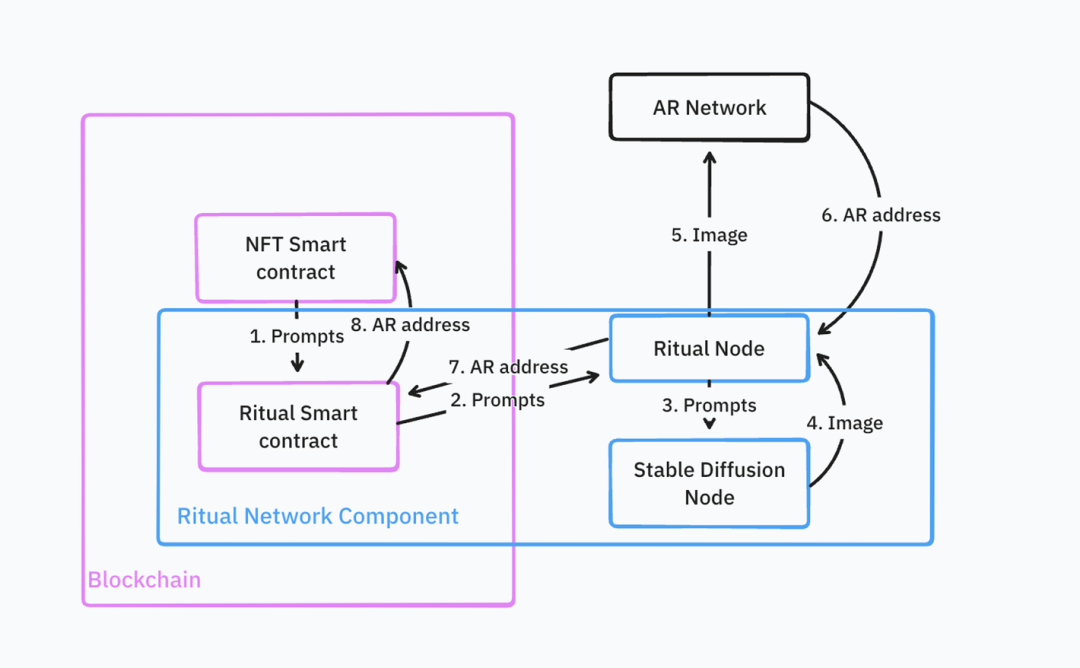

Đây là kiến trúc vận hành AIGC NFT. Mô hình lan tỏa tạo NFT và tải lên Arweave. Mạng suy luận dùng địa chỉ Arweave này để đúc NFT trên chuỗi.

Nguồn: IOSG Ventures

Quá trình này rất phức tạp, nhà phát triển phải tự triển khai và duy trì phần lớn cơ sở hạ tầng, như nút Ritual với logic dịch vụ tùy chỉnh, nút Stable Diffusion và hợp đồng thông minh NFT.

Gợi ý: Các mạng suy luận hiện tại khá phức tạp trong việc tích hợp và triển khai mô hình tùy chỉnh, và ở giai đoạn này hầu hết chưa hỗ trợ xác minh. Sử dụng công nghệ AI ở frontend sẽ là lựa chọn đơn giản hơn cho nhà phát triển. Nếu bạn thực sự cần xác minh, nhà cung cấp ZKML Giza là lựa chọn tốt.

4. Mạng tác nhân

Mạng tác nhân giúp người dùng dễ dàng tùy chỉnh tác nhân. Mạng này gồm các thực thể hoặc hợp đồng thông minh có thể tự thực hiện nhiệm vụ, giao tiếp với nhau và tương tác với mạng blockchain, không cần can thiệp trực tiếp của con người. Nó tập trung vào công nghệ LLM. Ví dụ, nó có thể cung cấp một chatbot GPT am hiểu Ethereum. Tuy nhiên, công cụ hiện tại của chatbot này còn hạn chế, nhà phát triển chưa thể xây dựng ứng dụng phức tạp trên nền tảng này.

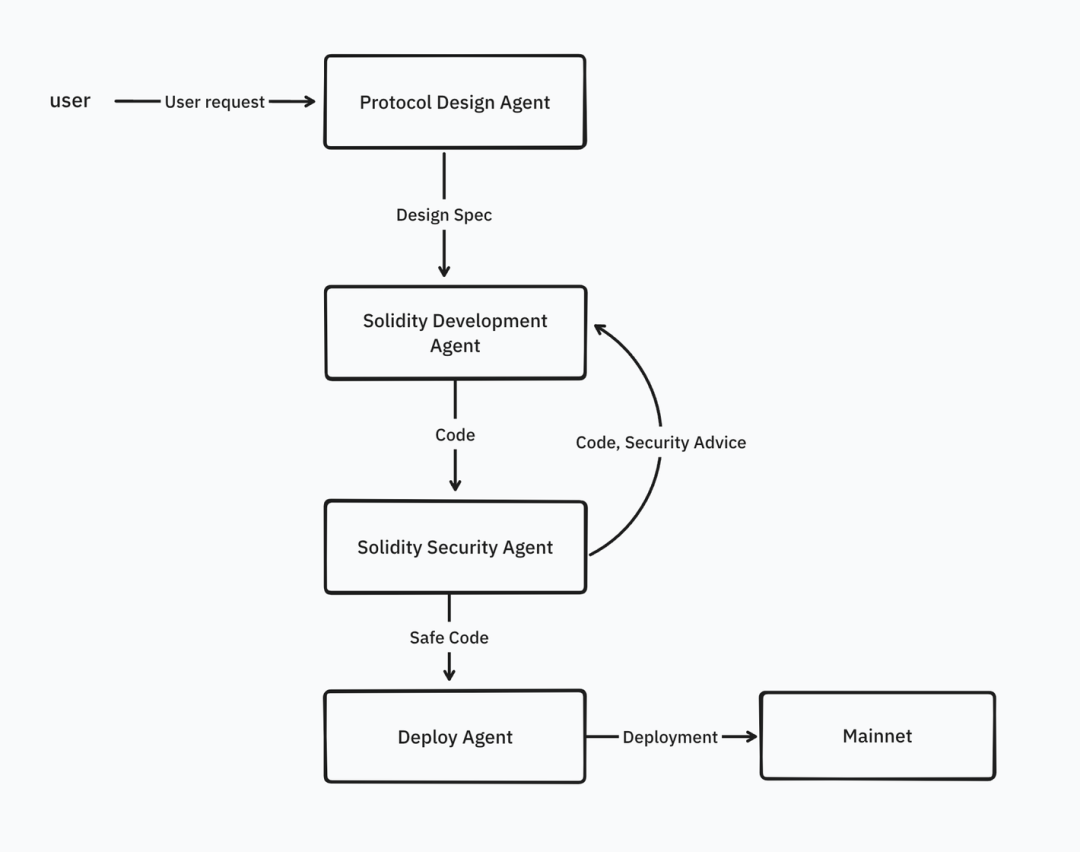

Nguồn: IOSG Ventures

Tuy nhiên, trong tương lai, mạng tác nhân sẽ cung cấp thêm nhiều công cụ cho tác nhân sử dụng, không chỉ giới hạn ở tri thức mà còn cả khả năng gọi API bên ngoài, thực hiện nhiệm vụ cụ thể. Nhà phát triển sẽ có thể nối nhiều tác nhân để xây dựng quy trình làm việc. Ví dụ, viết hợp đồng thông minh Solidity có thể liên quan đến nhiều tác nhân chuyên biệt: tác nhân thiết kế giao thức, tác nhân phát triển Solidity, tác nhân kiểm tra an toàn mã và tác nhân triển khai Solidity.

Nguồn: IOSG Ventures

Chúng ta phối hợp sự hợp tác của các tác nhân này thông qua prompt và kịch bản.

Một số ví dụ về mạng tác nhân gồm Flock.ai, Myshell, Theoriq.

Gợi ý: Phần lớn tác nhân hiện nay chức năng còn hạn chế. Với các trường hợp sử dụng cụ thể, tác nhân Web2 phục vụ tốt hơn và có công cụ biên đạo trưởng thành như Langchain, Llamaindex.

5. Sự khác biệt giữa mạng tác nhân và mạng suy luận

Mạng tác nhân tập trung hơn vào LLM, cung cấp các công cụ như Langchain để tích hợp nhiều tác nhân. Thông thường, nhà phát triển không cần tự phát triển mô hình học máy, vì mạng tác nhân đã đơn giản hóa quá trình phát triển và triển khai mô hình. Họ chỉ cần nối các tác nhân và công cụ cần thiết. Trong hầu hết trường hợp, người dùng cuối sẽ trực tiếp sử dụng các tác nhân này.

Mạng suy luận là cơ sở hạ tầng nền tảng cho mạng tác nhân. Nó cung cấp quyền truy cập cấp thấp hơn cho nhà phát triển. Bình thường, người dùng cuối không dùng trực tiếp mạng suy luận. Nhà phát triển cần triển khai mô hình riêng của họ, không chỉ giới hạn ở LLM, và có thể truy cập qua điểm cuối off-chain hoặc on-chain.

Mạng tác nhân và mạng suy luận không phải là hai sản phẩm hoàn toàn độc lập. Chúng ta đã bắt đầu thấy một số sản phẩm tích hợp dọc, vì hai chức năng này phụ thuộc vào cơ sở hạ tầng tương tự, nên đồng thời cung cấp cả khả năng tác nhân và suy luận.

6. Những cơ hội mới nổi

Ngoài suy luận mô hình, huấn luyện và mạng tác nhân, lĩnh vực web3 còn nhiều vùng đất mới đáng khám phá:

Tập dữ liệu: Làm sao biến dữ liệu blockchain thành tập dữ liệu dùng được cho học máy? Nhà phát triển học máy cần dữ liệu cụ thể và chuyên sâu hơn. Ví dụ, Giza cung cấp một số tập dữ liệu chất lượng cao về DeFi, dành riêng cho huấn luyện học máy. Dữ liệu lý tưởng không chỉ là bảng dữ liệu đơn giản mà còn bao gồm dữ liệu đồ thị mô tả tương tác trong thế giới blockchain. Hiện tại, chúng ta còn thiếu ở điểm này. Một số dự án đang giải quyết bằng cách thưởng cho cá nhân tạo tập dữ liệu mới, như Bagel và Sahara, hứa hẹn bảo vệ quyền riêng tư dữ liệu cá nhân.

Lưu trữ mô hình: Một số mô hình rất lớn, làm sao lưu trữ, phân phối và kiểm soát phiên bản là vấn đề then chốt, ảnh hưởng đến hiệu suất và chi phí học máy trên chuỗi. Trong lĩnh vực này, Filecoin, AR và 0g đã có tiến triển tiên phong.

Đào tạo mô hình: Đào tạo mô hình phân tán và có thể kiểm chứng là bài toán khó. Gensyn, Bittensor, Flock và Allora đã có tiến triển đáng kể.

Giám sát: Vì suy luận mô hình xảy ra cả on-chain và off-chain, chúng ta cần cơ sở hạ tầng mới để giúp nhà phát triển web3 theo dõi tình trạng sử dụng mô hình, kịp thời phát hiện sự cố và sai lệch. Với công cụ giám sát phù hợp, nhà phát triển học máy web3 có thể điều chỉnh kịp thời, liên tục tối ưu độ chính xác mô hình.

Cơ sở hạ tầng RAG: RAG phân tán cần môi trường cơ sở hạ tầng hoàn toàn mới, yêu cầu cao về lưu trữ, tính toán embedding và cơ sở dữ liệu vector, đồng thời đảm bảo bảo mật dữ liệu. Điều này khác xa cơ sở hạ tầng AI Web3 hiện tại, nơi phần lớn phụ thuộc vào bên thứ ba để thực hiện RAG, như Firstbatch và Bagel.

Mô hình tùy chỉnh cho Web3: Không phải mô hình nào cũng phù hợp với ngữ cảnh Web3. Trong nhiều trường hợp, cần huấn luyện lại mô hình để thích nghi với dự đoán giá, gợi ý, v.v. Cùng với sự phát triển mạnh mẽ của cơ sở hạ tầng AI, chúng tôi kỳ vọng trong tương lai sẽ có nhiều mô hình bản địa Web3 hơn phục vụ ứng dụng AI. Ví dụ Pond đang phát triển GNN blockchain cho nhiều trường hợp như dự đoán giá, gợi ý, phát hiện gian lận và chống rửa tiền.

Mạng đánh giá: Đánh giá tác nhân khi thiếu phản hồi con người là không dễ. Khi công cụ tạo tác nhân phổ biến, thị trường sẽ xuất hiện vô số tác nhân. Khi đó cần một hệ thống để thể hiện năng lực các tác nhân, giúp người dùng xác định tác nhân nào hoạt động tốt nhất trong từng tình huống cụ thể. Ví dụ, Neuronets là một đơn vị tham gia lĩnh vực này.

Cơ chế đồng thuận: Với nhiệm vụ AI, PoS chưa chắc là lựa chọn tối ưu. Độ phức tạp tính toán, khó khăn trong xác minh và thiếu tính xác định là những thách thức chính PoS đối mặt. Bittensor đã tạo ra một cơ chế đồng thuận trí tuệ mới, thưởng cho các nút đóng góp vào mô hình học máy và đầu ra trong mạng.

7. Triển vọng tương lai

Hiện tại chúng tôi đang quan sát xu hướng tích hợp dọc. Bằng cách xây dựng một lớp tính toán cơ bản, mạng lưới có thể hỗ trợ nhiều tác vụ học máy khác nhau, bao gồm huấn luyện, suy luận và dịch vụ mạng tác nhân. Mô hình này hướng tới việc cung cấp giải pháp trọn gói cho nhà phát triển học máy Web3.

Hiện tại, dù suy luận trên chuỗi tốn kém và chậm, nó lại cung cấp khả năng kiểm chứng tuyệt vời và tích hợp liền mạch với hệ thống backend (như hợp đồng thông minh). Tôi tin rằng tương lai sẽ là mô hình lai ghép. Một phần xử lý suy luận diễn ra ở frontend hoặc off-chain, trong khi các suy luận then chốt, mang tính quyết định sẽ được thực hiện trên chuỗi. Mô hình này đã được áp dụng trên thiết bị di động. Bằng cách tận dụng đặc điểm thiết bị di động, nó có thể chạy nhanh các mô hình nhỏ tại chỗ, đồng thời chuyển các tác vụ phức tạp hơn lên đám mây, sử dụng các mô hình LLM lớn hơn để xử lý.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News