Thắp sáng tia lửa blockchain: LLM mở ra khả năng tương tác mới với blockchain

Tuyển chọn TechFlowTuyển chọn TechFlow

Thắp sáng tia lửa blockchain: LLM mở ra khả năng tương tác mới với blockchain

Khó có thể sử dụng blockchain và bằng chứng không kiến thức để cung cấp năng lực tính toán quy mô lớn cho việc huấn luyện và suy luận các mô hình phức tạp, do đó kết hợp LLM với blockchain là cách hợp lý hơn.

Tác giả: Yiping, IOSG Ventures

Chào mừng bạn đến với bài viết thứ hai trong chuỗi nghiên cứu của chúng tôi về mô hình ngôn ngữ lớn (LLM) và công nghệ blockchain. Trong bài viết trước, chúng tôi đã thảo luận ở cấp độ kỹ thuật về cách tích hợp LLM với công nghệ blockchain, cũng như lý do tại sao khung LLM đặc biệt phù hợp với lĩnh vực blockchain. Chúng tôi cũng đã phác họa các hướng tiềm năng cho việc kết hợp LLM và blockchain trong tương lai.

Trong bài viết này, chúng tôi sẽ tiếp cận theo hướng thực tiễn hơn, đi sâu vào tám lĩnh vực ứng dụng cụ thể mà chúng tôi tin rằng sẽ làm thay đổi đáng kể trải nghiệm người dùng trên blockchain. Điều thú vị hơn nữa là chúng tôi dự đoán những ứng dụng đột phá này sẽ trở thành hiện thực trong vòng một năm tới.

Hãy cùng chúng tôi khám phá tương lai của tương tác blockchain. Dưới đây là phần giới thiệu ngắn gọn về tám ứng dụng mà chúng tôi sẽ thảo luận:

1. Tích hợp AI/LLM nội tại vào blockchain

2. Sử dụng LLM để phân tích giao dịch

3. Sử dụng LLM tăng cường bảo mật

4. Sử dụng LLM viết mã

5. Sử dụng LLM đọc mã

6. Sử dụng LLM hỗ trợ cộng đồng

7. Sử dụng LLM theo dõi thị trường

8. Sử dụng LLM phân tích dự án

Tích hợp AI/LLM nội tại vào blockchain

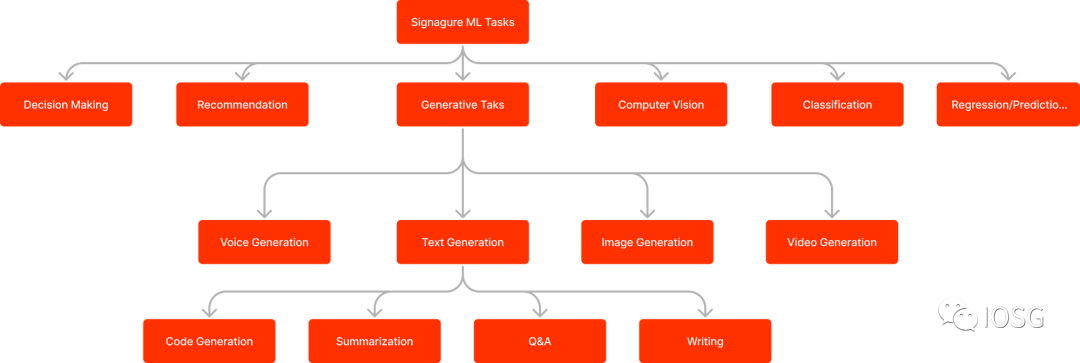

Blockchain sẽ tích hợp sẵn các chức năng và mô hình trí tuệ nhân tạo (AI). Các nhà phát triển có thể truy cập các hàm AI để thực hiện các nhiệm vụ học máy tiêu biểu như phân loại, hồi quy, hoàn thiện văn bản và AIGC ngay trên chuỗi. Các chức năng AI này có thể được gọi thông qua hợp đồng thông minh.

Với các chức năng nội tại này, các nhà phát triển có thể trao cho hợp đồng thông minh khả năng thông minh và tự chủ. Phân loại, hồi quy và AIGC là các nhiệm vụ AI điển hình. Hãy cùng xem xét các ứng dụng của các chức năng này trong lĩnh vực blockchain và một vài ví dụ dự án.

Phân loại

Phân loại có thể được sử dụng để xác định một địa chỉ là bot hay con người thật. Điều này có thể thay đổi hoàn toàn tình trạng bán NFT hiện nay. Phân loại cũng có thể nâng cao an ninh hệ sinh thái DeFi. Hợp đồng thông minh DeFi có thể lọc các giao dịch độc hại, ngăn chặn thất thoát tài sản.

Hồi quy (Regression)

Phân tích hồi quy có thể được sử dụng cho dự báo, áp dụng trong quản lý quỹ và tài sản. Numer.ai đã sử dụng AI để hỗ trợ quản lý quỹ của họ. Numer cung cấp dữ liệu chứng khoán chất lượng cao, nơi các nhà khoa học dữ liệu làm việc và áp dụng học máy để dự đoán thị trường chứng khoán.

AIGC

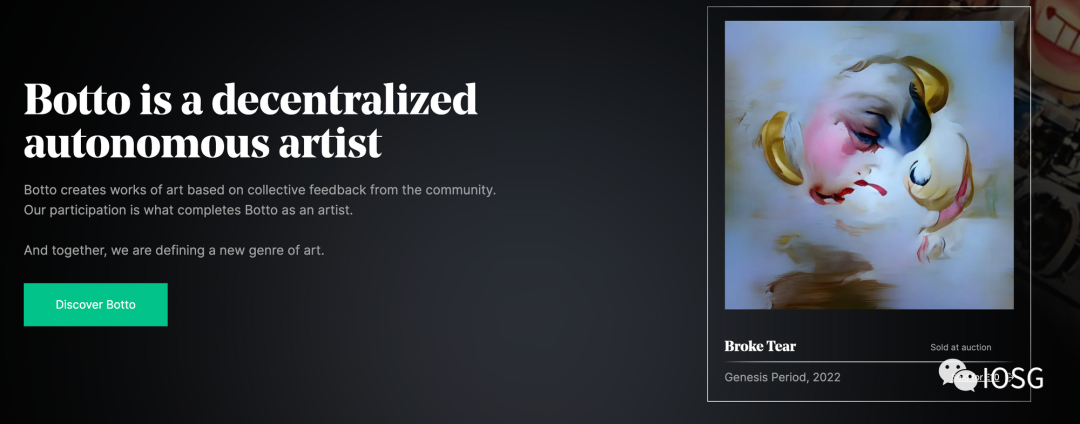

Nhiều dự án NFT đang cố gắng xây dựng một vũ trụ IP. Tuy nhiên, nội dung hạn chế của họ không đủ để duy trì một vũ trụ. Nếu chúng ta có thể sử dụng AIGC trên chuỗi để xuất ra vô số nội dung mang phong cách thương hiệu đặc trưng với chi phí tương đối thấp thì sao? Mô hình có thể xuất ra văn bản, minh họa, âm nhạc, giọng nói thậm chí cả video. Điều này mở rộng đáng kể quy mô của vũ trụ IP. Người tham gia cộng đồng có thể cùng nhau tinh chỉnh mô hình để đáp ứng mong đợi của họ. Quá trình tinh chỉnh cũng tạo cảm giác tham gia cho cộng đồng.

Botto sử dụng mô hình AIGC để tạo nội dung nghệ thuật. Cộng đồng bỏ phiếu cho hình ảnh yêu thích nhất, từ đó cùng nhau tinh chỉnh mô hình AIGC.

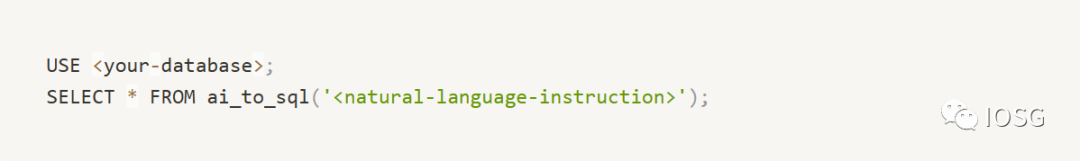

Nếu coi blockchain như một cơ sở dữ liệu, chúng ta cũng thấy Databend đang tích hợp các chức năng AI nội tại vào cơ sở dữ liệu của họ. Họ cung cấp các chức năng sau:

-

ai_embedding_vector: Tạo vector nhúng cho tài liệu văn bản.

-

ai_text_completion: Tạo văn bản hoàn chỉnh dựa trên gợi ý cho trước.

-

cosine_distance: Tính khoảng cách cosin giữa hai vector nhúng.

-

ai_to_sql: Chuyển đổi lệnh ngôn ngữ tự nhiên thành truy vấn SQL.

Cung cấp năng lực AI cho blockchain

Chúng ta biết rằng một số dự án đang cung cấp chức năng AI cho blockchain.

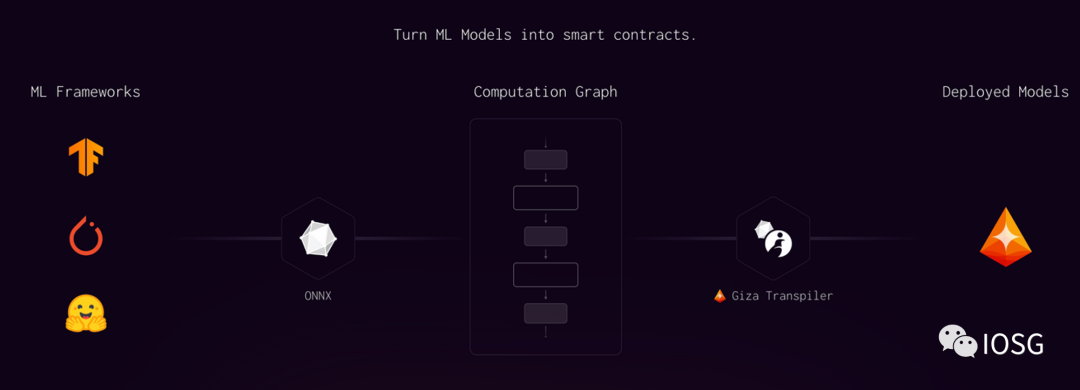

Giza đang tập trung vào ZKML. Dự án này tạo bằng chứng suy luận bên ngoài chuỗi và xác minh trên chuỗi. Hiện tại, Giza hỗ trợ các blockchain tương thích với Máy ảo Ethereum (EVM) và StarkNet. Gần đây, Giza đã công bố hợp tác với Yearn.finance, trong đó Yearn sẽ tận dụng chức năng AI của Giza để nâng cao khả năng đánh giá rủi ro.

Modulus Labs cũng đang hoạt động theo hướng tương tự. Họ đang nỗ lực cải tiến hệ thống bằng chứng nhằm tạo ra các mạch hiệu suất cao dành cho AI. Họ đã công bố các bản demo như AI cờ vua và AI dự đoán giá Ethereum. Dự án demo mới nhất zkMon của họ là bộ sưu tập NFT mạng đối kháng tạo sinh đầu tiên trên thế giới được chứng minh bằng kiến thức không tiết lộ (zero-knowledge).

Sử dụng LLM phân tích giao dịch

Việc phân tích giao dịch thường do các ứng dụng chuyên biệt thực hiện (ví dụ như Debank). Phân tích thủ công rất khó khăn, bao gồm thu thập dữ liệu, làm sạch dữ liệu và phân tích — đòi hỏi người dùng phải có kỹ năng lập trình. Với khả năng phân tích và trực quan hóa dữ liệu của LLM, chúng ta hiện có một phương pháp mới. Nhờ LLM, chúng ta có thể phân tích dữ liệu trên chuỗi theo nhu cầu tùy chỉnh. Chúng ta có thể phân tích tỷ lệ thắng, hiệu suất, hoặc bất kỳ thông tin nào khác mà chúng ta muốn biết.

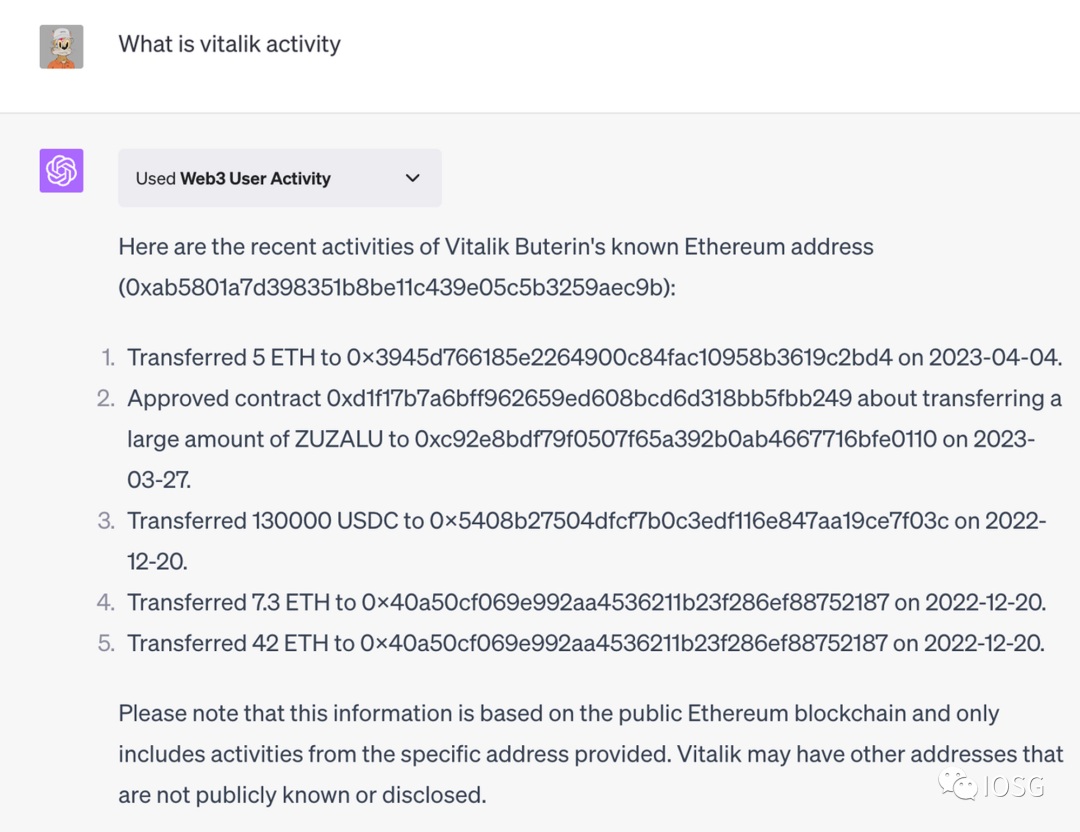

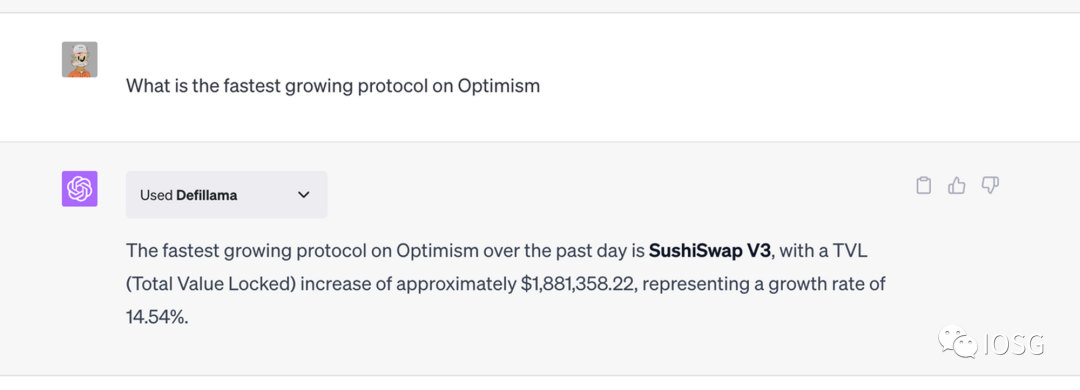

RSS3 đã phát triển một plugin ChatGPT có tên "Web3 User Activity", hướng tới mục tiêu này. Người dùng có thể nhập địa chỉ ví, ENS hoặc Lens để truy vấn hoạt động trên chuỗi. Plugin sẽ xuất thông tin giao dịch dưới dạng dễ đọc. Tuy nhiên, đáng tiếc là nó chưa thể thực hiện các truy vấn phức tạp như: có bao nhiêu người nắm giữ Azuki, hợp đồng thông minh nào phổ biến nhất, v.v. Người dùng cũng cần lưu ý rằng địa chỉ và nhãn do plugin cung cấp không nhất thiết chính xác.

DeFiLlama cũng đã phát hành một plugin ChatGPT. Người dùng có thể truy vấn mọi dữ liệu có sẵn trên DeFiLlama bằng ngôn ngữ tự nhiên. Nó cũng có thể thực hiện các thao tác lọc và sắp xếp đơn giản:

Dune cũng đang tích hợp GPT vào sản phẩm của mình để đạt được các chức năng sau:

-

Diễn giải truy vấn: Sử dụng LLM để giải thích truy vấn

-

Dịch truy vấn: Sử dụng LLM để dịch từ các ngôn ngữ SQL khác sang DuneSQL

-

Truy vấn ngôn ngữ tự nhiên: Cho phép người dùng viết truy vấn bằng ngôn ngữ tự nhiên

-

Tìm kiếm: Sử dụng LLM để cải thiện kết quả tìm kiếm

-

Cơ sở tri thức trợ lý: Trò chuyện với tài liệu hướng dẫn

Sử dụng LLM tăng cường bảo mật

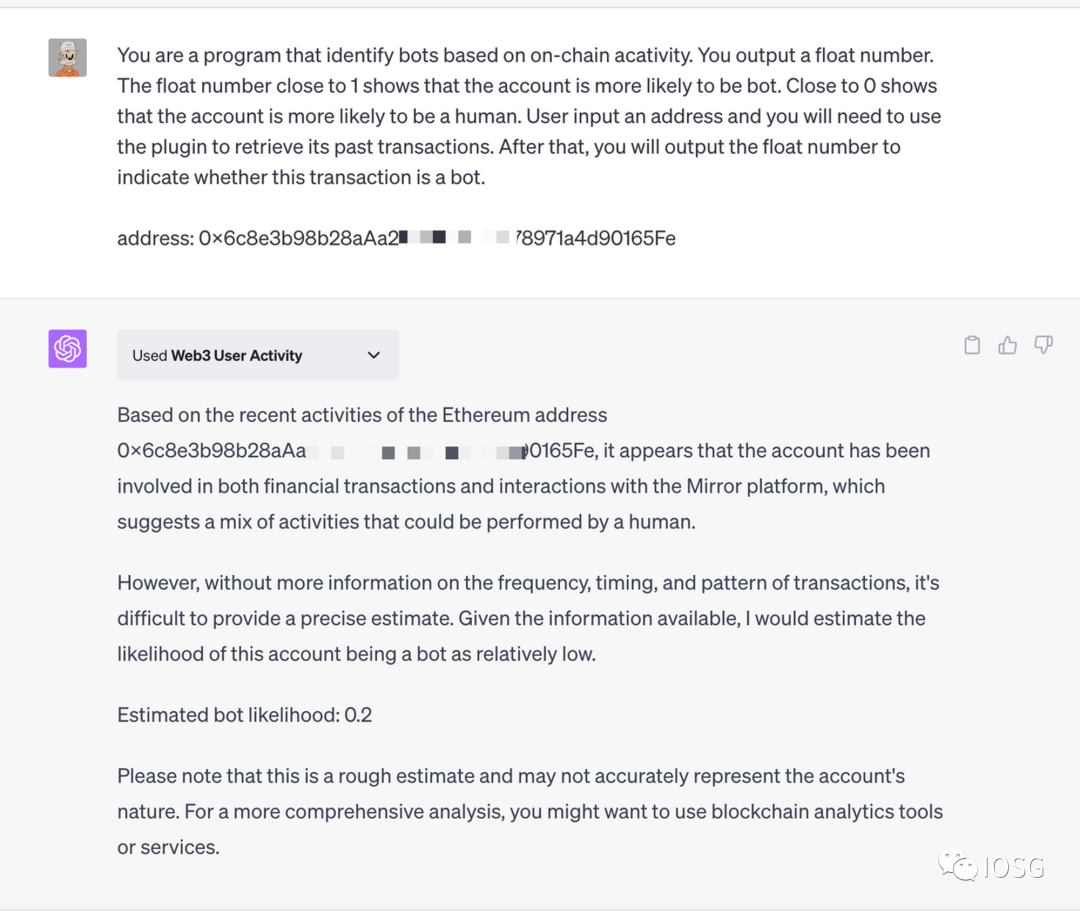

Nhờ khả năng suy luận logic, LLM có thể được dùng để lọc các giao dịch độc hại, đóng vai trò như tường lửa cho hợp đồng thông minh. Dưới đây là một ví dụ cụ thể về cách ngăn chặn hoạt động bot:

Sau khi nhập địa chỉ, LLM có thể lấy tất cả dữ liệu giao dịch thông qua plugin bên thứ ba, phân tích các giao dịch này và ước tính xác suất địa chỉ là bot. Chức năng này có thể được tích hợp vào các dApp không chào đón bot, ví dụ như bán NFT.

Dưới đây là một ví dụ đơn giản với ChatGPT. ChatGPT sử dụng plugin Web3 User Activity do RSS3 phát triển để truy xuất lịch sử giao dịch của tài khoản, sau đó phân tích và đưa ra đánh giá về khả năng tài khoản là bot.

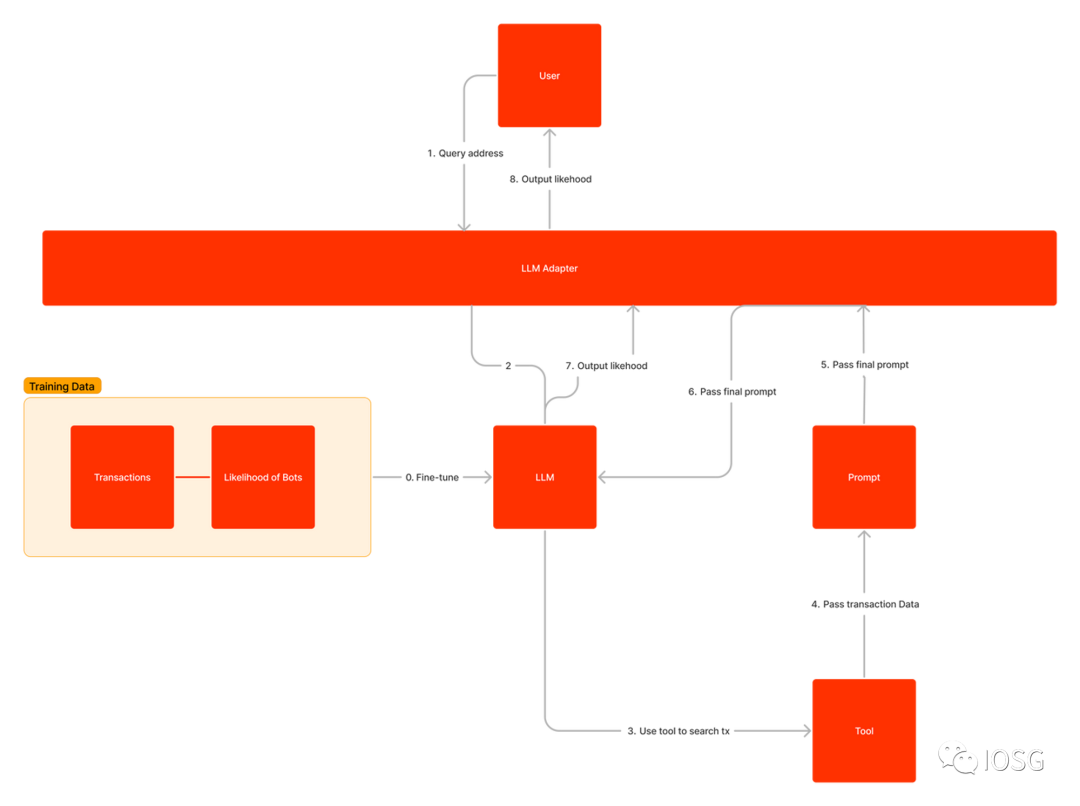

Nếu chúng ta cung cấp thêm dữ liệu giao dịch và tinh chỉnh LLM trên tập dữ liệu liên quan đến bot, chúng ta có thể đạt được kết quả chính xác hơn. Dưới đây là luồng làm việc mẫu cho loại ứng dụng này. Chúng ta cũng có thể thêm lớp bộ nhớ đệm và cơ sở dữ liệu để tăng tốc độ phản hồi và giảm chi phí.

Sử dụng LLM viết mã

LLM được sử dụng rộng rãi trong phát triển phần mềm để giúp lập trình viên viết mã nhanh hơn và tốt hơn. Theo chỉ dẫn của lập trình viên, LLM có thể sinh mã thay họ. Hiện tại, lập trình viên vẫn cần cung cấp hướng dẫn chi tiết. Rất khó để LLM tự động sinh toàn bộ mã dự án.

Một số mô hình LLM phổ biến dùng cho lập trình bao gồm StarCoder, StarCoder+, Code T5, LTM, DIDACT, WizardCoder, FalCoder-7B và MPT30B.

Tất cả các mô hình này đều có thể dùng để viết hợp đồng thông minh, nhưng có thể chưa được huấn luyện chuyên biệt trên dữ liệu hợp đồng thông minh. Vẫn còn không gian cải thiện.

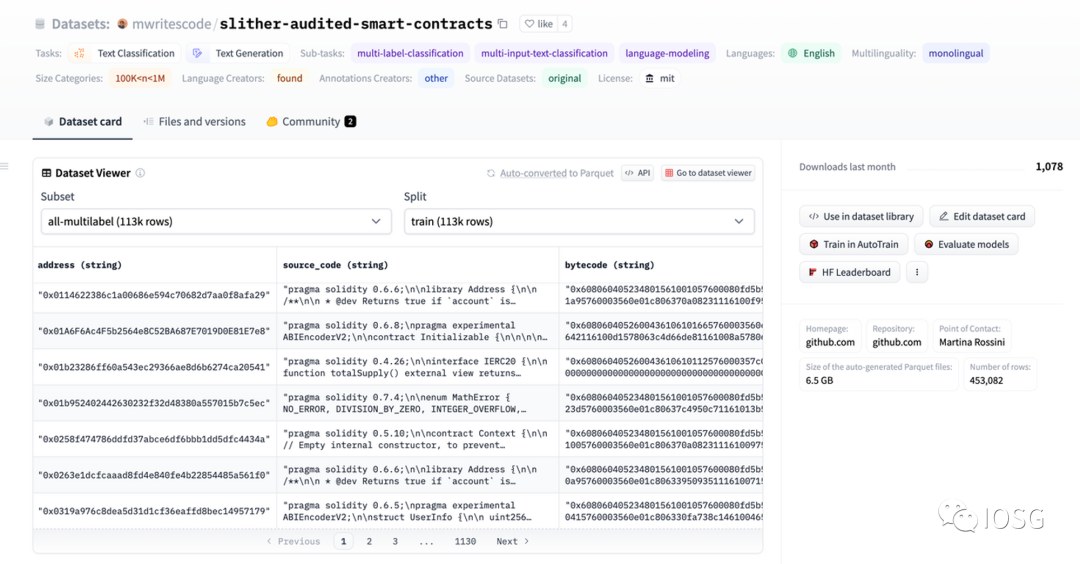

Hiện tại, trên HuggingFace chỉ có một tập dữ liệu liên quan đến hợp đồng thông minh. Đó là tập hợp các hợp đồng thông minh bị kiểm toán nhiều hơn, chứa 113.000 hợp đồng thông minh. Tập dữ liệu này có thể dùng cho các nhiệm vụ như phân loại văn bản, sinh văn bản và phát hiện lỗ hổng.

So với các công cụ hỗ trợ phát triển, tự động sinh mã có tiềm năng hơn. Sinh mã tự động phù hợp với hợp đồng thông minh vì chúng tương đối ngắn và đơn giản. LLM có thể hỗ trợ lập trình viên tự động sinh mã theo nhiều cách trong lĩnh vực blockchain.

Thử nghiệm

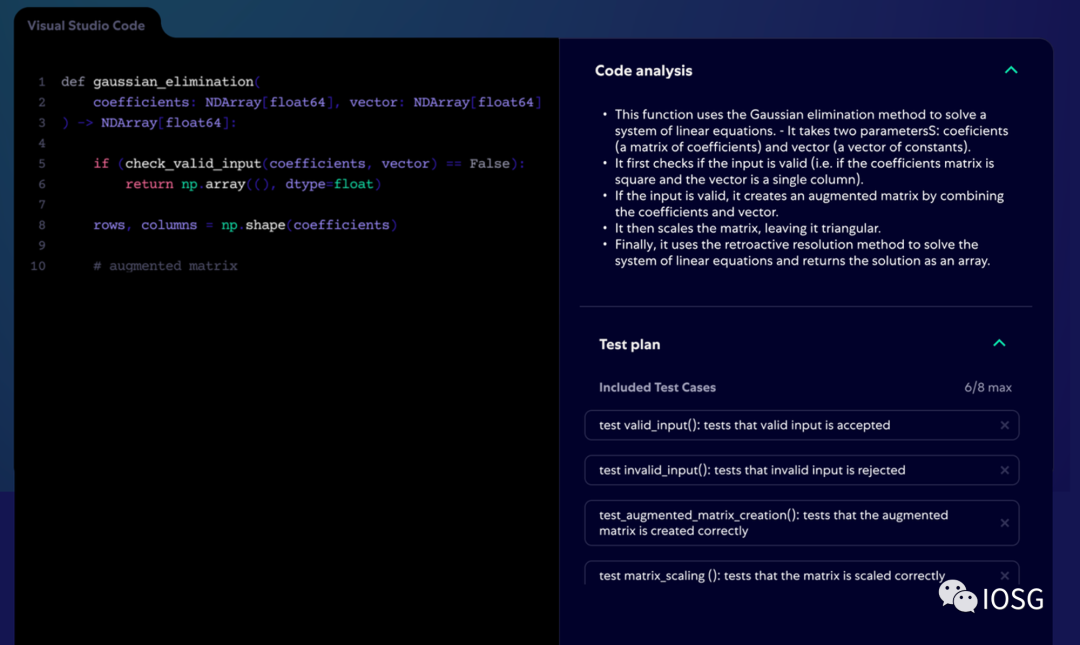

Đầu tiên, LLM có thể sinh thử nghiệm cho các hợp đồng thông minh đã được viết tốt. Codium có thể tự động sinh thử nghiệm cho dự án đã viết. Codium hiện hỗ trợ JS và TS. Codium đầu tiên hiểu cơ sở mã, phân tích từng hàm, chuỗi tài liệu và chú thích. Sau đó, Codium ghi lại phân tích mã dưới dạng chú thích vào tệp và xuất kế hoạch thử nghiệm. Người dùng có thể chọn các thử nghiệm yêu thích, Codium sẽ sinh mã thử nghiệm tương ứng.

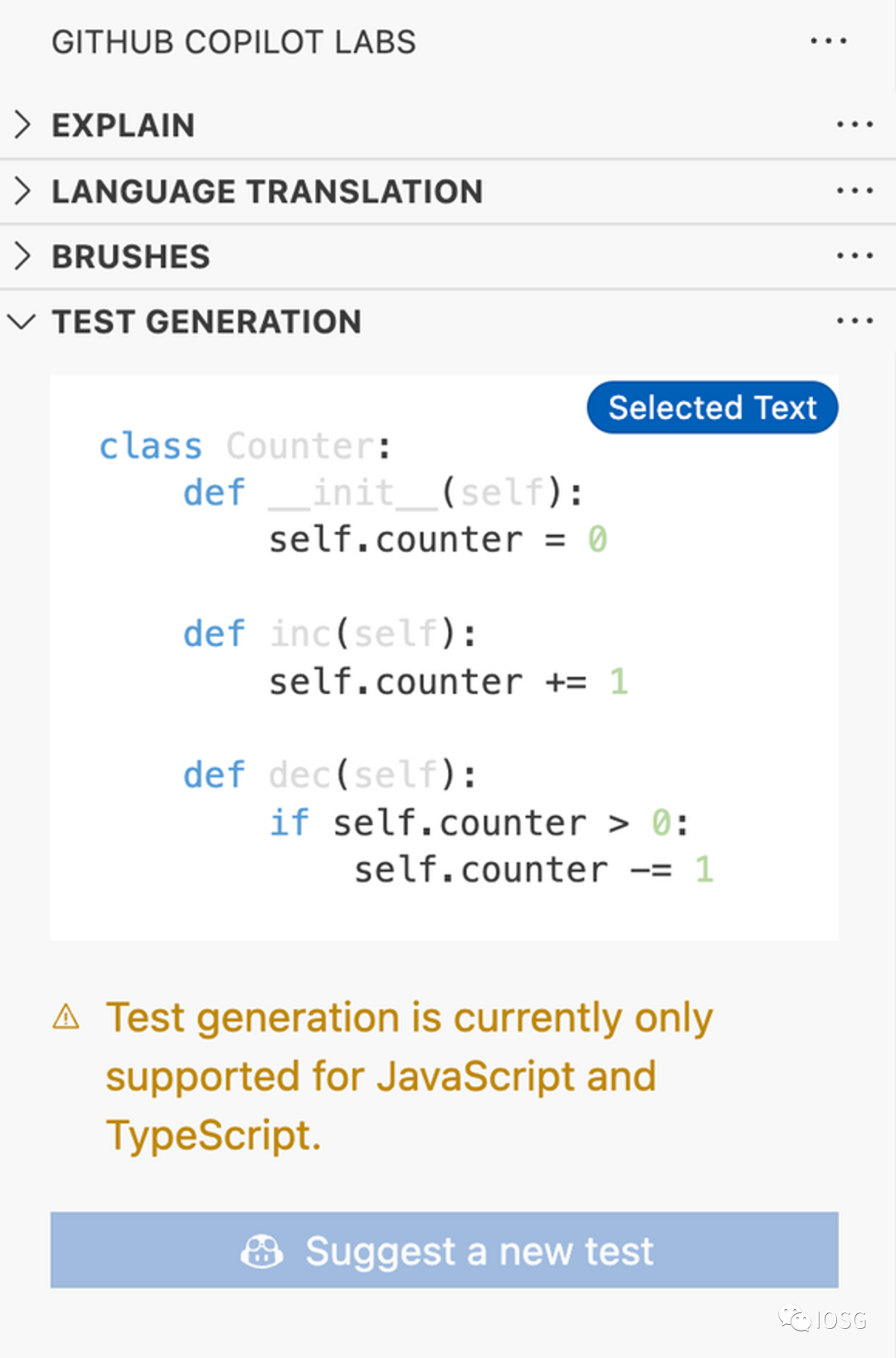

Các công cụ hỗ trợ khác cũng hỗ trợ sinh thử nghiệm cho các chức năng đã chọn.

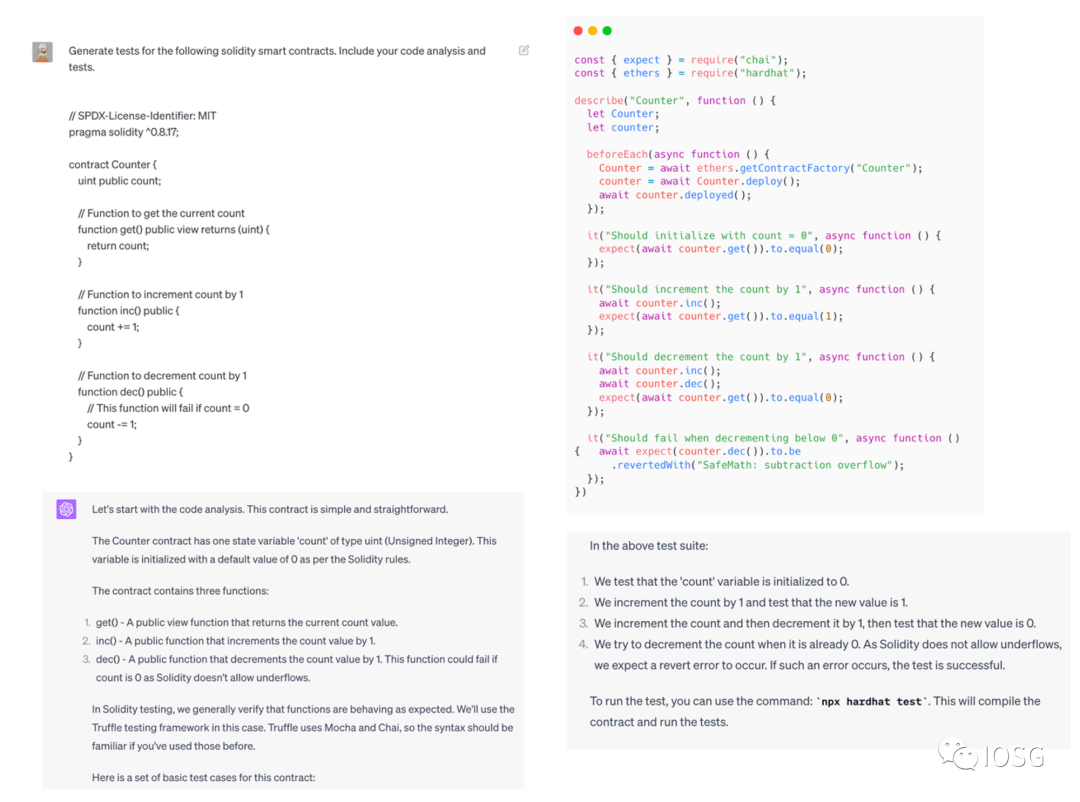

Chúng ta có thể sao chép chức năng tương tự trên GPT-4.

Chúng tôi yêu cầu phân tích mã trước vì muốn LLM dành nhiều thời gian hơn cho nhiệm vụ này. LLM không biết nhiệm vụ nào khó. Nó dành cùng mức độ tính toán cho mỗi token. Điều này có thể dẫn đến kết quả không chính xác trên các nhiệm vụ phức tạp. Vì đặc điểm này, chúng tôi yêu cầu phân tích mã. Như vậy, LLM sẽ dành nhiều token/thời gian hơn để suy nghĩ, từ đó cho kết quả chất lượng cao hơn. Phương pháp này còn được gọi là "chuỗi suy nghĩ" (chain-of-thought).

Để áp dụng cho các hợp đồng thông minh dài hơn, chúng ta cần LLM có khả năng xử lý ngữ cảnh dài hơn, hoặc thiết kế kỹ thuật để duy trì bộ nhớ.

Sinh script phụ trợ

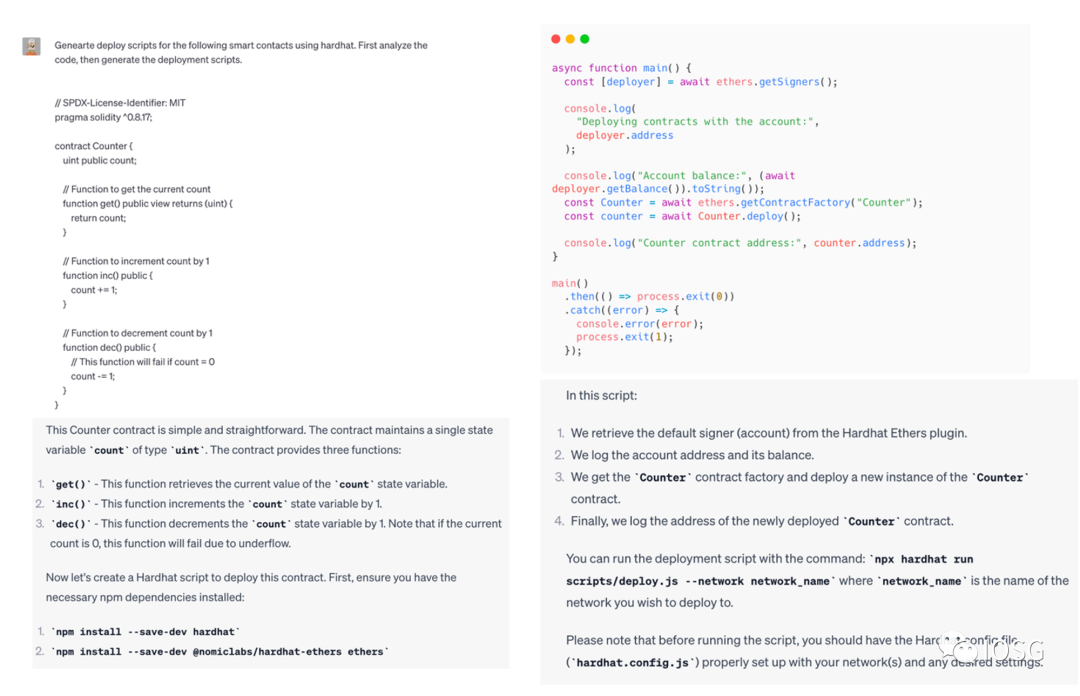

Thứ hai, chúng ta có thể dùng LLM tự động sinh các script phụ trợ như script triển khai.

Script triển khai có thể giảm lỗi tiềm ẩn trong quá trình triển khai thủ công. Ý tưởng này rất giống với việc tự động sinh thử nghiệm.

Tự động fork

Trong thời kỳ thị trường tăng giá, nhiều dự án fork sẽ xuất hiện, đội ngũ phát triển chỉ thay đổi một chút mã nguồn gốc. Đây sẽ là một trường hợp sử dụng tuyệt vời cho LLM: LLM có thể giúp lập trình viên tự động sửa đổi mã theo nhu cầu. Thường chỉ cần thay đổi một phần mã cụ thể, điều này tương đối dễ dàng với LLM.

Tự động sinh mã

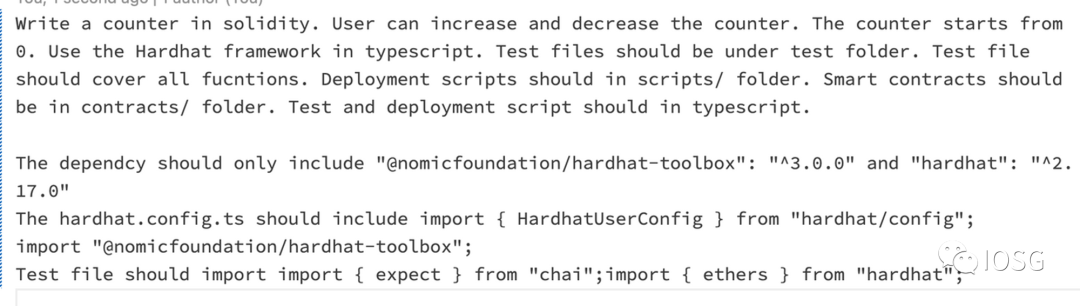

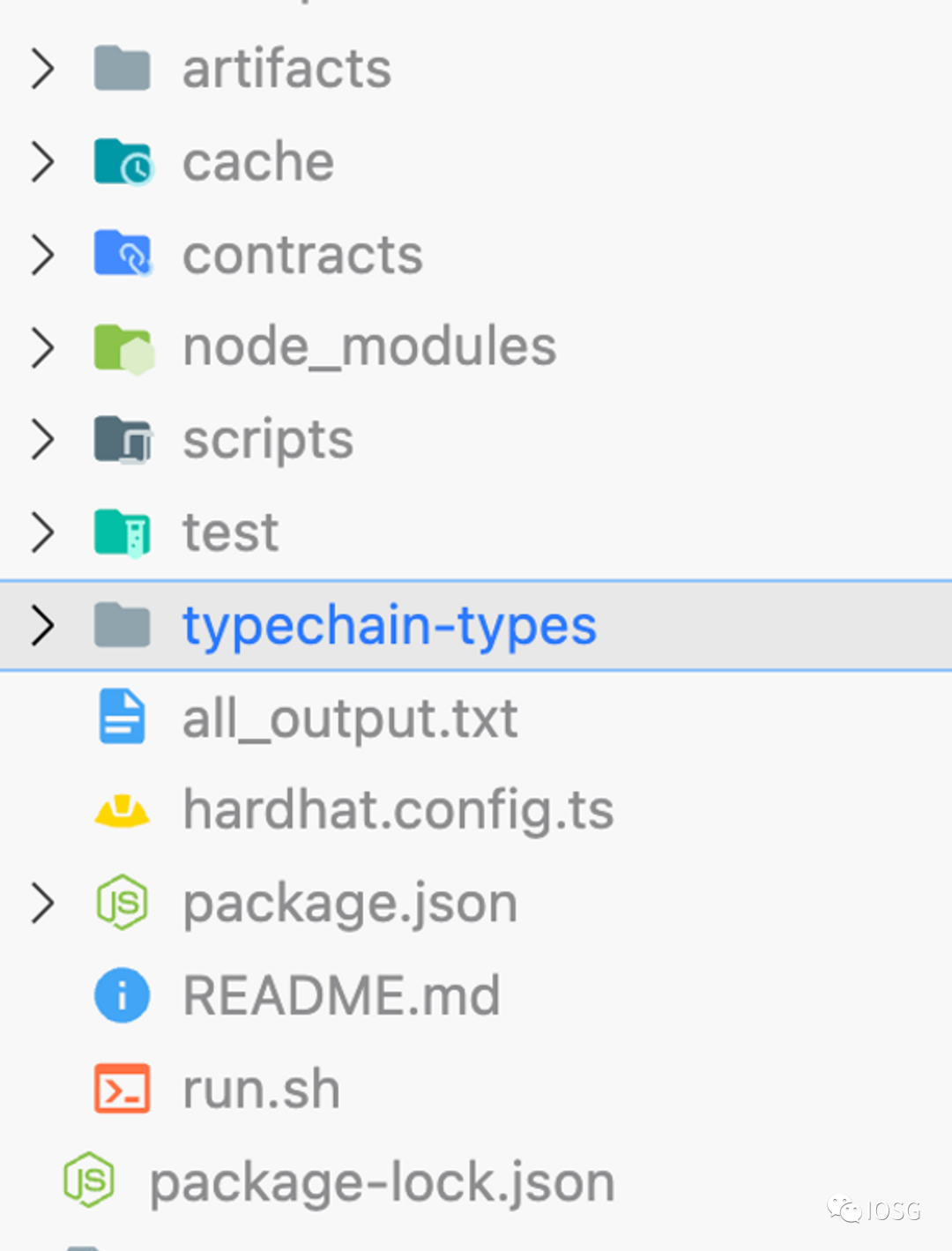

Nếu tiến xa hơn nữa, liệu LLM có thể tự động sinh hợp đồng thông minh theo yêu cầu của lập trình viên? So với các phần mềm phức tạp viết bằng JS, Rust và Python, hợp đồng thông minh tương đối ngắn và đơn giản. Hợp đồng thông minh không dùng nhiều thư viện bên ngoài. Vì vậy, **đối với LLM, việc hiểu cách viết hợp đồng thông minh tương đối dễ hơn.

Chúng ta đã thấy một số tiến triển trong việc tự động sinh mã. GPT-engineer là một trong những tiên phong. Nó sẽ thỏa mãn nhu cầu người dùng, đặt câu hỏi nếu cần làm rõ, rồi bắt đầu viết mã. Mã cũng bao gồm script chạy toàn bộ dự án. GPT-engineer có thể tự động khởi động dự án cho lập trình viên.

Sau khi người dùng nhập yêu cầu, GPT-engineer sẽ phân tích và yêu cầu làm rõ nếu cần. Sau khi thu thập đủ thông tin, GPT-engineer sẽ xuất thiết kế chương trình trước, bao gồm các lớp, hàm và phương pháp cốt lõi cần thiết cho nhiệm vụ. Sau đó, GPT-engineer sẽ sinh mã cho từng tệp.

Với lời nhắc tương tự như vậy, chúng ta có thể sinh một hợp đồng thông minh đếm số.

Hợp đồng thông minh có thể biên dịch và hoạt động như mong đợi.

Do GPT-engineer ban đầu được thiết kế cho Python, nên có một số vấn đề khi sinh mã liên quan đến Hardhat. GPT-engineer không biết phiên bản Hardhat mới nhất, đôi khi sinh ra script thử nghiệm và triển khai lỗi thời.

Nếu mã của chúng ta có lỗi, chúng ta có thể cung cấp cơ sở mã và nhật ký lỗi điều khiển cho LLM. LLM có thể liên tục sửa mã cho đến khi mã chạy thành công. Chúng ta đã thấy các dự án như **[flo](https://flocli.vercel.app/)** đang phát triển theo hướng này. Hiện tại, flo chỉ hỗ trợ JS.

Nếu muốn nâng cao độ chính xác khi sinh hợp đồng thông minh, chúng ta có thể cải tiến GPT-engineer bằng các lời nhắc mới. Chúng ta có thể áp dụng phương pháp phát triển dựa trên thử nghiệm (test-driven development), yêu cầu LLM đảm bảo chương trình vượt qua các thử nghiệm nhất định, từ đó ràng buộc tốt hơn chương trình được sinh ra.

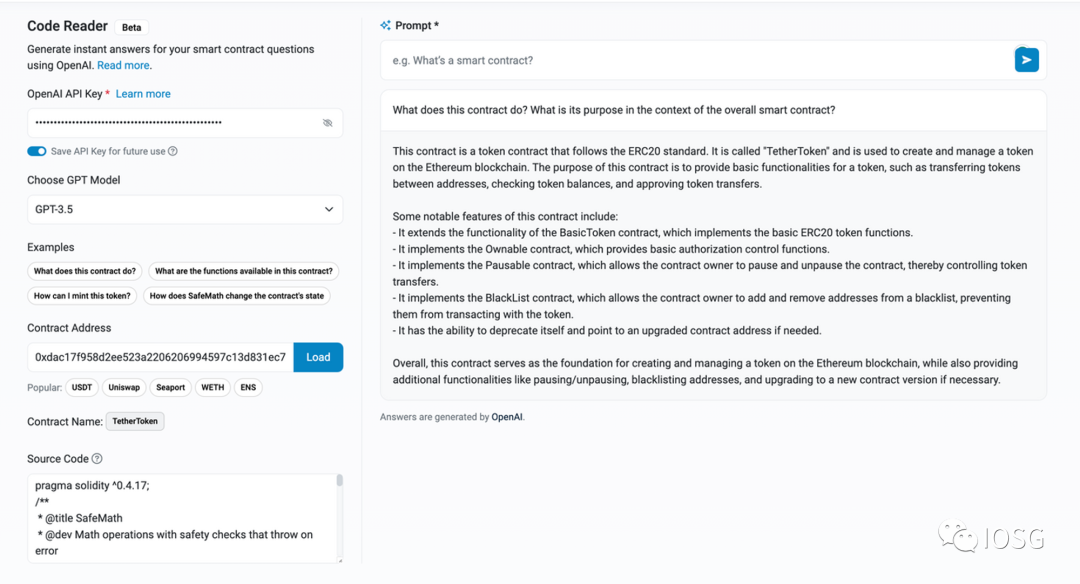

Sử dụng LLM đọc mã

Do LLM có khả năng hiểu mã tốt, chúng ta có thể dùng LLM để viết tài liệu dành cho nhà phát triển. LLM cũng có thể theo dõi thay đổi mã để cập nhật tài liệu. Chúng tôi đã thảo luận phương pháp này ở cuối báo cáo nghiên cứu trước "Exploring Developer Experience on ZKRUs: An In-Depth Analysis".

Đọc tài liệu là cách truyền thống, còn giao tiếp với mã là phương pháp mới. Người dùng có thể đặt bất kỳ câu hỏi nào về mã, LLM sẽ trả lời. LLM có thể giải thích mã cho lập trình viên, giúp họ nhanh chóng hiểu hợp đồng thông minh trên chuỗi. LLM cũng có thể giúp người không có kinh nghiệm lập trình hiểu hợp đồng thông minh.

Chúng ta đã thấy xu hướng này trong thế giới Web2. Nhiều công cụ hỗ trợ mã hiện nay có chức năng giải thích mã.

Etherscan cũng đã trình diễn tính năng mới, cho phép người dùng giao tiếp với mã, tận dụng sức mạnh của LLM.

Khi có thể hiểu mã, việc kiểm toán sẽ thay đổi ra sao? Trong thí nghiệm của bài báo "do you still need a manual smart contract audit", LLM đạt tỷ lệ phát hiện lỗ hổng 40%, vượt xa ngẫu nhiên. Tuy nhiên, tỷ lệ cảnh báo sai cũng rất cao. Tác giả chỉ ra rằng lời nhắc phù hợp là then chốt.

Ngoài lời nhắc, còn các lý do khác hạn chế ứng dụng:

-

LLM hiện tại chưa được huấn luyện chuyên biệt cho mục đích này. Dữ liệu huấn luyện có thể chưa bao gồm cơ sở mã hợp đồng thông minh và báo cáo kiểm toán tương ứng.

-

Thông thường các lỗ hổng nghiêm trọng nhất là vấn đề logic do sự kết hợp giữa các chức năng khác nhau. LLM hiện bị giới hạn bởi số lượng token. LLM không thể giải quyết các vấn đề có ngữ cảnh dài và đòi hỏi khả năng suy luận logic.

Những vấn đề này không khó giải quyết. Các công ty kiểm toán lớn sở hữu hàng ngàn báo cáo kiểm toán, có thể dùng để tinh chỉnh LLM. Các LLM với giới hạn token lớn đang xuất hiện. Claude có giới hạn 100.000 token. LTM-1 mới phát hành có giới hạn ấn tượng lên tới 5 triệu token. Với những nỗ lực giải quyết hai vấn đề này, chúng ta có thể thấy LLM sẽ ngày càng giỏi hơn trong việc phát hiện lỗ hổng. LLM có thể hỗ trợ kiểm toán viên và đẩy nhanh quy trình kiểm toán. Điều này có thể phát triển từng bước. Dưới đây là lộ trình phát triển có thể xảy ra:

1. Giúp kiểm toán viên tổ chức ngôn ngữ và định dạng báo cáo. Đảm bảo tính nhất quán ngôn ngữ trong cùng một công ty kiểm toán. Các nhóm khác nhau thường có sở thích từ vựng khác nhau.

2. Giúp kiểm toán viên nhận diện và xác minh các lỗ hổng tiềm năng.

3. Tự động sinh bản thảo báo cáo kiểm toán.

Sử dụng LLM hỗ trợ cộng đồng

Quản trị là phần cốt lõi của cộng đồng. Thành viên cộng đồng có quyền bỏ phiếu cho các đề xuất họ yêu thích. Những đề xuất này sẽ định hình tương lai sản phẩm.

Đối với các đề xuất quan trọng, sẽ có nhiều thông tin nền và thảo luận cộng đồng. Trước khi bỏ phiếu, rất khó để thành viên cộng đồng hiểu hết bối cảnh. LLM có thể giúp thành viên cộng đồng nhanh chóng hiểu lựa chọn của họ ảnh hưởng thế nào đến tương lai, và hỗ trợ họ bỏ phiếu.

Robot hỏi đáp là một ứng dụng tiềm năng khác. Chúng ta đã thấy các robot hỏi đáp dựa trên tài liệu dự án. Chúng ta có thể đi xa hơn bằng cách xây dựng cơ sở tri thức lớn hơn. Chúng ta có thể tích hợp nhiều phương tiện và nguồn khác nhau như bản trình bày, podcast, GitHub, chat Discord và Twitter Space. Robot hỏi đáp không chỉ tồn tại trong thanh tìm kiếm tài liệu mà còn có thể hỗ trợ tức thì cho thành viên cộng đồng trên Discord, hoặc lan tỏa tầm nhìn dự án và trả lời mọi câu hỏi trên Twitter.

AwesomeQA hiện đang phát triển theo hướng này. Dự án thực hiện ba chức năng:

-

Sử dụng tích hợp ChatGPT để trả lời câu hỏi của thành viên cộng đồng

-

Thu được thông tin chi tiết định hướng dữ liệu từ tin nhắn thành viên cộng đồng, ví dụ như phân tích FAQ

-

Phát hiện tin nhắn nào quan trọng, ví dụ như các vấn đề chưa được giải quyết

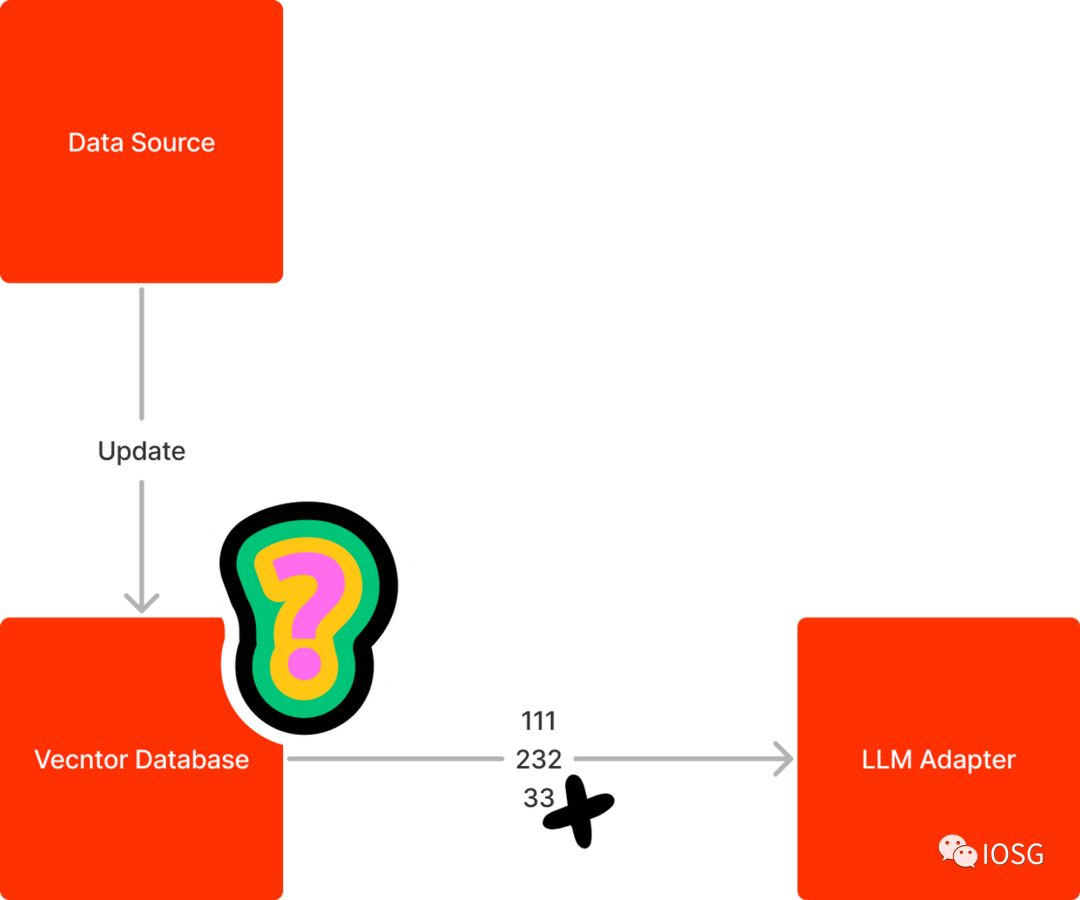

Một trong những khó khăn hiện tại của robot hỏi đáp là làm sao lấy chính xác ngữ cảnh liên quan từ cơ sở dữ liệu vector và cung cấp cho LLM. Ví dụ, nếu người dùng yêu cầu truy vấn nhiều yếu tố với nhiều đặc trưng kèm điều kiện lọc, robot có thể không truy xuất được ngữ cảnh liên quan từ cơ sở dữ liệu vector.

Cập nhật cơ sở dữ liệu vector là vấn đề khác. Giải pháp hiện tại là xây dựng lại cơ sở dữ liệu vector hoặc cập nhật theo không gian tên (namespace). Việc thêm namespace vào embedding giống như gắn nhãn vào dữ liệu. Điều này giúp lập trình viên dễ dàng tìm và cập nhật embedding tương ứng.

Sử dụng LLM theo dõi thị trường

Thị trường thay đổi rất nhanh, mỗi ngày có nhiều việc xảy ra. Ví dụ, KOL (người có ảnh hưởng) đăng ý tưởng và suy nghĩ mới, bản tin và email sản phẩm tràn ngập hộp thư của bạn. LLM có thể chọn cho bạn những ý tưởng và tin tức quan trọng nhất. Nó cũng có thể tóm tắt nội dung để rút ngắn thời gian đọc và giúp bạn theo kịp diễn biến thị trường.

minmax.ai tập trung vào lĩnh vực tin tức. Họ cung cấp bản tóm tắt tin tức mới nhất theo chủ đề cụ thể, cũng như phân tích cảm xúc về chủ đề đó.

Boring reports loại bỏ nội dung giật gân khỏi tin tức, tập trung vào chi tiết quan trọng, giúp người đọc đưa ra quyết định đúng đắn.

Tư vấn robot là một trong những lĩnh vực nóng nhất hiện nay. LLM có thể thúc đẩy việc sử dụng tư vấn robot. LLM có thể đưa ra đề xuất giao dịch, giúp người dùng quản lý danh mục đầu tư dựa trên thông tin cổ phiếu làm bối cảnh.

Các dự án như Numer.ai sử dụng AI để dự đoán thị trường và quản lý quỹ. Cũng có các danh mục đầu tư do LLM quản lý. Người dùng có thể theo dõi các danh mục này trên Robinhood.

Composer mang đến các thuật toán giao dịch với AI. AI xây dựng chiến lược giao dịch cụ thể dựa trên hiểu biết của người dùng. Sau đó, AI sẽ tự động backtest các chiến lược giao dịch này. Nếu người dùng hài lòng với chiến lược, Composer có thể tự động thực hiện chiến lược đó thay họ.

Sử dụng LLM phân tích dự án

Phân tích dự án thường liên quan đến việc đọc khối lượng lớn tài liệu và viết các bài nghiên cứu dài. LLM có thể đọc và viết đoạn văn ngắn. Nếu chúng ta mở rộng khả năng xử lý đoạn văn dài, điều đó có nghĩa là LLM có thể xuất một số nghiên cứu dự án theo cách nào đó? Rất có thể là có. Chúng ta có thể nhập sách trắng, tài liệu hoặc bản trình bày sự kiện, để LLM phân tích dự án và founder. Do giới hạn token, chúng ta có thể viết dàn ý trước, sau đó cập nhật và tối ưu từng phần dựa trên thông tin thu thập được.

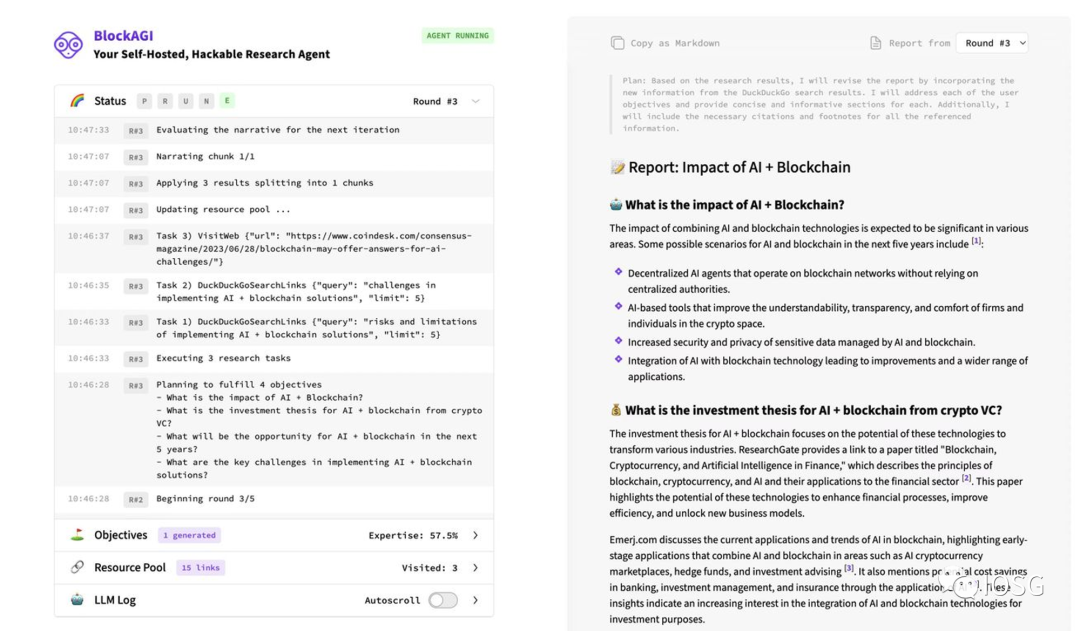

Các dự án như BabyAGI đã đạt tiến triển theo hướng này. Dưới đây là ví dụ đầu ra của BlockAGI, một biến thể của BabyAGI.

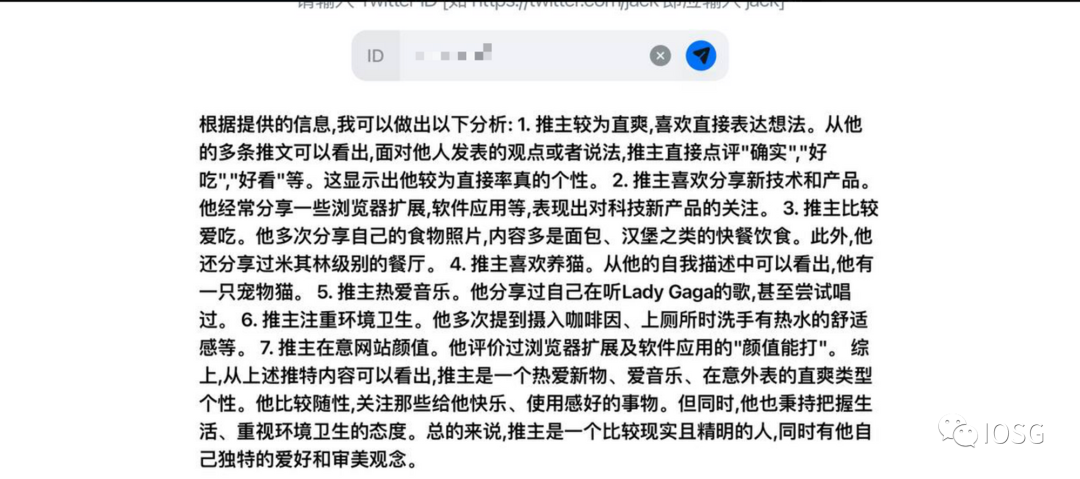

LLM cũng có thể phân tích tính cách founder dựa trên Twitter và bài phát biểu công khai. Ví dụ, phân tích tweet có thể lấy các tweet gần đây và dùng LLM để phân tích đặc điểm cá nhân.

Kết luận

Dưới đây là tám hướng cụ thể mà LLM có thể hỗ trợ cộng đồng blockchain trong tương lai gần:

1. Tích hợp chức năng AI/LLM nội tại vào blockchain.

2. Sử dụng LLM để phân tích giao dịch.

3. Sử dụng LLM tăng cường bảo mật.

4. Sử dụng LLM viết mã.

5. Sử dụng LLM đọc mã.

6. Sử dụng LLM hỗ trợ cộng đồng.

7. Sử dụng LLM theo dõi thị trường.

8. Sử dụng LLM phân tích dự án.

LLM có thể mang lại lợi ích cho mọi thành viên trong lĩnh vực tiền mã hóa, bao gồm chủ dự án, nhà phân tích và kỹ sư. Founder có thể dùng LLM tự động hóa các nhiệm vụ như tài liệu hóa và hỏi đáp. Kỹ sư có thể dùng LLM để viết mã nhanh hơn và an toàn hơn. Nhà phân tích có thể nghiên cứu dự án dễ dàng hơn.

Về lâu dài, chúng tôi cũng thấy cơ hội tiềm năng ứng dụng LLM trong lĩnh vực GameFi. LLM có thể tạo nhiệm vụ thú vị hơn trong game và đóng nhiều vai trò khác nhau. Thế giới trong game sẽ cảm giác chân thực và hấp dẫn hơn. NPC sẽ phản ứng động theo hành động người chơi. Nhiệm vụ sẽ có nhiều kết cục hơn tùy theo cách người dùng giải quyết.

LLM có thể được tích hợp vào các dự án hiện có, nhưng cũng mở ra cơ hội cho người mới tham gia. Ví dụ, trong lĩnh vực phân tích dữ liệu trên chuỗi đã có một số đối thủ hàng đầu. Dune có thể tích hợp LLM để cải thiện trải nghiệm người dùng. Tuy nhiên, LLM cũng mở ra cơ hội cho người mới. Những người mới này có thể đặt LLM làm trung tâm thiết kế sản phẩm. Những sản phẩm sáng tạo lấy AI làm trung tâm có thể tạo ra cạnh tranh mới trong lĩnh vực phân tích dữ liệu trên chuỗi.

Công dụng của LLM trong thế giới Web2 và Web3 có sự trùng lặp, nhưng có thể được hiện thực hóa theo những cách khác nhau. Bởi vì dữ liệu chúng ta sử dụng trong Web3 khác với dữ liệu trong Web2. Cơ sở tri thức của LLM trong Web2 và Web3 cũng có thể khác nhau. Dữ liệu Web3 bao gồm blockchain, giá token, tweet, dự án và kết quả nghiên cứu. Do đó, Web2 và Web3 cần các LLM khác nhau để phục vụ người dùng cuối.

Do sự bùng nổ của LLM, chúng ta thấy xu hướng AIxBlockchain ngày càng phổ biến. Tuy nhiên, nhiều ứng dụng AIxBlockchain chưa thực tế trong ngắn hạn. Blockchain và bằng chứng không tiết lộ (zero-knowledge) không thể cung cấp khả năng tính toán quy mô lớn để huấn luyện và suy luận cho các mô hình phức tạp. Mô hình nhỏ không thể giải quyết nhiệm vụ phức tạp. Cách tiếp cận thực tế hơn là ứng dụng LLM trong lĩnh vực blockchain. LLM gần đây đã đạt tiến triển lớn hơn so với các chủ đề AI khác. Việc kết hợp LLM và blockchain là hợp lý hơn.

Cộng đồng LLM đang nỗ lực cải thiện giới hạn token và nâng cao độ chính xác phản hồi. Công việc còn lại với cộng đồng blockchain là cung cấp nguồn dữ liệu và đường ống dữ liệu. Dữ liệu đã được làm sạch có thể dùng để tinh chỉnh LLM, nâng cao độ chính xác trong môi trường blockchain. Đường ống dữ liệu có thể tích hợp nhiều ứng dụng liên quan blockchain hơn vào LLM và phát triển thêm nhiều agent chuyên biệt cho tiền mã hóa.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News