この「ブタを屠る」詐欺グループでは、AIが恋愛を担当し、偽の弁護士資格証明書の作成も担当している。

TechFlow厳選深潮セレクト

この「ブタを屠る」詐欺グループでは、AIが恋愛を担当し、偽の弁護士資格証明書の作成も担当している。

詐欺パーク内の業務のほとんどは、1つのChatGPTアカウントでこなせる。

著者:クリー、TechFlow

OpenAIはこの2日間で、報告書を公開しました。その内容は、ChatGPTを悪用して不正行為を行っていた人物が、同社によって検出・摘発されたというものです。

報告書は非常に長く、多数のAI悪用事例が列挙されています。ロシア人が展開する虚偽宣伝活動や、スパイ容疑者が行うソーシャルエンジニアリングなども含まれていますが、本稿ではその中の一つの事例に焦点を当てます。

カンボジアにおける「ブタ飼い詐欺(Pig Butchering Scam)」です。

ブタ飼い詐欺自体は珍しくありません。カンボジアの詐欺拠点に関する話は、すでに数多く報じられています。しかし、今回のケースで注目すべきは、AIが果たす役割です。

この詐欺グループでは、ChatGPTが恋愛の相手役を務め、上司の指示を翻訳し、毎日の業務日報を作成し、さらに各被害者に対して「価値評価」まで行っています。

ブタ飼い詐欺の内部用語で「kill value(キル・バリュー)」と呼ばれるもので、つまり「あなたから搾取できる金額の予測値」を意味します。

一連の作業工程全体を見渡すと、ChatGPTが最も多忙な「従業員」である可能性すらあります。

OpenAIはこの事件に「Operation Date Bait(デート釣り作戦)」というコードネームを付与しています。

その手口は以下の通りです。

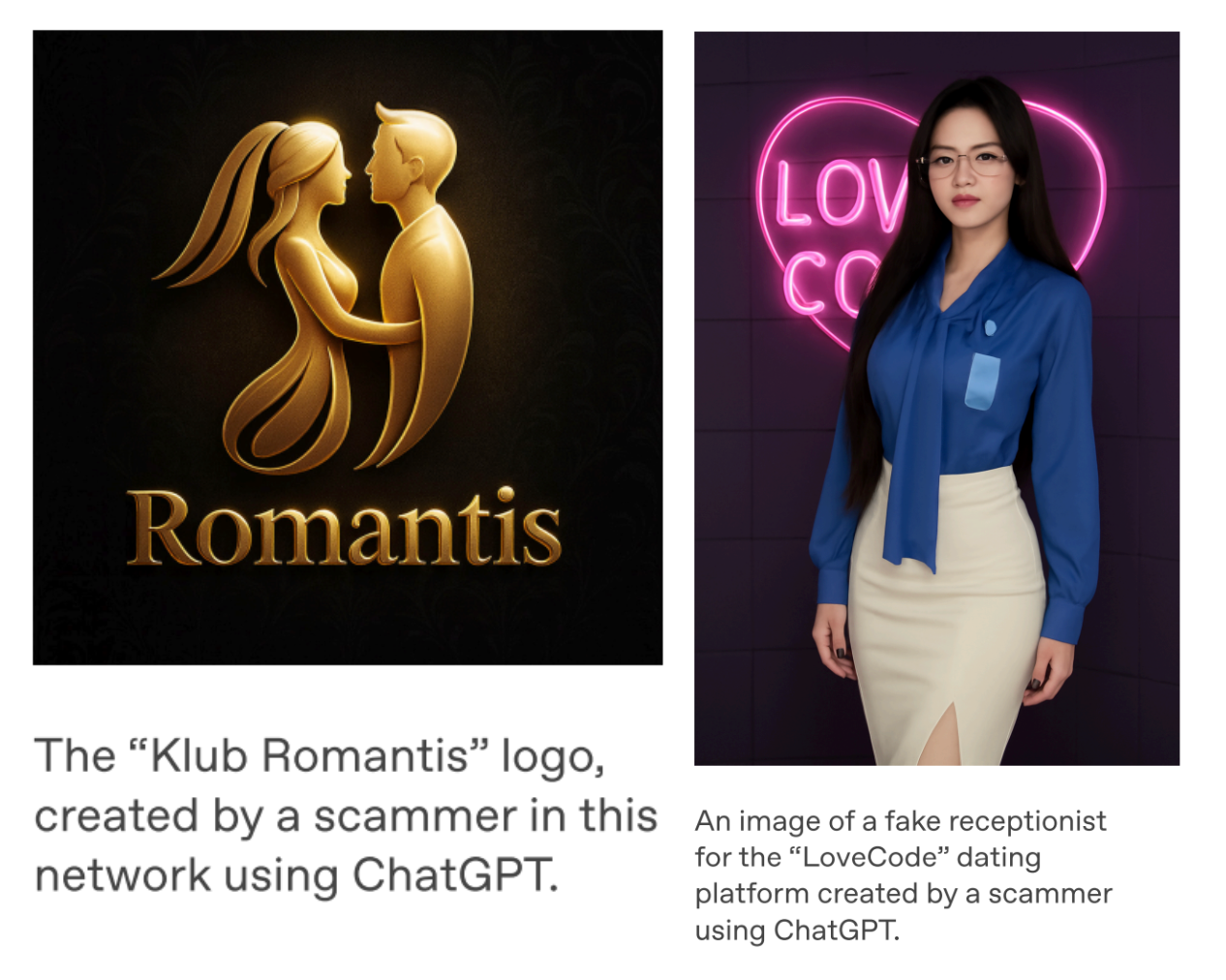

まず詐欺グループが、高級感のある疑似婚活サービス「Klub Romantis」を立ち上げます。ロゴはChatGPTで作成されています。その後、ソーシャルメディア上で有料広告を配信し、キーワードには「ゴルフ」「ヨット」「高級レストラン」などを設定。特にインドネシアの若年層男性をターゲットとしています。

ユーザーが広告をクリックすると、まずAIチャットボットとの会話が始まります。ボットはセクシーなフロントスタッフを装い、「好みの女性タイプを選んでください」と促します。選択後、Telegramへのリンクと専用招待コードが提供されます。

Telegramへ移行すると、今度は実在する人物が対応を引き継ぎます。

受付担当者は、ChatGPTを用いて官能的なメッセージを生成し、次第に露骨な会話を展開。その後、ユーザーを2つの偽の婚活プラットフォーム——「LoveCode」と「SexAction」——へ誘導します。

これらのプラットフォームには、多数の偽の女性プロフィールが掲載されており、さらに「○○さんがミッションを完了し、ボーナスを獲得しました」といった虚偽の通知が、常時スクロール表示されています。これらはすべてでっち上げであり、ネットに慣れた人であれば一目で見抜けるでしょう。しかし、すべての標的がそうした識別能力を持つとは限りません。

会話が一定の段階に達すると、ユーザーは「メンター」と呼ばれる担当者へと引き渡されます。このメンターは、次々と課金を伴う「ミッション」を課してきます。VIPカード購入、お気に入り女性への投票、ホテル予約のデポジット支払いなど、名目はさまざまです。

最終段階は、内部で「kill(キル)」と呼ばれます。

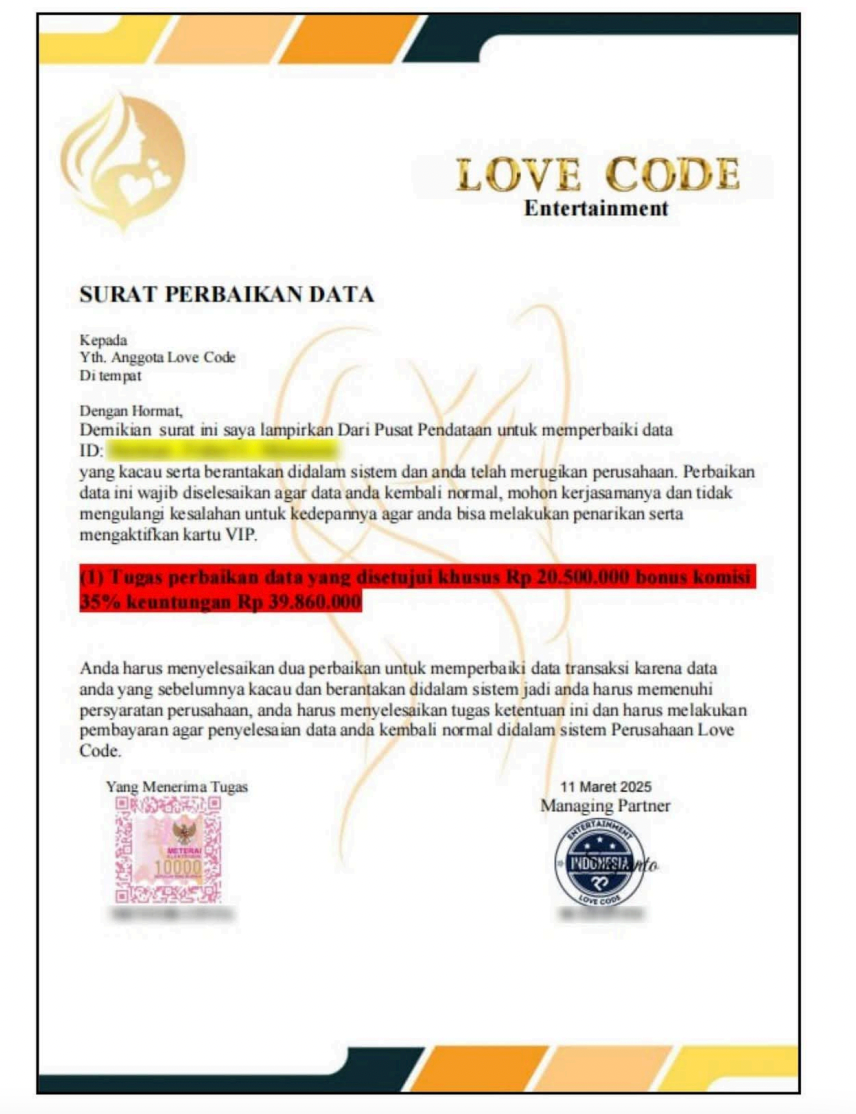

データ処理エラー、本人確認保証金といった理由をつけて、一度に大金を振り込ませます。OpenAIの報告書には、被害者に送られた詐欺メールの一部が掲載されており、そこでは2,050万インドネシア・ルピア(約1万2,000米ドル)の支払いを要求し、その返金率は35%と記されています。

資金が入金されると、Telegram上の詐欺師はユーザーをブロックし、「案件終了」というメモを追加します。

ここまで読むと、特に驚きはないかもしれません。

詐欺手法自体は新しくなく、ブタ飼い詐欺の手口はここ数年、何度も暴露されてきました。しかし、本当に驚かされるのは、その裏側の運営体制です。

OpenAIの調査員は、これらのChatGPTアカウントの利用ログから、一連の企業組織構造を明らかにしました。

詐欺拠点は3つの部門に分かれています。「流入チーム」は広告配信による集客を担当、「受付チーム」は会話による信頼構築を、「管理チーム」は最終的な資金回収をそれぞれ担っています。

毎日、業務日報が提出されます。日報には現在対応中の各被害者の情報が記載され、担当者名、進行ステップ、そしてその数字——

kill value(キル・バリュー).

つまり、管理チームがその人物から最終的に搾取できると予測した金額です。

また、ChatGPTは財務帳簿の分析や業務報告書の作成にも使われており、API連携方法や婚活サイトのコード修正についても質問されています。さらに、上司が中国語を話し、従業員がインドネシア語を話すという状況では、ChatGPTが双方の翻訳を担っています。

笑ってしまうのは、ある詐欺従業員がChatGPTに「収入を得た後の税務対応について」質問していたことです。職業欄には堂々と「scammer(詐欺師)」と記入されていました。

OpenAIの報告書は表現が極めて控えめで、「詐欺グループ自身の入力ログに基づけば、数百件の標的を同時に処理している可能性があり、1日あたり数千米ドルの収益を上げている」と述べています。ただし、こうした数字が実際に正確かどうかは、独立して検証できていないとも明記しています。

ただ筆者は、数字の真偽にこだわる必要はないと思っています。この一連のマネジメント・プロセスだけを見ても十分に衝撃的です。

流入、コンバージョン、顧客単価、日報、部門分担——用語を少し変えるだけで、まるでどこかのSaaS企業のオペレーションマニュアルを読んでいる錯覚に陥ります。

そして、恋愛演出、翻訳、日報作成、コード修正、会計処理……この詐欺拠点で行われる業務の半分以上を、単一のChatGPTアカウントがこなしているのです。

しかし、物語はここで終わりません。

OpenAIは、同一報告書内でさらに別の詐欺ライン——コードネーム「Operation False Witness(偽被害者詐欺)」——を解明しています。これもカンボジア発のものです。

この詐欺ラインの標的は、一般市民ではなく、すでに詐欺に遭った「被害者」です。

その論理は単純です。あなたはブタ飼い詐欺で金銭を失い、返金を望み、ネットで解決策を検索します。

すると、「詐欺被害者の救済に特化した法律事務所」の広告が目に留まり、クリックしてしまいます。

そのウェブサイトは非常に本格的に作られています。弁護士の写真は、ソーシャルメディアから盗用した実在の人物の画像か、あるいはAI生成のもの。どの事務所も住所、免許番号、紹介文を備えています。ChatGPTはニューヨーク州弁護士協会の会員証や、架空の弁護士登録記録まで生成しています。

OpenAIは、少なくとも6件の偽法律事務所を特定しました。

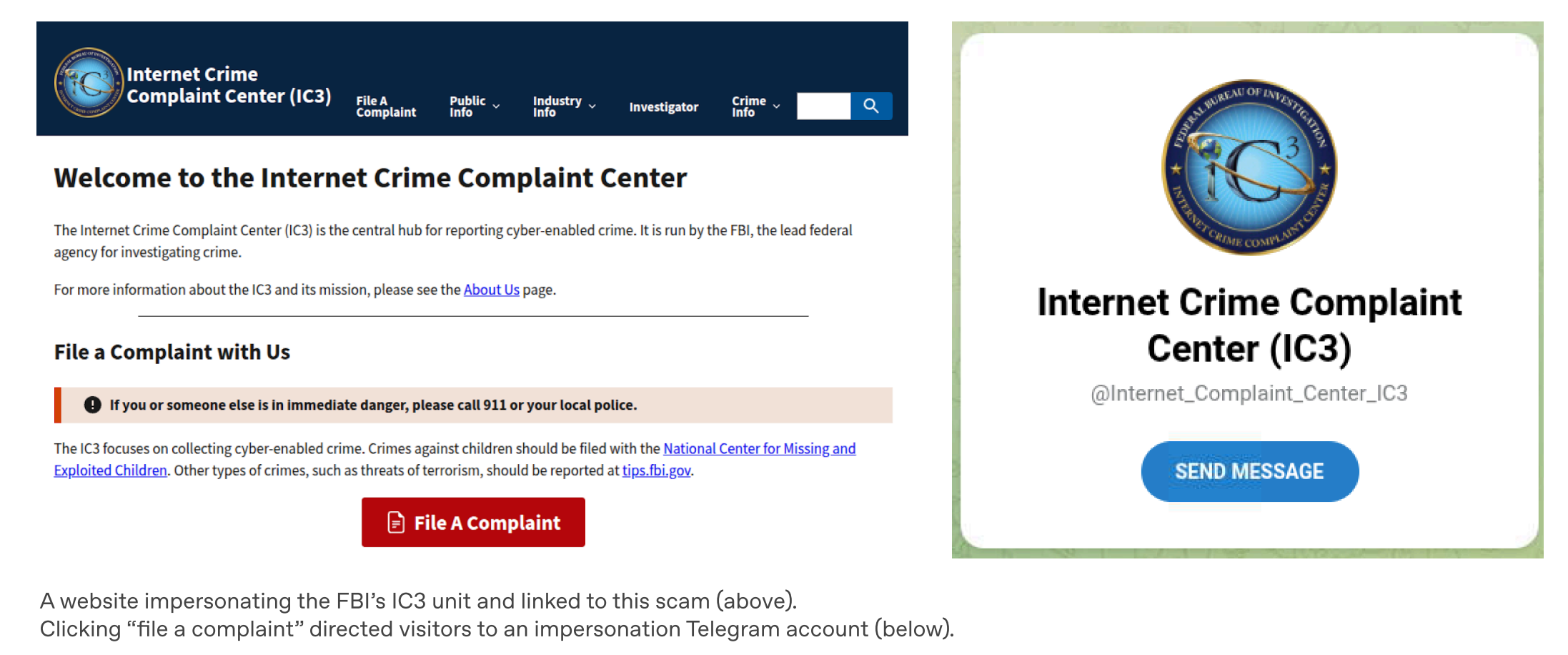

また、FBIのインターネット犯罪苦情センター(IC3)を模倣したウェブサイトもありました。ページ上には「苦情を提出する」ボタンがあり、クリックするとTelegramのアカウントへと遷移します。

Telegram上で「弁護士」が対応を始めます。会話の台詞はすべてChatGPTが生成したもので、意図的に「アメリカ英語」で書かれ、プロフェッショナルな弁護士のトーンを模倣しています。「国際刑事裁判所と提携しており、資金回収完了までは着手金を請求しません」と説明されます。

ただし、口座の「アクティベーション」のために、事前に15%の着手金を暗号資産で支払うよう求められます。

さらに、ユーザーには秘密保持契約の署名も求められます。この契約書もChatGPTが作成したもので、目的は「他の人に相談しないようにすること」に他なりません。

FBIは後に、この詐欺について特別な公開警告を発出し、「主に高齢者を標的としており、被害者が損失回復を切望する心理を巧みに利用している」と指摘しています。

この2つの事例を読み終えて、AIがもはや標準装備となった現代において、最も皮肉に感じられるのは次の点です。

最初に騙されたとき、あなたは単なる「標的」でした。しかし2度目の詐欺では、あなたは「より優れた標的」になります。なぜなら、あなた自身がすでに騙されやすいことを証明してしまったからです。

最後に、OpenAIは報告書の中で、詐欺の流れを3段階に整理しています。

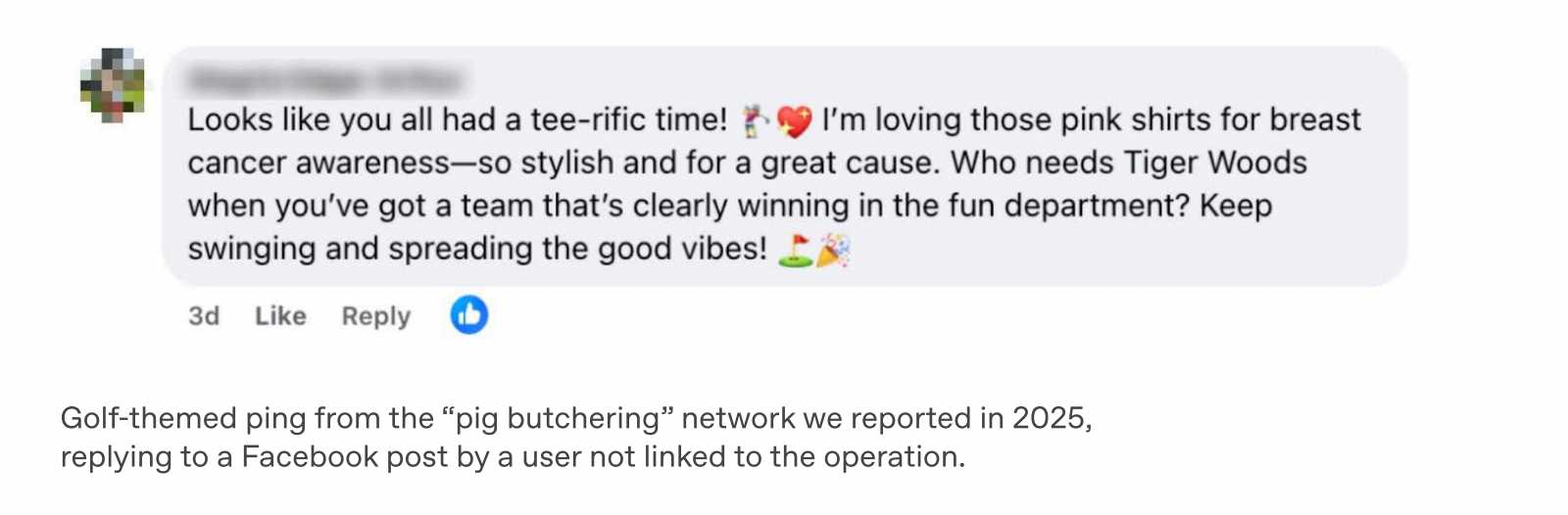

第一段階は「ping(ピン)」——冷たい接触、つまり標的があなたに気づくよう仕向けること。第二段階は「zing(ジング)」——感情を揺さぶり、心を動かしたり興奮させたり恐怖を抱かせること。第三段階は「sting(スティング)」——収穫、つまり金銭を奪い取ることです。

このフレームワークはとてもよくまとまっており、よく見てみると、この3段階のうち、AIができないステップは一体どれでしょうか?

かつてのブタ飼い詐欺では、最大のコストは「人件費」でした。何十人ものスタッフを雇って、パソコンの前でひたすらチャットさせる必要がありました。さらに、標的の言語を話せる人材を確保しなければなりませんでした。カンボジアの詐欺拠点では、当初から英語が堪能な人材を優先的に採用し、高い給与を支払っていました。

ところが、今回の報告書に記載されたデート詐欺事件では、管理職は中国語、従業員はインドネシア語、標的もインドネシア人です。三者間で言語が通じない状況では、従来なら到底成立しなかった業務が、ChatGPTの導入によって完全に実現しています。

言語対応は、その一例にすぎません。

報告書にはもう一つの興味深い記述があります。詐欺従業員が、ChatGPTに対して「OpenAIのAPIをどう接続すればよいか?」と質問していたという事実です。つまり、チャットの工程を完全に自動化しようとしていたのです。

言い換えれば、AIは詐欺の「巧妙さ」を高めたわけではありません。詐欺の手口は、昔から変わっていません。AIが変えたのは、「詐欺のコスト」なのです。

OpenAIによれば、この詐欺グループは現在、数百件の詐欺案件を同時並行で処理している可能性があります。規模が拡大すれば、一人当たりの被害者に割り当てる人的コストは逆に下がるため、単価が低くても大量の被害者を狙えるようになります。

もう一つ、もっと深く考えるべき問題があります。

OpenAIがこうした詐欺を発見できたのは、詐欺グループがChatGPTを使っていたため、その会話記録がOpenAIのサーバー上に残っていたからです。

では、ローカル環境でオープンソースのモデルを自己運用しているケースではどうでしょうか?

本報告書が示すことができるものは、おそらく全体のパズルのうち、OpenAIの光が届いているごく一部にすぎません。光が届かない部分がどれほど広大なのか——誰にも分かりません。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News