AIエージェントを自分で作りたい?この大規模言語モデルガイドをしっかり押さえておこう

TechFlow厳選深潮セレクト

AIエージェントを自分で作りたい?この大規模言語モデルガイドをしっかり押さえておこう

LLMの選定方法に関する完全ガイド。

著者:superoo7

翻訳:TechFlow

ほぼ毎日、似たような質問を受けます。20以上のAIエージェントの構築を支援し、テストモデルに多大なコストをかけてきた経験から、本当に効果のある知見をいくつかまとめました。

以下は、適切なLLMを選ぶための完全ガイドです。

現在の大規模言語モデル(LLM)の分野は急速に変化しています。毎週のように新しいモデルが登場し、「最高だ」と主張しています。

しかし現実には、すべてのニーズに対応できる万能のモデルは存在しません。

それぞれのモデルには特定の用途に適した特徴があります。

私は数十種類のモデルをテストしてきました。私の経験が、皆さんの時間とお金を無駄にすることを防ぐ助けになればと思います。

明記しておくと、この記事はラボでのベンチマークテストやマーケティング資料に基づくものではありません。

過去2年間にわたり、自らAIエージェントやジェネレーティブAI(GenAI)製品を構築してきた実務経験をもとに紹介します。

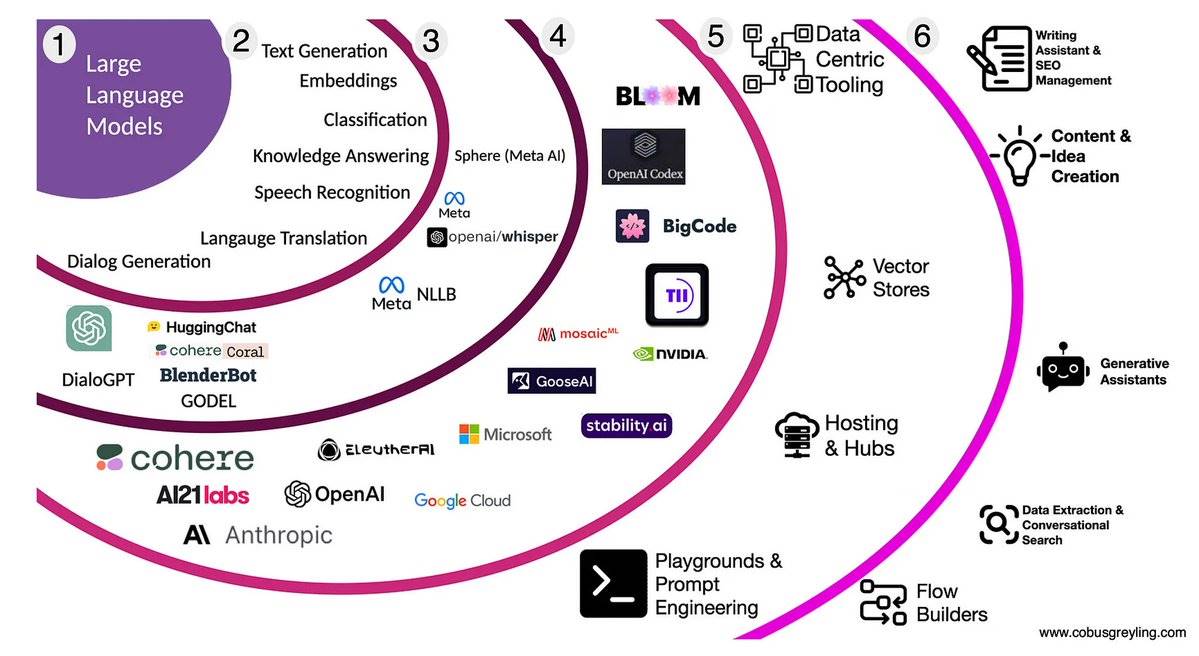

まず、LLMとは何かを理解しましょう。

大規模言語モデル(LLM)とは、コンピュータに「人間の言葉」を話させる技術です。入力された内容に基づき、次に最も現れる可能性が高い単語を予測します。

この技術の起点となったのは、この古典的論文です:Attention Is All You Need

基礎知識 ―― 閉じたソースコードモデルとオープンソースモデルの違い:

-

閉じたソースコードモデル:GPT-4やClaudeなど。通常は使用量に応じて課金され、提供者がホスティングします。

-

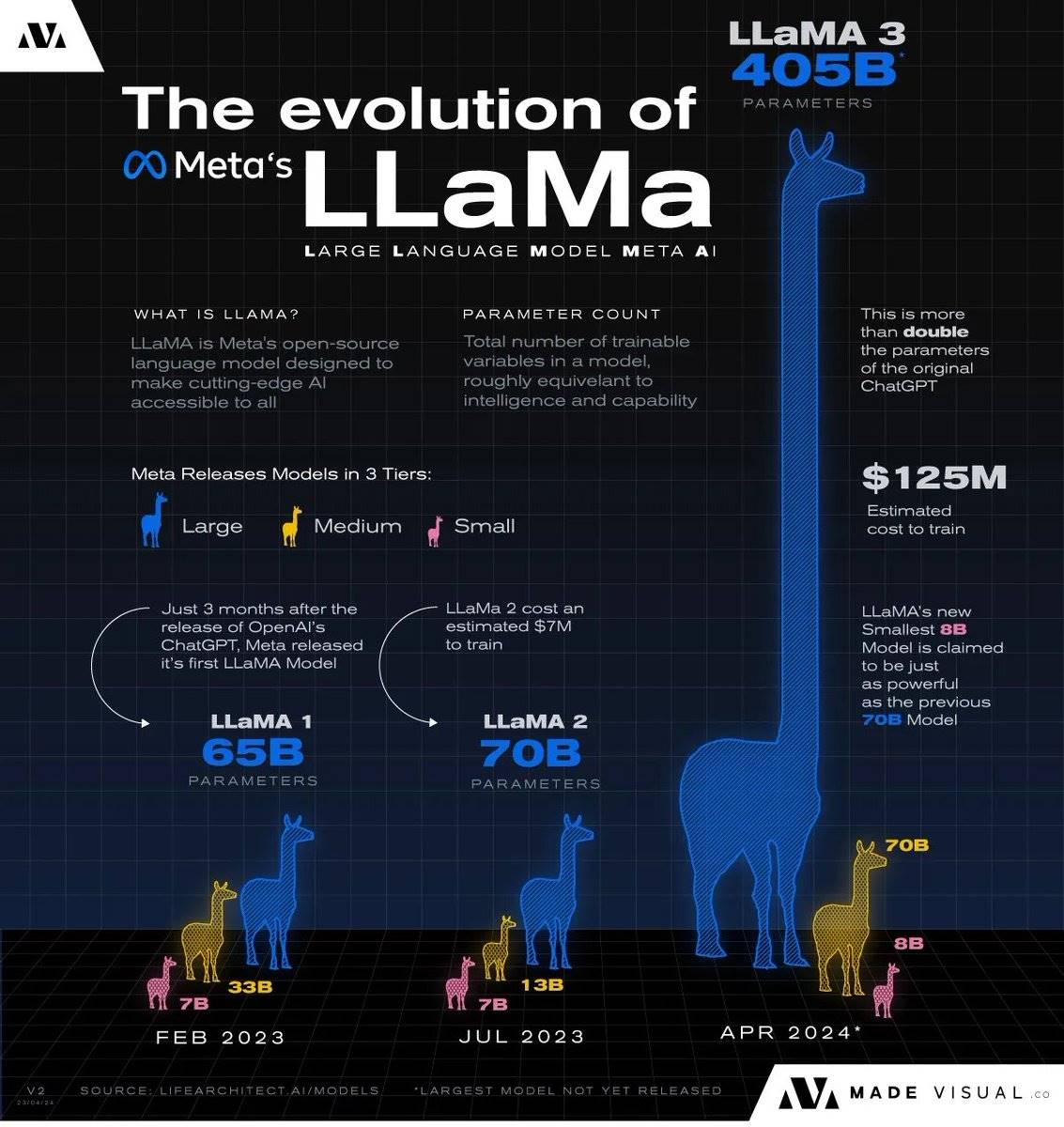

オープンソースモデル:MetaのLlamaやMixtralなど。ユーザー自身でデプロイと運用を行う必要があります。

初心者の方はこれらの用語に混乱するかもしれませんが、両者の違いを理解することは非常に重要です。

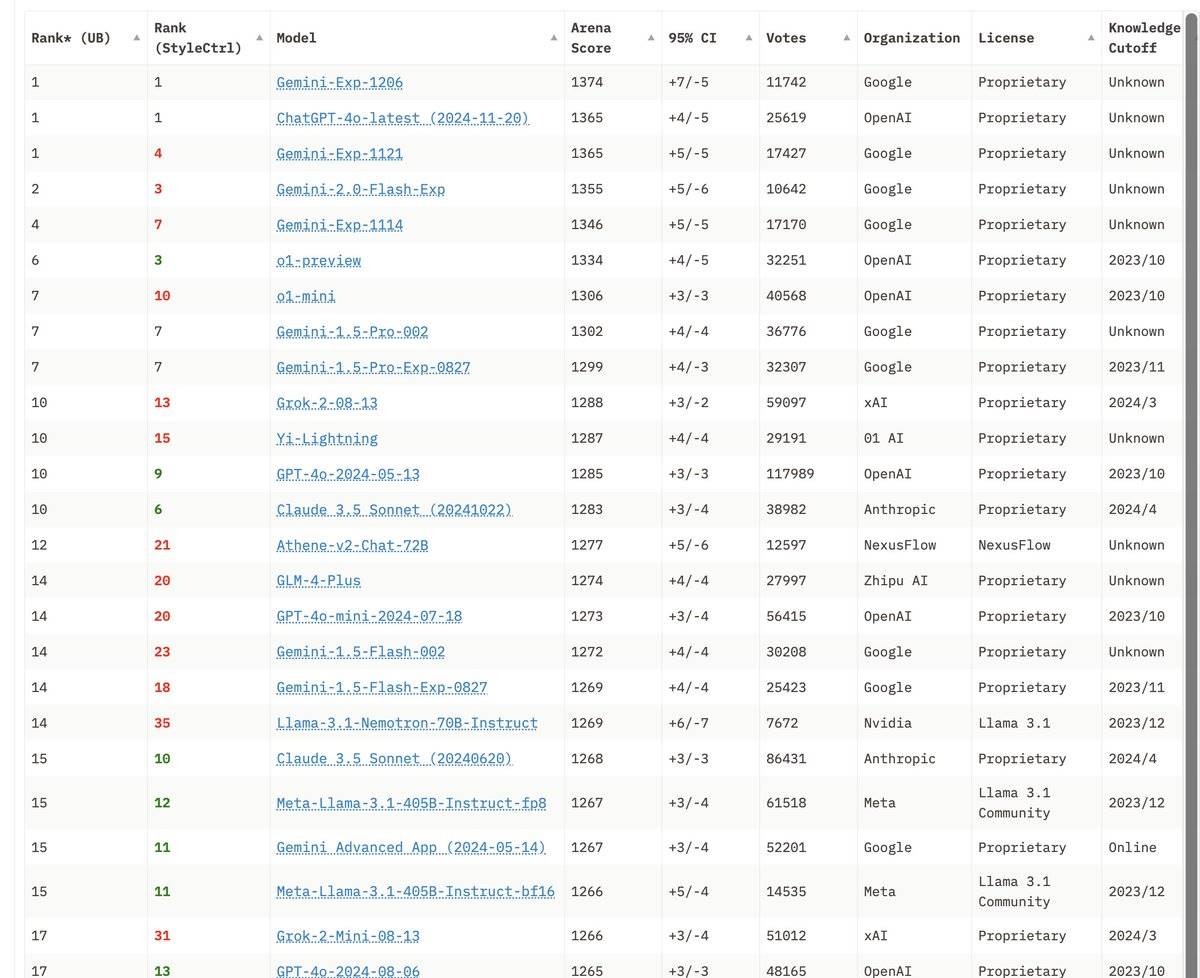

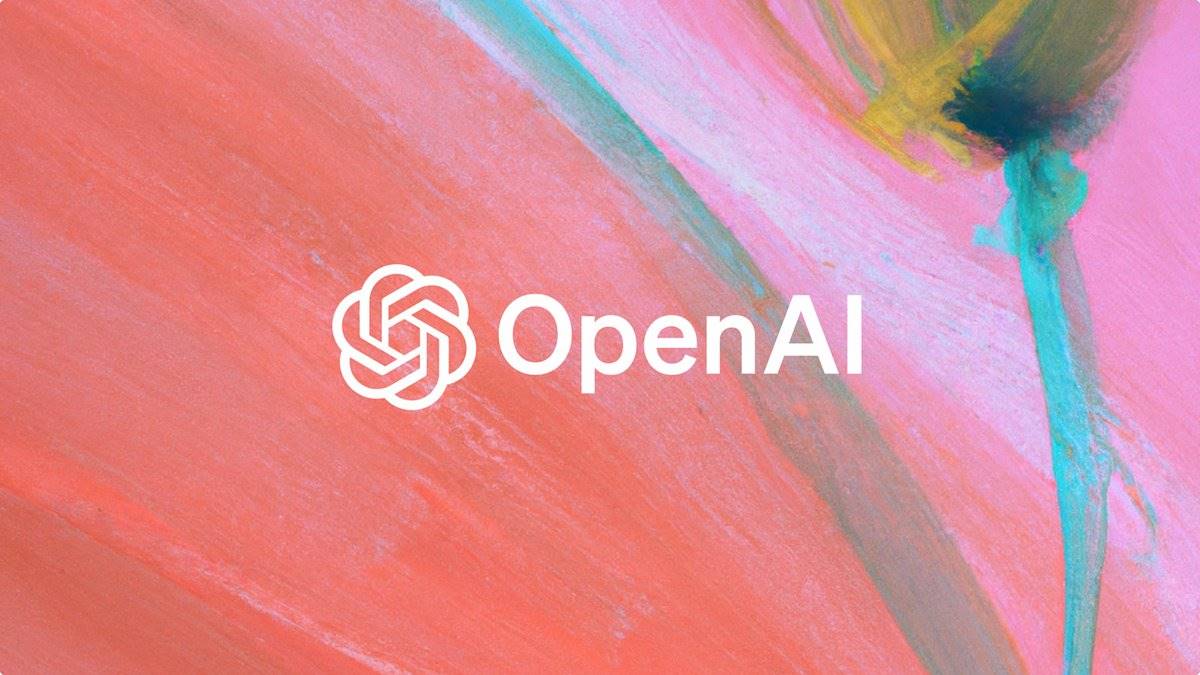

モデルの規模が大きい=性能が良い、ではありません。

例えば7Bは、70億個のパラメータを持つモデルを意味します。

しかし、大きなモデルが常に優れた結果を出すわけではありません。重要なのは、自分の具体的なニーズに合ったモデルを選ぶことです。

X/Twitter用のロボットやソーシャルAIを構築したい場合:

@xai のGrokは非常に優れた選択肢です。

-

無料枠が豊富

-

ソーシャルな文脈の理解能力に優れている

-

クローズドソースだが、試す価値あり

初心者開発者には強くおすすめします!(内緒の話:

@ai16zdao のElizaはデフォルトでXAI Grokを使用中)

多言語対応が必要な場合:

@Alibaba_Qwen のQwQモデルは、私たちのテストにおいて特にアジア言語処理で非常に優れたパフォーマンスを示しました。

ただし、このモデルのトレーニングデータは中国本土由来が中心のため、一部の情報が不足している可能性がある点に注意が必要です。

汎用性または推論能力の高いモデルが必要な場合:

@OpenAI のモデルは依然として業界のリーダー的存在です。

-

安定した高パフォーマンス

-

広範な実践的検証済み

-

強固なセキュリティ機構を備える

ほとんどのプロジェクトにとって理想的な出発点です。

開発者またはコンテンツクリエイターの場合:

@AnthropicAI のClaudeは、私が日常的に使う主力ツールです。

-

コーディング能力が非常に高い

-

レスポンスが明確かつ詳細

-

創造的な作業に最適

MetaのLlama 3.3は最近注目されています。

-

安定したパフォーマンス

-

オープンソースで柔軟性が高い

-

@OpenRouterAI や @GroqInc を通じて試用可能

たとえば、@virtuals_io などの暗号資産×AIプロジェクトがこれに基づいて製品を開発しています。

キャラクター演じ分け型AIが必要な場合:

@TheBlokeAI のMythoMax 13Bは、現在のロールプレイ分野におけるトップランナーであり、数か月連続で関連ランキング上位を維持しています。

CohereのCommand R+は過小評価されている優秀なモデルです。

ロールプレイタスクで優れたパフォーマンス

複雑なタスクにも容易に対応

最大128000トークンのコンテキストウィンドウをサポートし、「記憶力」が長い

GoogleのGemmaモデルは、軽量ながら強力な選択肢です。

-

特定タスクに集中し、優れた結果を出す

-

予算に優しい

-

コストに敏感なプロジェクトに適している

個人的な経験として、私は小型のGemmaモデルをAIプロセス内の「偏りのない審判」としてよく使い、検証タスクでは非常に効果的でした!

@MistralAIのモデルも注目に値します。

-

オープンソースでありながらハイエンド品質

-

Mixtralモデルのパフォーマンスは非常に強力

-

特に複雑な推論タスクに優れる

コミュニティからの評価も高く、試してみる価値は十分にあります。

専門アドバイス:組み合わせて使ってみよう!

-

異なるモデルにはそれぞれ長所がある

-

複雑なタスクのためにAI「チーム」を構成できる

-

各モデルに最も得意な部分を担当させる

まるで夢のチームを編成するように、それぞれのメンバーに独特の役割と貢献を持たせましょう。

すぐに始める方法:

@OpenRouterAI や @redpill_gpt を使ってモデルをテストするとよいでしょう。これらのプラットフォームは暗号通貨決済にも対応しており、非常に便利です。

さまざまなモデルの性能を比較するのに最適なツールです。

コスト削減のためにローカルでモデルを動かしたい場合は、@ollama を試してみてください。自分のGPUを使って実験できます。

速度を追求するなら、@GroqInc のLPU技術が極めて高速な推論を提供します。

-

利用可能なモデルの選択肢は限られている

-

しかし、本番環境でのデプロイに適した性能

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News