Tether lance une IA locale : de petits modèles s’opposent frontalement aux grands modèles basés sur le cloud

TechFlow SélectionTechFlow Sélection

Tether lance une IA locale : de petits modèles s’opposent frontalement aux grands modèles basés sur le cloud

La puissance de calcul, les modèles d’IA, les ensembles de données et les capacités intelligentes capables de fonctionner hors du nuage centralisé deviennent le deuxième actif de réserve de Tether.

Auteur : Liam Akiba Wright

Traduction : Luffy, Foresight News

Le nouveau projet de Tether, QVAC, débute avec une idée rare dans le secteur des stablecoins. L’entreprise décrit son modèle fondamental QVAC Psy comme une série de grands modèles « ancrés dans les principes de la psychohistoire ».

Le concept de psychohistoire provient de la célèbre saga de science-fiction *Fondation*, d’Isaac Asimov. Dans cette œuvre, le personnage principal, Hari Seldon, utilise les mathématiques, les statistiques et la dynamique sociale pour prédire le comportement collectif à grande échelle, afin de raccourcir l’ère sombre suivant l’effondrement de l’Empire galactique.

L’*Encyclopédie de la science-fiction* définit la psychohistoire d’Asimov comme une science fictive ; l’ensemble du plan conçu par Hari Seldon vise à anticiper les événements futurs et à préserver la connaissance humaine en cas d’effondrement du système social.

Cette formulation de Tether constitue en réalité un habillage scientifique-fictif de sa mission entrepreneuriale.

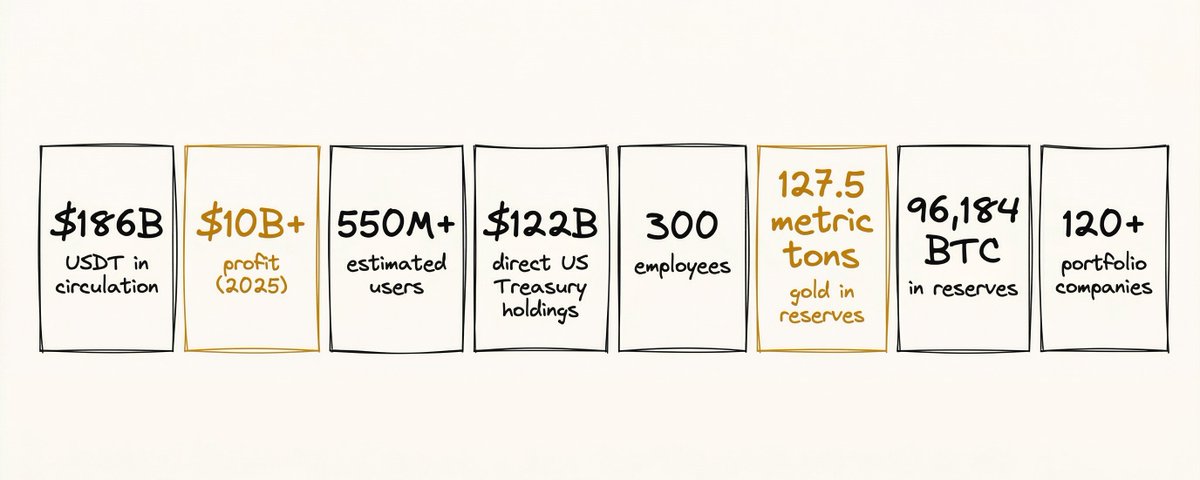

Grâce à ses actifs de réserve, à sa liquidité et à ses capacités de distribution, Tether a construit le plus grand système de stablecoins du secteur crypto ; aujourd’hui, elle transpose cette logique fondamentale au domaine de l’intelligence artificielle.

Le stablecoin USDT constitue le premier pilier de réserve de Tether ; tandis que la puissance de calcul, les modèles d’IA, les jeux de données et les capacités intelligentes pouvant fonctionner hors des nuages centralisés constituent désormais son deuxième pilier d’actifs réservés.

Du réservoir de dollars à celui des actifs intelligents

L’entrée de Tether dans le domaine de l’intelligence artificielle suit la logique opérationnelle de son activité centrale. USDT transforme la demande mondiale de dollars offshore en un portefeuille d’actifs réservés principalement composé d’obligations souveraines à court terme.

Selon le rapport d’audit des réserves de Tether pour le premier trimestre 2026, le bénéfice net de l’entreprise s’élève à 1,04 milliard de dollars américains, ses réserves tampons atteignent 8,23 milliards de dollars américains, ses engagements liés aux jetons s’élèvent à environ 183 milliards de dollars américains, et ses obligations du Trésor américain à court terme détenues directement ou indirectement représentent environ 141 milliards de dollars américains.

Une base de réserves aussi solide procure à Tether des revenus réguliers, une capacité patrimoniale suffisante, et lui permet d’investir ses bénéfices opérationnels dans des infrastructures à long terme.

CryptoSlate avait précédemment analysé que, grâce à son volume massif de stablecoins, Tether pouvait allouer stratégiquement ses fonds de réserve. En janvier de cette année, Tether a ainsi acquis 8 888 bitcoins, confirmant sa capacité à transformer ses revenus d’intérêts et ses bénéfices opérationnels en une allocation durable en bitcoins. Le projet QVAC étend cette logique d’allocation d’actifs à un tout nouveau domaine : l’intelligence artificielle.

Outre ses investissements dans le bitcoin, l’or, les startups, les énergies, l’exploitation minière cryptographique et les infrastructures de télécommunications, Tether entre désormais officiellement et massivement dans le domaine même de l’intelligence artificielle. Cette orientation transforme Tether d’un simple émetteur privé de liquidités en dollars en un constructeur privé d’infrastructures numériques.

La narration scientifique-fictive de la « psychohistoire » correspond précisément à cette direction stratégique : Tether considère l’intelligence artificielle non pas comme une simple piste logicielle, mais comme une architecture fondamentale de civilisation. Les documents officiels de QVAC se définissent comme une « plateforme d’intelligence stable infinie », mettant l’accent sur un système intelligent décentralisé fonctionnant prioritairement en local, destiné à concurrencer — voire remplacer — l’IA centralisée.

La vision de QVAC affirme que confier l’ensemble des interactions intelligentes à des serveurs centralisés n’est pas seulement lent et instable, mais expose également à des risques de contrôle et de restriction ; QVAC entend quant à elle devenir la base infranationale (edge) dédiée à un système intelligent personnel.

Cette philosophie résonne parfaitement avec celle de Tether concernant les stablecoins : transferts financiers sans autorisation préalable, données utilisateur conservées et contrôlées par l’utilisateur lui-même, intelligence artificielle exécutée localement, à proximité.

Derrière ce concept de science-fiction d’Asimov se cache un jugement plus sérieux de Tether : la valeur de l’intelligence artificielle ne s’ancrera véritablement que lorsqu’elle possédera la résilience et la robustesse propres à une infrastructure critique.

Bien que les grands modèles hébergés dans le cloud offrent des capacités globales supérieures, ils sont intrinsèquement exposés à des risques de plateforme, de tarification, de régulation politique, de latence réseau et de routage des données ; les modèles d’IA locaux, bien qu’ils sacrifient une partie de leurs performances, offrent en contrepartie la pleine propriété, la confidentialité et une stabilité continue d’utilisation.

Ce compromis logique s’accorde étroitement avec les principes du secteur crypto. L’auto-hébergement est certes moins pratique que la gestion via une plateforme d’échange, mais sa valeur ne devient évidente que lorsque survient une faillite d’échange ; de même, l’IA locale est moins facile à utiliser que les modèles hébergés dans le cloud, mais ses avantages apparaissent clairement dès qu’une coupure réseau, une modification des API, une suspension de compte ou une impossibilité de transférer des données surviennent.

QVAC : une architecture d’IA edge empruntant une voie différente

La différenciation fondamentale de QVAC réside dans son architecture sous-jacente. Les meilleurs grands modèles du marché — OpenAI, Anthropic, Google DeepMind, xAI — rivalisent tous sur des capacités universelles, la génération de code, les interactions multimodales, le raisonnement sur des contextes extrêmement longs, les applications d’agents intelligents et le déploiement d’entreprises dans le cloud.

QVAC, en revanche, choisit une voie radicalement différente : la déployabilité, la protection de la vie privée, la faible latence, la composable, et l’indépendance vis-à-vis de toute plateforme unique.

La documentation officielle de démarrage de QVAC définit le projet comme un écosystème open source multiplateforme, centré sur l’exécution prioritaire en local et les applications d’IA pair-à-pair, compatible avec Linux, macOS, Windows, Android et iOS. Les utilisateurs peuvent exécuter localement des modèles de langage, des systèmes de reconnaissance vocale, des systèmes de génération augmentée par recherche (RAG), ou encore déléguer des tâches d’inférence à d’autres nœuds de périphérie via les fonctions intégrées P2P.

Cela signifie que les critères de référence de QVAC diffèrent fondamentalement de ceux des grands modèles d’IA basés sur le cloud : les IA de pointe poursuivent les capacités modèles universelles les plus fortes que les services centralisés peuvent offrir ; QVAC, quant à elle, se concentre sur le lieu où l’inférence s’effectue, sur le contrôle de son exécution, sur la conservation des données sur l’appareil local, et sur la capacité des applications à continuer de fonctionner même si le service centralisé tombe en panne.

Tether a lancé en avril 2026 son kit de développement logiciel (SDK) QVAC, fournissant un ensemble de développement unifié permettant aux développeurs de créer, exécuter et affiner des applications d’IA sur n’importe quel appareil, adapté à toutes les plateformes sans nécessiter de modifications de code.

Le SDK QVAC repose sur une couche d’abstraction unifiée compatible avec divers moteurs d’inférence locaux, notamment QVAC Fabric (développé en interne), une version dérivée de llama.cpp, ainsi que des outils vocaux et de traduction tels que whisper.cpp, Parakeet et Bergamot.

Il dépasse largement le cadre d’une simple publication de modèle : il ressemble davantage à un système d’exploitation fondamental pour l’intelligence artificielle. L’écosystème open source de l’IA compte aujourd’hui de nombreux composants matures : Llama, Qwen, Mistral, Gemma, DeepSeek, Hugging Face, llama.cpp, Ollama, etc., autant de projets d’inférence locale florissants.

Le pari fondamental de QVAC est que les développeurs ont urgemment besoin d’un cadre complet pour l’IA edge, capable d’intégrer, via une interface unifiée, le chargement des modèles, le calcul d’inférence, la reconnaissance vocale, la reconnaissance optique de caractères (OCR), la traduction, la génération d’images à partir de texte, la génération augmentée par recherche (RAG), la distribution de modèles P2P, la délégation d’inférence et l’affinage local.

QVAC ambitionne de devenir la couche fondamentale de distribution de la puissance de calcul intelligente, s’appuyant sur des modèles locaux intermédiaires constamment mis à jour pour s’imposer comme l’entrée incontournable de l’écosystème de l’IA edge.

QVAC Fabric constitue le cœur de cette architecture technique. Tether indique que Fabric peut effectuer des ajustements fins de modèles sur du matériel grand public courant, en tirant parti des backends Vulkan et Metal, et qu’il est compatible avec les appareils Android équipés de GPU Qualcomm Adreno ou ARM Mali, les appareils Apple dotés de puces maison, ainsi que les ordinateurs Windows et Linux équipés de cartes graphiques AMD, Intel ou NVIDIA.

Par ailleurs, il adopte une technologie de découpage dynamique pour pallier les limites de mémoire vidéo des appareils mobiles, et prend en charge les ajustements fins LoRA accélérés par GPU ainsi que l’optimisation des instructions avec perte masquée.

Si ce flux de travail est validé par des développeurs externes, sa valeur dépassera largement celle d’une simple publication de modèle open source : les poids du modèle ne constituent qu’une couche fondamentale ; l’ajustement fin personnalisé local représente la véritable valeur ajoutée.

MedPsy : la première épreuve rigoureuse des capacités de QVAC

MedPsy est le premier produit modèle phare concrétisant QVAC. Selon le rapport technique publié le 7 mai sur Hugging Face, MedPsy est un modèle linguistique spécialisé dans la santé et le domaine médical, spécifiquement conçu pour un déploiement sur l’edge, disponible en deux versions : 1,7 milliard et 4 milliards de paramètres.

L’équipe avance une affirmation révolutionnaire : des modèles compacts, soigneusement entraînés sur des données médicales spécialisées, peuvent surpasser des modèles de référence médicaux volumineux, tout en étant capables de fonctionner sur des ordinateurs portables, des smartphones haut de gamme, voire des téléphones mobiles standard.

Selon QVAC, MedPsy-1,7B obtient une moyenne de 62,62 points sur sept tests fermés de référence médicale, dépassant nettement les 51,20 points de MedGemma-1.5-4B-it de Google, alors que son nombre de paramètres est inférieur de moitié ; MedPsy-4B atteint quant à lui une moyenne de 70,54 points, légèrement supérieure aux 69,95 points de MedGemma-27B-text-it, malgré un nombre de paramètres sept fois inférieur.

Sur les benchmarks HealthBench et HealthBench Hard (plus exigeant), l’écart s’élargit encore : MedPsy-4B obtient respectivement 74,00 et 58,00 points, contre 65,00 et 42,67 points pour MedGemma-27B-text-it.

Si ces scores peuvent être reproduits par des tiers, cela validera directement la vision fondamentale de QVAC : dans des domaines verticaux à forte valeur ajoutée et haute sensibilité, des modèles légers déployés sur l’edge peuvent rivaliser avec des systèmes géants hébergés dans le cloud.

Le processus d’entraînement illustre également la stratégie concurrentielle de QVAC : MedPsy s’appuie sur le modèle Qwen3 comme squelette, puis est amélioré par plusieurs cycles d’affinage supervisé et d’apprentissage renforcé axé sur les questions-réponses médicales ; plus de 30 millions d’échantillons synthétiques ont été générés durant les expérimentations, avec un apprentissage progressif en deux phases, et le modèle de supervision pour le raisonnement sur textes longs utilisé est le grand modèle Baichuan M3-235B.

À ce jour, les corpus d’entraînement n’ont pas été rendus publics, ce qui constitue un point critique : tous les résultats impressionnants publiés jusqu’ici proviennent d’évaluations internes à QVAC, et des questions essentielles restent en suspens — notamment celles relatives à d’éventuelles contaminations des données d’entraînement, à leur couverture thématique, à la conception des prompts et à l’influence du modèle superviseur — nécessitant impérativement une vérification externe.

Les avantages de son déploiement quantifié sont remarquables : des versions quantifiées GGUF compatibles avec llama.cpp et le SDK QVAC ont déjà été publiées. Avec la quantification Q4_K_M, la taille du modèle est réduite de 69 %, avec une perte moyenne inférieure à 1 point. Dans la configuration optimale équilibrant taille et performance, le modèle de 4 milliards de paramètres ne pèse que 2,72 Go, tandis que la version de 1,7 milliard de paramètres ne fait que 1,28 Go, permettant un déploiement aisé sur des appareils locaux.

QVAC précise également explicitement les risques associés : MedPsy ne prend en charge que les interactions textuelles, fonctionne uniquement en anglais, n’est pas adapté aux scénarios d’urgence clinique, souffre des hallucinations inhérentes aux grands modèles, et exige que les développeurs garantissent la sécurité de la vie privée des utilisateurs dans l’ensemble de l’architecture applicative.

Le domaine médical présente une demande intrinsèque très forte pour l’inférence locale : le potentiel de MedPsy est donc prometteur ; toutefois, sa véritable compétence ne sera confirmée que si des chercheurs externes parviennent à reproduire les scores de benchmark et à le tester dans des processus cliniques réels.

Praticité contre maîtrise : le combat ultime de l’industrie de l’IA

Le débat entre IA locale et IA dans le cloud est souvent réduit à un choix binaire entre confidentialité et performances. QVAC reformule cette logique : il s’agit fondamentalement d’un arbitrage entre praticité et maîtrise autonome.

L’IA dans le cloud excelle par sa facilité d’usage extrême : l’utilisateur ouvre une application, saisit une instruction, obtient immédiatement un résultat, sans avoir à se soucier des poids du modèle, de la mémoire vidéo de son appareil, des paramètres de quantification, des plongements vectoriels ou de la compatibilité de l’environnement d’exécution — la plateforme assume toute la complexité technique. Cette praticité extrême constitue précisément la raison principale de l’essor rapide des plateformes d’IA centralisées, permettant aux utilisateurs d’accéder à des capacités intelligentes de pointe avec un seuil d’entrée minimal.

QVAC, en revanche, exige que développeurs et utilisateurs assument une plus grande responsabilité opérationnelle, en échange d’une nouvelle architecture de sécurité : exécution locale hors ligne, fonctionnement même en cas de coupure réseau, réduction des fuites de données, libération de la dépendance aux API, et activation simultanée de canaux d’inférence et de distribution de modèles pair-à-pair.

Selon la présentation du SDK de Tether, les applications intégrant QVAC peuvent fonctionner de manière stable même dans des conditions de réseau dégradé, voire continuer à fonctionner normalement en l’absence totale de connexion. Une annonce préliminaire de QVAC datant de 2025 prévoit en outre que des agents intelligents pourront être déployés directement sur les appareils locaux, interagir de manière coordonnée via un réseau P2P, et, grâce au kit WDK, effectuer des transactions autonomes d’actifs Bitcoin et USDT.

C’est là la logique stratégique complète de Tether : argent, puissance de calcul, agents intelligents — tous obéissent au même paradigme de souveraineté autonome.

Certes, sa narration décentralisée n’est pas exempte de failles. D’un point de vue de l’inférence, QVAC atteint un haut degré de décentralisation : les utilisateurs peuvent télécharger librement les modèles, les exécuter localement, et conserver leurs données sensibles sur leurs appareils, ce qui retire à la plateforme le contrôle de chaque instruction d’interaction, contrairement aux API gérées. Grâce à son architecture réseau Holepunch, QVAC prend également en charge l’inférence déléguée et la distribution décentralisée de modèles, démontrant ainsi une innovation réelle au niveau de l’architecture.

Cependant, au niveau de la gouvernance, des attributs centralisés persistent. QVAC est entièrement financé, nommé, coordonné et promu par Tether ; ses applications phares, son écosystème de modèles, la feuille de route de son SDK, ainsi que sa philosophie de « stabilité intelligente », sont toutes pilotées par une seule entreprise.

Cette situation ne contredit pas sa valeur fondamentale de priorité locale, mais limite simplement les avantages de la décentralisation à la couche d’inférence — la plus solidement étayée par les preuves ; l’ensemble de l’écosystème doit encore progressivement mettre en place des mécanismes de contrôle distribué concernant les nœuds d’inscription par défaut, les canaux de publication des versions, les normes de sécurité, les critères d’admission des modèles et la gouvernance communautaire à long terme.

Les tests de reproduction détermineront la hauteur finale de QVAC

Aujourd’hui, la crédibilité publique de QVAC repose entièrement sur les résultats de reproductions tierces. Si les scores de benchmark de MedPsy peuvent être recréés dans des environnements d’évaluation externes, Tether aura véritablement concrétisé sa vision de « réserve d’actifs intelligents » : des modèles verticaux légers, open source et déployables localement peuvent rivaliser avec des modèles géants hébergés dans le cloud, même dans des domaines à haute sensibilité.

Même si les tests tiers réduisent, voire inversent, l’écart observé dans les scores, la valeur d’infrastructure de QVAC reste intacte — seule la narration relative aux performances des modèles serait atténuée. La question fondamentale de l’industrie revient toujours à une loi technologique intemporelle : la praticité extrême engendre une concentration du pouvoir, tandis que la maîtrise autonome implique un coût opérationnel.

C’est précisément là que réside la valeur de la narration scientifique-fictive d’Asimov : la psychohistoire de *Fondation* étudie les lois d’évolution des systèmes complexes et massifs sous pression ; Tether lui donne une nouvelle interprétation, en se concentrant sur la façon dont les infrastructures peuvent résister au monopole centralisé.

La narration scientifique-fictive est ambitieuse, la mise en œuvre technique en est encore à ses débuts, mais la logique stratégique globale est claire et cohérente. Tether s’appuie sur les flux de trésorerie constants générés par le plus grand stablecoin mondial pour construire une architecture d’IA fondée sur l’exécution locale, les réseaux pair-à-pair, les outils open source et les modèles légers pour l’edge, étendant ainsi la philosophie de souveraineté autonome des stablecoins du domaine monétaire à celui de l’intelligence.

Aujourd’hui, le secteur ne remet plus en cause la capacité des géants des stablecoins à s’implanter dans le domaine de l’IA — la réponse est évidente.

La véritable question centrale est la suivante : QVAC parviendra-t-il à concevoir des modèles et des infrastructures suffisamment performants pour convaincre les utilisateurs d’accepter un certain niveau de complexité opérationnelle, en échange d’une maîtrise locale et autonome ?

MedPsy constitue justement la première barrière mesurable. Les résultats des reproductions tierces détermineront si la narration psychohistorique de QVAC demeurera un simple métaphore de science-fiction, ou s’imposera bel et bien comme une architecture fondamentale opérationnelle, pleinement intégrée au segment dominant de l’IA edge.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News