Fondateur d’a16z : À l’ère des agents, ce qui compte vraiment a changé

TechFlow SélectionTechFlow Sélection

Fondateur d’a16z : À l’ère des agents, ce qui compte vraiment a changé

Les meilleurs programmeurs de demain ne devront peut-être pas savoir écrire de code, mais devront impérativement posséder une capacité exceptionnelle de raisonnement logique et de conception architecturale des systèmes, car le code deviendra un produit bon marché grâce à l’intelligence artificielle.

Auteur : a16z

Traduction : FuturePulse

Source du signalement : Il s’agit de la toute dernière interview de Marc Andreessen, fondateur d’a16z, diffusée sur le podcast Latent Space. Entrepreneur internet américain renommé, il a joué un rôle clé dans les débuts du développement d’internet ; après avoir fondé a16z, il est devenu l’un des investisseurs les plus influents de la Silicon Valley. L’ensemble de cet échange porte sur l’histoire du développement de l’IA et ses tendances les plus récentes — une lecture hautement recommandée.

I. Cette vague d’IA n’apparaît pas « du jour au lendemain » : elle marque la première fois, après 80 ans de course technologique, que ces outils entrent pleinement en service

- Cette vague d’IA ne surgit pas ex nihilo, mais constitue le fruit d’une course technologique de 80 ans.

- Marc Andreessen qualifie lui-même la situation actuelle de « succès nocturne de 80 ans », soulignant que l’explosion soudaine perçue par le grand public repose en réalité sur des décennies d’accumulation technologique, désormais libérées de façon concentrée.

- Il remonte cette lignée technologique aux premières recherches sur les réseaux de neurones, insistant sur le fait que l’industrie considère aujourd’hui comme acquise la validité fondamentale de l’architecture des réseaux de neurones.

- Selon lui, les jalons décisifs ne sont pas des moments isolés, mais une série d’étapes accumulées : AlexNet, le modèle Transformer, ChatGPT, les modèles de raisonnement (reasoning models), puis les agents et l’amélioration récursive de soi (self-improvement).

- Il met particulièrement l’accent sur le fait que cette fois-ci, ce n’est pas seulement la génération de texte qui s’est améliorée, mais bien quatre capacités qui apparaissent simultanément : les grands modèles linguistiques (LLM), le raisonnement, la programmation (coding), ainsi que les agents et l’amélioration récursive de soi.

- C’est précisément parce que ces capacités commencent à accomplir concrètement des tâches réelles qu’il affirme : « Cette fois-ci, c’est différent » — non pas parce que le récit est plus séduisant, mais parce que ces fonctionnalités sont désormais opérationnelles.

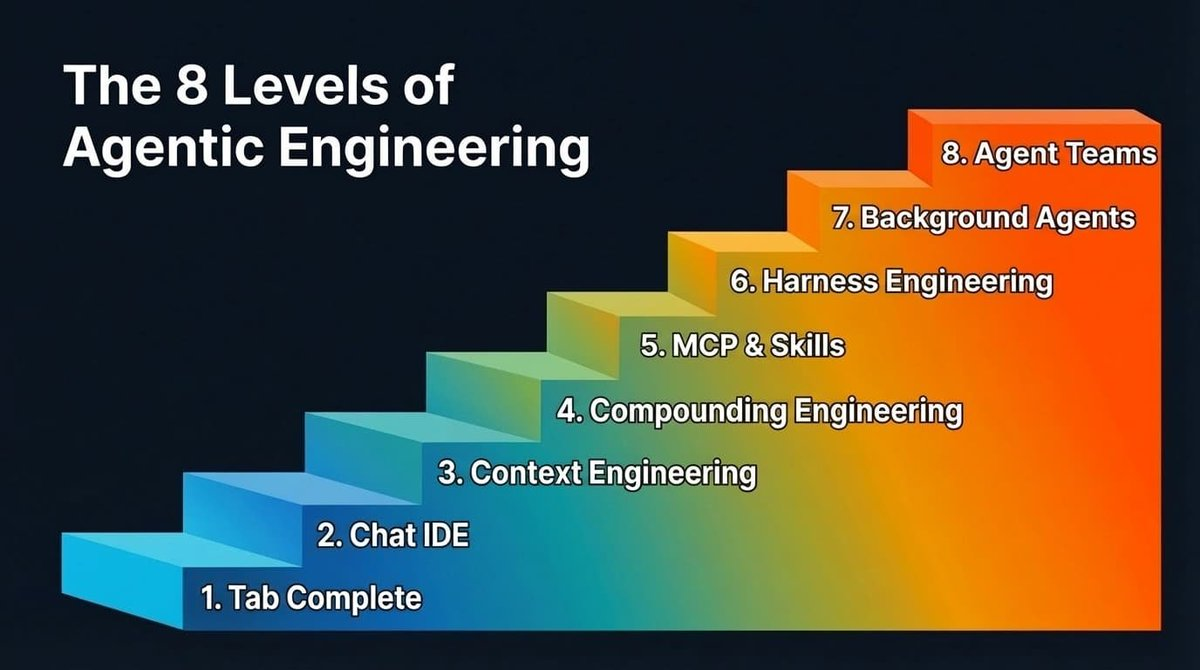

II. L’architecture des agents, incarnée par Pi et OpenClaw, représente une évolution logicielle bien plus profonde que celle des chatbots

- Il décrit les agents de façon très concrète : ils reposent essentiellement sur « un LLM + un shell + un système de fichiers + du markdown + cron/une boucle ». Dans cette architecture, le LLM assure le cœur du raisonnement et de la génération, le shell fournit l’environnement d’exécution, le système de fichiers conserve l’état, le markdown rend cet état lisible, tandis que cron ou la boucle permettent un réveil périodique et la progression des tâches.

- Il insiste sur l’importance de cette combinaison : hormis le modèle lui-même, tous les autres composants sont déjà des éléments éprouvés, compréhensibles et réutilisables du monde logiciel.

- L’état des agents étant stocké dans des fichiers, il peut être transféré d’un modèle à un autre, d’un environnement d’exécution (runtime) à un autre ; le modèle sous-jacent peut être remplacé sans perdre la mémoire ni l’état.

- Il revient à plusieurs reprises sur la notion d’introspection : l’agent connaît ses propres fichiers, peut lire son propre état, voire modifier ses propres fichiers et fonctionnalités, avançant ainsi vers l’objectif d’« extension de soi » (extend yourself).

- Pour lui, la véritable percée ne réside pas simplement dans le fait que le modèle « sait répondre », mais plutôt dans la capacité de l’agent à exploiter l’ensemble de la chaîne d’outils Unix existante, intégrant ainsi tout le potentiel latent de l’ordinateur.

III. L’ère du navigateur web, des interfaces graphiques traditionnelles et des logiciels actionnés manuellement par l’utilisateur sera progressivement remplacée par une interaction « agent-first »

- Marc Andreessen a clairement déclaré que, à l’avenir, « vous pourriez ne plus avoir besoin d’interface utilisateur ».

- Il précise davantage que les principaux utilisateurs des logiciels de demain ne seront probablement pas des humains, mais d’autres « bots ».

- Cela signifie que de nombreuses interfaces conçues aujourd’hui pour les clics, la navigation et le remplissage de formulaires par les humains se réduiront progressivement à un simple niveau d’exécution appelé en arrière-plan par les agents.

- Dans ce nouveau monde, l’humain agira surtout comme celui qui définit les objectifs : il indiquera au système ce qu’il souhaite obtenir, puis laissera l’agent invoquer les services requis, manipuler les logiciels et mener à bien les processus.

- Il relie ce changement à une vision plus large de l’avenir du logiciel : les logiciels de haute qualité deviendront de plus en plus « abondants », cessant d’être des produits rares, façonnés à la main par un petit nombre d’ingénieurs.

- Il juge également que l’importance des langages de programmation diminuera : les modèles seront capables d’écrire des programmes dans plusieurs langages, de les traduire entre eux, et à terme, les humains s’intéresseront davantage à comprendre pourquoi l’IA structure le code de telle manière qu’à rester attachés à un langage spécifique.

- Il évoque même une direction encore plus radicale : d’un point de vue conceptuel, l’IA pourrait non seulement générer du code, mais aussi produire directement des binaires (binary) ou des poids de modèles (model weights).

IV. Ce cycle d’investissement dans l’IA présente des similitudes avec la bulle internet de 2000, mais la structure fondamentale de l’offre et de la demande en diffère profondément

- En revenant sur l’an 2000, il souligne que l’effondrement fut largement dû non pas à un échec de l’internet lui-même, mais à une surcapacité massive dans les infrastructures de télécommunications et de bande passante : les fibres optiques et les centres de données avaient été déployés de façon prématurée, nécessitant ensuite une longue période d’absorption.

- Il reconnaît que des inquiétudes similaires liées à une « surcapacité » émergent aujourd’hui, mais précise que les principaux investisseurs sont désormais des grandes entreprises dotées de trésoreries solides (Microsoft, Amazon, Google), et non plus des acteurs fragiles fortement endettés.

- Il insiste notamment sur le fait que, aujourd’hui, tout investissement conduisant à une capacité GPU opérationnelle se transforme généralement rapidement en revenus — contrairement à l’an 2000, où d’importantes capacités restaient longtemps inutilisées.

- Il ajoute que la version de l’IA que nous utilisons actuellement est en réalité une version « freinée » (sandbagged) : faute de suffisamment de GPU, de mémoire ou de centres de données, le plein potentiel des modèles n’est pas encore déployé.

- Selon lui, les véritables contraintes des prochaines années ne résideront pas uniquement dans les GPU, mais aussi dans les CPU, la mémoire, les réseaux et les goulots d’étranglement systémiques de l’ensemble de l’écosystème des puces.

- Il place les lois d’échelle de l’IA (AI scaling laws) au même rang que la loi de Moore, considérant qu’elles ne décrivent pas seulement des tendances, mais qu’elles stimulent continuellement les flux de capitaux, l’ingénierie et la coordination industrielle.

- Il mentionne un phénomène contre-intuitif mais important : à mesure que l’optimisation logicielle s’accélère, certaines générations antérieures de puces peuvent même prendre de la valeur économique par rapport à leur prix d’achat initial.

V. L’open source, l’inférence en périphérie (edge inference) et l’exécution locale ne sont pas des solutions marginales, mais constituent une composante essentielle du paysage concurrentiel de l’IA

- Marc Andreessen affirme clairement que l’open source est extrêmement important, non seulement pour sa gratuité, mais surtout parce qu’il « permet à l’ensemble du monde d’apprendre comment cela fonctionne ».

- Il qualifie des publications open source telles que celles de DeepSeek de « cadeau offert au monde », car la diffusion conjointe du code et des articles scientifiques accélère la propagation des connaissances et élève le niveau minimum de compétence de toute l’industrie.

- Dans sa vision, l’open source n’est pas seulement un choix technique, mais aussi une stratégie géopolitique et commerciale : différents États et entreprises adopteront des niveaux d’ouverture variés, en fonction de leurs contraintes commerciales et de leurs objectifs d’influence.

- Il souligne également l’importance cruciale de l’inférence en périphérie (« Edge inference ») : durant les prochaines années, le coût de l’inférence centralisée ne sera probablement pas suffisamment bas pour que de nombreuses applications grand public puissent supporter durablement des coûts élevés d’inférence dans le cloud.

- Il cite un schéma récurrent : des modèles qui paraissent aujourd’hui « impossibles à faire tourner sur un PC » sont souvent effectivement exécutables localement quelques mois plus tard.

- Outre le coût, d’autres facteurs poussent à l’exécution locale : la confiance, la confidentialité, la latence et les scénarios d’utilisation — dispositifs portables, serrures intelligentes, objets personnels, etc., privilégient tous une inférence à faible latence et réalisée localement.

- Son jugement est sans ambiguïté : à l’avenir, pratiquement tout objet équipé d’une puce pourrait embarquer un modèle d’IA.

VI. Les vrais défis de l’IA ne résident pas seulement dans les capacités des modèles, mais aussi dans la sécurité, l’identité, les flux financiers, les organisations et les résistances institutionnelles

- Sur la sécurité, son analyse est très tranchée : presque tous les bogues de sécurité potentiels deviendront plus faciles à détecter, entraînant à court terme une « catastrophe mondiale de la cybersécurité ».

- Toutefois, il pense également que l’intelligence de programmation permettra de généraliser la correction des vulnérabilités ; à l’avenir, la manière de « protéger les logiciels » pourrait consister précisément à déléguer leur analyse et leur réparation à des bots.

- Sur la question de l’identité, il juge que la « preuve de robot » (proof of bot) est vouée à l’échec, car les bots deviendront de plus en plus performants ; la voie réellement praticable serait plutôt la « preuve d’humain » (proof of human), combinant biométrie, vérification cryptographique et divulgation sélective (selective disclosure).

- Il évoque aussi un problème souvent négligé : si les agents doivent effectivement agir dans le monde réel, ils auront finalement besoin d’argent, de moyens de paiement, voire d’une forme de compte bancaire, de carte ou d’infrastructure de type stablecoin. Sur le plan organisationnel, il emprunte le cadre du « capitalisme managérial » (managerial capitalism) pour avancer que l’IA pourrait renforcer la prééminence des entreprises dirigées par leurs fondateurs (founder-led company), car les bots excellent dans les tâches de reporting, de coordination, de traitement administratif et dans une multitude d’autres activités « managériales ».

- Il ne croit toutefois pas à une adoption rapide et fluide de l’IA par la société : citant les licences professionnelles, les syndicats, les grèves des dockers, les administrations publiques, l’enseignement primaire et secondaire (K–12), ou encore le secteur médical, il montre que le monde réel comporte de nombreux « freins institutionnels ».

- Son jugement est clair : tant les utopistes que les apocalyptiques de l’IA ont tendance à ignorer un point essentiel : le simple fait qu’une technologie soit possible ne signifie pas que les 8 milliards d’êtres humains vont immédiatement l’adopter.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News