Zhipu, Moonshot et Xiaomi réunis autour de la même table ronde : les grands modèles commencent réellement à « travailler », mais la puissance de calcul reste le goulot d’étranglement le plus important

TechFlow SélectionTechFlow Sélection

Zhipu, Moonshot et Xiaomi réunis autour de la même table ronde : les grands modèles commencent réellement à « travailler », mais la puissance de calcul reste le goulot d’étranglement le plus important

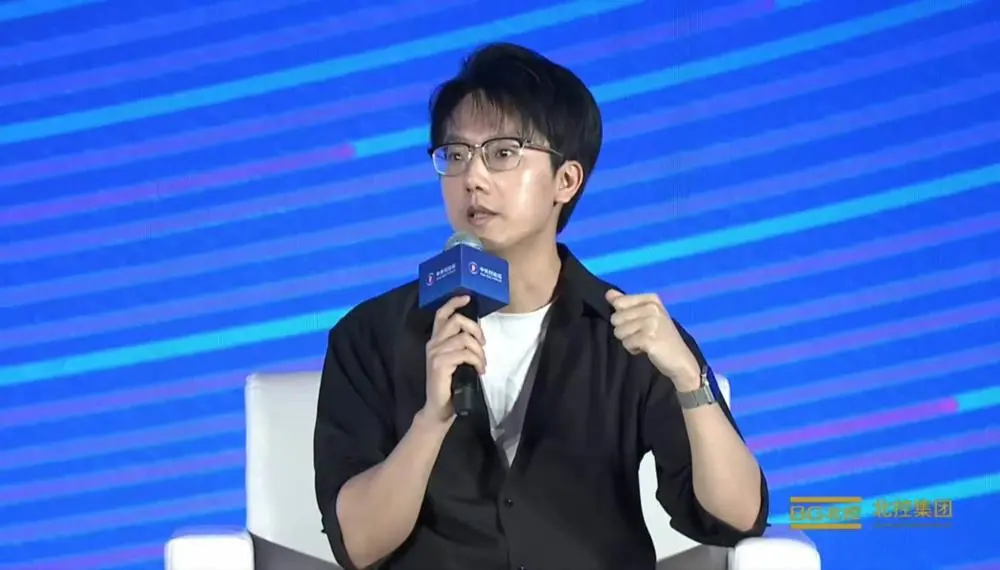

Modéré par Yang Zhilin, avec Luo Fuli et Zhang Peng partageant des informations concrètes, ce « dîner homard » a exploré en profondeur l’avenir de l’IA.

Auteur : Chen Jun-da

Zhixi Dongxi, 27 mars — Aujourd’hui, lors du Forum de Zhongguancun, Zhang Peng, PDG de Zhipu AI ; Yang Zhilin, PDG de Moonshot AI (modérateur) ; Luo Fuli, responsable des grands modèles MiMo chez Xiaomi ; Xia Lixue, PDG de InfraQ ; et Huang Chao, professeur adjoint à l’Université de Hong Kong se sont réunis sur scène dans une configuration rare pour un échange approfondi sur les perspectives futures des grands modèles open source et des agents intelligents.

Ce dialogue a pris pour point d’entrée OpenClaw, actuellement le projet le plus en vogue. Les intervenants ont unanimement estimé que les agents permettent enfin aux grands modèles de « travailler » réellement. Bien qu’OpenClaw étende les capacités des grands modèles, il en exige aussi davantage : Zhipu AI explore ainsi des fonctions telles que la planification à long terme et l’autocorrection, tandis que l’équipe de Luo Fuli privilégie des innovations architecturales visant à réduire les coûts, accélérer les performances, voire permettre l’auto-évolution des modèles.

L’infrastructure doit également s’adapter au rythme des agents. Selon Xia Lixue, les systèmes informatiques et les architectures logicielles actuels sont encore conçus pour les humains, non pour les agents — ce qui limite, en pratique, les capacités d’action des agents par celles des utilisateurs humains. Il est donc nécessaire de développer une « Agentic Infra ».

Pour plusieurs intervenants, l’open source constitue l’un des moteurs essentiels du développement des grands modèles et des agents. Le professeur adjoint à l’Université de Hong Kong, Huang Chao, considère notamment que la vitalité de l’écosystème open source est la clé pour faire passer les agents d’un simple « jouet » à de véritables « travailleurs ». Seule une construction collective par la communauté permettra de transformer progressivement logiciels, données et technologies vers une forme native des agents, afin de bâtir finalement un écosystème mondial d’IA durable.

En outre, les intervenants ont débattu de sujets tels que la hausse des prix des grands modèles, l’explosion de la consommation de tokens et les mots-clés définissant l’avenir de l’IA au cours des 12 prochains mois. Voici les points essentiels issus de cette table ronde :

1. Zhang Peng : L’augmentation de la taille des modèles entraîne une hausse proportionnelle des coûts d’inférence. La stratégie récente de hausse des tarifs adoptée par Zhipu AI correspond en réalité à un retour à une juste valeur commerciale ; une concurrence à bas prix sur le long terme nuirait au développement du secteur.

2. Zhang Peng : L’essor des nouvelles technologies comme les agents a multiplié par 10 la consommation de tokens, mais la demande réelle pourrait être multipliée par 100, avec encore de nombreux besoins insatisfaits. La puissance de calcul demeure donc la question centrale pour les 12 prochains mois.

3. Luo Fuli : Du point de vue des fournisseurs de grands modèles de base, OpenClaw garantit le niveau minimal de performance des grands modèles tout en repoussant leurs limites supérieures. La combinaison de modèles open source chinois et d’OpenClaw atteint désormais un taux d’exécution des tâches très proche de celui de Claude.

4. Luo Fuli : DeepSeek a redonné courage et confiance aux développeurs chinois de grands modèles. Certaines innovations architecturales, perçues initialement comme des compromis faits au nom de l’efficacité, ont en réalité déclenché une véritable révolution, permettant à l’industrie d’atteindre le plus haut niveau d’intelligence possible avec une puissance de calcul donnée.

5. Luo Fuli : Au cours de la prochaine année, l’élément le plus crucial du cheminement vers l’AGI sera l’« auto-évolution ». Celle-ci permet aux grands modèles d’explorer comme des scientifiques de premier plan, et constitue le seul levier véritable pour « créer de nouvelles choses ». Xiaomi a déjà accru son efficacité de recherche par un facteur 10 grâce à Claude Code couplé à des modèles de pointe.

6. Xia Lixue : À l’ère de l’AGI, l’infrastructure elle-même devra être un agent, capable de gérer de façon autonome l’ensemble de ses composants, d’itérer en fonction des besoins des clients IA, et d’assurer sa propre évolution et son propre perfectionnement.

7. Xia Lixue : OpenClaw a déclenché une explosion de la consommation de tokens. La vitesse actuelle de consommation de tokens évoque fortement celle des premiers temps de la 3G, lorsque chaque utilisateur ne disposait que de 100 Mo de données mobiles par mois.

8. Huang Chao : À l’avenir, de nombreux logiciels ne seront plus destinés aux humains : logiciels, données et technologies devront tous adopter une forme « Agent-Native ». Les humains n’auront probablement plus besoin que des interfaces graphiques (GUI) leur procurant du plaisir.

Voici le compte rendu intégral de cette table ronde :

01. OpenClaw, une « échafaudage », et la consommation de tokens des grands modèles reste encore à l’ère 3G

Yang Zhilin : Je suis honoré d’accueillir aujourd’hui ces intervenants de renom, représentant respectivement les couches des modèles, de l’infrastructure de calcul et des agents. Les deux mots-clés centraux de notre discussion sont aujourd’hui l’open source et les agents.

Première question : parlons d’OpenClaw, actuellement le projet le plus populaire. Quels aspects d’OpenClaw ou de produits similaires vous semblent les plus novateurs ou marquants dans votre usage quotidien ? D’un point de vue technique, comment percevez-vous l’évolution actuelle d’OpenClaw et des agents associés ?

Zhang Peng : J’ai commencé à expérimenter OpenClaw très tôt, à une époque où il s’appelait encore Clawbot. En tant qu’ancien programmeur, j’ai moi-même testé et bidouillé ce système, ce qui m’a offert une expérience personnelle très concrète.

À mon avis, la percée majeure, ou la nouveauté la plus frappante apportée par OpenClaw, c’est qu’il n’est plus l’apanage exclusif des programmeurs ou des passionnés de technologie. Désormais, même un utilisateur lambda peut facilement exploiter les capacités des meilleurs modèles, notamment en programmation et dans le domaine des agents.

C’est pourquoi, dans mes échanges avec les autres participants, j’aime à qualifier OpenClaw d’« échafaudage ». Il offre une possibilité : un support solide, pratique et extrêmement souple, construit au-dessus des modèles de base. Chacun peut ainsi exploiter librement les nouvelles fonctions offertes par les modèles sous-jacents.

Autrefois, nos idées étaient souvent bridées par notre incapacité à écrire du code ou à maîtriser d’autres compétences techniques. Aujourd’hui, grâce à OpenClaw, nous pouvons réaliser nos projets simplement par le biais d’un échange conversationnel.

OpenClaw m’a profondément impressionné, voire a bouleversé ma compréhension de ce domaine.

Xia Lixue : Initialement, j’ai eu du mal à m’habituer à OpenClaw, car je suis habitué à interagir avec les grands modèles via un dialogue classique. Après utilisation, j’ai trouvé qu’OpenClaw réagissait assez lentement.

Mais j’ai ensuite pris conscience d’une différence fondamentale entre OpenClaw et les assistants conversationnels précédents : c’est avant tout une « personne » capable de mener à bien des tâches complexes. Une fois que j’ai commencé à lui confier des missions plus élaborées, j’ai constaté qu’il s’en acquittait remarquablement bien.

Cette prise de conscience m’a profondément marqué. Passer d’un modèle qui répond token par token à un assistant conversationnel, puis à un agent, voire à un « homard » (expression familière désignant un agent autonome), capable d’exécuter des tâches, élargit considérablement l’horizon de l’imagination autour de l’IA.

Parallèlement, cela impose des exigences accrues sur l’ensemble du système. C’est pourquoi, au début, j’avais l’impression qu’OpenClaw « laguait ». En tant qu’acteur de l’infrastructure, je vois clairement que OpenClaw ouvre de nouvelles opportunités tout en posant de nouveaux défis à l’ensemble de l’écosystème et des systèmes sous-jacents.

Toutes les ressources dont nous disposons actuellement ne suffisent pas à soutenir cette croissance exponentielle. Par exemple, dans notre entreprise, la consommation de tokens a doublé toutes les deux semaines depuis fin janvier, soit une multiplication par 10 à ce jour.

La dernière fois que j’ai observé une telle vitesse de croissance, c’était à l’époque de la 3G, lorsqu’on consommait les premiers mégaoctets de données mobiles. J’ai l’impression que la consommation actuelle de tokens évoque exactement cette période où l’on ne disposait que de 100 Mo par mois.

Dans ces conditions, l’optimisation et l’intégration de nos ressources doivent être améliorées. Il faut permettre à chacun — non seulement dans le domaine de l’IA, mais dans toute la société — d’utiliser pleinement les capacités d’IA d’OpenClaw.

En tant qu’acteur de l’infrastructure, je suis profondément enthousiaste face à cette ère, et convaincu qu’il existe encore de nombreuses pistes d’optimisation à explorer et à tester.

02. OpenClaw rehausse le potentiel des modèles nationaux ; la rupture dans les modes d’interaction est capitale

Luo Fuli : Pour ma part, je considère OpenClaw comme un événement révolutionnaire et disruptif dans l’évolution des cadres d’agents.

Parmi les personnes de mon entourage qui pratiquent intensivement la programmation, Claude Code reste encore leur premier choix. Toutefois, ceux qui utilisent OpenClaw constateront que sa conception cadre d’agents est largement en avance sur celle de Claude Code. Récemment, bon nombre des mises à jour de Claude Code tendent justement à s’en rapprocher.

Mon expérience personnelle avec OpenClaw est qu’il étend sans cesse mon champ d’imagination, à tout moment et en tout lieu. Claude Code me permettait initialement d’étendre ma créativité uniquement sur mon bureau, alors qu’OpenClaw le fait partout et à tout instant.

OpenClaw apporte deux valeurs fondamentales. Premièrement, il est open source. Cette caractéristique favorise grandement la participation active de la communauté, qui peut ainsi contribuer à son évolution — condition préalable indispensable.

Pour un cadre d’IA comme OpenClaw, une grande partie de sa valeur réside dans le fait qu’il élève considérablement le niveau maximal atteignable par les modèles nationaux, qui, bien que proches des modèles fermés, n’avaient pas encore tout à fait comblé l’écart.

Dans la plupart des scénarios, on constate que le taux d’exécution des tâches obtenu avec la combinaison d’un modèle open source chinois et d’OpenClaw est très proche de celui du dernier modèle Claude. En outre, OpenClaw assure également un niveau minimal robuste — grâce à un système Harness ou à son écosystème de « Skills », garantissant ainsi l’intégrité et la précision des tâches.

En résumé, du point de vue des développeurs de grands modèles de base, OpenClaw garantit le niveau minimal des grands modèles tout en repoussant leurs limites supérieures.

Par ailleurs, je pense qu’une autre contribution majeure d’OpenClaw à la communauté est d’avoir éveillé les esprits, en montrant que la couche des agents recèle un potentiel d’imagination bien plus vaste que celui des seuls grands modèles.

Récemment, j’ai observé que, au-delà des chercheurs, de plus en plus de personnes participent activement à la révolution AGI, et commencent à utiliser des cadres d’agents plus puissants tels que Harness ou Scaffold. Dans une certaine mesure, ils utilisent ces outils pour remplacer une partie de leur travail, libérant ainsi du temps pour se consacrer à des activités plus créatives.

Huang Chao : Je pense que, d’abord sur le plan des modes d’interaction, OpenClaw connaît un tel succès principalement parce qu’il procure une expérience plus « humaine ». Nous travaillons sur les agents depuis un ou deux ans, mais des outils comme Cursor ou Claude Code avaient davantage l’allure d’« outils ». OpenClaw, quant à lui, est le premier à s’intégrer directement dans une application de messagerie instantanée, créant une sensation proche de celle du « Jarvis personnel » idéal. Ce pourrait bien être là une rupture dans les modes d’interaction.

Par ailleurs, OpenClaw inspire la communauté en démontrant à nouveau la faisabilité d’un cadre simple mais efficace comme l’« Agent Loop ». Il relance aussi une réflexion fondamentale : avons-nous besoin d’un agent universel, capable de tout accomplir, ou plutôt d’un « petit majordome » — un système léger, comparable à un système d’exploitation ou à un échafaudage ?

L’approche d’OpenClaw consiste à proposer un « petit système » — ou « système d’exploitation homard » — accompagné de son écosystème, afin de susciter une attitude ludique et de mobiliser ainsi l’ensemble des outils disponibles dans cet écosystème.

Avec l’émergence de fonctionnalités telles que les « Skills » ou « Harness », de plus en plus de personnes peuvent concevoir des applications adaptées à des systèmes comme OpenClaw, pour les déployer dans tous les secteurs. Ce point s’intègre naturellement et étroitement à l’écosystème open source. Ce sont, à mon sens, les deux enseignements les plus importants tirés d’OpenClaw.

03. Le nouveau modèle GLM est spécifiquement conçu pour « travailler » ; la hausse des tarifs marque un retour à une juste valeur commerciale

Yang Zhilin : Zhang Peng, pourrais-tu nous parler du nouveau modèle GLM-5 Turbo récemment lancé par Zhipu AI ? J’ai compris qu’il intègre des améliorations substantielles en matière de capacités d’agent. Pourrais-tu nous présenter ses différences par rapport aux autres modèles ? Par ailleurs, nous avons noté une stratégie de hausse des tarifs : quel signal de marché cela envoie-t-il ?

Zhang Peng : Excellente question. Nous avons effectivement publié récemment une mise à jour anticipée, qui s’inscrit dans notre feuille de route globale.

L’objectif principal est de passer d’un simple « dialogue » à un véritable « travail » — ce que beaucoup ressentent actuellement : les grands modèles ne se contentent plus de discuter, ils accomplissent réellement des tâches pour les humains.

Or, « travailler » implique des exigences fonctionnelles très élevées : le modèle doit pouvoir planifier des tâches à long terme, procéder à des essais successifs, compresser le contexte, s’autocorriger, et traiter éventuellement des informations multimodales. Ces exigences diffèrent donc nettement de celles des modèles généraux orientés dialogue. GLM-5 Turbo a été précisément renforcé dans ces domaines, notamment pour accomplir des tâches prolongées — comme fonctionner sans interruption pendant soixante-douze heures, ou maintenir un cycle continu (loop) : nous y avons consacré beaucoup d’efforts.

Le problème de la consommation de tokens retient aussi beaucoup d’attention. Un modèle intelligent accomplissant des tâches complexes consomme une quantité colossale de tokens. Les utilisateurs lambda n’en prennent peut-être pas pleinement conscience, mais ils constatent vite, en consultant leur facture, que les coûts s’envolent. Nous avons donc optimisé ce point : face à des tâches complexes, le modèle utilise désormais des tokens de manière plus efficace. Globalement, l’architecture reste une architecture générique polyvalente, mais avec des renforcements ciblés sur des capacités spécifiques.

La hausse des tarifs s’explique aussi aisément. Comme mentionné précédemment, il ne s’agit plus désormais d’une simple question-réponse, mais d’une chaîne de raisonnement très longue. De nombreuses tâches nécessitent l’écriture de code et l’interaction avec les infrastructures sous-jacentes, suivies de débogage et de corrections constantes, ce qui engendre une consommation massive de ressources. Le volume de tokens requis pour accomplir une tâche complexe peut être dix à cent fois supérieur à celui nécessaire pour répondre à une simple question.

Une augmentation des tarifs est donc justifiée. Par ailleurs, les modèles augmentent de taille, ce qui accroît mécaniquement les coûts d’inférence. Nous revenons ainsi à une juste valeur commerciale, car une concurrence à bas prix sur le long terme nuirait à l’ensemble du secteur. Cela permet aussi de boucler positivement la boucle commerciale, d’optimiser continuellement les capacités des modèles, et d’offrir un service toujours meilleur.

04. Construire une usine de tokens plus efficace ; l’infrastructure elle-même doit devenir un agent

Yang Zhilin : Le nombre de modèles open source augmente sans cesse, et un écosystème commence à se former, permettant à divers modèles d’apporter plus de valeur aux utilisateurs sur différentes plateformes de calcul. Avec l’explosion de la consommation de tokens, les grands modèles passent progressivement de l’ère de l’entraînement à celle de l’inférence. Xia Lixue, quels défis et opportunités cela représente-t-il pour InfraQ, du point de vue de l’infrastructure ?

Xia Lixue : Nous sommes un fournisseur d’infrastructures né dans l’ère de l’IA, et nous soutenons actuellement Zhipu AI, Kimi, MiMo, etc., afin qu’ils exploitent leur « usine de tokens » de façon plus efficace. Nous collaborons également avec de nombreuses universités et instituts de recherche.

Nous nous interrogeons donc constamment : quelle infrastructure l’ère de l’AGI exigera-t-elle ? Et comment pouvons-nous progressivement la concevoir et la déployer ? Nous sommes déjà pleinement préparés aux problèmes à résoudre à court, moyen et long termes.

Le défi immédiat est celui que vous venez d’évoquer : l’explosion de la consommation de tokens déclenchée par OpenClaw, qui impose une optimisation accrue de l’efficacité des systèmes. Même la révision des tarifs est une réponse à cette exigence.

Notre stratégie consiste à intégrer matériel et logiciel. Par exemple, nous avons connecté presque tous les types de puces de calcul disponibles, reliant ainsi une dizaine de puces différentes et des dizaines de clusters de calcul distincts. Cela permet de pallier la pénurie de ressources de calcul dans les systèmes IA : quand les ressources font défaut, la meilleure solution est d’abord de mobiliser toutes celles disponibles, puis d’optimiser leur utilisation pour obtenir le meilleur rendement possible.

À ce stade, notre objectif est donc de construire une usine de tokens plus efficace. Nous y avons réalisé de nombreuses optimisations, notamment en assurant une adéquation optimale entre les modèles et les ressources matérielles (comme la mémoire vidéo), ou encore en explorant les synergies possibles entre les nouvelles architectures de modèles et celles des matériels. Mais résoudre les problèmes d’efficacité actuels ne fait que créer une usine de tokens standardisée.

Pour l’ère des agents, cela ne suffit pas. Car un agent ressemble davantage à une personne à qui l’on peut confier une tâche. Je suis convaincu que de nombreuses infrastructures issues de l’ère du cloud computing ont été conçues pour servir un programme ou un ingénieur humain, non pour l’IA. Cela revient à construire une infrastructure dotée d’une interface destinée aux humains, puis à y ajouter une couche supplémentaire pour y connecter les agents — ce qui limite, en pratique, les capacités d’action des agents par celles des utilisateurs humains.

Prenons un exemple : un agent peut penser et lancer une tâche en quelques millisecondes, mais des capacités fondamentales comme Kubernetes (K8s) ne sont pas préparées à cela, car les humains lancent généralement des tâches à l’échelle de la minute. Nous devons donc aller plus loin, et développer ce que nous appelons une « Agentic Infra » — une « usine de tokens intelligente », ce à quoi InfraQ s’emploie actuellement.

À plus long terme, à l’ère véritable de l’AGI, nous pensons que l’infrastructure elle-même devra être un agent. L’usine que nous construisons devra être capable de s’auto-évoluer et de s’auto-perfectionner, formant ainsi une entité autonome. Elle aurait un PDG — cet PDG étant lui-même un agent, peut-être OpenClaw — chargé de gérer l’ensemble de l’infrastructure, d’identifier les besoins des clients IA et d’itérer sur l’infrastructure en conséquence. Seul un tel couplage IA-IA permettrait une synergie optimale. Nous menons déjà des recherches dans ce sens, notamment pour améliorer la communication entre agents ou développer des capacités comme le « cache-to-cache ».

Nous réfléchissons donc constamment à la manière dont l’infrastructure et l’IA doivent évoluer non pas de façon isolée — où je recevrais une demande et la mettrais simplement en œuvre — mais en produisant des interactions riches et dynamiques. Ce n’est que de cette manière que l’on atteindra une véritable synergie matériel-logiciel et algorithme-infrastructure, mission à laquelle InfraQ aspire depuis toujours. Merci.

05. Les innovations « faites pour l’efficacité » ont aussi leur sens ; DeepSeek a redonné courage et confiance aux équipes nationales

Yang Zhilin : Passons maintenant à Luo Fuli. Xiaomi a récemment publié de nouveaux modèles et ouvert les technologies sous-jacentes, apportant une contribution majeure à la communauté. Quels atouts Xiaomi possède-t-il selon toi dans le domaine des grands modèles ?

Luo Fuli : Je préfère d’abord écarter la question des atouts spécifiques de Xiaomi, pour aborder plutôt un avantage collectif des équipes chinoises spécialisées dans les grands modèles. Ce sujet revêt une portée plus large.

Il y a environ deux ans, les équipes chinoises de modèles de base ont déjà accompli de remarquables percées : dans des conditions de puissance de calcul limitée — notamment avec des bandes passantes restreintes sur les interconnexions NVLink — elles ont su contourner ces limitations liées à des ressources de calcul modestes, en introduisant des innovations architecturales apparemment « faites pour l’efficacité », telles que les séries DeepSeek V2 et V3, ou encore les architectures MoE et MLA.

Or, ces innovations ont déclenché une véritable révolution : comment exploiter au mieux l’intelligence disponible, avec une puissance de calcul donnée ? C’est ce que DeepSeek a apporté à toutes les équipes chinoises de modèles de base — du courage et de la confiance. Aujourd’hui, nos puces nationales, notamment celles dédiées à l’inférence ou à l’entraînement, ne subissent plus ces contraintes. Mais c’est précisément dans ce contexte de limitation que sont nées de nouvelles explorations visant à améliorer l’efficacité de l’entraînement et à réduire les coûts d’inférence.

Des architectures récentes comme Hybrid Sparse ou Linear Attention — par exemple NSA de DeepSeek, KSA de Kimi, ou HySparse de Xiaomi — sont toutes des innovations architecturales destinées à l’ère des agents, et se distinguent nettement des architectures MoE de la génération précédente.

Pourquoi ces innovations architecturales sont-elles si importantes ? Si vous utilisez réellement OpenClaw, vous constaterez qu’il devient de plus en plus intuitif et intelligent. L’un des prérequis est la longueur du contexte utilisé lors de l’inférence. La gestion de contextes longs est un sujet ancien, mais existe-t-il vraiment aujourd’hui des modèles capables de performer de façon stable, robuste et économique sur des contextes très longs ?

Beaucoup de modèles ne sont pas incapables de gérer un contexte de 1 million ou 10 millions de tokens, mais le coût et la lenteur de l’inférence sur de tels volumes sont prohibitifs. Seule une réduction des coûts et une accélération des performances permettront de confier aux modèles des tâches à haute valeur productive, et d’exécuter des tâches plus complexes — voire d’atteindre l’auto-itération du modèle — sur de longs contextes.

L’auto-itération du modèle signifie qu’il peut, dans un environnement complexe, s’auto-évoluer grâce à un contexte très long. Cette évolution peut concerner le cadre d’agents lui-même, ou même les paramètres du modèle — car le contexte est, à mon avis, une forme d’évolution des paramètres. La conception d’une architecture supportant des contextes longs, et la réalisation d’une inférence efficace sur ces contextes, constituent donc une compétition globale.

Outre l’exploration, dès l’entraînement initial, d’architectures « long-context-efficient » — un sujet sur lequel nous travaillons depuis environ un an — la vraie difficulté actuelle réside dans l’obtention de stabilité et de hautes performances sur des tâches à long terme, ce que nous cherchons à résoudre actuellement par des innovations dans la phase de post-entraînement.

Nous réfléchissons à la conception d’algorithmes d’apprentissage plus efficaces, à la collecte de textes réellement dotés de dépendances à long terme dans des contextes de 1 million, 10 millions ou 100 millions de tokens, et à l’intégration de données issues de trajectoires générées dans des environnements complexes. Voilà ce que nous faisons actuellement en post-entraînement.

Mais à plus long terme, avec la progression fulgurante des grands modèles et le soutien des cadres d’agents, comme l’a souligné Xia Lixue, la demande d’inférence a déjà augmenté d’un facteur proche de dix. La consommation globale de tokens connaîtra-t-elle cette année une croissance de cent fois ?

Nous entrons alors dans une nouvelle dimension concurrentielle — celle de la puissance de calcul, des puces d’inférence, voire, à un niveau plus fondamental, de l’énergie. Si nous réfléchissons collectivement à cette question, j’espère beaucoup apprendre de vous. Merci.

06. Trois modules clés pour les agents ; l’explosion des agents multiples aura un fort impact

Yang Zhilin : Des analyses très perspicaces. Passons maintenant à Huang Chao, qui a développé Nanobot, un projet d’agent particulièrement influent, et compte de nombreux adeptes dans la communauté. Du point de vue du cadre Harness ou des applications d’agents, quels sont les axes technologiques que tu juges importants et dignes d’attention ?

Huang Chao : Si l’on abstrait la technologie des agents, les trois modules clés sont la planification (Planning), la mémoire (Memory) et l’utilisation d’outils (Tool Use).

Commençons par la planification. Le problème actuel réside dans les tâches à long terme ou les contextes très complexes, par exemple comportant 500 étapes ou davantage : de nombreux modèles ne parviennent pas à planifier efficacement. Fondamentalement, cela tient au fait que les modèles manquent peut-être de ces savoirs implicites, surtout dans des domaines verticaux complexes. À l’avenir, il faudra probablement intégrer ces connaissances relatives aux tâches complexes directement dans les modèles — une piste prometteuse.

Bien entendu, les « Skills » et « Harness » atténuent dans une certaine mesure les erreurs liées à la planification, car ils fournissent des « Skills » de haute qualité, guidant ainsi le modèle dans l’exécution de tâches difficiles.

Passons à la mémoire. La mémoire semble toujours souffrir de problèmes de compression inexacte ou de récupération imprécise des informations. Sous des tâches à long terme ou dans des scénarios complexes, la pression sur la mémoire explose. Actuellement, les projets comme OpenClaw utilisent essentiellement une mémoire très simple, basée sur un système de fichiers au format Markdown, partagée via des fichiers. À l’avenir, la mémoire devrait évoluer vers une conception hiérarchique, tout en devenant plus universelle.

Franchement, les mécanismes actuels de mémoire peinent à atteindre une universalité réelle — car les scénarios de programmation, de recherche approfondie ou multimodale impliquent des modalités de données très différentes. Comment assurer une recherche et un indexage efficaces de ces mémoires tout en conservant des performances élevées ? C’est toujours un arbitrage délicat.

En outre, OpenClaw ayant considérablement abaissé le seuil de création d’agents, nous allons probablement bientôt passer d’un seul « homard » à plusieurs. J’ai vu que Kimi propose déjà un mécanisme de « Swarm d’agents ». À l’avenir, chacun pourrait disposer d’une « troupe d’homards ».

Comparé à un seul homard, une troupe d’homards entraînera une explosion du contexte, ce qui exercera une pression considérable sur la mémoire. Aujourd’hui, aucun mécanisme satisfaisant n’existe encore pour gérer le contexte généré par une « troupe d’homards », notamment dans des scénarios complexes comme la programmation ou la découverte scientifique, où le modèle et l’ensemble de l’architecture d’agents subissent une forte tension.

Enfin, l’utilisation d’outils (Tool Use), c’est-à-dire les « Skills », pose aussi des problèmes similaires à ceux rencontrés autrefois avec MCP — notamment un manque de garantie de qualité et des risques de sécurité. Aujourd’hui, les « Skills » présentent le même défaut : s’il en existe beaucoup, peu sont de haute qualité, et les « Skills » médiocres nuisent à la précision d’exécution des tâches par les agents. On retrouve aussi des risques d’injection malveillante. Du point de vue de l’utilisation d’outils, la communauté devra donc améliorer l’écosystème des « Skills », voire permettre à ces derniers de s’auto-évoluer durant leur exécution.

En résumé, Planning, Memory et Tool Use constituent à la fois les points douloureux actuels des agents et les directions prometteuses pour l’avenir.

07. Les mots-clés des 12 prochains mois : écosystème, tokens durables, auto-évolution et puissance de calcul

Yang Zhilin : Vous avez tous deux abordé, sous des angles différents, un problème commun : à mesure que la complexité des tâches augmente, le contexte explose. Du point de vue des modèles, on peut augmenter la longueur native du contexte ; du point de vue des cadres d’agents (Harness), des mécanismes comme la planification, la mémoire ou les agents multiples permettent de supporter des tâches plus complexes, même avec des capacités de modèles limitées. Je pense que ces deux axes vont produire davantage de synergies dans les prochaines étapes, renforçant encore la capacité d’exécution des tâches.

Terminons par une projection ouverte. Chacun d’entre vous doit décrire, en un seul mot, la tendance du développement des grands modèles au cours des 12 prochains mois, ainsi que vos espérances. Nous commencerons par Huang Chao.

Huang Chao : Douze mois dans le domaine de l’IA semblent une éternité — on ignore totalement ce à quoi cela ressemblera dans douze mois.

Yang Zhilin : Initialement, j’avais écrit « cinq ans », mais j’ai modifié cela.

Huang Chao : Oui, rires. Le mot qui me vient à l’esprit est « écosystème ». Aujourd’hui, OpenClaw stimule fortement l’activité de la communauté, mais pour que les agents deviennent réellement des « travailleurs », et non plus simplement des jouets ou une simple curiosité, il faut qu’ils s’ancrent durablement comme des outils opérationnels, comme de véritables « collègues ».

Cela nécessite les efforts conjoints de l’ensemble de l’écosystème, notamment de l’open source : une fois les explorations technologiques et les modèles eux-mêmes ouverts, toute la communauté doit collaborer — que ce soit pour itérer les modèles, améliorer les plateformes de « Skills », ou développer divers outils — afin de créer un écosystème véritablement adapté aux « homards ».

Une tendance claire émerge : les logiciels futurs seront-ils encore destinés aux humains ? Je crois que beaucoup d’entre eux ne le seront plus — car les humains ont besoin d’interfaces graphiques (GUI), tandis que l’avenir sera orienté « Agent-Native ». Ce qui est intéressant, c’est que les humains n’utiliseront probablement plus que les GUI leur procurant du plaisir. Or, l’écosystème entier passe actuellement du mode GUI/MCP au mode CLI (ligne de commande). Il faut donc que l’écosystème transforme les systèmes logiciels, les données et les technologies en une forme « Agent-Native », pour que le développement global soit plus riche.

Luo Fuli : Réduire la question à un an est très pertinent. Si l’on parlait de cinq ans, selon ma propre définition de l’AGI, je dirais qu’elle est déjà réalisée. Donc, si je devais résumer en un mot l’élément le plus crucial du cheminement vers l’AGI au cours de la prochaine année, je choisirais « auto-évolution ».

Ce terme peut paraître mystérieux, et il a déjà été évoqué à plusieurs reprises au cours de l’année écoulée. Mais récemment, j’en ai acquis une compréhension plus profonde, et surtout une vision plus concrète et réalisable de sa mise en œuvre. La raison en est que, grâce à des modèles puissants, nous n’avions pas exploité pleinement le potentiel des modèles pré-entraînés dans le paradigme « Chat ». Or, les cadres d’agents ont justement débloqué ce potentiel. Lorsque nous demandons à un modèle d’exécuter des tâches sur une durée prolongée, nous découvrons qu’il peut apprendre et évoluer de lui-même.

Un essai simple consiste à intégrer, dans un cadre d’agents existant, une contrainte vérifiable, puis à instaurer une boucle (loop) qui incite le modèle à itérer continuellement l’optimisation de son objectif. On constate alors qu’il produit spontanément des solutions de plus en plus performantes. Cette auto-évolution peut déjà fonctionner pendant un ou deux jours, bien sûr selon la difficulté de la tâche.

Par exemple, dans certains domaines de recherche scientifique — comme la recherche de meilleures architectures de modèles — où des critères d’évaluation existent (par exemple, une PPL plus faible), nous constatons déjà que le modèle peut s’optimiser et s’exécuter de façon autonome pendant deux ou trois jours.

Du point de vue de mon équipe, l’auto-évolution est le seul levier permettant de « créer de nouvelles choses ». Elle ne remplace pas la productivité humaine existante, mais agit comme un scientifique de premier plan, explorant des domaines encore inconnus. Il y a un an, j’aurais estimé que ce calendrier s’étendait sur trois à cinq ans, mais aujourd’hui, je pense qu’il faut le ramener à un à deux ans. Très bientôt, nous serons peut-être capables d’associer un grand modèle à un cadre d’agents puissant d’auto-évolution, et d’accélérer la recherche scientifique d’au moins un ordre de grandeur.

J’ai déjà constaté que les chercheurs de mon équipe, dont le workflow est hautement incertain et créatif, ont vu leur efficacité de recherche multipliée par près de dix grâce à Claude Code combiné à des modèles de pointe. J’espère vivement que ce paradigme se propage à d’autres disciplines et domaines, ce qui montre à quel point l’« auto-évolution » est cruciale.

Xia Lixue : Mon mot-clé est « tokens durables ». Je constate que le développement de l’IA est un processus continu à long terme, et nous souhaitons qu’il dispose d’une vitalité durable. Du point de vue de l’infrastructure, une question majeure est que les ressources sont finies.

Tout comme le concept de développement durable, en tant qu’« usine de tokens », pouvons-nous fournir de façon continue, stable et à grande échelle des tokens, permettant aux meilleurs modèles de servir effectivement un plus grand nombre d’applications en aval ? C’est une question centrale à nos yeux.

Nous devons élargir notre perspective à l’ensemble de l’écosystème — de l’énergie à la puissance de calcul, en passant par les tokens et les applications — afin de créer une itération économique durable. Non seulement nous devons mobiliser l’ensemble des ressources de calcul nationales, mais aussi exporter ces capacités à l’international, afin d’intégrer et de coordonner les ressources mondiales.

Je pense aussi que la notion de « durabilité » permet de construire une économie chinoise originale des tokens. Autrefois, nous parlions de « Made in China », transformant notre capacité manufacturière bon marché en produits de qualité exportés mondialement.

Aujourd’hui, nous devons réaliser un « AI Made in China » — transformer durablement, via notre usine de tokens, les avantages chinois en matière d’énergie, etc., en tokens de haute qualité exportés à l’échelle mondiale, pour devenir véritablement l’« usine de tokens mondiale ». C’est la valeur que la Chine souhaite apporter à l’intelligence artificielle mondiale cette année.

Zhang Peng : Je serai

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News