Gradients : Infrastructure décentralisée d’entraînement de l’IA pour l’écosystème Bittensor

TechFlow SélectionTechFlow Sélection

Gradients : Infrastructure décentralisée d’entraînement de l’IA pour l’écosystème Bittensor

Gradients comble le manque d’infrastructures d’entraînement dans l’écosystème TAO et explore un nouveau paradigme d’« optimisation de l’IA pilotée par le marché », avec un potentiel à long terme de devenir une couche d’accès essentielle à l’entraînement décentralisé de l’IA.

Source : Institut de recherche CoinW

Résumé

Gradients est un sous-réseau d’entraînement IA décentralisé (SN56) construit sur Bittensor. Son cœur repose sur des mécanismes tels que la publication de tâches, la concurrence entre mineurs et le filtrage par des validateurs, transformant ainsi l’entraînement de modèles — processus technique complexe — en une collaboration réseau pilotée par le marché. Sur le plan architectural, Gradients associe l’AutoML et la puissance de calcul distribuée pour créer un marché d’entraînement centré sur des mécanismes incitatifs, abaissant non seulement les barrières à l’usage de l’IA, mais aussi améliorant l’efficacité d’utilisation des ressources de calcul. Du point de vue de l’écosystème et des données, Gradients a achevé la mise en place de son réseau de base, bien que ses poids incitatifs et ses entrées de fonds restent actuellement limités. Gradients comble ainsi le manque d’infrastructures d’entraînement dans l’écosystème TAO et explore un nouveau paradigme : « l’optimisation de l’IA pilotée par le marché ». À long terme, il possède un fort potentiel pour devenir une couche d’accès essentielle à l’entraînement décentralisé de l’IA.

1. Partons de l’AutoML Web2 : état actuel et limites de l’entraînement IA

1.1 Qu’est-ce que l’AutoML ?

Dans la conception traditionnelle, entraîner un modèle d’IA constitue une opération très exigeante sur le plan technique : elle nécessite que des ingénieurs préparent les données, sélectionnent les modèles, ajustent itérativement les hyperparamètres et évaluent les performances — un processus complexe et chronophage. L’AutoML (apprentissage automatique automatisé), quant à lui, vise précisément à automatiser ces étapes fastidieuses. On peut le considérer comme un « outil automatisé de construction de modèles » : l’utilisateur fournit simplement les données et précise l’objectif visé (par exemple, classification, prédiction ou reconnaissance), tandis que le système s’occupe automatiquement du choix du modèle, de l’ajustement des paramètres et de l’optimisation de l’entraînement. Cela permet de transformer l’IA d’un outil réservé à quelques ingénieurs spécialisés en une capacité accessible aux développeurs ordinaires voire aux entreprises — une étape décisive vers la démocratisation de l’IA.

1.2 Limites fondamentales de l’AutoML traditionnel

Aujourd’hui, les solutions AutoML dominantes sont proposées par des fournisseurs de services cloud, tels que Google Vertex AI ou AWS SageMaker, qui offrent une « formation IA en tant que service ». Bien que l’AutoML Web2 ait notablement abaissé les barrières à l’entrée, son modèle sous-jacent présente des limites évidentes. Premièrement, le problème de centralisation : la puissance de calcul, les tarifs et les règles sont entièrement contrôlés par la plateforme, ce qui crée une forte dépendance vis-à-vis d’un seul prestataire et supprime toute capacité de négociation pour l’utilisateur. Deuxièmement, les coûts sont élevés et peu transparents : les ressources GPU indispensables à l’entraînement de l’IA sont concentrées entre les mains des fournisseurs cloud, dont les mécanismes tarifaires font défaut de concurrence marchande. Enfin, l’efficacité de l’optimisation atteint une limite intrinsèque. Fondamentalement, l’AutoML traditionnel reste un système unique cherchant la solution optimale — quelle que soit sa sophistication, il ne fait qu’explorer une seule voie technologique. Son espace d’exploration est donc restreint et il ne peut pas tester simultanément plusieurs approches radicalement différentes. Ainsi, l’entraînement IA Web2 actuel constitue un « système fermé », où l’entraînement, l’optimisation et la gestion des ressources se déroulent entièrement au sein d’un environnement contrôlé par une seule plateforme. Ce modèle, bien qu’efficace, révèle progressivement ses limites face à la croissance continue de la demande.

2. Gradients : reconstruire l’entraînement IA à l’aide d’un « réseau »

2.1 Qu’est-ce que Gradients ? Une plateforme AutoML décentralisée

Dans le chapitre précédent, nous avons souligné que le principal défaut de l’AutoML Web2 réside dans son caractère « fermé » : l’entraînement dépend entièrement de la plateforme, les voies d’optimisation sont limitées et la circulation des ressources est entravée. Gradients constitue précisément une refonte de ce modèle. Né d’une communauté décentralisée d’ingénieurs lancée par WanderingWeights, Gradients s’appuie sur le réseau Bittensor et fonctionne comme un sous-réseau d’entraînement IA (Subnet 56). Contrairement aux plateformes traditionnelles, il ne propose pas de service centralisé, mais décompose le processus d’entraînement pour le confier à un réseau ouvert. L’utilisateur doit simplement définir son objectif (type de modèle et jeu de données), tandis que l’exécution de l’entraînement, l’optimisation des paramètres et la sélection des résultats sont toutes gérées automatiquement par le réseau. Dans ce cadre, l’entraînement IA passe d’un processus d’ingénierie complexe à une opération simplifiée — « soumettre une demande, obtenir un résultat » — plus proche d’une capacité universelle que d’un travail technique exigeant une expertise pointue.

2.2 D’un système fermé à une collaboration ouverte : quels problèmes Gradients résout-il ?

Le changement fondamental apporté par Gradients consiste à transformer un processus d’entraînement autrefois clos dans une plateforme unique en un processus collaboratif ouvert. La tâche d’entraînement n’est plus accomplie par un seul système, mais distribuée à plusieurs participants qui tentent chacun une solution en parallèle, avant qu’un mécanisme d’évaluation unifié ne retienne la meilleure. Cette architecture réduit d’abord la dépendance vis-à-vis des fournisseurs centralisés, ancrant l’entraînement sur une puissance de calcul distribuée ; ensuite, les ressources GPU dispersées sont intégrées dans un même réseau, formant ainsi un mode d’allocation des ressources plus proche d’un marché concurrentiel. Plus important encore, l’optimisation des modèles n’est plus cantonnée à une seule voie, mais explore simultanément plusieurs méthodes, permettant d’approcher progressivement des solutions meilleures et d’élever ainsi le plafond global d’optimisation.

2.3 Changement fondamental : d’un outil à un « marché d’entraînement »

Dans l’AutoML traditionnel, la plateforme agit davantage comme un outil, utilisant des algorithmes internes pour aider l’utilisateur à trouver la solution optimale. Dans Gradients, ce processus ressemble davantage à un « marché » en continu : l’utilisateur publie une demande, différents participants rivalisent autour de la même tâche, et un mécanisme d’évaluation sélectionne le résultat final. Par conséquent, les performances du modèle ne dépendent plus uniquement des capacités d’un seul système, mais émergent d’une compétition et d’une itération continues impliquant de multiples parties prenantes. L’AutoML cesse alors d’être un problème d’optimisation technique relativement clos pour devenir un processus dynamique piloté par des incitations, dont la capacité d’optimisation peut s’étendre indéfiniment avec l’augmentation du nombre de participants. Ce changement confère à l’entraînement IA des caractéristiques d’auto-évolution propres aux marchés.

2.4 Rôle dans l’écosystème TAO : couche d’infrastructure d’entraînement IA

Dans l’architecture des sous-réseaux de Bittensor, chaque Subnet remplit une fonction spécifique — inférence, traitement de données ou entraînement — et Gradients occupe précisément la couche d’entraînement. Il convertit la puissance de calcul dispersée en modèles concrets, et grâce à ses mécanismes de distribution des tâches et d’évaluation, assure une affectation et une optimisation continues de ces ressources. Par ailleurs, il relie l’offre de puissance de calcul à la demande de modèles, transformant ainsi l’entraînement — auparavant un simple processus de consommation de ressources — en un processus de collaboration réseau organisé et optimisé. Dans ce système, Gradients joue un rôle central : il convertit des ressources distribuées en capacités IA exploitables et soutient le développement des applications supérieures.

3. Architecture centrale : comment l’entraînement IA s’accomplit-il dans le réseau ?

Dans le chapitre précédent, nous avons indiqué que Gradients transforme l’entraînement IA d’un processus « réalisé à l’intérieur d’une plateforme » en un processus « accompli par collaboration réseau ». Mais comment ce réseau fonctionne-t-il concrètement ? Le cœur de ce chapitre consiste à décomposer clairement ce processus.

3.1 Entraînement distribué : comment une tâche est-elle « accomplie par plusieurs personnes » ?

On peut imaginer Gradients comme un « réseau de collaboration à l’entraînement » en activité permanente. Lorsqu’un utilisateur soumet une tâche d’entraînement, celle-ci n’est pas attribuée à un seul système, mais distribuée simultanément à plusieurs participants du réseau. Ces derniers utilisent tous les mêmes données et le même objectif pour expérimenter chacun une méthode différente d’entraînement, puis soumettent leurs résultats dans un délai imparti. Le système procède ensuite à une évaluation unifiée de ces résultats et sélectionne la solution la plus performante. Pour l’utilisateur, ce processus revient à lancer une seule tâche, ce qui équivaut à « solliciter » simultanément plusieurs approches d’optimisation distinctes et à choisir automatiquement la meilleure. L’essentiel ici ne réside pas dans la puissance individuelle d’un nœud, mais dans la combinaison d’essais parallèles multi-participants et de filtrage automatique, permettant d’approcher sans cesse la solution optimale.

Dans ce réseau, trois catégories d’acteurs interviennent principalement : les utilisateurs, les mineurs et les validateurs. Les utilisateurs définissent les besoins d’entraînement ; les mineurs fournissent la puissance de calcul et expérimentent diverses méthodes d’entraînement ; les validateurs évaluent les résultats et sélectionnent le meilleur modèle. Cette répartition des rôles garantit un fonctionnement continu de l’entraînement et une sélection itérative de solutions toujours meilleures. Globalement, cela forme un réseau collaboratif piloté par la « demande, l’offre et l’évaluation ».

3.2 AutoML pilotée par le marché

Comme illustré précédemment, Gradients ne se contente pas de transposer l’AutoML sur la blockchain : il modifie profondément la logique sous-jacente de l’optimisation des modèles en introduisant la participation multiple et des mécanismes incitatifs. Alors que l’AutoML traditionnel dépend d’un système unique cherchant la solution optimale dans un espace de recherche limité, Gradients étend ce processus à l’ensemble du réseau : différents participants explorent continuellement des méthodes variées autour d’une même tâche, et une évaluation unifiée permet de sélectionner et d’itérer constamment. L’optimisation des modèles cesse ainsi d’être un simple calcul ponctuel pour devenir un processus dynamique évolutif. Dans ce mécanisme, les résultats supérieurs obtiennent des récompenses plus importantes, attirant ainsi continuellement les participants à améliorer leurs stratégies et à faire progresser globalement les performances.

4. Mécanismes incitatifs et concurrentiels : comment l’entraînement IA génère-t-il une « boucle vertueuse » ?

4.1 Mécanisme incitatif (piloté par TAO) : de l’action d’entraînement au retour sur investissement

La clé de la pérennité de Gradients réside dans son mécanisme incitatif, qui s’appuie sur le système natif de Bittensor. Le TAO est le jeton natif du réseau Bittensor, servant de « vecteur de valeur » pour l’ensemble du réseau : d’une part, il récompense les participants qui fournissent de la puissance de calcul ou contribuent des modèles ; d’autre part, il permet, notamment via le staking, de participer à la répartition des poids des sous-réseaux, influençant ainsi la manière dont les ressources circulent entre les différents sous-réseaux.

Le réseau principal de Bittensor génère continuellement de nouveaux « émissions » (Emission), soit des jetons TAO (actuellement environ 3 600 TAO par jour), répartis selon des règles prédéfinies entre les différents sous-réseaux. La part allouée à chaque sous-réseau dépend de ses « performances » globales sur le réseau, telles que son niveau d’activité, la qualité de ses contributions ou encore le soutien financier qu’il reçoit. Pour le sous-réseau hébergeant Gradients, les TAO ainsi alloués sont redistribués en interne aux participants. Le critère principal de cette redistribution est la qualité des modèles fournis : plus un modèle est performant, plus son auteur reçoit de récompenses.

Concrètement, les mineurs soumettent leurs résultats d’entraînement, tandis que les validateurs testent et notent ces résultats. Le système calcule ensuite le « poids de contribution » de chaque participant en fonction de ces notes, puis répartit les récompenses proportionnellement à ce poids. Les modèles les plus performants (par exemple, ceux présentant une meilleure généralisation ou une stabilité accrue) obtiennent des gains plus importants, tandis que les validateurs recevant des récompenses plus élevées sont ceux dont les évaluations sont les plus justes et reflètent le mieux la qualité réelle. Cette conception lie directement « mieux faire » à « mieux gagner », incitant ainsi les participants à améliorer continuellement leurs modèles.

4.2 Concurrence entre sous-réseaux : une compétition non seulement interne, mais aussi externe

Outre la concurrence interne au sous-réseau, Gradients fait également face à une « concurrence horizontale » au sein de l’ensemble du réseau Bittensor. Comme les allocations de TAO sont dynamiques, les différents sous-réseaux se disputent des poids plus élevés. Seuls ceux produisant régulièrement des résultats de haute qualité et attirant un nombre croissant de participants obtiendront une part plus importante des récompenses. Ainsi, les incitations de Gradients ne dépendent pas uniquement des performances internes de ses modèles, mais aussi de sa compétitivité relative au sein de l’écosystème. Tout le système forme une boucle à plusieurs niveaux : concurrence entre modèles au sein du sous-réseau ; concurrence entre sous-réseaux sur la scène globale. En définitive, l’investissement en puissance de calcul, les performances des modèles et le retour économique sont étroitement liés, créant un mécanisme de rétroaction positive en continu.

4.3 Gradients 5.0 : de la concurrence simple à un « mécanisme de tournoi »

Sur la base de la concurrence continue initiale, Gradients a évolué vers un mécanisme plus structuré : le « tournoi d’entraînement ». On peut le concevoir comme une compétition cyclique : à chaque cycle, une fenêtre temporelle est définie, durant laquelle plusieurs participants rivalisent autour d’une même tâche, et des sélections successives permettent d’éliminer progressivement les moins performants jusqu’à désigner la solution optimale. Cette forme met l’accent sur des comparaisons périodiques et une évaluation concentrée. Un changement important réside dans le fait que les mineurs ne soumettent plus directement leurs résultats d’entraînement, mais plutôt leur « méthode d’entraînement » (code), qui est ensuite exécutée uniformément par les nœuds validateurs. Cette approche améliore d’abord l’équité, en éliminant les biais liés aux différences d’environnement de calcul, et protège ensuite mieux la confidentialité des données et du processus d’entraînement. En outre, les solutions gagnantes sont souvent conservées comme méthodes réutilisables, analogues à des « bonnes pratiques » accumulées progressivement. À long terme, ce mécanisme ne se contente pas de sélectionner le meilleur modèle, mais construit aussi une bibliothèque de méthodes d’entraînement en constante évolution.

5. Situation actuelle de l’écosystème

5.1 Structure des participants : un réseau collaboratif composé de demande, d’offre et d’évaluation

L’écosystème Gradients repose sur trois rôles fondamentaux : les utilisateurs (côté demande), les mineurs (côté offre) et les validateurs (côté évaluation). Les utilisateurs comprennent principalement des développeurs IA, des PME et des acteurs Web3. Ce groupe possède généralement un certain bagage technique, mais manque de puissance de calcul ou d’une capacité complète d’entraînement de modèles, ce qui le pousse à utiliser Gradients afin de construire des modèles à moindre coût. Les mineurs fournissent la puissance de calcul GPU et participent à la compétition autour des tâches d’entraînement, motivés principalement par l’obtention de récompenses en TAO. Les validateurs évaluent et classent les résultats d’entraînement : ils constituent un maillon essentiel pour assurer la qualité des modèles et le bon fonctionnement du mécanisme.

En examinant plus finement les profils utilisateurs, on observe que le groupe réellement actif sur Gradients présente une caractéristique nette de « semi-développeurs » : il se distingue à la fois des laboratoires IA de pointe et des utilisateurs ordinaires totalement dépourvus de compétences techniques, se composant majoritairement de développeurs et d’utilisateurs techniques Web3 dotés d’une certaine capacité d’ingénierie. Ce trait se retrouve également dans la structure communautaire : l’écosystème est aujourd’hui dominé par la langue anglaise, ses utilisateurs clés étant principalement situés en Amérique du Nord et en Europe, avec une présence notable de mineurs d’Asie du Sud-Est et de fournisseurs mondiaux de ressources GPU. Globalement, il s’agit d’une communauté technique orientée développeurs.

5.2 Situation actuelle du fonctionnement de l’écosystème

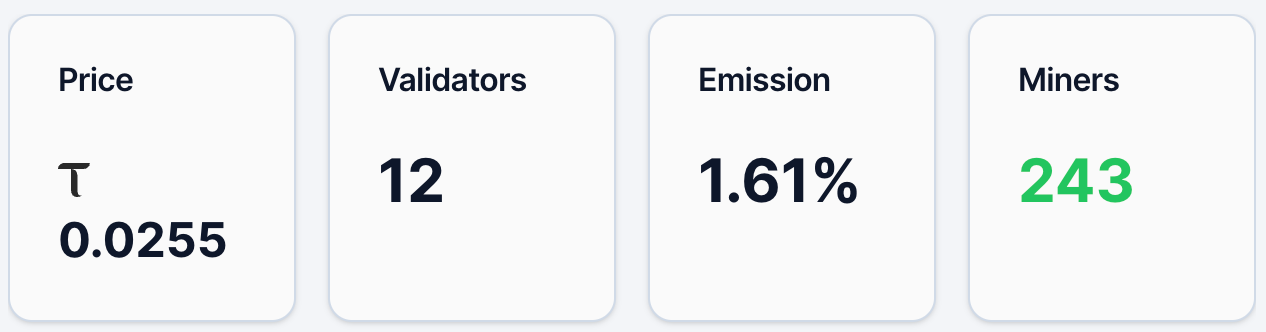

À la date du 12 mai, le prix du jeton alpha de Gradients s’élève à environ 0,0255 TAO, avec environ 4 890 adresses détentrices, 243 mineurs et 12 validateurs. La part de l’émission (Emission) est de 1,61 %. Par ailleurs, dans son pool de liquidité, la part de TAO est de 2,19 %, contre 97,81 % pour Alpha. D’après le prix et le nombre d’adresses détentrices, Gradients dispose déjà d’une base utilisateurs et d’une attention significatives, bien qu’il demeure encore à un stade précoce de diffusion. En comparaison avec Chutes, projet phare de l’écosystème TAO, le prix du jeton alpha était ce jour-là de 0,0877 TAO, avec 13 409 adresses détentrices.

Figure 1. Données Gradients.

Source : https://bittensormarketcap.com/subnets/56

Ensuite, le mécanisme d’émission (Emission) incitative. Dans l’écosystème Bittensor, l’« Emission » désigne la pondération en temps réel de la part des nouvelles récompenses allouées à ce sous-réseau au sein du réseau global. Le réseau Bittensor génère continuellement de nouveaux TAO, répartis entre les différents sous-réseaux selon leurs poids respectifs. Le taux actuel de 1,61 % signifie que Gradients ne reçoit qu’une petite fraction des nouvelles récompenses générées par le réseau. Cet indicateur reflète essentiellement le « vote » du marché, exprimé par les flux financiers (notamment via le staking), sur les différents sous-réseaux. Ainsi, un niveau de 1,61 % indique généralement une reconnaissance et des entrées de fonds relativement limitées, tout en laissant une marge de progression potentielle pour augmenter ce poids. Du point de vue de la structure des fonds (pool de liquidité), la part de TAO n’est que de 2,19 %, tandis qu’Alpha atteint 97,81 %, ce qui montre que les entrées de capitaux externes restent faibles et que l’offre provient actuellement surtout de l’intérieur du sous-réseau. Le prix est sensible aux nouveaux apports de fonds : une arrivée accrue de TAO pourrait avoir un effet multiplicateur plus marqué.

6. Paysage concurrentiel et analyse des forces/faiblesses

6.1 Positionnement sectoriel : infrastructure d’entraînement IA décentralisée et AutoML décentralisée

Gradients s’inscrit dans la niche spécialisée « infrastructure d’entraînement IA + AutoML décentralisée ». Il cherche à libérer l’entraînement des modèles des plateformes centralisées et à réaliser une utilisation plus efficace des ressources et une optimisation plus poussée des modèles via des mécanismes réseau. Dans l’écosystème Web2, ce segment est déjà relativement mature, avec des représentants emblématiques tels que Google Vertex AI et AWS SageMaker. Ces plateformes offrent aux développeurs des services intégrés d’entraînement et de déploiement de modèles via le cloud computing, mais reposent fondamentalement sur une architecture centralisée. En revanche, la différence de Gradients ne réside pas dans une « plus grande richesse fonctionnelle », mais dans une logique sous-jacente radicalement différente : il transforme l’entraînement d’un « service de plateforme » en une « collaboration réseau », et utilise des mécanismes concurrentiels pour sélectionner les meilleurs résultats, s’approchant ainsi davantage d’un système d’entraînement fonctionnant selon les principes d’un marché.

6.2 Comparaison transversale : différences entre AutoML Web2 et Web3

À une échelle plus large, la différence entre Web2 et Web3 dans le domaine de l’AutoML reflète deux paradigmes opposés. Le modèle Web2 privilégie l’efficacité et la stabilité : en concentrant les ressources et en optimisant l’ingénierie, il fournit une expérience de service contrôlée et éprouvée. Le modèle Web3, quant à lui, met l’accent sur l’ouverture et les mécanismes incitatifs : en intégrant la participation de multiples acteurs, il permet à l’optimisation des modèles d’évoluer continuellement dans un contexte concurrentiel. Plus concrètement, l’AutoML Web2 ressemble à « un outil puissant » : l’utilisateur confie sa tâche à la plateforme, qui recherche la solution optimale en interne. En revanche, l’AutoML Web3 représenté par Gradients ressemble davantage à « un marché ouvert » : l’utilisateur publie une demande, différents participants proposent des solutions, et un mécanisme d’évaluation sélectionne le résultat final. Cette différence produit un impact direct : le premier modèle est plus stable et contrôlable, mais ses voies d’optimisation sont limitées ; le second offre un espace d’exploration plus vaste et un potentiel de performance supérieur, bien qu’il doive encore progresser en termes de stabilité et de maturité.

6.3 Différenciation de Gradients dans l’écosystème Web3

Dans le paysage actuel de l’IA Web3, la plupart des projets se concentrent encore sur la couche d’inférence ou sur les agents IA, tandis que les initiatives spécifiquement axées sur « l’infrastructure d’entraînement » sont relativement rares. Certains projets tentent de combiner des réseaux de puissance de calcul ou de données pour offrir des capacités d’entraînement, mais globalement, la plupart restent au stade de l’orchestration des ressources ou du marché de la puissance de calcul. La spécificité de Gradients réside dans le fait qu’il va au-delà d’une simple mise en relation de puissance de calcul : il s’élève à la couche supérieure du « mécanisme d’optimisation des modèles » lui-même, en introduisant un système d’évaluation et de concurrence qui confère au processus d’entraînement une capacité d’évolution continue. Cela signifie qu’il ne résout pas seulement la question « d’où vient la puissance de calcul ? », mais aussi « comment utiliser plus efficacement cette puissance de calcul ? ». Dans cette perspective, Gradients s’apparente davantage à un réseau « orienté résultats d’entraînement », plutôt qu’à un simple marché de puissance de calcul ou une plateforme-outil — ce qui constitue sa principale distinction avec la plupart des autres projets IA Web3.

6.4 Avantages centraux : amélioration de l’efficacité pilotée par les mécanismes

En synthèse, les avantages de Gradients résident principalement dans sa conception mécanique. Premièrement, l’abstraction des tâches abaisse les seuils d’entrée, permettant aux utilisateurs d’obtenir des résultats de modèles sans devoir s’impliquer profondément dans les processus complexes d’entraînement, ce qui élargit considérablement sa base d’utilisateurs potentiels. Deuxièmement, au niveau des ressources, l’introduction de la puissance de calcul distribuée libère l’entraînement de la dépendance vis-à-vis d’un seul fournisseur cloud, ce qui permet théoriquement de former une structure de coûts plus souple grâce à la concurrence. Plus important encore, la façon dont l’optimisation est réalisée change fondamentalement. En combinant l’exploration parallèle de plusieurs participants avec un mécanisme de sélection, Gradients propose une alternative à l’optimisation unidirectionnelle traditionnelle, offrant ainsi aux modèles la possibilité d’atteindre des performances supérieures en un temps plus court. Ce modèle « d’optimisation pilotée par la concurrence » constitue son avantage le plus fondamental.

6.5 Défis potentiels

La qualité des modèles pourrait présenter des problèmes de stabilité. L’entraînement décentralisé dépend de la participation multiple, ce qui peut certes élever le plafond de performance, mais aussi engendrer des fluctuations dans les résultats. Par rapport aux systèmes centralisés, il comporte donc une certaine incertitude en matière de contrôle. Ensuite, le problème de la confiance au niveau entreprise. Pour les utilisateurs professionnels, la sécurité des données et la vérifiabilité du processus d’entraînement sont primordiales, or, dans un environnement décentralisé, garantir que les données ne soient pas détournées et que les résultats soient auditables demeure un défi critique. Enfin, la dépendance à l’égard de l’économie token. Le fonctionnement de Gradients repose fortement sur son mécanisme incitatif : si l’attractivité des récompenses en TAO diminue, cela risque d’affecter le niveau de participation des mineurs et l’activité globale du réseau. Sa pérennité à long terme dépend donc, dans une certaine mesure, de la capacité de son modèle économique à instaurer une boucle vertueuse stable.

7. Perspectives futures : l’AutoML décentralisée est-elle viable ?

Au stade actuel, Gradients en est encore à ses débuts. Sa réussite future dépendra de plusieurs facteurs clés : premièrement, sa capacité à attirer durablement des demandes réelles d’entraînement, et non seulement des participants motivés par les incitations ; deuxièmement, la qualité des modèles, c’est-à-dire si l’approche décentralisée peut produire de façon stable des résultats exploitables, voire supérieurs ; troisièmement, la capacité du mécanisme économique à générer une boucle vertueuse, assurant un équilibre durable entre l’offre de puissance de calcul et les revenus générés.

Dans un contexte sectoriel plus large, l’entraînement IA se scinde actuellement en deux voies. L’une, le modèle Web2, est dominée par les grandes entreprises technologiques qui renforcent continuellement les performances des modèles grâce à des ressources centralisées et à une ingénierie poussée, tirant parti de leur stabilité et de leur maturité. L’autre, incarnée par Gradients, est une voie Web3 qui, via un réseau ouvert et des mécanismes incitatifs, implique un plus grand nombre d’acteurs dans l’optimisation des modèles, faisant ainsi progresser sans cesse le plafond de performance. La première vise à « construire un système plus puissant », tandis que la seconde cherche plutôt à « construire un réseau capable de s’auto-évoluer ».

De ce point de vue, l’exploration menée par Gradients représente une nouvelle possibilité : l’entraînement IA n’est plus uniquement une question technique, mais une combinaison de « puissance de calcul + données + mécanismes de marché ». Si ce modèle s’avère viable, il pourrait devenir la porte d’entrée de l’entraînement IA décentralisé et jouer un rôle d’infrastructure clé au sein de l’écosystème Bittensor. Bien entendu, cette voie devra encore faire ses preuves dans le temps, mais elle offre déjà une trajectoire d’évolution de l’AutoML radicalement différente de l’approche traditionnelle.

Références

1. Documentation Bittensor : https://docs.learnbittensor.org

2. Site web de Gradients : https://www.gradients.io/

3. Gradients : https://bittensormarketcap.com/subnets/56

4. Compte X (anciennement Twitter) de Gradients : https://x.com/gradients_ai

5. Taostats : https://taostats.io/subnets/56/chart

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News