Chiến dịch phản công về năng lực tính toán AI của Trung Quốc

Tuyển chọn TechFlowTuyển chọn TechFlow

Chiến dịch phản công về năng lực tính toán AI của Trung Quốc

Chi phí bản thân chính là sự tiến bộ.

Tác giả: Sleepy.txt

Tám năm trước, ZTE từng trải qua một cơn ngừng tim đột ngột.

Ngày 16 tháng 4 năm 2018, một lệnh cấm của Cục An ninh Công nghiệp và An ninh Thương mại (BIS) thuộc Bộ Thương mại Hoa Kỳ khiến ZTE — nhà cung cấp thiết bị viễn thông lớn thứ tư thế giới với 80.000 nhân viên và doanh thu hàng năm vượt mốc 100 tỷ Nhân dân tệ — phải tạm dừng hoạt động toàn bộ chỉ trong một đêm. Nội dung lệnh cấm rất đơn giản: trong vòng bảy năm tới, bất kỳ công ty nào của Hoa Kỳ đều bị cấm bán linh kiện, hàng hóa, phần mềm và công nghệ cho ZTE.

Không còn chip Qualcomm, các trạm gốc ngừng sản xuất; không còn giấy phép sử dụng hệ điều hành Android của Google, điện thoại cũng mất đi hệ thống vận hành khả dụng. Sau 23 ngày, ZTE phát hành thông cáo báo chí khẳng định các hoạt động kinh doanh chủ chốt của công ty đã không thể tiếp tục.

Tuy nhiên, ZTE cuối cùng vẫn sống sót — nhưng với cái giá lên tới 1,4 tỷ USD.

Trong đó, 1 tỷ USD là khoản tiền phạt phải thanh toán một lần; 400 triệu USD là khoản tiền bảo đảm được gửi vào tài khoản phong tỏa tại một ngân hàng Hoa Kỳ. Ngoài ra, toàn bộ ban lãnh đạo phải thay mới hoàn toàn và chấp nhận sự giám sát tuân thủ từ một nhóm chuyên gia đến từ Hoa Kỳ. Trong suốt năm 2018, ZTE ghi nhận khoản lỗ ròng 7 tỷ Nhân dân tệ, doanh thu giảm mạnh 21,4% so với năm trước.

Ông Yin Yimin, khi ấy đang giữ chức Chủ tịch Hội đồng Quản trị ZTE, viết trong thư nội bộ: “Chúng ta đang hoạt động trong một ngành công nghiệp phức tạp, phụ thuộc sâu sắc vào chuỗi cung ứng toàn cầu.” Câu nói này, lúc bấy giờ nghe như một lời tự vấn và cũng là nỗi bất lực khôn nguôi.

Tám năm sau, vào ngày 26 tháng 2 năm 2026, DeepSeek — kỳ lân AI của Trung Quốc — tuyên bố rằng mô hình ngôn ngữ đa phương thức (multimodal) thế hệ V4 sắp ra mắt sẽ ưu tiên hợp tác sâu rộng với các nhà sản xuất chip nội địa, lần đầu tiên thực hiện thành công toàn bộ quy trình huấn luyện — từ tiền huấn luyện (pre-training) đến tinh chỉnh (fine-tuning) — mà không sử dụng giải pháp dựa trên chip NVIDIA.

Nói một cách dễ hiểu: Chúng tôi sẽ không dùng NVIDIA nữa.

Ngay khi tin tức được công bố, phản ứng đầu tiên của thị trường là hoài nghi. Thị phần của NVIDIA trên thị trường chip huấn luyện AI toàn cầu vượt quá 90%; việc từ bỏ nó có hợp lý về mặt thương mại hay không?

Nhưng lựa chọn của DeepSeek ẩn chứa một vấn đề lớn hơn logic thương mại: Ngành AI Trung Quốc thực sự cần một mức độ độc lập về năng lực tính toán (compute independence) như thế nào?

Điều thực sự “bị bóp cổ” là gì?

Nhiều người nghĩ rằng các lệnh cấm xuất khẩu chip chỉ nhắm vào phần cứng. Nhưng điều thực sự khiến các công ty AI Trung Quốc cảm thấy nghẹt thở lại là một thứ mang tên CUDA.

CUDA (Compute Unified Device Architecture) là nền tảng tính toán song song và mô hình lập trình do NVIDIA ra mắt năm 2006. Nó cho phép các nhà phát triển gọi trực tiếp năng lực xử lý của GPU NVIDIA nhằm tăng tốc các tác vụ tính toán phức tạp.

Trước thời đại AI, CUDA chỉ là một công cụ dành riêng cho một nhóm nhỏ kỹ sư chuyên sâu. Nhưng khi làn sóng học sâu (deep learning) ập đến, CUDA trở thành nền móng cho toàn bộ ngành công nghiệp AI.

Việc huấn luyện các mô hình ngôn ngữ lớn (LLM) về bản chất là thực hiện hàng loạt phép toán ma trận khổng lồ — chính xác là lĩnh vực GPU làm tốt nhất.

Nhờ chiến lược đầu tư sớm hơn cả chục năm, NVIDIA đã xây dựng một chuỗi công cụ hoàn chỉnh — từ phần cứng nền tảng đến ứng dụng phần mềm phía trên — dựa trên CUDA, phục vụ toàn bộ cộng đồng nhà phát triển AI toàn cầu. Ngày nay, tất cả các framework AI hàng đầu thế giới — từ TensorFlow của Google đến PyTorch của Meta — đều gắn bó mật thiết với CUDA ở tầng底层.

Một nghiên cứu sinh tiến sĩ chuyên ngành AI, ngay từ ngày đầu nhập học, đã học tập, lập trình và thực hiện thí nghiệm trong môi trường CUDA. Mỗi dòng mã họ viết ra đều góp phần củng cố thêm “thành trì” của NVIDIA.

Tính đến năm 2025, hệ sinh thái CUDA đã có hơn 4,5 triệu nhà phát triển, bao phủ hơn 3.000 ứng dụng được tăng tốc bởi GPU, và hơn 40.000 công ty trên toàn cầu đang sử dụng CUDA. Con số này cho thấy hơn 90% nhà phát triển AI toàn cầu đều bị ràng buộc chặt chẽ vào hệ sinh thái của NVIDIA.

Sức mạnh đáng sợ của CUDA nằm ở cơ chế “bánh xe quay” (flywheel effect): càng nhiều nhà phát triển sử dụng, càng xuất hiện thêm nhiều công cụ, thư viện và mã nguồn, hệ sinh thái càng phát triển mạnh mẽ; hệ sinh thái càng phát triển, lại càng thu hút thêm nhiều nhà phát triển gia nhập. Một khi bánh xe đã quay, gần như không thể ngăn chặn hay đảo ngược.

Kết quả là NVIDIA vừa bán cho bạn chiếc xẻng đắt nhất, vừa định nghĩa duy nhất tư thế đào mỏ. Bạn muốn đổi sang một chiếc xẻng khác? Được thôi. Nhưng trước hết, bạn phải viết lại toàn bộ kinh nghiệm, công cụ và mã nguồn mà hàng chục vạn bộ óc thông minh nhất thế giới đã tích lũy trong suốt hơn một thập kỷ dưới tư thế đào mỏ đó.

Chi phí này, ai sẽ chi trả?

Vì vậy, khi BIS áp đặt đợt kiểm soát đầu tiên vào ngày 7 tháng 10 năm 2022 — hạn chế xuất khẩu chip A100 và H100 của NVIDIA sang Trung Quốc — các công ty AI Trung Quốc lần đầu tiên cùng nhau cảm nhận được cảm giác nghẹt thở kiểu ZTE. Sau đó, NVIDIA tung ra phiên bản “đặc biệt cho thị trường Trung Quốc”: A800 và H800, giảm băng thông kết nối giữa các chip để tạm thời duy trì nguồn cung.

Nhưng chỉ một năm sau, vào ngày 17 tháng 10 năm 2023, đợt kiểm soát thứ hai được siết chặt hơn: A800 và H800 cũng bị cấm xuất khẩu, đồng thời 13 công ty Trung Quốc bị đưa vào danh sách thực thể. NVIDIA buộc phải ra mắt thêm phiên bản cắt giảm sâu hơn: H20. Đến tháng 12 năm 2024, đợt kiểm soát cuối cùng dưới nhiệm kỳ Tổng thống Biden được áp dụng, thậm chí xuất khẩu H20 cũng bị hạn chế nghiêm ngặt.

Ba đợt kiểm soát, mỗi đợt một khắt khe hơn.

Nhưng lần này, diễn biến câu chuyện hoàn toàn khác so với thời kỳ ZTE.

Một cuộc突 phá phi đối xứng

Dưới áp lực lệnh cấm, tất cả đều cho rằng giấc mơ mô hình ngôn ngữ lớn (LLM) của Trung Quốc sẽ chấm dứt tại đây.

Họ đã sai. Thay vì đối đầu trực diện, các công ty Trung Quốc chọn một hướng突 phá khác. Chiến trường đầu tiên của cuộc突 phá này không nằm ở phần cứng, mà ở thuật toán.

Từ cuối năm 2024 đến năm 2025, các công ty AI Trung Quốc đồng loạt chuyển hướng sang một hướng công nghệ mới: mô hình chuyên gia hỗn hợp (Mixture of Experts – MoE).

Hiểu một cách đơn giản, đó là chia một mô hình khổng lồ thành nhiều “chuyên gia” nhỏ, và khi xử lý tác vụ chỉ kích hoạt những “chuyên gia” liên quan nhất — chứ không bắt toàn bộ mô hình hoạt động cùng lúc.

DeepSeek V3 là ví dụ tiêu biểu cho hướng tiếp cận này. Mô hình sở hữu 671 tỷ tham số, nhưng mỗi lần suy luận (inference) chỉ kích hoạt 37 tỷ tham số — chiếm chưa đầy 5,5% tổng số. Về chi phí huấn luyện, V3 sử dụng 2.048 GPU NVIDIA H800 trong 58 ngày, tổng chi phí đạt 5,576 triệu USD. So sánh với ước tính chi phí huấn luyện GPT-4 ngoài thị trường — khoảng 78 triệu USD — thì chênh lệch lên tới một cấp độ.

Việc tối ưu hóa cực hạn ở tầng thuật toán trực tiếp phản ánh rõ nét trên giá cả. Giá API của DeepSeek chỉ dao động từ 0,028–0,28 USD cho mỗi triệu token đầu vào và 0,42 USD cho mỗi triệu token đầu ra. Trong khi đó, GPT-4o có giá 5 USD/token đầu vào và 15 USD/token đầu ra; Claude Opus còn đắt hơn: 15 USD/token đầu vào và 75 USD/token đầu ra. Quy đổi ra, DeepSeek rẻ hơn Claude từ 25 đến 75 lần.

Chênh lệch giá này tạo tiếng vang lớn trên thị trường nhà phát triển toàn cầu. Tháng 2 năm 2026, trên OpenRouter — nền tảng tổng hợp API mô hình AI lớn nhất thế giới — lượng gọi API tuần của các mô hình AI Trung Quốc tăng vọt 127% trong ba tuần, lần đầu tiên vượt qua Mỹ. Một năm trước, thị phần mô hình Trung Quốc trên OpenRouter chưa tới 2%; một năm sau, con số này tăng 421%, tiến gần đến mức 60%.

Đằng sau dãy số này là một thay đổi cấu trúc thường bị lãng quên. Từ nửa cuối năm 2025, xu hướng ứng dụng AI chủ đạo đã dịch chuyển từ trò chuyện (chat) sang Agent. Trong kịch bản Agent, lượng token tiêu thụ cho một tác vụ cao gấp 10–100 lần so với một cuộc trò chuyện đơn giản. Khi lượng token tăng theo cấp số mũ, giá thành trở thành yếu tố quyết định. Sự cạnh tranh vượt trội về giá của các mô hình Trung Quốc đúng lúc bắt nhịp được xu thế này.

Tuy nhiên, vấn đề đặt ra là: việc giảm chi phí suy luận không giải quyết được bài toán cốt lõi của huấn luyện. Một mô hình ngôn ngữ lớn nếu không được liên tục huấn luyện và cập nhật trên dữ liệu mới, năng lực của nó sẽ nhanh chóng suy giảm. Còn huấn luyện — vẫn là “lỗ đen” năng lực tính toán không thể tránh khỏi.

Vậy “chiếc xẻng” để huấn luyện — sẽ đến từ đâu?

Sự “chính thức hóa” của phương án dự phòng

Hưng Hóa, một thành phố nhỏ thuộc tỉnh Giang Tô, nổi tiếng với thép không gỉ và thực phẩm sức khỏe, trước đây chẳng hề liên quan đến AI. Nhưng vào năm 2025, một dây chuyền sản xuất máy chủ năng lực tính toán nội địa dài 148 mét đã được xây dựng và đưa vào vận hành tại đây — từ ký hợp đồng đến投产 chỉ mất đúng 180 ngày.

Lõi của dây chuyền này gồm hai loại chip hoàn toàn nội địa: vi xử lý Longxin 3C6000 và thẻ gia tốc AI Thái Sơ Nguyên Kỳ T100. Longxin 3C6000 được thiết kế hoàn toàn tự chủ, từ tập lệnh đến kiến trúc vi xử lý. Thái Sơ Nguyên Kỳ bắt nguồn từ Trung tâm Siêu máy tính Vô Tích và đội ngũ nghiên cứu của Đại học Thanh Hoa, sử dụng kiến trúc đa nhân dị cấu (heterogeneous many-core).

Khi vận hành đầy tải, dây chuyền này xuất xưởng một máy chủ mỗi năm phút; tổng vốn đầu tư đạt 1,1 tỷ Nhân dân tệ, dự kiến sản xuất 100.000 máy chủ mỗi năm.

Quan trọng hơn, các cụm máy chủ vạn card (tức cụm gồm hàng chục nghìn card tính toán) được xây dựng dựa trên những chip nội địa này đã bắt đầu đảm nhận các tác vụ huấn luyện mô hình ngôn ngữ lớn thực tế.

Tháng 1 năm 2026, Zhipu AI phối hợp cùng Huawei ra mắt GLM-Image — mô hình sinh ảnh tiên tiến nhất (SOTA) đầu tiên trên thế giới được huấn luyện hoàn toàn bằng chip nội địa. Tháng 2, mô hình ngôn ngữ lớn “Tinh Thần” (Xingchen) quy mô nghìn tỷ tham số của Tập đoàn Viễn thông Trung Quốc đã hoàn tất toàn bộ quy trình huấn luyện trên cụm vạn card tính toán nội địa tại khu临港 (Lingang) thuộc Thượng Hải.

Ý nghĩa của những ví dụ này nằm ở một điều: chúng chứng minh rằng chip nội địa đã vượt qua bước ngoặt từ “có thể dùng cho suy luận” sang “có thể dùng cho huấn luyện”. Đây là một bước chuyển mang tính chất biến. Suy luận chỉ yêu cầu chạy mô hình đã được huấn luyện sẵn, nên yêu cầu đối với chip tương đối thấp; còn huấn luyện đòi hỏi xử lý lượng dữ liệu khổng lồ, thực hiện các phép tính gradient phức tạp và cập nhật tham số — do đó yêu cầu về năng lực tính toán, băng thông kết nối và hệ sinh thái phần mềm cao hơn hẳn một cấp độ.

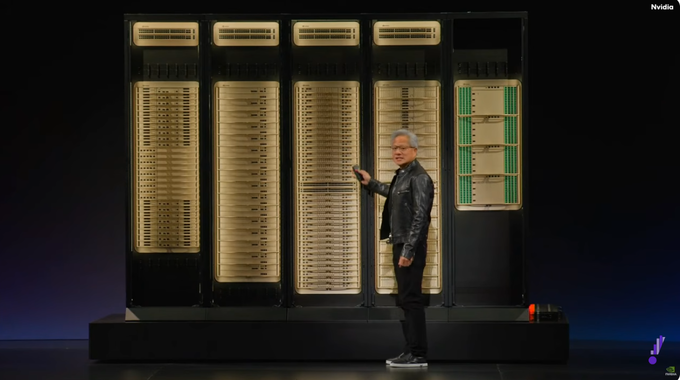

Lực lượng nòng cốt đảm nhận vai trò này là dòng chip昇腾 (Ascend) của Huawei. Tính đến cuối năm 2025, hệ sinh thái Ascend đã thu hút hơn 4 triệu nhà phát triển, có hơn 3.000 đối tác, 43 mô hình ngôn ngữ lớn hàng đầu trong ngành đã hoàn tất tiền huấn luyện trên nền tảng Ascend, và hơn 200 mô hình mã nguồn mở đã được thích nghi hoàn chỉnh. Tại hội nghị MWC ngày 2 tháng 3 năm 2026, Huawei còn ra mắt thế hệ nền tảng năng lực tính toán mới SuperPoD dành riêng cho thị trường quốc tế.

Hiệu năng FP16 của Ascend 910B hiện đã ngang bằng với NVIDIA A100. Dù vẫn còn khoảng cách, nhưng mức chênh lệch đã chuyển từ “không thể dùng” sang “có thể dùng”, và đang tiến dần đến “dùng tốt”. Việc xây dựng hệ sinh thái không thể chờ đến khi chip hoàn hảo mới bắt đầu — mà phải triển khai quy mô lớn ngay từ giai đoạn “đủ dùng”, để nhu cầu thực tế từ các ứng dụng thúc đẩy quá trình cải tiến liên tục của cả chip lẫn phần mềm. Các mục tiêu nhập khẩu máy chủ năng lực tính toán nội địa của ByteDance, Tencent và Baidu trong năm 2026 đều tăng gấp đôi so với năm trước. Theo số liệu từ Bộ Công nghiệp và Công nghệ Thông tin Trung Quốc (MIIT), quy mô trung tâm tính toán trí tuệ nhân tạo (AI computing) của Trung Quốc đã đạt 1.590 EFLOPS. Năm 2026 đang trở thành “năm đầu tiên” của việc triển khai quy mô lớn năng lực tính toán nội địa.

Nỗi lo thiếu điện tại Mỹ và làn sóng “xuất khẩu Token” từ Trung Quốc

Đầu năm 2026, bang Virginia — nơi tập trung lưu lượng dữ liệu của hàng loạt trung tâm dữ liệu toàn cầu — tạm dừng phê duyệt các dự án trung tâm dữ liệu mới. Bang Georgia cũng theo sau, kéo dài lệnh tạm dừng đến năm 2027. Các bang Illinois và Michigan cũng lần lượt ban hành các biện pháp hạn chế tương tự.

Theo Cơ quan Năng lượng Quốc tế (IEA), năm 2024, lượng điện tiêu thụ bởi các trung tâm dữ liệu tại Mỹ đã đạt 183 terawatt-giờ (TWh), chiếm khoảng 4% tổng tiêu thụ điện cả nước. Đến năm 2030, con số này dự kiến tăng gấp đôi lên 426 TWh, chiếm tỷ lệ có thể vượt 12%. CEO của Arm thậm chí dự báo đến năm 2030, các trung tâm dữ liệu AI sẽ tiêu thụ từ 20–25% tổng điện năng của Mỹ.

Lưới điện Mỹ hiện đã quá tải. Lưới điện PJM — phục vụ 13 bang miền Đông Mỹ — đang đối mặt với tình trạng thiếu hụt công suất 6 GW. Đến năm 2033, toàn nước Mỹ sẽ thiếu hụt 175 GW công suất điện — tương đương lượng điện tiêu thụ của 130 triệu hộ gia đình. Chi phí điện buôn bán tại các khu vực tập trung trung tâm dữ liệu đã tăng 267% so với năm năm trước.

Đỉnh điểm của năng lực tính toán chính là năng lượng. Và ở chiều đo này, khoảng cách giữa Trung Quốc và Mỹ còn lớn hơn cả ở lĩnh vực chip — chỉ khác là chiều hướng ngược lại.

Lượng điện sản xuất hàng năm của Trung Quốc là 10,4 nghìn tỷ kWh, trong khi của Mỹ là 4,2 nghìn tỷ kWh — tức Trung Quốc sản xuất gấp 2,5 lần Mỹ. Quan trọng hơn, điện dùng cho sinh hoạt dân dụng tại Trung Quốc chỉ chiếm 15% tổng tiêu thụ, còn tại Mỹ con số này là 36%. Điều này có nghĩa là Trung Quốc có dư thừa điện cho mục đích công nghiệp lớn hơn nhiều so với Mỹ — và do đó có tiềm năng lớn hơn nhiều để đầu tư vào hạ tầng tính toán.

Về giá điện, mức giá tại các khu vực tập trung công ty AI ở Mỹ dao động từ 0,12–0,15 USD/kWh, trong khi giá điện công nghiệp tại Tây Bộ Trung Quốc chỉ khoảng 0,03 USD/kWh — chỉ bằng 1/4 đến 1/5 mức giá tại Mỹ.

Tốc độ tăng trưởng sản lượng điện mới của Trung Quốc hiện đã đạt gấp 7 lần so với Mỹ.

Ngay khi Mỹ đang đau đầu vì thiếu điện, ngành AI Trung Quốc lại âm thầm “xuất khẩu” ra toàn cầu. Nhưng lần này, thứ được xuất khẩu không phải là sản phẩm, cũng không phải là nhà máy — mà là Token.

Token — đơn vị nhỏ nhất để mô hình AI xử lý thông tin — đang trở thành một loại hàng hóa số mới. Chúng được “sản xuất” tại các nhà máy năng lực tính toán của Trung Quốc rồi truyền tải đến toàn cầu qua cáp quang dưới đáy biển.

Dữ liệu phân bố người dùng của DeepSeek minh họa rõ điều này: thị phần trong nước chiếm 30,7%, Ấn Độ 13,6%, Indonesia 6,9%, Mỹ 4,3%, Pháp 3,2%. DeepSeek hỗ trợ 37 ngôn ngữ và rất phổ biến tại các thị trường mới nổi như Brazil. Toàn cầu có 26.000 doanh nghiệp đã mở tài khoản, và 3.200 tổ chức đã triển khai phiên bản doanh nghiệp.

Năm 2025, 58% các công ty khởi nghiệp AI mới thành lập đã tích hợp DeepSeek vào stack công nghệ của mình. Tại Trung Quốc, DeepSeek chiếm 89% thị phần. Còn tại các quốc gia chịu trừng phạt, thị phần dao động từ 40–60%.

Cảnh tượng này khiến người ta nhớ đến một cuộc chiến khác về quyền tự chủ công nghiệp cách đây bốn thập kỷ.

Năm 1986, tại Tokyo, dưới áp lực mạnh mẽ từ Mỹ, Chính phủ Nhật Bản ký kết “Hiệp định bán dẫn Mỹ-Nhật”. Ba điều khoản cốt lõi của hiệp định gồm: yêu cầu Nhật Bản mở cửa thị trường bán dẫn, thị phần chip Mỹ tại Nhật phải đạt trên 20%; cấm xuất khẩu chip Nhật với giá thấp hơn chi phí sản xuất; áp thuế trừng phạt 100% đối với chip Nhật xuất khẩu sang Mỹ trị giá 300 triệu USD. Đồng thời, Mỹ bác bỏ thương vụ mua lại Fairchild Semiconductor của Fujitsu.

Năm đó, ngành bán dẫn Nhật Bản đang ở đỉnh cao. Năm 1988, Nhật Bản kiểm soát 51% thị phần bán dẫn toàn cầu, trong khi Mỹ chỉ chiếm 36,8%. Trong top 10 công ty bán dẫn toàn cầu, Nhật Bản chiếm tới sáu vị trí: NEC đứng thứ hai, Toshiba thứ ba, Hitachi thứ năm, Fujitsu thứ bảy, Mitsubishi thứ tám, Panasonic thứ chín. Năm 1985, Intel thua lỗ 173 triệu USD trong cuộc cạnh tranh bán dẫn Mỹ-Nhật và suýt phá sản.

Nhưng sau khi hiệp định được ký kết, mọi thứ đã thay đổi hoàn toàn.

Mỹ sử dụng các công cụ như điều tra Điều 301 để gây áp lực toàn diện lên các công ty bán dẫn Nhật Bản. Đồng thời, Mỹ hậu thuẫn Samsung và SK Hynix của Hàn Quốc để tấn công thị trường Nhật Bản bằng giá thấp hơn. Thị phần DRAM của Nhật Bản từ mức 80% sụt giảm xuống còn 10%. Đến năm 2017, thị phần IC của Nhật Bản chỉ còn 7%. Những ông lớn từng một thời bất khả chiến bại hoặc bị chia tách, hoặc bị mua lại, hoặc lặng lẽ rời sân sau những khoản lỗ triền miên.

Bi kịch của ngành bán dẫn Nhật Bản nằm ở chỗ: họ hài lòng với vai trò là “nhà sản xuất xuất sắc nhất” trong một hệ thống phân công lao động toàn cầu do một lực lượng bên ngoài chi phối — mà chưa bao giờ nghĩ đến việc xây dựng một hệ sinh thái độc lập thuộc về riêng mình. Khi “thủy triều” rút đi, họ mới nhận ra rằng ngoài việc sản xuất, mình chẳng còn gì cả.

Ngành AI Trung Quốc hôm nay đang đứng trước một ngã rẽ vừa giống, vừa khác biệt hoàn toàn.

Giống ở chỗ: chúng ta cũng đang đối mặt với áp lực khổng lồ từ bên ngoài. Ba đợt kiểm soát xuất khẩu chip, mỗi đợt một khắt khe hơn; bức tường hệ sinh thái CUDA vẫn sừng sững cao ngất.

Khác ở chỗ: lần này, chúng ta chọn một con đường khó hơn. Từ việc tối ưu hóa cực hạn ở tầng thuật toán, đến bước nhảy vọt của chip nội địa từ suy luận sang huấn luyện, đến việc tích lũy 4 triệu nhà phát triển trong hệ sinh thái Ascend, đến việc “xuất khẩu Token” thâm nhập thị trường toàn cầu — từng bước đi trên con đường này đều đang góp phần xây dựng một hệ sinh thái công nghiệp độc lập mà Nhật Bản chưa từng có được.

Kết luận

Ngày 27 tháng 2 năm 2026, ba báo cáo kết quả kinh doanh sơ bộ từ các công ty sản xuất chip AI nội địa được công bố cùng một ngày.

Cambricon: doanh thu tăng vọt 453%, lần đầu tiên đạt lợi nhuận toàn năm. Moore Threads: doanh thu tăng 243%, nhưng lỗ ròng 1 tỷ USD.沐曦 (Muxi): doanh thu tăng 121%, lỗ ròng gần 800 triệu USD.

Một nửa là lửa, một nửa là nước biển.

Lửa là sự khát khao tuyệt đối từ thị trường. Khoảng trống 95% mà Jensen Huang để lại đang từng chút một được lấp đầy bởi những con số doanh thu của các công ty nội địa này. Dù hiệu năng ra sao, dù hệ sinh thái thế nào, thị trường vẫn cần một lựa chọn thứ hai ngoài NVIDIA. Đây là cơ hội cấu trúc ngàn năm có một, được mở ra bởi những xung đột địa chính trị.

Nước biển là chi phí khổng lồ để xây dựng hệ sinh thái. Mỗi đồng lỗ đều là tiền thật chi ra để đuổi kịp hệ sinh thái CUDA: là chi phí R&D, là hỗ trợ phần mềm, là chi phí nhân sự kỹ sư được cử đến tận hiện trường khách hàng để từng bước giải quyết các vấn đề biên dịch. Những khoản lỗ này không phải do quản trị kém, mà là “thuế chiến tranh” bắt buộc phải trả để xây dựng một hệ sinh thái độc lập.

Ba báo cáo tài chính này ghi chép chân thực hơn bất kỳ báo cáo ngành nào khác về diện mạo thực sự của cuộc “chiến tranh năng lực tính toán”. Đó không phải một chiến thắng tiến quân ào ạt, mà là một trận chiến chiếm cứ từng tấc đất — vừa tiến lên vừa đổ máu.

Nhưng hình thái cuộc chiến thực sự đã thay đổi. Tám năm trước, chúng ta bàn về câu hỏi “liệu có thể sống sót hay không?”. Hôm nay, chúng ta bàn về câu hỏi “sống sót sẽ phải trả giá bao nhiêu?”.

Chính cái giá đó — đã là tiến bộ.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News