Chưa ra mắt, tại sao Sora đã làm chấn động giới Internet?

Tuyển chọn TechFlowTuyển chọn TechFlow

Chưa ra mắt, tại sao Sora đã làm chấn động giới Internet?

OpenAI gọi trực tiếp nó là "máy mô phỏng thế giới", có khả năng mô phỏng các đặc điểm của con người, động vật và môi trường trong thế giới vật lý.

Tác giả: Mộc Mục

Chưa kịp mở thử nghiệm công khai, OpenAI đã khiến cả giới công nghệ, Internet và mạng xã hội chấn động bằng đoạn video teaser do mô hình tạo video từ văn bản Sora sản xuất.

Theo video được phát hành chính thức bởi OpenAI, Sora có khả năng tạo ra các "siêu video" dài tới một phút dựa trên thông tin văn bản do người dùng cung cấp, không chỉ chi tiết hình ảnh chân thực mà mô hình này còn mô phỏng cảm giác chuyển động của ống kính.

Nhìn vào hiệu ứng video đã được công bố, giới chuyên môn đặc biệt phấn khích trước khả năng hiểu thế giới thực tế mà Sora thể hiện. So với các mô hình lớn khác chuyển đổi từ văn bản sang video, Sora cho thấy ưu thế vượt trội về hiểu ngữ nghĩa, trình bày hình ảnh, tính liên tục thị giác và độ dài video.

OpenAI trực tiếp gọi nó là "bộ mô phỏng thế giới", tuyên bố rằng nó có thể mô phỏng các đặc điểm của con người, động vật và môi trường trong thế giới vật lý. Tuy nhiên, công ty cũng thừa nhận rằng hiện tại Sora vẫn chưa hoàn hảo, vẫn tồn tại những hạn chế trong việc hiểu biết đầy đủ và các vấn đề an toàn tiềm tàng.

Do đó, Sora hiện chỉ mở thử nghiệm cho một số rất ít người, OpenAI chưa công bố thời điểm nào sẽ mở rộng cho đại chúng, nhưng sự chấn động mà nó mang lại đã đủ để các công ty phát triển mô hình tương tự nhận ra khoảng cách.

Teaser Sora gây chấn động dư luận

Ngay khi ra mắt mô hình tạo video từ văn bản Sora, tại Trung Quốc lại xuất hiện hàng loạt bình luận theo kiểu "sửng sốt".

Các phương tiện truyền thông cá nhân hét lên rằng "thực tại không còn tồn tại", các lãnh đạo Internet cũng hết lời ca ngợi năng lực của Sora. Chu Hồng Vĩ, người sáng lập 360, cho rằng sự ra đời của Sora có nghĩa là việc đạt được AGI (trí tuệ nhân tạo phổ quát) có thể rút ngắn từ 10 năm xuống còn khoảng hai năm. Chỉ trong vài ngày, chỉ số tìm kiếm Google của Sora tăng vọt, mức độ nóng bỏng gần như sánh ngang ChatGPT.

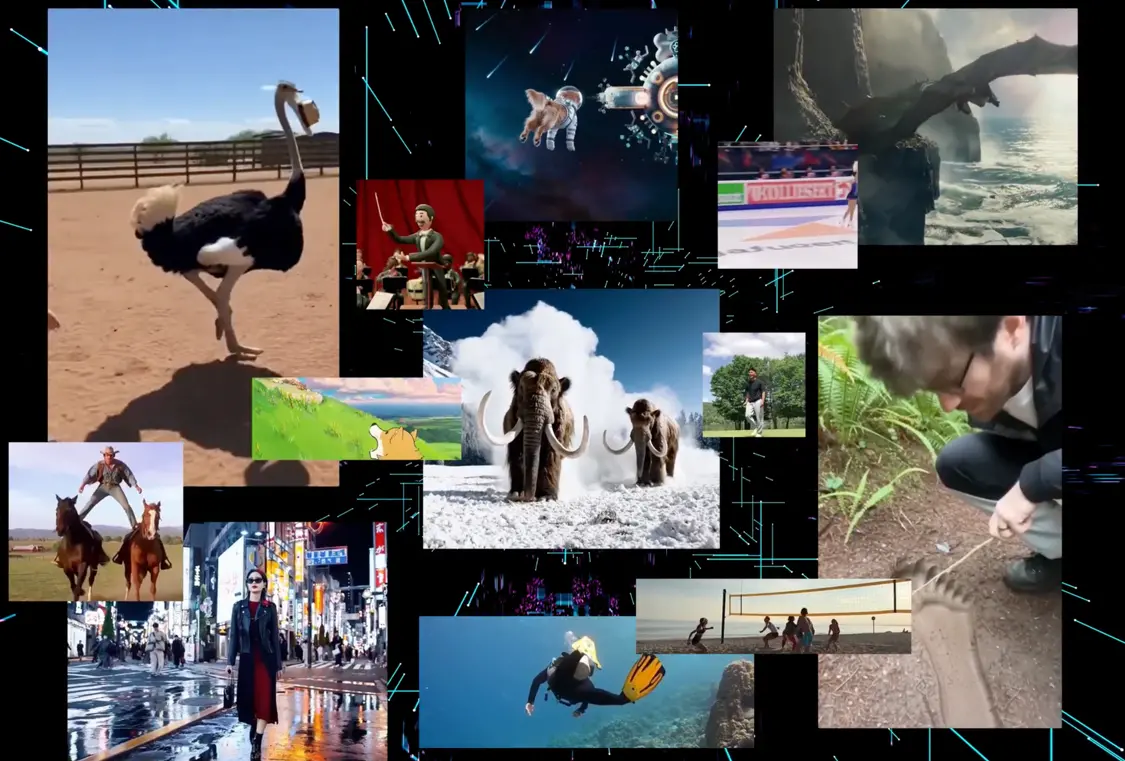

Sự bùng nổ của Sora bắt nguồn từ 48 đoạn video được OpenAI công bố, trong đó đoạn dài nhất lên đến một phút. Điều này không chỉ phá vỡ giới hạn thời lượng trước đó của các mô hình tạo video từ văn bản như Gen2, Runway, mà còn sở hữu hình ảnh sắc nét, thậm chí còn học được ngôn ngữ hình ảnh.

Trong một đoạn video dài một phút, một phụ nữ mặc váy đỏ đi bộ trên con phố rực rỡ đèn neon, phong cách hiện thực, hình ảnh mượt mà. Ấn tượng nhất là cận cảnh khuôn mặt người phụ nữ, ngay cả lỗ chân lông, đốm tàn nhang và vết thâm mụn cũng được mô phỏng rõ ràng, hiệu ứng trang điểm bị trôi giống như tắt bộ lọc làm đẹp khi livestream, nếp nhăn cổ thậm chí còn "tiết lộ" chính xác tuổi tác, hài hòa hoàn hảo với trạng thái khuôn mặt.

Ngoài mô phỏng con người chân thực, Sora còn có thể mô phỏng động vật và môi trường thực tế. Một đoạn video cận cảnh nhiều góc độ chú chim Victoria crowned pigeon, tái hiện cực kỳ rõ ràng bộ lông màu xanh dương từ thân đến mào, thậm chí cả chuyển động mắt đỏ và nhịp thở đều chi tiết đến mức khó phân biệt đây là hình ảnh do AI tạo ra hay do con người quay thật.

Đối với các hoạt hình sáng tạo phi hiện thực, hiệu quả sinh video của Sora cũng đạt đến chất lượng hình ảnh như phim hoạt hình Disney, khiến cư dân mạng lo lắng về công ăn việc làm của các họa sĩ hoạt hình.

Hơn nữa, cải tiến mà Sora mang lại cho mô hình tạo video từ văn bản không chỉ nằm ở độ dài và chất lượng hình ảnh, nó còn có thể mô phỏng chuyển động ống kính và quỹ đạo quay phim, góc nhìn người thứ nhất trong game, góc máy bay không người lái, thậm chí cả kỹ thuật quay liền mạch một cảnh như trong phim điện ảnh.

Sau khi xem những đoạn video tuyệt vời do OpenAI công bố, bạn sẽ hiểu vì sao giới Internet và dư luận mạng xã hội lại kinh ngạc trước Sora—và tất cả những gì bạn thấy mới chỉ là... trailer.

OpenAI đưa ra tập dữ liệu "mảnh ghép thị giác"

Vậy thì, Sora đã đạt được khả năng mô phỏng như thế nào?

Theo báo cáo kỹ thuật Sora được OpenAI công bố, mô hình này đang vượt qua những giới hạn trước đây của các mô hình tạo dữ liệu hình ảnh.

Trước đây, các nghiên cứu về tạo hình ảnh thị giác từ văn bản đã sử dụng nhiều phương pháp khác nhau, bao gồm mạng lưới tuần hoàn, mạng đối kháng sinh (GAN), biến đổi tự hồi quy và mô hình khuếch tán, nhưng điểm chung là tập trung vào các loại dữ liệu thị giác ít, video ngắn hoặc video kích thước cố định.

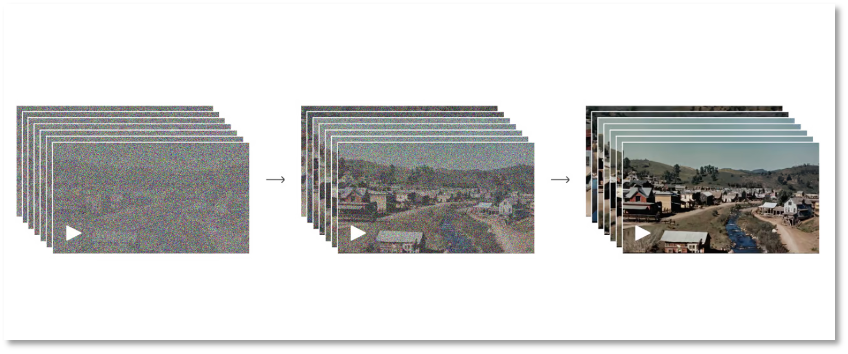

Sora sử dụng một mô hình khuếch tán dựa trên Transformer, quá trình tạo hình ảnh được chia thành hai giai đoạn: quá trình thuận và quá trình nghịch, nhằm giúp Sora có khả năng mở rộng video theo chiều thời gian về phía trước hoặc phía sau.

Giai đoạn thuận mô phỏng quá trình khuếch tán từ hình ảnh thật sang hình ảnh nhiễu hoàn toàn. Cụ thể, mô hình sẽ từng bước thêm nhiễu vào hình ảnh cho đến khi hình ảnh trở thành hoàn toàn nhiễu. Giai đoạn nghịch là quá trình ngược lại, mô hình sẽ phục hồi dần hình ảnh gốc từ hình ảnh nhiễu. Một thuận một nghịch, hư thực luân chuyển, OpenAI dùng cách này để giúp máy móc Sora hiểu được quá trình hình thành hình ảnh thị giác.

Quá trình từ hình ảnh nhiễu hoàn toàn đến hình ảnh rõ nét

Quá trình từ hình ảnh nhiễu hoàn toàn đến hình ảnh rõ nét

Tất nhiên, quá trình này cần được luyện tập và học hỏi lặp đi lặp lại, mô hình sẽ học cách loại bỏ dần nhiễu và phục hồi chi tiết hình ảnh. Qua các vòng lặp của hai giai đoạn này, mô hình khuếch tán của Sora có thể tạo ra hình ảnh chất lượng cao. Mô hình này thể hiện hiệu suất xuất sắc trong các lĩnh vực như tạo hình ảnh, chỉnh sửa hình ảnh, siêu phân giải, v.v.

Quá trình trên giải thích lý do tại sao Sora có thể tạo ra hình ảnh rõ nét, chi tiết cực cao. Tuy nhiên, để chuyển từ hình ảnh tĩnh sang video động, mô hình cần tích lũy thêm dữ liệu và luyện tập sâu hơn.

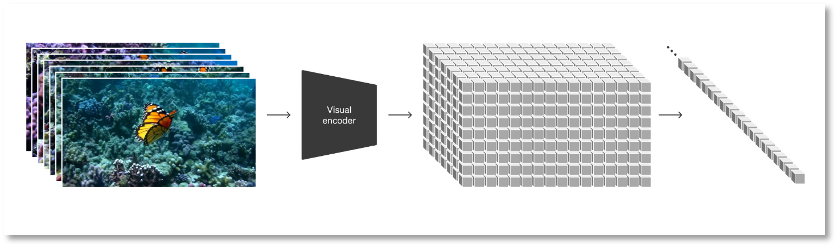

Trên cơ sở mô hình khuếch tán, OpenAI chuyển đổi tất cả các dạng dữ liệu thị giác như video và hình ảnh thành biểu diễn thống nhất, để huấn luyện quy mô lớn cho Sora. Cách biểu diễn mà Sora sử dụng được OpenAI định nghĩa là "các mảnh ghép thị giác (patches)", tức là tập hợp các đơn vị dữ liệu nhỏ hơn, tương tự như tập hợp văn bản trong GPT.

Các nhà nghiên cứu trước tiên nén video vào không gian tiềm ẩn (latent space) thấp chiều, sau đó phân tách biểu diễn này thành các mảnh patch không gian-thời gian, đây là một dạng biểu diễn có khả năng mở rộng cao, thuận tiện cho việc chuyển đổi từ video sang patch, đồng thời phù hợp để huấn luyện mô hình sinh xử lý nhiều loại video và hình ảnh khác nhau.

Chuyển đổi dữ liệu thị giác thành các patch

Chuyển đổi dữ liệu thị giác thành các patch

Để huấn luyện Sora với lượng thông tin và tính toán ít hơn, OpenAI đã phát triển một mạng nén video, đầu tiên giảm chiều video xuống không gian tiềm ẩn thấp hơn mức pixel, sau đó lấy dữ liệu video đã nén để tạo ra các patch, điều này giúp giảm lượng thông tin đầu vào, từ đó giảm áp lực tính toán. Đồng thời, OpenAI cũng huấn luyện mô hình giải mã tương ứng để ánh xạ thông tin đã nén trở lại không gian pixel.

Dựa trên cách biểu diễn bằng các mảnh ghép thị giác, các nhà nghiên cứu có thể huấn luyện Sora cho các video/hình ảnh với độ phân giải, thời lượng và tỷ lệ khung hình khác nhau. Khi chuyển sang giai đoạn suy luận, Sora có thể xác định logic video và kiểm soát kích thước video được tạo bằng cách sắp xếp các patch khởi tạo ngẫu nhiên trong một lưới phù hợp.

OpenAI cho biết, trong quá trình huấn luyện quy mô lớn, mô hình video đã thể hiện các chức năng đáng kinh ngạc, bao gồm khả năng mô phỏng chân thực con người, động vật và môi trường trong thế giới thực, tạo ra video độ trung thực cao, đồng thời đạt được tính nhất quán 3D và tính nhất quán theo thời gian, từ đó mô phỏng chân thực thế giới vật lý.

Altman làm cầu nối giúp người dùng thử nghiệm

Từ kết quả đến quá trình nghiên cứu, Sora thể hiện năng lực mạnh mẽ, nhưng người dùng thông thường vẫn chưa thể trải nghiệm. Hiện tại, họ chỉ có thể viết prompt, sau đó @Sam Altman - người sáng lập OpenAI trên X (Twitter), nhờ ông làm cầu nối, giúp tạo video trên Sora rồi đăng lên để công chúng xem hiệu quả.

Điều này khiến không ít người nghi ngờ liệu Sora có thực sự mạnh như những gì OpenAI công bố hay không.

Về vấn đề này, OpenAI thẳng thắn thừa nhận rằng mô hình hiện tại vẫn còn một số vấn đề. Giống như GPT ở giai đoạn đầu, Sora hiện nay cũng gặp phải hiện tượng "ảo giác", những lỗi sai này thể hiện rõ ràng hơn trong kết quả video chủ yếu là hình ảnh.

Ví dụ, nó không thể mô phỏng chính xác nhiều quá trình vật lý cơ bản, chẳng hạn như mối quan hệ giữa băng chuyền máy chạy bộ và chuyển động của con người, hay trình tự logic giữa việc ly thủy tinh vỡ và chất lỏng bên trong chảy ra.

Trong đoạn video "các nhà khảo cổ khai quật ra một chiếc ghế nhựa", chiếc ghế nhựa lại trôi nổi thẳng ra khỏi cát.

Có cả những chú sói con xuất hiện vô cớ, bị cư dân mạng chế giễu là "phân bào nguyên phân của sói".

Đôi khi nó cũng không phân biệt được trước-sau, trái-phải.

Những sai sót trong các hình ảnh động này dường như chứng minh rằng Sora vẫn cần phải hiểu và luyện tập thêm nhiều về logic vận động trong thế giới vật lý. Ngoài ra, so với rủi ro của ChatGPT, Sora với trải nghiệm thị giác trực quan hơn tiềm ẩn rủi ro đạo đức và an ninh nghiêm trọng hơn.

Trước đây, mô hình tạo hình ảnh từ văn bản Midjourney đã cho con người thấy rằng "có hình ảnh không đồng nghĩa với sự thật", hình ảnh giả do trí tuệ nhân tạo tạo ra ngày càng trở thành yếu tố lan truyền tin đồn. Tiến sĩ Newell, Giám đốc Khoa học của công ty xác thực danh tính iProov, cho biết Sora sẽ khiến "những đối tượng xấu dễ dàng tạo ra các video giả chất lượng cao hơn".

Có thể hình dung, nếu video do Sora tạo ra bị lợi dụng vào các mục đích xấu như lừa đảo, vu khống, lan truyền bạo lực và nội dung khiêu dâm, hậu quả sẽ khó lường—đây cũng là lý do khiến Sora vừa gây kinh ngạc vừa khiến người ta lo sợ.

OpenAI cũng đã cân nhắc đến các vấn đề an toàn mà Sora có thể gây ra, có lẽ đây cũng là lý do vì sao Sora hiện chỉ mở thử nghiệm giới hạn theo hình thức mời cho một số rất ít người. Khi nào sẽ mở rộng cho đại chúng? OpenAI chưa đưa ra lịch trình cụ thể, nhưng nhìn vào các video được công bố, thời gian để các công ty khác đuổi kịp mô hình Sora là không còn nhiều.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News