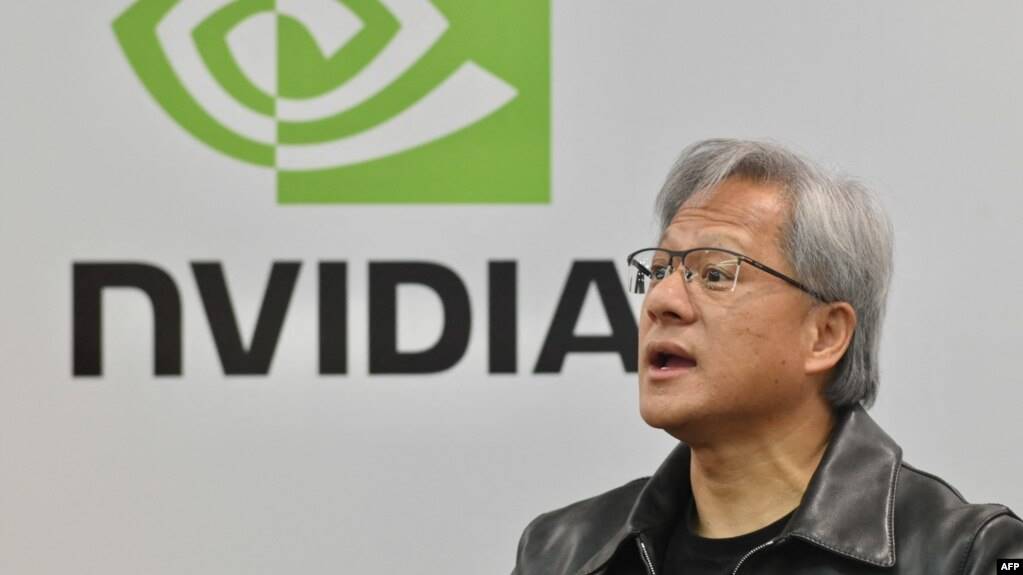

黄仁勲氏最新インタビュー:DeepSeekをファーウェイと密接に結びつけようとしている——米国にとってはあまりにも恐ろしいこと

TechFlow厳選深潮セレクト

黄仁勲氏最新インタビュー:DeepSeekをファーウェイと密接に結びつけようとしている——米国にとってはあまりにも恐ろしいこと

対中輸出に関して、彼は極端な輸出管理政策を「非常に幼稚だ」と批判した。

編集:シャオシャオ、NetEase Intelligent

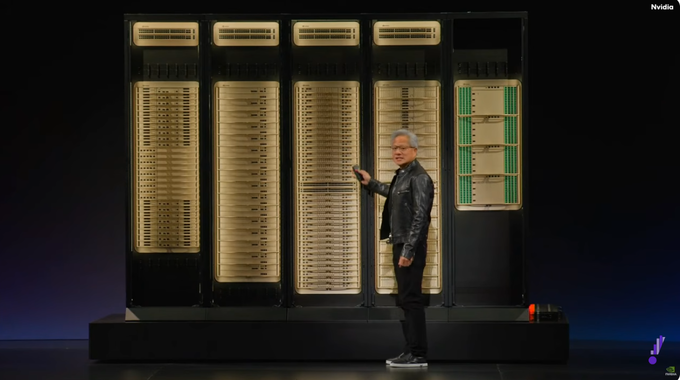

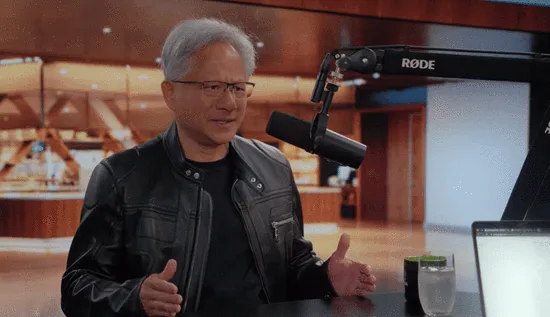

NVIDIA CEOのジェンスン・ファン氏は最近、米国を代表するテクノロジーパッドキャスト「Dwarkesh Patel Podcast」のホストであるドワルケシュ・パテル氏によるインタビューに応じ、同社の「モートゥー(護城河)」、グーグルのTPUとの競争、中国向けチップ輸出規制といった重要課題について包括的に回答しました。

彼は、NVIDIAのモートゥーがサプライチェーンの深部まで及んでいると強調し、台湾積体電路製造(TSMC)やメモリサプライヤーとの間で数千億ドル規模の調達約束を結ぶことで、極めて緊密な連携関係を築いていると述べました。

TPUとの競争に関しては、アントロピック社の事例はASIC成長の「特異点」であり、トレンドではないと指摘。NVIDIAのアクセラレーテッド・コンピューティングは、AIを超えて分子動力学、データ処理、流体力学など多様な分野をカバーしており、CUDAの高いプログラマビリティにより、毎年10~50倍の性能向上を実現していると説明しました。

また、NVIDIAが自ら超大規模クラウドプロバイダーにならない理由についても説明しました。十分なキャッシュフローを有しながらも、「絶対に必要なことだけを行い、それ以外は極力避ける」という原則を貫き、CoreWeave、OpenAI、Anthropicなどへの投資を通じてエコシステムを支援することを選択したと語りました。同時に、アントロピック社への早期大規模投資を怠ったことは自身の失敗だったと認めています。さらに、AI革命が起きなかったとしても、NVIDIAは物理、化学、データ処理などの分野でアクセラレーテッド・コンピューティングによって非常に大きな企業になるだろうと強調しました。

中国向け輸出については、極端な輸出規制政策は「非常に幼稚だ」と批判。AIの演算能力はチップとエネルギーの融合であるとし、EUV露光装置の制限があるにもかかわらず、中国には7nmチップの大規模製造能力が依然として存在すると指摘しました。現在の主流大規模言語モデル(LLM)の多くがHopperアーキテクチャ上で訓練されていることを踏まえれば、中国は豊富な電力供給とチップクラスターの規模拡大によって、単一チップの性能差を十分に補えると述べました。

さらに、中国の膨大なAI研究チームが、より効率的なコンピューターサイエンスを通じてモデル性能を高めていると指摘。デプシーク(DeepSeek)を例に挙げ、「これは決して無視できる進展ではない」と警告しました。こうした優れたオープンソースモデルが、ファーウェイなどの国内ハードウェアに特化して最適化され、その上で最高のパフォーマンスを発揮するよう強制された場合、結果として米国の技術スタックのグローバル優位性が直接的に損なわれると考えています。彼は、世界第2の市場を自ら放棄すれば、中国は米国とは独立した基盤となるコンピューティングアーキテクチャを構築せざるを得なくなると指摘。こうしたオープンスタンダードに基づく技術が徐々にグローバルサウスへと浸透していく中で、米国は長期的なAIエコシステム標準競争において、不利な立場に追い込まれる可能性が高いと懸念しています。

以下は、ジェンスン・ファン氏のインタビュー全文です:

サプライチェーンの支配こそがNVIDIA最大のモートゥーか?

パテル:多くのソフトウェア企業の時価総額が下落しています。なぜなら、AIがソフトウェアをコモディティ化してしまうのではないかという懸念が広がっているからです。ある見方によれば、NVIDIAは設計ファイルをTSMCに送り、TSMCがロジックチップとスイッチを製造し、SKハイニックス、マイクロン、サムスンのHBMを用いてパッケージ化し、その後台湾のODM企業でラックに組み立てているにすぎません。本質的にはNVIDIAはソフトウェアを提供しており、ハードウェアは他社が製造しているのです。もしソフトウェアがコモディティ化されれば、NVIDIAもまたコモディティ化されるのでしょうか?

ファン:最終的に誰かが電子をトークンに変換しなければなりません。この変換プロセスは、完全にコモディティ化されることは極めて困難です。あるトークンを他のトークンよりも価値あるものにするのは、ある分子を他の分子よりも価値あるものにするのと同じくらい、高度な技術・工学・科学・発明を必要とします。こうした作業は、まだ十分に理解されておらず、また未完のものです。私は、このようなコモディティ化が起こるとは思っていません。

しかし、私たちはこのプロセスをより効率的にしていきます。あなたがこの問いを立てた方式こそが、私が会社をどう捉えているかの思考モデルそのものです。つまり、入力は電子であり、出力はトークンであり、その間にNVIDIAが位置しています。私たちの原則は、「絶対に必要なことだけを行い、それ以外は極力避ける」ことです。「極力避ける」とは、自分では行う必要がない部分はパートナーと協力し、それを自社のエコシステムの一部として取り込むということです。

今日のNVIDIAは、おそらく世界で最も大規模なパートナーエコシステムを持つ企業です。これには、上流・下流のサプライチェーン、あらゆるコンピューター企業、アプリケーション開発者、モデルベンダーが含まれます。AIはまるで5層のケーキのようであり、私たちはそのすべての層で独自のエコシステムを構築しています。私たちは「極力避ける」姿勢を貫きつつ、絶対に必要な部分に集中しますが、その部分は極めて困難であり、私はそれがコモディティ化されることはないと思っています。

また、私はエンタープライズソフトウェア企業がコモディティ化されるとも思いません。現在のほとんどのソフトウェア企業はツールメーカーであり、Excel、PowerPoint、Cadence、Synopsysなどが該当します。私の見解は多くの人と逆で、AIエージェントの数は指数関数的に増加し、ツールのユーザー数も指数関数的に増加すると考えています。これらのツールのインスタンス数は、爆発的に増える可能性があります。

例えば、Synopsysのデザインコンパイラは、レイアウトや設計ルールチェックを行うために多数のAIエージェントによって利用されます。今日の制約要因はエンジニアの人数ですが、明日には各エンジニアの背後に複数のAIエージェントがついて回るでしょう。私たちは、既存のツールを用いて、かつてないほど広範な設計空間を探索できるようになります。ツールの高頻度利用により、ソフトウェア企業は飛躍的に成長します。こうした状況がまだ実現していないのは、AIエージェントがツールを使いこなすほどに熟達していないからです。ツールメーカー自身がAIエージェントを開発するか、あるいはAIエージェントがツールを使いこなせるようになるか——どちらも実現するでしょう。

パテル:最新の資料では、ファウンドリ、メモリ、パッケージングに対する約1,000億ドルの調達約束が記載されています。半導体調査機関SemiAnalysisは、この数字が2,500億ドルに達すると予測しています。これを読むと、NVIDIAのモートゥーは、将来数年にわたって希少なコンポーネントを独占的に確保したことにあるように思われます。他社にはアクセラレーターがあっても、メモリやロジックチップが手に入らないのです。これが今後数年の主なモートゥーなのでしょうか?

ファン:これは、私たちが可能にして、他社には極めて困難なことの一つです。私たちは上流に対して巨額のコミットメントを行っています。そのうち一部は、あなたが言及したような明示的なものですが、その他には、上流企業のCEOたちに対し、「この業界の規模はこれだけあり、その理由はこうだ」と説明し、論理的根拠を示して彼らに納得させ、投資を促した「暗黙のコミットメント」もあります。

なぜ彼らは私に投資しようとするのでしょうか?それは、私が彼らの供給全体を購入し、それを下流で販売する能力を持っていることを知っているからです。NVIDIAの下流需要および下流サプライチェーンは非常に巨大であり、そのため彼らは上流に投資することを決めたのです。

GTCカンファレンスをご覧になった方は、その規模と盛り上がりに驚かれたと思います。それは、AIコミュニティ全体が一堂に会し、互いに交流し、お互いを見せるために集まっているからです。私が彼らを集めたのは、下流が上流を、上流が下流を見る機会を作り、全員がAIの進歩を目撃できるようにするためです。また、AIネイティブ世代やすべてのスタートアップ企業とも出会える場でもあります。こうすることで、彼らは私が話す内容を実際に検証できます。私は、サプライチェーン、パートナー、エコシステムが直面する機会を理解するために、直接的・間接的に多大な時間を費やしています。

ある人は、私の基調講演はまるで授業のようで、しかもちょっと苦痛だと評しています。実はそれが狙いなのです。私は、サプライチェーン全体、上流・下流、エコシステム全体が、「何が起きるのか」「なぜ起きるのか」「いつ起きるのか」「どれだけの規模で起きるのか」を理解し、そして私と同じように体系的に考えるようになることを目指しています。

モートゥーに関して言えば、私たちは未来に向けて先手を打っています。もし今後数年で本当に1兆ドル規模に成長したとしたら、当然、それに見合ったサプライチェーンを構築する能力が備わっているでしょう。しかし、その前提条件は、今日の事業規模と影響力、そして事業の高速な資金循環(キャッシュフロー)です。事業の循環が遅ければ、誰も空っぽの枠組みのためにサプライチェーンを構築しようとしないでしょう。私たちが今日このような規模を維持できている根本的な理由は、下流の需要が極めて旺盛であることです。彼らが実際に見て、聞いて、それが現実に起きていると認識したときこそ、私たちが現在の規模でこうしたことを成し遂げられるのです。

パテル:具体的に、上流が追いつけるかどうかについてもう少し詳しく教えてください。NVIDIAは連続して収入を倍増させており、毎年世界に提供する演算能力は3倍以上増加しています。

ファン:この規模で倍増することは、確かに驚異的です。

パテル:しかし、ロジックチップを見てみましょう。NVIDIAはTSMCのN3ノード最大の顧客であり、N2ノード最大の顧客の一つでもあります。SemiAnalysisによると、今年AIがN3ノードの生産能力の60%を占め、来年には86%に達するとのことです。すでに大部分を占めているのに、どうやって倍増するのでしょうか?年々倍増し続けることができるのでしょうか?我々はすでに、上流の制約によってAI演算能力の伸びが鈍化せざるを得ない段階に至っているのでしょうか?何か解決策が見えていますか?結局のところ、ウェハー工場の生産能力を年々倍増させるには、一体どうすればよいのでしょうか?

ファン:どんな時点であれ、瞬間的な需要は、世界中の上流・下流の総供給を上回ることがあります。実際、配管工の人数が足りず、それがボトルネックになったこともありました。

パテル:配管工の方々は、来年のGTCに招待すべきですね。

ファン:素晴らしいアイデアです。しかしこれはむしろ好ましい現象です。業界の瞬間的な需要が総供給を上回ることを望むべきであり、逆であればあまりよくありません。あるコンポーネントの不足が大きすぎれば、業界全体が一斉にその問題解決に動き出します。実際、今ではCoWoSについて議論する人はほとんどいません。過去2年間、私たちはこの問題を必死に解決し、状況はかなり改善しました。TSMCも、CoWoSの供給がロジックチップおよびメモリの需要に追いつく必要があることを理解しており、ロジックチップの拡張と同じペースでCoWoSおよび将来のパッケージング技術を拡張しています。これは非常に良いことで、CoWoSやHBMメモリはかつてはニッチな技術でしたが、今やメインストリームのコンピューティング技術となっています。

現在、私たちはより広範なサプライチェーンに影響を与えることができます。AI革命の初期段階から、私はこうした話を5年前から行ってきました。それを信じて投資した企業もあり、マイクロンのCEOサンジェイ・メフルオトラ氏とそのチームがその例です。私はあの会議を鮮明に覚えています。私が正確に予測した通りのことが起きており、現在の状況もまさにその通りです。彼らは本当に投資を倍増させました。LPDDRおよびHBMメモリに関する共同開発を通じて、彼らは大規模な投資を行い、大きな成功を収めました。他の企業はやや遅れて参入しましたが、今では皆が参画しています。

各ボトルネックには大量の注目が集まります。私たちは、数年前からボトルネックを予測し始めています。例えば、過去数年間、Lumentum、Coherent、シリコンフォトニクス・エコシステムへの投資は、サプライチェーンを再構築しました。私たちはTSMCを中心にサプライチェーン全体を構築し、シリコンフォトニクス統合プラットフォーム「COUPE」の共同開発を行いました。多くの技術を発明し、特許をサプライチェーンにライセンス供与することで、オープンな環境を維持しています。

私たちは、新技術・新プロセス・新テスト装置(例:両面プローブ)の発明、企業への投資による増産支援など、サプライチェーンの強化を図っています。私たちはエコシステムを形成し、その規模を支えられるサプライチェーンを育てようとしています。

パテル:いくつかのボトルネックは、他のものより容易に解決できるようです。例えばCoWoSの増産は比較的簡単です。

ファン:私たちが担当するのは、最も困難なボトルネックです。

パテル:それは何ですか?

ファン:配管工と電気技師です。私が終末論者を心配する理由はここにあります。彼らは「仕事が消える」「職がなくなる」と主張します。もしソフトウェアエンジニアになることを阻止すれば、当然ソフトウェアエンジニアが枯渇します。10年前にも同じ予言がありました。ある終末論者は、「絶対に放射線科医になってはいけない」と断言し、今でもネット上には「放射線科医は最初に消える職業だ」という動画が残っています。さて、今、何が不足していますか?放射線科医です。

パテル:一部のものはスケールアップ可能ですが、他はそうではありません。あなたは毎年、ロジックチップの生産量を2倍にするのでしょうか?最終的にはメモリとロジックチップの両方がEUV露光装置に依存します。あなたは毎年、EUV露光装置の台数を2倍に増やすことができるのでしょうか?

ファン:こうした生産能力は、2〜3年以内に急速にスケールアップ可能です。サプライチェーンに需要信号を送るだけでよいのです。1台作れるなら10台作れ、10台作れるなら100万台作れます。こうしたものは複製が難しくありません。

パテル:あなたはサプライチェーンのどこまで深く関わるつもりですか?ASMLに対して「3年後にNVIDIAの年間売上が2兆ドルになるので、EUV露光装置を大幅に増やしてほしい」と直接依頼するのでしょうか?

ファン:一部は直接伝え、一部は間接的に伝えます。TSMCを説得できれば、ASMLも説得できます。私たちは、キーボトルネックを見つけ出す必要があります。しかし、TSMCが説得されれば、数年以内に十分なEUV露光装置が確保できます。

私の見解では、どんなボトルネックも2〜3年を超えて続くことはありません。その一方で、私たちは計算効率を10倍、20倍と引き上げ続けています。HopperからBlackwellへの移行では、30〜50倍の向上を実現しました。CUDAの柔軟性のおかげで、私たちは絶えず新しいアルゴリズム・新技術を発明し、容量を増やしながら効率を高めています。こうしたことは、私をまったく心配させません。私が心配しているのは、下流の状況です。エネルギー政策がエネルギー拡張を阻害しており、エネルギーがなければ新たな産業は築けません。エネルギーがなければ、新たな製造業も立ち上げられません。

米国を再工業化する必要があります。チップ製造、コンピューター製造、パッケージングを米国に呼び戻さねばなりません。EV、ロボット、AIファクトリーの製造も必要です。これらすべてはエネルギーなしには実現できませんが、エネルギーの整備には長い時間がかかります。チップ製造能力は2〜3年で解決可能な問題です。CoWoS製造能力も同様です。

TPUはNVIDIAのAI演算能力支配を打ち破るか?

パテル:世界トップ3のモデルのうち、ClaudeとGeminiの2つはグーグルのTPUで訓練されています。これはNVIDIAにとってどのような意味を持つのでしょうか?

ファン:私たちが行っていることは全く異なります。NVIDIAは、単なるテンソル処理ユニット(TPU)ではなく、アクセラレーテッド・コンピューティングを提供しています。アクセラレーテッド・コンピューティングは、分子動力学、量子色力学、データ処理、構造化データ、非構造化データ、流体力学、素粒子物理学など、AIを超えた幅広い分野で活用できます。もちろんAIもその一部です。

アクセラレーテッド・コンピューティングは、それよりもはるかに広範です。AIは現在の話題であり、明らかに重要かつ影響力がありますが、コンピューティングはそれよりも遥かに広範です。NVIDIAは、汎用コンピューティングからアクセラレーテッド・コンピューティングへと、コンピューティングのあり方を再定義しました。私たちの市場カバレッジは、いかなるTPUやASICよりも遥かに大きく、あらゆるアプリケーションを加速できる唯一の企業です。私たちは巨大なエコシステムを持ち、あらゆるフレームワークやアルゴリズムがNVIDIA上で動作します。

私たちのコンピューターは、他者が操作できるように設計されているため、あらゆる運用者が私たちのシステムを購入できます。しかし、多くの自社開発システムは、その柔軟性が低いため、他者が操作できないのが実情です。誰でも構築・運用できる私たちのシステムは、グーグル、アマゾン、Azure、オラクルなどのあらゆるクラウドに存在します。

他人にレンタルする場合、多様な業界からの膨大な顧客群が購入保証者となる必要があります。自社で使用する場合、もちろん私たちは自社運用を支援できます。xAIにおけるマスク氏への支援がその例です。また、あらゆる企業・業界の運用者に能力を付与できます。例えば、リリー社のために科学研究および創薬発見向けのスーパーコンピューターを構築し、その運用を支援することが可能です。これは、創薬発見およびバイオサイエンス全般にわたって活用できます。

TPUでは実行できないアプリケーションが多数存在します。NVIDIAのCUDAも優れたテンソル処理ユニットですが、データ処理のすべての工程、計算、AIなど、あらゆる処理を担えます。私たちの市場機会ははるかに大きく、カバレッジも広範です。世界中のあらゆるアプリケーションをサポートしているため、どこででもNVIDIAシステムを構築でき、必ず顧客がいることが保証されます。これは全く異なる状況です。

パテル:あなたの収益は驚異的ですが、それは製薬業界や量子コンピューティングからではなく、主にAIから生まれています。AIという前例のない技術が、前例のないスピードで成長しているからです。そこで疑問が生じます。AIにとって最も有益なのは何でしょうか?TPUは本質的に巨大なパルスアレイであり、行列乗算に特に優れています。GPUはより柔軟で、分岐判断が多く、メモリアクセスが不規則なタスクにも適しています。しかし、AIが実際に行っているのは何でしょうか?要するに、AIとは、非常に予測可能な行列乗算を何度も繰り返す作業にすぎません。それならば、なぜチップ上にスレッドブロックスケジューラーやスレッドとメモリバンク間の切り替えといった汎用機能のための領域を確保する必要があるのでしょうか?その領域は、すべて行列乗算専用に割り当てられるはずです。TPUはまさに、今爆発的に成長している計算需要に特化して設計されています。あなたはどう考えますか?

ファン:行列乗算はAIの重要な一部ですが、すべてではありません。新しいアテンション機構を考案したり、分解方法を変更したり、混合状態空間モデル(SSM)のような全く新しいアーキテクチャを発明したりする場合、普遍的にプログラマブルなアーキテクチャが必要です。拡散モデルと自己回帰モデルを融合したモデルを作成する場合も、同様に普遍的にプログラマブルなアーキテクチャが必要です。私たちは、あなたが思いつくあらゆるものに対応できます。これが私たちの優位性です。プログラマブルであるため、新しいアルゴリズムの開発ははるかに容易です。

新しいアルゴリズムを開発する能力こそが、AIがこれほど速く進歩している理由です。TPUを含む他の技術は、ムーアの法則に従い、年間約25%の進歩を遂げます。しかし、年間10倍や100倍の飛躍を実現するには、アルゴリズムと計算方法を根本的に毎年変える必要があります。

これがNVIDIAの根本的な優位性です。BlackwellはHopperと比べて50倍のエネルギー効率を実現しました。私が初めて「35倍」と発表したとき、誰も信じませんでした。その後、ある記事では「実は50倍だ」と報じられました。単なるムーアの法則では到底達成できません。私たちが採用した新モデル、例えばエキスパート・ミックス(MoE)モデルを並列化・分解・分散化し、全体のコンピューティングシステムに展開することで実現しました。CUDAがなければ、また、新しいカーネルを深く書き込む能力がなければ、これは極めて困難です。

これは、プログラマブルなアーキテクチャとNVIDIAの極めて密接な共同設計能力の結合です。NVLinkやSpectrum-Xといったネットワーク構造そのものに一部の計算をオフロードすることもできます。プロセッサー、システム、ネットワーク構造、ライブラリ、アルゴリズムを同時に変更できます。CUDAがなければ、どこから手をつけてよいかさえわかりません。

パテル:これはNVIDIAの顧客に関する興味深い問題を提起します。収益の60%は5つの超大規模クラウドプロバイダーから得ています。かつての顧客は、実験を行う教授たちで、彼らはCUDAを必要とし、他のアクセラレーターでは動作しませんでした。彼らはただPyTorchでCUDAを走らせれば、すべてが最適化されていたのです。しかし、これらの超大規模クラウドプロバイダーは、自社でカーネルを書く能力を持っています。実際、特定のアーキテクチャから最後の5%のパフォーマンスを引き出すためには、それが不可欠です。Anthropicとグーグルは、主に自社のアクセラレーター(TPUおよびTrainium)を稼働させています。GPUを使用するOpenAIでさえ、Tritonを採用しており、彼らは自社のカーネルを必要としています。彼らはcuBLASやNCCLを使わず、自社のソフトウェアスタックを用い、他のアクセラレーターにもコンパイルできます。もしあなたの大多数の顧客がCUDAの代替品を作成し、実際にそうしているとすれば、CUDAは、最先端のAIがNVIDIA上で走るという点において、どれほど重要な要素なのでしょうか?

ファン:CUDAは豊かなエコシステムです。あらゆるコンピューター上で開発を行う場合、CUDAを第一選択とすることは非常に賢明です。なぜなら、そのエコシステムが非常に充実しており、あらゆるフレームワークをサポートしているからです。カスタムカーネルを書こうとする場合、私たちのTritonへの貢献は非常に大きく、Tritonのバックエンドには大量のNVIDIA技術が組み込まれています。

私たちは、あらゆるフレームワークがより良くなることを喜んで支援します。Triton、vLLM、SGLangなど、多数のフレームワークがあります。また、verlやNeMo RLなど、強化学習向けの新しいフレームワークも登場しています。後学習(post-training)および強化学習分野は、爆発的に成長しています。したがって、特定のアーキテクチャ上で開発を行う場合、CUDAを選ぶのが最も意味があります。なぜなら、そのエコシステムの充実度が確実に保証されているからです。

また、万が一問題が発生した場合、問題の原因は自分のコードにある可能性の方が高く、山積みになった下位層のシステムにある可能性は低いと理解できます。あなたが扱っているコードの規模の大きさを忘れてはいけません。システムが動作しない場合、「自分が間違っているのか、それともコンピューターが間違っているのか?」と自問することになります。もちろん、常に「自分が間違っている」と気づけることが理想です。そうすることで、コンピューターを常に信頼できるようになります。明らかに私たちにもバグはたくさんありますが、肝心なのは、私たちのシステムが何度も検証済みであり、安心してその上に構築できることです。これが、私がまず言いたかった点、すなわちエコシステムの豊かさ、プログラマビリティ、および能力です。

第二に、開発者にとって最も重要なのは、インストールベース(既設台数)です。自分のソフトウェアが多くのコンピューターで動作することを望みます。自分だけのためにソフトウェアを書くのではなく、自分のクラスターまたは他人のクラスターのために書くのです。なぜなら、あなたはフレームワーク開発者だからです。NVIDIAのCUDAエコシステムは、最終的にそれが最大の財産なのです。

現在、世界中に数億台のGPUが存在し、あらゆるクラウドに配置されています。A10、A100、H100、H200、Lシリーズ、Pシリーズなど、さまざまなサイズ・形状のGPUがあります。ロボット企業であれば、CUDAスタックがロボット内部で直接動作することを望むでしょう。私たちはほぼどこにでも存在しています。このインストールベースは、一度ソフトウェアやモデルを開発すれば、どこでも使えることを意味します。この価値は計り知れません。

最後に、私たちはあらゆるクラウドに存在するため、真にユニークです。AI企業や開発者であれば、どのクラウドプロバイダーと提携するか、また負荷をどこで実行するかが不透明でも構いません。問題ありません。私たちは、あなた自身のデータセンターを含め、どこにでも存在します。エコシステムの豊かさ、インストールベースの広範さ、存在場所の多様性——これらすべてが重なって、CUDAは比類なく価値あるものとなります。

パテル:納得できます。しかし、私はこれらの優位性が、あなた最大の顧客にとってどれほど重要なのかを問いたいのです。多くの人にとってはCUDAは非常に価値あるものかもしれませんが、あなたの収益の大半は、自社でソフトウェアスタックを構築できる大規模顧客から得られています。特に、将来AIが強化学習で厳密に検証可能な分野に進出すれば、問題は「誰が大規模クラスター上で最も高速な行列乗算およびアテンションカーネルを書けるか?」に変わります。これは非常に検証可能な最適化問題です。

こうした超大規模クラウドプロバイダーは、完全に自社でこれらのカスタムカーネルを書く能力を持っています。もちろん、NVIDIAのコストパフォーマンスが依然として優れているため、彼らはNVIDIAを選択し続けるかもしれません。しかし、そうなれば問題は、単にハードウェアの仕様の優劣、および1ドルあたりの演算能力や帯域幅の多寡に帰着します。

歴史的にNVIDIAはCUDAというモートゥーを武器に、AIハードウェアおよびソフトウェアで70%以上の利益率を維持してきました。しかし、現在の問題は、最大の顧客がこのモートゥーを回避できる能力を有している場合、果たしてこの高い利益率を維持できるのかという点です。

ファン:私たちは、これらのAIラボに驚異的な数のエンジニアを割り当て、彼らと共にソフトウェアスタックの最適化に取り組んでいます。その理由は、私たち以上に私たちのアーキテクチャを理解する者はいないからです。これらのアーキテクチャはCPUほど汎用的ではありません。CPUは、ある意味でキャデラックのようなもので、運転が容易で、高速走行をせず、クルーズコントロールが備わっており、すべてがシンプルです。一方、NVIDIAのGPUおよびアクセラレーターはF1カーに近いです。誰でも時速160kmまで出せますが、限界まで押し上げるには相当の専門知識が必要です。私たちは大量のAIを用いてカーネルを書いています。

私は、当面の間、私たちは依然として必要とされ続けると確信しています。私たちの専門知識により、AIラボのパートナーは簡単に2倍のパフォーマンス向上を達成できます。あるカーネルやソフトウェアスタック全体を最適化した後、モデルの速度が50%、2倍、さらには3倍に向上することは珍しくありません。彼らが保有するHopperおよびBlackwellのクラスター規模を考えれば、これは非常に大きな数字です。パフォーマンスが2倍になれば、そのまま収益が2倍になります。

NVIDIAのコンピューティングスタックは、総所有コスト(TCO)において世界最高であり、他社に匹敵するものはありません。いかなるプラットフォームも、私たちのパフォーマンスとTCOの比率を上回るものを提示したことはありません。DylanのInferenceMAXベンチマークテストは、誰でも利用可能です。しかし、TPUやTrainiumはこのテストに参加していません。私は、TPUが宣伝する「極めて低い推論コスト」を示すためにInferenceMAXテストに挑戦することを強く奨励しています。しかし、なかなか応じてくれません。

MLPerfについても同様です。私はTrainiumが、彼らが主張する40%の優位性を示すことを強く望んでいます。また、TPUのコスト優位性もぜひ示してもらいたいです。しかし、私の見解では、彼らが主張するこれらの優位性は、第一原理から考えて全く筋が通っていません。したがって、私たちが成功している理由は単純で、TCOが非常に優れているからです。

第二に、あなたは収益の60%がトップ5のクラウドプロバイダーから得られていると述べましたが、これらのビジネスの大部分は外部向けです。例えば、AWSでNVIDIAチップを使用しているのは、内部利用ではなく、外部顧客向けが大半です。Azureやオラクルの顧客も、明らかに外部向けです。彼らが私たちを支持するのは、私たちの影響力の大きさ、そして私たちが世界最高の顧客を彼らに紹介でき、それらの顧客がすべてNVIDIA上で構築されているからです。これらの企業がNVIDIA上で構築しているのは、私たちの影響力と多機能性の高さゆえです。

したがって、私はこのフィードバックループ(飛輪効果)を、インストールベース、アーキテクチャのプログラマビリティ、エコシステムの豊かさ、そして世界中の数千社のAI企業の存在と捉えています。もしAIスタートアップ企業であれば、どのアーキテクチャを選ぶでしょうか?最も豊かなものを選び、私たちが最も豊かです。最も大きなインストールベースを持つものを選び、私たちが最大です。最も完成されたエコシステムを持つものを選びます。これが飛輪です。

以上の点を総合すると、私たちの1ドルあたりのパフォーマンスは最高であり、顧客のトークンコストは最低です。私たちの1ワットあたりのパフォーマンスは世界最高であり、パートナーが1ギガワットのデータセンターを建設した場合、そのデータセンターは最大限の収益およびトークンを生み出すことが望まれます。これは直接収益に結びつきます。収益を最大化するために、可能な限り多くのトークンを生成したいと考えるでしょう。私たちのアーキテクチャは、世界で最も高い1ワットあたりのトークン数を実現しています。また、インフラストラクチャーのレンタルを目的とする場合、私たちには世界最多の顧客がいます。これが飛輪が回る理由です。

パテル:興味深いです。結局のところ、実際の市場構造はどのようなものなのかという問題に帰着します。他の企業が存在するとしても、世界中の数千社のAI企業が、ほぼ均等な演算能力シェアを占める世界が存在するかもしれません。しかし、現実には、たとえこの5つのクラウドプロバイダーを通じても、アマゾンで実際に演算能力を使用しているのは、Anthropic、OpenAI、および大規模な基礎研究ラボです。こうした大手プレイヤーは、異なるアクセラレーターを稼働させる能力とリソースを有しています。

もしあなたが述べたコストパフォーマンスや1ワットあたりのパフォーマンスなどの優位性がすべて真実であるならば、なぜAnthropicのような企業が、数日前にブロードコムおよびグーグルと、数ギガワット規模のTPU取引を発表し、その大部分の演算能力をそこに集中させたのでしょうか?グーグルにとっても、TPUは彼らの演算能力の大部分を占めています。したがって、こうした大規模AI企業の演算能力は、かつてはすべてNVIDIAに依存していたものが、今はそうではないという状況が見られます。紙面上のこれらの優位性がすべて成立しているとすれば、彼らがなぜ他のアクセラレーターを選んだのか、非常に疑問に思います。

ファン:Anthropicは単なる特異点であり、大きなトレンドではありません。Anthropicという企業が存在しなければ、TPUの成長はどこから来るでしょうか?100%Anthropicによるものです。同様に、Anthropicがいなければ、Trainiumの成長はどこから来るでしょうか?これも100%Anthropicによるものです。これは、ほぼ公然の秘密です。ASICの機会が増えたわけではなく、単にAnthropicという1社があるだけです。

パテル:しかし、OpenAIはAMDと取引をしており、自社でTitanアクセラレーターを製造しています。

ファン:はい、しかし、彼らの大部分の演算能力は依然としてNVIDIA上で稼働していると、誰もが認めていると思います。私たちは引き続き多くの共同作業を行います。私は、他のものを使用したり、試したりすることを否定しません。彼らが試さなければ、私たちの優れた点を理解できません。時には、思い出させる必要もあります。私たちは現在の地位を、常に勝ち取らなければならないのです。

誰かが大風呂敷を広げることはよくあります。どれだけのASICプロジェクトが中止されたかを考えてみてください。ASICを製造するだけでなく、NVIDIAより優れたものを製造しなければならないというのは、非常に難しいことです。実際には不合理です。NVIDIAに何らかの欠陥があると仮定しない限り、それは成立しません。しかし、私たちの規模とスピードは現実に存在し、世界で唯一、毎年新製品を発表し、毎年大きな飛躍を遂げている企業です。

パテル:彼らの論理は、NVIDIAより優れている必要はなく、70%程度の性能差があれば十分だということかもしれません。なぜなら、あなたに70%の利益率を支払っているからです。

ファン:いいえ、ASICの利益率も非常に高いことを忘れないでください。仮にNVIDIAの利益率が70%で、ASICの利益率が65%だとしましょう。あなたは何を節約できたのでしょうか?

パテル:ブロードコムのような企業のことですか?

ファン:そうです。あなたは他人に支払う必要があります。私の知る限り、ASICの利益率は非常に高く、彼ら自身もそれを誇りに思っています。

では、なぜそうしたのかという問いに戻ります。以前は、私たちにはその能力がありませんでした。当時、OpenAIやAnthropicのような基礎AIラボを立ち上げることがどれほど困難か、また、彼らがサプライヤー自身からの巨額投資を必要としていることに、私は深く気づいていませんでした。当時は、数十億ドルをAnthropicに投資して、彼らに私たちの演算能力を使ってもらうという能力がありませんでした。しかし、グーグルやAWSにはその能力がありました。彼らは当初から巨額の投資を行い、その見返りとしてAnthropicは彼らの演算能力を使用しました。当時の私たちには、その能力がありませんでした。

私の過ちだったのは、彼らが本当に他に選択肢がなく、リスク資本が50~100億ドルをAIラボに投資してAnthropicのような存在になることを期待することは不可能だという点を、深く理解していなかったことです。これは私の過ちでした。しかし、当時その理解があったとしても、私たちがその規模で行動できたとは思いません。しかし、私は二度とこの過ちを犯しません。

私はOpenAIへの投資を喜んで行い、彼らの拡大を支援することも喜んで行います。これは必要不可欠だと信じています。その後、私たちがその能力を獲得したとき、Anthropicが私たちに来たので、私は投資家になることを喜び、彼らの拡大を支援することも喜びました。当時はそれができませんでした。もし全てをやり直すことができ、当時のNVIDIAが今の規模であったなら、私は間違いなくそうしたでしょう。

なぜNVIDIAは超大規模クラウドプロバイダーにならないのか?

パテル:長年にわたり、NVIDIAはAI分野で儲け、しかも莫大な利益を上げてきた企業です。現在、あなたは投資を行っています。報道によると、OpenAIには300億ドル、Anthropicには100億ドルを投資しています。現在、彼らの評価額は上昇しており、今後もさらに上昇すると信じています。したがって、これまでずっと彼らに演算能力を提供し、その方向性を見守ってきたのであれば、彼らの価値が1~2年前には現在の10分の1、あるいは1年前には現在の価値の10分の1であった時期に、あなたはその時点で巨額の投資をし、基礎AIラボとして自社で巨額の投資を行うか、あるいは現在の評価額でより早く投資を行うべきだったのではないでしょうか?あなたには現金があります。では、なぜもっと早く行動しなかったのでしょうか?

ファン:私たちは、可能な限り早く、そして能力ができたときにすぐに行動しました。もし私が早めに行動できたなら、そうしたでしょう。Anthropicが私たちに行動を求めたとき、私たちはその能力がありませんでした。当時は、その選択肢すら頭にありませんでした。

パテル:どういうことですか?資金の問題ですか?

ファン:はい、投資規模の問題です。当時は、社外への投資をしたことがなく、ましてやそんな巨額の投資をしたことはありませんでした。私たちにはその必要性が認識されていませんでした。私は、彼らが他のすべての企業と同じようにVCから資金調達できるものだと考えていました。しかし、彼らが目指していたことは、VCにはできないことでした。OpenAIが目指していたことも、VCにはできないことでした。私は今ではそれを理解していますが、当時は知りませんでした。

しかし、それが彼らの天才性の証です。彼らは、その点で非常に賢いのです。彼らは当時から、そのようなことをしなければならないと理解していました。私は、彼らがそれを成し遂げたことをとても嬉しく思います。たとえそれがAnthropicを他の企業に導いたとしても、私はそれでも嬉しいです。Anthropicの存在は世界にとって良いことであり、私はそれを喜んでいます。

パテル:あなたは依然として多くのお金を稼いでおり、四半期ごとにさらに多く稼いでいます。あなたがこれほど多くの現金を継続的に稼いでいるのであれば、NVIDIAはそれをどのように使うべきでしょうか?一つの答えは、資本支出をこれらのラボの運用支出に変換し、彼らが演算能力をレンタルできるようにする中間業者エコシステムが、すでに一式揃っているという点です。チップは高価ですが、その寿命期間中に多くの収益を生み出します。なぜなら、AIモデルがどんどん良くなっているからです。それらが生成するトークンの価値は増加していますが、展開コストは高いのです。NVIDIAには資本支出を行う余裕があります。実際、報道によると、CoreWeaveへの支援額は63億ドルに達し、すでに20億ドルを投資しています。では、なぜNVIDIA自身がクラウドプロバイダーになり、超大規模クラウドプロバイダーとなって、自社で演算能力をレンタルしないのでしょうか?

ファン:これは私たちの会社理念であり、私はそれが賢明であると考えています。私たちは、「絶対に必要なことだけを行い、それ以外は極力避ける」べきです。つまり、私たちがコンピューティングプラットフォームを構築するという仕事を行わなければ、誰も行わないであろうと、私は本気で信じています。もし私たちが私たちが冒すリスクを冒さず、NVLinkを私たちのやり方で構築せず、ソフトウェアスタック全体を構築せず、私たちのやり方でエコシステムを構築せず、20年間CUDAを投資し、その大部分の期間で赤字を出していなければ、誰も行わないでしょう。

もし私たちが、光線追跡、画像生成、初期のAI作業、これらのモデル、データ処理、構造化データ処理、ベクトルデータ処理など、特定の分野に特化したライブラリを、15年前から作り始めなかったとすれば、誰も作らないでしょう。私はこれを完全に信じています。計算リソグラフィ用のライブラリ「cuLitho」を作成しましたが、もし私たちが作らなければ、誰も作らないでしょう。したがって、アクセラレーテッド・コンピューティングが今日このような進歩を遂げられたのは、私たちがこれらのことを実行したからです。

したがって、私たちはこのことを実行すべきであり、全身全霊をかけて全力で取り組むべきです。しかし、世界には多くのクラウドが存在し、もし私たちが行わなければ、誰かが行うでしょう。したがって、私たちは「絶対に必要なことだけを行い、それ以外は極力避ける」という理念を貫いており、それは私たちの会社の日々の活動に存在しています。私が行うすべてのことは、この視点から見ています。

クラウドに関して言えば、もし私たちがCoreWeaveの存在を支援しなければ、これらの新しいクラウド、AIクラウドは存在しません。もし私たちがCoreWeaveを支援しなければ、彼らは存在しません。もし私たちがNscaleを支援しなければ、彼らは今日の成果を達成していません。Nebiusを支援しなければ、彼らも今日の姿にはなっていません。今、彼らは非常にうまくやっています。

これは一種のビジネスモデルです。私たちは「絶対に必要なことだけを行い、それ以外は極力避ける」べきです。したがって、私たちはエコシステムに投資しています。なぜなら、私は私のエコシステムが繁栄することを望んでいるからです。私は、このアーキテクチャ、AIが可能な限り多くの業界、可能な限り多くの国に広がり、地球全体がAIの上に構築され、米国の技術スタックの上に構築されることを望んでいます。このビジョンこそが、私たちが追求しているものです。

もう一点、多くの優れた基礎モデル企業があり、私たちはできる限りすべてに投資しています

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News