AIが『1984年』を読み、それを禁止することを決定した

TechFlow厳選深潮セレクト

AIが『1984年』を読み、それを禁止することを決定した

AIによる判断に抵抗した者は職を失い、AIによる判断に同意して署名した者は何事もなく過ごしている。

著者:クーリー、TechFlow

先週、イギリス・マンチェスターにある中学校が、自校の図書館をAIで審査した。

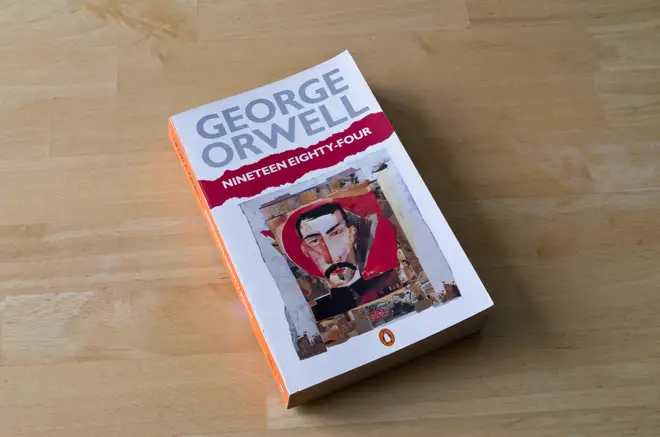

AIは193冊の書籍を「廃棄対象」とするリストを作成し、それぞれに削除理由を添付した。ジョージ・オーウェル『1984年』もそのリストに含まれており、理由は「拷問、暴力、性的脅迫をテーマとする内容を含む」であった。

『1984年』は、政府がすべてを監視し、歴史を書き換え、市民が何を読むかを一方的に決めてしまう世界を描いた作品である。今や、AIが一校の学校のためにまさに同じことを実行している——しかも、AI自身がその判断の意味をまったく理解していない可能性すらある。

当該学校の司書はこのAIによる勧告を不合理と判断し、全件の実施を拒否した。

これに対し、学校は直ちに「児童の安全」を根拠に彼女を対象とした内部調査を開始し、「不適切な書籍を図書館に導入した」として地方政府へ通報した。彼女は強いストレスにより休職を余儀なくされ、最終的には退職に至った。

皮肉なことに、地方政府の調査結果は、彼女が確かに「児童の安全に関する手順」に違反していたとして、苦情を「成立」と認定した。

イギリス学校図書館協会(School Library Association)のカロライン・ローチ会長によれば、この判定によって彼女は今後、いかなる学校でも職に就くことができなくなるという。

AIの判断に抵抗した者は職を失い、AIの判断に賛同してサインした者は何事もなく済んだ。

その後、学校は内部文書において、すべての分類およびその理由がAIによって生成されたことを認め、「分類はAIが生成したものではあるが、おおむね正確であると我々は判断している」と明記した。

一校の学校が「生徒にふさわしい書籍とは何か」という極めて人間的な判断をAIに委ね、AIは自分自身も理解できない答えを返し、それを人間の管理者が詳細を確認することなく承認したのである。

この一件は、イギリスの言論の自由を守る団体「Index on Censorship」によって暴露されたが、その影響は単一の学校の書棚にとどまらない問いを引き起こした:

AIが、人間に許容されるコンテンツと危険なコンテンツを判断し始めるとき、いったい誰がAIの判断の正しさを評価するのか?

ウィキペディアがAIにドアを閉じる

同じ週、別の機関がこの問いに行動で応えた。

学校がAIに「人が何を読むべきか」を決定させたのに対し、世界最大のオンライン百科事典「ウィキペディア(Wikipedia)」は、真逆の選択をした:「百科事典に何を書くか」をAIに決断させない。

同じ週、英語版ウィキペディアは、大規模言語モデル(LLM)を用いて記事を生成または改稿することを禁じる新方針を正式に採択した。投票結果は賛成44票、反対2票であった。

直接のきっかけとなったのは、「TomWikiAssist」という名のAIアカウントだった。今年3月初頭、このアカウントがウィキペディア上で自主的に複数の記事を作成・編集したが、コミュニティによって発見され、緊急措置が取られた。

AIが1本の記事を書くのにかかる時間は数秒だが、ボランティアの編集者がAIが生成した記事の事実関係、出典、表現の正確性を検証するには、数時間かかる。

ウィキペディアの編集コミュニティの人数には限りがある。もしAIが無制限にコンテンツを量産できるなら、人間の編集者は到底審査しきれない。

しかし、これが最も深刻な問題ではない。ウィキペディアは、世界中のAIモデルにとって最も重要な学習データ源の一つである。AIはウィキペディアから知識を学び、その知識を使って新たなウィキペディア記事を書く。そしてその新規記事は、次世代のAIモデルの学習データとして再び取り込まれる。

一度、AIが生成した誤情報が混入すると、この循環の中で誤りは不断に拡大・増幅され、「マトリョーシカ式のAIによるデータ汚染」が起きる:

AIが訓練データを汚染し、汚染された訓練データがさらにAIを汚染する。

ただし、ウィキペディアの方針にはAI利用を完全に禁止するものではなく、二つの例外が設けられている:編集者が自ら書いた文章の推敲や翻訳補助としてAIを活用することは許可されている。しかしその一方で、方針は明確に警告している。「AIはあなたの指示を超えてテキストの意味を変更し、引用元と矛盾する内容を生成する可能性がある」ためだ。

人間のライターが誤りを犯せば、ウィキペディアは過去20年以上にわたり、コミュニティによる協働作業でそれを訂正してきた。しかし、AIが犯す誤りは性質が異なる。AIがでっち上げる内容は、しばしば「本物より本物らしい」だけでなく、大量生産も可能なのである。

一校の学校がAIの判断を信じて行動した結果、司書を失った。ウィキペディアはその逆を選択し、ドアをバタンと閉じた。

だが、もしAIそのものを開発する人々自身が、すでにAIを信用しなくなっているとしたら?

AIを開発する人々が、まず自分たちが恐れる

外部の機関がAIへの門戸を閉ざす一方で、AI企業自身も後退を始めている。

同じ週、OpenAIはChatGPTの「アダルトモード」の導入を無期限に延期した。この機能は当初、昨年12月の提供開始を目指しており、年齢確認を経た成人ユーザーがChatGPTと性的な会話をすることを可能にするものだった。

CEOのサム・アルトマン氏は昨年10月、自らこの機能を予告し、「大人を大人として扱う」という趣旨の発言を行っていた。

ところが、3度の延期を経た末、結局この機能は全面中止となった。

英フィナンシャル・タイムズ紙の報道によると、OpenAI内部の健康顧問委員会は、この機能に対して全会一致で反対した。顧問たちの懸念は具体的なものだった:ユーザーがAIに対して不健全な感情的依存を抱くこと、そして未成年者が年齢確認を回避する手段を見つけることは避けられない、というものである。

ある顧問の発言はさらに率直だった。「重大な改良が行われない限り、この機能は“セクシーな自殺コーチ”と化すだろう」。

年齢確認システムの誤判定率は10%を超えている。ChatGPTの週間アクティブユーザー数が8億人規模であることを考えれば、10%という数字は、数千万人が誤って年齢分類される可能性を意味する。

アダルトモードは、今月唯一の中止となった製品ではない。AI動画生成ツール「Sora」、およびChatGPT内蔵の即時決済機能も、同時期にすべてサービス終了となった。アルトマン氏は、会社がコア事業に集中するため、「副次的なタスク」を削減する必要があると説明している。

だが、OpenAIは同時にIPO(新規株式公開)に向けて準備を進めている。

上場を目指す企業が、議論を呼ぶ可能性のある機能を相次いで中止するのは、単なる「集中」とは呼びにくい動きである。

5か月前までアルトマン氏は「大人を大人として扱う」と述べていたが、5か月後には、自社が「AIがユーザーに触れさせてよいものと、そうでないものを、まだ明確に定義できていない」ことに気づいたのだ。

AIを開発する人々自身が、その答えを持っていない。では、その線引きを果たすべきは一体誰なのか?

追いつかないスピード差

これら3つの出来事を並べてみると、核心的な結論が自然と浮かび上がる:

AIがコンテンツを生成する速度と、人間がコンテンツを審査する速度は、もはや比較にならないほど乖離している。

この文脈で見れば、マンチェスターの学校の選択は十分に理解できる。193冊の書籍を司書が1冊ずつ読み、吟味して判断するにはどれほどの時間がかかるだろうか?それに対し、AIが処理するには数分で済む。

校長は「数分」のほうの選択肢をとった。果たして彼は本当にAIの判断力そのものを信頼していたのか?筆者はむしろ、彼がその時間をかけたくなかったからだと考える。

これは経済的な問題である。生成コストはゼロに近づきつつあるが、審査コストはすべて人間が負担している。

ゆえに、AIの影響を受けるあらゆる機関は、最も乱暴な方法で対応を余儀なくされている:ウィキペディアは全面禁止、OpenAIは製品ラインを一斉に削減。いずれも熟考の末の結論ではなく、「考える暇がないから、まず塞ぐ」だけの緊急避難的措置なのだ。

「まず塞ぐ」ことが、今や日常的な対応になりつつある。

AIの能力は数か月ごとに進化を遂げているが、AIが扱ってよいコンテンツとそうでないコンテンツについての議論は、まともな国際的枠組みすら存在しない。各機関は自らの敷地内の線引きだけを気にし、互いに矛盾する線が引かれ、調整する主体もいない。

AIのスピードはさらに加速する一方で、審査を担う人材は増えない。この「はさみ差」はますます拡大し続け、やがて『1984年』の禁止など比ではない重大な事態を招く日が来るだろう。

そうなってから線を引こうとしても、すでに手遅れかもしれない。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News