ロボットの次のステップ

TechFlow厳選深潮セレクト

ロボットの次のステップ

ロボットのChatGPT的瞬間?

執筆:Henry

最近ロボットの進展がかなり大きい?

最近、スマートロボットの研究は活発で、新しいデモンストレーションが次々と登場しています。

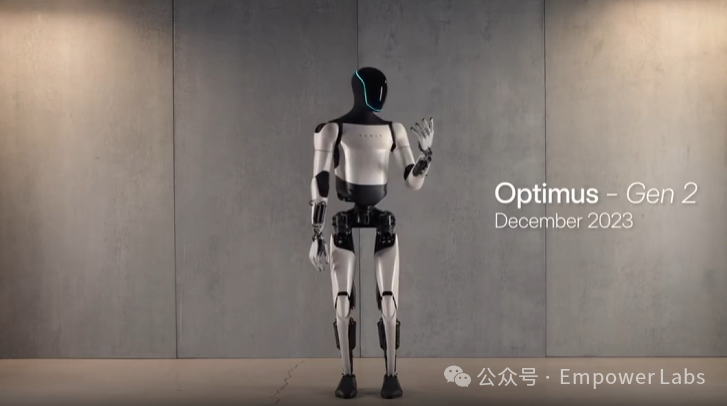

12月中旬、テスラは第二世代のOptimusを発表しました。これは産業用製品ではなく純粋なプロトタイプですが、完成度は非常に高いものです。デモでは、宇宙飛行士のような外観を持つOptimusが精巧な運動能力を披露しました。マスク氏は、人間と同じ大きさと形状に設計した理由について、「人間がやりたがらないあらゆる作業をシームレスに代替するため」と述べています。

テスラのロボットは強烈なSF的工業デザインを持ち、高価そうに見えます。そのイメージが「すべてが当然のように動く」という期待感を生んだのかもしれません。しかし実際には、テスラは多くの応用シーンを提示しておらず、人々の反応も「なるほど」という程度でした。ところが、翌1月に相次いで発表された2体のロボットは、多くの人々に本気の「えっ?」という驚きを与えました。

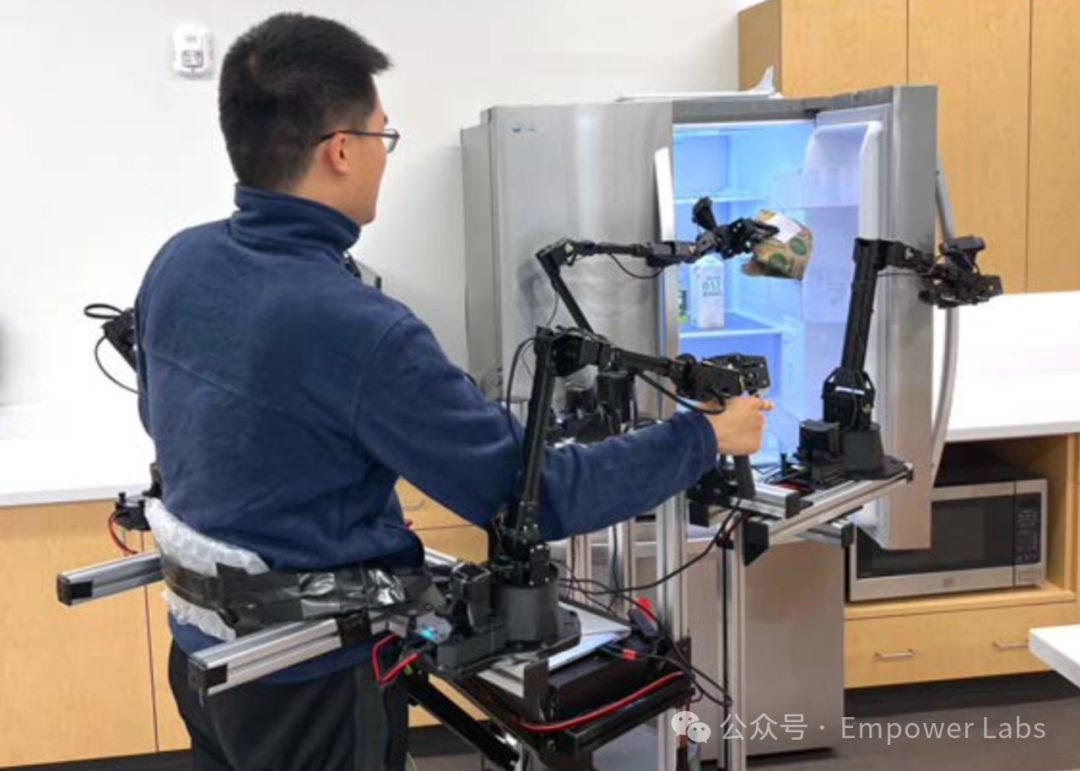

まず最初に登場したのは、スタンフォード大学の研究チームによるMobile Alohaプロジェクトです。このプロジェクトが広く注目を集めた理由は、ロボットの使用シーンが比較的実用的だったからでしょう——料理、猫とのふれあい、洗濯などです。実際、このプロジェクトの主な革新点は、低コストのハードウェア(3万ドル以上で家庭用としては依然として高価ですが)を使って、自律移動可能な両手操作ロボット(外見はあまり人間に似ていませんが)を実現し、さらに人間のスキルを学習できるようにしたことにあるのです。この学習プロセスは少し中二感があります。料理の場合を例にすると、まず人間がロボットを操作して一回料理を行います。するとロボットはその動作の大まかな流れを記憶します。もちろん初めは鍋をうまく扱えませんが、驚くべきことに、腕に搭載されたカメラを使って数十回の自律トレーニングを経ることで、実際に安定して扱えるようになるのです。

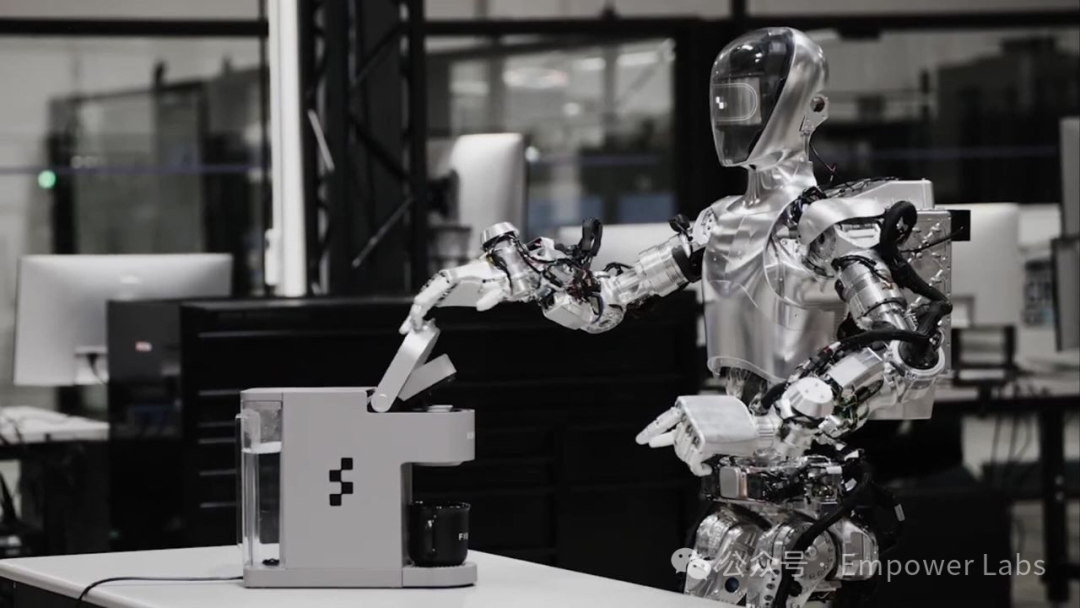

続いて、Figure社が自社の人型ロボットFigure 01がコーヒーを作る様子を映した動画を公開しました。このロボットは人の音声指示「コーヒーを一杯作って」を受け取り、カプセル式コーヒーマシンを使って熟練した手さばきでコーヒーを淹れました。Figure社はこれを「人型ロボットのChatGPT的な瞬間」と称しています。これは大規模言語モデル(LLM)を使って音声指令を理解したという意味ではなく、コーヒー作りのスキルが単に人間の行動を観察・模倣して学習されたという点に衝撃があるからです。まさにChatGPTの登場時と同様のインパクトがある、というわけです。Figure 01は、視覚的に人間がコーヒーマシンを使う様子を観察し、タスクに対する理解を構築した後、数回の自律訓練と誤り修正を通じてこのスキルを習得しました。これはAI駆動の汎用人型ロボットの広大な将来性を示しています。

ビル・ゲイツの「A robot in every home」

2007年の『サイエンティフィック・アメリカン』第1号には、ビル・ゲイツによる署名入り記事が掲載されていました。私はそれが表紙トップの特集記事だったと記憶しています。タイトルは「A robot in every home」です。

この記事の中で、ビル・ゲイツはロボット産業の可能性に強い期待を示していました。それは彼が30年前にマイクロソフトを創業した当時と非常に似ていたからです——画期的な技術が登場している一方で、専門レベルの商用機器はごく少数の大手企業に独占されていたのです。スタートアップやギークたちも面白いものを次々と作り出していましたが、それらは非常に分散しており、共通の標準や開発ツールがまったく存在しませんでした。そこでビル・ゲイツは大胆に予言しました。「こうした問題が解決されれば、ロボットは必ずや一般家庭に入っていくだろう」と。

そのため、マイクロソフトは直ちに投資を行い、Robotics部門を設立し、Microsoft Robotics Studioをリリースして、PC時代に成し遂げた成功を再現しようとしたのです。

この記事の中で、ビル・ゲイツは有名なDARPA 2004年オフロードチャレンジを引用しています。そうです、インターネットの起源とも言われる伝説のDARPAが主催したこの大会の目的は、完全自律走行車両が140マイル以上あるモハベ砂漠を横断することでした。初年度の大会では、最優秀の参加者でもわずか7マイルしか走行できませんでしたが、翌年には5台の車両が完走し、しかもほぼ全力疾走で達成したのです。この競技はロボット技術の進化スピードを極めて象徴的に示しており、それがまさにビル・ゲイツの自信の源でもありました。

当時のマイクロソフトが注力していたのは開発ツールの整備でした。センサーやモーター、サーボ機構などのハードウェア性能は急速に向上し、価格も下がっていましたが、開発面では各ハードウェアごとに専用のドライバープログラムを書く必要がありました。また、当時弱かったプロセッサーが複数のセンサーからのデータをリアルタイム処理できるようにすることも大きな課題でした。マイクロソフトの解決策は、ドライバーに標準を設けることと、マルチスレッド機能を提供することでした。マイクロソフトは.NET Micro Frameworkまで開発しました。.NET技術を熟知している方はご存知でしょうが、このような強力なツールをロボット開発に持ち込んだことは、まさしく次元の違いでした。これにより、ロボット開発者はメモリ管理やスレッドスケジューリングに頭を悩ませることなく、純粋にロジックの記述に集中できるようになったのです。

しかし、その後の結果はすでにご存知の通りです。マイクロソフトのロボット分野への取り組みは成功せず、Robotics部門は2014年の組織再編で完全に解散されました。筆者が長年にわたり断続的に観察してきた限り、主な理由はおそらくコストと応用の2点でしょう。事実、今日に至るまで、家庭用のロボットアームを自作しようとすればまだ相当な費用がかかり、いったい何に使うのかさえ明確ではありません。

ロボットのChatGPT Momentなのか?

時間を現在に戻すと、Mobile AlohaにせよFigure 01にせよ、いずれも以下のような能力を示しています——センサー(カメラであれ、遠隔操作の関節であれ)を通じてある動作を学習し、自律的な訓練とフィードバックによってその動作を真に習得する能力です。さらに、その一連の動作はスキルとして定着し、自然な会話によって呼び出すことが可能になります。そしてこうしたスキルは、プログラムを書くことなく、同じ種類のロボットに即座にコピーできます。

どうやら、ロボットの能力は確かに新たな高みに到達したようです。そのため、「ロボットにもついにChatGPT級の破壊的瞬間が訪れたのか?」と、多くの人が思わず叫んでしまったのも無理はありません。

ビル・ゲイツが予言をした十数年前と比べると、現代のロボットは以下の点で著しい進歩を遂げています:

1. より汎用的になった。ビル・ゲイツにとってのロボットとは、特定のタスクをこなせればどんな形でもよかったのですが、筆者がかつてRoboticsグループの会議に潜り込んで見たデモも、せいぜい走ったり這ったりするだけのものでした。しかし今のロボットは、家庭環境でのスキルを持ち、それらが複製・共有可能になっています。また、ロボット自体の設計が人型に近づいているのも、さまざまな汎用タスクを人間の代わりにこなすためです。

2. 自然なインタラクション方式。マルチモーダルなLLMの支援により、現在のロボット技術は人間の音声指示を理解できるだけでなく、カメラなどの入力からも学習できるようになりました。これは機械学習分野における大きな進歩であり、開発および利用の難易度を大きく下げています。

3. コストのさらなる低下。Mobile Alohaが公表したハードウェアコストは3万ドルを超えていますが、これは移動ベースを含んだ金額です。もしロボットアームのみに限れば、なんとか高級家電並みと考えることも可能です。移動ベースというものは次の注目ポイントの一つかもしれません。例えば最近、テスラへの投資を行う一部の論理は「電気自動車としてではなく、次世代の汎用移動プラットフォームとして見るべきだ」というものです。

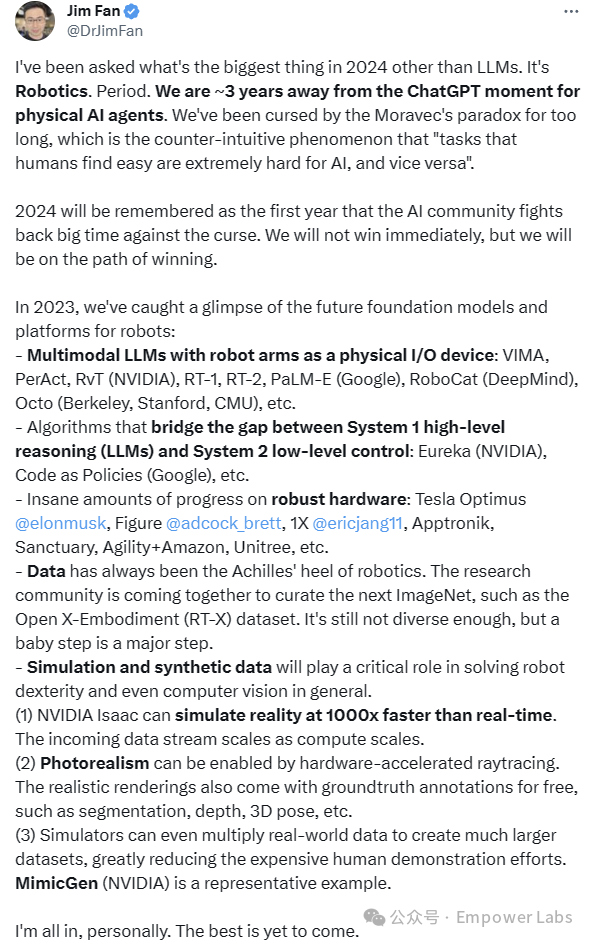

Jim Fanはこの分野最大のKOLの一人で、英偉達(NVIDIA)の上級科学者であり、かつてはOpenAIの最初のインターンでもありました。彼は最近のツイートで、なぜロボットが2024年の最大の注目分野になると彼が考えるのかを説明しています。

しかし、この熱意に満ちたツイートの中でも、Jimは「汎用物理AIロボット」の実現にはまだ約3年かかると考えています。

これに対して筆者は慎重な楽観主義者です。楽観するのはこれほどの進歩を目の当たりにしているからであり、慎重なのはマイクロソフトの失敗という前例があるからです。

ただ一点だけ確かなことがあります。それは、確かに非常にわくわくする時代が来ているということです。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News