もしOpenAIがDAOだったら、この騒動を避けられたのだろうか?

TechFlow厳選深潮セレクト

もしOpenAIがDAOだったら、この騒動を避けられたのだろうか?

ルールや制約は多くの合意を生み出すことができるが、真に偉大な合意は往々にしてルールによって形作られるものではない。

著者:王超

週末のこの大ドラマが幕を開けた当初から、すでにOpenAIはDAOにすべきだという声があった。物語が進むにつれて、こうした意見を持つ人々はますます増えていった。もしOpenAIが実際にDAOの形態で運営されていたなら、この騒動を回避できたのだろうか? 私はそれが可能だったと考えている。しかし、それはDAOのガバナンスが特に優れているからではなく、むしろOpenAIのガバナンスに重大な問題があるためである。DAOという領域から少しでも学んでいれば、このような事態は起こらなかっただろう。

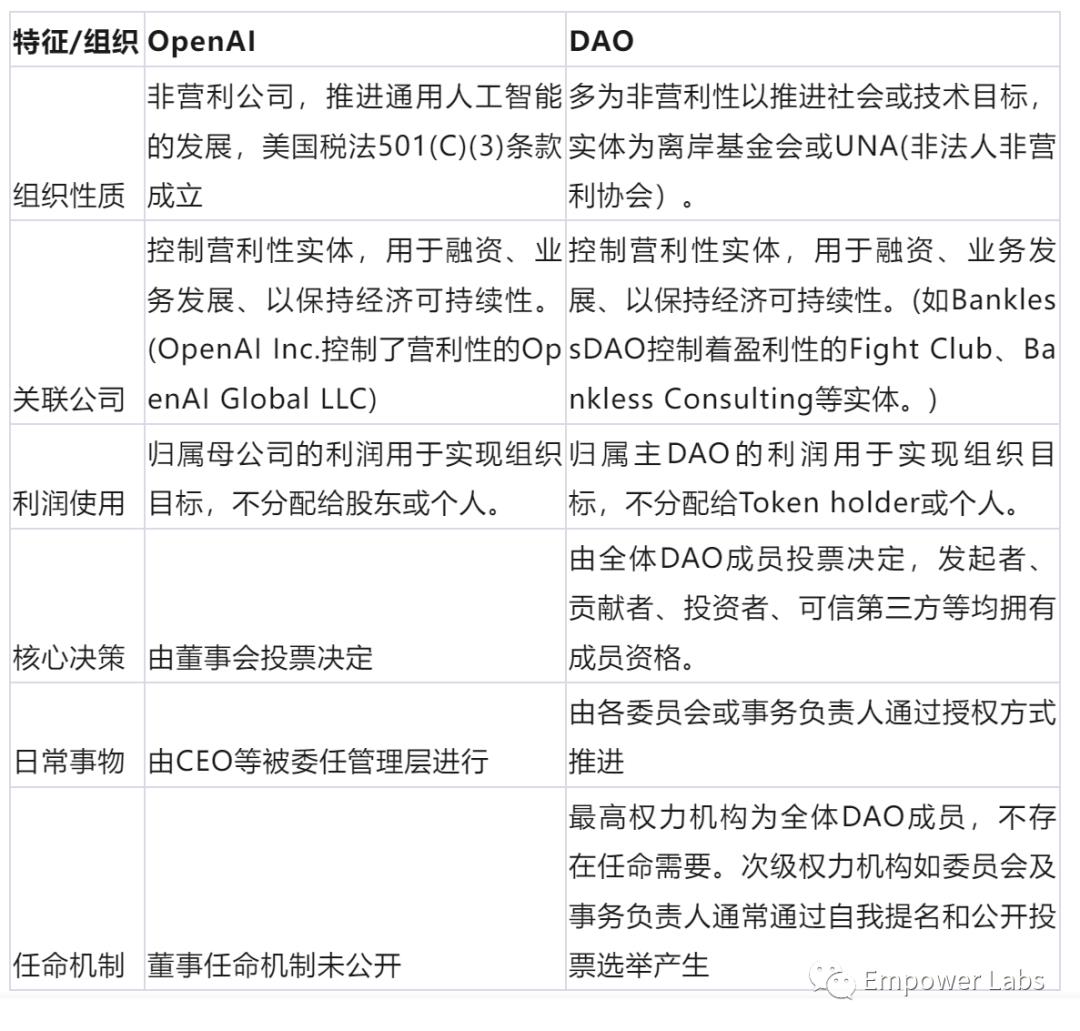

OpenAIは安全な汎用人工知能(AGI)を創造し、全人類に平等に利益をもたらすことを目的とした非営利組織である。つまり、OpenAIは公共財を生み出す組織だと考えられる。多くのDAOもまた公共財を創出する組織であり、多くの点でOpenAIとDAOはすでに非常に似通っている。

(DAOは新しいタイプの組織形態として多様な形態を持っている。ここでの比較対象は一般的な非営利性DAOに限られ、すべてのDAOがこのモデルに当てはまるわけではないことに注意が必要である。)

最近のOpenAI内部の混乱は、その構造的問題に起因するものではなく、ガバナンスルールが不明確かつ不合理であったために操作の余地が生まれた結果である。例えば、元々9人で構成されるはずの理事会は、何人かの退任により現在は6人にまで減少している。最高権力機関である理事会が新たなメンバーを適時に補充しなかったため、メンバーがさらに減って3人になれば、わずか2人の合意でOpenAIの運命を決めることさえ可能になる。また、重要な事項についても極めていい加減な対応が見られる。CEOのサム・アルトマンの交代といった極めて重要な決定についても、理事会全員による討議や審議を経ず、一部の役員が非公開会議の中で勝手に決定したものであり、関係者の意見を十分に考慮せず、適切なコミュニケーションや協議の機会も提供されていない。

営利目的の上場企業ですら、独立取締役を導入して企業統治の透明性を高め、少数株主や一般大衆の利益をより適切に代表しようとしている。基礎科学の発展、社会の安全性、さらには人類の運命に関わるような重要組織であるOpenAIにとって、外部取締役の存在はすでに実現されているものの、この制度は明らかに本来の機能を果たしていない。OpenAIの理事会は、従業員代表など、より多くのバランスを取る仕組みを取り入れる必要があるだけでなく、より効果的なガバナンス体制の構築も求められている。DAOのガバナンスモデルを参考に、OpenAIのためにより堅固で透明性が高く、包括的なガバナンス構造を設計することは、検討に値する方向性だと私は考える。

興味深いのは、もともとDAOが提唱された背景には、技術的自由主義者がコードに完全に依存して、人為的な介入を最大限排除した自己完結的なシステムを構築しようとする思想があり、「Autonomous(自律性)」と呼ばれる理念が強調されていたことだ。しかし、人的な政治的調整がDAOの中に現れた瞬間、それはもはやDAOではなく「DO」となり、自律性を失ってしまう。だが現時点では、理想化されたDAOは到底実現不可能である。そのため、妥協案として、ブロックチェーンネットワークを通じて集団的にガバナンスを行う組織をすべてDAOと見なすようになっている。これは、人による統治という現実を受け入れ、コードによる拘束はあくまで補助的な手段として位置づけられたということだ。その結果、DAOの最大の特徴は「Autonomous」から、「Community Driven(コミュニティ主導)」、すなわちより広範な利害関係者の参加と利益代表へと移行している。

偶然にも、AGIの目標もまた「自律性(Autonomous)」の追求にある。OpenAIは自らの組織定義の中で明言している。AGIとは、経済的に高い価値を持つほとんどの業務において人間よりも優れたパフォーマンスを発揮する高度に自律的なシステムのことである。

by AGI we mean a highly autonomous system that outperforms humans at most economically valuable work.

OpenAI

AGIにおける自律性は、主に行動能力のレベルでの話ではあるが、より根本的な原則に立ち返って考えれば、AGIもDAOも、外界からの支配に依存せずに真正に自律的に動作するシステムの構築を目指しており、本質的な違いはない。それならば、このような自律的システムに対して我々はどのようにガバナンスを行えばよいのか。内発的な人間の価値観とのアライメントやトレーニングに頼るべきなのか、あるいはより多くの外部的制約を加えるべきなのか。LLMからAGIに至るまで、これらは今まさに真剣に考えるべき課題である。

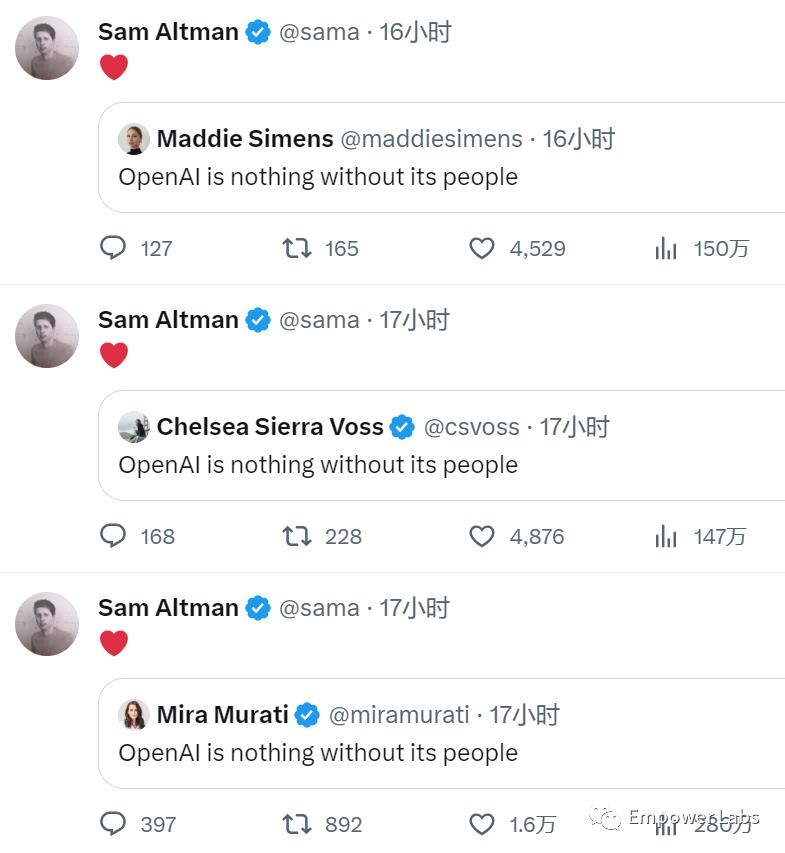

OpenAIのこの大ドラマの最新展開として、従業員の90%がサムに追随して辞職する意思を表明したことが挙げられるが、これは過去数年間DAO分野で繰り広げられてきた古典的な論争 ―― 「コードによって定められたルールと、コミュニティの集団的コンセンサス、どちらが重要か」に見事に呼応している。

ルールや制約は多くの合意を形成できるかもしれないが、本当に偉大な合意は、しばしばルールによって作られるものではない。共有された使命感と文化的価値観があってこそ、深遠な共鳴と真正の一致が達成されるのである。

人間同士でいかにそのような共鳴を生み出すか、私たちはそれを知っている。では、AIの場合はどうだろうか?

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News