Dans cette arnaque « d’abattage de porcs », l’IA se charge à la fois des relations amoureuses et de la fabrication de faux diplômes d’avocat.

TechFlow SélectionTechFlow Sélection

Dans cette arnaque « d’abattage de porcs », l’IA se charge à la fois des relations amoureuses et de la fabrication de faux diplômes d’avocat.

La majeure partie du travail effectué dans les zones de fraude peut être accomplie avec un seul compte ChatGPT.

Auteur : Kuli, TechFlow

Ces derniers jours, OpenAI a publié un rapport détaillant des cas dans lesquels ChatGPT a été utilisé à des fins malveillantes — et comment OpenAI y a mis fin.

Le rapport est très long et recense une multitude d’exemples d’abus de l’intelligence artificielle. Certains proviennent de Russes menant des campagnes de désinformation ; d’autres semblent impliquer des agents espions pratiquant l’ingénierie sociale. Mais aujourd’hui, je souhaite m’attarder sur l’un de ces cas particuliers :

La « fraude du porc » au Cambodge.

La « fraude du porc » n’est pas nouvelle : les récits liés aux « parcs industriels » cambodgiens sont légion. Ce qui surprend ici, c’est le rôle joué par l’IA.

Dans ce réseau criminel, ChatGPT s’occupait des relations amoureuses, traduisait les instructions des superviseurs, rédigait quotidiennement des rapports de travail et estimait la valeur potentielle de chaque victime.

Dans le jargon interne de ces escroqueries, cette estimation s’appelle la « kill value », c’est-à-dire le montant que les fraudeurs estiment pouvoir extorquer à une victime donnée.

Sur toute la chaîne de production, ChatGPT était probablement l’employé le plus sollicité.

OpenAI a attribué à ce cas le nom de code « Operation Date Bait » (Opération Appât-Rendez-vous).

Voici comment cela fonctionnait.

Le réseau frauduleux avait d’abord créé un faux service haut de gamme de rencontres, baptisé « Klub Romantis », dont le logo avait été généré par ChatGPT. Il diffusait ensuite des publicités payantes sur les réseaux sociaux, en ciblant des mots-clés tels que « golf », « yacht » ou « restaurants haut de gamme », afin d’atteindre spécifiquement de jeunes hommes indonésiens.

Lorsque vous cliquiez sur la publicité, vous entamiez une conversation avec un chatbot IA. Celui-ci se faisait passer pour une réceptionniste séduisante, vous demandait de choisir le type de femme qui vous attirait, puis vous envoyait un lien Telegram accompagné d’un code d’invitation personnel.

Une fois sur Telegram, des personnes réelles prenaient le relais.

Les réceptionnistes continuaient à utiliser ChatGPT pour générer des messages flirtant ouvertement, puis vous orientaient vers deux plateformes de rencontres factices, nommées respectivement « LoveCode » et « SexAction ».

Ces plateformes affichaient des profils féminins entièrement fictifs, ainsi qu’une barre de défilement affichant en boucle des messages du type « Félicitations à [nom] pour avoir accompli sa mission et débloqué sa prime ». Tout cela était inventé. Un internaute expérimenté pourrait immédiatement repérer la supercherie — mais tous les cibles ne sont pas aussi vigilants.

Lorsque la relation avait suffisamment évolué, la réceptionniste vous transférait à un « mentor ». Celui-ci vous incitait alors à accomplir diverses « missions », chacune nécessitant un versement financier, dont le montant augmentait progressivement : achat d’une carte VIP, vote pour une « jeune femme convoitée », dépôt de garantie pour une réservation d’hôtel… Les prétextes étaient nombreux.

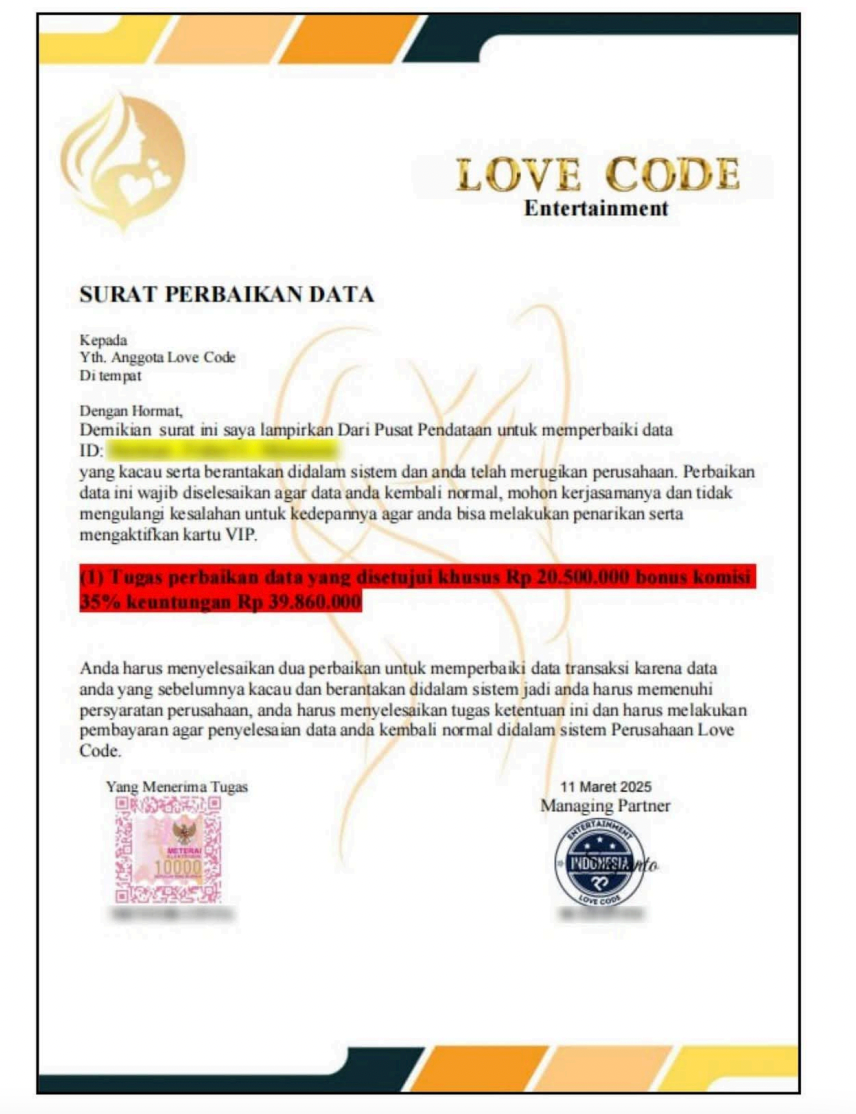

L’étape finale, appelée en interne « kill », consistait à vous demander un virement unique et substantiel, justifié par un prétexte fallacieux — erreur de traitement des données, dépôt de garantie pour vérification, etc. OpenAI a inclus dans son rapport une lettre envoyée par les fraudeurs à une victime, exigeant le paiement de 20,5 millions de roupies indonésiennes (environ 12 000 dollars américains), avec promesse d’un bonus de remboursement de 35 %.

Dès réception du paiement, les escrocs vous bloquaient sur Telegram et ajoutaient la mention « dossier clos » à votre profil.

Jusqu’ici, vous pourriez penser que rien de bien nouveau.

La technique elle-même n’est effectivement pas novatrice : les mécanismes de la « fraude du porc » ont déjà été largement décortiqués ces dernières années. Ce qui laisse pantois, c’est plutôt l’infrastructure logistique qui se cache derrière.

Grâce aux historiques d’utilisation des comptes ChatGPT, les enquêteurs d’OpenAI ont reconstitué une structure organisationnelle complète :

Le « parc industriel » frauduleux était divisé en trois départements : l’équipe d’acquisition, l’équipe d’accueil et l’équipe de supervision. L’équipe d’acquisition lançait les campagnes publicitaires pour attirer des victimes ; l’équipe d’accueil entretenait la conversation afin d’établir la confiance ; l’équipe de supervision procédait à la phase finale de collecte.

Chaque jour, un rapport était produit. Celui-ci listait toutes les victimes en cours de traitement, précisait leur responsable, l’état d’avancement de la procédure et, surtout, ce chiffre :

« kill value ».

Il s’agit de l’estimation, formulée par le superviseur, du montant total susceptible d’être extorqué à cette victime.

ChatGPT était également utilisé pour analyser les comptes financiers, rédiger des rapports opérationnels, et même répondre à des questions techniques telles que « comment intégrer une API ? » ou « comment modifier le code d’un site de rencontres ? ». Dans les cas où le superviseur parlait chinois et les employés indonésien, ChatGPT assurait la traduction dans les deux sens.

Un détail cocasse : un fraudeur avait demandé à ChatGPT des conseils fiscaux concernant ses revenus illégaux, en indiquant sans ambages, dans le champ « profession », le mot « scammer » (escroc).

Le ton du rapport d’OpenAI reste mesuré : d’après les traces laissées par le réseau lui-même dans ses interactions avec ChatGPT, celui-ci aurait pu traiter simultanément des centaines de cibles, générant plusieurs milliers de dollars par jour. Toutefois, OpenAI précise qu’elle n’a pu vérifier indépendamment l’exactitude de ces chiffres.

Pour ma part, je pense qu’il n’est pas essentiel de s’interroger sur leur authenticité : la simple existence de cette méthodologie de gestion suffit à impressionner.

Acquisition, conversion, valeur moyenne par client, rapports quotidiens, répartition des responsabilités entre départements… En changeant simplement quelques termes, on croirait lire le manuel opérationnel d’une entreprise SaaS.

Et pourtant, les tâches de séduction, de traduction, de rédaction de rapports, de programmation ou de comptabilité… la majorité d’entre elles étaient réalisées par un seul compte ChatGPT.

L’histoire ne s’arrête pas là.

Dans ce même rapport, OpenAI dévoile une deuxième opération, baptisée « Operation False Witness » (Opération Témoin Faux), provenant elle aussi du Cambodge.

Cette fois, la cible n’est plus le grand public, mais les victimes déjà escroquées.

Le raisonnement est simple : vous avez été victime d’une « fraude du porc », vous souhaitez récupérer votre argent, et vous effectuez une recherche en ligne pour savoir comment procéder.

Vous tombez alors sur une publicité annonçant un cabinet d’avocats spécialisé dans la restitution des fonds aux victimes de fraude. Vous cliquez dessus.

Le site web semble parfaitement crédible. Les photos d’avocats sont soit des portraits volés sur les réseaux sociaux, soit entièrement générées par IA. Chaque cabinet dispose d’une adresse, d’un numéro d’agrément et d’une présentation détaillée. ChatGPT a généré des cartes d’adhésion à l’Ordre des avocats de l’État de New York, ainsi que des registres d’inscription fictifs.

OpenAI a identifié au moins six cabinets d’avocats factices.

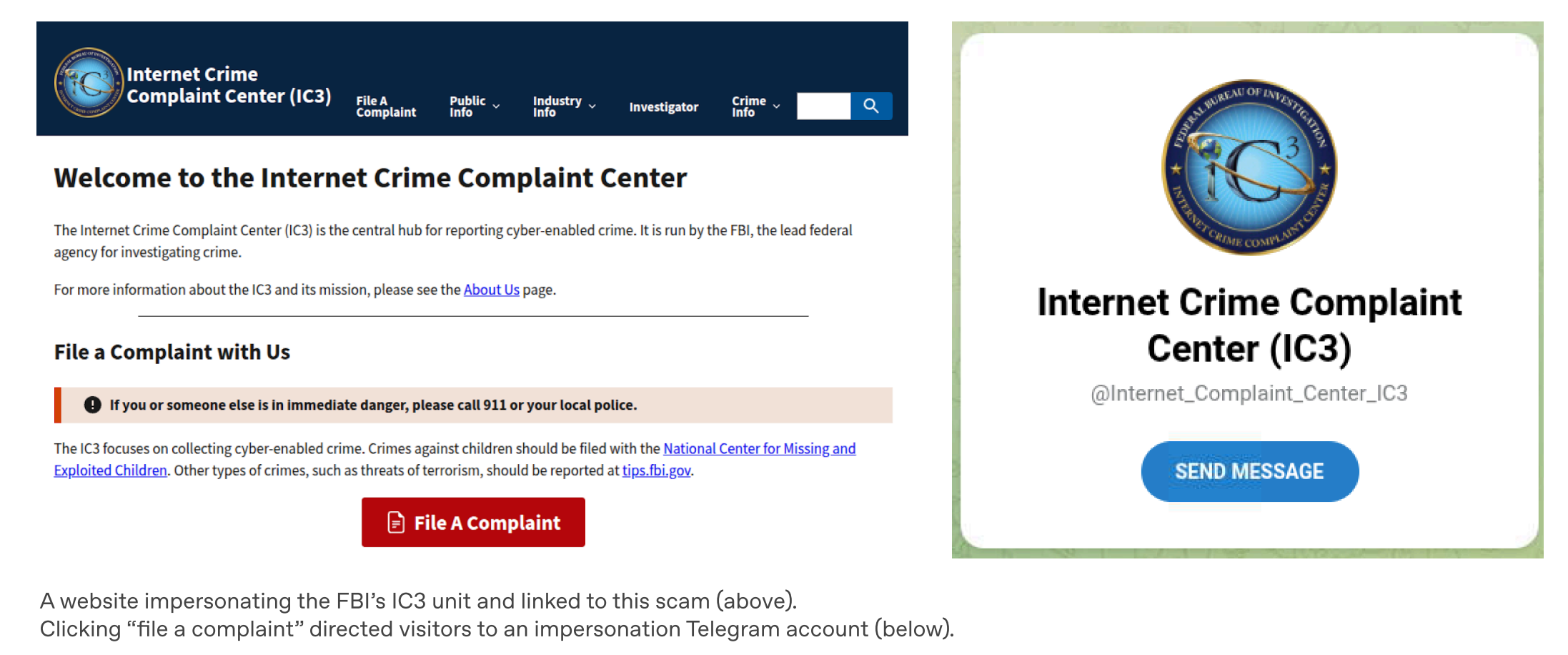

Un autre site imitait carrément le Centre de plaintes pour les crimes informatiques du FBI (IC3). Une bannière « Déposer une plainte » invitait à cliquer — ce qui redirigeait directement vers un compte Telegram.

Une fois sur Telegram, un « avocat » entamait la discussion. Les messages étaient générés par ChatGPT, rédigés explicitement en anglais américain et calqués sur le ton professionnel d’un juriste qualifié. Celui-ci vous expliquait que son cabinet collaborait avec la Cour pénale internationale et ne percevait aucun frais avant la restitution effective des fonds.

Mais il fallait d’abord verser 15 % de frais d’activation de compte, payables uniquement en cryptomonnaie.

On vous demandait également de signer un accord de confidentialité — rédigé, là encore, par ChatGPT, dans le but explicite de vous dissuader de consulter des tiers pour vérifier la légitimité de l’offre.

Le FBI a ultérieurement publié une alerte publique spécifiquement consacrée à cette escroquerie, soulignant qu’elle ciblait principalement les personnes âgées, exploitant leur désir pressant de récupérer leurs pertes.

Après avoir étudié ces deux cas, je pense que, dans un contexte où l’IA est devenue un outil standard, ce qui suscite le plus d’amertume, c’est ceci :

Lors de la première escroquerie, vous n’étiez qu’une cible. Lors de la seconde, vous devenez une cible encore plus intéressante, parce que vous avez déjà prouvé que vous pouviez être dupé.

Pour finir, OpenAI résume dans son rapport le processus frauduleux en trois étapes.

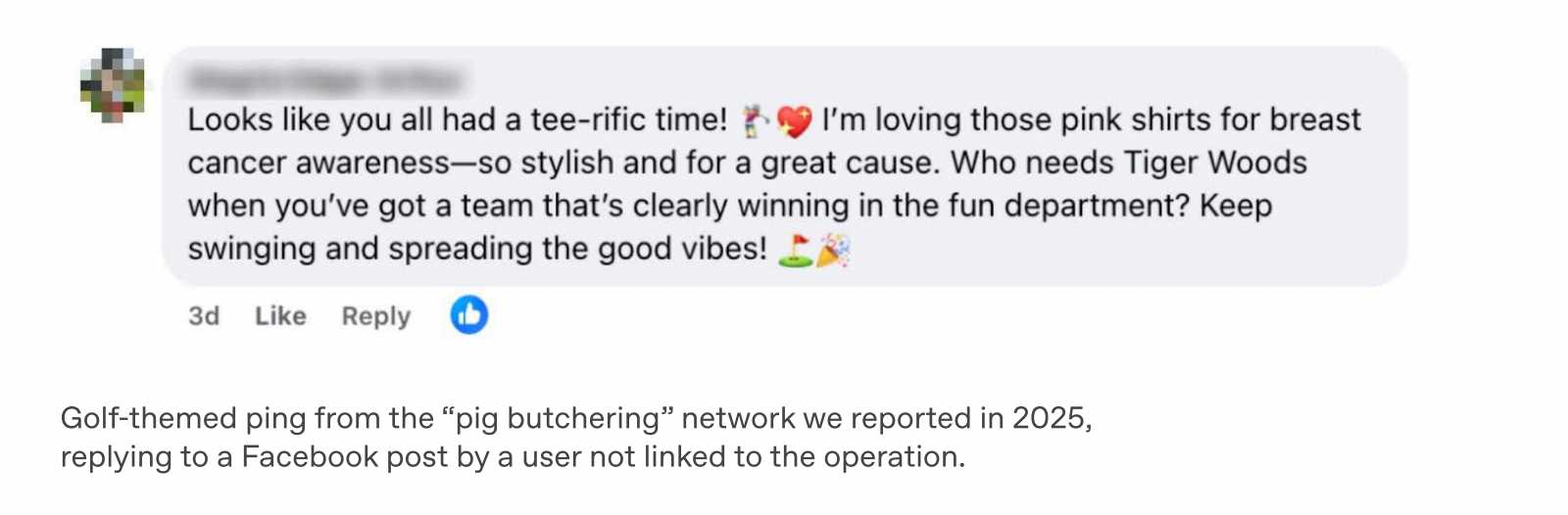

La première s’appelle « ping » : contact froid, destiné à attirer l’attention de la cible. La deuxième, « zing » : déclenchement d’une émotion — désir, excitation ou peur. La troisième, « sting » : collecte, c’est-à-dire le transfert d’argent.

Ce cadre est bien conçu. En y regardant de plus près, quelle étape ne pourrait pas être automatisée par une IA ?

Au début, la « fraude du porc » reposait essentiellement sur la main-d’œuvre : il fallait embaucher des dizaines de personnes pour tenir des conversations en continu devant un ordinateur, et ces personnes devaient maîtriser la langue de la cible. Les « parcs industriels » cambodgiens recrutaient notamment des candidats anglophones, auxquels ils offraient des salaires élevés.

Dans le cas de la fraude amoureuse décrite dans le rapport, le superviseur parle chinois, les employés indonésien, et les cibles sont également indonésiennes. Trois langues différentes — une situation qui, auparavant, rendait l’opération impossible. Avec ChatGPT, tout devient possible.

La barrière linguistique n’est qu’un aspect du problème.

Un autre détail du rapport est révélateur : certains fraudeurs ont même demandé à ChatGPT comment intégrer l’API d’OpenAI afin d’automatiser complètement la phase de discussion.

Autrement dit, l’IA ne rend pas les escroqueries plus sophistiquées — les méthodes restent les mêmes. L’IA rend les escroqueries moins coûteuses.

Selon OpenAI, ce réseau pourrait actuellement traiter simultanément des centaines de cas. À mesure que l’échelle augmente, le coût humain alloué à chaque victime diminue, ce qui permet de viser davantage de personnes, même celles dont la « valeur » individuelle est moindre.

Il existe un autre point qui mérite réflexion.

OpenAI a pu identifier ces activités parce que le réseau utilisait ChatGPT, dont les échanges sont stockés sur les serveurs d’OpenAI.

Et les réseaux qui emploieraient des modèles open source déployés localement ?

Ce rapport ne montre probablement qu’un petit fragment du puzzle — celui que la lumière d’OpenAI parvient à éclairer. Quant à l’étendue des zones demeurant dans l’ombre, personne ne le sait.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News