Le plus grand modèle vidéo open source au monde est désormais créé en Chine, produit par Jieyue

TechFlow SélectionTechFlow Sélection

Le plus grand modèle vidéo open source au monde est désormais créé en Chine, produit par Jieyue

Dans le monde futur des grands modèles d'IA, la force chinoise sera présente et ne restera jamais en arrière.

Auteur : Heng Yu, en provenance d'Aofeisi

Source de l'image : générée par Wujie AI

À l’instant, StepFun a collaboré avec Geely Automotive Group pour publier deux modèles multimodaux open source !

Les deux nouveaux modèles sont :

-

Le modèle de génération vidéo Step-Video-T2V, le plus volumineux au monde en termes de paramètres parmi les modèles open source

-

Le premier modèle open source de niveau produit dans l’industrie pour lesinteractions vocales Step-Audio

Le leader du multimodal ouvre désormais ses modèles multimodaux, dont Step-Video-T2V adopte la licence MIT, l’une des plus libérales et ouvertes existantes, autorisant librement toute modification et usage commercial.

(Comme d'habitude, les liens directs vers GitHub, Hugging Face et ModelScope se trouvent en bas d'article)

Au cours du développement de ces deux grands modèles, les deux parties ont complété leurs forces respectives en matière de puissance de calcul, d’algorithmes et d’entraînement sur scénarios spécifiques, « renforçant significativement les performances des grands modèles multimodaux ».

D’après les rapports techniques officiels publiés, les deux modèles révélés obtiennent d'excellents résultats dans les benchmarks, surpassant tous les autres modèles open source nationaux et internationaux comparables.

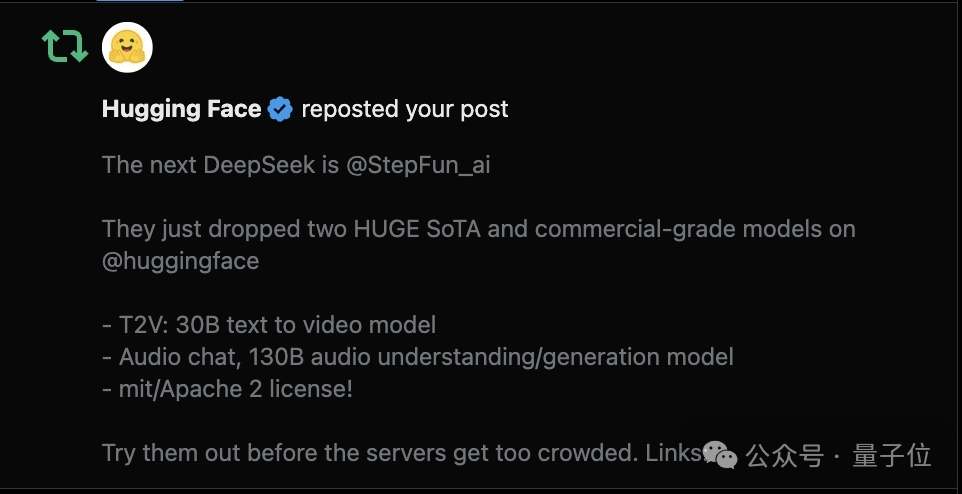

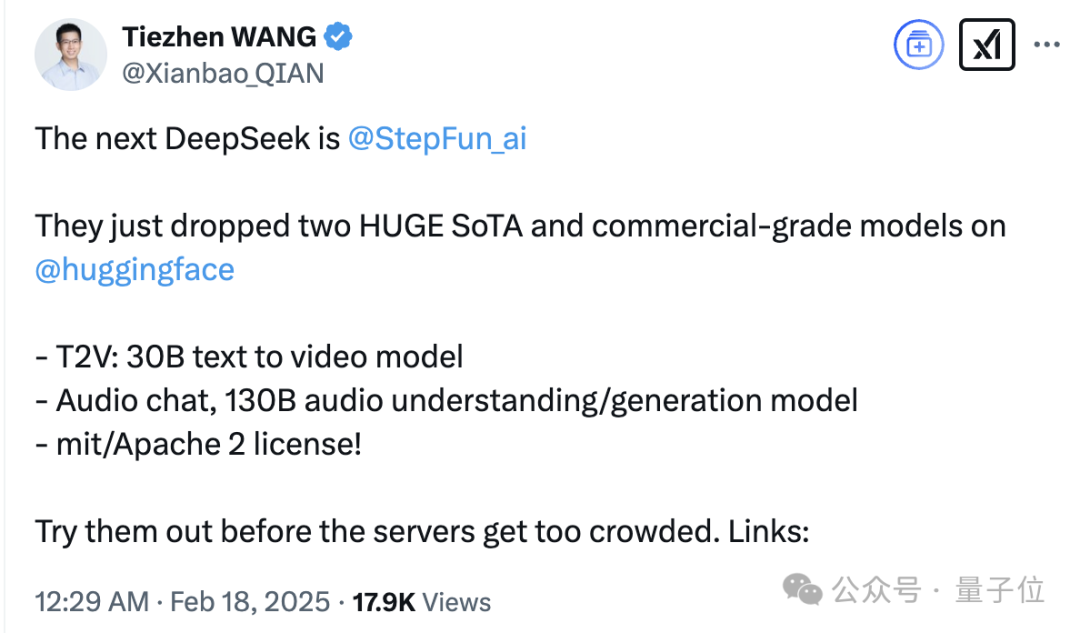

Le responsable chinois de Hugging Face a également relayé un éloge très positif à leur sujet.

Points clés : « The next DeepSeek », « HUGE SoTA ».

Oh vraiment ?

Quantum Bit va donc analyser en détail ce rapport technique ainsi que des tests exclusifs pour vérifier si ces modèles méritent vraiment leur réputation.

Quantum Bit confirme que les deux nouveaux modèles open source sont déjà intégrés à l’application YaoWen, permettant à chacun de les tester directement.

Le leader du multimodal publie pour la première fois ses modèles multimodaux

Step-Video-T2V et Step-Audio marquent la première publication open source de modèles multimodaux par StepFun.

Step-Video-T2V

Examinons d’abord le modèle de génération vidéo Step-Video-T2V.

Son volume de paramètres atteint 30 milliards, ce qui en fait actuellement le plus grand modèle de génération vidéo open source au monde en termes de taille, capable nativement de traiter des entrées en chinois et en anglais.

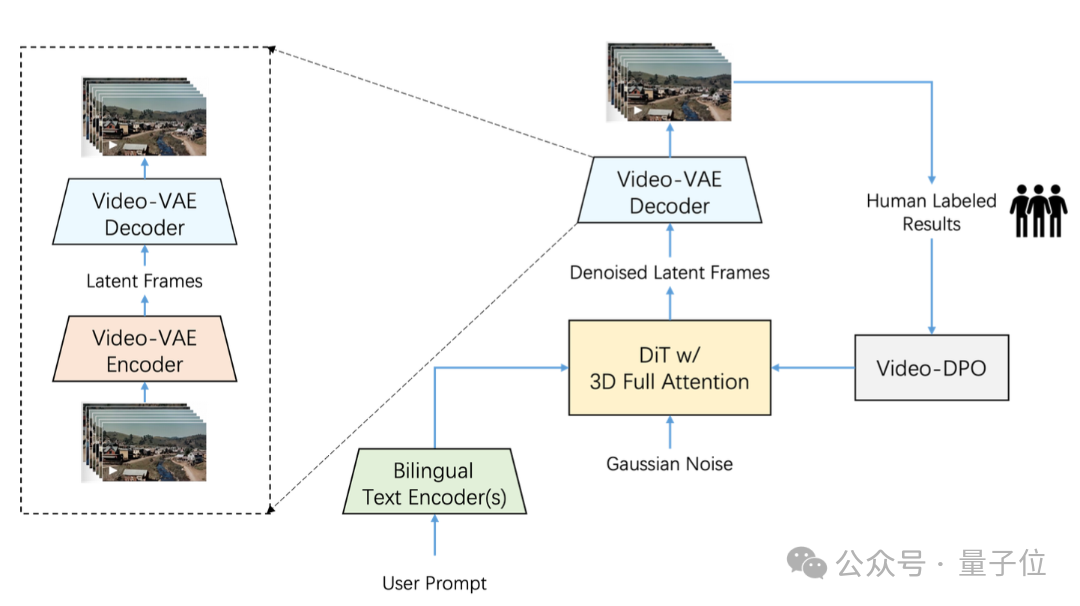

La présentation officielle indique que Step-Video-T2V possède quatre grandes caractéristiques techniques :

Premièrement, il peut générer directement des vidéos allant jusqu’à 204 images, en résolution 540P, garantissant une très haute cohérence et densité informationnelle.

Deuxièmement, conçu et entraîné spécifiquement pour la génération vidéo, son Video-VAE à taux de compression élevé permet, tout en maintenant une qualité de reconstruction élevée, de compresser l’espace vidéo de 16×16 fois et le temps de 8 fois.

La plupart des modèles VAE actuels sur le marché utilisent un taux de compression de 8x8x4. Avec une compression supplémentaire de 8 fois sous nombre d’images identique, Video-VAE améliore ainsi l’efficacité d’entraînement et de génération de 64 fois.

Troisièmement, des optimisations systématiques approfondies ont été effectuées sur les hyperparamètres, l’architecture et l’efficacité d’entraînement du modèle DiT, assurant efficacité et stabilité durant l’apprentissage.

Quatrièmement, une stratégie complète d’entraînement est détaillée, incluant les tâches, objectifs pédagogiques, méthodes de construction et de filtrage des données à chaque étape.

En outre, l’étape finale d’entraînement intègre Video-DPO (optimisation des préférences vidéo), un algorithme d’apprentissage par renforcement adapté à la génération vidéo, permettant d’améliorer encore la qualité, la cohérence et la stabilité des vidéos générées.

Le résultat final : des mouvements plus fluides, des détails plus riches et un alignement plus précis aux instructions.

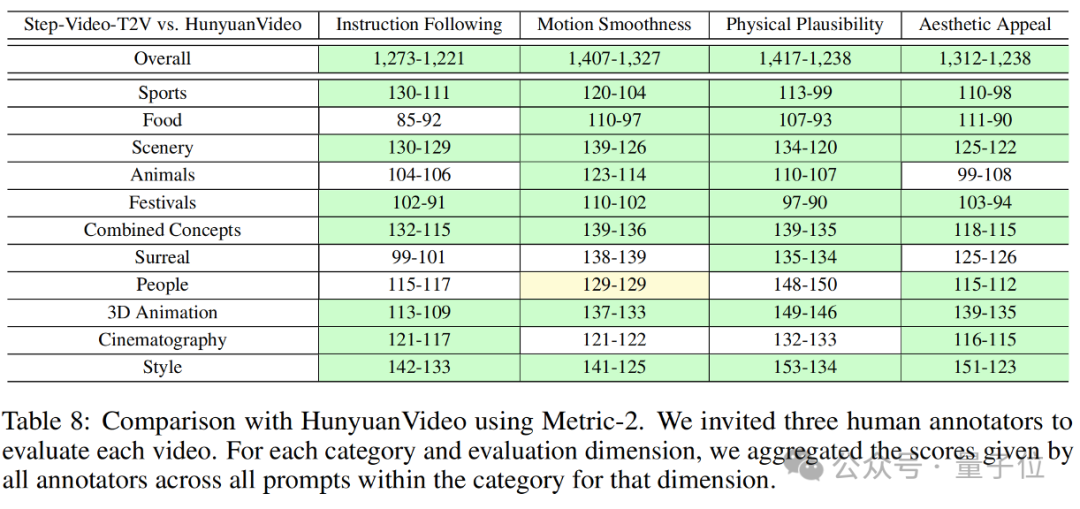

Pour évaluer de manière exhaustive les performances des modèles open source de génération vidéo, StepFun a publié simultanément un nouveau jeu de données de référence dédié à l’évaluation de la qualité texte-vers-vidéo : Step-Video-T2V-Eval.

Ce jeu de données est également publié en open source ~

Il contient 128 questions d’évaluation en chinois issues d’utilisateurs réels, visant à mesurer la qualité des vidéos générées selon 11 catégories thématiques : mouvement, paysages, animaux, concepts combinés, surréalisme, etc.

Les résultats d’évaluation de Step-Video-T2V sur ce jeu de données figurent ci-dessous :

On constate que Step-Video-T2V dépasse tous les meilleurs modèles vidéo open source précédents en conformité aux instructions, fluidité du mouvement, cohérence physique et qualité esthétique.

Cela signifie que tout le domaine de la génération vidéo peut désormais s'appuyer sur ce nouveau modèle de base, le plus performant à ce jour, pour mener recherche et innovation.

Concernant les performances pratiques, selon StepFun :

Step-Video-T2V excelle dans la génération complexe de mouvements, de personnages esthétiques, d’imagination visuelle, de textes basiques, d’entrées natives bilingues chinois-anglais et de langage cinématographique. Il possède également une compréhension sémantique et une conformité aux instructions remarquables, aidant efficacement les créateurs vidéo à concrétiser leurs idées avec précision.

Alors, qu’attendez-vous ? Passons aux tests —

Selon l’ordre donné par l’équipe officielle, le premier test porte sur la capacité de Step-Video-T2V à gérer des mouvements complexes.

Les anciens modèles de génération vidéo avaient tendance à produire des images étranges lorsqu’il s’agissait de ballet, danse de salon, danse traditionnelle chinoise, gymnastique rythmique, karaté ou arts martiaux.

Par exemple, une troisième jambe apparaissant soudainement, ou des bras fusionnés – assez effrayant.

Nous avons mené un test ciblé en soumettant à Step-Video-T2V l’instruction suivante :

Un terrain de badminton en intérieur, vue frontale, caméra fixe filmant un homme jouant au badminton. Un homme portant un t-shirt rouge et un short noir tient un raquette et se tient au centre du terrain vert. Le filet traverse le terrain, le divisant en deux. L’homme frappe la balle avec sa raquette et l’envoie de l’autre côté. La lumière est uniforme et brillante, l’image est nette.

Scène, personnage, cadrage, lumière, action – tout correspond parfaitement.

Générer des « personnages esthétiques » constitue le deuxième défi lancé par Quantum Bit à Step-Video-T2V.

Soit dit, les modèles texte-image actuels peuvent générer des photos réalistes de personnes, notamment statiques, avec des détails locaux quasi indiscernables du réel.

Mais dès qu’il s’agit de vidéo, lorsque la personne bouge, des défauts physiques ou logiques restent détectables.

Quant à la performance de Step-Video-T2V —

Prompt : Un homme, vêtu d’un costume noir, cravate foncée et chemise blanche, porte une cicatrice sur le visage, expression sérieuse. Gros plan.

« Rien qui fasse AI. »

C’est le verdict unanime de l’équipe éditoriale de Quantum Bit après avoir visionné la vidéo.

Un « rien qui fasse AI » où les traits sont bien formés, la texture de peau réaliste, la cicatrice clairement visible.

Un « rien qui fasse AI » où le réalisme est poussé sans yeux vides ni expression figée.

Les deux premiers tests conservaient une caméra fixe.

Et concernant les mouvements de caméra ?

Troisième test : évaluer la maîtrise de Step-Video-T2V des mouvements de caméra, comme zoom, travelling, panoramique, suivi.

Si on lui demande de tourner, il tourne :

Pas mal du tout ! Presque prêt à tenir le rôle de steadicam sur un plateau (blague).

Après plusieurs tests, les résultats parlent d’eux-mêmes :

Step-Video-T2V confirme bel et bien, comme indiqué dans les benchmarks, ses excellentes capacités de compréhension sémantique et de suivi des instructions.

Il maîtrise même la génération de texte basique sans difficulté :

Step-Audio

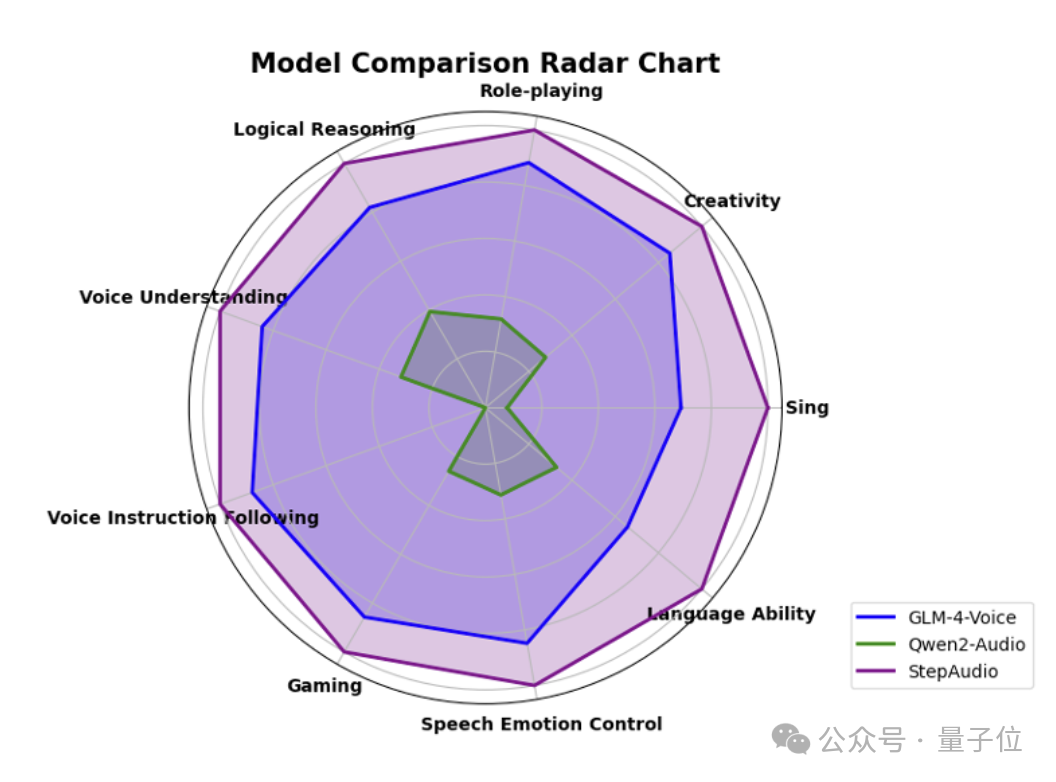

L’autre modèle publié simultanément, Step-Audio, est le premier modèle open source de dialogue vocal de niveau produit dans l’industrie.

Dans le cadre d’évaluation multidimensionnel StepEval-Audio-360, développé et publié en open source par StepFun, Step-Audio obtient les meilleurs résultats sur les dimensions de raisonnement logique, création, contrôle d’instructions, compétences linguistiques, jeu de rôle, jeux de mots et valeur émotionnelle.

Dans cinq grands ensembles de tests publics populaires tels que LlaMA Question et Web Questions, Step-Audio dépasse tous les modèles open source similaires du secteur et arrive en tête.

On observe notamment des performances particulièrement remarquables dans l’évaluation HSK-6 (test de niveau en chinois).

Test pratique ci-dessous :

StepFun explique que Step-Audio peut générer des expressions émotionnelles, dialectes, langues, chants et styles personnalisés selon différents contextes, permettant un dialogue naturel et de haute qualité avec l’utilisateur.

De plus, la voix générée non seulement paraît réaliste, naturelle et dotée d’une haute intelligence émotionnelle, mais permet aussi une reproduction fidèle du timbre vocal et le jeu de rôles.

Bref, Step-Audio répond pleinement aux besoins d’applications dans les secteurs du divertissement audiovisuel, des réseaux sociaux, des jeux, etc.

L’écosystème open source de StepFun prend de l’ampleur

Comment dire… Un seul mot : intensité.

StepFun est vraiment intense, surtout dans son domaine de prédilection : les modèles multimodaux —

Depuis leur sortie, les modèles multimodaux de la série Step occupent régulièrement la première place dans les principaux benchmarks et classements mondiaux.

En trois derniers mois seulement, ils ont déjà gravi plusieurs fois le sommet.

-

Le 22 novembre dernier, dans le dernier classement du « Grand Modèle Arena », le modèle multimodal Step-1V a atteint un score total égal à celui de Gemini-1.5-Flash-8B-Exp-0827, se classant premier modèle chinois dans le domaine visuel.

-

En janvier, sur la plateforme d’évaluation nationale de grands modèles « Sinan » (OpenCompass), la nouvelle série Step-1o a remporté la première place du classement en temps réel des modèles multimodaux.

-

Le même jour, dans le dernier classement du « Grand Modèle Arena », le modèle multimodal Step-1o-vision a également décroché la première place nationale dans le domaine visuel.

Ensuite, les modèles multimodaux de StepFun ne se distinguent pas seulement par leurs performances élevées et leur qualité, mais aussi par une fréquence élevée de mise à jour —

À ce jour, StepFun a publié successivement 11 grands modèles multimodaux.

Le mois dernier, six modèles ont été lancés en six jours, couvrant les domaines du langage, de la voix, de la vision et du raisonnement, consolidant davantage son titre de leader du multimodal.

Ce mois-ci, deux nouveaux modèles multimodaux sont publiés en open source.

En maintenant ce rythme, StepFun continuera de confirmer sa position de « joueur complet » du multimodal.

Grâce à ses solides capacités multimodales, depuis 2024, le marché et les développeurs reconnaissent et intègrent massivement l’API StepFun, formant une vaste base d’utilisateurs.

Grand public, par exemple, l’enseigne ChaBaDao a intégré le modèle multimodal Step-1V dans plusieurs milliers de ses magasins à travers le pays, explorant l’application des grands modèles dans l’industrie de la boisson au thé, via inspection intelligente et marketing AIGC.

Des données publiques montrent qu’en moyenne, plus d’un million de boissons ChaBaDao sont livrées quotidiennement aux consommateurs sous surveillance d’inspection intelligente par IA.

Step-1V permet en moyenne d’économiser quotidiennement 75 % du temps d’auto-inspection aux superviseurs de ChaBaDao, offrant aux clients un service plus sécurisé et de meilleure qualité.

Développeurs indépendants, comme les applications phares « Wei Zhi Shu » et « Lin Jian Liao Yu Shi » (thérapie psychologique par IA), après avoir effectué des tests A/B sur la plupart des modèles nationaux, ont finalement choisi l’API multimodale de StepFun.

(Chut : car elle donne le meilleur taux de conversion payant)

Des données spécifiques indiquent qu’au second semestre 2024, le volume d’appels à l’API multimodale de StepFun a augmenté de plus de 45 fois.

Enfin, cette publication concerne justement les modèles multimodaux, cœur de compétence de StepFun.

Nous notons que StepFun, qui a déjà acquis reconnaissance sur le marché et auprès des développeurs, a pensé cette publication comme une étape préparatoire à une intégration plus profonde ultérieure.

D’un côté, Step-Video-T2V adopte la licence MIT, l’une des plus ouvertes et permissives, autorisant toute modification et usage commercial.

On peut dire qu’il n’y a « aucun secret gardé ».

D’un autre côté, StepFun affirme « réduire au maximum les barrières d’accès industrielles ».

Prenons Step-Audio : contrairement aux solutions open source existantes nécessitant redéploiement et développement supplémentaire, Step-Audio est une solution complète de dialogue en temps réel, fonctionnant immédiatement après un simple déploiement.

Une expérience bout-en-bout accessible dès le départ.

À force de telles initiatives, un écosystème technologique open source propre à StepFun, centré sur ses modèles multimodaux phares, commence à prendre forme.

Dans cet écosystème, technologie, créativité et valeur commerciale s’entrecroisent, propulsant conjointement l’avancement des technologies multimodales.

Et avec la poursuite du développement et des itérations des modèles StepFun, l’intégration rapide et continue des développeurs, ainsi que l’appui et la collaboration des partenaires, l’effet « boule de neige » de l’écosystème StepFun est désormais amorcé et continue de croître.

La force chinoise open source s’exprime désormais par la performance

Il fut un temps où, évoquant les leaders de l’open source en grands modèles, on pensait à Meta avec LLaMA ou Albert Gu avec Mamba.

Aujourd’hui, il est indéniable que la force chinoise dans les grands modèles open source rayonne désormais mondialement, redéfinissant par la performance les « idées reçues ».

Le 20 janvier, veille du Nouvel An chinois de l’année du Serpent, fut une journée intense de confrontation entre grands modèles nationaux et internationaux.

Le plus marquant fut l’arrivée de DeepSeek-R1, dont les performances de raisonnement égalent celles d’OpenAI o1, mais à un coût trois fois inférieur.

L’impact fut colossal : en une nuit, Nvidia a perdu 5890 milliards de dollars (environ 4 240 milliards de yuans), établissant le record de plus forte baisse quotidienne de l’histoire du Nasdaq américain.

Mais ce qui est encore plus important et éclatant, c’est que la raison pour laquelle R1 a suscité un tel enthousiasme mondial réside non seulement dans ses performances exceptionnelles et son prix abordable, mais surtout dans son caractère open source.

Un caillou jeté dans la mare provoque des vagues infinies : même OpenAI, longtemps moqué pour ne plus être « open », a vu son PDG Sam Altman intervenir publiquement à plusieurs reprises.

Altman a déclaré : « Sur la question de l’ouverture des poids des modèles d’IA, (personnellement) nous sommes du mauvais côté de l’histoire. »

Il a ajouté : « Il existe vraiment un besoin mondial de modèles open source, capables d’apporter une grande valeur. Je suis heureux qu’il existe déjà d’excellents modèles open source. »

Aujourd’hui, StepFun commence également à publier ses nouvelles cartes maîtresses.

Et l’open source en est le but initial.

L’équipe officielle affirme que publier Step-Video-T2V et Step-Audio vise à promouvoir le partage et l’innovation des technologies des grands modèles, et à encourager le développement inclusif de l’intelligence artificielle.

Dès sa sortie, l’open source démontre sa puissance dans plusieurs benchmarks.

Aujourd’hui, autour de la table des grands modèles open source, DeepSeek brille par son raisonnement, StepFun par son multimodal, et bien d’autres continuent de progresser…

Leurs performances ne se distinguent pas seulement dans le cercle open source, mais font aussi forte impression dans l’ensemble du domaine des grands modèles.

— La force chinoise open source, après avoir émergé, progresse désormais davantage.

Prenez l’exemple de cette publication par StepFun : elle franchit des avancées techniques dans le domaine multimodal et change la logique de choix des développeurs mondiaux.

De nombreux experts techniques influents des communautés open source comme Eleuther AI ont volontairement testé les modèles StepFun, saluant : « Merci à l’open source chinois ».

Wang Tiezhen, responsable chinois de Hugging Face, affirme directement que StepFun sera le prochain « DeepSeek ».

Passant de la « percée technologique » à l’« ouverture écosystémique », la voie des grands modèles chinois devient de plus en plus stable.

Pour conclure, la double publication de StepFun aujourd’hui pourrait n’être qu’une note de bas de page dans la course IA de 2025.

Plus profondément, elle reflète la confiance technologique de la Chine dans l’open source, et envoie un signal clair :

Dans le monde futur des grands modèles d’IA, la Chine sera présente, et ne restera jamais en arrière.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News