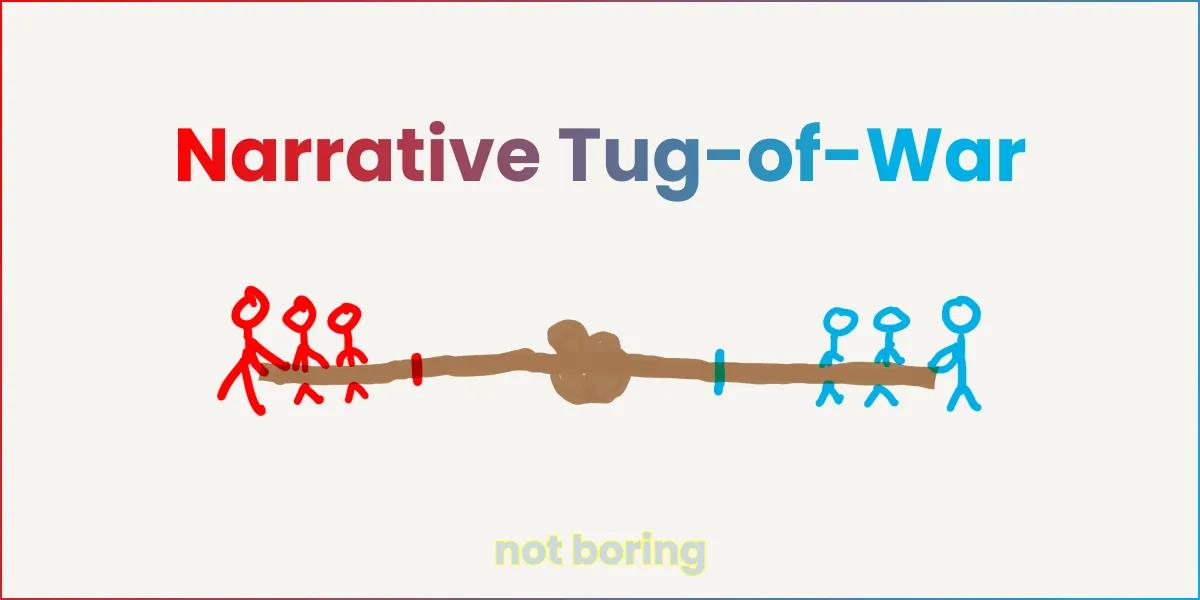

Guerre de narration : ne vous concentrez pas sur les débats extrêmes, mais sur la narration elle-même

TechFlow SélectionTechFlow Sélection

Guerre de narration : ne vous concentrez pas sur les débats extrêmes, mais sur la narration elle-même

Ne vous concentrez pas sur les personnes aux deux extrémités qui tirent la corde, mais sur le nœud central.

Rédaction : Packy

Traduction : TechFlow

L’un des changements les plus marquants dans ma perception du monde au cours de l’année écoulée a été de considérer les débats idéologiques comme une partie de tir à la corde narrative.

À chaque récit correspond un récit égal et opposé, presque inévitablement.

Un camp tire vers un extrême, tandis que l’autre le ramène vers sa propre position.

Par exemple : l’intelligence artificielle va nous anéantir tous ←→ l’intelligence artificielle va sauver le monde.

Ce qui commence par une petite divergence finit par s’amplifier en visions du monde totalement opposées. Ce qui était initialement un dialogue subtil devient un slogan. Ce qui était d’abord un interlocuteur devient un ennemi.

Si vous vous concentrez sur les extrêmes, sur les équipes qui tirent aux deux bouts de la corde, il est facile de s’emballer. Bien sûr, il est aussi facile de critiquer chaque mot qu’ils prononcent et de souligner tout ce qu’ils ignorent ou omettent.

Mais je vous invite à ne pas faire cela. Concentrez-vous plutôt sur le nœud au milieu.

Ce nœud bouge d’avant en arrière lorsque chaque camp essaie de le tirer davantage vers son côté. C’est ce nœud qui mérite toute notre attention.

Pour eux, c’est une bataille d’idées. Pour nous, c’est là que naissent les nouvelles choses.

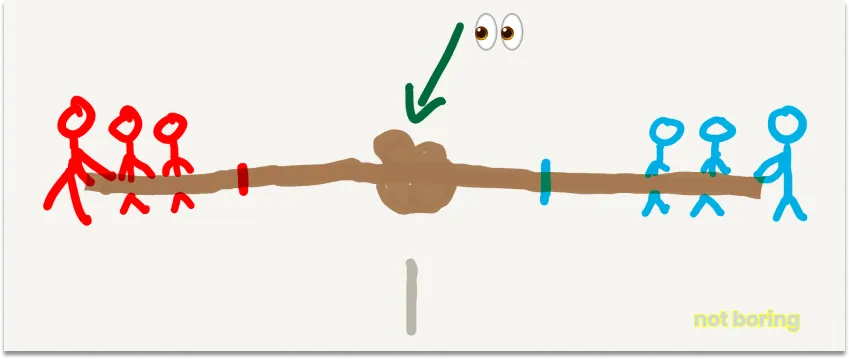

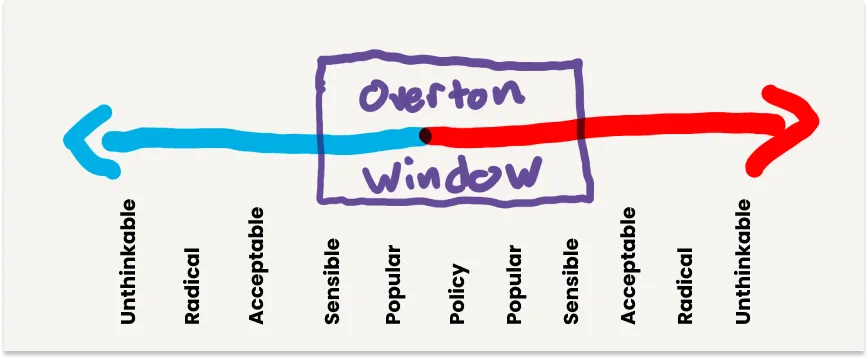

Il existe un concept appelé « fenêtre d’Overton » : l’éventail des politiques acceptables politiquement pour la majorité des gens à un moment donné.

Depuis que Joseph Overton a formulé cette idée au milieu des années 1990, le concept a dépassé le cadre des politiques gouvernementales. Il est désormais utilisé pour décrire comment certaines idées pénètrent le discours dominant, influençant ainsi l’opinion publique, les normes sociales et les pratiques institutionnelles.

La fenêtre d’Overton, c’est ce nœud dans le tir à la corde narratif. Les équipes aux deux extrémités ne s’attendent pas vraiment à ce que tout le monde adopte leurs idées ; elles veulent simplement tirer suffisamment fort pour déplacer la fenêtre d’Overton dans leur direction.

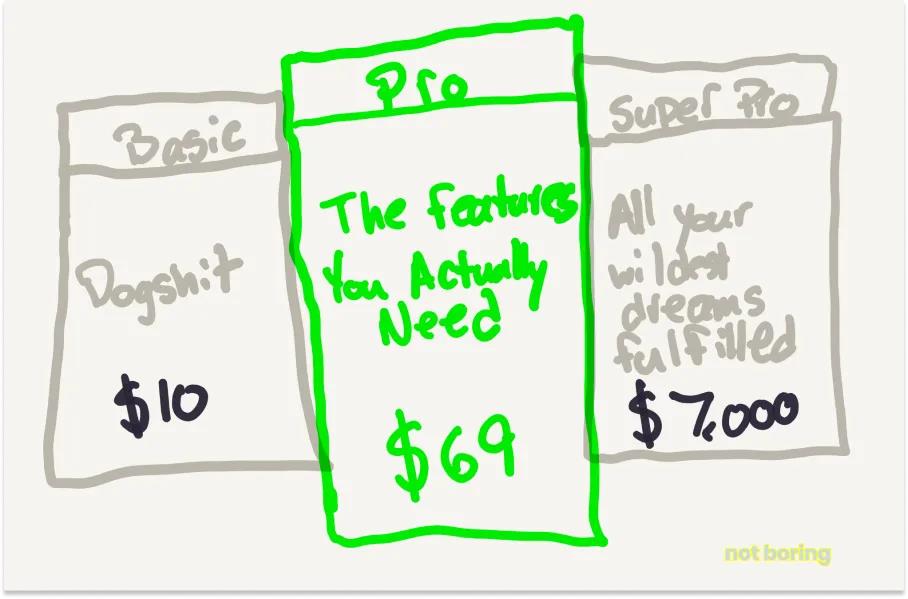

On peut aussi penser à cela comme un ancrage de prix : lorsqu’une entreprise propose plusieurs niveaux tarifaires, elle sait que vous choisirez probablement le niveau intermédiaire.

Personne ne s’attend à ce que vous payiez 7 000 dollars pour la version super professionnelle. L’entreprise sait simplement que, en vous la montrant, elle rend plus acceptable le fait de payer 69 dollars pour la version professionnelle.

Les récits fonctionnent de la même manière. Sauf qu’au lieu d’une entreprise ajustant stratégiquement ses prix pour maximiser vos chances d’acheter la version professionnelle, il s’agit ici d’équipes indépendantes et opposées qui cherchent à tirer le nœud avec suffisamment de force pour le ramener à une position qu’elles jugent acceptable. Quand on y pense, c’est une forme de magie culturelle.

Je pourrais illustrer cette idée par de nombreux exemples, mais prenons celui de la technologie. Plus précisément, la lutte entre décroissance et croissance, ou entre l’AE (altruisme effectif) et l’e/acc.

AE et e/acc

L’un des plus grands débats dans mon domaine (récemment exacerbé par les événements dramatiques autour d’OpenAI) oppose l’altruisme effectif (AE) à l’effectivisme accélérationniste (e/acc).

C’est la dernière manifestation d’un conflit ancien entre ceux qui croient que nous devrions continuer à croître et ceux qui pensent que non — un cas parfait où ce tir à la corde narrative se déploie pleinement.

Examinés séparément, les deux points de vue semblent extrêmes.

L’AE (que j’utilise ici comme raccourci pour désigner l’équipe du risque IA) estime que l’intelligence artificielle pourrait très bien nous anéantir tous. Compte tenu du fait que des centaines de billions d’humains existeront dans les milliers d’années à venir, même une probabilité de 1 % que l’IA nous anéantisse justifie de tout faire pour l’empêcher, car cela sauverait des dizaines, voire des centaines de milliards de vies. Nous devons arrêter le développement de l’IA avant d’atteindre l’intelligence artificielle générale, quel qu’en soit le coût.

Eliezer Yudkowsky, figure de proue de ce courant, a écrit dans Time :

Fermez tous les grands clusters de GPU. Mettez fin à tous les grands entraînements. Fixez une limite à la puissance de calcul que toute personne peut utiliser pour entraîner des systèmes d’IA, et diminuez progressivement cette limite au fil des ans pour compenser les algorithmes d’entraînement plus efficaces. Aucune exception pour les gouvernements ni les armées. Concluez immédiatement un accord multinational pour empêcher les activités interdites de se délocaliser. Suivez toutes les ventes de GPU. Si un centre de données est découvert, détruisez-le par frappe aérienne.

L’idée de bombarder des centres de données pour arrêter le développement de l’IA est véritablement absurde.

L’e/acc (que j’utilise ici comme raccourci pour désigner l’équipe pro-IA) pense que l’IA ne nous tuera pas, et qu’il faut tout faire pour l’accélérer. Ils considèrent que la technologie est bonne, que le capitalisme est bon, et que leur combinaison — la machine capitalo-technologique — est « un moteur infini de création matérielle, de croissance et d’abondance ». Nous devons protéger cette machine capitalo-technologique à tout prix.

Marc Andreessen, qui affiche fièrement « e/acc » dans sa bio Twitter, a récemment publié The Techno-Optimist Manifesto, plaidoyer vigoureux en faveur du progrès technologique. Certains passages ont particulièrement irrité les adversaires de l’IA :

Nous avons des ennemis.

Ils ne sont pas de mauvaises personnes, mais ils ont de mauvaises idées.

Notre société subit depuis soixante ans une vaste campagne de destruction, anti-technologique et anti-vie, apparaissant sous diverses formes : « risques existentiels », « durabilité », « ESG », « objectifs de développement durable », « responsabilité sociale », « capitalisme des parties prenantes », « principe de précaution », « confiance et sécurité », « éthique technologique », « gestion des risques », « décroissance », « limites à la croissance ».

Ce mouvement destructeur repose sur de vieilles idées fausses — de nombreux zombies intellectuels hérités du communisme, qui ont été et restent catastrophiques.

Comme de nombreux journalistes et blogueurs l’ont rapidement souligné, des notions que la plupart des gens considèrent comme positives — comme la durabilité, l’éthique ou la gestion des risques — paraissent soudainement absurdes dans ce débat.

Les critiques de ces deux textes passent à côté d’un point essentiel : les arguments de chaque camp ne doivent pas être pris isolément. La nuance n’est pas le but premier de chacun. Vous tirez fortement aux extrémités afin que la nuance apparaisse au centre.

Bien que chaque camp compte ses éléments les plus radicaux — l’un exigeant l’arrêt complet de l’IA, l’autre un développement sans entraves de la machine capitalo-technologique, hors de tout contrôle étatique ou corporatif — ce qui se joue réellement est une lutte narrative.

L’AE souhaite réguler l’IA et participer à l’élaboration de ces régulations. L’e/acc veut que l’IA reste ouverte, libre de tout contrôle, qu’il vienne d’un État ou d’une entreprise.

L’un attire l’attention en alertant que l’IA va nous tuer tous, effrayant le public et les gouvernements pour qu’ils imposent rapidement des régulations. L’autre tire en sens inverse en affirmant que l’IA va sauver le monde, afin d’empêcher des règles trop précoces et permettre aux gens de découvrir par eux-mêmes ses bienfaits.

Pour ma part, sans surprise, je me situe du côté des techno-optimistes. Mais cela ne signifie pas que je pense que la technologie est une panacée, ni que des problèmes réels n’existent pas.

Cela signifie que je crois que le développement est préférable à la stagnation, que les problèmes ont des solutions, que l’histoire montre que le progrès technologique et le capitalisme ont amélioré le niveau de vie humain, et que de mauvaises régulations représentent un risque plus grand que l’absence de régulation.

Bien que le monde évolue selon ce tir à la corde narratif, il existe aussi des vérités. Les pessimistes — de Malthus à Ehrlich — se sont avérés erronés, mais la peur se propage, et le récit dominant continue donc de pencher contre la technologie. Ce qui est vraiment inquiétant, c’est que des régulations restrictives soient mises en place avant que la vérité ne puisse émerger.

Car le problème de ce jeu de tir à la corde, c’est qu’il n’est pas équitable.

Le camp anti-développement n’a besoin que de tirer assez longtemps pour que la régulation soit mise en œuvre. Une fois en place, elle est difficile à renverser ; souvent, elle s’intensifie progressivement. L’exploitation mondiale de l’énergie nucléaire en est un exemple flagrant.

S’ils réussissent à faire franchir au nœud la ligne de régulation, ils gagnent. Le jeu est terminé.

Le camp pro-croissance doit continuer à tirer suffisamment longtemps pour que la vérité puisse émerger malgré le chaos généré par les nouvelles technologies, pour que les entrepreneurs puissent construire des produits qui tiennent leurs promesses, et pour que les esprits créatifs proposent des solutions aux problèmes sans freiner le progrès.

Ils doivent maintenir ce tir à la corde assez longtemps pour que des solutions émergent au centre.

Vitalik Buterin, cofondateur d’Ethereum, a publié un article intitulé My techno-optimism, dans lequel il propose une solution : la d/acc.

Il écrit que le « d » peut signifier beaucoup de choses : notamment défense, décentralisation, démocratie et différenciation. Cela signifie développer l’IA grâce à la technologie d’une manière qui anticipe les problèmes potentiels et priorise la prospérité humaine.

D’un côté, le mouvement pour la sécurité de l’IA fait campagne avec le message : « Tu devrais t’arrêter. »

De l’autre, l’e/acc dit : « Tu es déjà un héros tel que tu es. Continuons. »

Vitalik propose la d/acc comme troisième voie, une voie médiane :

Un message d/acc dirait : « Tu devrais construire, et construire quelque chose qui te profite ainsi qu’à la prospérité humaine, mais fais-le de façon plus sélective et plus consciente, en t’assurant que ce que tu construis aide réellement à ta prospérité et à celle de l’humanité. »

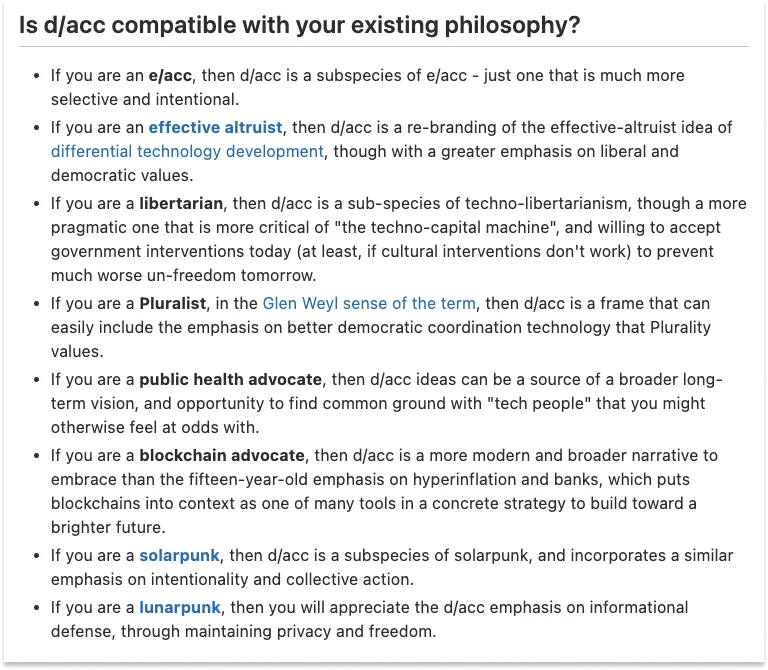

Il pense que c’est une synthèse capable d’attirer les gens, quelle que soit leur philosophie (tant qu’elle ne repose pas sur l’idée de « réglementer la technologie jusqu’à l’anéantir »).

Sans la pression exercée par l’AE et l’e/acc aux deux extrêmes, il n’y aurait probablement pas d’espace médian pour la d/acc de Vitalik. Les extrêmes, par leur manque de nuance, créent justement l’espace nécessaire pour que la nuance émerge au centre.

Si l’AE gagnait, la régulation bloquerait le développement ou le concentrerait entre les mains de quelques entreprises, et cet espace disparaîtrait. Si l’objectif est la régulation, alors aucune solution sans régulation n’existe.

Mais si l’objectif est la prospérité humaine, alors de nombreuses solutions sont possibles.

Bien que Vitalik désapprouve explicitement certains aspects de l’e/acc, Marc Andreessen et Beff Jezos, cofondateur anonyme de l’e/acc, ont tous deux partagé le post de Vitalik. Cela montre qu’ils se soucient davantage de trouver de meilleures solutions que de défendre coûte que coûte leur propre position.

Que la d/acc soit ou non la réponse, elle illustre parfaitement le rôle des extrêmes. Ce n’est que lorsque l’e/acc fixe la borne extérieure que des solutions comme la fusion entre humains et IA via Neuralink peuvent sembler raisonnables et modérées.

Dans ce débat comme dans d’autres tir à la corde narratifs, les extrêmes ont un rôle à jouer, mais ils ne sont pas la fin en soi. À chaque AE correspond un e/acc égal et opposé. Tant que le jeu continue, des solutions peuvent émerger de cette tension.

Répétons-le : ne vous focalisez pas sur les tireurs aux deux extrémités. Concentrez-vous sur le nœud au milieu.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News