Si OpenAI était une DAO, pourrait-elle éviter cette mascarade ?

TechFlow SélectionTechFlow Sélection

Si OpenAI était une DAO, pourrait-elle éviter cette mascarade ?

Bien que les règles et contraintes puissent établir de nombreuses consensus, les véritables grands consensus ne sont souvent pas forgés par des règles.

Auteur : Wang Chao

Dès le début du drame de ce week-end, certaines personnes ont suggéré qu'OpenAI devrait créer un DAO. À mesure que l'intrigue progressait, de plus en plus partageaient cet avis. Si OpenAI avait réellement adopté une gouvernance sous forme de DAO, aurait-on pu éviter cette crise ? Je pense que oui. Mais pas parce que la gouvernance par DAO présente des avantages évidents, plutôt parce que la gouvernance actuelle d'OpenAI comporte de graves défauts. En empruntant ne serait-ce qu'une petite partie des principes éprouvés dans l'écosystème DAO, une telle situation aurait pu être évitée.

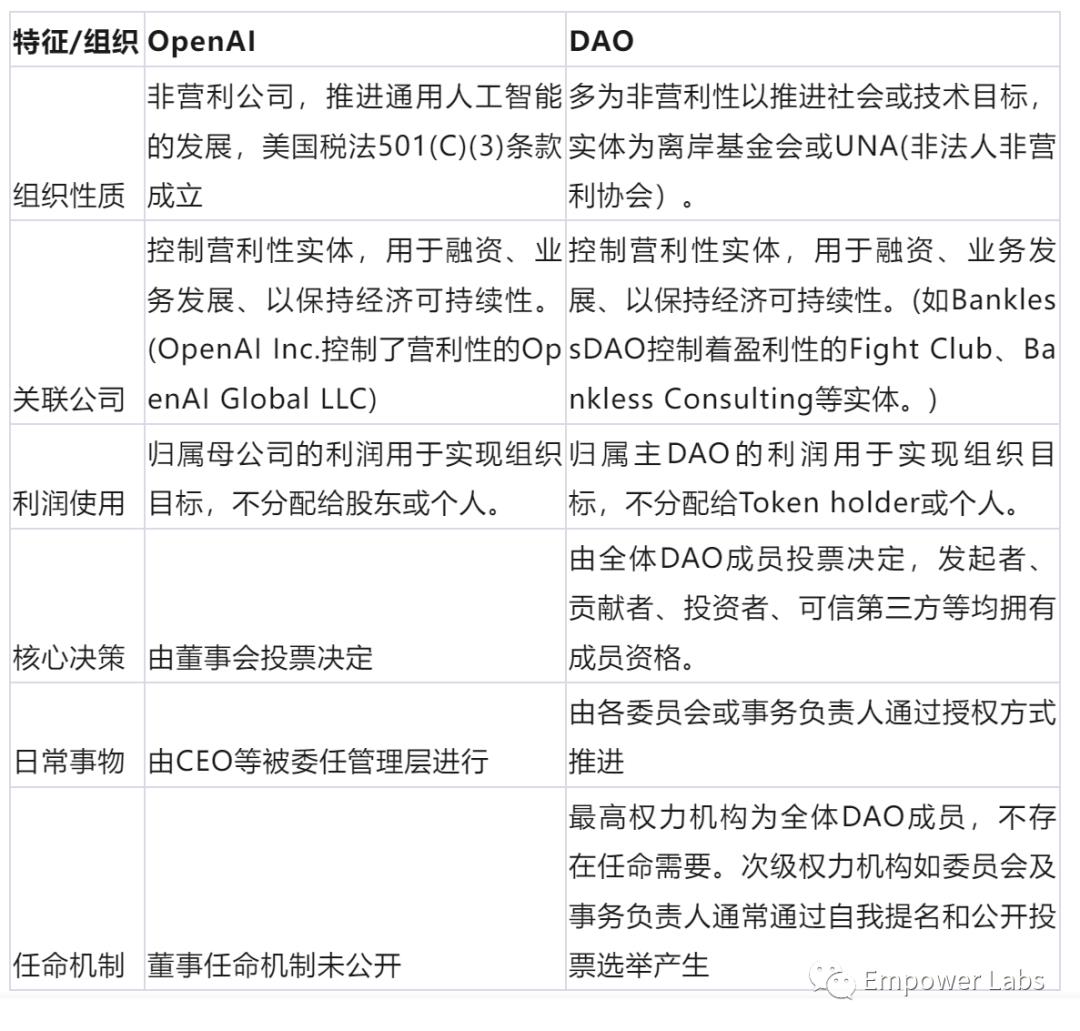

OpenAI est une organisation à but non lucratif dont l'objectif est de développer une intelligence artificielle générale (AGI) sûre et de faire bénéficier équitablement toute l'humanité. On peut donc considérer qu'OpenAI est une organisation créant des biens publics. De nombreux DAO relèvent également de cette catégorie, et sur bien des aspects, OpenAI et les DAO se ressemblent déjà fortement.

(Les DAO, en tant que nouvelle forme organisationnelle, prennent de nombreuses formes différentes. Cette comparaison porte ici uniquement sur les DAO à but non lucratif courants, sans prétendre représenter tous les modèles de DAO.)

L'agitation interne récente chez OpenAI ne découle pas fondamentalement de sa structure, mais plutôt de règles de gouvernance mal définies et inappropriées, qui laissent place aux manipulations. Par exemple, le conseil d'administration était initialement composé de 9 membres, mais avec le départ de certains administrateurs, il n'en reste aujourd'hui que 6. En tant qu'organe suprême, le conseil n'a pas procédé rapidement au remplacement des postes vacants. Si le nombre de membres continue de diminuer jusqu'à atteindre 3, alors seulement deux voix suffiront pour décider du destin d'OpenAI. Sur le plan opérationnel, les décisions sont prises de manière arbitraire : le remplacement du PDG Sam Altman, décision cruciale, n'a visiblement pas été discuté ni examiné par l'ensemble du conseil, mais décidé en réunion privée par une minorité d'administrateurs, sans tenir compte suffisamment des parties prenantes ni offrir d'opportunité de dialogue et de concertation.

Même les sociétés cotées à but lucratif intègrent des administrateurs indépendants afin d'améliorer la transparence de leur gouvernance et mieux représenter les intérêts des actionnaires minoritaires et du public. Pour une organisation aussi stratégique qu'OpenAI, dont les enjeux touchent le développement technologique fondamental, la sécurité sociale et même le destin de l'humanité, l'introduction de directeurs externes s'avère clairement insuffisante. Le conseil d'administration d'OpenAI doit non seulement intégrer davantage de contre-pouvoirs — comme des représentants des employés — mais aussi mettre en place des mécanismes de gouvernance plus efficaces. S'inspirer du modèle de gouvernance des DAO pour concevoir une structure plus solide, transparente et inclusive me semble une piste sérieuse à explorer.

Il est intéressant de noter que les DAO ont été initialement imaginés par des techno-libertariens souhaitant compter entièrement sur le code pour former un système auto-cohérent et durable, excluant au maximum toute interférence humaine : c'est ce qu'on appelle l'Autonomie (Autonomous). Lorsque la coordination politique humaine entre dans le jeu, le DAO cesse d'être un DAO et devient un DO, perdant ainsi son autonomie. Toutefois, à l'étape actuelle, un DAO idéalisé est tout simplement irréalisable. Par conséquent, on fait un pas en arrière : désormais, on qualifie de DAO toute organisation gérée collectivement via un réseau blockchain. Cela signifie que l'on accepte la réalité de la gouvernance humaine, le code ne servant plus que de soutien. La caractéristique majeure des DAO n'est plus l'Autonomie, mais plutôt l'orientation communautaire — Community Driven — favorisant une représentation plus large et une participation accrue.

Par coïncidence, l'objectif de l'AGI est également l'Autonomie. OpenAI précise explicitement dans sa documentation qu'une AGI désigne un système hautement autonome capable de surpasser les performances humaines dans la majorité des travaux économiquement valorisables.

by AGI we mean a highly autonomous system that outperforms humans at most economically valuable work.

OpenAI

Bien que l'autonomie dans le contexte de l'AGI concerne surtout la capacité d'action, si l'on examine les principes fondateurs, AGI et DAO partagent le même objectif : construire un système véritablement autonome, capable de fonctionner sans contrôle externe. Il n'y a donc aucune différence essentielle. Alors, face à un tel système autonome, comment devrions-nous le gouverner ? Devrions-nous compter davantage sur l'alignement des valeurs humaines internes et sur la formation, ou introduire davantage de contraintes externes ? De LLM à AGI, c'est là une question urgente à laquelle il faut répondre.

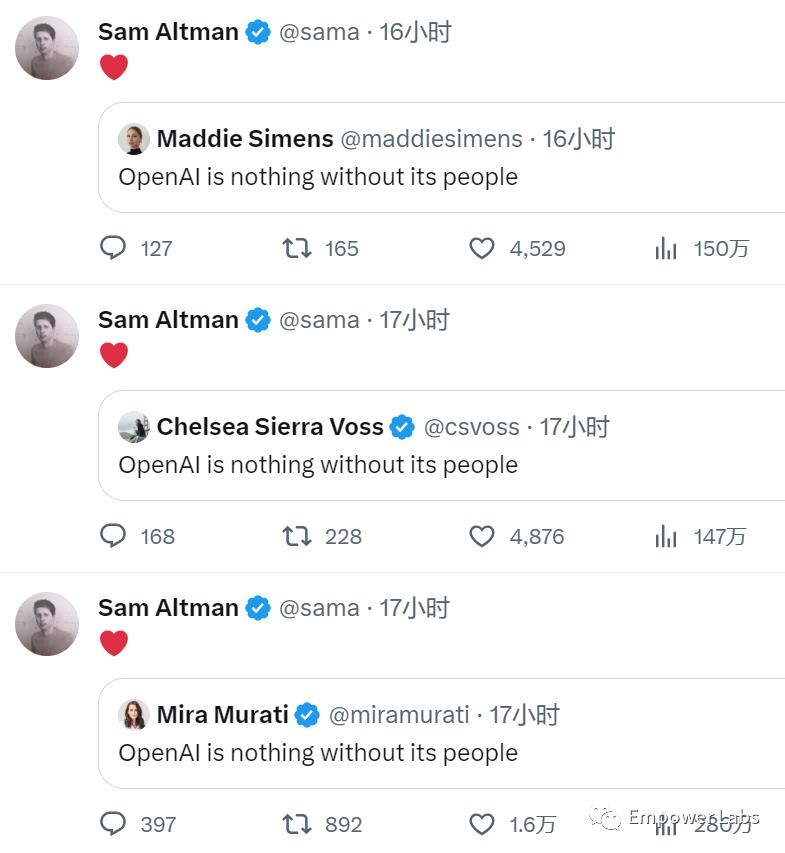

Le dernier rebondissement de cette affaire OpenAI — près de 90 % des employés ayant signé une pétition indiquant leur volonté de démissionner et de suivre Sam — fait écho à un débat classique qui traverse le monde des DAO depuis plusieurs années : quelle chose prime, les règles codifiées ou le consensus collectif de la communauté ?

Bien que les règles et contraintes puissent générer de nombreux consensus, les véritables grands consensus ne sont jamais forgés par les règles seules. Ce sont les missions partagées et les valeurs culturelles communes qui créent véritablement une résonance profonde et une cohérence durable.

Nous savons comment créer cette résonance entre êtres humains. Mais qu’en est-il de l’IA ?

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News