Xuất phát từ độ phù hợp sản phẩm, vòng AI tiền mã hóa này còn những dự án nào có cơ hội?

Tuyển chọn TechFlowTuyển chọn TechFlow

Xuất phát từ độ phù hợp sản phẩm, vòng AI tiền mã hóa này còn những dự án nào có cơ hội?

Cơ hội lớn tiếp theo của công nghệ mã hóa và AI không phải là một đồng tiền đầu cơ khác, mà là cơ sở hạ tầng có thể thực sự thúc đẩy sự phát triển của AI.

Tác giả: Evan ⨀

Biên dịch: TechFlow

Lĩnh vực giao thoa giữa mã hóa và AI vẫn còn ở giai đoạn rất sơ khai. Mặc dù thị trường đã chứng kiến sự xuất hiện của vô số tác nhân thông minh và token, phần lớn các dự án dường như chỉ là những trò chơi con số, khi các nhóm cố gắng "sút bóng" càng nhiều càng tốt.

Mặc dù AI là cuộc cách mạng công nghệ của thế hệ chúng ta, nhưng sự kết hợp với mã hóa chủ yếu được xem như một công cụ thanh khoản để tiếp cận sớm thị trường AI.

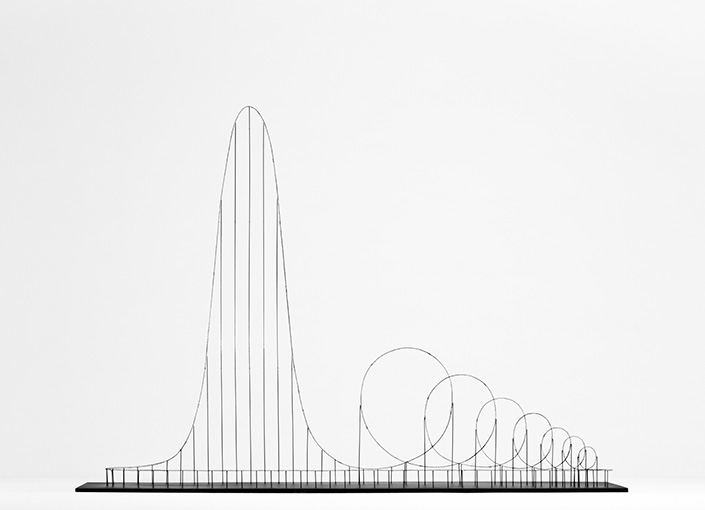

Do đó, trong lĩnh vực giao thoa này, chúng ta đã chứng kiến nhiều chu kỳ, nơi phần lớn các câu chuyện đều trải qua quá trình tăng giảm giống như "tàu lượn siêu tốc".

Làm thế nào để phá vỡ chu kỳ thổi phồng?

Vậy cơ hội lớn tiếp theo của mã hóa và AI đến từ đâu? Ứng dụng hay cơ sở hạ tầng nào thực sự có thể tạo ra giá trị và tìm được điểm phù hợp với thị trường?

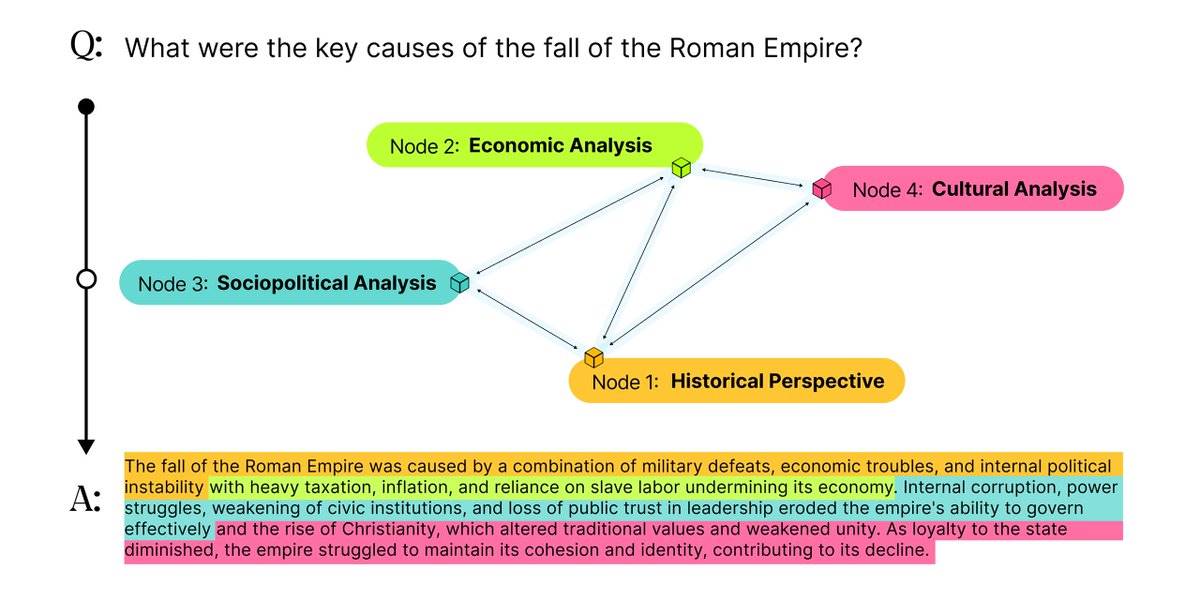

Bài viết này sẽ cố gắng khám phá các điểm quan tâm chính trong lĩnh vực này thông qua khung phân tích sau:

-

AI có thể hỗ trợ ngành mã hóa như thế nào?

-

Ngành mã hóa có thể phản hồi lại AI ra sao?

Đặc biệt với điểm thứ hai — cơ hội cho AI phi tập trung — tôi đặc biệt quan tâm và sẽ giới thiệu một số dự án thú vị:

1. AI hỗ trợ ngành mã hóa như thế nào?

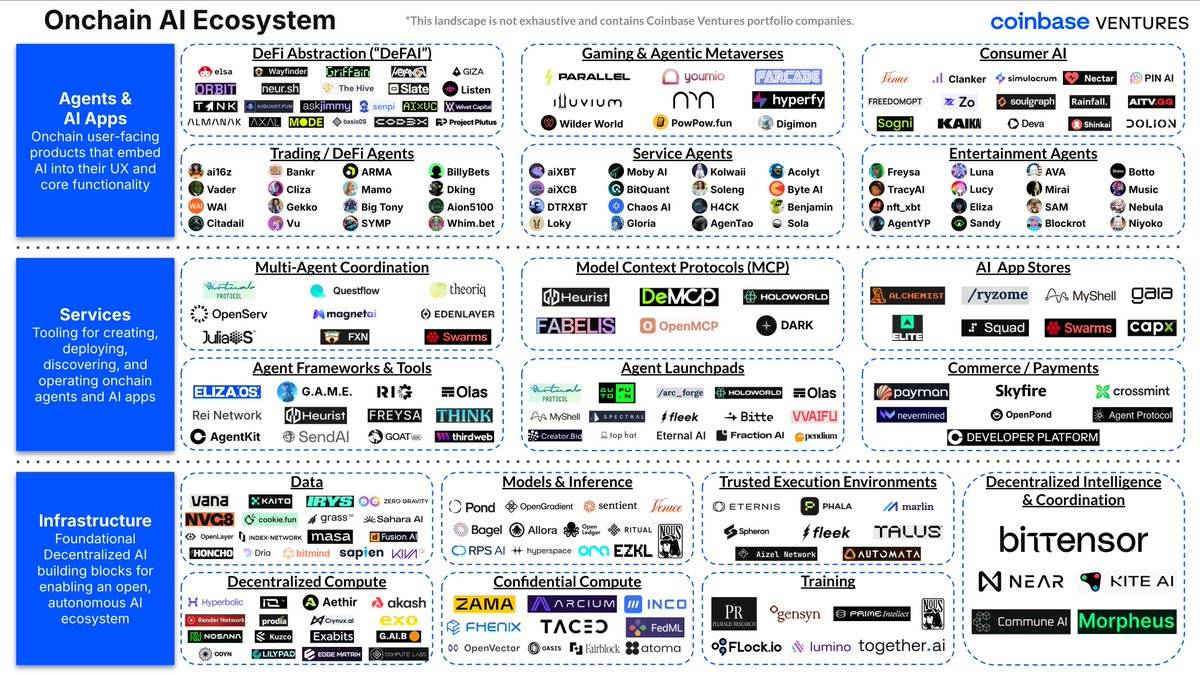

Dưới đây là bản đồ hệ sinh thái toàn diện hơn do CV cung cấp:

https://x.com/cbventures/status/1923401975766355982/photo/1

Mặc dù còn nhiều lĩnh vực dọc khác như AI dành cho người dùng, khung tác nhân thông minh và nền tảng khởi chạy, AI đã ảnh hưởng đến trải nghiệm mã hóa theo ba hướng chính sau:

1. Công cụ phát triển

Tương tự Web2, AI đang đẩy nhanh việc phát triển các dự án mã hóa thông qua các nền tảng không cần mã (no-code) và ít mã (vibe-code). Nhiều ứng dụng thuộc loại này có mục tiêu tương tự như trong lĩnh vực truyền thống, ví dụ như Lovable.dev.

Các nhóm như @poofnew và @tryoharaAI đang giúp các nhà phát triển không chuyên về kỹ thuật nhanh chóng triển khai và cải tiến mà không cần hiểu sâu về hợp đồng thông minh. Điều này không chỉ rút ngắn thời gian đưa sản phẩm mã hóa ra thị trường, mà còn hạ thấp rào cản gia nhập cho những người am hiểu thị trường và sáng tạo, ngay cả khi họ không có nền tảng kỹ thuật.

Hơn nữa, các phần khác của trải nghiệm nhà phát triển cũng được tối ưu hóa, ví dụ như kiểm thử và bảo mật hợp đồng thông minh: @AIWayfinder, @octane_security

2. Trải nghiệm người dùng

Mặc dù lĩnh vực mã hóa đã đạt được tiến bộ đáng kể trong quy trình vào cửa và trải nghiệm ví (như Bridge, Sphere Pay, Turnkey, Privy), trải nghiệm người dùng (UX) cốt lõi vẫn chưa có sự thay đổi chất lượng. Người dùng vẫn phải tự mình duyệt qua các trình duyệt blockchain phức tạp và thực hiện các giao dịch nhiều bước.

Các tác nhân thông minh AI đang thay đổi tình trạng này, trở thành lớp tương tác mới:

Tìm kiếm và khám phá: Các nhóm đang đua nhau phát triển các công cụ kiểu "Perplexity phiên bản blockchain". Những giao diện ngôn ngữ tự nhiên dựa trên trò chuyện này cho phép người dùng dễ dàng tìm thông tin thị trường (alpha), hiểu hợp đồng thông minh và phân tích hành vi trên chuỗi mà không cần xử lý dữ liệu giao dịch gốc.

Cơ hội lớn hơn nằm ở chỗ, các tác nhân thông minh có thể trở thành cổng vào để người dùng khám phá các dự án mới, cơ hội lợi nhuận và token. Tương tự như Kaito giúp các dự án thu hút sự chú ý trên nền tảng khởi chạy, các tác nhân có thể hiểu hành vi người dùng và chủ động cung cấp nội dung họ cần. Điều này không chỉ tạo ra mô hình kinh doanh bền vững mà còn có thể mang lại lợi nhuận thông qua chia sẻ doanh thu hoặc hoa hồng liên kết.

Thao tác dựa trên ý định: Người dùng không cần nhấn vào nhiều giao diện, chỉ cần bày tỏ ý định (ví dụ: "chuyển 1000 USD ETH sang vị thế stablecoin sinh lời cao nhất"), tác nhân sẽ tự động thực hiện các giao dịch nhiều bước phức tạp.

Ngăn ngừa lỗi: AI còn có thể ngăn các lỗi phổ biến như nhập sai số tiền giao dịch, mua token lừa đảo hoặc phê duyệt hợp đồng độc hại.

Thêm thông tin về Hey Anon thực hiện tự động hóa DeFAI như thế nào:

3. Công cụ giao dịch và tự động hóa DeFi

Hiện tại, nhiều nhóm đang đua nhau phát triển các tác nhân thông minh nhằm giúp người dùng nhận tín hiệu giao dịch thông minh hơn, thực hiện giao dịch thay người dùng, hoặc tối ưu và quản lý chiến lược.

Tối ưu hóa lợi nhuận

Các tác nhân có thể tự động di chuyển vốn giữa các giao thức cho vay, sàn giao dịch phi tập trung (DEX) và các cơ hội farm dựa trên biến động lãi suất và tình trạng rủi ro.

Thực thi giao dịch

AI có thể thực hiện các chiến lược vượt trội so với giao dịch thủ công bằng cách xử lý dữ liệu thị trường nhanh hơn, quản lý cảm xúc và tuân theo khung làm việc đã thiết lập.

Quản lý danh mục đầu tư

Các tác nhân có thể tái cân bằng danh mục, quản lý mức độ rủi ro và nắm bắt cơ hội chênh lệch giá giữa các chuỗi và giao thức khác nhau.

Nếu một tác nhân thực sự có thể quản lý vốn tốt hơn con người một cách liên tục, điều này sẽ là bước nhảy vọt về mặt quy mô so với các tác nhân DeFi AI hiện tại. DeFi AI hiện nay chủ yếu giúp người dùng thực hiện ý định đã định rõ, còn đây sẽ là bước tiến tới quản lý vốn hoàn toàn tự động. Tuy nhiên, sự chấp nhận của người dùng đối với sự chuyển đổi này tương tự như quá trình phổ biến xe điện, vẫn tồn tại khoảng cách niềm tin lớn trước khi được xác minh ở quy mô lớn. Nhưng nếu thành công, công nghệ này có khả năng chiếm giữ giá trị lớn nhất trong lĩnh vực này.

Ai sẽ là người chiến thắng trong lĩnh vực này?

Mặc dù một số ứng dụng độc lập có thể chiếm ưu thế về phân phối, khả năng cao hơn là các giao thức hiện có sẽ trực tiếp tích hợp công nghệ AI:

-

DEX (Sàn giao dịch phi tập trung): Thực hiện định tuyến thông minh hơn và bảo vệ khỏi lừa đảo.

-

Giao thức cho vay: Tự động tối ưu hóa lợi nhuận dựa trên mức độ rủi ro của người dùng, và trả nợ khi hệ số sức khỏe khoản vay xuống dưới ngưỡng nhất định, giảm rủi ro thanh lý.

-

Ví: Phát triển thành trợ lý AI, hiểu được ý định người dùng.

-

Nền tảng giao dịch: Cung cấp các công cụ hỗ trợ AI giúp người dùng kiên định với chiến lược giao dịch của họ.

Tầm nhìn cuối cùng

Giao diện tương tác trong lĩnh vực mã hóa sẽ tiến hóa thành sự kết hợp với AI dạng hội thoại, có thể hiểu các mục tiêu tài chính của người dùng và thực hiện chúng hiệu quả hơn chính người dùng.

2. Mã hóa hỗ trợ AI: Tương lai của AI phi tập trung

Theo tôi, tiềm năng của mã hóa trong việc hỗ trợ AI còn lớn hơn nhiều so với ảnh hưởng của AI lên mã hóa. Các nhóm đang làm việc về AI phi tập trung đang khám phá một số câu hỏi cơ bản và thực tế nhất về tương lai của AI:

-

Có thể phát triển các mô hình tiên tiến mà không phụ thuộc vào chi phí vốn khổng lồ từ các tập đoàn công nghệ tập trung không?

-

Có thể phối hợp các nguồn lực tính toán phân tán toàn cầu để huấn luyện mô hình hoặc tạo dữ liệu một cách hiệu quả không?

-

Điều gì xảy ra nếu công nghệ mạnh mẽ nhất của loài người bị kiểm soát bởi một vài công ty?

Tôi khuyến nghị mạnh mẽ bạn đọc bài viết về AI phi tập trung (DeAI) của @yb_effect tại đây để hiểu sâu hơn về lĩnh vực này.

Chỉ mới thấy phần nổi của tảng băng trôi, làn sóng tiếp theo trong giao thoa giữa mã hóa và AI có thể đến từ những đội ngũ nghiên cứu học thuật AI đi đầu. Những đội ngũ này chủ yếu xuất thân từ cộng đồng AI mã nguồn mở, có sự thấu hiểu sâu sắc về ý nghĩa thực tiễn và giá trị triết học của AI phi tập trung, và coi đây là cách tốt nhất để mở rộng AI.

Vấn đề hiện tại của AI là gì?

Năm 2017, bài báo biểu tượng "Attention Is All You Need" đã đề xuất kiến trúc Transformer, giải quyết một vấn đề then chốt tồn tại hàng thập kỷ trong học sâu. Từ khi ChatGPT phổ biến vào năm 2019, kiến trúc Transformer đã trở thành nền tảng cho hầu hết các mô hình ngôn ngữ lớn (LLMs), đồng thời khơi mào làn sóng cạnh tranh về năng lực tính toán.

Kể từ đó, năng lực tính toán cần thiết để huấn luyện AI tăng gấp 4 lần mỗi năm. Điều này dẫn đến sự tập trung hóa cao độ trong phát triển AI, vì việc huấn luyện sơ cấp phụ thuộc vào GPU hiệu suất cao, mà những tài nguyên này chỉ nằm trong tay các tập đoàn công nghệ lớn nhất.

-

Xét về mặt tư tưởng, AI tập trung là một vấn đề vì công cụ mạnh mẽ nhất của loài người có thể bị kiểm soát hoặc thu hồi bất cứ lúc nào bởi nhà tài trợ. Vì vậy, dù các đội mã nguồn mở không thể cạnh tranh trực tiếp về tốc độ tiến bộ với các phòng thí nghiệm tập trung, việc cố gắng thách thức tình trạng này vẫn cực kỳ quan trọng.

Công nghệ mã hóa cung cấp cơ sở điều phối kinh tế để xây dựng các mô hình mở. Nhưng trước khi đạt được điều đó, chúng ta cần trả lời một câu hỏi: AI phi tập trung ngoài lý tưởng còn giải quyết được những vấn đề thực tế nào? Tại sao việc để mọi người cộng tác lại quan trọng đến vậy?

-

May mắn thay, các đội ngũ làm việc trong lĩnh vực này rất thực tế. Mã nguồn mở đại diện cho triết lý mở rộng công nghệ cốt lõi: thông qua hợp tác quy mô nhỏ, mỗi đội đang tối ưu hóa điểm cực đại cục bộ của riêng mình và dần dần xây dựng từ đó, cuối cùng vượt qua phương pháp tập trung bị giới hạn bởi quy mô và quán tính tổ chức để đạt được điểm cực đại toàn cục nhanh hơn.

-

Đồng thời, đặc biệt trong lĩnh vực AI, mã nguồn mở cũng là điều kiện cần để tạo ra trí tuệ — không phải theo nghĩa đạo đức, mà là khả năng thích nghi với các vai trò và nhân cách khác nhau mà từng cá nhân trao cho nó.

Trong thực tế vận hành, mã nguồn mở có thể mở ra cánh cửa đổi mới để giải quyết một số giới hạn cơ sở hạ tầng rất thực tế.

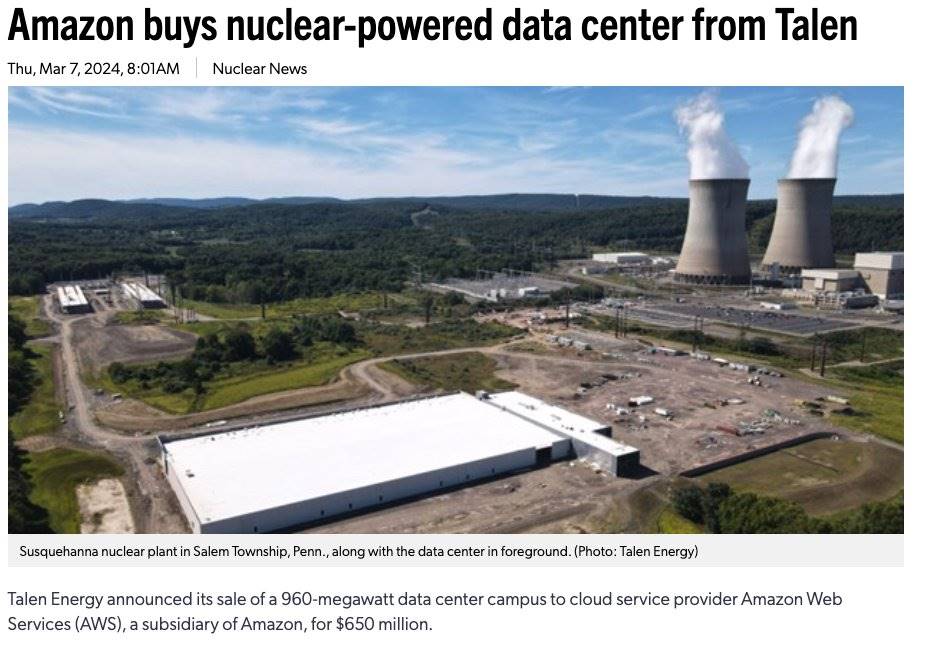

Tình trạng thiếu hụt tài nguyên tính toán

Việc huấn luyện mô hình AI hiện đã đòi hỏi cơ sở hạ tầng năng lượng khổng lồ. Hiện đã có nhiều dự án đang xây dựng các trung tâm dữ liệu quy mô từ 1 đến 5 gigawatt. Tuy nhiên, việc mở rộng liên tục các mô hình tiên tiến sẽ cần năng lượng vượt quá khả năng cung cấp của một trung tâm dữ liệu đơn lẻ, thậm chí tương đương với mức tiêu thụ năng lượng của cả một thành phố. Vấn đề không chỉ nằm ở đầu ra năng lượng, mà còn ở giới hạn vật lý của một trung tâm dữ liệu đơn lẻ.

Mặc dù vượt qua giai đoạn huấn luyện sơ cấp của các mô hình tiên tiến này, chi phí suy luận (Inference) cũng sẽ tăng đáng kể do sự xuất hiện của các mô hình suy luận mới và DeepSeek. Như nhóm @fortytwonetwork đã nói:

"Khác với các mô hình ngôn ngữ lớn (LLMs) truyền thống, các mô hình suy luận ưu tiên tạo ra phản hồi thông minh hơn bằng cách phân bổ thêm thời gian xử lý. Tuy nhiên, sự chuyển đổi này đi kèm với sự đánh đổi: cùng nguồn lực tính toán chỉ xử lý được ít yêu cầu hơn. Để đạt được những cải tiến có ý nghĩa này, mô hình cần thêm thời gian 'suy nghĩ', điều này làm trầm trọng thêm tình trạng khan hiếm tài nguyên tính toán."

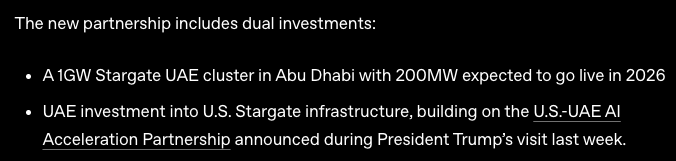

Thiếu hụt tài nguyên tính toán đã rất rõ ràng. Ví dụ, OpenAI giới hạn API gọi 10.000 lần mỗi phút, điều này thực tế giới hạn các ứng dụng AI chỉ phục vụ đồng thời khoảng 3.000 người dùng. Ngay cả những dự án tham vọng như Stargate — kế hoạch cơ sở hạ tầng AI 500 tỷ USD do Tổng thống Trump gần đây công bố — cũng có thể chỉ tạm thời làm giảm nhẹ vấn đề này.

Theo nghịch lý Jevons, việc nâng cao hiệu quả thường dẫn đến tăng tiêu thụ tài nguyên do nhu cầu tăng theo. Khi các mô hình AI trở nên mạnh mẽ và hiệu quả hơn, nhu cầu tính toán có thể bùng nổ do các trường hợp sử dụng mới và việc áp dụng rộng rãi hơn."

Vậy công nghệ mã hóa xuất hiện ở đâu? Blockchain có thể hỗ trợ có ý nghĩa thực sự như thế nào cho việc tìm kiếm và phát triển AI?

Công nghệ mã hóa cung cấp một phương pháp hoàn toàn khác biệt: huấn luyện và điều phối kinh tế toàn cầu, phân tán + phi tập trung. Thay vì xây dựng trung tâm dữ liệu mới, hãy tận dụng hàng triệu GPU hiện có — bao gồm thiết bị chơi game, thiết bị khai thác mã hóa và máy chủ doanh nghiệp — vốn phần lớn thời gian đều đang闲置. Tương tự, blockchain cũng có thể thực hiện suy luận phi tập trung bằng cách tận dụng tài nguyên tính toán rảnh trên các thiết bị người dùng.

Một vấn đề lớn trong huấn luyện phân tán là độ trễ. Ngoài yếu tố mã hóa, các nhóm như Prime Intellect và Nous đang nghiên cứu các đột phá công nghệ nhằm giảm nhu cầu giao tiếp GPU:

-

DiLoCo (Prime Intellect): Triển khai của Prime Intellect giảm nhu cầu giao tiếp đến 500 lần, khiến việc huấn luyện xuyên lục địa trở nên khả thi và đạt được hiệu suất sử dụng tính toán 90-95%.

-

DisTrO/DeMo (Nous Research): Gia đình các bộ tối ưu hóa của Nous Research đạt được mức giảm nhu cầu giao tiếp lên đến 857 lần nhờ công nghệ nén biến đổi cosin rời rạc.

Tuy nhiên, các cơ chế điều phối truyền thống không thể giải quyết các thách thức về niềm tin vốn có trong việc huấn luyện AI phi tập trung, và các đặc tính vốn có của blockchain có thể tìm thấy điểm phù hợp thị trường (PMF) tại đây:

-

Xác thực và khả năng chịu lỗi: Huấn luyện phi tập trung phải đối mặt với thách thức người tham gia gửi kết quả tính toán ác ý hoặc sai. Công nghệ mã hóa cung cấp các phương án xác thực mật mã (như TOPLOC của Prime Intellect) và cơ chế trừng phạt kinh tế để ngăn chặn hành vi xấu.

-

Tham gia không cần cấp phép: Khác với các dự án tính toán phân tán truyền thống cần quy trình phê duyệt, công nghệ mã hóa cho phép đóng góp thực sự không cần cấp phép. Bất kỳ ai có tài nguyên tính toán rảnh đều có thể tham gia ngay lập tức và bắt đầu kiếm lợi nhuận, từ đó tối đa hóa nguồn lực khả dụng.

-

Cân bằng động cơ kinh tế: Cơ chế thưởng dựa trên blockchain đồng bộ lợi ích của từng chủ sở hữu GPU với mục tiêu huấn luyện tập thể, biến tài nguyên tính toán trước đây bị bỏ không thành có hiệu quả kinh tế.

Với điều này, các nhóm trong stack AI phi tập trung giải quyết vấn đề mở rộng AI và sử dụng blockchain như thế nào? Những điểm chứng minh là gì?

-

Prime Intellect: Huấn luyện phân tán và phi tập trung

-

DiLoCo: Giảm nhu cầu giao tiếp đến 500 lần, khiến việc huấn luyện xuyên lục địa trở nên khả thi.

-

PCCL: Xử lý việc tham gia động, lỗi nút và đạt tốc độ giao tiếp 45 Gbit/s xuyên lục địa.

-

Hiện đang huấn luyện mô hình 32 tỷ tham số thông qua các nút làm việc phân bố toàn cầu.

-

Đạt hiệu suất sử dụng tính toán 90-95% trong môi trường sản xuất.

-

Thành quả: Thành công huấn luyện INTELLECT-1 (10 tỷ tham số) và INTELLECT-2 (32 tỷ tham số), thực hiện huấn luyện mô hình quy mô lớn xuyên lục địa.

-

-

Nous Research: Huấn luyện phi tập trung và tối ưu hóa giao tiếp

-

DisTrO/DeMo: Thông qua công nghệ biến đổi cosin rời rạc (Discrete Cosine Transform), đạt mức giảm nhu cầu giao tiếp lên đến 857 lần.

-

Mạng Psyche: Sử dụng cơ chế điều phối blockchain, cung cấp khả năng chịu lỗi và cơ chế thưởng để khởi động tài nguyên tính toán.

-

Hoàn thành một trong những lần huấn luyện sơ cấp lớn nhất trên Internet, huấn luyện mô hình Consilience (40 tỷ tham số).

-

-

Pluralis: Học giao thức (Protocol Learning) và song song mô hình

Pluralis áp dụng một cách tiếp cận khác biệt so với AI mã nguồn mở truyền thống, gọi là Học giao thức (Protocol Learning). Khác với các dự án huấn luyện phi tập trung khác (như Prime Intellect và Nous) sử dụng phương pháp song song dữ liệu, Pluralis cho rằng song song dữ liệu có khuyết điểm kinh tế, và chỉ dựa vào việc gom nguồn lực tính toán là không đủ để đáp ứng nhu cầu huấn luyện các mô hình tiên tiến. Ví dụ, Llama3 (4000 tỷ tham số) cần 16.000 GPU H100 80GB để huấn luyện.

Nguồn: Liên kết

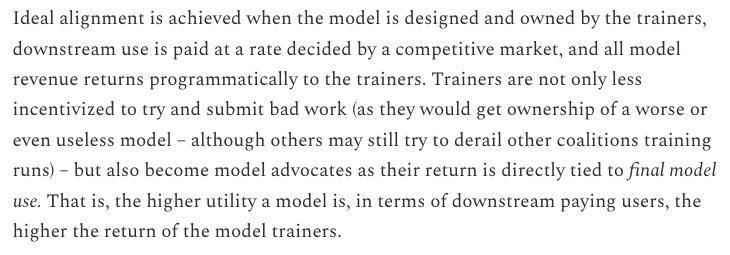

Ý tưởng cốt lõi của Học giao thức (Protocol Learning) là giới thiệu cơ chế thu thập giá trị thực tế cho những người huấn luyện mô hình, từ đó tập hợp tài nguyên tính toán cần thiết cho huấn luyện quy mô lớn. Cơ chế này phân bổ quyền sở hữu một phần mô hình tỷ lệ thuận với đóng góp huấn luyện. Trong kiến trúc này, mạng nơ-ron được huấn luyện theo cách hợp tác, nhưng bộ trọng số đầy đủ không bao giờ có thể được trích xuất bởi bất kỳ người tham gia đơn lẻ nào (gọi là mô hình giao thức Protocol Models). Trong thiết lập này, bất kỳ người tham gia nào muốn lấy được trọng số mô hình đầy đủ sẽ phải chịu chi phí tính toán cao hơn chi phí huấn luyện lại mô hình.

Cách thức hoạt động cụ thể của Học giao thức như sau:

-

Phân mảnh mô hình: Mỗi người tham gia chỉ sở hữu một phần mảnh (shards) của mô hình, chứ không phải trọng số đầy đủ.

-

Huấn luyện hợp tác: Quá trình huấn luyện yêu cầu truyền các giá trị kích hoạt (activations) giữa các người tham gia, nhưng không để ai nhìn thấy mô hình đầy đủ.

-

Chứng chỉ suy luận: Suy luận cần chứng chỉ, được phân bổ dựa trên đóng góp huấn luyện của người tham gia. Bằng cách này, người đóng góp có thể kiếm lợi nhuận từ việc sử dụng thực tế của mô hình.

Ý nghĩa của Học giao thức là biến mô hình thành một nguồn lực kinh tế hoặc hàng hóa, cho phép tài chính hóa hoàn toàn. Bằng cách này, Học giao thức có tiềm năng đạt được quy mô tính toán cần thiết để hỗ trợ các nhiệm vụ huấn luyện thực sự cạnh tranh. Pluralis kết hợp tính bền vững của phát triển mã đóng (như nguồn thu ổn định từ việc phát hành mô hình mã đóng) với lợi thế của hợp tác mã nguồn mở, mở ra khả năng mới cho sự phát triển của AI phi tập trung.

Fortytwo: Suy luận đám đông phi tập trung

Nguồn: Liên kết

-

Trong khi các đội khác tập trung vào thách thức huấn luyện phân tán và phi tập trung, Fortytwo lại tập trung vào suy luận phân tán, giải quyết vấn đề khan hiếm tài nguyên tính toán trong giai đoạn suy luận thông qua trí tuệ đàn thể (Swarm Intelligence).

-

Fortytwo giải quyết vấn đề khan hiếm tính toán ngày càng nghiêm trọng xung quanh suy luận. Để tận dụng năng lực tính toán rảnh trên phần cứng tiêu dùng (ví dụ như MacBook Air trang bị chip M2), Fortytwo kết nối mạng các mô hình ngôn ngữ nhỏ chuyên dụng.

-

Fortytwo kết nối mạng nhiều mô hình ngôn ngữ nhỏ, các nút này hợp tác đánh giá đóng góp của nhau, khuếch đại hiệu suất mạng thông qua đánh giá ngang hàng. Cuối cùng, phản hồi được tạo ra dựa trên đóng góp có giá trị nhất trong mạng, hỗ trợ hiệu quả suy luận.

-

Điều thú vị là, phương pháp mạng suy luận của Fortytwo có thể bổ sung cho các dự án huấn luyện phân tán/phi tập trung. Hãy tưởng tượng một kịch bản tương lai: các mô hình ngôn ngữ nhỏ (SLMs) chạy trên các nút Fortytwo có thể chính là các mô hình được huấn luyện bởi Prime Intellect, Nous hoặc Pluralis. Những dự án huấn luyện phân tán này cùng nhau có thể tạo ra các mô hình nền tảng mã nguồn mở (Foundation Models), sau đó được tinh chỉnh cho lĩnh vực cụ thể và cuối cùng hoàn thành suy luận thông qua mạng lưới điều phối của Fortytwo.

Tóm tắt

Cơ hội lớn tiếp theo của công nghệ mã hóa và AI không phải là một token đầu cơ khác, mà là cơ sở hạ tầng thực sự có thể thúc đẩy sự phát triển của AI. Hiện tại, điểm nghẽn mở rộng của AI tập trung chính là điểm mạnh cốt lõi của lĩnh vực mã hóa trong việc điều phối tài nguyên toàn cầu và cân bằng động cơ kinh tế.

AI phi tập trung mở ra một vũ trụ song song, không chỉ mở rộng khả năng kiến trúc AI mà còn khám phá các ranh giới công nghệ tiềm năng khi kết hợp tự do thử nghiệm với tài nguyên thực tế.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News