중국 AI 컴퓨팅 파워 반격전

글쓴이: Sleepy.txt

8년 전, 중싱(中興)은 심장마비를 겪었다.

2018년 4월 16일, 미국 상무부 산하 산업안보국(BIS)이 내린 한 장의 금지 조치는, 직원 8만 명, 연간 매출 1,000억 위안을 넘는 글로벌 4위 통신장비 업체인 중싱통신을 하루 아침에 가동 중단시켰다. 금지 조치 내용은 단순했다. 향후 7년간 미국 기업들이 중싱에 부품, 상품, 소프트웨어 및 기술을 판매하는 것을 전면 금지한다는 것이다.

퀄컴 칩이 없으면 기지국 생산이 중단된다. 구글 안드로이드 라이선스가 없으면 스마트폰도 사용 가능한 운영체제를 잃는다. 23일 후, 중싱은 공고를 통해 “주요 영업 활동이 이미 진행 불가능한 상태”라고 발표했다.

그러나 중싱은 결국 살아남았지만, 그 대가는 14억 달러였다.

10억 달러의 벌금을 일시불로 납부하고, 추가로 4억 달러의 보증금을 미국 은행의 신탁 계좌에 예치해야 했다. 또한 전 임원진을 교체하고, 미국 측 준법감시팀의 현장 진입을 허용해야 했다. 2018년 한 해 동안 중싱의 순손실은 70억 위안에 달했고, 매출은 전년 대비 21.4% 급감했다.

당시 중싱 회장이었던 인이민(殷一民)은 내부 서신에서 이렇게 적었다. “우리는 복잡하고, 전 세계 공급망에 고도로 의존하는 산업 속에 있다.” 이 문장은 당시에는 성찰이자 무력감이었다.

8년 후, 2026년 2월 26일, 중국 AI 유니콘 딥시크(DeepSeek)는 곧 출시될 V4 멀티모달 대규모 언어모델(Large Language Model, LLM)이 국산 칩 제조사와 심층 협력을 통해, 사전 학습부터 정밀 조정까지 전 과정을 영상처리장치(NVIDIA) 칩 없이 구현할 것이라고 발표했다.

즉, ‘우리는 더 이상 NVIDIA를 사용하지 않는다’는 의미다.

소식이 전해지자 시장의 첫 반응은 의문이었다. NVIDIA는 전 세계 AI 훈련 칩 시장 점유율이 90%를 넘는다. 이를 포기하는 것이 과연 상업적으로 타당한가?

하지만 딥시크의 선택 뒤에는 상업 논리보다 훨씬 큰 질문이 숨어 있다. 바로 ‘중국 AI는 과연 어떤 형태의 컴퓨팅 파워 자립을 필요로 하는가?’라는 문제다.

정말 ‘목이 졸린’ 것은 무엇인가?

많은 이들이 칩 금지 조치가 하드웨어를 차단한다고 생각한다. 그러나 중국 AI 기업들을 실제로 질식시키는 것은 ‘CUDA’라는 이름의 소프트웨어다.

CUDA는 ‘Compute Unified Device Architecture’의 약자로, NVIDIA가 2006년에 도입한 병렬 컴퓨팅 플랫폼이자 프로그래밍 모델이다. 개발자들이 NVIDIA GPU의 연산 능력을 직접 호출해 복잡한 계산 작업을 가속화할 수 있도록 해준다.

AI 시대가 도래하기 전까지 CUDA는 극소수의 테크놀로지 애호가들만 사용하던 도구에 불과했다. 그러나 딥러닝 열풍이 몰아치자 CUDA는 전체 AI 산업의 기반이 되었다.

대규모 언어모델(Large Language Model)의 훈련은 본질적으로 방대한 행렬 연산이며, 이는 바로 GPU가 가장 잘 수행하는 작업이다.

NVIDIA는 수십 년 전부터 선제적으로 CUDA 생태계를 구축해 전 세계 AI 개발자들에게 하드웨어부터 상위 애플리케이션까지 완전한 도구 체인을 제공해왔다. 오늘날, 구글의 TensorFlow부터 메타(Meta)의 PyTorch까지 모든 주요 AI 프레임워크는 모두 CUDA와 깊이 결합되어 있다.

AI 전공 박사과정 학생은 입학 첫날부터 CUDA 환경에서 학습하고, 프로그래밍하며 실험을 한다. 그가 작성하는 모든 코드는 NVIDIA의 ‘모든 것을 통제하는 벽’을 더욱 두껍게 만든다.

2025년 기준, CUDA 생태계는 450만 명 이상의 개발자를 확보했으며, 3,000개 이상의 GPU 가속 애플리케이션을 지원하고, 전 세계 4만 개 이상의 기업이 CUDA를 사용하고 있다. 이 수치는 전 세계 AI 개발자의 90% 이상이 NVIDIA 생태계에 묶여 있음을 의미한다.

CUDA의 무서운 점은 ‘플라이휠 효과(flywheel effect)’에 있다. 개발자가 많을수록 더 많은 도구와 라이브러리, 코드가 생성되며 생태계는 더욱 번성하게 된다. 그리고 생태계가 번성할수록 또 다른 개발자들이 유입되는 양상이다. 일단 시작된 이 플라이휠은 사실상 멈추거나 흔들 수 없다.

결과적으로 NVIDIA는 당신에게 가장 비싼 삽을 팔면서도, 동시에 ‘유일한 채광 자세’까지 규정한다. 다른 삽으로 바꾸고 싶다고? 물론 가능하다. 하지만 지난 수십 년간 전 세계 수십만 명의 천재들이 그 자세에 맞춰 쌓아온 모든 경험, 도구, 코드를 전부 다시 써야 한다.

그 비용은 누가 부담할 것인가?

그래서 2022년 10월 7일, BIS가 A100 및 H100 칩의 중국 수출을 제한하는 첫 번째 규제 조치를 시행했을 때, 중국 AI 기업들은 처음으로 중싱식 질식감을 집단적으로 느꼈다. 이에 NVIDIA는 이후 중국 특별판 A800과 H800을 출시했는데, 이는 칩 간 연결 대역폭을 낮춘 ‘약화 버전’으로, 간신히 공급을 유지하는 수준이었다.

그러나 단 1년 후, 즉 2023년 10월 17일, 두 번째 규제가 강화되면서 A800과 H800 역시 금지되었고, 13개 중국 기업이 실체명단(Entity List)에 등재되었다. 이에 NVIDIA는 추가로 성능을 크게 낮춘 H20을 출시不得不했다. 그리고 2024년 12월, 바이든 행정부 임기 말에 시행된 세 번째 규제에서는 H20의 수출조차 엄격히 제한되었다.

총 세 차례의 규제, 단계적 강화.

하지만 이번 이야기의 전개는, 당시 중싱과는 완전히 다르다.

비대칭적 돌파

금지 조치 아래, 사람들은 중국 AI의 대규모 언어모델 꿈이 여기서 끝날 것이라 예상했다.

그들은 틀렸다. 봉쇄에 직면한 중국 기업들은 정면 돌파를 선택하지 않고, 오히려 ‘돌파’를 시작했다. 이 돌파의 첫 전장은 칩이 아니라 알고리즘이었다.

2024년 말부터 2025년까지, 중국 AI 기업들은 집단적으로 하나의 기술 방향으로 전환했다. 바로 ‘혼합 전문가 모델(Mixture of Experts, MoE)’이다.

간단히 말하면, 거대한 모델을 여러 개의 작은 전문가 모듈로 분할한 뒤, 특정 작업을 처리할 때는 관련성 높은 일부 전문가만 활성화하고, 전체 모델을 작동시키지 않는 방식이다.

딥시크의 V3는 이 접근법의 전형적인 사례다. 총 파라미터 수는 6710억 개지만, 추론(inference) 시에는 그중 370억 개만 활성화되며, 이는 전체의 5.5%에 불과하다. 훈련 비용 측면에서는 2048개의 NVIDIA H800 GPU를 사용해 58일간 훈련했고, 총 비용은 557.6만 달러였다. 비교를 위해 외부에서 추정한 GPT-4 훈련 비용은 약 7800만 달러로, 거의 14배 차이가 난다.

알고리즘 차원의 극한 최적화는 곧바로 가격에 반영됐다. 딥시크의 API 가격은 입력 토큰 100만 개당 0.028~0.28달러, 출력은 0.42달러다. 반면 GPT-4o는 입력 5달러, 출력 15달러이며, 클로드 오푸스(Claude Opus)는 더 비싸서 입력 15달러, 출력 75달러다. 환산해 보면, 딥시크는 클로드보다 25~75배 저렴하다.

이 가격 차이는 글로벌 개발자 시장에서 큰 파장을 일으켰다. 2026년 2월, 세계 최대 AI 모델 API 통합 플랫폼인 OpenRouter에서 중국 AI 모델의 주간 호출량이 3주 만에 127% 급증하며, 사상 처음으로 미국을 넘어섰다. 1년 전만 해도 중국 모델의 OpenRouter 점유율은 2% 미만이었으나, 1년 후에는 421% 증가해 약 60%에 육박했다.

이 데이터 뒤에는 종종 간과되는 구조적 변화가 있다. 2025년 하반기부터 AI 애플리케이션의 주요 사용 사례가 챗(chat)에서 에이전트(Agent)로 전환되기 시작했다. 에이전트 환경에서는 한 번의 작업에 소비되는 토큰 수가 단순 챗보다 10~100배 많다. 토큰 소비량이 지수적으로 증가함에 따라, 가격이 결정적인 요소가 되었다. 중국 모델의 극한의 가성비는 바로 이 창(window)을 정확히 맞췄다.

하지만 문제는, 추론 비용 감소가 훈련의 근본적 문제를 해결하지 못한다는 점이다. 최신 데이터를 기반으로 지속적인 훈련과 반복 개선이 이루어지지 않으면, 대규모 언어모델의 성능은 급속히 퇴화한다. 그런데 훈련은 여전히 피할 수 없는 ‘연산 능력의 블랙홀’이다.

그렇다면 훈련을 위한 ‘삽’은 어디서 구할 것인가?

예비 공급업체의 정식 채택

장쑤성 싱화(興化), 장쑤 남부의 소도시로 스테인리스강과 건강식품으로 유명했고, 그 이전까지는 AI와 전혀 무관했다. 그러나 2025년, 이곳에 148미터 길이의 국산 컴퓨팅 파워 서버 생산라인이 건설·가동됐다. 계약 체결부터 가동까지 단 180일이 걸렸다.

이 생산라인의 핵심은 두 가지 완전히 국산화된 칩이다. 하나는 명령어 집합과 마이크로아키텍처 전부를 자체 개발한 롱신(Longxin) 3C6000 프로세서이고, 다른 하나는 국가 슈퍼컴퓨팅 우시 센터 및 칭화대학교 연구진에서 유래한 태초원기(Taichu Yuanqi) T100 AI 가속 카드다. 태초원기는 이종 다핵(heterogeneous many-core) 아키텍처를 채택했다.

이 생산라인이 가동되면 5분마다 서버 1대가 완성되며, 총 투자액은 11억 위안이고, 연간 생산능력은 10만 대다.

더 중요한 것은, 이러한 국산 칩으로 구성된 수만 개의 GPU 클러스터가 이미 실제 대규모 언어모델 훈련 작업을 맡기 시작했다는 점이다.

2026년 1월, 지푸 AI(Zhipu AI)와 화웨이(Huawei)는 GLM-Image를 공동 발표했는데, 이는 국산 칩만으로 전 과정 훈련을 완료한 최초의 SOTA(SOTA: State-of-the-Art) 이미지 생성 모델이다. 2월에는 중국텔레콤의 천억 파라미터 규모 ‘성신(星辰)’ 대규모 언어모델이 상하이 린강(临港)에 위치한 국산 수만 개 GPU 클러스터에서 전 과정 훈련을 완료했다.

이 사례들의 의미는 단 하나다. 국산 칩이 이제 ‘추론용으로 활용 가능’ 단계를 넘어 ‘훈련용으로도 활용 가능’ 단계에 진입했다는 것이다. 이것은 질적 도약이다. 추론은 이미 훈련된 모델을 실행하는 것으로, 칩에 대한 요구 사양이 비교적 낮다. 반면 훈련은 방대한 데이터를 처리하고 복잡한 그래디언트 계산 및 파라미터 업데이트를 수행해야 하므로, 칩의 연산 능력, 칩 간 연결 대역폭, 소프트웨어 생태계 등에 대한 요구 수준이 한 차원 높다.

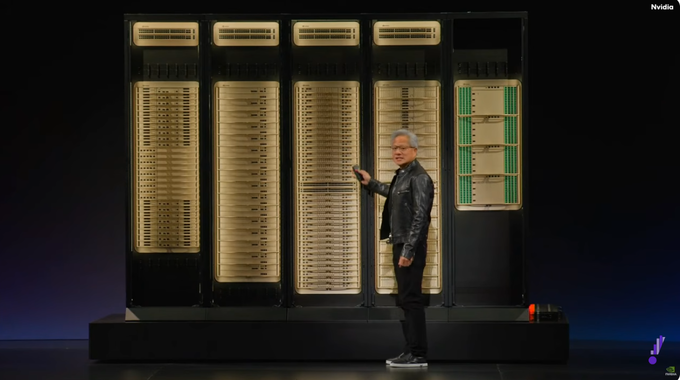

이 작업을 담당하는 핵심 역량은 화웨이의 승텅(昇騰) 시리즈 칩이다. 2025년 말 기준, 승텅 생태계 개발자 수는 400만 명을 넘었고, 파트너사는 3,000개를 초과했다. 업계 주요 대규모 언어모델 43개가 승텅 기반으로 사전 훈련을 완료했으며, 200개 이상의 오픈소스 모델이 승텅에 적응 완료했다. 2026년 3월 2일 MWC(Mobile World Congress) 대회에서 화웨이는 해외 시장에 새롭게 개발한 차세대 컴퓨팅 파워 기반 인프라 ‘슈퍼포드(SuperPoD)’를 세계 최초로 공개했다.

승텅 910B의 FP16 연산 능력은 이미 NVIDIA A100 수준에 도달했다. 여전히 격차는 존재하지만, ‘사용 불가능’에서 ‘사용 가능’으로, 그리고 ‘사용 가능’에서 ‘편리하게 사용 가능’으로 나아가고 있다. 생태계 구축은 칩이 완벽해질 때까지 기다려서는 안 되며, ‘충분히 사용 가능한’ 단계에서부터 대규모로 확산시켜야 하며, 실제 비즈니스 수요를 통해 칩과 소프트웨어의 지속적 개선을 촉진해야 한다. 바이트댄스, 텐센트, 바이두는 국산 컴퓨팅 파워 서버 도입 목표를 2026년에 전년 대비 일반적으로 2배로 증가시킬 계획이다. 중국 공업정보화부(MIIT) 자료에 따르면, 중국의 인텔리전트 컴퓨팅 규모는 이미 1590 EFLOPS에 달한다. 2026년은 중국 국산 컴퓨팅 파워 규모 배치의 원년이 되고 있다.

미국의 전력 부족과 중국의 해외 진출

2026년 초, 전 세계 대규모 데이터센터 트래픽을 처리하는 버지니아주가 신규 데이터센터 건설 승인을 중단했다. 조지아주는 이를 2027년까지 연장했고, 일리노이주와 미시간주도 잇따라 제한 조치를 발표했다.

국제에너지기구(IEA)에 따르면, 2024년 미국 데이터센터 전력 소비량은 183테라와트시(TWh)에 달해 전국 총 전력 소비량의 약 4%를 차지했다. 2030년에는 이 수치가 426TWh로 2배 이상 증가해, 전국 전력 소비 비중이 12%를 넘을 것으로 예상된다. ARM 사 CEO는 2030년까지 AI 데이터센터가 미국 전력 소비의 20~25%를 차지할 것이라고 전망했다.

미국의 전력망은 이미 과부하 상태다. 미국 동부 13개 주를 커버하는 PJM 전력망은 현재 6GW의 용량 부족을 겪고 있다. 2033년까지 미국 전체 전력 용량 부족은 175GW에 달할 것으로 예상되는데, 이는 약 1.3억 가구의 전력 소비량에 해당한다. 데이터센터 집중 지역의 도매 전력 가격은 5년 전보다 267% 상승했다.

연산 능력의 끝은 에너지다. 그리고 에너지라는 측면에서 중국과 미국의 격차는 칩보다 더 크다. 다만 방향은 정반대다.

중국의 연간 발전량은 10.4조 kWh이고, 미국은 4.2조 kWh로, 중국은 미국의 2.5배다. 더 중요한 것은, 중국의 주거용 전력 소비는 전체 전력 소비의 15%에 불과한 반면, 미국은 36%에 달한다는 점이다. 이는 중국이 미국보다 훨씬 더 많은 산업용 전력 여유량을 컴퓨팅 파워 인프라 구축에 투입할 수 있음을 의미한다.

전력 가격 면에서도, 미국 AI 기업 집중 지역의 전기 요금은 kWh당 0.12~0.15달러인데 반해, 중국 서부 지역의 산업용 전기 요금은 약 0.03달러로, 미국의 4분의 1에서 5분의 1 수준이다.

중국의 발전량 증가율은 미국의 7배에 달한다.

미국이 전력 부족으로 고민하는 사이, 중국 AI는 조용히 해외로 진출하고 있다. 하지만 이번에 해외로 진출하는 것은 제품도, 공장도 아닌, ‘토큰(Token)’이다.

토큰은 AI 모델이 정보를 처리하는 최소 단위이며, 이제 새로운 디지털 상품이 되고 있다. 이 토큰은 중국의 컴퓨팅 파워 공장에서 생산되어 해저 광케이블을 통해 전 세계로 전송된다.

딥시크의 사용자 분포 데이터는 매우 의미심장하다. 중국 내 수요가 30.7%, 인도 13.6%, 인도네시아 6.9%, 미국 4.3%, 프랑스 3.2%를 차지한다. 딥시크는 37개 언어를 지원하며, 브라질 등 신흥시장에서도 널리 사용되고 있다. 전 세계 2만 6천 개 기업이 계정을 개설했고, 3,200개 기관이 기업용 버전을 도입했다.

2025년, 신규 AI 스타트업의 58%가 딥시크를 기술 스택에 포함시켰다. 중국 내 점유율은 89%에 달한다. 제재를 받는 다른 국가들에서는 40~60% 수준의 점유율을 기록하고 있다.

이 광경은 40년 전, 또 다른 한 차례의 산업 자주권 전쟁을 연상시킨다.

1986년 도쿄에서, 미국의 강압적인 압력 아래 일본 정부는 ‘미일 반도체 협정’에 서명했다. 이 협정의 핵심 조항은 세 가지였다. 첫째, 일본 반도체 시장 개방을 요구하고, 미국 반도체의 일본 내 시장 점유율을 20% 이상으로 확보해야 한다. 둘째, 일본 반도체의 원가 이하 수출을 엄격히 금지한다. 셋째, 일본 수출 반도체 3억 달러 어치에 대해 100%의 징벌적 관세를 부과한다. 동시에 미국은 후지쯔(Fujitsu)의 패리서미콘(Fairchild Semiconductor) 인수를 거부했다.

당시 일본 반도체 산업은 정점에 있었다. 1988년 일본은 세계 반도체 시장 점유율의 51%를 차지했고, 미국은 36.8%에 불과했다. 세계 10대 반도체 기업 중 6개가 일본 기업이었는데, NEC가 2위, 도시바가 3위, 히타치가 5위, 후지쯔가 7위, 미쓰비시가 8위, 파나소닉이 9위였다. 1985년, 인텔(Intel)은 미일 반도체 경쟁에서 1억 7,300만 달러의 손실을 기록하며 파산 직전까지 몰렸다.

그러나 협정 체결 후 모든 것이 바뀌었다.

미국은 301조사를 비롯한 다양한 수단을 통해 일본 반도체 기업에 전방위적인 압박을 가했다. 동시에 삼성전자와 SK하이닉스 등 한국 기업을 육성하여, 저렴한 가격으로 일본 시장을 공략하도록 했다. 일본의 DRAM 시장 점유율은 80%에서 10%로 급락했고, 2017년에는 일본 IC 시장 점유율이 7%로 줄어들었다. 한때 위세를 떨쳤던 거대 기업들은 분할되거나 인수되거나, 끝없는 적자 속에서 침묵 속에 사라졌다.

일본 반도체의 비극은, 단일 외부 세력이 주도하는 글로벌 분업 체계 내에서 가장 훌륭한 ‘생산자’가 되는 데 만족했지, 자신만의 독립적인 생태계를 구축하려는 생각조차 하지 않았다는 데 있다. 물이 빠졌을 때야 비로소, 자신이 생산 외에는 아무것도 갖지 못했다는 사실을 깨달은 것이다.

오늘날 중국 AI 산업은 유사하면서도 완전히 다른 갈림길에 서 있다.

유사한 점은, 우리 역시 외부로부터의 거대한 압박을 똑같이 받고 있다는 점이다. 세 차례의 칩 규제, 단계적 강화, 여전히 높이 솟은 CUDA 생태계 장벽.

다른 점은, 이번 우리는 훨씬 더 어려운 길을 선택했다는 점이다. 알고리즘 차원의 극한 최적화에서부터, 국산 칩이 추론에서 훈련까지 도달한 도약, 승텅 생태계 400만 개발자의 축적, 그리고 토큰 해외 진출을 통한 글로벌 시장 침투까지. 이 길 위의 모든 단계는, 일본이 결코 가질 수 없었던 독립적인 산업 생태계를 구축하는 과정이다.

맺음말

2026년 2월 27일, 세 개의 중국 내 AI 칩 기업이 하루 동안 각각 실적 보고서를 발표했다.

한우지(寒武紀)는 매출이 453% 폭증하며 사상 처음으로 연간 흑자를 달성했다. 모얼셴스(摩爾線程)는 매출이 243% 증가했으나, 순손실은 10억 위안이다. 무시(沐曦)는 매출이 121% 증가했으나, 순손실은 약 8억 위안에 달했다.

반은 불꽃, 반은 바다.

불꽃은 시장의 극심한 갈증이다. 황런쉰(黃仁勳)이 비워둔 95%의 공백을, 이 국산 기업들의 매출 수치가 한 치씩 채워가고 있다. 성능이 어떠하든, 생태계가 어떤 수준이든, 시장은 NVIDIA 외에 두 번째 선택지를 갈망한다. 이는 지정학적 갈등이 열어준, 천재일우의 구조적 기회다.

바다는 생태계 구축의 거대한 비용이다. 매 한 푼의 손실은 CUDA 생태계를 따라잡기 위해 지불하는 ‘현금’이다. 연구개발 투자, 소프트웨어 보조금, 고객 현장에 파견되어 컴파일 문제를 하나하나 해결하는 엔지니어들의 인건비—모든 손실은 경영 부실이 아니라, 독립적인 생태계를 구축하기 위해 반드시 치러야 할 ‘전쟁세(war tax)’다.

이 세 개의 실적 보고서는, 어떤 업계 리포트보다도 이 연산 능력 전쟁의 진짜 모습을 솔직하게 기록하고 있다. 이는 승리의 함성을 높이는 전진이 아니라, 피를 흘리면서도 계속 전진하는 참혹한 진지전이다.

그러나 전쟁의 양상은 분명히 바뀌었다. 8년 전, 우리는 ‘살아남을 수 있을까?’라는 질문을 던졌다. 오늘날, 우리는 ‘살아남기 위해 어느 정도의 대가를 치러야 할까?’를 묻고 있다.

그 대가 자체가 바로 진보다.

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News