NVIDIA의 AI 축제 GTC 개막, 최강 AI 칩 Blackwell 등장

글: 리단

출처: 월스트리트 인사이더

올해 세계 최대 규모의 인공지능(AI) 개발자 회의로 불리는 엔비디아 2024 GTC AI 컨퍼런스가 미국 동부시간 3월 18일 월요일에 개막했다.

올해는 엔비디아가 5년 만에 연례 GTC 행사를 다시 오프라인으로 개최하는 해이며, 앞서 분석에서 엔비디아가 본격적인 AI 기술을 공개할 것으로 예상된 행사였다.

현지 시각 월요일 오후, 엔비디아 창립자이자 CEO 젠슨 황은 캘리포니아주 샌호세 SAP 센터에서 '개발자를 위한 1위 AI 컨퍼런스(1# AI Conference for Developers)'라는 주제로 강연을 진행했다.

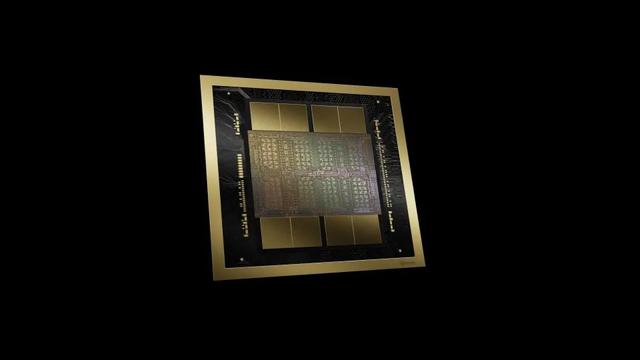

블랙웰, 전 세대 대비 비용 및 에너지 소비 25배 향상… 세계 최강 칩, TSMC 4nm 공정

젠슨 황은 AI 모델 구동을 위한 차세대 칩과 소프트웨어를 소개했다. 엔비디아는 새로운 AI 그래픽 프로세서(GPU) 블랙웰(Blackwell)을 정식 발표했으며, 올해 말부터 출하될 예정이다.

블랙웰 플랫폼은 수조 개의 매개변수를 가진 거대 언어 모델(LLM) 상에서 실시간 생성형 AI를 구축하고 실행할 수 있으며, 전 세대 대비 비용과 에너지 소비가 25배 개선됐다.

엔비디아에 따르면, 블랙웰은 최대 10조 매개변수 모델에 대한 AI 학습 및 실시간 LLM 추론을 지원하는 6가지 혁신 기술을 갖췄다:

-

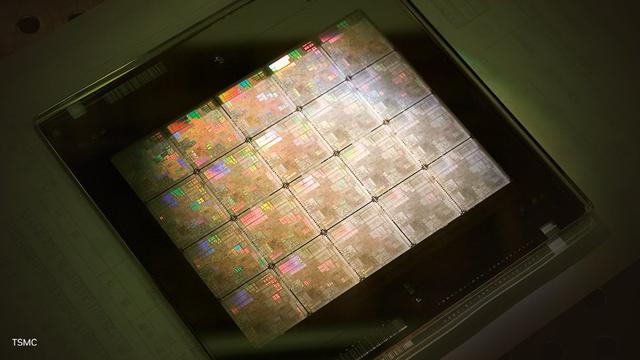

세계 최강 칩: 블랙웰 아키텍처 GPU는 2080억 개의 트랜지스터로 구성되며, 맞춤형 TSMC 4나노미터(nm) 공정으로 제조된다. 두 개의 리틱 한계 GPU 다이(die)가 10TB/s의 칩 간 링크로 연결되어 단일 통합 GPU를 형성한다.

-

2세대 트랜스포머 엔진: 블랙웰 텐서코어 기술과 TensorRT-LLM, NeMo Megatron 프레임워크 내 고급 동적 범위 관리 알고리즘을 결합해, 새로운 4비트 부동소수점 AI를 통해 계산 능력과 모델 크기 추론 성능을 두 배로 높였다.

-

5세대 NVLink: 수조 매개변수 및 믹스드 익스퍼트(MoE) AI 모델의 성능 향상을 위해, 최신 NVLink는 각 GPU당 1.8TB/s의 양방향 처리량을 제공하며, 최대 576개 GPU 간 복잡한 LLM 통신을 원활하게 보장한다.

-

RAS 엔진: 블랙웰 기반 GPU는 신뢰성(Reliability), 가용성(Availability), 서비스 가능성(Serviceability)을 위한 전용 엔진을 포함한다. 또한 AI 기반 예방 유지보수 기능을 활용해 진단 및 신뢰성 문제 예측이 가능하며, 이는 시스템 가동 시간을 극대화하고, 대규모 AI 배치의 탄력성을 높여 수 주에서 수 개월간 연속 운용이 가능하며 운영 비용을 절감한다.

-

안전한 인공지능: 고급 기밀 컴퓨팅 기능을 통해 AI 모델과 고객 데이터를 보호하면서 성능 저하 없이 새로운 네이티브 인터페이스 암호화 프로토콜을 지원하며, 의료 및 금융 서비스 등 개인정보 보호가 중요한 산업에 필수적이다.

-

압축 해제 엔진: 전용 압축 해제 엔진은 최신 포맷을 지원해 데이터베이스 조회 속도를 높이고, 데이터 분석 및 데이터 과학 작업에서 최고 성능을 제공한다. 향후 몇 년간 기업이 연간 수백억 달러를 지출하는 데이터 처리 분야에서 GPU 가속이 더욱 확대될 전망이다.

GB200 NVL72, H100 대비 추론 성능 최대 30배 향상

엔비디아는 동시에 슈퍼칩 GB200 그레이스 블랙웰 슈퍼칩(Grace Blackwell Superchip)도 소개했다. 이는 900GB/s의 초저전력 NVLink를 통해 두 개의 B200 텐서코어 GPU를 NVIDIA 그레이스 CPU에 연결한다.

최고의 AI 성능을 확보하기 위해, GB200 기반 시스템은 월요일 함께 발표된 엔비디아 Quantum-X800 InfiniBand 및 Spectrum-X800 이더넷 플랫폼과 연결할 수 있으며, 최대 800Gb/s의 고속 네트워크를 제공한다.

GB200은 엔비디아 GB200 NVL72의 핵심 구성 요소로, 가장 계산 집약적인 워크로드에 적합한 다중 노드, 액체 냉각, 랙 규모 시스템이다. 36개의 그레이스 블랙웰 슈퍼칩을 통합하여, 72개의 블랙웰 GPU와 36개의 그레이스 CPU를 5세대 NVLink로 연결한다. GB200 NVL72은 또한 NVIDIA BlueField®-3 데이터 처리 유닛(DPU)을 포함하여 초대규모 AI 클라우드에서 클라우드 네트워킹 가속, 컴포저블 스토리지, 제로 트러스트 보안 및 GPU 컴퓨팅 탄력성을 구현한다.

H100 텐서코어 GPU와 비교할 때, GB200 NVL72은 LLM 추론 워크로드에서 최대 30배의 성능 향상과 비용 및 에너지 소비를 최대 25배 감소시킨다.

GB200 NVL72 플랫폼은 단일 GPU처럼 작동하며, 1.4 엑사플롭스(exaflops)의 AI 성능과 30TB의 고속 메모리를 갖추고 있으며, 최신 DGX SuperPOD의 기본 구성 요소이다.

엔비디아는 x86 기반 생성형 AI 플랫폼을 지원하기 위해, 8개의 B200 GPU를 NVLink로 연결하는 서버 마더보드 HGX B200도 출시했다. HGX B200은 엔비디아 Quantum-2 InfiniBand 및 Spectrum-X 이더넷 네트워크 플랫폼을 통해 최대 400Gb/s의 네트워크 속도를 지원한다.

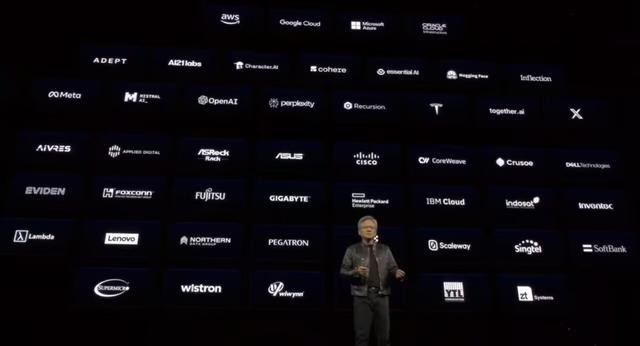

아마존·마이크로소프트·구글·오라클, 블랙웰 지원 클라우드 서비스 첫 번째 제공사

블랙웰 칩은 아마존, 마이크로소프트, 구글 등 세계 최대 규모의 데이터센터 운영사들이 새 컴퓨터 및 기타 제품을 배치하는 기반이 될 것이다. 블랙웰 기반 제품은 올해 말 출시될 예정이다.

엔비디아는 아마존 AWS, 구글 클라우드, 마이크로소프트 Azure, 오라클 클라우드 인프라스트럭처(OCI)가 블랙웰 지원 인스턴스를 처음 제공하는 클라우드 서비스 제공업체(CSP)가 되며, 엔비디아 클라우드 파트너십 프로그램 참여 기업인 Applied Digital, CoreWeave, Crusoe, IBM Cloud, Lambda 역시 초기 블랙웰 인스턴스 제공 CSP가 될 것이라고 밝혔다.

주권 AI(Sovereign AI) 클라우드를 위한 서비스도 제공될 예정이며, 여기에는 Indosat Ooredoo Hutchinson, Nebius, Nexgen Cloud, 오라클 EU 주권 클라우드, 오라클 미국·영국·호주 정부 클라우드, Scaleway, Singtel, Northern Data Group의 Taiga Cloud, Yotta Data Services의 Shakti Cloud, YTL Power International 등이 포함된다.

젠슨 황은 "30년간 우리는 딥러닝과 AI 분야의 변혁적 돌파구를 이루기 위해 가속 컴퓨팅을 추구해 왔다. 생성형 AI는 우리 시대의 결정적 기술이다. 블랙웰은 이 새로운 산업 혁명을 추진하는 엔진이다. 세계에서 가장 역동적인 기업들과 협력함으로써 우리는 모든 산업 분야에서 AI의 가능성을 실현할 것이다."라고 말했다.

엔비디아는 보도 자료에서 마이크로소프트, 아마존, 구글, 메타, 델, OpenAI, 오라클, 머스크가 이끄는 테슬라 및 xAI 등 블랙웰을 도입할 조직들을 언급했으며, 젠슨 황은 이러한 기업들을 포함한 더 많은 파트너십을 소개했다.

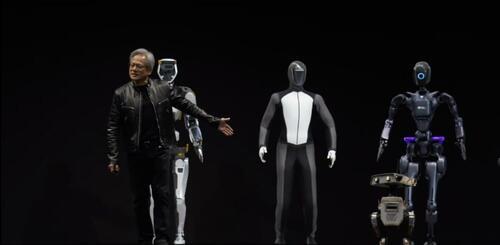

AI 프로젝트 Project GR00T, 인간형 로봇 개발 지원

젠슨 황은 강연 중 엔비디아가 인간형 로봇의 미래를 지원하는 다중 모달 AI 프로젝트인 Project GR00T를 출시했다고 밝혔다. 이 프로젝트는 일반 기반 모델을 사용해 인간형 로봇이 텍스트, 음성, 영상, 심지어 현장 데모까지 입력으로 받아들여 처리하고, 특정 일반 작업을 수행할 수 있게 한다.

Project GR00T는 엔비디아 아이작(Isaac) 로봇 플랫폼 도구를 활용해 개발되었으며, 강화 학습을 위한 새로운 Isaac 랩(Laboratory)도 포함된다.

젠슨 황은 "Project GR00T 플랫폼 기반 로봇은 인간의 행동을 관찰함으로써 자연어를 이해하고 동작을 모방하도록 설계되며, 이를 통해 조정성, 유연성 및 기타 기술을 빠르게 학습하고 현실 세계에 적응하며 상호작용할 수 있다. 로봇 반란은 절대 발생하지 않는다."라고 설명했다.

젠슨 황은 또 이렇게 말했다.

"범용 인간형 로봇을 위한 기본 모델을 구축하는 것은 현재 AI 분야에서 해결할 수 있는 가장 흥미로운 문제 중 하나다. 이 기술들을 융합함으로써 전 세계 최고의 로봇 전문가들은 인공 범용 로봇 분야에서 큰 도약을 이룰 수 있을 것이다."

TSMC와 시놉시스, 엔비디아 리소그래피 기술 도입

젠슨 황은 TSMC와 시놉시스(Synopsys)가 엔비디아의 계산 리소그래피 기술을 도입하며, 엔비디아의 계산 리소그래피 플랫폼 CuLitho를 사용한다고 밝혔다.

TSMC와 시놉시스는 이미 엔비디아의 Culitho W 소프트웨어를 통합했으며, 엔비디아 차세대 블랙웰 GPU를 활용해 AI 및 HPC 응용 분야를 구현할 예정이다.

새 소프트웨어 NIM, 기존 엔비디아 GPU로 AI 추론 더 쉽게

엔비디아는 동시에 '엔비디아 NIM(NVIDIA NIM)'이라는 추론 마이크로서비스도 발표했다. NIM은 클라우드 네이티브 최적화 마이크로서비스로, 생성형 AI 모델의 시장 출시 시간 단축과 클라우드, 데이터센터, GPU 가속 워크스테이션에서의 배포를 간소화하기 위해 설계되었다.

NIM은 산업 표준 API를 사용해 AI 모델 개발과 프로덕션 패키징의 복잡성을 추상화함으로써 개발자층을 확장한다. NIM은 엔비디아 AI Enterprise의 일부로, AI 기반 기업 애플리케이션 개발 및 AI 모델의 프로덕션 배포를 위한 간소화된 경로를 제공한다.

NIM은 사용자가 구형 엔비디아 GPU를 이용해 추론하거나 AI 소프트웨어를 실행하는 과정을 더 쉽게 만들어 주며, 기업 고객이 기존에 보유한 엔비디아 GPU를 계속 사용할 수 있도록 한다. 추론에 필요한 컴퓨팅 파워는 새로운 AI 모델을 처음 학습할 때보다 적다. NIM은 기업이 OpenAI 등의 외부 AI 서비스를 구매하는 대신, 자체 AI 모델을 운영할 수 있게 한다.

엔비디아 서버 기반 고객은 엔비디아 AI Enterprise를 구독하면 NIM을 사용할 수 있으며, 연간 라이선스 비용은 GPU당 4,500달러다.

엔비디아는 마이크로소프트, 허깅페이스(Hugging Face) 등 주요 AI 기업들과 협력해, 그들의 AI 모델이 호환 가능한 모든 엔비디아 칩에서 원활히 작동하도록 할 예정이다. NIM을 사용하는 개발자는 긴 설정 과정 없이 자체 서버 또는 클라우드 기반 엔비디아 서버에서 효율적으로 모델을 실행할 수 있다.

일각에서는 NIM과 같은 소프트웨어가 AI 배포를 더 쉬워지게 하면서 엔비디아의 수익 창출뿐 아니라 고객이 엔비디아 칩을 계속 사용하도록 유도하는 추가적인 이유를 제공한다고 평가했다.

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News