苦渋の宗教:人工知能が拡張法則を中心に展開する聖戦

TechFlow厳選深潮セレクト

苦渋の宗教:人工知能が拡張法則を中心に展開する聖戦

人工知能コミュニティは、その未来について、そして神の教義を創造するのに十分な規模があるかどうかを巡って論争に巻き込まれている。

執筆:Mario Gabriele

翻訳:Block unicorn

人工知能における聖戦

私は、死ぬまで神がいると信じて生きて、死の際に神がいなかったことに気づくほうがましだ。逆に、神がいないと思って生き、死の際に神がいたと気づくのは耐えられない。――ブレーズ・パスカル

宗教とは興味深いものだ。おそらくどの方向からも完全に証明できないためだろうし、あるいは私が最も好む言葉のように、「事実では感情に対抗できない」からかもしれない。

信仰は、その高まりとともに信じられないほどのスピードで加速する傾向があり、神の存在を疑うことがほとんど不可能になる。周囲の人々が次々と信じ始めれば、どうしてあなたが神の存在を疑えるだろうか?世界全体が一つの教義を中心に再編成されるとき、異端が立つ余地などどこにあるというのか?寺院や大聖堂、法律や規範がすべて新しい、揺るぎない福音に基づいて構築されるとき、反対意見のスペースは一体どこにあるのか?

アブラハム的宗教が初めて登場し各大陸へ広がったとき、あるいは仏教がインドからアジア全域へ拡散したとき、その信仰の巨大な運動エネルギーは自己強化の循環を生み出した。より多くの人々が改宗し、これらの信仰を中心に複雑な神学体系や儀礼が構築されるにつれ、基本的な前提を疑問視することがますます難しくなっていった。軽信の海の中で異端となることは容易ではない。壮大な教会、複雑な経典、繁栄する修道院はすべて、神の存在を示す物理的証拠として機能したのだ。

しかし宗教の歴史はまた、こうした構造がいかに簡単に崩壊するかも教えてくれる。キリスト教がスカンジナビア半島に伝播すると、古代の北欧信仰はたった数世代で崩壊した。古代エジプトの宗教体系は数千年続いたが、より持続性のある新たな信仰が台頭し、より大きな権力構造が出現したときに消滅した。同じ宗教内部においてさえ、劇的な分裂を目にしてきた――宗教改革は西ヨーロッパのキリスト教を引き裂き、東西教会の大分裂は東方正教会とカトリック教会の分離をもたらした。こうした分裂は、一見些細な教義の相違から始まり、次第にまったく異なる信仰体系へと進化していくことが多い。

聖典

神とは、あらゆる知的思考レベルを超越したメタファーである。それだけだ。――ジョゼフ・キャンベル

要するに、神を信じることが宗教なのであり、あるいは神を創造することも同様にそうなのかもしれない。

誕生以来、楽観的な人工知能研究者たちは自らの仕事を神話的創造――すなわち神の創造に例えてきた。ここ数年、大規模言語モデル(LLMs)の爆発的発展は、信奉者たちの信念をさらに強め、我々が神聖な道を歩んでいるという確信を深めた。

それは2019年に書かれたブログ記事の正当性も裏付けている。人工知能の分野外の人々が最近になってようやく知るようになったこの記事だが、カナダの計算機科学者リチャード・サットンによる「苦い教訓(The Bitter Lesson)」は、コミュニティ内でますます重要なテキストとなり、隠れた知識から新たな包括的宗教の基盤へと進化してきた。

わずか1,113語(あらゆる宗教には神聖な数字が必要だ)の中で、サットンは一つの技術的洞察を要約している。「過去70年のAI研究から得られる最大の教訓は、計算能力を活用する汎用的手法こそが最終的に最も効果的であり、極めて大きな利点を持つということだ」。AIモデルの進歩は指数関数的に増加する計算資源によって推進され、モアの法則の巨大な波に乗っている。一方でサットンは、AI研究の多くが専門的な技術――人間の知識や狭域ツールの導入――を通じて性能を最適化しようとしてきた点を指摘する。こうした最適化は短期的には役立つかもしれないが、サットンによれば、それらは結局時間と資源の無駄であり、巨大な波が押し寄せる中でサーフボードのフィンを調整したり、ワックスを変えたりするようなものだとされる。

これがいわゆる「苦い宗教」の基礎である。この宗教にはただ一つの戒律しかなく、コミュニティでは通常「スケーリングの法則(scaling law)」と呼ばれている:計算の指数的拡張が性能を押し上げる。それ以外はすべて愚かである。

「苦い宗教」は大規模言語モデル(LLMs)から世界モデルへ、そして現在は生物学、化学、具身知能(ロボット工学および自動運転車)といった未開拓の聖域へと急速に広がっている。

しかしサットンの教えが広まるにつれ、定義そのものも変化しつつある。これはすべての活発で生命力ある宗教に共通する特徴――論争、延長、注釈――である。「スケーリングの法則」はもはや単なる計算の拡張を意味するわけではない(箱舟はもはや一艘の船ではない)。今やそれは、トランスフォーマーや計算性能を向上させるさまざまな手法を含む概念であり、いくつかのテクニックも含まれている。

今日の「聖典」には、コアモデル自体へのテクニック適用(モデルマージ、エキスパート混合(MoE)、知識蒸留)から、これらの常に飢えた神々に供給する合成データの生成に至るまで、AIスタックの各部分を最適化する試みがすべて含まれており、膨大な実験が行われている。

対立する教派

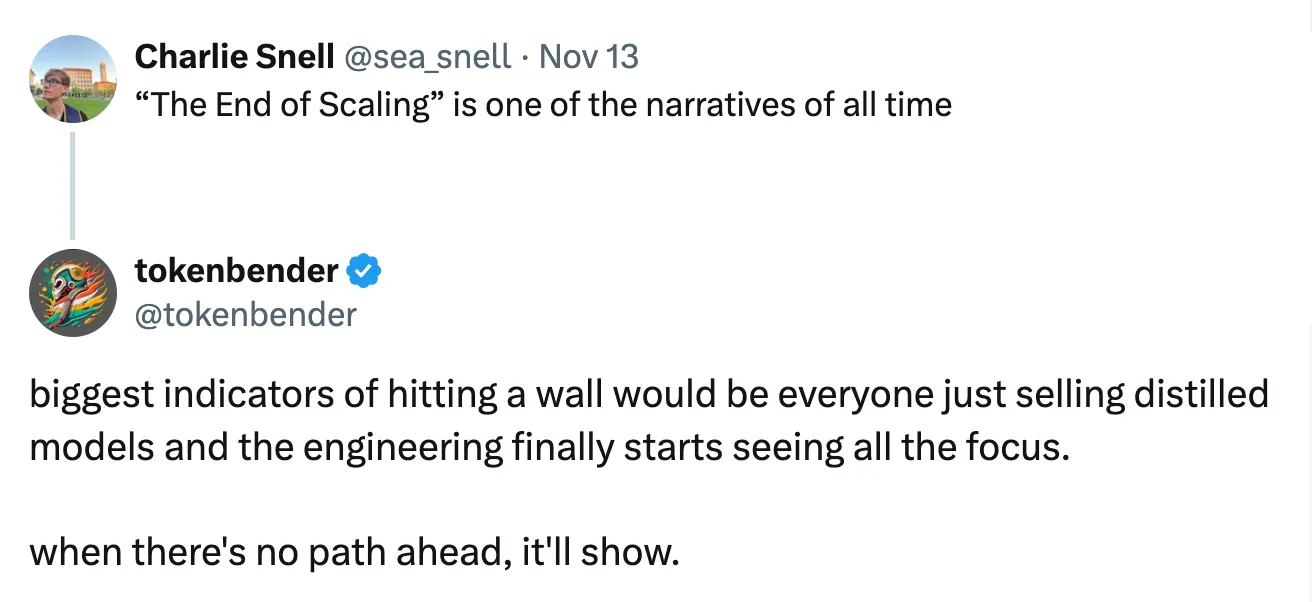

最近、人工知能コミュニティで議論を巻き起こしている問題は、「苦い宗教」がまだ正しいかどうかという、まさに聖戦的な色合いを持ったものだ。

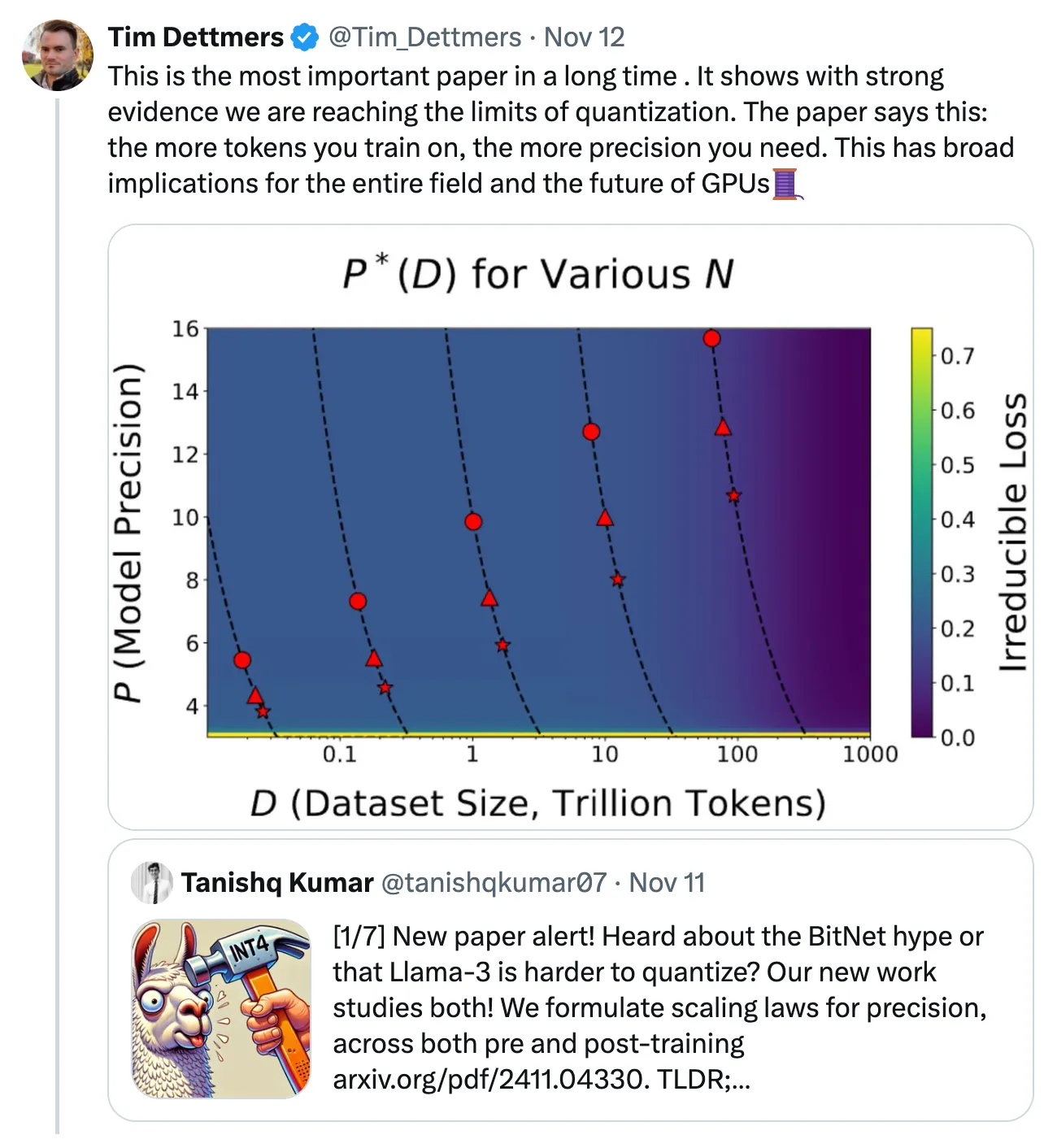

今週、ハーバード大学、スタンフォード大学、MITが発表した「精度のスケーリングの法則」と題する新論文が、この衝突に火をつけた。この論文は、AIモデルの性能を改善し、オープンソースエコシステムにとって非常に有益な「量子化(quantization)」技術の効率向上が限界に達していることを議論している。アレン研究所の研究科学者Tim Dettmersは以下の投稿でその重要性を概説し、「長期間で最も重要な論文」と評した。これはここ数週間にわたって過熱する議論の継続を象徴しており、注目に値するトレンド――二つの宗教のますますの固定化――を明らかにしている。

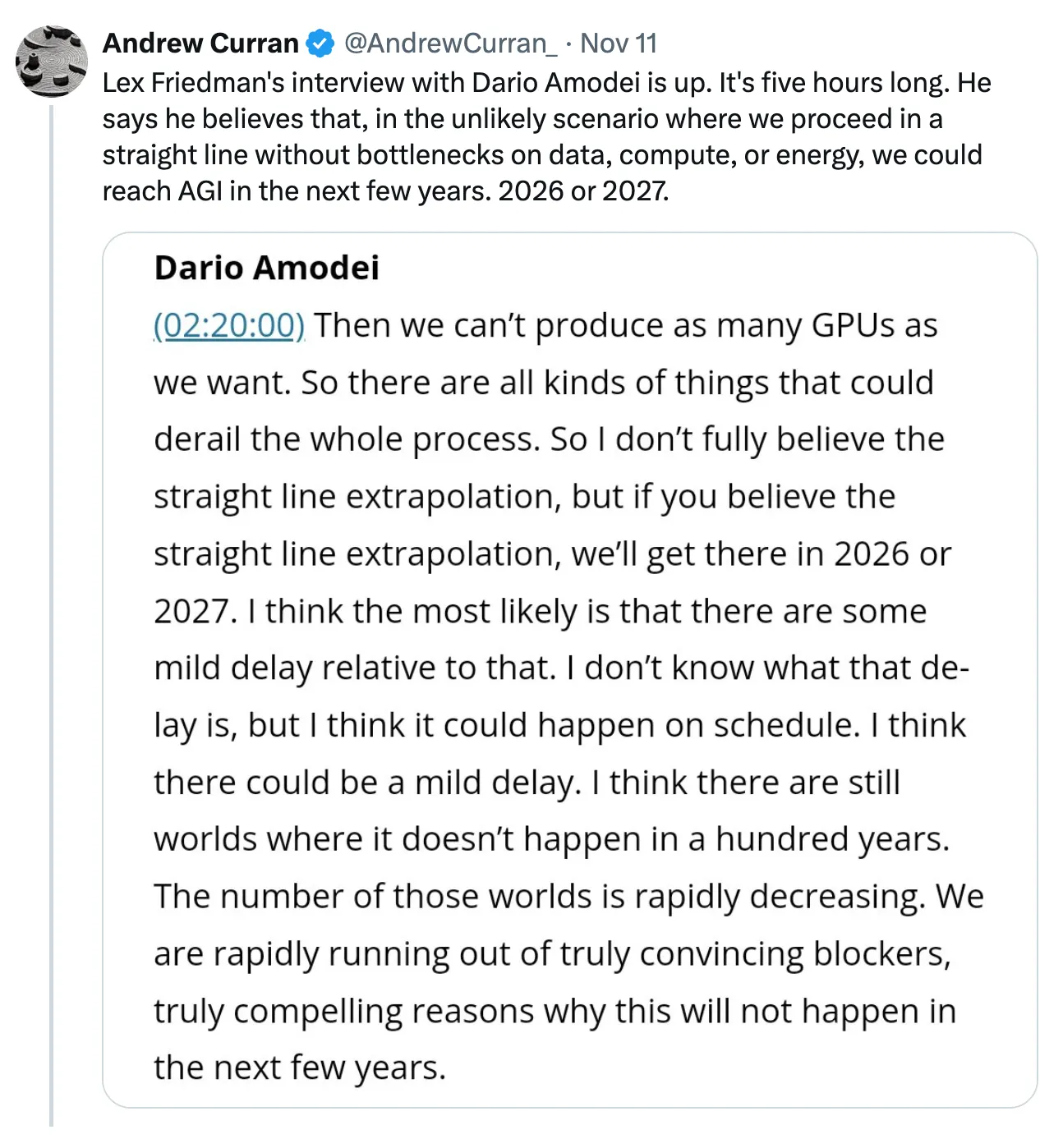

OpenAI CEOのSam AltmanとAnthropic CEOのDario Amodeiは同じ教派に属している。二人とも、今後約2〜3年で汎用人工知能(AGI)を達成できると自信を持って述べている。AltmanとAmodeiはどちらも、「苦い宗教」の神聖性に最も依存している人物と言えるだろう。彼らのインセンティブはすべて、過剰な約束をし、最大限のバズを生み出して、規模の経済がほぼ完全に支配するこのゲームの中で資本を蓄積することに向いている。もし「スケーリングの法則」が「アルファでありオメガ」、最初であり最後、始まりであり終わりでないのであれば、なぜ220億ドルが必要なのか?

元OpenAIチーフサイエンティストのIlya Sutskeverは異なる原則を堅持している。彼は他の研究者たち(最近のリーク情報によれば、OpenAI内部の多くの研究者も含む)と共に、スケーリングは上限に近づいていると考えている。このグループは、進捗を維持しAGIを現実世界に持ち込むには、必然的に新たな科学と研究が必要だと主張する。

Sutskever派は、Altman派の持続的な拡張思想が経済的に非現実的であると合理的に指摘する。人工知能研究者のNoam Brownが問いかけたように、「結局のところ、本当に数千億ドル、あるいは数兆ドルをかけてモデルを訓練するつもりなのか?」これは、計算の拡張を訓練から推論に移行させた場合に必要な、さらに数十億ドルの推論計算コストを含んでいない。

しかし真の信奉者たちは、敵の論理に非常に慣れ親しんでいる。あなたの家の前に立つ宣教師は、あなたの享楽主義的ジレンマを簡単に乗り越えることができる。BrownやSutskeverに対する反論として、Sutskever派は「推論時計算(test-time compute)」の可能性を指摘する。これまでとは異なり、「推論時計算」は訓練時の計算量増加ではなく、実行時により多くのリソースを投入するものだ。AIモデルがあなたの質問に答えたり、コードやテキストを生成したりする際に、より多くの時間と計算を提供できる。これは、数学の試験勉強から、先生にもう1時間追加してもらい電卓の使用を許可してもらうように説得するのに相当する。エコシステム内の多くの人々にとって、これは「苦い宗教」の新たな最前線であり、チームが正統的な事前学習から、ポストトレーニング/推論の手法へとシフトしている。

他の信仰体系の弱点を指摘し、他の教義を批判しながら自らの立場を隠すのは簡単だ。では、私の信仰は何か?まず第一に、私は現行のモデル群が時間とともに非常に高い投資収益率をもたらすと信じている。人々が制限を回避し既存のAPIを活用する方法を学ぶにつれ、本当に革新的な製品体験が生まれ成功するだろう。私たちはAI製品の模倣的段階や漸進的段階を超えていく。これを「汎用人工知能(AGI)」と呼ぶべきではない。その定義には枠組み上の欠陥があるため、むしろ「最小実現可能知能」として捉えるべきだ。これは異なる製品や使用シナリオに応じてカスタマイズ可能な能力である。

超人工知能(ASI)の実現については、さらなる構造が必要となる。より明確な定義と区分けにより、それぞれがもたらす経済的価値と経済的コストとの間のトレードオフをより効果的に議論できるようになる。例えば、AGIは一部のユーザーに経済的価値を提供するかもしれない(単なる局所的信仰体系にすぎない)。一方、ASIは止められない複利効果を示し、世界、私たちの信仰体系、社会構造そのものを変えてしまう可能性がある。私は、トランスフォーマーの単なる拡張だけでASIを達成できるとは思わない。残念ながら、誰かが言うかもしれないが、これは私の無神論的信仰にすぎない。

失われた信仰

人工知能コミュニティは短期間でこの聖戦を解決することはできない。この感情的な争いには、提示できる事実は何もない。代わりに、私たちは「スケーリングの法則」に対する信仰の疑念が何を意味するかに注目すべきだ。信仰の喪失は、大規模言語モデル(LLMs)を超えて、すべての業界や市場に連鎖反応を引き起こす可能性がある。

強調すべきは、AI/機械学習のほとんどの分野で、我々はまだ「スケーリングの法則」を徹底的に探求していないということだ。これからもさらに多くの奇跡が起きるだろう。しかし、もし疑念が確かに忍び寄ってきたならば、投資家や建設者にとって、バイオテクノロジーやロボティクスといった「曲線初期」カテゴリの究極的性能状態に対して、これまでと同じ高い確信を持ち続けることが難しくなるだろう。言い換えれば、もし大規模言語モデルが減速し、選ばれた道から逸脱し始めたとすれば、多くの創業者や投資家の隣接分野における信仰体系は崩壊するだろう。

それが公正かどうかは別の問題だ。

ある見解では、「汎用人工知能(AGI)」は自然に大規模化を必要とするため、特定領域モデルの「品質」はより小さな規模で示されるべきであり、実際の価値を提供する前にすぐにつまずくことはないはずだ。特定領域のモデルがデータの一部しか取り込まず、そのため実現可能性を得るために必要な計算リソースも一部にすぎないとすれば、十分な改良余地があるのではないだろうか?直感的には理にかなっているが、繰り返し確認されているのは、往々にしてそれが鍵ではないことだ。関連する、あるいは一見無関係なデータを含めることで、一見無関係なモデルの性能が向上することがよくある。例えば、プログラミングデータを含めると、より広範な推論能力の向上につながるように見える。

長期的には、特定領域モデルに関する議論は無意味になるかもしれない。ASI(超人工知能)を構築しようとする者は、最終的にすべての分野で無限の創造力を発揮できる、自己複製・自己改善可能な存在を目指すことになるだろう。元OpenAI取締役でOpen Philanthropy創設者のHolden Karnofskyは、このような創造物を「PASTA」(科学技術の進歩を自動化するプロセス)と呼んでいる。Sam Altmanの当初の収益化プランも同様の原理に依存しているように見える:「AGIを構築し、その後それを使って利益を得る方法を尋ねる」。これは終末論的人工知能、すなわち最終的な運命である。

OpenAIやAnthropicのような大規模AI研究所の成功は、資本市場が「X分野のOpenAI」型の研究所を支援する熱意を高めた。こうした研究所の長期的目標は、特定の垂直分野や領域内で「AGI」を構築することにある。このスケール分解の推論はパラダイムシフトをもたらし、OpenAIモデルの模倣から、製品中心の企業へと移行するだろう。これは私がCompoundの2023年年会で提起した可能性である。

終末論的モデルとは異なり、こうした企業は一連の進捗を示さなければならない。それらは応用研究を行う科学組織ではなく、スケールの工学的課題に基づいて構築された企業であり、最終目標は製品を構築することである。

科学の世界では、自分が何をしているかわかっているなら、それをやってはいけない。工学の世界では、自分が何をしているかわかっていなければ、それをやってはいけない。――リチャード・ハミング

信奉者たちは短期間で神聖な信仰を失うことはないだろう。前述したように、宗教が急成長するとき、人々は生活や崇拝の脚本、ヒューリスティックな方法論を編纂する。彼らは実体的な記念碑やインフラを建設し、自らの力と知恵を強化し、「自分たちが何をしているかわかっている」と示す。

最近のインタビューで、Sam AltmanはAGIについて次のように語った(強調は当方):

今回が初めて、本当にやるべきことがわかっていると感じている。これからAGIを構築するまで、まだまだ多くの作業が必要だ。未知の課題はあるが、基本的にやるべきことはわかっている。時間がかかるし、難しいが、非常にエキサイティングでもある。

審判

「苦い宗教」を疑問視するスケーリング懐疑論者たちは、ここ数年で最も深い議論の一つを清算しようとしている。私たち一人ひとりが何らかの形で考えてきたことだ。もし我々が神を発明したらどうなるか?その神はどれほど早く現れるのか?もしAGI(汎用人工知能)が本当に不可逆的に台頭したら、何が起こるのか?

あらゆる未知で複雑なテーマと同様に、私たちはすぐに脳内に特定の反応パターンを形成してしまう。一部の人々は、自分がもはや不要になることに絶望し、大多数は破滅と繁栄の混合を予想し、最後の一部は人類が最も得意とする行動――解決すべき問題を見つけ、自ら作り出した問題を解決し続け、純粋な豊かさを実現する――を行うだろうと予測する。

大きな利害関係を持つ人々にとっては、スケーリングの法則が成立し、AGIが数年以内に到来した場合、世界が自分にとってどうなるかを予測したいだろう。あなたはこの新しい神にどう仕えるのか、この新しい神はどのようにあなたに仕えるのか?

しかし、停滞の福音が楽観主義者を追い払ったらどうなるのか?もし、神ですら衰退するかもしれないと考えるようになったら?以前の記事『ロボットFOMO、スケーリングの法則、技術予測』で私はこう書いた:

時々私は、スケーリングの法則が成立しなかったらどうなるかを考える。それは収益減少、成長鈍化、金利上昇が多くの技術分野に与えた影響と似ているかもしれない。また、スケーリングの法則が完全に成立したとしても、他の多くの分野での先行者たちや価値獲得の商品化曲線と似たような結果になるかもしれない。

「資本主義の良い点は、どんな形であれ、答えを見つけるために大量のお金を費やすということだ」

創業者や投資家にとっての問題は、「次に何が起こるか?」である。各垂直領域で偉大な製品構築者が誰になるかは、徐々に明らかになりつつある。各業界にはさらに多くの人が現れるだろうが、物語はすでに始まっている。では、新たな機会はどこから生まれるのか?

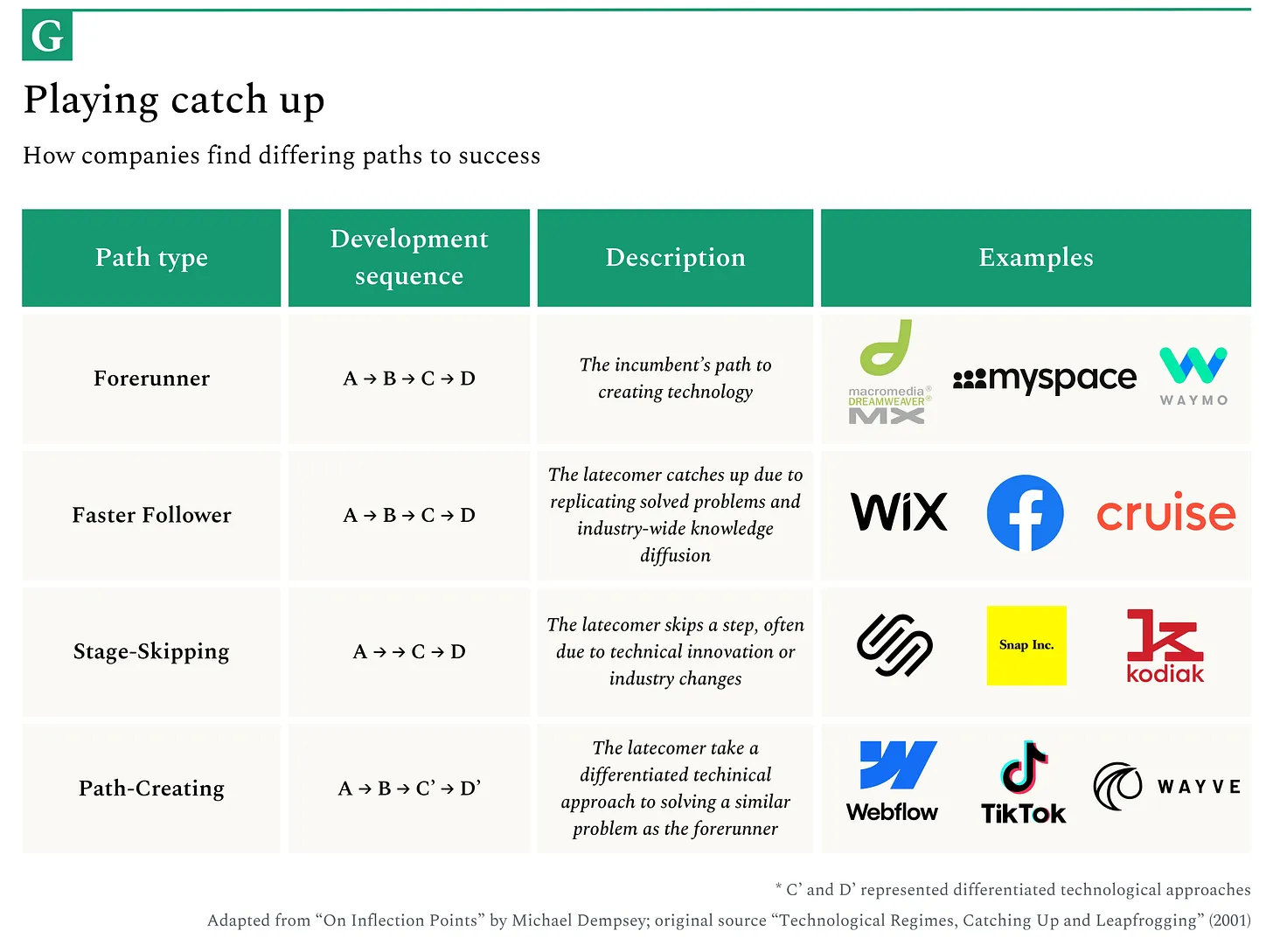

もしスケーリングが停滞すれば、倒産と合併の波が押し寄せると予想される。残った企業はますます工学に重点を置くようになるだろう。この進化は、人材の流動性を追跡することで予見できる。すでにOpenAIが自社製品化を進めていることから、その兆候は見え始めている。この変化は、工学ではなく革新的な応用研究と科学に依存することで「横道超え」を図り、新路線を開拓して既存企業を凌駕する次世代スタートアップに空間を与えるだろう。

宗教からの教訓

私の技術に対する見方は、明らかに複利効果を持っているように見えるものは、通常長期間持続せず、また誰もが当然と思うようなビジネスモデルは、奇妙なほど予想よりも遅く、小さく発展するものだ、というものだ。

宗教的分裂の初期兆候は、通常予測可能なパターンに従う。これを利用して、「苦い宗教」の進化を追跡するフレームワークを構築できる。

それは通常、資本主義的あるいはイデオロギー的理由による、互いに競合する解釈の出現から始まる。初期キリスト教では、キリストの神性や三位一体の本質に関する異なる見解が分裂を引き起こし、まったく異なる聖書解釈を生んだ。前述したAIの分裂に加え、他にも現れつつある亀裂がある。例えば、一部のAI研究者たちがトランスフォーマーの核心的正統性を拒否し、状態空間モデル(State Space Models)、Mamba、RWKV、液体モデル(Liquid Models)などの他のアーキテクチャへと移行している。これらは今のところ弱いシグナルにすぎないが、異端的思考の萌芽と、基本原理からこの分野を再考しようとする意思の表れである。

時間の経過とともに、預言者たちの焦燥的な発言も不信感を生む。宗教的指導者の予言が成就しない、あるいは神の介入が約束された通りに訪れないとき、疑念の種が蒔かれるのだ。

ミラー派運動は1844年にキリストの再来を予言したが、イエスが来なかったことで運動は崩壊した。テクノロジー界では、通常失敗した予言は静かに葬られ、先知たちは予定された期限が何度もずれても、楽観的で長期的な未来像を描き続けることが許容される(こんにちは、Elon)。しかし、継続的な改善による基礎モデルの性能向上がなければ、「スケーリングの法則」への信仰も同様に崩壊する可能性がある。

腐敗し、肥大化し、不安定になった宗教は、離反者に対して脆弱になる。プロテスタント改革が成功したのは、ルターの神学的主張だけではなく、カトリック教会が衰退と混乱の時期にあったからだ。主流の機関に亀裂が生じるとき、長らく「異端」とされてきた思想が突然、肥沃な土壌を得るのである。

人工知能の分野では、より少ない計算やデータで同程度の結果を出す小規模モデルや代替手法に注目すべきだろう。中国の企業系研究所やオープンソースチーム(Nous Researchなど)が行っている研究が該当する。生物的知能の限界を突破し、長らく克服不能とされていた障壁を乗り越える者たちが、新たなナラティブを生み出すかもしれない。

変化の始まりを観察する最も直接的でタイムリーな方法は、実務家の動向を追うことだ。正式な分裂の前には、宗教学者や神職者たちは通常、個人的には異端的見解を持ちながら、公には服従を装う。現代における対応現象は、表面的にはスケーリングの法則に従いつつも、裏ではまったく異なるアプローチを追求しているAI研究者たちだろう。彼らは適切なタイミングでコンセンサスに挑戦したり、研究所を去って理論的により広大な天地を求めるのを待っている。

宗教や技術的正統の厄介な点は、それらが一部は正しいものの、最も忠実な信奉者が考えるほど普遍的ではないことだ。宗教が人間の根本的真理を形而上学的枠組みに組み込むように、「スケーリングの法則」はニューラルネットワークの学習の現実を確かに描写している。問題は、この現実が現在の熱狂が示唆するように完全かつ不変なものかどうか、そしてこれらの宗教的機関(AI研究所)が、熱狂者たちを連れて前進できるほど柔軟かつ戦略的であるかどうかだ。同時に、知識を普及させる印刷機(チャットインターフェースやAPI)を構築し、知識の伝播を可能にすることも必要だ。

終焉

「宗教は一般大衆にとっては真実であり、賢者にとっては偽りであり、支配者にとっては有用である」――ルキウス・アンナエウス・セネカ

宗教的機関に対する一つの古びた見方は、一定規模に達すると、多くの人間組織と同様に、生存本能に屈し、競争の中で生き残ろうとするという点だ。その過程で、真理や偉大な動機(これらは互いに排他的ではない)を無視してしまう。

私はかつて、資本市場が物語駆動の情報カプセル(ニッチ)になる方法についての記事を書いた。インセンティブ構造はしばしばこうした物語の持続を助長する。「スケーリングの法則」に対するコンセンサスは、不気味なほどそれに似ている――数学的に洗練されており、大規模な資本配分の調整に極めて有効な、根深い信仰体系だ。多くの宗教的枠組みと同様に、それが基本的真理よりもむしろ調整機構としての価値が高い可能性がある。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News