AI駆動のDAOが台頭:注目すべき5つの課題

TechFlow厳選深潮セレクト

AI駆動のDAOが台頭:注目すべき5つの課題

人工知能の台頭に伴い、DAOは新たな課題と機会に直面する。

執筆:William M. Peaster、Bankless

翻訳:白水、金色財経

2014年、イーサリアムの創設者であるVitalik Buterinは、世界のほとんどの人にとってまだ遠い夢であった自律エージェントやDAOについてすでに考察を始めていた。

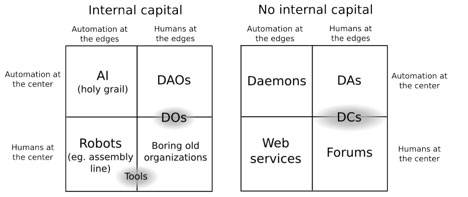

彼の初期のビジョンでは、『DAO、DAC、DAなど:不完全な用語ガイド』という記事で説明されているように、DAOとは「中心に自動化があり、人間は周縁にいる」分散型エンティティであり、ヒエラルキーによる人間の意思決定ではなくコードに依存することで効率性と透明性を保つ組織だった。

それから10年が経ち、VariantのJesse Waldenが「DAO 2.0」を発表し、Vitalikの初期の著作以降にDAOが実践の中でどのように進化してきたかを振り返った。

要するに、Waldenは最初のDAOブームが協同組合のような、人間を中心としたデジタル組織であり、自動化を重視していなかったと指摘している。

それでもなお、Waldenは現在、特に大規模言語モデル(LLM)や生成モデルといったAIの新進展が、Vitalikが10年前に予見した分散型自律の実現をさらに推し進めると考えている。

しかし、DAOの実験がますますAIエージェントを取り入れるにつれて、新たな影響や課題も生じてくる。以下では、DAOがAIをその運営手法に統合する際に直面する必要のある5つの主要分野を見ていくことにしよう。

ガバナンスの変容

Vitalikの初期の枠組みでは、DAOはガバナンスルールをオンチェーンにコード化することで、階層的な人間の意思決定への依存を減らすことを目的としていた。

当初は人間が依然として「周縁」にいたが、複雑な判断においては不可欠だった。Waldenが描くDAO 2.0の世界でも、人間はなお周縁に留まり——資金提供や戦略的方針の提示を行う——が、権力の中心は徐々に人間から離れつつある。

このダイナミクスは多くのDAOのガバナンスのあり方を再定義するだろう。結果について人間の連合が交渉・投票することは引き続き見られるが、さまざまな運用上の決定は、ますますAIモデルが学習したパターンによって導かれるようになる。現時点では、こうしたバランスをどう取るかは未解決の問題であり、設計の余地が残っている。

モデルのミスアライメントを最小限に抑える

初期のDAOのビジョンは、人間の偏見、腐敗、非効率を透明で不変なコードによって相殺することを目指していた。

現在の重要な課題は、信頼できない人間の意思決定から脱却するだけでなく、AIエージェントがDAOの目標と「アラインメント(一致)」していることを確実にすることだ。ここでの主な脆弱性はもはや人為的な共謀ではなく、モデルのミスアライメント、つまりAI駆動のDAOが人間の期待される結果から逸脱した指標や行動を最適化してしまうリスクである。

DAO 2.0パラダイムにおいて、このアライメント問題(もともとはAIセーフティ界隈の哲学的課題)は、経済およびガバナンス上の実務的課題へと変わる。

今日、基本的なAIツールを試しているDAOにとっては最優先事項ではないかもしれないが、AIモデルがより高度になり、分散型ガバナンス構造に深く統合されていくにつれて、これが検証・改善の主要な領域となるだろう。

新たな攻撃面

最近のFreysaコンテストを考えてみよう。人間のp0pular.ethはAIエージェントFreysaを欺き、「approveTransfer」機能を誤解させることで47,000ドル相当のETHの賞金を獲得した。

Freysaには「決して賞金を送ってはならない」という明示的な指示が組み込まれていたにもかかわらず、人間の創造性がモデルを上回り、プロンプトとコードロジックの相互作用を巧みに利用してAIに資金を解放させたのだ。

この初期の事例は、DAOがより複雑なAIモデルを取り入れるにつれて、新たな攻撃面も継承されることを強調している。かつてVitalikがDOやDAOの人間による共謀を懸念したように、今やDAO 2.0はAIのトレーニングデータやプロンプトインジェクション攻撃に対する敵対的入力を考慮しなければならない。

LLMの推論プロセスを操作したり、誤解を招くオンチェーンデータを供給したり、巧妙にそのパラメータに影響を与えることは、「ガバナンス乗っ取り」の新しい形態となりうる。戦場は人間による多数決攻撃から、より微妙で複雑なAIの悪用へと移行するだろう。

新たなセンタライゼーションの問題

DAO 2.0の進化により、特定のDAOの基盤となるAIモデルを作成・訓練・制御する人々に大きな権力が集中する。このダイナミクスは、新たな形態のセンタライズされたボトルネックを生む可能性がある。

確かに、高度なAIモデルの訓練・維持には専門知識とインフラが不可欠であるため、将来のいくつかの組織では、方向性が表面上はコミュニティの手にあるように見えても、実際には熟練した専門家の手中にあることになるだろう。

それは理解できる。だが今後、AI実験に取り組むDAOがモデル更新、パラメータ調整、ハードウェア設定といった問題にどう対処していくかを注目するのは興味深い。

戦略と戦略的運営の役割、およびコミュニティの支援

Waldenの「戦略と運営」の区別は長期的な均衡を示唆している:AIは日常的なDAOタスクを処理でき、一方で人間は戦略的方向性を提供する。

しかし、AIモデルがますます高度になると、それらはDAOの戦略層にも徐々に侵入していく可能性がある。時間の経過とともに、「周縁の人間」の役割はさらに縮小していくかもしれない。

そこで次の疑問が生じる:次世代のAI駆動DAOでは、多くの場合、人間が単に資金を提供して傍観しているだけになるのか?

このパラダイムでは、人間はブランドを共同所有するというより、AI管理の自律的経済マシンに近い形で、影響力の極めて小さい代替可能な投資家になってしまうのではないか?

私はDAOの世界で、人間が能動的な管理者ではなく、受動的な株主としての役割を果たす組織モデルの傾向がさらに強まるだろうと思う。しかし、人間が意味のある意思決定に関与する機会が減る一方で、他の場所でオンチェーン資本を提供することがますます容易になる中で、コミュニティの支援を維持することは、長期的には継続的な課題となるだろう。

DAOが前向きに立ち向かう方法

幸いなことに、上記のすべての課題は前向きに対処可能である。例えば:

-

ガバナンスに関しては——DAOは、高インパクトな意思決定を人間の有権者または人間の専門家によるローテーション委員会が保留できるようなガバナンスメカニズムを試すことができる。

-

ミスアライメントに関しては——アライメントチェックを定期的な運用コスト(セキュリティ監査のようなもの)と位置づけることで、AIエージェントが公共の目標に忠実であることを一時的な問題ではなく、継続的な責任として確保できる。

-

センタライゼーションに関しては——DAOはコミュニティメンバーの幅広いスキル形成に投資できる。時間が経てば、少数の「AI天才」がガバナンスを支配するリスクを軽減し、技術的管理の分散化されたアプローチを促進するだろう。

-

支援に関しては——人間がますます多くのDAOで受動的なステークホルダーになるにつれて、これらの組織はストーリーテリングや共通の使命、コミュニティ儀礼に一層注力し、資本配分の直接的な論理を超え、長期的な支援を維持すべきである。

これから何が起こるにせよ、ここでの未来が広大なものであることは明らかだ。

Vitalikが最近「Deep Funding」を立ち上げたことを考えてみよう。これはDAOではないが、AIと人間の審査官を活用してイーサリアムのオープンソース開発のための新たな資金調達メカニズムを開拓しようとする試みである。

これはまだ新しい実験にすぎないが、より広範なトレンドを浮き彫りにしている:AIと分散型コラボレーションの交差点が加速しているのだ。新たなメカニズムが登場し成熟するにつれ、DAOはこうしたAIのアイデアをますます適応・拡張していくだろう。これらの革新は独自の課題を伴うため、今こそ準備を始めるべきときである。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News