Tutoriel pour s’enrichir grâce à l’IA : commencez par créer du contenu explicite, puis vendez des cours

TechFlow SélectionTechFlow Sélection

Tutoriel pour s’enrichir grâce à l’IA : commencez par créer du contenu explicite, puis vendez des cours

Les désirs se vendent bien, mais il est difficile de répartir les responsabilités.

Auteur : Sha La Jiang

« Manger et faire l’amour sont des instincts fondamentaux. » La plupart des grands modèles économiques naissent de ce principe — et les technologies AIGC ne font pas exception.

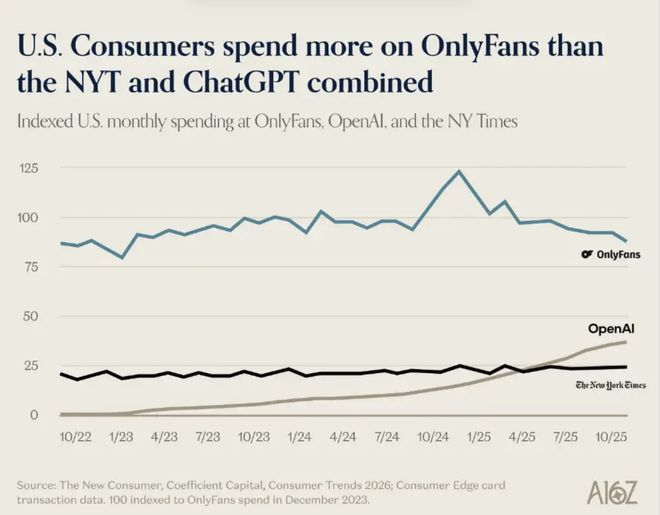

a16z, l’un des fonds de capital-risque les plus influents de la Silicon Valley, a publié un rapport consacré aux tendances de consommation liées à l’IA. Ce rapport, censé traiter sérieusement de la productivité offerte par l’IA, contient pourtant une courbe qui suscite à la fois le fou rire et la réflexion : en 2023, les utilisateurs américains ont dépensé davantage sur OnlyFans que sur OpenAI et le New York Times réunis.

Tableau extrait du rapport d’a16z

C’est ironique — et terriblement vrai : la productivité ne rivalise pas avec la tension sexuelle.

Alors, combien peut-on gagner grâce à l’IA dans les zones grises ?

Source image : Giphy

La productivité ne vaut pas la tension sexuelle

Les premiers créateurs de mannequins virtuels basés sur l’IA le savent mieux que personne.

Dès la fin de l’année 2022, lorsque des outils comme Midjourney et Stable Diffusion ont commencé à produire des images stables, certains ont immédiatement compris leur potentiel : ces systèmes permettent de générer des visages humains ultra-réalistes, en masse, à coût quasi nul. Ils ont donc créé des personnages féminins virtuels, leur ont attribué un nom, une personnalité fictive et quelques publications « quotidiennes » soigneusement rédigées, puis les ont fait évoluer sur Instagram et TikTok sous couvert d’identités réelles. Les réponses intimes envoyées en messagerie privée étaient quant à elles automatisées via ChatGPT, offrant ainsi une « expérience de petite amie ». L’ensemble du processus était presque entièrement automatisé, sans qu’il soit nécessaire pour l’opérateur de se montrer.

Source image : Giphy

Ce modèle fonctionne particulièrement bien sur Fanvue, une plateforme concurrente d’OnlyFans. Fanvue adopte une approche plus souple à l’égard des contenus générés par IA : selon ses propres chiffres, les mannequins virtuels basés sur l’IA ont représenté 15 % des revenus totaux de la plateforme en novembre 2023. En 2024, les principaux mannequins virtuels IA généraient régulièrement plus de 20 000 dollars par mois ; certains comptes bien structurés dépassaient déjà les 200 000 dollars annuels. En 2025, ce chiffre continue de croître : selon Will Monange, PDG de Fanvue, les revenus globaux des créateurs IA sur la plateforme ont augmenté de plus de 60 % par rapport à la même période en 2024, faisant des mannequins virtuels la catégorie de contenu à la croissance la plus rapide.

OnlyFans interdit officiellement les contenus générés par IA, mais certains trouvent toujours des moyens de contourner cette règle. Sur Reddit, on trouve fréquemment des discussions sur les techniques permettant de tirer profit de l’IA tout en restant dans les zones grises d’OnlyFans — notamment en recrutant une femme réelle pour valider l’identité sur la plateforme, puis en entraînant un modèle IA à partir de ses photos afin de produire massivement du contenu.

Source image : Giphy

Même les politiques strictes des plateformes ne résistent pas à la progression technologique : aujourd’hui, les images générées par IA sont si réalistes qu’elles trompent même les observateurs les plus expérimentés. Il y a peu, j’ai vu sur Xiaohongshu une vidéo d’un jeune homme séduisant assis dans une voiture — je n’ai réalisé qu’il s’agissait d’un personnage IA qu’en lisant le commentaire épinglé : « Ce goût est vraiment excellent chez cet IA. »

En dehors du domaine des contenus pour adultes, une autre vague d’entrepreneurs a également réussi à générer des revenus grâce à l’IA — mais dans une direction radicalement différente : les livres illustrés pour enfants.

Zhao Lei (nom d’emprunt) figure parmi les premiers entrés sur ce marché. À la fin de l’année 2022, il venait d’être licencié d’un poste de chef de produit dans une grande entreprise technologique et cherchait activement une nouvelle voie. À cette époque, Midjourney commençait tout juste à produire des images fiables. En observant les petits animaux générés dans un style aquarelle, il eut soudain une idée : « Cela ressemble exactement aux illustrations d’un livre pour enfants ! » Il passa deux semaines à étudier Amazon KDP, avec une logique d’une simplicité déconcertante : ChatGPT rédige l’histoire, Midjourney fournit les illustrations, on met en page et on publie — puis on attend les revenus. « À l’époque, c’était vraiment très rentable », raconte-t-il. « Avec seulement quelques titres, on pouvait générer plus de 10 000 yuans de revenus passifs par mois. »

Mais cette fenêtre d’opportunité ne resta ouverte que peu de temps. À partir de la deuxième moitié de 2023, les livres illustrés générés par IA se sont multipliés exponentiellement sur KDP, tandis que TikTok voyait apparaître près de 90 000 tutoriels similaires, tous portant des titres identiques : « EASY AI Money », « Gagnez 100 000 yuans par mois grâce aux livres pour enfants générés par IA ».

Tout le monde s’est rué sur la même piste, diluant rapidement les ventes. Les problèmes de qualité sont alors apparus au grand jour : dinosaures dotés de pattes avant gigantesques, enfants dessinés avec un nombre erroné de doigts… Les grandes plateformes ont commencé à exiger, lors de la publication, une déclaration explicite indiquant si l’IA avait été utilisée ou non — scellant ainsi, en pratique, la fin de cette filière. « Aujourd’hui, gagner de l’argent grâce aux livres illustrés générés par IA est devenu extrêmement difficile », confirme Zhao Lei.

Il a alors rejoint, sans concertation préalable, les autres acteurs de l’IA dans les zones grises — vers une destination commune : la vente de formations (sur ce point, le phénomène récent « Homard » a poussé la stratégie à son paroxysme).

Source image : Giphy

Zhao Lei vend une formation intitulée « Du zéro à la publication : guide complet pour créer des livres illustrés avec l’IA », tandis que les créateurs de mannequins virtuels proposent des tutoriels sur « la construction d’un mannequin virtuel IA ». Ceux qui achètent ces formations sont les nouveaux venus, qui viennent tout juste d’entendre parler de ces opportunités et croient encore que la fenêtre reste ouverte.

Deux secteurs, deux contenus différents, deux emballages distincts — mais un seul et même produit : l’illusion qu’« on peut aussi réussir, comme un cochon qui prend son envol ».

L’esthétique et les « anciennes compétences » bloquent bon nombre de personnes

Ces activités, qui semblent offrir une manne facile au cœur d’une tendance porteuse, comportent-elles réellement des barrières à l’entrée ?

Une amie, conceptrice UX dans le secteur internet, m’a donné une réponse : les restrictions géographiques d’accès aux services et les frais d’abonnement. Dès la sortie de Midjourney, elle a rédigé un manuel d’utilisation, vendu 99 yuans l’exemplaire, toujours disponible aujourd’hui sur Xiaohongshu comme source de revenus passifs. Du point de vue de l’utilisation des outils, son analyse est pertinente — la barrière technique baisse effectivement très rapidement.

Mais en tant que personne dont les compétences en dessin se limitent à des bâtonnets, et qui obtient régulièrement des résultats médiocres avec divers outils AIGC, je dois compléter son analyse en mentionnant un autre obstacle : le sens esthétique.

Source image : Giphy

Autrefois, on plaisantait en disant que l’IA ne remplacerait jamais les designers, car les clients ne savaient pas eux-mêmes ce qu’ils voulaient. Je pensais que c’était une simple blague — jusqu’à ce que j’utilise moi-même ces outils, et découvre que cette boutade s’appliquait à la lettre à mon cas.

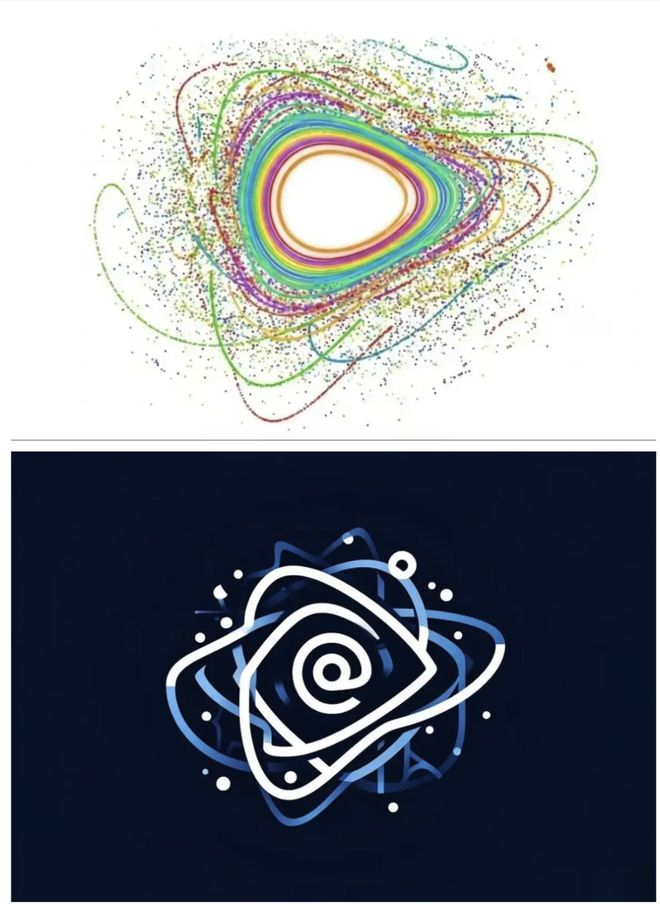

L’an dernier, j’ai lancé un compte média et souhaitais utiliser le concept physique de « île intégrable » comme base pour mon logo. Une « île intégrable » désigne, dans le flot chaotique de l’information, les éléments dignes d’être conservés durablement. J’ai rassemblé des références visuelles de ce concept, ouvert l’outil, y ai importé ces images, puis rédigé une longue série de prompts descriptifs — avant de lancer la génération. Le résultat fut un fouillis total. Après sept ou huit itérations, chaque version n’était qu’une variante différente du chaos. Je sentais vaguement ce que je voulais, mais je ne savais absolument pas comment traduire cette impression en instructions précises. Finalement, j’ai dû demander l’aide d’un ami designer, qui, en vingt minutes, a produit une version d’un tout autre niveau que mes deux heures d’efforts infructueux.

Image supérieure : avant modification ; image inférieure : après modification

Le problème ne vient pas de l’outil — il vient de moi. Plus précisément, il réside dans mon incapacité à transformer une impression esthétique floue en langage précis.

Ce blocage n’est pas propre à moi.

Une amie spécialiste du marketing de contenu a commencé l’année dernière à utiliser Seedance pour produire des courtes vidéos. Elle a rapidement maîtrisé l’outil lui-même, mais ce qui l’a véritablement freinée, c’est la rédaction des storyboards. « Je sais que je veux une image “de qualité”, mais le mot “qualité” ne signifie strictement rien dans un prompt », explique-t-elle. « Je ne sais pas concrètement quelle lumière, quel cadrage ou quel mouvement de caméra cela implique. » Le résultat final, selon ses propres termes, est « un peu ressemblant, mais quelque part faux ».

Un autre ami utilise Marble, un outil capable de générer des images 3D à partir de texte ou d’images. Il a généré, rejeté, recommencé plusieurs fois, avant de réaliser qu’il ne disposait d’aucun cadre de référence — il ne savait pas à quoi ressemblait une « bonne » image, et ne pouvait donc pas juger si le résultat généré correspondait à ses attentes.

Vue panoramique d’une image 3D générée par Marble

En revanche, un ami photographe obtient, avec les mêmes outils, des résultats nettement supérieurs. « Je n’ai pas passé beaucoup de temps à étudier les techniques avancées de rédaction de prompts », dit-il. « Je sais simplement quel cadrage et quelle lumière je veux — et quand je le formule clairement, l’outil me donne exactement ce que je cherche. »

Les capacités des outils progressent rapidement, mais les écarts entre utilisateurs ne se réduisent pas pour autant — ils se creusent même, dans une certaine mesure. Avant, personne ne parvenait à produire de bons résultats ; aujourd’hui, ceux qui possèdent une culture esthétique accumulée peuvent obtenir d’excellents résultats, tandis que les autres oscillent encore entre « fonctionnel » et « agréable à utiliser ».

Les outils eux-mêmes réagissent à cette réalité. Le succès de solutions comme NotebookLM — qui proposent des modèles prédéfinis — repose sur une logique simple : elles évitent la condition préalable « vous devez savoir ce que vous voulez ». Le modèle prend les décisions esthétiques à votre place ; vous n’avez qu’à fournir le contenu. Mais ce modèle présente aussi une limite intrinsèque : il résout le problème de la « fonctionnalité », pas celui de la « beauté ».

Cette dynamique se retrouve de façon tout aussi claire dans le domaine de la rédaction. Une amie chargée de marketing stratégique a récemment été affectée à la gestion des relations publiques (RP), et doit désormais produire de nombreux textes. Son supérieur lui a dit qu’elle pouvait utiliser l’IA — ce qui l’a rendue encore plus perdue. Elle m’a contacté pour récupérer un guide que j’avais rédigé auparavant sur la rédaction assistée par IA. Le nœud du problème ? Elle ne ressent pas ce qu’est « un bon communiqué RP » : elle ignore les critères de qualité, et ne sait donc pas dans quelle direction orienter les corrections apportées aux textes générés par IA.

Source image : Giphy

Pour ma part, j’utilise l’IA pour écrire avec beaucoup plus d’aisance — non pas parce que je maîtrise mieux les outils, mais parce que, après des années de journalisme écrit, j’ai développé un sens aigu de l’expression : je sais pourquoi une phrase fonctionne, où elle sonne faux, et surtout, je distingue immédiatement les faiblesses d’un texte généré par IA — et donc, vers où le pousser. Ici, l’esthétique devient une capacité concrète et opérationnelle : elle me montre la cible, plutôt que de laisser l’IA tourner en boucle sans but.

Quand les capacités des outils cessent d’être un frein, l’esthétique et les « anciennes compétences » deviennent la barrière la plus élevée — et utiliser mal l’IA peut même être pire que de ne pas l’utiliser du tout.

Je veux du sexy — est-ce que ça change quelque chose, que ce soit de l’IA ou un humain ?

Les premiers à saisir les opportunités ne récoltent pas seulement des bénéfices — ils suscitent aussi la controverse. Dans le milieu actuel de l’AIGC, une situation paradoxale émerge : l’usage ou non de l’IA devient plus important que la qualité du travail produit.

Fang Yuan (nom d’emprunt) est designer graphique spécialisé dans l’identité de marque. Il a récemment mené à bien un projet de conception visuelle en trois jours grâce à des outils IA — un délai réduit de moitié par rapport aux deux semaines habituelles. Il estime personnellement que le résultat est même meilleur que ceux produits précédemment. Il envoie le travail au client, puis attend la réponse.

La première réaction du client n’est pas un commentaire sur le travail, mais une question : « Si c’est si rapide, vous avez utilisé l’IA, n’est-ce pas ? » Fang Yuan n’a pas eu le temps de répondre que le client ajoute aussitôt : « Nous n’acceptons pas les œuvres de design impliquant l’IA. » Il ne sait toujours pas si le client a ouvert les fichiers joints. Il est consterné : la haute efficacité est devenue une faute.

Source image : Giphy

Il n’est pas le seul dans cette situation. Pour beaucoup, l’IA s’est insidieusement transformée en un critère moral implicite d’évaluation. Ce n’est pas comme Photoshop ou Excel : personne ne demande, en recevant une photo retouchée, « Avez-vous utilisé un logiciel de retouche ? », ni, en recevant un rapport financier, « Avez-vous utilisé Excel ? »

L’IA déclenche une forme différente de suspicion — une interrogation plus proche de : « Avez-vous vraiment accompli ce travail ? »

Dans le domaine créatif, existe depuis longtemps un pacte implicite : une œuvre de qualité suppose qu’un être humain y a investi temps, énergie et patience. L’apparition de l’IA vient briser précisément la ligne causale tacite reliant « effort » et « résultat ».

Quand vous produisez en trois jours une œuvre comparable, en qualité, à celle que quelqu’un aurait réalisée manuellement en deux semaines, quelque chose semble « ne pas aller ». Ce malaise peut se résumer en un seul mot : « injustice ».

Une étude menée par l’université de l’Arizona a montré que, lorsque les designers annoncent spontanément avoir utilisé l’IA comme aide, même en précisant qu’il ne s’agit que d’un support, la confiance des clients diminue en moyenne de 20 %.

Et à mesure que les technologies AIGC mûrissent, ce problème évolue, passant d’un enjeu de confiance individuelle entre client et prestataire à un enjeu systémique impliquant les plateformes.

À partir de 2023, les autorités chinoises ont progressivement mis en place des réglementations exigeant l’étiquetage des contenus générés par IA : d’abord, en janvier, le « Règlement sur la gestion des synthèses profondes dans les services d’information Internet », qui encadre principalement les technologies de deepfake (remplacement de visages, synthèse vocale, etc.) ; puis, en août de la même année, la « Méthode provisoire sur la gestion des services d’intelligence artificielle générative », qui étend le champ d’application aux services génératifs tels que ChatGPT. En mars 2025, la régulation s’est renforcée encore : l’Administration d’État de la Cybersécurité et des Informations (CAC), en collaboration avec plusieurs départements, a publié la « Méthode sur l’identification des contenus générés ou synthétisés par IA », couvrant désormais l’ensemble des formats — texte, image, audio et vidéo.

Mais aucune réglementation ne peut tracer avec précision la frontière entre ce qui relève de la création humaine et ce qui relève de la génération par IA.

Les plateformes peuvent identifier une vidéo entièrement générée par IA, mais elles peinent à trancher dans les cas limites : une photo de soi, retouchée par IA (couleur, cadrage), constitue-t-elle un « contenu généré par IA » ? Une vidéo composée de rushs personnels, mais dont le montage et la bande-son ont été entièrement confiés à l’IA, doit-elle être étiquetée ? Un article rédigé initialement par IA, puis réécrit à 70 % par un humain — à qui revient l’étiquette ?

Source image : Giphy

Derrière cette difficulté à définir des frontières claires se cache en réalité une question de responsabilité. Sans définition précise, la responsabilité n’a aucun ancrage. Si la mélodie d’un titre est composée par IA et les paroles réécrites par un humain, qui assume la responsabilité en cas de litige sur les droits d’auteur ? Ou encore, si un avis critique est généré par IA et que le blogueur n’y a modifié que le ton, mais que le produit recommandé s’avère décevant, notre question « Est-ce que c’est de l’IA ? » exprime en réalité une interrogation plus fondamentale : derrière cette œuvre, y a-t-il réellement une personne qui en assume la responsabilité ? Quelqu’un qui réfléchit à vos besoins ? Quelqu’un qui se soucie de la qualité du résultat ?

Ce qui est le plus difficile à définir, ce n’est pas la frontière — c’est la responsabilité.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News