Point de vue : Dans la ruée vers l’or de l’IA, la logique du « vendeur de pelles » n’est plus valable.

TechFlow SélectionTechFlow Sélection

Point de vue : Dans la ruée vers l’or de l’IA, la logique du « vendeur de pelles » n’est plus valable.

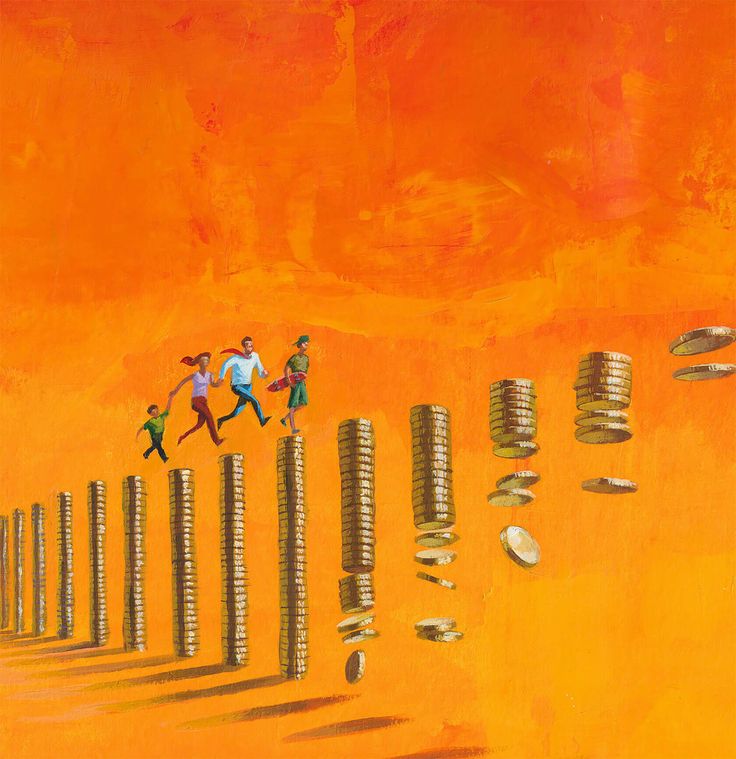

Les entreprises d’IA véritablement pérennes ne sont pas celles qui vendent des outils, mais celles qui utilisent l’IA comme une matière première dans des domaines verticaux spécialisés — de véritables « artisans bijoutiers ».

Auteur : Ben Basche

Traduction : TechFlow

Introduction de TechFlow : « Pendant la ruée vers l’or, vendez des pelles » était autrefois une règle d’or dans le monde des startups. Mais à l’ère de l’IA, cette logique ne tient plus : les chercheurs d’or ouvrent désormais eux-mêmes des quincailleries. OpenAI, Anthropic et Google absorbent systématiquement les couches intermédiaires, les assistants de programmation, l’automatisation des navigateurs, etc. Selon Ben Basche, les entreprises IA capables de survivre durablement ne sont pas celles qui vendent des outils, mais celles qui utilisent l’IA comme matière première dans des domaines verticaux précis — des « orfèvres » capables de plonger profondément dans un secteur spécifique, de maîtriser les savoirs locaux et de disposer d’un contexte non reproductible.

Texte intégral :

Une phrase est devenue un mantra dans la communauté des startups avant et après la première bulle Internet : « Pendant la ruée vers l’or, vendez des pelles et des pioches. » Autrefois, ce n’étaient pas les chercheurs d’or qui faisaient fortune, mais ceux qui leur fournissaient leurs outils. C’est Levi Strauss, et non les prospecteurs, qui a amassé une fortune.

Ce cadre était pertinent. Il a fonctionné efficacement pendant un certain temps.

Mais dans le domaine de l’IA, il est faux. Si votre entreprise repose sur cette logique, vous devriez sérieusement examiner ce qui s’est produit au cours des douze derniers mois.

Le laboratoire est toute la pile technologique

Voici ce qui s’est réellement produit — d’abord discrètement, puis soudainement et massivement.

OpenAI a lancé Operator, un agent informatique capable de naviguer sur le Web, de remplir des formulaires et d’exécuter des tâches de bout en bout. Puis sont arrivés l’API Responses et le SDK Agents, permettant aux développeurs d’accéder nativement aux capacités d’appel d’outils, de mémoire et d’orchestration, sans dépendre de frameworks tiers. Suivent Codex, un agent de programmation cloud autonome capable d’écrire, tester et itérer des logiciels, ainsi que Deep Research. Chacun de ces produits aurait suffi, il y a deux ans, à justifier le financement d’une startup.

Anthropic a lancé Claude Code, Computer Use, Projects avec mémoire persistante, et le MCP (Model Context Protocol) — devenu quasi instantanément la norme dominante pour connecter les modèles IA aux outils externes et aux données. Ensuite, Anthropic a transféré le MCP à la Linux Foundation afin d’en faire une infrastructure plutôt qu’un produit commercial. Enfin, Claude in Excel, Claude in Chrome et Cowork ont été annoncés.

Google a lancé Gemini 2.0, doté nativement de capacités d’appel d’outils et de perception multimodale, intégré à Vertex AI comme plan de contrôle d’agents destiné aux entreprises, offrant dès l’ouverture des fonctions de stratégie et d’orchestration à l’échelle organisationnelle.

Chacune de ces initiatives empiète directement sur un terrain autrefois occupé par des startups.

La logique de la « vente de pelles » repose sur une hypothèse implicite : les laboratoires resteraient cantonnés à leur propre domaine — développer des modèles fondamentaux, fournir des API, et laisser aux écosystèmes les couches d’outils, d’orchestration et d’applications. Cette hypothèse est morte.

Le massacre des intergiciels

Examinons concrètement ce qui s’est passé au niveau de la couche intergicielle.

LangChain fut, en 2023, la quintessence de la stratégie « vente de pelles » dans la vague IA. Cadre d’orchestration permettant de chaîner les appels aux modèles de langage, de connecter des outils et de gérer la mémoire. Des milliers d’équipes l’ont utilisé pour construire leurs produits ; son dépôt GitHub compte plus de 100 000 étoiles. En 2024, de nombreuses équipes ont commencé à publier des billets expliquant pourquoi elles retiraient LangChain de leurs environnements de production. Pas parce qu’il était mauvais, mais parce que les modèles sous-jacents étaient devenus assez intelligents pour s’en passer. La couche d’abstraction construite par LangChain résolvait les problèmes d’hier.

Pendant ce temps, OpenAI lançait son propre SDK Agents. Microsoft sortait AutoGen et Semantic Kernel. Les laboratoires et leurs sociétés mères n’ont pas racheté LangChain. Ils se sont simplement mis à intégrer nativement, dans leurs plateformes, les fonctionnalités que LangChain proposait.

Le même scénario se répète à chaque niveau : cadres d’agents, outils de gestion des prompts, pipelines RAG, cadres d’évaluation, outils d’observabilité. Tous sont progressivement absorbés dans les produits natifs des éditeurs de modèles sous-jacents.

L’aspect cruel de la situation réside dans le fait que, lorsque OpenAI ou Anthropic intègrent nativement des capacités d’orchestration à leurs API, ils n’ont pas besoin de battre leurs concurrents sur le plan fonctionnel. Il leur suffit d’être « suffisamment bons » et « déjà présents ». Les développeurs suivent naturellement le chemin de moindre résistance. Une startup spécialisée dans un intergiciel ingénieux doit alors non seulement surpasser nettement ses concurrents, mais aussi maintenir cet avantage face à l’évolution constante des modèles — tout en rivalisant avec des acteurs disposant de capitaux illimités et contrôlant l’infrastructure sous-jacente. Ce n’est pas une entreprise : c’est un projet de recherche soumis à une horloge.

Les chercheurs d’or ouvrent leur propre quincaillerie — les pelles ne se vendent plus

La métaphore de la « vente de pelles » échoue fondamentalement dans le domaine de l’IA en raison d’une différence structurelle cruciale. En 1849, Levi Strauss et les autres marchands de quincaillerie ne cherchaient pas eux-mêmes de l’or. Chercheurs d’or et fournisseurs étaient des acteurs indépendants, aux intérêts séparés.

Dans le domaine de l’IA, les laboratoires creusent l’or, vendent les pelles, construisent les routes et dessinent les cartes. Ils ont tout intérêt à contrôler l’ensemble de la pile technologique : chaque couche supplémentaire contrôlée représente un point de verrouillage, une opportunité d’expansion des marges et un fossé de distribution.

Le don du protocole MCP par Anthropic à la Linux Foundation n’était pas un acte de philanthropie. Il s’agissait de faire en sorte qu’une norme conçue par Anthropic devienne une infrastructure universelle — à l’instar de l’Ethernet. Les normes constituent la défense la plus puissante dans le secteur technologique, car elles sont invisibles et permanentes.

Ainsi, si la proposition de valeur de votre startup repose sur l’idée suivante : « Nous nous positionnons entre les développeurs et les modèles pour simplifier la réalisation de X », vous devez accepter un fait : l’entité située entre vous et vos clients vous a remarqué, dispose des ressources nécessaires pour vous copier, et possède des raisons structurelles impérieuses de le faire.

Alors, quoi fonctionne vraiment ?

Revenons à la métaphore de la ruée vers l’or. Si les pelles ne se vendent plus, que faut-il vendre ?

Vendez des bijoux.

Ou mieux encore : utilisez l’or comme matière première industrielle pour fabriquer des objets dans lesquels les chercheurs d’or n’ont aucun intérêt.

Dans la véritable ruée vers l’or de 1849, les entreprises ayant survécu à la période de prospérité n’étaient pas celles vendant des outils génériques. Elles étaient celles qui transformaient l’or en matériau brut pour créer des produits spécialisés, grâce à une expertise approfondie. Orfèvres, dentistes, puis ingénieurs électriciens : tous possédaient une compréhension si fine d’un cas d’usage spécifique qu’elle était inaccessible aux généralistes.

La version IA consiste à construire des applications dans des domaines verticaux exigeant un contexte réel du monde physique — un contexte que les laboratoires ne possèdent pas et ne peuvent pas facilement acquérir.

Interrogez-vous sur ce que OpenAI, Anthropic et Google ne font structurellement pas bien :

Ils ne connaissent pas en profondeur les flux de travail propres à votre secteur. Ils n’ont aucune relation avec vos clients. Ils ne peuvent pas accéder à moindre coût aux données privées qui rendent un modèle réellement performant dans un contexte spécifique. Ils ne se pencheront jamais sur les raisons pour lesquelles un artisan sud-africain émet ses factures d’une manière particulière, ni sur les complexités inhérentes à l’intégration des paiements mobiles au Kenya, ni sur les difficultés spécifiques, opérationnelles et profondément ancrées liées à l’autorisation préalable des soins médicaux aux États-Unis.

Les laboratoires construisent des infrastructures horizontales. L’opportunité réside dans les domaines verticaux — ceux qui exigent des connaissances locales géographiques, réglementaires, culturelles et sectorielles pour fonctionner réellement.

C’est pourquoi les fintech émergentes, les solutions juridiques IA adaptées à des juridictions spécifiques, les outils de conformité destinés aux secteurs réglementés, ou encore l’automatisation des workflows dans des niches professionnelles spécialisées sont bien plus défensives que « construire une meilleure version de LangChain ».

Le fossé de protection ne réside pas dans le modèle. Il réside dans le contexte.

L’usage industriel de l’or

Cette idée comporte une deuxième version, également essentielle à comprendre : utiliser l’IA comme on utilise l’or dans l’industrie — non pas comme réserve de valeur ou objet d’exposition, mais comme composant intégré dans des systèmes créant une valeur économique durable.

La conductivité électrique de l’or est presque inégalée. Ainsi, chaque carte électronique en contient. Personne n’en parle, personne ne le met en avant dans ce contexte. Il agit silencieusement comme entrée critique au sein d’un système plus vaste.

Les entreprises IA les plus durables en cours de construction aujourd’hui considèrent les modèles comme des composants — une entrée permettant de résoudre un problème réel — plutôt que comme le produit lui-même. L’IA est l’or dans la carte électronique, pas l’or dans la vitrine.

Concrètement, cela signifie choisir un domaine marqué par de véritables points douloureux, une réelle complexité des flux de travail et des données difficiles d’accès, puis concevoir un produit dont la performance est significativement améliorée par l’intégration d’un modèle. L’IA est un détail d’implémentation ; le produit est celui qui remplace un processus manuel source de souffrance.

Cela s’oppose diamétralement à l’approche « Nous avons ajouté une simple interface autour de GPT-4 ». L’interface est la vitrine ; la carte électronique est invisible.

Des segments récemment éliminés

Pour être plus précis, voici les catégories de startups que les laboratoires absorbent systématiquement depuis la fin 2024 :

Cadres d’orchestration d’agents. Devenus fonctionnalités natives de OpenAI Agents SDK, de la chaîne d’outils d’Anthropic et de Google Vertex Agent Builder.

Assistants IA pour la programmation. Codex d’OpenAI peut désormais effectuer une programmation autonome à l’échelle d’un dépôt entier. Claude Code offre des capacités similaires. GitHub Copilot est la solution native de Microsoft. Le segment des assistants de programmation indépendants est fortement réduit.

Automatisation des navigateurs et des ordinateurs. Operator d’OpenAI, Computer Use d’Anthropic et Gemini Astra de Google. Les trois principaux laboratoires disposent désormais de produits dans ce domaine. Toutes les startups utilisant des modèles de langage pour l’automatisation robotique des processus (RPA) sont en mode défensif.

Pipelines RAG et outils de recherche vectorielle. Ces technologies sont largement banalisées. La plupart des API de modèles intègrent désormais nativement des capacités de recherche. La différenciation au niveau des frameworks a disparu.

Assistants IA généralistes et outils d’efficacité. Directement absorbés par Claude, ChatGPT et Gemini.

Outils de gestion des prompts et d’évaluation. De plus en plus intégrés nativement. LangSmith conserve encore une marge limitée, mais elle court contre la montre.

Le schéma est extrêmement cohérent : dès qu’un laboratoire identifie une catégorie suscitant un intérêt notable chez les développeurs et juge qu’elle est étroitement liée à son produit central, il lance sa propre version. Elle n’a pas besoin d’être supérieure, mais elle est intégrée, moins coûteuse par défaut, et bénéficie d’une capacité de distribution que les startups ne peuvent égaler.

Que faire maintenant ?

Si vous lancez une startup IA aujourd’hui, la question à vous poser n’est pas « Y a-t-il une demande ? » La demande est partout. La vraie question est : « Ce produit pourrait-il être éliminé d’un seul coup par une publication produit d’un laboratoire disposant de plus de 10 milliards de dollars de capital ? »

Si la réponse est « oui », ou même « probablement », ce n’est pas une entreprise : c’est une fonctionnalité.

Les stratégies durables présentent les caractéristiques suivantes : une forte spécificité verticale (les laboratoires peuvent construire des solutions générales, mais pas celle que vous proposez), des données privées ou des relations non reproductibles par simple collecte sur le Web public, une complexité réglementaire et de conformité rendant insuffisante la simple utilisation directe d’une API, et des canaux de distribution dans des communautés où la confiance et le contexte local comptent davantage que les capacités brutes.

La ruée vers l’or est bien réelle. L’or est partout. Mais les chercheurs d’or ouvrent désormais leurs propres boutiques — et ils le font avec des capitaux illimités.

Vendez des bijoux. Utilisez l’or comme matière première industrielle. Créez des choses qui n’intéressent pas les chercheurs d’or — parce qu’elles sont trop spécialisées, trop localisées, trop profondément ancrées dans des savoirs sectoriels qu’ils ne posséderont jamais.

C’est, selon moi, la bonne stratégie.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News