La religion amère : la croisade de l'intelligence artificielle autour de la loi d'expansion

TechFlow SélectionTechFlow Sélection

La religion amère : la croisade de l'intelligence artificielle autour de la loi d'expansion

La communauté de l'intelligence artificielle est plongée dans un débat sur son avenir et sur la question de savoir s'il existe une échelle suffisante pour créer la doctrine de Dieu.

Rédaction : Mario Gabriele

Traduction : Block unicorn

La croisade de l’intelligence artificielle

Je préfère vivre ma vie comme si Dieu existait, puis découvrir à la mort qu’il n’existe pas, plutôt que de vivre comme s’il n’existait pas, pour mourir et découvrir qu’il existe. — Blaise Pascal

La religion est une chose curieuse. Peut-être parce qu’elle ne peut être prouvée dans aucune direction, ou peut-être simplement parce que, comme l’une de mes citations préférées le dit : « On ne peut pas combattre les émotions avec des faits. »

La caractéristique de la croyance religieuse est qu’en montant en intensité, elle s’accélère à une vitesse incroyable, au point qu’il devient presque impossible de douter de l’existence de Dieu. Quand tout autour de vous croit fermement, comment pourriez-vous remettre en question une présence divine ? Quand le monde se réorganise autour d’un dogme, où place reste-t-il pour l’hérésie ? Et quand temples et cathédrales, lois et normes sont tous réarrangés selon un nouvel évangile inébranlable, quel espace subsiste pour l’opposition ?

Lorsque les religions abrahamiques ont émergé pour la première fois et se sont propagées aux continents, ou lorsque le bouddhisme s’est étendu depuis l’Inde vers toute l’Asie, cette puissante dynamique de croyance a créé un cercle vertueux auto-renforçant. À mesure que davantage de personnes se convertissaient et que des systèmes théologiques complexes et des rituels étaient établis autour de ces croyances, remettre en cause les fondements mêmes devenait de plus en plus difficile. Dans un océan de crédulité, il n’est guère aisé de devenir hérétique. Les majestueuses cathédrales, les textes sacrés élaborés et les monastères prospères servaient tous de preuves tangibles de l’existence du divin.

Mais l’histoire des religions nous enseigne aussi combien ces structures peuvent facilement s’effondrer. Lorsque le christianisme s’est répandu en Scandinavie, les anciennes croyances nordiques se sont effondrées en seulement quelques générations. Le système religieux de l’Égypte antique a duré des millénaires avant de disparaître face à l’émergence de nouvelles croyances plus durables et soutenues par des structures de pouvoir plus grandes. Même à l’intérieur d’une même religion, nous avons assisté à des ruptures dramatiques : la Réforme a déchiré le christianisme occidental, tandis que le Grand Schisme a séparé les Églises orientale et occidentale. Ces divisions commencent souvent par des divergences doctrinales apparemment mineures, qui finissent par évoluer vers des systèmes de croyance entièrement distincts.

Les Saintes Écritures

Dieu est une métaphore au-delà de tous les niveaux de pensée intellectuelle. C’est aussi simple que cela. — Joseph Campbell

En somme, croire en Dieu, c’est la religion. Et peut-être créer Dieu n’est-ce pas bien différent.

Depuis sa naissance, les chercheurs optimistes en intelligence artificielle (IA) ont conçu leur travail comme une forme de création divine — la création de Dieu. Ces dernières années, l’essor fulgurant des grands modèles linguistiques (LLMs) a renforcé chez les fidèles la conviction qu’ils sont sur une voie sacrée.

Cela a également confirmé un article de blog écrit en 2019. Bien que peu connu en dehors du domaine de l’IA jusqu’à récemment, « La leçon amère », publié par le scientifique canadien en informatique Richard Sutton, est devenu un texte de plus en plus central pour la communauté, passant d’un savoir ésotérique à une base quasi-religieuse pour une nouvelle foi universelle.

En 1 113 mots (chaque religion a besoin de chiffres sacrés), Sutton résume une observation technique : « La plus grande leçon tirée de 70 ans de recherche en IA est que les méthodes générales exploitant le calcul s’avèrent à terme les plus efficaces, et de loin. » Les progrès des modèles d’IA bénéficient d’une augmentation exponentielle des ressources informatiques, surfant sur la vague immense de la loi de Moore. En parallèle, Sutton souligne que beaucoup d’efforts en IA se concentrent sur l’optimisation via des techniques spécialisées — intégrant des connaissances humaines ou des outils étroits. Bien que ces optimisations soient utiles à court terme, elles sont, selon lui, une perte de temps et de ressources, comparables à régler les ailerons d’un surfboard ou essayer une nouvelle cire alors qu’une énorme vague approche.

Tel est le fondement de ce que nous appelons la « religion amère ». Elle n’a qu’un seul commandement, souvent désigné dans la communauté comme la « loi d’extension » : l’augmentation exponentielle du calcul améliore les performances ; tout le reste est inepte.

La religion amère s’étend maintenant rapidement, passant des grands modèles linguistiques (LLMs) aux modèles du monde, puis à la biologie, à la chimie et à l’intelligence incarnée (robotique et véhicules autonomes), autant de temples encore non convertis.

Cependant, avec la propagation de la doctrine de Sutton, les définitions évoluent aussi. Signe de toute religion vivante et active : débats, interprétations, annotations. La « loi d’extension » ne signifie plus simplement agrandir le calcul (l’arche n’était pas qu’un bateau), elle englobe désormais diverses méthodes visant à améliorer les performances des transformeurs et du calcul, y compris certaines astuces.

Le canon inclut désormais toutes les tentatives d’optimiser chaque partie de la pile IA, allant des astuces appliquées directement au modèle principal (fusion de modèles, mélange d’experts (MoE), distillation de connaissances), jusqu’à la génération de données synthétiques pour nourrir ces dieux toujours affamés, accompagnées d’innombrables expériences.

Les sectes en conflit

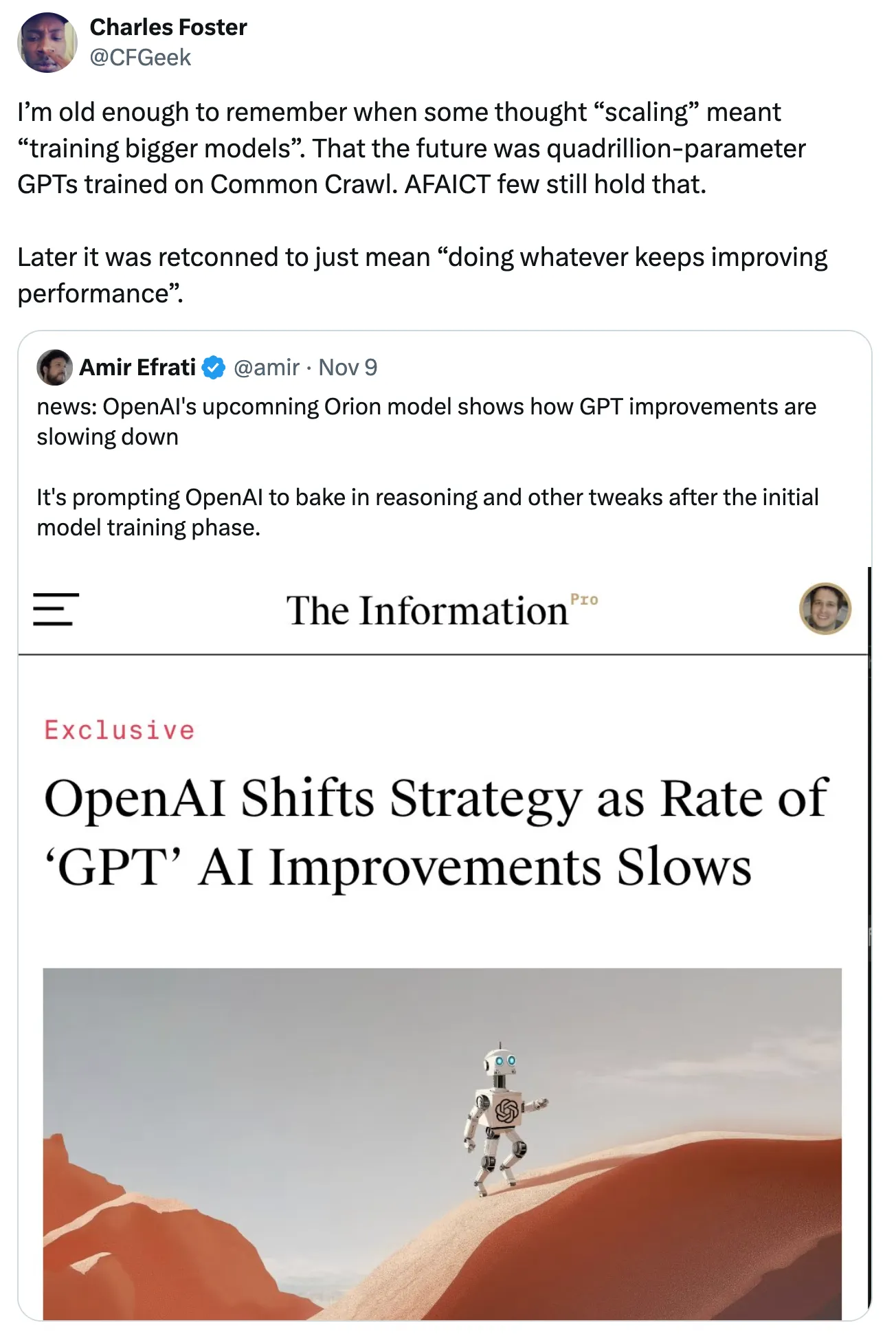

Récemment, une question a secoué la communauté de l’IA, imprégnée d’un souffle de croisade : la « religion amère » est-elle encore valide ?

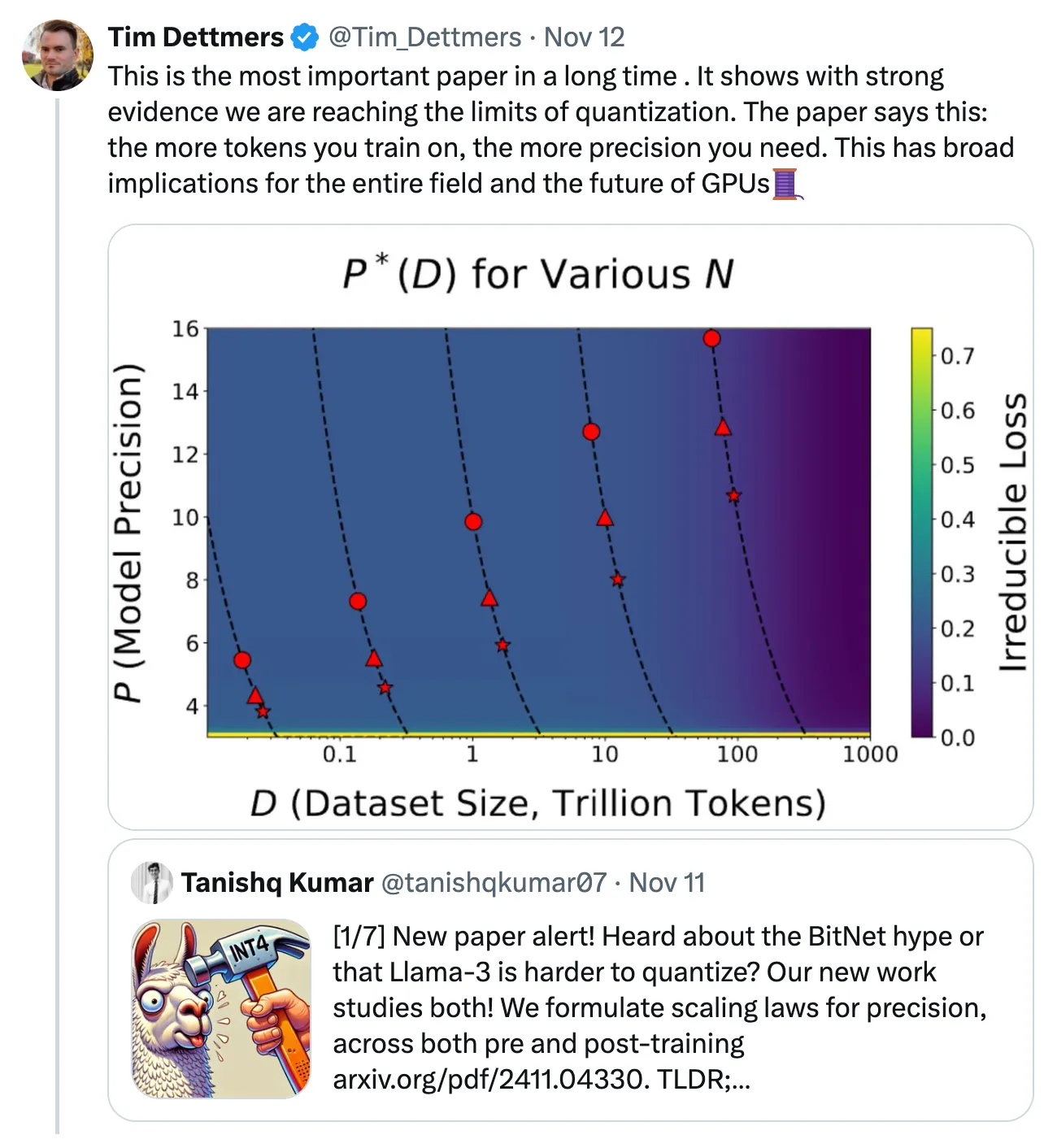

Cette semaine, une nouvelle étude intitulée « The Scaling Law of Precision » publiée par Harvard, Stanford et le MIT a ravivé le conflit. Ce papier traite de la fin des gains d’efficacité apportés par les techniques de quantification, une série de méthodes améliorant les performances des modèles d’IA, particulièrement bénéfiques pour l’écosystème open source. Le chercheur scientifique de l’Institut Allen pour l’IA, Tim Dettmers, a résumé son importance dans le post ci-dessous, la qualifiant de « l’article le plus important depuis longtemps ». Il prolonge un débat qui s’intensifie depuis plusieurs semaines et révèle une tendance notable : la consolidation croissante de deux religions opposées.

Le PDG d’OpenAI, Sam Altman, et celui d’Anthropic, Dario Amodei, appartiennent à la même secte. Tous deux affirment avec confiance que nous atteindrons l’intelligence artificielle générale (AGI) dans environ 2 à 3 ans. Altman et Amodei sont probablement les figures les plus tributaires de la sainteté de la « religion amère ». Tous leurs incitatifs les poussent à promettre excessivement, à générer le plus de battage médiatique possible afin d’accumuler du capital dans un jeu dominé presque entièrement par les économies d’échelle. Si la loi d’extension n’était pas « l’Alpha et l’Oméga », le commencement et la fin, pourquoi auriez-vous besoin de 22 milliards de dollars ?

L’ancien scientifique en chef d’OpenAI, Ilya Sutskever, adhère à un ensemble de principes différents. Lui et d’autres chercheurs (y compris beaucoup au sein même d’OpenAI, selon des fuites récentes) pensent que l’extension touche à ses limites. Ce groupe considère qu’il sera nécessaire d’apporter de nouvelles avancées scientifiques et de nouvelles recherches pour maintenir le progrès et concrétiser l’AGI.

Le camp Sutskever fait valoir raisonnablement que la vision d’Altman d’une extension continue n’est pas économiquement viable. Comme le chercheur en IA Noam Brown l’a demandé : « Allons-nous vraiment entraîner des modèles coûtant des centaines de milliards, voire des milliers de milliards de dollars ? » Sans compter les dizaines de milliards supplémentaires nécessaires si nous transférons l’extension du calcul de l’entraînement vers l’inférence.

Mais les vrais croyants connaissent bien les arguments adverses. Le missionnaire à votre porte sait habilement contourner votre dilemme épicurien. Face aux critiques de Brown et Sutskever, le camp de la « religion amère » invoque la possibilité du « calcul pendant l’inférence ». Contrairement à ce qui a été fait jusqu’ici, cette approche ne repose pas sur un plus grand calcul lors de l’entraînement, mais consacre davantage de ressources à l’exécution. Quand un modèle d’IA doit répondre à une question ou générer du code ou du texte, il peut disposer de plus de temps et de puissance de calcul. C’est comme passer de réviser pour un examen de maths à convaincre le professeur de vous accorder une heure supplémentaire et d’utiliser une calculatrice. Pour beaucoup dans l’écosystème, c’est la nouvelle frontière de la « religion amère », car les équipes passent progressivement de la méthode orthodoxe de pré-entraînement aux méthodes post-entraînement / inférence.

Il est facile de pointer les failles d’autres systèmes de croyance, de critiquer d’autres doctrines sans exposer ses propres positions. Quelle est donc ma propre croyance ? D’abord, je crois que cette génération actuelle de modèles offrira un retour sur investissement très élevé au fil du temps. À mesure que les utilisateurs apprendront à contourner les limitations et à exploiter les API existantes, nous assisterons à l’émergence et au succès de véritables innovations produits. Nous dépasserons la phase mimétique et incrémentale des produits d’IA. Nous ne devrions pas les qualifier d’« intelligence artificielle générale » (AGI), car cette définition souffre de défauts conceptuels, mais plutôt de « minimal viable intelligence », personnalisable selon différents produits et cas d’usage.

Pour atteindre l’intelligence artificielle superintelligente (ASI), davantage de structure sera nécessaire. Des définitions et distinctions plus claires nous aideront à discuter efficacement des compromis entre valeur économique potentielle et coûts économiques. Par exemple, l’AGI pourrait offrir une valeur économique à une partie des utilisateurs (un système de croyance localisé), tandis que l’ASI pourrait produire des effets composés irrésistibles, transformant le monde, nos systèmes de croyance et notre structure sociale. Je ne pense pas que l’extension des transformeurs seule puisse réaliser l’ASI ; mais malheureusement, comme certains pourraient le dire, ce n’est là qu’un acte de foi athée.

La foi perdue

La communauté de l’IA ne résoudra pas rapidement cette croisade ; dans un tel conflit émotionnel, aucun fait ne peut être brandi. Au lieu de cela, nous devrions nous demander ce que signifie pour l’IA de remettre en question sa foi en la loi d’extension. Une telle perte de foi pourrait provoquer une réaction en chaîne, allant au-delà des grands modèles linguistiques (LLMs), affectant tous les secteurs et marchés.

Il faut reconnaître que dans la plupart des domaines de l’IA/apprentissage automatique, nous n’avons pas encore pleinement exploré la loi d’extension ; d’autres miracles sont encore possibles. Toutefois, si le doute s’installe vraiment, il deviendra plus difficile pour les investisseurs et les bâtisseurs de maintenir une confiance élevée dans l’état final des performances des catégories en début de courbe, comme la biotechnologie ou la robotique. Autrement dit, si nous voyons les LLMs ralentir et s’écarter de la voie choisie, les systèmes de croyance de nombreux fondateurs et investisseurs dans des domaines adjacents s’effondreront.

Savoir si cela est juste est une autre question.

Une idée veut que l’« intelligence artificielle générale » exige naturellement une plus grande échelle, donc la « qualité » des modèles spécialisés devrait se manifester à plus petite échelle, évitant ainsi de buter rapidement sur des goulots d’étranglement avant d’apporter une valeur pratique. Si un modèle spécialisé n’ingère qu’une partie des données, et n’a donc besoin que d’une fraction des ressources informatiques pour devenir viable, ne devrait-il pas avoir suffisamment d’espace pour s’améliorer ? Cela semble intuitivement logique, mais nous constatons répétitivement que ce n’est souvent pas le cas : inclure des données pertinentes ou apparemment non pertinentes améliore fréquemment les performances de modèles a priori non liés. Par exemple, inclure des données de programmation semble renforcer les capacités de raisonnement général.

À long terme, le débat sur les modèles spécialisés pourrait devenir obsolète. Quiconque construira une ASI (intelligence artificielle superintelligente) aura probablement pour objectif final un entité capable d’autoréplication et d’autoperfectionnement, dotée d’une créativité illimitée dans tous les domaines. Holden Karnofsky, ancien membre du conseil d’administration d’OpenAI et fondateur d’Open Philanthropy, nomme cette création « PASTA » (Processus d'Avancement Scientifique et Technologique Automatisé). Le plan de rentabilité initial de Sam Altman semble reposer sur un principe similaire : « Construire une AGI, puis lui demander comment gagner de l’argent. » C’est l’IA apocalyptique, le destin ultime.

Le succès d’OpenAI et d’Anthropic a stimulé l’enthousiasme des marchés financiers pour des laboratoires similaires au modèle « OpenAI du domaine X », dont l’objectif à long terme est de construire une « AGI » dans leur secteur vertical spécifique. Cette extrapolation de l’échelle pourrait conduire à un changement de paradigme, s’éloignant du modèle OpenAI pour privilégier des entreprises centrées sur le produit — une possibilité que j’ai évoquée lors de la conférence annuelle de Compound en 2023.

Contrairement au modèle apocalyptique, ces entreprises devront démontrer une série de progrès. Elles seront des entreprises basées sur l’ingénierie à grande échelle, et non des organisations scientifiques axées sur la recherche appliquée, avec pour objectif final la construction de produits.

Dans le domaine scientifique, si vous savez ce que vous faites, alors vous ne devriez pas le faire. Dans le domaine de l’ingénierie, si vous ne savez pas ce que vous faites, alors vous ne devriez pas le faire. — Richard Hamming

Les fidèles ne perdront probablement pas leur foi sacrée à court terme. Comme mentionné précédemment, avec l’essor d’une religion viennent des scénarios de vie et de culte, ainsi que des heuristiques. Ils érigent des monuments physiques et des infrastructures, renforçant leur puissance et leur sagesse, affirmant ainsi qu’ils « savent ce qu’ils font ».

Lors d’un récent entretien, Sam Altman a déclaré ceci à propos de l’AGI (mise en gras par nous) :

C’est la première fois que je sens que nous savons vraiment quoi faire. Beaucoup de travail reste à accomplir d’ici la construction d’une AGI. Nous connaissons certains inconnus, mais je pense que fondamentalement, nous savons quoi faire, cela prendra du temps ; ce sera difficile, mais aussi extrêmement excitant.

Le Jugement

En remettant en question la « religion amère », les sceptiques de l’extension mettent en lumière l’un des débats les plus profonds des dernières années. Chacun d’entre nous y a déjà réfléchi d’une manière ou d’une autre. Que se passerait-il si nous inventions Dieu ? À quelle vitesse ce Dieu apparaîtrait-il ? Et si l’AGI (intelligence artificielle générale) surgissait réellement, de façon irréversible, que se passerait-il ?

Comme tous les sujets complexes et inconnus, nous avons vite rangé nos réactions spécifiques dans notre esprit : certains désespèrent à l’idée de devenir obsolètes, la majorité anticipe un mélange de destruction et de prospérité, et une minorité pense que l’humanité fera ce qu’elle fait de mieux : continuer à chercher des problèmes à résoudre, et résoudre ceux qu’elle a créés, atteignant ainsi une richesse pure.

Ceux qui ont beaucoup à perdre veulent pouvoir prédire à quoi ressemblerait le monde si la loi d’extension tenait, et si l’AGI arrivait dans quelques années. Comment servirez-vous ce nouveau Dieu, et comment ce nouveau Dieu vous servira-t-il ?

Mais que se passerait-il si l’Évangile de la stagnation chassait les optimistes ? Et si nous commencions à penser que même Dieu pourrait décliner ? Dans un précédent article, « Robot FOMO, loi d’échelle et prévision technologique », j’écrivais :

J’imagine parfois ce qui arriverait si la loi d’extension ne tenait pas, serait-ce comparable aux pertes de revenus, au ralentissement de la croissance et à la hausse des taux d’intérêt dans de nombreux domaines technologiques ? J’imagine aussi que si la loi d’extension était entièrement vérifiée, cela ressemblerait aux courbes de commercialisation des pionniers dans d’autres domaines et à l’appropriation de leur valeur.

« L’avantage du capitalisme, c’est que, quoi qu’il arrive, nous dépenserons beaucoup d’argent pour trouver la réponse. »

Pour les fondateurs et les investisseurs, la question devient : que va-t-il se passer ensuite ? Les candidats potentiels à la construction de grands produits dans chaque secteur vertical deviennent progressivement identifiables. Il y en aura davantage dans chaque industrie, mais l’histoire a déjà commencé. D’où viendront les nouvelles opportunités ?

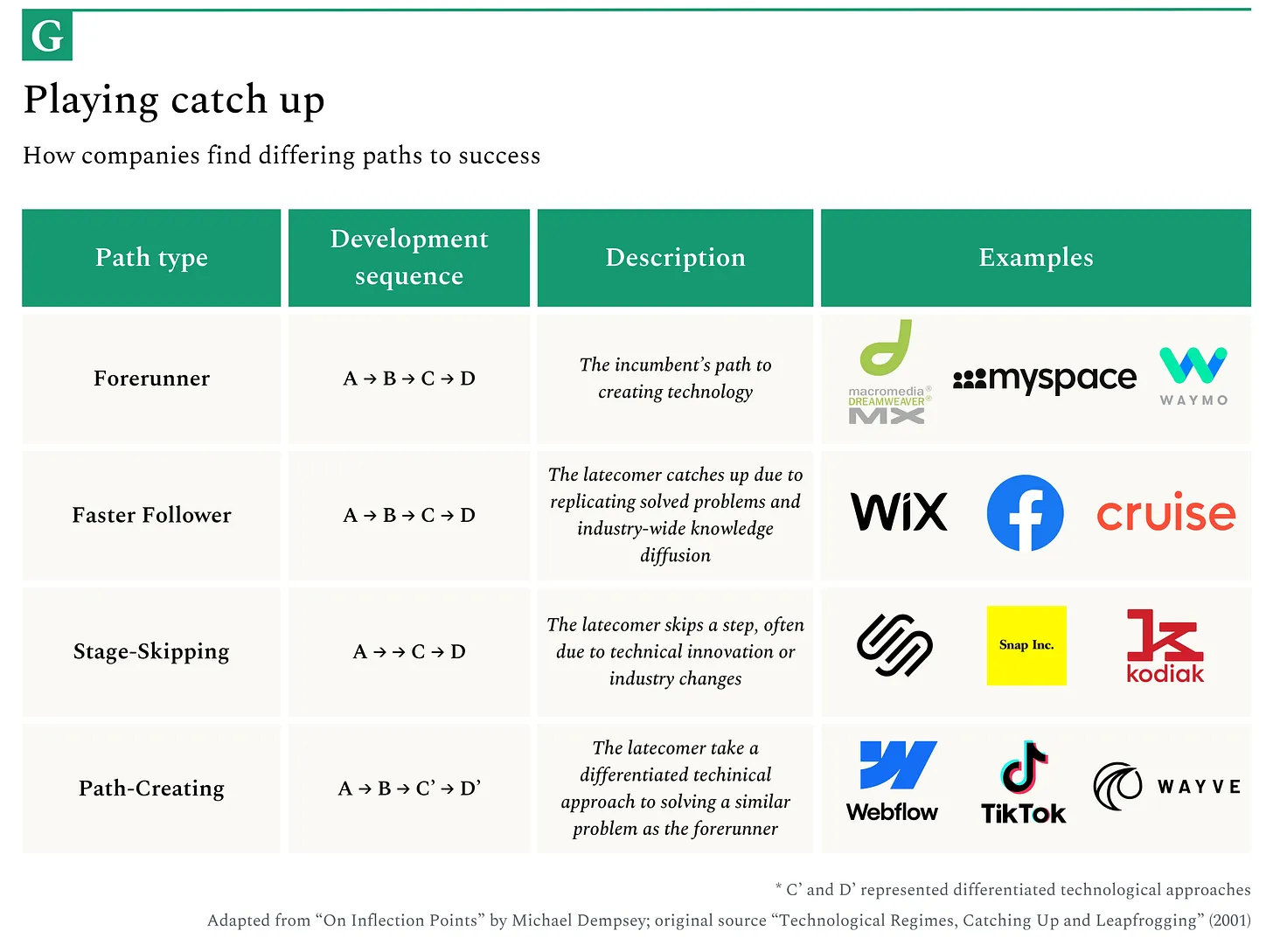

Si l’extension stagne, je m’attends à une vague de faillites et de fusions. Les entreprises restantes se concentreront de plus en plus sur l’ingénierie, une évolution que nous devrions anticiper en surveillant les mouvements de talents. Nous voyons déjà des signes qu’OpenAI s’oriente dans cette direction, en se productivisant de plus en plus. Ce changement ouvrira la voie à une nouvelle génération de startups, capables de dépasser les entreprises existantes en empruntant de nouvelles voies grâce à des recherches appliquées innovantes et à la science, plutôt qu’à l’ingénierie.

Les leçons de la religion

Mon avis sur la technologie est que tout ce qui semble manifestement bénéficier d’effets cumulatifs ne dure généralement pas longtemps, et que tout le monde admet que toute entreprise semblant bénéficier d’effets cumulatifs se développe étrangement à un rythme et à une échelle bien inférieurs aux attentes.

Les premiers signes de division religieuse suivent généralement un schéma prévisible, pouvant servir de cadre pour suivre l’évolution de la « religion amère ».

Elle commence habituellement par l’apparition d’interprétations concurrentes, motivées par des raisons capitalistes ou idéologiques. Dans le christianisme primitif, les divergences sur la divinité du Christ ou la nature de la Trinité ont conduit à des schismes et à des lectures radicalement différentes de la Bible. Outre les divisions déjà mentionnées dans l’IA, d’autres fissures apparaissent. Par exemple, certains chercheurs rejettent l’orthodoxie centrale du transformeur au profit d’autres architectures comme les modèles d’état (State Space Models), Mamba, RWKV, les modèles liquides (Liquid Models), etc. Bien que ce ne soient encore que de faibles signaux, ils témoignent de germes d’hérésie et d’une volonté de repenser le domaine à partir de principes fondamentaux.

Avec le temps, les déclarations impatientes des prophètes suscitent aussi la méfiance. Quand les prophéties des chefs religieux ne se réalisent pas, ou que l’intervention divine tarde à venir, des graines de doute sont semées.

Le mouvement Miller a prédit le retour du Christ en 1844, mais lorsque Jésus n’est pas venu comme prévu, le mouvement s’est effondré. Dans la tech, nous enterrons silencieusement les prédictions ratées et permettons à nos prophètes de continuer à dessiner des futurs optimistes à long terme, malgré des échéances répétées manquées (salut, Elon). Pourtant, sans performance brute des modèles continuellement améliorée, la foi en la loi d’extension pourrait subir un effondrement similaire.

Une religion corrompue, gonflée ou instable est vulnérable aux apostats. La Réforme protestante a progressé non seulement grâce à la théologie de Luther, mais aussi parce qu’elle est survenue durant un moment de déclin et de troubles au sein de l’Église catholique. Lorsque les institutions dominantes montrent des signes de fracture, les idées hérétiques de longue date trouvent soudain un terrain fertile.

Dans le domaine de l’IA, nous pourrions observer des modèles plus petits ou des approches alternatives obtenant des résultats similaires avec moins de calcul ou de données, comme les travaux menés par divers laboratoires chinois ou des équipes open source (comme Nous Research). Ceux qui franchiront les limites de l’intelligence biologique, surmontant des obstacles jusque-là jugés insurmontables, pourraient aussi forger un nouveau récit.

Le moyen le plus direct et immédiat d’observer le début d’un changement est de suivre les mouvements des praticiens. Avant toute division formelle, les théologiens et clercs gardent souvent en privé des opinions hérétiques tout en affichant publiquement leur conformité. Aujourd’hui, cela correspondrait à des chercheurs en IA qui, tout en suivant officiellement la loi d’extension, poursuivent en secret des approches radicalement différentes, attendant le bon moment pour contester le consensus, ou quittant leurs laboratoires pour explorer des horizons théoriques plus vastes.

Le problème avec les orthodoxies religieuses et technologiques est qu’elles contiennent souvent une part de vérité, mais sans être aussi universellement valides que leurs fidèles les plus ardents le croient. Comme les religions intègrent des vérités humaines fondamentales dans leurs cadres métaphysiques, la loi d’extension décrit clairement une réalité du fonctionnement des réseaux neuronaux. La question est de savoir si cette réalité est aussi complète et immuable que l’enthousiasme actuel le suggère, et si ces institutions religieuses (les laboratoires d’IA) sont assez flexibles et stratégiques pour entraîner les fidèles avec elles, tout en construisant les presses à imprimer (interfaces conversationnelles et API) qui diffuseront leurs connaissances.

L’aboutissement

« La religion est vraie pour le peuple, fausse pour le sage, utile pour le gouvernant. » — Lucius Annaeus Seneca

Une vision potentiellement dépassée des institutions religieuses est qu’une fois atteint une certaine taille, elles deviennent, comme beaucoup d’organisations humaines, sujettes aux motivations de survie, cherchant à survivre dans la compétition. Ce faisant, elles négligent la vérité et les grandes aspirations (qui ne s’excluent pas mutuellement).

J’ai écrit un article sur la manière dont les marchés financiers deviennent des bulles informationnelles guidées par des récits, et dont les incitations perpétuent souvent ces narratifs. Le consensus autour de la loi d’extension évoque une similitude inquiétante — un système de croyance profondément ancré, mathématiquement élégant et extrêmement utile pour coordonner le déploiement massif de capitaux. Comme de nombreuses structures religieuses, il pourrait avoir davantage de valeur en tant que mécanisme de coordination qu’en tant que vérité fondamentale.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News