La fuite d'OpenAI rejoint Musk

TechFlow SélectionTechFlow Sélection

La fuite d'OpenAI rejoint Musk

Outre Pavel Izmailov, de nombreux talents exceptionnels ont récemment été recrutés par Musk.

Rédaction : Bai Jiao, Heng Yu, Fa Zi, Ao Fei Si

Source : Quantum Bit

Le lanceur d'alerte récemment licencié par OpenAI a rejoint Elon Musk à toute vitesse.

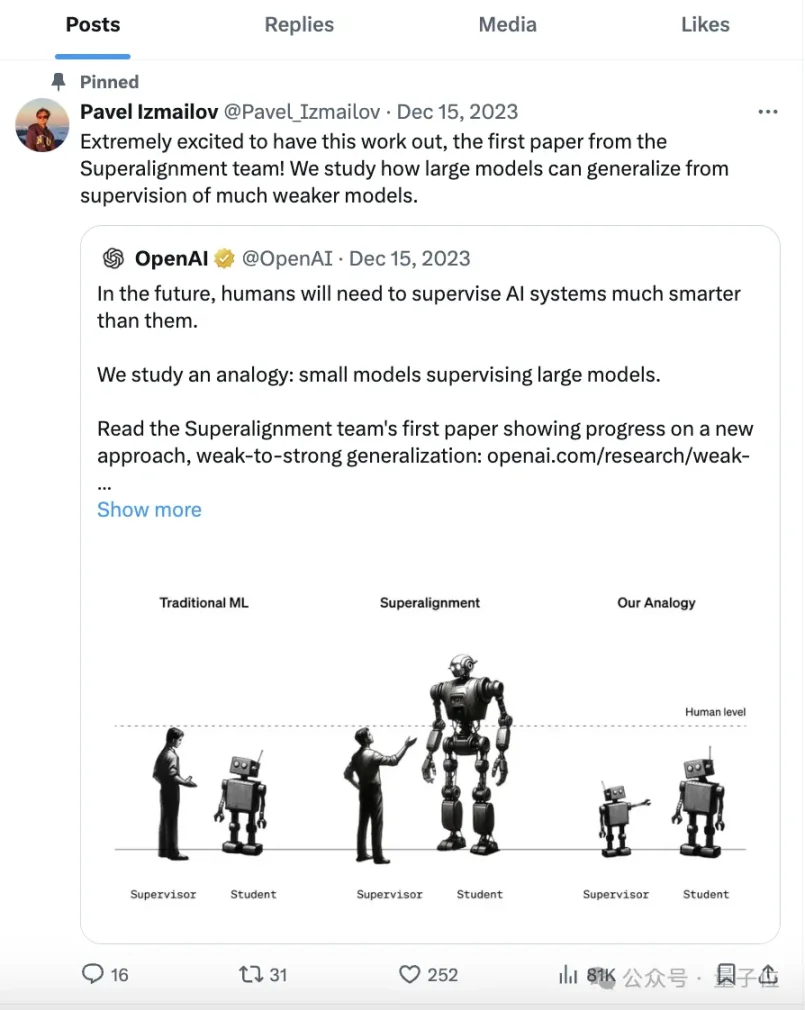

L'intéressé, Pavel Izmailov (appelé ici « Petit P »), est l'un des alliés de Ilya, ayant travaillé dans l'équipe de super-alignement dirigée par ce dernier.

Il y a une quinzaine de jours, Petit P aurait été soupçonné d'avoir divulgué des secrets liés au projet Q*, et a donc été licencié. Bien que l'on ignore précisément ce qu'il a pu divulguer, cette affaire a fait grand bruit sur la scène internationale.

Et voilà que désormais, sa biographie Twitter proclame fièrement :

Chercheur @xai

On ne peut nier qu'Elon Musk recrute vite et bien. Outre Petit P, plusieurs autres talents de haut niveau ont récemment rejoint ses rangs.

Les internautes s'en sont donné à cœur joie. Beaucoup le félicitent, le trouvant brillant :

Mais certains désapprouvent fortement, jugeant scandaleux d'embaucher quelqu’un accusé de fuite de données confidentielles — un comportement assimilable à du ramassage d'ordures.

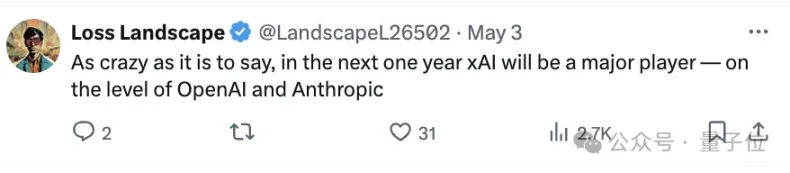

En outre, les récentes réalisations de xAI — notamment la sortie de Grok 1.5V — ont considérablement renforcé sa visibilité, suscitant cette réflexion :

xAI devient un acteur majeur face à OpenAI et Anthropic.

Embauche d'un ancien employé licencié par OpenAI

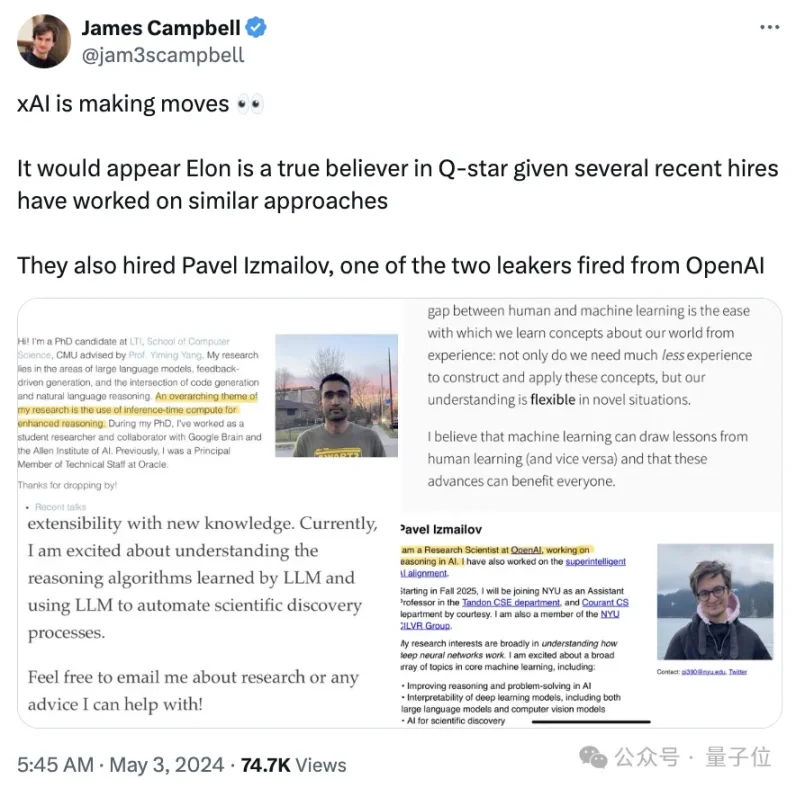

Voici comment les choses se sont passées : un blogueur particulièrement attentif aux nouveautés dans le domaine des grands modèles a fait une découverte majeure :

Il y aurait beaucoup de nouveaux employés chez xAI, la société d'Elon Musk ?!?

Et parmi eux, plusieurs auraient des domaines de recherche liés à l'algorithme Q*, mystérieux projet d'OpenAI. On pourrait dire qu'Elon Musk est le véritable disciple de Q*.

Qui sont exactement ces nouveaux arrivants chez xAI ?

Le plus remarquable est bien sûr celui dont nous avons parlé en début d'article, Petit P.

Membre du groupe CILVR de l'Université de New York, il a indiqué qu'il rejoindrait à l'automne 2025 le département CSE de Tandon et le département CS de Courant en tant que professeur assistant.

Il y a encore quinze jours, son profil indiquait qu’il travaillait sur l’inférence des grands modèles chez OpenAI.

Quinze jours plus tard, tout a changé.

Pourtant, son tweet épinglé n'a pas bougé : c'est toujours le premier article de l’équipe de super-alignement, dont Petit P est co-auteur.

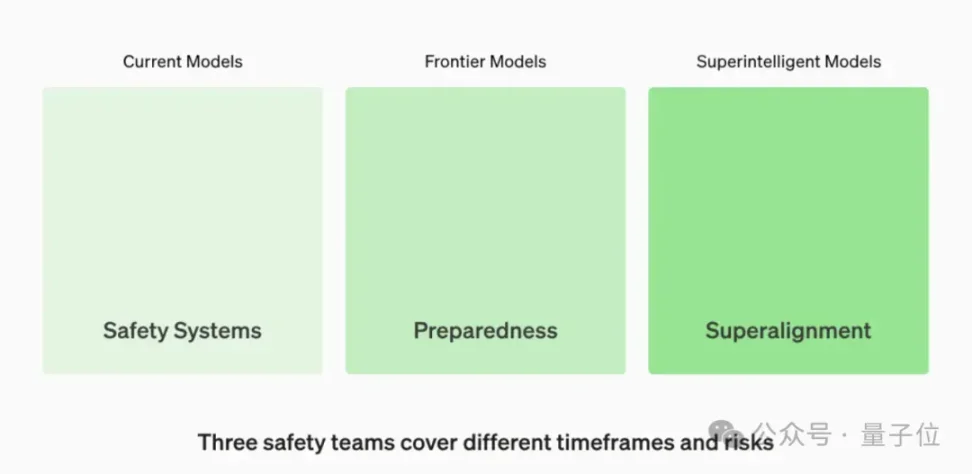

L’équipe de super-alignement a été formée en juillet dernier. Elle est l’une des trois équipes de sécurité créées par OpenAI pour anticiper les problèmes de sécurité liés aux grands modèles à différentes échelles temporelles.

Spécialisée dans les risques futurs, elle vise à poser les bases de la sécurité des intelligences artificielles dépassant l'humain, sous la direction de Ilya Sutskever et Jan Leike.

Bien qu'OpenAI semble accorder une grande importance à la sécurité, les divergences internes quant au développement sécurisé de l'IA ne sont plus un secret.

Ces désaccords sont même considérés comme la principale cause du coup de théâtre au conseil d'administration d'OpenAI en novembre dernier.

Selon les rumeurs, Ilya Sutskever serait devenu le chef de cette « mutinerie » après avoir découvert certaines choses qui l'ont profondément inquiété.

Beaucoup de membres de l’équipe de super-alignement soutiennent Ilya ; lors de l’initiative de soutien à Sam Altman, ils sont restés globalement silencieux.

Après le règlement du conflit, Ilya semble avoir disparu d'OpenAI, alimentant toutes sortes de rumeurs, sans jamais faire de clarification publique en ligne.

Personne ne sait donc aujourd'hui quel est l’état actuel de l’équipe de super-alignement.

Petit P, membre de cette équipe et subordonné de Ilya, a été licencié d'OpenAI il y a quinze jours. Les internautes spéculent qu'il aurait été victime d'une purge post-conflit menée par Sam Altman.

Un talent qui rejoint Elon Musk en pleine nuit

Bien que l'on ignore encore la nature complète de Q*, de nombreux indices montrent qu'il vise à combiner grands modèles, apprentissage par renforcement et algorithmes de recherche afin de renforcer les capacités de raisonnement de l'IA.

Outre Petit P, qui attire tous les regards, plusieurs autres nouveaux talents recrutés par xAI ont des recherches étroitement liées à ces sujets.

Qian Huang, actuellement doctorante à l'Université de Stanford.

Elle a travaillé chez Google DeepMind depuis l'été dernier. Son compte Twitter indique désormais @xai, mais on ignore encore son poste exact.

Son site GitHub révèle que ses recherches portent sur l'intégration du raisonnement machine et humain, en particulier sur la rationalité, l'interprétabilité et l'extensibilité des nouvelles connaissances.

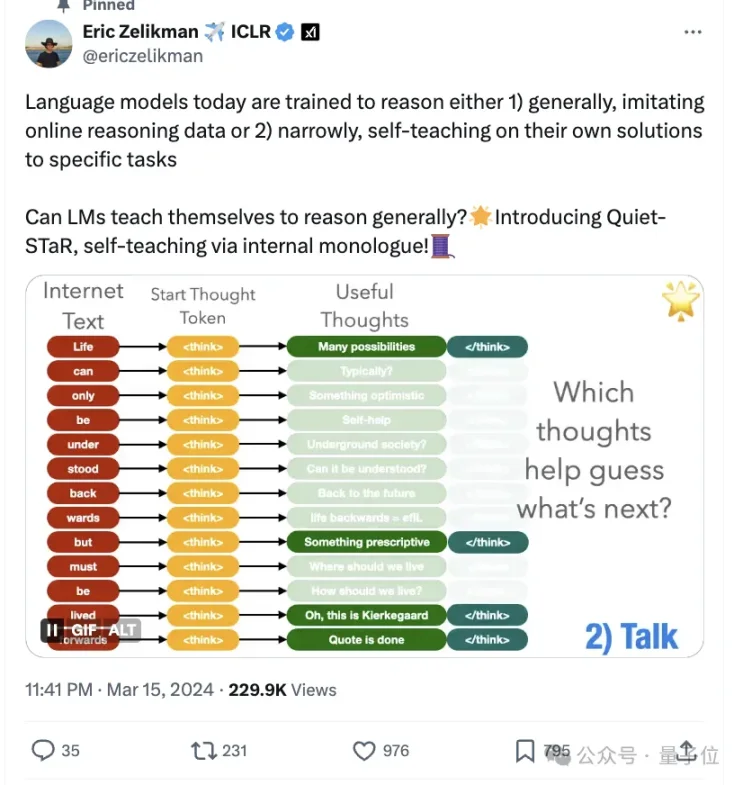

Eric Zelikman, doctorant à Stanford, dont le compte Twitter indique « study why @xai ».

Il a auparavant effectué des stages au Google Research Institute et au Microsoft Research Institute.

Sur son site personnel, il déclare : « Je suis fasciné par la manière dont (et si) les algorithmes peuvent apprendre des représentations et du raisonnement significatifs. C’est ce que je cherche à comprendre chez xAI. »

En mars dernier, son équipe a lancé l'algorithme Quiet-Star, également associé à Q*, permettant aux grands modèles d'apprendre à penser de façon autonome.

Aman Madaan, doctorant à l'Institut de technologie du langage de Carnegie Mellon.

Ses domaines de recherche incluent les grands modèles linguistiques, la génération assistée par retour d'information, ainsi que l'intersection entre génération de code et raisonnement en langage naturel. Son thème central : utiliser le calcul en temps d'inférence (Inference-Time Compute) pour améliorer les capacités de raisonnement.

Durant son doctorat, Aman a été chercheur étudiant et collaborateur au sein de Google Brain et de l'Institut Allen pour l'intelligence artificielle ; auparavant, il était ingénieur principal chez Oracle.

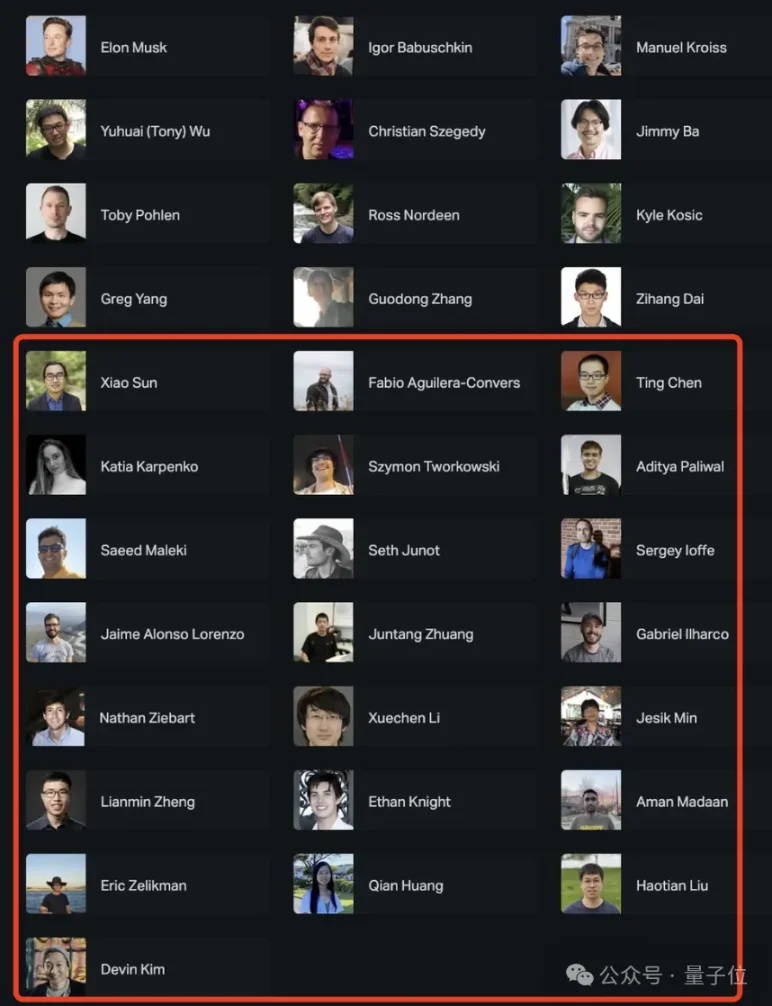

Avec Pavel Izmailov et les autres nouveaux employés, l'équipe technique d'Elon Musk compte désormais 34 membres (hors Elon Musk lui-même), soit environ deux fois plus que l'équipe initiale de 12 personnes.

Parmi les nouveaux arrivants, sept sont d'origine chinoise. Avec les cinq membres fondateurs également d'origine chinoise, ils sont désormais douze au total.

-

Xiao Sun, anciennement chez Meta et IBM, docteur de Yale, diplômé de l'Université de Pékin.

-

Ting Chen, anciennement chez Google DeepMind et Google Brain, diplômé de l'Université de Post et Télécommunications de Pékin.

-

Juntang Zhuang, anciennement chez OpenAI, contributeur clé de DALL-3 et GPT-4, diplômé de Tsinghua, doctorat de Yale.

-

Xuechen Li, doctorat de Stanford cette année, contributeur principal de la série de grands modèles Alpaca.

-

Lianmin Zheng, docteur en informatique de l'UC Berkeley, créateur de Vicuna et Chatbot Arena.

-

Qian Huang, doctorante à Stanford, diplômée du lycée Nankai de Tianjin.

-

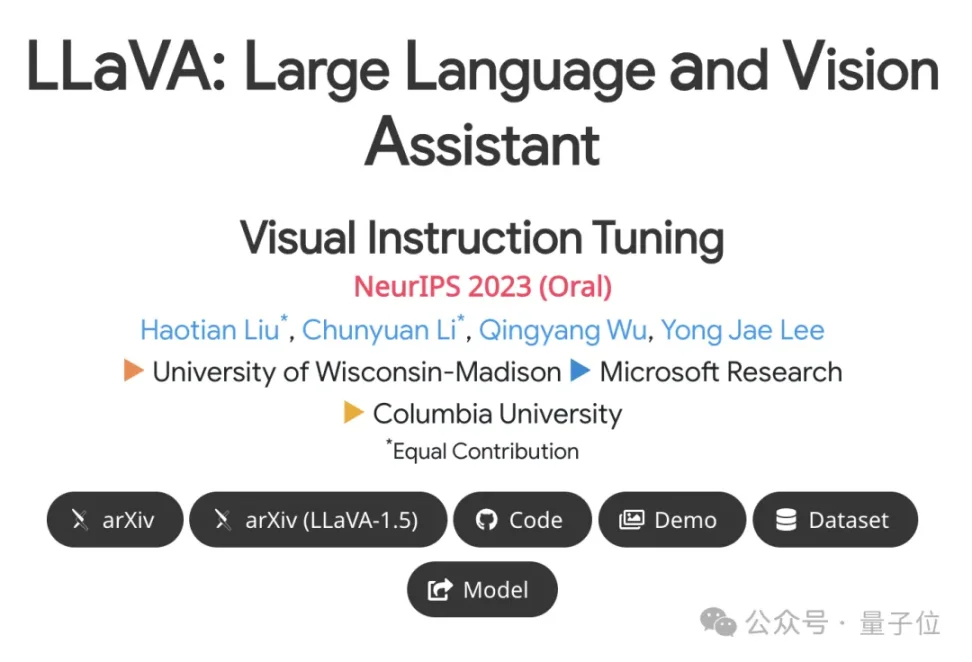

Haotian Liu, Université du Wisconsin-Madison, diplômé de l'Université de Zhejiang, premier auteur de LLaVA.

En termes d'origine institutionnelle, la majorité provient de Google, Stanford, Meta, OpenAI et Microsoft. Tous possèdent une solide expérience dans l'entraînement de grands modèles, tels que les séries GPT, Alpaca/Vicuna, ou les grands modèles développés par Google et Meta.

En termes de date d'embauche, la plupart sont arrivés entre février et mars de cette année, avec en moyenne un nouveau membre toutes les cinq jours, soit 13 au total. Entre août et octobre de l'année dernière, seulement cinq avaient rejoint xAI.

En croisant ces dates avec les avancées de Grok, on peut discerner les phases stratégiques de recrutement chez xAI.

Par exemple, le 29 mars, Elon Musk a soudainement annoncé Grok-1.5, dont la longueur de contexte a bondi de 8192 à 128 000, atteignant ainsi le niveau de GPT-4.

Un mois plus tôt, en février, l'ex-employé d'OpenAI Juntang Zhuang a rejoint xAI. Il est l'inventeur de l'algorithme permettant à GPT-4 Turbo de gérer un contexte de 128k.

De même, le 15 avril, xAI a lancé Grok-1.5V, un modèle multimodal capable de traiter non seulement du texte, mais aussi des graphiques, captures d'écran et photos.

Or, en mars, Haotian Liu, premier auteur de LLaVA, venait justement de rejoindre l'équipe. LLaVA est un modèle multimodal entraîné de bout en bout, présentant des capacités comparables à GPT-4V. La version LLaVA-1.5 a d'ailleurs atteint des performances SoTA sur 11 benchmarks.

On peut donc raisonnablement imaginer quelles nouvelles améliorations attendent Grok grâce à cette nouvelle vague de recrutement ?

Un internaute lance : peu importe, où est donc Grok-1.5 (toujours pas open source) ?

Quoi qu'il en soit, selon les critères de recrutement exprimés par Elon Musk, un internaute résume bien la situation :

On dit tous que l'entreprise de IA d'Elon Musk regorge de talents, mais en réalité, Elon Musk ne se soucie pas vraiment de votre talent. Il a clairement dit : tant que vous pouvez travailler 80 heures par semaine sans craquer, vous êtes le bienvenu.

80 heures ?!

Quantum Bit fait rapidement le calcul : cela revient à travailler 11,5 heures par jour, sans jour de repos…

Oubliez le QI, physiquement, on ne tiendrait pas le coup.

Liens de référence :

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News