GitHub Copilot thay đổi mô hình thu phí, vén màn lời nói dối lớn nhất của ngành AI

Tuyển chọn TechFlowTuyển chọn TechFlow

GitHub Copilot thay đổi mô hình thu phí, vén màn lời nói dối lớn nhất của ngành AI

OpenAI, Anthropic và Microsoft đều đang chịu lỗ để nuôi dưỡng bạn, nhưng trò chơi này sắp không thể kéo dài thêm nữa.

Tác giả: Ed Zitron

Biên dịch: TechFlow

Giới thiệu của TechFlow: Cuối cùng Microsoft cũng không còn chịu nổi nữa — GitHub Copilot đã chuyển từ mô hình tính phí theo tháng sang tính phí theo token. Đây không phải là một nâng cấp sản phẩm, mà là sự phá sản tập thể của trò lừa đảo trợ cấp toàn ngành AI: OpenAI, Anthropic và các công ty khác dùng mô hình phí hàng tháng để che giấu chi phí thực tế, khiến người dùng cứ chi 1 đô la thì nền tảng lại đốt tới 8–13 đô la chi phí tính toán, từ đó huấn luyện nên một thói quen sử dụng hoàn toàn không thể duy trì lâu dài. Khi giá cả trở về với thực tế, bạn sẽ nhận ra rằng những công cụ AI “cách mạng” kia có thể chỉ là những món đồ chơi đắt đỏ.

Tôi vừa viết một bài về cách OpenAI “hạ gục” Oracle; bài viết hôm nay sử dụng một số tư liệu từ bài đó. Đây là một trong những bài tôi tâm đắc nhất, và tôi rất tự hào về nó.

Việc đăng ký phiên bản trả phí vừa mang lại giá trị tuyệt vời, vừa giúp tôi có thể đều đặn xuất bản mỗi tuần những bài nghiên cứu chuyên sâu, miễn phí như thế này.

Sáng hôm qua, người dùng GitHub Copilot đã chính thức xác nhận thông tin tôi đưa ra cách đây một tuần — tất cả các gói GitHub Copilot sẽ chuyển sang mô hình tính phí theo mức độ sử dụng vào ngày 1 tháng 6 năm 2026.

Microsoft giờ đây sẽ không còn cung cấp cho người dùng một số lượng cố định “yêu cầu” nào đó, mà thay vào đó tính phí dựa trên chi phí thực tế mà người dùng tiêu thụ từ mô hình — Microsoft gọi đây là “…một bước tiến quan trọng hướng tới một mô hình kinh doanh Copilot bền vững và đáng tin cậy, đồng thời đảm bảo trải nghiệm người dùng ở mọi cấp độ.” Số lượng tính năng người dùng được phép sử dụng giờ đây phụ thuộc trực tiếp vào số token họ mua được bằng khoản phí đăng ký (ví dụ: gói 19 đô la/tháng cho phép sử dụng token trị giá 19 đô la).

Diễn giải đơn giản: “Chúng tôi không thể tiếp tục trợ cấp người dùng GitHub Copilot nữa — nếu không Amy Hood (CFO của Microsoft) sẽ cầm gậy bóng chày đánh người.”

Thông báo này bản thân nó đã là một bản xem trước thú vị về cách những điều chỉnh giá cả sẽ được đóng gói khéo léo:

Copilot giờ đây đã không còn là sản phẩm của một năm trước. Nó đã tiến hóa từ một trợ lý tích hợp trong trình soạn thảo thành một nền tảng tác nhân (agent) thông minh có khả năng thực hiện các phiên lập trình kéo dài, đa bước, sử dụng các mô hình mới nhất để lặp lại trên toàn bộ kho mã nguồn. Việc sử dụng tác nhân đang dần trở thành chế độ mặc định — điều này làm gia tăng đáng kể nhu cầu tính toán và suy luận. Hiện tại, một câu hỏi trò chuyện nhanh và một phiên lập trình tự chủ kéo dài nhiều giờ có thể khiến người dùng trả cùng một mức phí. GitHub đã liên tục gánh chịu chi phí suy luận ngày càng leo thang phía sau việc sử dụng này, nhưng mô hình cao cấp dựa trên số lần yêu cầu hiện tại đã trở nên không bền vững. Việc tính phí theo mức độ sử dụng giải quyết vấn đề này. Nó giúp gắn kết hơn giữa giá cả và mức độ sử dụng thực tế, hỗ trợ chúng tôi duy trì độ tin cậy phục vụ lâu dài, đồng thời giảm bớt nhu cầu giới hạn người dùng nặng.

Thấy chưa? Không phải Microsoft đang trợ cấp sức mạnh tính toán cho gần hai triệu người dùng, mà là AI đã trở nên quá mạnh mẽ và phức tạp đến mức về cơ bản đã trở thành một sản phẩm hoàn toàn khác!

Dù Copilot “có thể không còn là sản phẩm của một năm trước”, nhưng sự lệch lạc kinh tế nền tảng hầu như chẳng hề thay đổi: Trong suốt ba năm qua, Microsoft vẫn cho phép người dùng “đốt” lượng token vượt xa khoản phí đăng ký hàng tháng. Theo báo cáo của Wall Street Journal tháng 10 năm 2023:

Người dùng cá nhân trả 10 đô la/tháng để sử dụng trợ lý AI này. Dữ liệu từ một nguồn thạo tình hình cho biết, trong vài tháng đầu năm nay, trung bình mỗi người dùng khiến công ty lỗ hơn 20 đô la/tháng, một số người thậm chí khiến công ty chi tới 80 đô la/tháng.

Tất nhiên, người dùng GitHub Copilot giờ đây đang nổi dậy phản đối, gọi sản phẩm là “đã chết”, “hoàn toàn sụp đổ”.

Hai năm trước, trong bài viết “Khủng hoảng AI thế hệ thứ hai”, tôi đã tiên đoán ngày này:

Ngày ấy cuối cùng cũng đã đến — bởi vì mọi dịch vụ AI bạn đang dùng đều đang trợ cấp chi phí tính toán, và do đó, mọi dịch vụ đều đang lỗ:

Khi bạn trả phí cho các dịch vụ AI khởi nghiệp — đương nhiên bao gồm cả OpenAI và Anthropic — bạn trả phí theo tháng, ví dụ như Claude của Anthropic có các gói 20, 100 hoặc 200 đô la/tháng; Perplexity có các gói 20 hoặc 200 đô la/tháng; hoặc OpenAI có các gói 8, 20 hoặc 200 đô la/tháng. Trong một số trường hợp doanh nghiệp, bạn nhận được “hạn mức” tính theo đơn vị công việc — ví dụ như Lovable cấp cho người dùng “100 hạn mức/tháng” trong gói đăng ký 25 đô la/tháng, cộng thêm 25 đô la lưu trữ đám mây (đến hết quý I/2026), và các hạn mức này có thể được tích lũy qua các tháng. Khi bạn sử dụng các dịch vụ này, công ty liên quan hoặc phải trả phí theo tỷ lệ mỗi triệu token cho phòng thí nghiệm AI, hoặc (với Anthropic và OpenAI) trả phí thuê GPU từ nhà cung cấp đám mây để chạy mô hình. Một token về cơ bản tương đương khoảng 3/4 từ. Là người dùng, bạn không cảm nhận được việc tiêu thụ token — bạn chỉ thấy quá trình nhập và xuất dữ liệu. Các phòng thí nghiệm AI che giấu chi phí dịch vụ bằng cách dùng các thuật ngữ như “token”, “tin nhắn”, hoặc giới hạn tốc độ 5 giờ kèm phần trăm — khiến bạn, với tư cách người dùng, thực sự không hiểu rõ tổng chi phí thực tế là bao nhiêu. Ở hậu trường, các công ty khởi nghiệp AI đang cháy tiền điên cuồng — ngay cả Anthropic gần đây vẫn cho phép bạn “đốt” tới 8 đô la chi phí tính toán cho mỗi đô la phí đăng ký. OpenAI cũng cho phép điều này, dù khó đo lường chính xác con số cụ thể.

Các công ty khởi nghiệp AI và các ông lớn đám mây đều tưởng rằng họ có thể dùng mô hình trợ cấp, lỗ vốn để thu hút đủ đông người dùng, khiến họ “nghiện” đến mức khi doanh nghiệp tăng giá, họ vẫn từ chối chuyển sang nền tảng khác. Tôi nghĩ họ cũng tin rằng chi phí token sẽ giảm dần theo thời gian — nhưng thực tế lại xảy ra điều ngược lại: dù giá một số mô hình có thể giảm, nhưng các mô hình “suy luận” mới hơn lại tiêu thụ nhiều token hơn, nghĩa là chi phí suy luận vô lý thay vì giảm đi, lại ngày càng tăng lên theo thời gian.

Cả hai giả định trên đều sai lầm, bởi mô hình đăng ký hàng tháng là điều phi lý đối với bất kỳ dịch vụ nào kết nối với mô hình ngôn ngữ lớn (LLM).

Mô hình kinh tế cốt lõi của AI tạo sinh đã sụp đổ

Hãy suy luận như sau. Khi Uber (không, điều này hoàn toàn khác với Uber) bắt đầu tăng giá dịch vụ xe, thì logic kinh tế nền tảng không hề thay đổi, và cách hiển thị cho hành khách lẫn tài xế cũng không đổi — người dùng trả tiền cho mỗi chuyến đi, tài xế được trả tiền cho mỗi chuyến đi. Tài xế vẫn phải tự trả chi phí xăng, bảo hiểm xe, giấy phép do chính quyền địa phương yêu cầu, và chi phí tài chính có thể phát sinh từ xe — những khoản này Uber không trợ cấp. Khoản lỗ khổng lồ của Uber bắt nguồn từ trợ cấp, chi phí tiếp thị không ngừng nghỉ, và các nỗ lực nghiên cứu thất bại như ô tô tự lái.

Đăng ký AI tạo sinh hoàn toàn khác với Uber

Để minh họa quy mô lệch lạc trong định giá AI, tôi mời bạn tưởng tượng một dòng lịch sử song song, nơi Uber vận hành với một mô hình kinh doanh rất khác biệt.

Đăng ký AI tạo sinh giống như việc Uber thu 20 đô la/tháng để bạn được đi 100 chuyến xe trong phạm vi 100 dặm, trong khi giá xăng là 150 đô la/gallon — và Uber trả tiền xăng, vì có người kiên quyết tin rằng dầu mỏ rồi sẽ rẻ đến mức không đáng để đo đếm.

Uber cuối cùng sẽ quyết định bắt đầu thu phí đăng ký hàng tháng để người dùng có tư cách đặt xe, rồi sau đó tính thêm phí xăng dựa trên lượng xăng người dùng tiêu thụ. Đột nhiên, người dùng chuyển từ việc trả 20 đô la/tháng cho 100 chuyến xe sang việc trả 20 đô la để có tư cách đặt xe cộng thêm 26 đô la cho 10 dặm di chuyển. Người dùng dĩ nhiên sẽ cảm thấy bực bội.

Dù nghe có vẻ phóng đại, nhưng đây lại là một ẩn dụ khá chính xác về những gì đang diễn ra trong ngành AI tạo sinh — đặc biệt là với GitHub Copilot.

Chính sách định giá cũ của GitHub Copilot cho phép 300 yêu cầu nâng cao mỗi tháng, cộng thêm “yêu cầu trò chuyện không giới hạn” sử dụng các mô hình như GPT-5 mini. Mỗi “yêu cầu” (theo lời Microsoft) là “…bất kỳ tương tác nào bạn yêu cầu Copilot thực hiện giúp bạn”, và trong hệ thống dựa trên yêu cầu về sau, các mô hình đắt hơn sẽ chiếm nhiều yêu cầu hơn — ví dụ Claude Opus 4.6 chiếm ba yêu cầu nâng cao. Khi bạn dùng hết yêu cầu nâng cao, Copilot sẽ cho phép bạn tùy ý sử dụng các mô hình rẻ hơn còn lại trong suốt tháng.

Tình hình cũng không luôn như vậy. Cho đến tháng 5 năm 2025, Microsoft thậm chí còn cho người dùng sử dụng mô hình không giới hạn — dù vậy người dùng vẫn tức giận vì bất kỳ hạn chế nào áp lên sản phẩm.

Microsoft — giống như mọi công ty AI khác — đã lừa dối khách hàng bằng cách bán các dịch vụ không bền vững, bởi vì việc bán các dịch vụ LLM dựa trên đăng ký hàng tháng từ xưa đến nay, và mãi mãi, đều là điều phi lý.

Nếu bạn muốn biết dịch vụ tính phí theo token có thể tốn bao nhiêu, một người dùng trong nhóm con GitHub Copilot đã phát hiện ra rằng chi phí token cho một yêu cầu nâng cao trước đây dao động khoảng 11 đô la — bởi một “yêu cầu” như vậy thường sử dụng 60.000 token trong cửa sổ ngữ cảnh, kết hợp nhiều công cụ và hàng loạt “vòng lặp nội bộ” (các thao tác mô hình thực hiện) để tạo ra đầu ra.

Còn có sự thiếu tin cậy nền tảng của các mô hình ngôn ngữ lớn dễ sinh ảo giác. Dù việc một yêu cầu nâng cao rơi vào vòng lặp vô hạn và xuất ra nửa đoạn mã lỗi có thể gây bực bội, thì cùng sự cố đó lại khó được tha thứ hơn nhiều khi chính bạn phải trả tiền.

Người dùng cũng bị huấn luyện để sử dụng sản phẩm theo một cách hoàn toàn khác biệt so với mô hình tính phí theo token — tôi tin rằng nhiều người thậm chí chưa từng thực sự nhận thức được mình đã “đốt” bao nhiêu “token”, hay một nhiệm vụ cụ thể cần bao nhiêu — và con số này sẽ thay đổi tùy theo mô hình bạn chọn.

Điều này hoàn toàn khác với Uber — bất kỳ ai nói ngược lại đều đang cố biện minh cho hành vi tồi tệ. Uber có thể tăng giá, nhưng không cần thay đổi kịch bản kinh tế nền tảng một cách ngoạn mục, và người dùng cũng không cần hoàn toàn thay đổi cách họ sử dụng sản phẩm — chỉ vì Uber đột nhiên bắt đầu tính phí theo gallon.

Các gói đăng ký AI hàng tháng đều là một phần của trò lừa trợ cấp AI — một nỗ lực cố ý tách rời AI tạo sinh khỏi chi phí thực tế của nó

Chưa từng — và sẽ chẳng bao giờ tồn tại — một cách nào về mặt kinh tế khả thi để cung cấp dịch vụ do LLM điều khiển, trừ khi tính phí theo mức tiêu thụ token thực tế của từng người dùng. Và trong quá trình lừa dối người dùng, các công ty này đã tạo ra những sản phẩm với lợi ích ảo và tỷ suất hoàn vốn đáng nghi ngờ.

Điều này đã rõ ràng trong nhiều năm qua.

Về góc độ kinh tế, mô hình đăng ký hàng tháng chỉ hợp lý khi chi phí tương đối ổn định. Phòng tập thể hình có thể bán thẻ hội viên vì họ có thể ước tính tương đối chính xác mức hao mòn thiết bị, chi phí tổ chức lớp học, và chi phí điện, nhân sự, nước trong một khoảng thời gian xác định.

Chi phí của khách hàng Google Workspace — ít nhất là trước khi có AI — chủ yếu nằm ở chi phí truy cập hoặc lưu trữ tài liệu, và chi phí duy trì Google Docs cùng các dịch vụ khác. Chi phí lưu trữ kỹ thuật số tương đối thấp (và khác với LLM, Google Workspace không đòi hỏi nhiều tài nguyên tính toán), nghĩa là một người dùng Google Drive “nặng” đặc biệt cũng sẽ không làm xói mòn lợi nhuận từ phí đăng ký hàng tháng của họ.

Tuy nhiên, các dịch vụ này cố tình che giấu số lượng token hoặc chi phí thực tế cho một hoạt động cụ thể — điều này khiến người dùng thực sự không hiểu giới hạn tốc độ nghĩa là gì, và dẫn đến việc mỗi lần giới hạn tốc độ thay đổi đột ngột đều khiến khách hàng vội vã tìm cách xác định họ thực sự có thể làm được bao nhiêu việc với dịch vụ.

Đây là một cách kinh doanh tàn bạo, thao túng và lừa đảo — tồn tại duy nhất nhằm giúp Anthropic, OpenAI và các công ty AI khác mở rộng cơ sở người dùng, bởi đa số người dùng AI hoàn toàn cảm nhận lợi ích thực hoặc tưởng tượng của mình thông qua lăng kính “đốt” 8–13,5 đô la chi phí tính toán cho mỗi đô la phí đăng ký.

Mục tiêu duy nhất của hành vi gian lận cố ý này là đảm bảo đa số người dùng sẽ không bao giờ tiếp cận chi phí thực tế của AI tạo sinh. Khi The Atlantic viết một bài xã luận đầy nhiệt huyết về Claude Code như “khoảnh khắc ChatGPT” của Anthropic, bài viết dựa trên gói đăng ký 20 đô la/tháng — chứ không dựa trên chi phí token thực tế mà Anthropic phải bỏ ra để cung cấp dịch vụ, và điều này khiến tác giả dễ dàng bỏ qua những “lỗi nhỏ” có thể xảy ra ở mô hình, hoặc khi nó “bị kẹt ở các tác vụ lập trình phức tạp hơn”.

Nếu tác giả phải trả trực tiếp cho lượng token tiêu thụ thực tế, và mỗi lần bị kẹt đều khiến cô ấy mất 15 đô la tiền token, tôi không tin cô ấy sẽ dễ dàng bỏ qua những sự cố đó.

Nhưng tất cả đều là một phần của trò lừa đảo.

Rất, rất quan trọng là những người viết về AI trên các phương tiện truyền thông chính thống thực tế không hiểu rõ dịch vụ này tốn bao nhiêu tiền, và bất kỳ bài viết chính thống nào về ChatGPT hay Claude Code đều do những người gần như hoàn toàn không biết chi phí thực tế cho từng tác vụ riêng lẻ viết ra.

Hãy nhớ: Các dịch vụ AI tạo sinh phần lớn là sản phẩm thử nghiệm, chức năng không giống bất kỳ phần mềm hay phần cứng hiện đại nào khác. Con người không thể đơn giản bước đến trước ChatGPT hay Claude và bắt đầu yêu cầu nó làm việc.

Tôi nói thật đấy — bạn có thể làm như vậy, nhưng nếu lời nhắc (prompt) của bạn sai, bạn không hiểu cách nó vận hành, hoặc bạn phạm lỗi trong dữ liệu đầu vào, hoặc nếu nó đơn giản là hiểu sai, nó sẽ xuất ra thứ bạn không thích — điều này lại buộc bạn phải nhắc lại nó. Về bản chất, LLM là không thể đoán trước.

Bạn không thể đảm bảo LLM sẽ thực hiện một hành động cụ thể nào đó, hay sẽ trả về một kết quả dựa trên thực tế. Bạn cũng không thể xác định chắc chắn chi phí cho một tác vụ cụ thể — ngay cả khi bạn đã từng thực hiện tác vụ đó nhiều lần bằng LLM — và bạn cũng không thể xác định chắc chắn khi nào mô hình có thể “phát điên” và xóa bỏ thứ gì đó, hoặc thậm chí không làm gì cả nhưng lại khẳng định đã làm.

Nếu người dùng buộc phải trả đúng mức phí thực tế, tôi tin rằng nhiều người sẽ lập tức từ bỏ sản phẩm — bởi vì chỉ cần bạn “thử nghiệm linh tinh” để khám phá khả năng của LLM, bạn dễ dàng đốt sạch 5 đô la tiền token.

Ghi chú bên lề: Thực tế, bạn có thể đốt rất nhiều tiền mà vẫn không đạt được kết quả mong muốn — bởi LLM không phải là trí tuệ nhân tạo thực sự! Bất kỳ ai thực sự hiểu giới hạn của nó đều có thể dễ dàng tiêu tốn 30, 50, thậm chí 100 đô la để thuyết phục LLM làm điều mà nó kiên quyết tuyên bố mình có thể làm. Có một thuật ngữ dành riêng cho điều này: nịnh bợ. LLM thường được thiết kế để khẳng định người dùng — ngay cả khi người dùng đang nói những điều nguy hiểm và điên rồ — và điều này có thể mở rộng đến mức “Bạn muốn thực hiện điều gì đó lớn lao, hoàn toàn không khả thi về mặt kỹ thuật hoặc kinh tế sao? Tất nhiên rồi!” Đó chính là lý do ngành công nghiệp nỗ lực che giấu chi phí này đến vậy — đây chính là trò “ăn chặn” trắng trợn!

Tôi tin rằng việc chuyển đa số gói đăng ký AI sang mô hình tính phí theo token là điều không thể tránh khỏi — đặc biệt là Anthropic và OpenAI hiện đã áp dụng mô hình này với khách hàng doanh nghiệp.

Các doanh nghiệp thông thường có thể chịu đựng được việc chuyển sang tính phí theo token không? Anthropic ước tính người dùng chi từ 13–30 đô la/ngày trên Claude Code (hơn 7.000 đô la/năm), trong khi các tổ chức lớn chi hàng trăm nghìn hoặc hàng triệu đô la mỗi năm

Như tôi đã thảo luận tuần trước, CTO của Uber từng phát biểu tại một hội nghị rằng công ty đã tiêu hết toàn bộ ngân sách AI cho năm 2026 chỉ trong vài tháng; Goldman Sachs khuyến nghị một số công ty chi tới 10% lương nhân viên cho token AI — và con số này có thể tăng lên 100% trong vài quý tới.

Đây là hệ quả trực tiếp của việc đào tạo mọi người dùng AI chi tiêu tối đa cho các dịch vụ này trong khi che giấu chi phí thực tế. Mọi công ty lớn yêu cầu “mọi nhân viên sử dụng AI tối đa” đều đang làm như vậy trong khi hoàn toàn phớt lờ hoặc tách biệt khỏi mức tiêu thụ token thực tế — và khi các công ty buộc phải trả chi phí thực tế, tôi không chắc bạn sẽ chứng minh được bất kỳ khoản đầu tư nào vào công nghệ này là hợp lý về mặt kinh tế như thế nào.

Tất nhiên, bạn sẽ nói những điều nhảm nhí như “kỹ sư giao code nhanh hơn”, tôi hiểu. Nhưng nhanh hơn bao nhiêu? Bạn kiếm thêm hoặc tiết kiệm được bao nhiêu tiền? Nếu bạn chi 10% chi phí nhân sự cho token AI, khoản chi phí bổ sung này có được bù đắp từ nơi khác không? Tôi không chắc là có. Tôi không chắc bất kỳ doanh nghiệp nào chi mạnh tay cho token đã thực sự nhìn thấy lợi tức đầu tư — đó cũng là lý do vì sao mọi nghiên cứu về ROI của AI đều không tìm thấy bằng chứng đáng kể nào.

Trong đa số trường hợp, những người say mê bàn luận về mọi khả năng của AI tạo sinh mà bạn đọc được đều đang trải nghiệm nó mà không phải chịu chi phí thực tế. Mỗi kẻ điên cuồng trên Twitter khoe cả đội kỹ sư của mình đang “sử dụng Claude Code điên cuồng”, đều dùng gói Teams đăng ký 125 đô la/người/tháng — với giới hạn sử dụng và gói tiêu dùng cá nhân 100 đô la/tháng của Anthropic gần như tương đương. Mỗi kẻ “quái vật” trên LinkedIn khẳng định mình “hoàn thành công việc cả tiếng đồng hồ chỉ trong vài phút” nhờ một sản phẩm Perplexity nào đó, cũng chỉ chi tối đa 200 đô la/tháng cho gói Max của Perplexity.

Thực tế, gói Teams đăng ký 10 người, 1.250 đô la/tháng kia, có thể dễ dàng đốt tới 5.000–10.000 đô la/tháng cho các cuộc gọi API — thậm chí còn hơn thế. Amol Avasare, Giám đốc Tăng trưởng của Anthropic, tuần trước cho biết gói Max của họ được thiết kế cho việc trò chuyện cường độ cao, chứ không phải cho những việc người dùng đang làm với Claude Code và Cowork — và ông khẳng định rõ ràng Anthropic hiện đang cân nhắc “những lựa chọn khác để tiếp tục cung cấp trải nghiệm chất lượng cao”, nói cách khác là “chúng tôi sẽ điều chỉnh giá vào lúc nào đó”.

Tôi không chắc người dùng có nhận thức đầy đủ về mức độ đắt đỏ của token — đặc biệt là trong các dự án lập trình liên quan đến kho mã nguồn lớn và thường xuyên gọi các công cụ lập trình và hạ tầng. Một người chi 200 đô la/tháng có thể chịu nổi mức 350, 400 hay 500 đô la không? Họ có thể chịu đựng việc chi vượt mức đó trong một tháng nào đó không? Nếu ngân sách vượt quá giới hạn thì sao? Hoặc nếu họ thực sự không đủ khả năng chi trả để hoàn thành công việc thì sao?

Để bạn có ví dụ thực tế hơn, cho đến đầu tháng 4, tài liệu phát triển dành cho Claude Code của chính Anthropic (phiên bản lưu trữ) vẫn ghi rõ: “[Người dùng Claude Code] có chi phí trung bình là 6 đô la/người/ngày, và 90% người dùng giữ chi phí hàng ngày dưới 12 đô la.” Đến tuần này, tài liệu đã được cập nhật như sau:

Claude Code tính phí dựa trên lượng token API tiêu thụ. Giá các gói đăng ký (Pro, Max, Team, Enterprise) xem tại claude.com/pricing. Chi phí cho mỗi nhà phát triển thay đổi đáng kể tùy theo lựa chọn mô hình, kích thước kho mã nguồn và mô hình sử dụng (ví dụ như chạy nhiều phiên bản hoặc tự động hóa). Trong triển khai doanh nghiệp, chi phí trung bình khoảng 13 đô la/người/ngày làm việc tích cực, tương đương 150–250 đô la/tháng, và 90% người dùng giữ chi phí dưới 30 đô la/ngày làm việc tích cực. Để ước tính chi phí cho nhóm của bạn, hãy bắt đầu từ một nhóm thử nghiệm nhỏ, sử dụng công cụ theo dõi dưới đây để thiết lập mốc chuẩn, rồi mới mở rộng quy mô.

Nếu ta giả định một tháng trung bình có 21 ngày làm việc, chi phí trung bình cho người dùng Claude Code là khoảng 273 đô la/tháng, hay 3.276 đô la/năm. Với mức 30 đô la/ngày làm việc, con số này là 630 đô la/tháng, hay 7.560 đô la/năm.

Những con số này thật đáng kinh ngạc — và còn đáng kinh ngạc hơn khi bạn nhận ra rằng nếu bạn sử dụng bất kỳ mô hình nào mới hơn của Anthropic, bạn sẽ không thể chỉ chi 30 đô la/ngày. Claude Opus 4.7 có giá 5 đô la/mỗi triệu token đầu vào và 25 đô la/mỗi triệu token đầu ra. Một triệu token tương đương khoảng 50.000 dòng mã — và nếu bạn sử dụng mô hình “tiên tiến nhất” được quảng cáo, bạn chắc chắn sẽ tiêu thụ ít nhất một triệu token, và con số này sẽ tăng vọt nếu bạn không rõ nên dùng mô hình nào cho từng tác vụ cụ thể.

Hãy cùng phân tích thêm con số 30 đô la này.

Với một đội phát triển 10 người, chi phí một năm là 75.600 đô la — và chúng ta mới chỉ tính ngày làm việc.

Nếu trong ba tháng bạn tăng lên mức trung bình 50 đô la/ngày làm việc, tổng chi phí sẽ tăng lên 88.200 đô la.

Nếu bạn thêm một tháng chi hơn 100 đô la/ngày, tổng chi phí một năm sẽ là 102.900 đô la.

Nếu bạn chi 300 đô la/ngày, thì 10 người sẽ tiêu tốn 756.000 đô la/năm.

Dù điều này có thể khả thi trong các công ty khởi nghiệp có vốn dồi dào hoặc trong tư duy “dự trữ sẵn” của Meta — một kiểu “cộng hòa chuối” — thì bất kỳ doanh nghiệp nào thực sự quan tâm đến chi phí đều sẽ gặp khó khăn trong việc biện minh cho việc chi thêm năm hoặc sáu chữ số cho một dịch vụ “tăng năng suất”, trong khi hiệu quả tăng năng suất này dường như chẳng ai có thể đo lường được.

Hiện tại, tôi cho rằng đa số công ty có thể chia thành ba loại:

Các triển khai doanh nghiệp trong các tổ chức lớn như Spotify hoặc Uber, nơi CEO cuồng tín AI cho phép ngân sách không kiểm soát. Tôi cũng xếp các công ty khởi nghiệp lớn có vốn dồi dào vào nhóm này.

Các công ty khởi nghiệp nhỏ sử dụng gói “Teams” được trợ cấp.

Các cá nhân trả phí hàng tháng để truy cập Claude hoặc các dịch vụ AI đăng ký khác.

Các tổ chức lớn vẫn có thể lập luận rằng họ đang đốt hàng triệu đô la tiền token AI cho các kỹ sư phần mềm, với lý do đáng ngờ là “các kỹ sư giỏi nhất” không viết bất kỳ dòng mã nào.

Chỉ cần một cuộc họp báo cáo tài chính tồi tệ là đủ để thay đổi lập luận này. Đến một lúc nào đó, các nhà đầu tư — ngay cả những kẻ ngốc nghếch và điên cuồng nhất luôn thổi phồng bong bóng AI — cũng sẽ bắt đầu đặt câu hỏi về chi phí R&D leo thang không ngừng (chi phí token AI thường được giấu kín ở đây), khi doanh thu của công ty không theo kịp. Điều này rất có thể dẫn đến nhiều đợt sa thải hơn để kiểm soát chi phí — như Meta đã làm — và cuối cùng là thu hẹp quy mô khi có người đặt câu hỏi: “Những thứ này thực sự giúp chúng ta hoàn thành công việc nhanh hơn và tốt hơn chưa?”

Tôi cũng tin rằng trong vòng sáu tháng tới, các công ty khởi nghiệp đốt hơn 10% chi phí nhân sự cho token AI sẽ gặp khó khăn trong việc thuyết phục nhà đầu tư rằng điều này là cần thiết.

Khi tất cả đều chuyển sang mô hình tính phí theo token, tôi không chắc chúng ta sẽ còn thấy nhiều lời ca ngợi về AI tạo sinh như hiện nay.

Kinh tế học của trung tâm dữ liệu và năng lực tính toán AI là phi lý

Cách người ta nói về trung tâm dữ liệu AI hoàn toàn tách rời thực tế — và tôi tin rằng người ta không nhận ra toàn bộ thời đại này đã trở nên phi lý đến mức nào.

Trung tâm dữ liệu AI tốn kém cả chi phí xây dựng và vận hành, nhưng doanh thu thực tế lại rất ít

Theo Jerome Darling của TD Cowen, chi phí IT cốt lõi (GPU và phần cứng liên quan) khoảng 30 triệu đô la, và chi phí cho mỗi megawatt (MW) công suất trung tâm dữ liệu là 14 triệu đô la. Thời gian xây dựng trung tâm dữ liệu thường dao động từ một đến ba năm — và đó còn là trong điều kiện có sẵn nguồn cung cấp điện.

Trong tổng số 114 GW trung tâm dữ liệu dự kiến hoàn thành vào cuối năm 2028, chỉ có 15,2 GW đang trong giai đoạn xây dựng theo bất kỳ hình thức nào. Còn cụm từ “đang xây dựng” có thể chỉ đơn giản có nghĩa là “trên mặt đất có một cái hố”. Nó không có nghĩa — và cũng không nên có nghĩa — rằng công suất mà cơ sở này cung cấp sẽ sớm sẵn sàng sử dụng.

Hãy bắt đầu đơn giản: Mỗi khi bạn nghĩ đến “100 MW”, hãy nghĩ ngay đến “4,4 tỷ đô la”, trong đó phần lớn dành cho GPU của NVIDIA.

Vì vậy, mỗi trung tâm dữ liệu AI đều bắt đầu trong tình trạng lỗ hàng triệu đô la, và ngay cả với kế hoạch khấu hao sáu năm, cũng phải mất nhiều năm mới có thể thu hồi vốn… và với chu kỳ nâng cấp hàng năm của NVIDIA, một khi bạn hoàn tất hợp đồng khách hàng đầu tiên, những GPU đó rất khó có thể tạo ra nhiều lợi nhuận như mong đợi.

Hiện vẫn chưa rõ nhóm khách hàng cho năng lực tính toán AI có tồn tại ngoài OpenAI và Anthropic hay không — hai công ty này chiếm tới 50% nhu cầu cho các trung tâm dữ liệu AI đang được xây dựng; nếu một trong hai bên không có khả năng thanh toán, sẽ tạo ra một điểm yếu hệ thống nghiêm trọng.

Dù sao, cũng chưa rõ các trung tâm dữ liệu này sẽ thu phí theo mức nào trong dài hạn. Mặc dù giá thị trường (spot price) có thể vào khoảng 4,50 đô la/giờ cho mỗi GPU B200, nhưng giá hợp đồng dài hạn thường thấp hơn nhiều — một nhà sáng lập (theo The Information) cho biết họ trả khoảng 3,70 đô la/giờ/GPU cho cam kết một năm.

Cần làm rõ: Chúng ta phải phân biệt giữa chi phí thị trường — chi phí khởi động GPU ngẫu nhiên trên máy chủ của người khác — và năng lực tính toán theo hợp đồng, vốn chiếm phần lớn chi phí đầu tư ban đầu (CAPEX) của trung tâm dữ liệu. Đa số trung tâm dữ liệu được xây dựng với mục đích phục vụ một hoặc hai khách hàng lớn, nghĩa là các khách hàng này có thể thương lượng được mức giá hỗn hợp rẻ hơn.

Vì vậy, nhiều trung tâm dữ liệu tính phí thấp hơn nhiều so với 3,70 đô la/giờ — bởi họ tính phí theo megawatt (hoặc kilowatt).

Đây là nơi kinh tế học bắt đầu sụp đổ.

Kinh tế học sụp đổ của trung tâm dữ liệu 100 MW — 2,55 đô la/giờ, biên lợi nhuận gộp 16% ở mức sử dụng 100%, nhưng thua lỗ do nợ

Đây là chi phí ban đầu cho một trung tâm dữ liệu 100 MW. Một trung tâm dữ liệu 100 MW có thể chỉ có 85 MW công suất tính phí thực tế, theo thảo luận với các nguồn tin am hiểu về cách tính phí siêu quy mô, họ ước tính doanh thu mỗi MW khoảng 12,5 triệu đô la, tương đương doanh thu hàng năm khoảng 1,063 tỷ đô la.

Bây giờ, tôi cần làm rõ: Hầu hết các công ty trung tâm dữ liệu bạn biết thực tế không tự xây dựng chúng, mà giao việc này cho các công ty như Applied Digital — còn được gọi là “đối tác quản lý”. Ví dụ, CoreWeave trả phí quản lý cho Applied Digital để sử dụng trung tâm dữ liệu tại Bắc Dakota. CoreWeave chịu trách nhiệm về toàn bộ GPU và các công nghệ khác bên trong trung tâm dữ liệu.

Để giải thích sự lệch lạc kinh tế, tôi sẽ sử dụng một ví dụ lý thuyết — một trung tâm dữ liệu cho thuê cho một công ty lý thuyết về năng lực tính toán AI.

GPU trong trung tâm dữ liệu này rất có thể là chip Blackwell của NVIDIA. Khả năng cao hơn là trung tâm dữ liệu sử dụng các cụm (pod) gồm 8 GPU B200, giá bán lẻ khoảng 450.000 đô la/cụm, hay 56.250 đô la/GPU. Với tải IT cốt lõi 85 MW, tổng CAPEX IT mỗi MW khoảng 36,78 triệu đô la, hay tổng CAPEX IT khoảng 3,126 tỷ đô la, trong đó riêng GPU chiếm khoảng 2,67 tỷ đô la.

Giả sử trung tâm dữ liệu này nằm tại Ellendale, Bắc Dakota — nghĩa là giá điện công nghiệp khoảng 6,31 cent/kWh, chi phí điện hàng năm khoảng 55,4 triệu đô la. Theo thảo luận với các nguồn tin, tôi ước tính chi phí duy trì, nhân sự, thay thế nguồn điện và các chi phí liên tục khác chiếm khoảng 12% doanh thu, hay khoảng 128 triệu đô la/năm — đưa tổng chi phí lên 183,4 triệu đô la.

Chờ đã, xin lỗi. Bạn còn phải trả phí quản lý cho IT cốt lõi — theo Brightlio, phí này thường khoảng 180–200 đô la/kW/tháng, tùy quy mô và vị trí triển khai, mặc dù tôi từng đọc thấy mức thấp tới 130 đô la — và tôi sẽ lấy con số này, tương đương khoảng 133 triệu đô la/năm. Tổng chi phí hiện tại là 316,4 triệu đô la.

Ồ, con số này vẫn thấp hơn 1,06 tỷ đô la, vậy là chúng ta vẫn ổn, đúng không?

Sai rồi! Bạn có 3,126 tỷ đô la thiết bị IT cần khấu hao — với kế hoạch khấu hao sáu năm, chi phí khấu hao hàng năm khoảng 521 triệu đô la. Như vậy, tổng chi phí hàng năm là 837,4 triệu đô la, để lại khoảng 168,6 triệu đô la lợi nhuận hàng năm, hay biên lợi nhuận gộp khoảng 16,7%…

…nếu bạn duy trì mức sử dụng 100% suốt thời gian! Thấy chưa? Trung tâm dữ liệu có thể cần một đến hai tháng để lắp đặt GPU và đưa khách hàng vào sử dụng — trong thời gian đó doanh thu của bạn bằng không, nhưng chi phí lại lớn hơn nhiều, vì bạn vẫn phải trả phí quản lý, điện và vận hành — dù mức phí thấp hơn nhiều (tôi mô hình hóa ở mức 10% chi phí điện và 15% chi phí quản lý/vận hành), nghĩa là bạn lỗ khoảng 3,27 triệu đô la mỗi ngày.

Để ví dụ này, chúng ta giả định bạn cần thêm một tháng nữa để đưa hệ thống này vận hành — nghĩa là bạn đã chi khoảng 102 triệu đô la, không thể thu hồi, khiến tổng chi phí hàng năm (bao gồm khấu hao) đạt 939,4 triệu đô la, hay biên lợi nhuận gộp 6,6%.

Chết tiệt, bạn không mua GPU này bằng nợ chứ? Bạn dùng rồi à? Tệ đến mức nào? Ôi trời — bạn đã vay một khoản vay đảm bảo bằng tài sản kỳ hạn sáu năm, với tỷ lệ giá trị cho vay (LTV) 80%, nghĩa là bạn vay 2,8 tỷ đô la với lãi suất 6%.

Ngân hàng của bạn, với lòng rộng lượng vĩnh cửu, đã cho bạn một ưu đãi — thời gian ân hạn 12 tháng, bạn chỉ trả lãi… khoảng 168 triệu đô la — khiến tổng chi phí năm đầu tiên (không tính tháng trì hoãn để công bằng) đạt khoảng 1,005 tỷ đô la… trong khi doanh thu là 1,06 tỷ đô la.

Đó là biên lợi nhuận gộp 5,19%, và bạn thậm chí chưa bắt đầu trả gốc. Khi điều đó xảy ra, bạn phải trả 54,1 triệu đô la/tháng cho khoản vay, tổng cộng khoảng 649 triệu đô la/năm trong năm năm tiếp theo — tức khoảng 1,48 tỷ đô la, hay biên lợi nhuận gộp âm khoảng 40%.

Tôi phải làm rõ: Đây là nếu bạn đạt mức sử dụng 100% và khách thuê luôn thanh toán đúng hạn.

Stargate Abilene là một thảm họa — 2,94 đô la/GPU/giờ, doanh thu hàng năm 10 tỷ đô la, tiến độ chậm hàng năm, và chỉ có một khách thuê đang lỗ hàng tỷ đô la mỗi năm

Hãy nói về dự án được kỳ vọng là khả thi nhất về mặt kinh tế trong lịch sử trung tâm dữ liệu — một khu phức hợp trung tâm dữ liệu quy mô lớn do Oracle xây dựng cho công ty AI lớn nhất thế giới. Oracle là một doanh nghiệp gần siêu quy mô với hàng chục năm kinh nghiệm, có lịch sử bán các phần mềm cơ sở dữ liệu và quản lý doanh nghiệp đắt đỏ cho doanh nghiệp và chính phủ.

Ha, tôi đương nhiên đang đùa — nơi này là một cơn ác mộng thực sự.

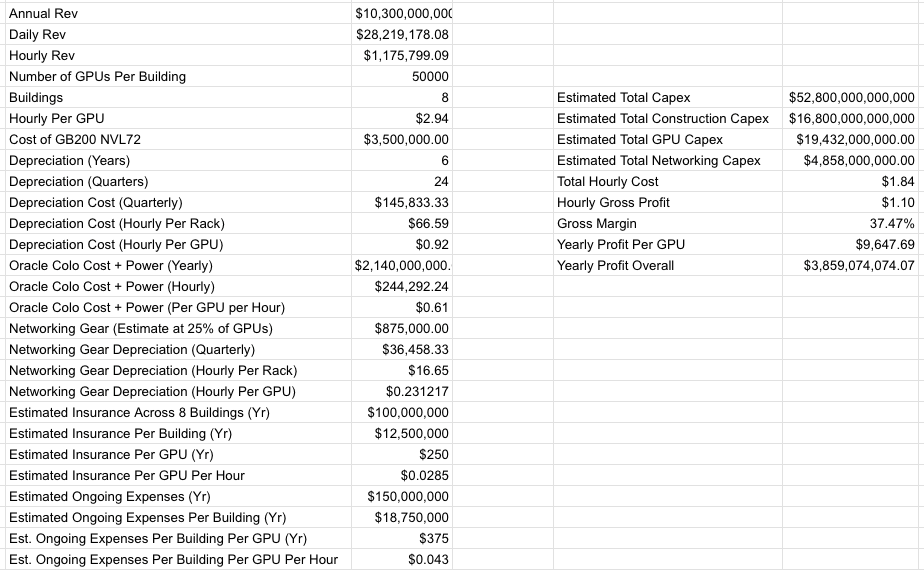

Stargate Abilene — một khu phức hợp trung tâm dữ liệu gồm tám tòa nhà, công suất 1,2 GW, với khoảng 824 MW tải IT cốt lõi — lần đầu tiên được công bố vào tháng 7 năm 2024. Tính đến ngày 27 tháng 4 năm 2026, chỉ có hai tòa nhà đang vận hành và tạo ra doanh thu, còn tòa thứ ba gần như không có thiết bị IT nào. Tôi ước tính tổng chi phí của Stargate Abilene khoảng 52,8 tỷ đô la.

Theo báo cáo của tôi, Oracle dự kiến thu về khoảng 10 tỷ đô la doanh thu hàng năm từ Stargate Abilene, và tôi ước tính tổng doanh thu khoảng 75 tỷ đô la từ 7,1 GW công suất trung tâm dữ liệu mà họ xây dựng cho một khách hàng duy nhất: OpenAI. Như tôi cũng đã đưa tin, Oracle ước tính vào năm 2024 rằng Abilene sẽ phải trả ít nhất 2,14 tỷ đô la/năm cho phí quản lý và điện cho nhà phát triển đất Crusoe.

Tôi cũng nên bổ sung rằng dường như Oracle đang tự chi trả toàn bộ chi phí xây dựng Abilene.

Theo tính toán và báo cáo của tôi, tôi ước tính Abilene khi vận hành đầy đủ sẽ có biên lợi nhuận gộp thô khoảng 37,47%:

Tôi phải làm rõ: Biên lợi nhuận gộp 37,47% có thể cao quá mức, vì tôi không biết chính xác chi phí bảo hiểm hoặc nhân sự thực tế của Oracle — chỉ có các ước tính dựa trên tài liệu mà ấn phẩm này đã xem xét. Tôi cũng nên làm rõ rằng Oracle đang đặt toàn bộ tương lai của mình vào các dự án như Stargate Abilene, với chi phí đầu tư hàng tỷ đô la từ trước, và lĩnh vực kinh doanh này — ngay cả khi OpenAI thanh toán đúng hạn mọi khoản — cũng cần nhiều năm mới có thể sinh lời.

Thật không may, tôi không thể xác định được Abilene đã được tài trợ bằng nợ ở mức độ nào. Tôi chỉ biết Oracle đã huy động khoảng 18 tỷ đô la vào tháng 9 năm 2025 thông qua việc phát hành trái phiếu với các kỳ hạn từ 7 đến 40 năm, và trong báo cáo tài chính quý gần nhất đã ghi nhận dòng tiền tự do âm 24,7 tỷ đô la.

Điều tôi thực sự biết là Oracle đã ký một hợp đồng thuê 15 năm với nhà phát triển Crusoe, và tương lai của Oracle phụ thuộc nặng nề vào khả năng OpenAI tiếp tục thanh toán — điều này lại phụ thuộc vào khả năng Oracle hoàn thành dự án Stargate Abilene.

Tôi cũng cần làm rõ rằng lợi nhuận hàng năm 3,85 tỷ đô la chỉ có thể đạt được nếu OpenAI thanh toán đúng hạn, nhập cư vào Abilene với tốc độ nhanh nhất có thể và mọi việc diễn ra đúng kế hoạch.

Nếu OpenAI không thể huy động được 852 tỷ đô la doanh thu, tài trợ và nợ trong vòng 4 năm tới, dự án trung tâm dữ liệu Stargate sẽ làm sụp đổ Oracle

Thật không may, điều hoàn toàn ngược lại đã xảy ra:

Theo báo cáo của DatacenterDynamics, 200 MW điện đầu tiên dự kiến được đưa vào sử dụng “vào năm 2025”. Theo thời gian, việc nhập cư dự kiến bắt đầu vào nửa đầu năm 2025, “có tiềm năng đạt 1 GW vào năm 2025”, hoàn thành toàn bộ công suất 1,2 GW vào giữa năm 2026, cấp điện vào giữa năm 2026 và triển khai 64.000 GPU vào cuối năm 2026. Tính đến ngày 30 tháng 9 năm 2025, “hai tòa nhà đã đi vào hoạt động”. Tính đến ngày 12 tháng 12 năm 2025, Clay Magouyurk, đồng Giám đốc điều hành của Oracle, cho biết Abilene “đang tiến triển đúng kế hoạch”, “đã giao hơn 96.000 GPU NVIDIA Grace Blackwell GB200”, tức là số lượng GPU cho hai tòa nhà. Bốn tháng sau, vào ngày 22 tháng 4 năm 2026, Oracle đăng trên X (Twitter): “…tại Abilene, 200 MW đã đi vào vận hành, và việc bàn giao khu phức hợp tám tòa nhà vẫn đang tiến triển đúng kế hoạch.” Hiện không rõ đây là 200 MW công suất IT cốt lõi hay tổng công suất điện khả dụng của khu Abilene. Dù sao, con số này cũng chỉ đủ để hỗ trợ hai tòa nhà — nghĩa là Oracle tuyệt đối không “đang tiến triển đúng kế hoạch”.

Đây là một vấn đề lớn. OpenAI chỉ có thể trả tiền cho năng lực tính toán thực tế tồn tại — và chỉ có 206 MW công suất IT cốt lõi thực sự tạo ra doanh thu, trong khi tòa nhà thứ ba ít nhất còn cần thêm một tháng (nếu không phải là một quý) nữa mới có thể đưa vào sử dụng.

Tuy nhiên, toàn bộ dự án trung tâm dữ liệu Stargate còn có một vấn đề lớn hơn và căn bản hơn — tất cả chỉ có ý nghĩa nếu OpenAI đạt được những dự báo phi lý, mang tính hoạt hình.

Như tôi đã thảo luận vào thứ Sáu:

Tôi xin nhắc lại các con số này: Sau khi hoàn thành, 7,1 GW trung tâm dữ liệu Stargate đang được xây dựng sẽ tạo ra doanh thu hàng năm khoảng 75 tỷ đô la, với tổng chi phí vượt quá 340 tỷ đô la. Dòng tiền tự do của Oracle là âm 24,7 tỷ đô la, các mảng kinh doanh khác đang đình trệ, khiến mảng điện toán đám mây — đang từ âm lợi nhuận chuyển sang lợi nhuận thấp — trở thành động lực tăng trưởng duy nhất. Để thực sự có khả năng thanh toán các hợp đồng năng lực tính toán của mình — bao gồm các hợp đồng với Amazon, Microsoft, CoreWeave, Google, Cerberas và chính Oracle — OpenAI phải huy động hoặc kiếm được 852 tỷ đô la doanh thu và/hoặc tài trợ trong vòng bốn năm, điều này đòi hỏi doanh nghiệp của họ phải tăng trưởng hơn 250% mỗi năm, và thực tế tăng trưởng 10 lần vào cuối năm 2030, khi nó phải tìm ra cách đạt dòng tiền dương — những con số này mới có ý nghĩa. Nói rõ ràng, dự báo của OpenAI là sẽ kiếm được 673 tỷ đô la trong bốn năm tới và đốt 218 tỷ đô la để làm điều đó. Đây là một doanh nghiệp cực kỳ phi lợi nhuận — ngay cả khi nó có thể sinh lời, nó cũng phải kiếm được nhiều hơn rất nhiều so với hiện tại để tiếp tục thanh toán cho Oracle.

Tôi tính ra con số 75 tỷ đô la này dựa trên giả định rằng GPU Vera Rubin sẽ đạt khoảng 14 triệu đô la/MW cho phần còn lại của 4,64 GW công suất IT cốt lõi — con số này tôi đã xác nhận với các nguồn tin am hiểu ngành trung tâm dữ liệu — và đây là công suất tôi dự kiến cấu thành phần còn lại của trung tâm dữ liệu Stargate.

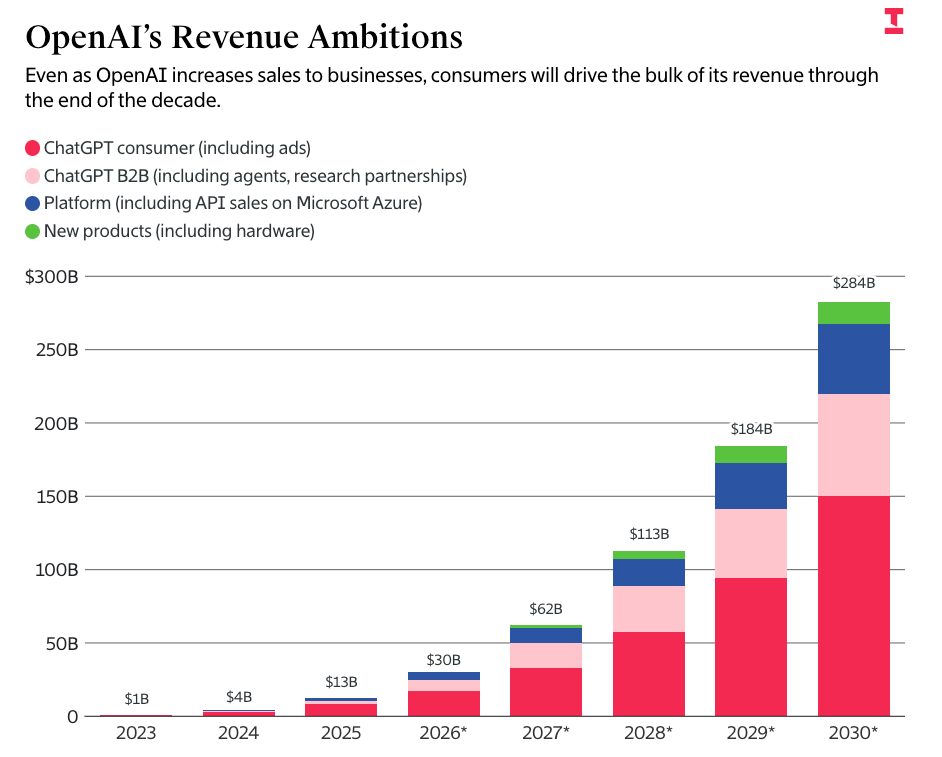

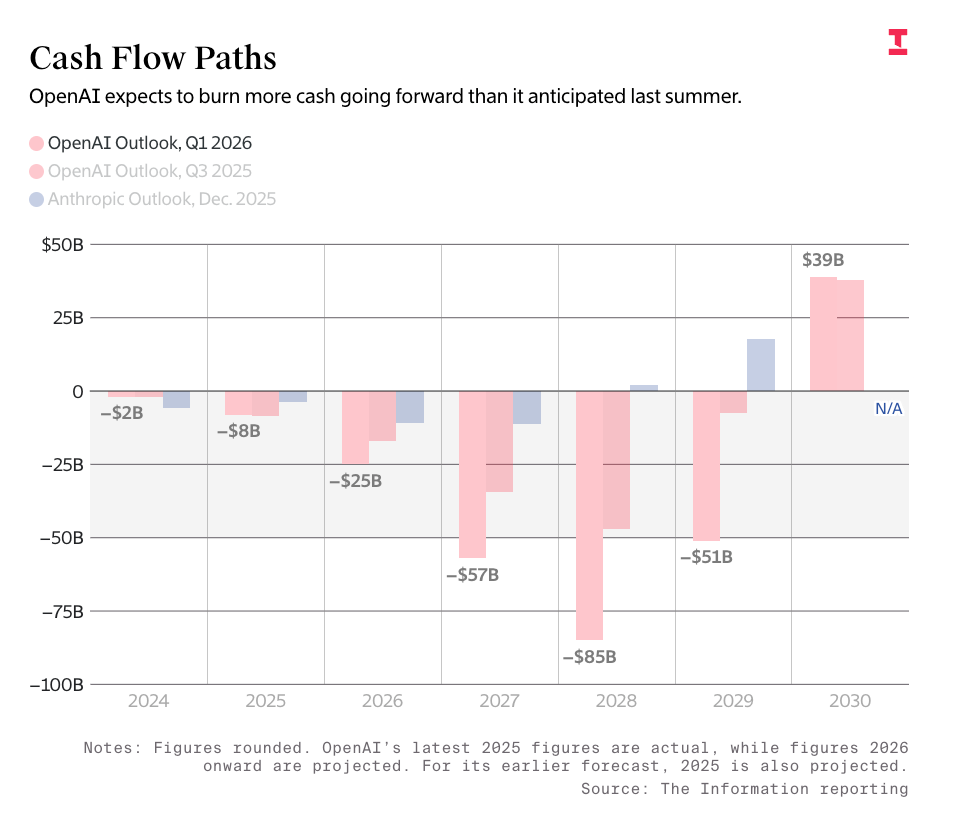

Các con số của OpenAI được lấy trực tiếp từ thông tin rò rỉ được The Information đưa tin về dự báo tốc độ đốt tiền và doanh thu của OpenAI, công ty này dự kiến sẽ tạo ra 673 tỷ đô la doanh thu vào cuối năm 2030 và đốt 852 tỷ đô la để làm điều đó:

Tôi phải làm rõ: Bất kỳ phóng viên nào lặp lại những con số này mà không chỉ ra mức độ ngu ngốc của chúng đều nên cảm thấy hơi xấu hổ. Theo nội dung trả phí của tôi vào thứ Sáu:

Nói cách khác, OpenAI dự báo doanh thu hai năm tới sẽ vượt qua TSMC, doanh thu hàng năm ba năm tới gần bằng Meta, và doanh thu hàng năm vào cuối năm 2030 sẽ bằng Microsoft (khoảng 300 tỷ đô la trong 12 tháng qua).

Nếu OpenAI không thể thanh toán chi phí năng lực tính toán này, Oracle sẽ sụp đổ — bởi riêng việc xây dựng trung tâm dữ liệu Stargate, Oracle đã gánh khoảng 115 tỷ đô la nợ, và còn cần thêm 150 tỷ đô la nữa để hoàn thành chúng:

Oracle là một công ty hiện có doanh thu hàng năm khoảng 64 tỷ đô la, và dòng tiền tự do quý gần nhất là âm 24,7 tỷ đô la. Công ty đã phát hành trái phiếu 18 tỷ đô la vào tháng 9 năm 2025, 25 tỷ đô la vào tháng 2 năm 2026, và một đợt chào bán trên thị trường trị giá 20 tỷ đô la vào tháng 3 — dù được gọi là “đã hoàn tất” từ nhiều tháng trước, nhưng dường như chỉ mới hoàn tất gần đây khoản tài trợ 38 tỷ đô la cho các dự án Stargate Wisconsin và Shackelford. Tôi cũng bao gồm khoản nợ trung tâm dữ liệu 14 tỷ đô la liên quan đến Stargate Michigan. Dù sao, Oracle cũng không có đủ vốn để hoàn thành Stargate Abilene. Công ty ít nhất còn cần thêm 150 tỷ đô la để hoàn thành công việc này — và đó còn là trong giả định các đối tác khác chịu khoảng 30 tỷ đô la chi phí. Thực tế, con số có thể còn cao hơn.

Tôi thực sự cần làm rõ rằng Oracle không có con đường nào khác để đạt được khoản doanh thu này nếu không có OpenAI, và các dự án này hoàn toàn được tài trợ và thanh toán bằng dòng tiền dự kiến từ chính trung tâm dữ liệu.

Tôi thậm chí không phải người duy nhất lo ngại về điều này — Sarah Friar của OpenAI cũng bày tỏ mối lo tương tự sau khi công ty không đạt được các mục tiêu về người dùng và doanh thu, theo báo cáo của Wall Street Journal:

OpenAI gần đây không đạt được các mục tiêu về người dùng và doanh thu mới, những thất bại này khiến một số lãnh đạo công ty lo ngại liệu công ty có thể duy trì chi tiêu quy mô lớn cho trung tâm dữ liệu hay không. Giám đốc tài chính Sarah Friar đã thông báo với các lãnh đạo khác rằng bà lo ngại nếu tăng trưởng doanh thu không đủ nhanh, công ty có thể không đủ khả năng thanh toán các hợp đồng tính toán trong tương lai, theo một nguồn tin am hiểu.

Hội đồng quản trị trong vài tháng gần đây cũng đã xem xét kỹ lưỡng hơn các giao dịch trung tâm dữ liệu của công ty và đặt câu hỏi về việc CEO Sam Altman vẫn nỗ lực giành thêm năng lực tính toán trong bối cảnh kinh doanh đang chậm lại, theo một nguồn tin am hiểu.

Nếu điều này vẫn chưa khiến bạn lo lắng, có lẽ điều này sẽ:

Bà ấy nhấn mạnh với các giám đốc điều hành và thành viên hội đồng quản trị về nhu cầu cải thiện kiểm soát nội bộ của OpenAI, cảnh báo rằng công ty chưa sẵn sàng đáp ứng các tiêu chuẩn báo cáo nghiêm ngặt yêu cầu đối với một công ty niêm yết. Một số nguồn tin am hiểu cho biết Altman có xu hướng theo đuổi lộ trình IPO tích cực hơn.

Nghe có vẻ như một công ty có thể kiếm được 852 tỷ đô la vào cuối thập kỷ này thật đấy!

Anthropic cũng tệ không kém OpenAI, cam kết lấy tới 10 GW năng lực tính toán từ Google và Amazon (doanh thu hàng năm hơn 100 tỷ đô la)

Dù tôi thường chỉ trích những cam kết phi lý của OpenAI, nhưng Anthropic cũng không hề kém cạnh — cam kết lấy “lên tới” 5 GW công suất từ cả Google và Amazon, và tôi ước tính thỏa thuận này bao gồm cam kết năng lực tính toán thực tế khoảng 100 tỷ đô la, dựa trên quy mô công suất.

Bây giờ, tôi nên bổ sung rằng Google và Amazon thông minh và ít tuyệt vọng hơn Oracle — nghĩa là nếu Anthropic cuối cùng cạn kiệt tài chính, họ có thể chịu được cú sốc này. Phần “lên tới” trong thỏa thuận mang lại cho họ một chút linh hoạt cấp thiết mà Oracle hoàn toàn không có.

Dù vậy, để thực sự thực hiện cam kết của mình, Anthropic phải đồng ý chi từ 25 đến 100 tỷ đô la mỗi năm cho năng lực tính toán vào cuối năm 2030.

Giám đốc tài chính của Anthropic cho biết vào tháng Ba rằng công ty đã tạo ra 5 tỷ đô la doanh thu trong suốt thời gian tồn tại.

Cần 156,8 tỷ đô la doanh thu năng lực tính toán AI hàng năm để hỗ trợ 15,2 GW trung tâm dữ liệu đang được xây dựng, và cần 1,18 nghìn tỷ đô la để hỗ trợ toàn bộ 114 GW đã được công bố

Sự phấn khích gần như khiêu dâm xung quanh hàng trăm tỷ đô la GPU mà Jensen Huang tuyên bố sẽ xuất xưởng thường xuyên, che giấu một câu hỏi đáng lo: Bán cho ai, Jensen?

Nếu chúng ta giả định công suất trung tâm dữ liệu đang được xây dựng là 15,2 GW (dự kiến hoàn thành trước cuối năm 2028) có hệ số PUE khoảng 1,35, thì chúng ta có khoảng 11,2 GW công suất IT cốt lõi. Với mức 14 triệu đô la/MW, để các trung tâm dữ liệu này có giá trị, cần khoảng 156,8 tỷ đô la doanh thu hàng năm từ việc thuê GPU.

Khi tính đến tổng công suất 114 GW dự kiến đi vào hoạt động trước cuối năm 2028, con số này tăng vọt lên 1,18 nghìn tỷ đô la doanh thu hàng năm.

Để bạn có bối cảnh, CoreWeave — nhà cung cấp đám mây mới lớn nhất, với khách hàng gồm Meta, OpenAI, Google (cho OpenAI), Microsoft (cho OpenAI), Anthropic và NVIDIA — đã tạo ra khoảng 5,1 tỷ đô la doanh thu và dự kiến sẽ tạo ra từ 12–13 tỷ đô la vào năm 2026.

Cuối cùng thì ai là khách hàng cho toàn bộ năng lực tính toán này, và khi toàn bộ công suất được xây dựng xong, khả năng họ mua là bao nhiêu? Mặc dù nhiều trung tâm dữ liệu khác nhau tuyên bố có khách thuê trong những năm đầu tiên tồn tại, nhưng các khách thuê này chỉ bắt đầu thanh toán sau khi trung tâm dữ liệu hoàn thành — và nếu là các công ty khởi nghiệp AI, thì câu hỏi hợp lý là: Khi trung tâm dữ liệu hoàn thành, họ còn tồn tại không?

Hãy nhớ: Khách hàng năng lực tính toán AI chủ yếu là các nhà cung cấp đám mây siêu quy mô đang cố gắng chuyển chi phí đầu tư ra khỏi bảng cân đối kế toán, hoặc các công ty khởi nghiệp AI không có lợi nhuận. Cả Anthropic và OpenAI đều dự định đốt hàng chục tỷ đô la trong vài năm tới, và cả hai đều không có lộ trình sinh lời.

Điều này có nghĩa là một phần lớn — nếu không phải phần lớn nhất — doanh thu năng lực tính toán AI phụ thuộc vào dòng vốn đầu tư mạo hiểm và nợ liên tục, và cả hai chỉ có thể duy trì nếu các nhà đầu tư vẫn tin rằng AI tạo sinh sẽ là thứ lớn nhất và vĩ đại nhất trên thế giới.

Điều này thực sự vận hành như thế nào? Ai đang trả tiền cho công suất trung tâm dữ liệu này? Đây là dành cho ai? Nhu cầu thực tế ở đâu?

Nếu nhu cầu này tồn tại, khách hàng sẽ trả tiền như thế nào?

AI tạo sinh là phi lợi nhuận và không bền vững — và chỉ ngày càng đắt đỏ hơn

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News