AI đã đọc cuốn “1984” và quyết định cấm xuất bản tác phẩm này

Tuyển chọn TechFlowTuyển chọn TechFlow

AI đã đọc cuốn “1984” và quyết định cấm xuất bản tác phẩm này

Những người phản đối đánh giá của AI đã mất việc, trong khi những người ký tên đồng ý với đánh giá của AI thì không gặp bất kỳ vấn đề gì.

Tác giả: Khổ Lý, TechFlow

Tuần trước, một trường trung học ở Manchester, Anh, đã sử dụng trí tuệ nhân tạo (AI) để rà soát thư viện của chính mình.

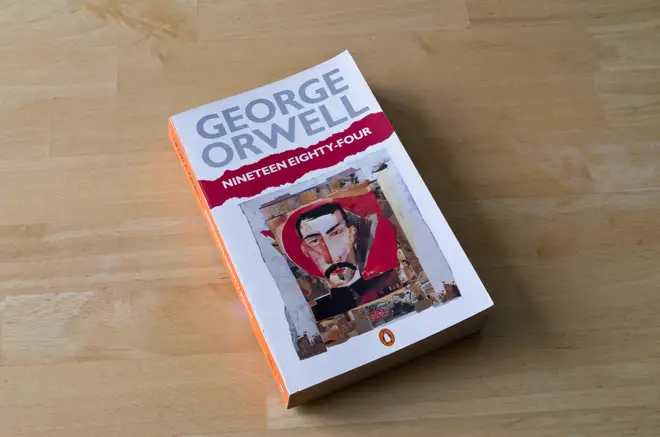

AI đã lập danh sách 193 cuốn sách cần loại bỏ, kèm theo lý do cho từng cuốn. Tác phẩm “1984” của George Orwell nằm ngay trong danh sách này, với lý do là “chứa các chủ đề tra tấn, bạo lực và cưỡng ép tình dục”.

“1984” viết về một thế giới nơi chính phủ giám sát mọi thứ, viết lại lịch sử và quyết định người dân được phép đọc hay không được phép đọc điều gì. Giờ đây, AI đã làm điều tương tự đối với một trường học — và có thể nó thậm chí còn chẳng hiểu nổi mình đang nói gì.

Thủ thư của trường cho rằng quyết định này là phi lý và từ chối thực hiện toàn bộ các khuyến nghị do AI đưa ra.

Ngay sau đó, nhà trường tiến hành điều tra nội bộ đối với bà với lý do “an toàn trẻ em”, cáo buộc bà đưa những cuốn sách không phù hợp vào thư viện và báo cáo sự việc lên chính quyền địa phương. Dưới áp lực nặng nề, bà phải nghỉ ốm và cuối cùng từ chức.

Điều trớ trêu là kết luận điều tra của chính quyền địa phương xác định bà thực sự đã vi phạm quy trình an toàn trẻ em và khiếu nại là có cơ sở.

Bà Carolyn Roche, Chủ tịch Hiệp hội Thư viện Trường học Anh Quốc, cho biết kết luận này đồng nghĩa với việc bà sẽ không còn được làm việc tại bất kỳ trường học nào nữa.

Người phản kháng đánh giá của AI đã mất việc; còn người ký duyệt đánh giá của AI thì chẳng gặp chuyện gì.

Sau đó, trong một tài liệu nội bộ, nhà trường thừa nhận toàn bộ phân loại và lý do đều do AI tạo ra, nguyên văn như sau: “Mặc dù phân loại được AI sinh ra, chúng tôi cho rằng phân loại này nhìn chung là chính xác.”

Một trường học đã giao việc phán xét “cuốn sách nào phù hợp với học sinh” cho AI; AI trả lại một câu trả lời mà chính nó cũng không hiểu; rồi một quản lý con người chỉ liếc qua rồi đóng dấu phê chuẩn.

Sự việc được Tổ chức Tự do Báo chí Anh Quốc Index on Censorship phanh phui, và những vấn đề đặt ra vượt xa một kệ sách của một trường học:

Khi AI bắt đầu thay con người quyết định nội dung nào là phù hợp, nội dung nào là nguy hiểm, thì ai sẽ là người đánh giá xem đánh giá của AI là đúng hay sai?

Wikipedia đóng cửa với AI

Cùng tuần đó, một tổ chức khác đã dùng hành động để trả lời câu hỏi trên.

Nhà trường để AI quyết định con người được đọc gì. Còn Wikipedia — bách khoa toàn thư trực tuyến lớn nhất thế giới — lại chọn hướng ngược lại: không để AI quyết định bách khoa viết gì.

Cùng tuần đó, Wikipedia tiếng Anh chính thức thông qua một chính sách mới, cấm sử dụng mô hình ngôn ngữ lớn để tạo hoặc viết lại nội dung các mục từ. Kết quả biểu quyết là 44 phiếu thuận, 2 phiếu chống.

Nguyên nhân trực tiếp là một tài khoản AI tên TomWikiAssist. Đầu tháng Ba năm nay, tài khoản này đã tự động tạo và chỉnh sửa nhiều mục từ trên Wikipedia, và bị cộng đồng phát hiện kịp thời để xử lý khẩn cấp.

AI chỉ mất vài giây để viết một mục từ, nhưng các tình nguyện viên phải mất hàng giờ để kiểm chứng tính chính xác của sự kiện, nguồn tham khảo và cách diễn đạt trong một mục từ do AI tạo ra.

Cộng đồng biên tập Wikipedia vốn chỉ có hạn. Nếu AI có thể sản xuất nội dung vô hạn, đội ngũ biên tập con người hoàn toàn không thể kiểm duyệt nổi.

Đó chưa phải phần nan giải nhất. Wikipedia là một trong những nguồn dữ liệu huấn luyện quan trọng nhất toàn cầu dành cho các mô hình AI. AI học kiến thức từ Wikipedia, rồi dùng những điều đã học để viết các mục từ Wikipedia mới; các mục từ mới này lại được đưa vào huấn luyện cho thế hệ mô hình AI tiếp theo.

Một khi thông tin sai lệch do AI tạo ra lọt vào vòng luẩn quẩn này, nó sẽ liên tục khuếch đại — trở thành một kiểu “độc AI dạng hộp đựng hộp”:

AI làm ô nhiễm dữ liệu huấn luyện, dữ liệu huấn luyện lại làm ô nhiễm AI.

Tuy nhiên, chính sách của Wikipedia vẫn để mở hai khe hở cho AI: biên tập viên được phép dùng AI để hiệu đính văn bản do chính họ viết, hoặc dùng AI hỗ trợ dịch thuật. Nhưng chính sách đặc biệt cảnh báo rằng AI “có thể vượt quá yêu cầu của bạn, thay đổi ý nghĩa văn bản khiến nó mâu thuẫn với nguồn dẫn chiếu”.

Khi tác giả con người mắc lỗi, hơn hai thập kỷ qua Wikipedia luôn dựa vào cộng đồng hợp tác để sửa chữa. Còn AI mắc lỗi theo một cách khác: những điều nó bịa ra trông thật hơn cả sự thật, và có thể được sản xuất hàng loạt.

Một trường học tin vào đánh giá của AI, kết quả là mất đi một thủ thư. Còn Wikipedia chọn không tin, và trực tiếp đóng sập cánh cửa.

Nhưng nếu ngay cả những người tạo ra AI cũng bắt đầu hoài nghi chính mình thì sao?

Người tạo AI trước tiên đã sợ chính mình

Bên ngoài, các tổ chức đang đóng cửa với AI; còn bên trong, các công ty AI cũng đang thu mình lại.

Cùng tuần đó, OpenAI tạm hoãn vô thời hạn chế độ “người lớn” của ChatGPT. Tính năng này vốn dự kiến ra mắt vào tháng Mười Hai năm ngoái, cho phép người dùng trưởng thành đã xác minh độ tuổi trò chuyện với ChatGPT về các chủ đề nhạy cảm.

CEO Sam Altman hồi tháng Mười năm ngoái từng đích thân công bố, nguyên văn là “đối xử với người dùng trưởng thành như những người trưởng thành”.

Kết quả là tính năng này đã bị trì hoãn ba lần, rồi cuối cùng bị hủy bỏ hoàn toàn.

Theo báo cáo của tờ Financial Times (Anh), Ủy ban Tư vấn Sức khỏe Nội bộ của OpenAI đã bác bỏ tính năng này với tỷ lệ 100%. Các cố vấn bày tỏ mối lo rất cụ thể: người dùng có thể phát triển sự phụ thuộc cảm xúc không lành mạnh vào AI, và thanh thiếu niên chắc chắn sẽ tìm mọi cách để vượt qua hệ thống xác minh độ tuổi.

Một cố vấn còn nói thẳng hơn: nếu không cải tiến đáng kể, sản phẩm này có thể biến thành “huấn luyện viên tự tử gợi cảm”.

Tỷ lệ sai sót của hệ thống xác minh độ tuổi vượt quá 10%. Với quy mô 800 triệu người dùng hoạt động mỗi tuần của ChatGPT, 10% tương đương với hàng chục triệu người có thể bị phân loại sai.

Chế độ người lớn không phải sản phẩm duy nhất bị hủy trong tháng này. Công cụ video AI Sora và tính năng thanh toán tức thì tích hợp trong ChatGPT cũng đồng loạt bị gỡ bỏ. Altman cho biết công ty sẽ tập trung vào hoạt động cốt lõi và cắt giảm các “nhiệm vụ phụ”.

Tuy nhiên, OpenAI cũng đang chuẩn bị cho đợt IPO.

Một công ty đang chạy nước rút để niêm yết cổ phiếu, lại dồn dập cắt giảm các tính năng tiềm ẩn gây tranh cãi — hành động này có cái tên chính xác hơn có lẽ không phải là “tập trung”.

Năm tháng trước, Altman vẫn khẳng định sẽ đối xử với người dùng như những người trưởng thành; năm tháng sau, ông nhận ra công ty của mình vẫn chưa xác định rõ AI nên để người dùng chạm vào điều gì và không nên để chạm vào điều gì.

Ngay cả những người tạo ra AI cũng chưa có câu trả lời. Vậy ranh giới ấy rốt cuộc nên do ai vạch ra?

Khoảng cách tốc độ không thể đuổi kịp

Khi đặt ba sự việc này cạnh nhau, bạn dễ dàng rút ra một kết luận cốt lõi:

Tốc độ AI sản xuất nội dung và tốc độ con người thẩm định nội dung đã không còn ở cùng một cấp độ.

Lựa chọn của trường ở Manchester trong bối cảnh này vì thế rất dễ hiểu. Để thủ thư đọc kỹ từng cuốn trong số 193 cuốn sách rồi đưa ra phán xét, cần bao lâu? Còn để AI chạy một lượt, chỉ mất vài phút.

Hiệu trưởng chọn phương án vài phút — vậy liệu ông ấy thực sự tin vào năng lực phán đoán của AI chăng? Tôi cho rằng lý do sâu xa hơn là ông ấy không muốn tốn thời gian đó.

Đây là một vấn đề kinh tế. Chi phí tạo nội dung tiến gần về 0, trong khi toàn bộ chi phí thẩm định đều do con người gánh chịu.

Vì vậy, mọi tổ chức chịu ảnh hưởng bởi AI đều buộc phải ứng phó bằng cách thô bạo nhất: Wikipedia cấm tuyệt đối; OpenAI cắt bỏ toàn bộ đường sản phẩm. Không có giải pháp nào là kết quả của sự suy ngẫm kỹ lưỡng — tất cả đều là biện pháp “chặn trước đã”, vì không kịp suy nghĩ thấu đáo.

“Chặn trước đã” đang trở thành trạng thái bình thường.

Năng lực của AI được cập nhật vài tháng một lần, trong khi các cuộc thảo luận về việc AI được phép chạm vào nội dung nào vẫn chưa có lấy một khuôn khổ quốc tế đủ uy tín. Mỗi tổ chức chỉ lo vạch ranh giới trong sân nhà mình; các ranh giới ấy mâu thuẫn nhau, và chẳng có ai phối hợp.

Tốc độ của AI vẫn đang tăng lên. Số lượng con người phụ trách kiểm duyệt sẽ không tăng. Khoảng cách kéo giãn này chỉ ngày càng lớn hơn, cho đến một ngày xảy ra sự việc nghiêm trọng hơn nhiều so với việc cấm “1984”.

Lúc ấy mới vạch ranh giới, e rằng đã muộn.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News