OpenAI vừa ra mắt chính thức mô hình o1, chúng ta chính thức bước vào một kỷ nguyên mới

Tuyển chọn TechFlowTuyển chọn TechFlow

OpenAI vừa ra mắt chính thức mô hình o1, chúng ta chính thức bước vào một kỷ nguyên mới

Chúng ta không còn bất kỳ trở ngại nào trên con đường hướng tới AGI.

Tác giả: Kazek

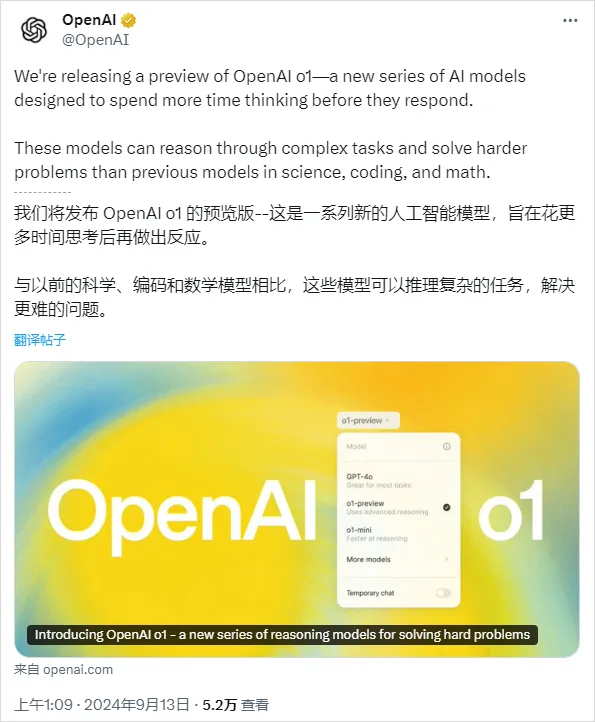

Giữa đêm khuya, OpenAI đã tung ra mô hình mới nhất của mình sau gần nửa năm im lặng.

Mà không hề báo trước, chính thức ra mắt.

Tên chính thức không phải là "Dâu tây", "Dâu tây" chỉ là một biệt danh nội bộ. Tên thật của chúng, là:

Vì sao lại đặt tên là o1, đây là lời giải thích từ OpenAI:

Đối với các tác vụ suy luận phức tạp, đây là một bước tiến quan trọng, đại diện cho một cấp độ mới về năng lực trí tuệ nhân tạo. Vì lý do này, chúng tôi đang đặt lại con số đếm về 1 và đặt tên cho dòng sản phẩm này là OpenAI o1.

Dịch ra là:

Đối với các nhiệm vụ suy luận phức tạp, đây là một bước tiến đáng kể, đại diện cho một trình độ mới của khả năng AI. Vì vậy, chúng tôi đặt lại con số đếm về 1 và đặt tên chuỗi này là OpenAI o1.

Sức mạnh của mô hình lần này thậm chí khiến OpenAI sẵn sàng bỏ luôn hệ thống đặt tên GPT trước đó, để khởi động một dòng tên mới mang ký hiệu 'o'.

Nổ tung rồi, thực sự nổ tung rồi.

Hiện tại, tôi đang nổi da gà, thật đấy, việc ra mắt OpenAI o1 lần này cũng đánh dấu rằng ngành công nghiệp AI chính thức bước vào một kỷ nguyên hoàn toàn mới.

"Trên con đường hướng tới AGI, chúng ta đã không còn bất kỳ trở ngại nào nữa."

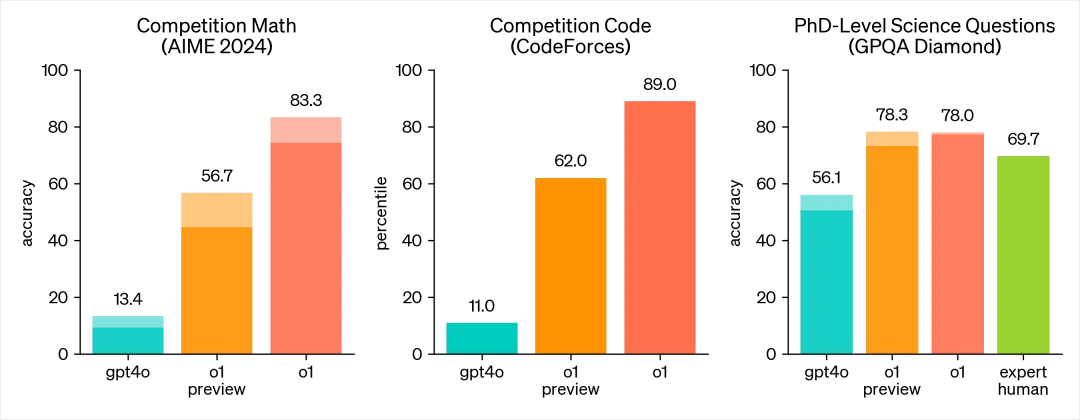

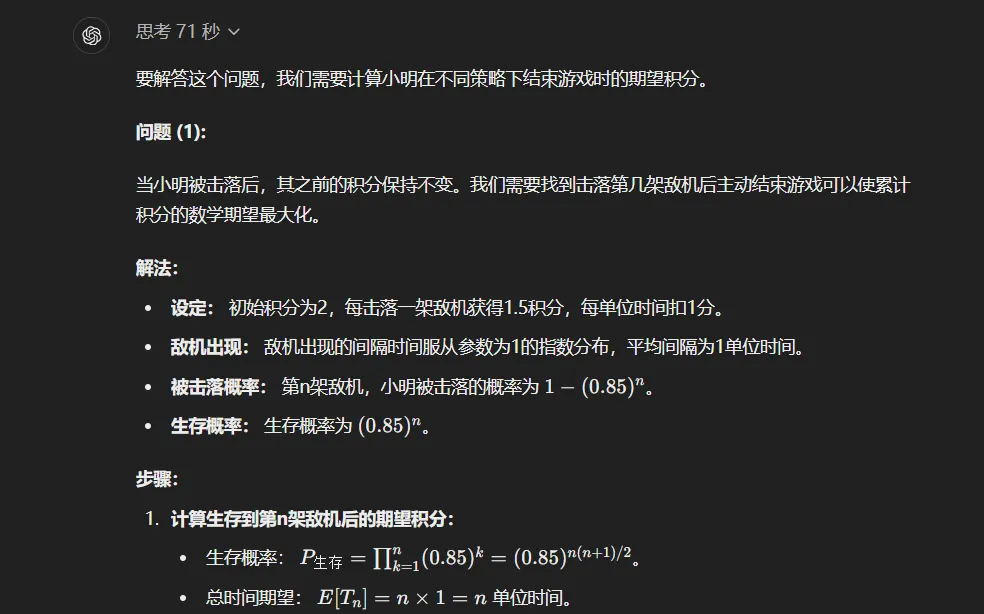

Về khả năng suy luận và logic, tôi sẽ trực tiếp đưa hình ảnh lên trước, các bạn sẽ hiểu mức độ điên rồ của thứ này đến đâu.

AIME 2024, một kỳ thi toán học trình độ cao, tỷ lệ chính xác của GPT-4o là 13,4%, trong khi phiên bản xem trước o1 đạt 56,7%, còn phiên bản chính thức chưa phát hành của o1 đạt tới 83,3%.

Trong kỳ thi lập trình, GPT-4o đạt 11,0%, o1 phiên bản xem trước đạt 62%, o1 phiên bản chính thức đạt 89%.

Còn ở câu hỏi khoa học cấp tiến sĩ (GPQA Diamond), GPT-4o đạt 56,1, trình độ chuyên gia con người là 69,7, thì o1 đạt mức khủng khiếp là 78%.

Tôi đã nhờ Claude dịch giúp hình ảnh về o1, xấu xấu một chút nhưng vẫn đọc được ý nghĩa từng dữ liệu.

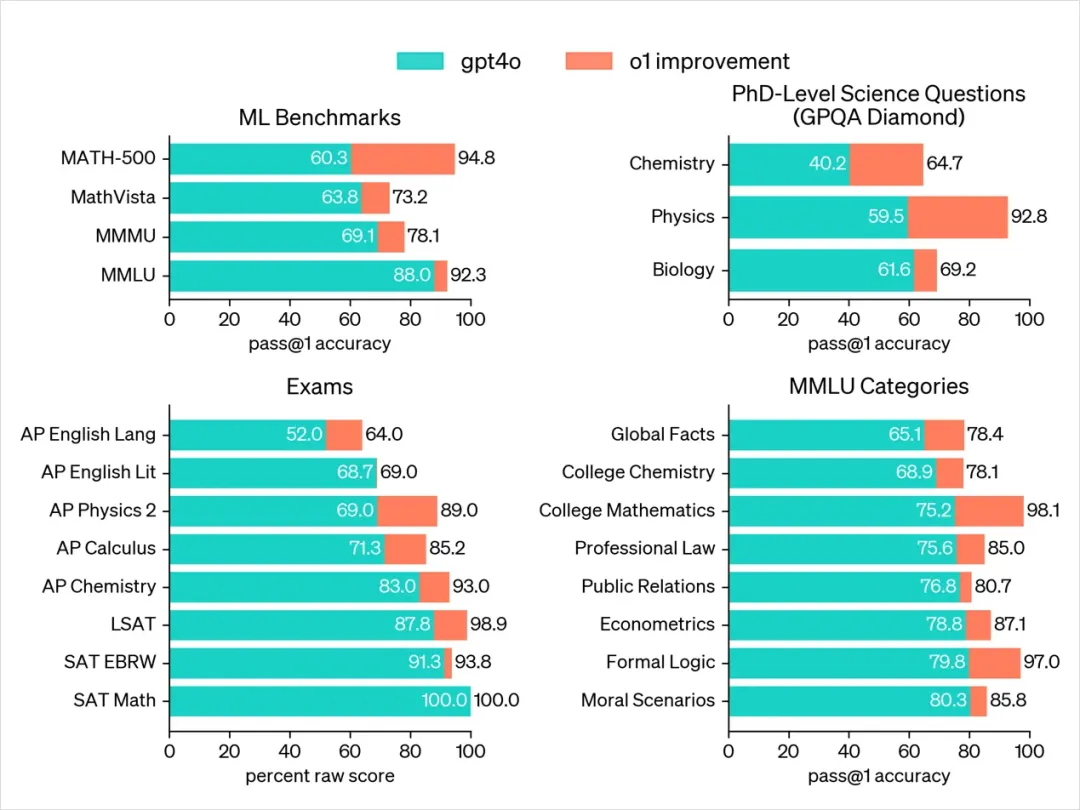

Thế nào gọi là áp đảo toàn diện? Đây chính là.

Đặc biệt trên bộ kiểm thử GPQA-diamond – kiểm tra kiến thức chuyên sâu về hóa học, vật lý và sinh học – o1 vượt qua hoàn toàn cả các chuyên gia tiến sĩ con người, đây cũng là lần đầu tiên trong lịch sử có một mô hình đạt được thành tựu như vậy.

Nguyên nhân khiến mô hình này đạt được thành quả to lớn như vậy nằm ở nền tảng Self-play RL. Ai chưa biết về cái này có thể đọc bài viết dự đoán của tôi hôm trước: Mô hình dâu tây mới rốt cuộc là gì?

Thông qua Self-play RL, o1 học được cách mài giũa chuỗi tư duy và hoàn thiện các chiến lược sử dụng. Nó học được cách nhận diện và sửa chữa sai lầm của bản thân.

Nó cũng học được cách phân tích các bước phức tạp thành những bước đơn giản hơn.

Và khi phương pháp hiện tại không hiệu quả, nó biết thử các phương pháp khác.

Những điều nó học được chính là cách suy nghĩ cốt lõi nhất của con người: suy nghĩ chậm.

Giải Nobel Kinh tế học Daniel Kahneman có một cuốn sách nổi tiếng tên là: Suy nghĩ nhanh và chậm.

Trong đó miêu tả rất chi tiết hai kiểu tư duy của con người.

Loại thứ nhất là suy nghĩ nhanh (Hệ thống 1), đặc điểm là nhanh chóng, tự động, trực giác, vô thức. Ví dụ:

-

Nhìn thấy khuôn mặt cười là biết đối phương đang vui.

-

Tính toán đơn giản như 1+1=2.

-

Lái xe gặp tình huống nguy hiểm lập tức đạp phanh.

Đây chính là suy nghĩ nhanh, cũng là khả năng phản ứng nhanh mà các mô hình lớn truyền thống học được thông qua ghi nhớ máy móc.

Loại thứ hai là suy nghĩ chậm (Hệ thống 2), đặc điểm là chậm rãi, cần nỗ lực, mang tính logic, có ý thức. Ví dụ:

-

Giải một bài toán phức tạp

-

Hoàn thành tờ khai thuế

-

Cân nhắc ưu nhược điểm trước khi đưa ra quyết định quan trọng

Đây chính là suy nghĩ chậm – cốt lõi làm nên sức mạnh của con người, cũng là nền tảng thiết yếu để AI tiến tới bước tiếp theo: AGI.

Và bây giờ, o1 cuối cùng đã邁出 vững chắc một bước, sở hữu được đặc tính "suy nghĩ chậm" của con người, trước khi trả lời, nó sẽ liên tục suy nghĩ, phân tích, thấu hiểu, suy luận, rồi mới đưa ra câu trả lời cuối cùng.

Thật lòng mà nói, những khả năng suy luận được tăng cường này cực kỳ hữu ích khi xử lý các vấn đề phức tạp trong lĩnh vực khoa học, lập trình, toán học và tương tự.

Ví dụ như o1 có thể được các nhà nghiên cứu y học dùng để chú thích dữ liệu giải trình tự tế bào, được các nhà vật lý dùng để tạo ra các công thức toán học phức tạp phục vụ quang học lượng tử, hoặc được các lập trình viên trong mọi lĩnh vực dùng để xây dựng và thực thi các quy trình làm việc nhiều bước, v.v.

o1 cũng chắc chắn là vòng xoáy dữ liệu thế hệ mới, nếu câu trả lời đúng, cả chuỗi logic sẽ trở thành một tập dữ liệu nhỏ chứa ví dụ huấn luyện có phần thưởng dương và âm.

Với cấp độ người dùng của OpenAI, tốc độ tiến hóa trong tương lai sẽ còn kinh khủng hơn nữa.

Viết đến đây, tôi bỗng thở dài, cảm thấy rằng so với o1 một năm sau, có lẽ tôi chỉ là một kẻ vô dụng hoàn toàn, thật sự...

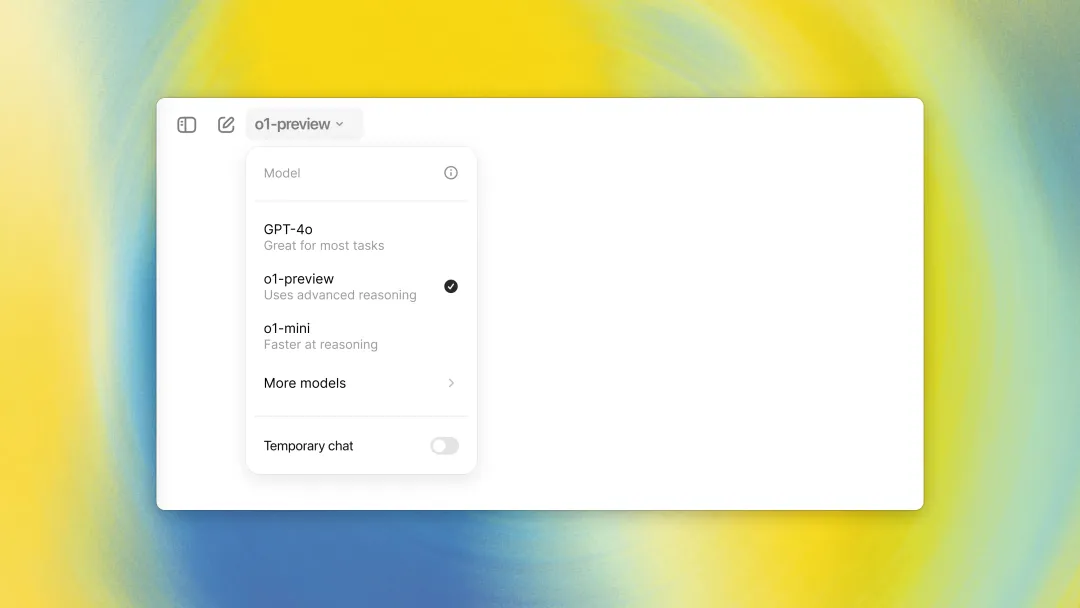

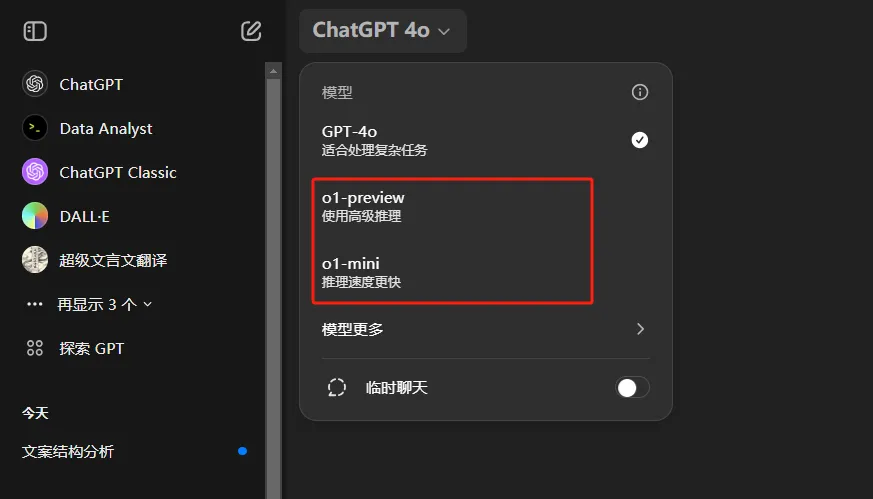

Hiện tại, mô hình o1 đã bắt đầu mở cửa dần cho tất cả người dùng ChatGPT Plus và Team, trong tương lai sẽ cân nhắc mở cho người dùng miễn phí.

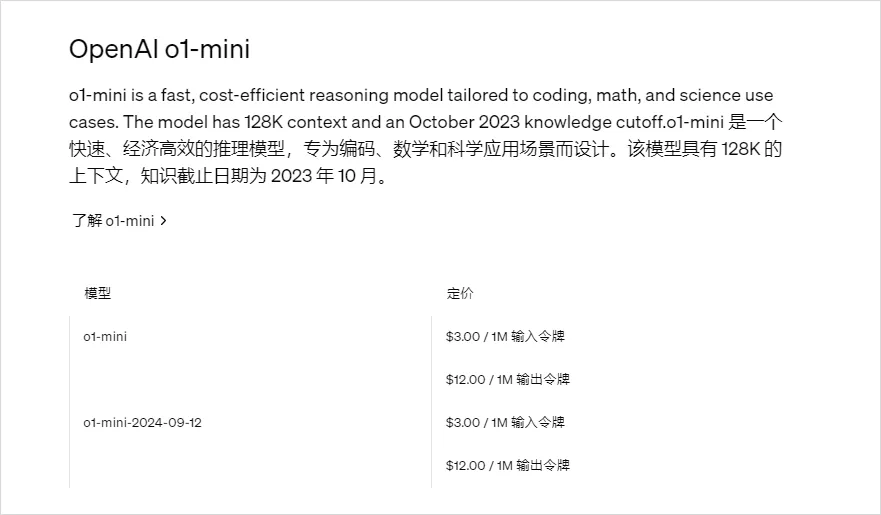

Chia làm hai mô hình: o1 Preview và o1-mini. o1-mini nhanh hơn, nhỏ hơn, rẻ hơn, khả năng suy luận cũng khá tốt, cực kỳ phù hợp với toán học và mã nguồn, chỉ kém về kiến thức tổng quát, thích hợp cho các trường hợp cần suy luận nhưng không yêu cầu kiến thức rộng khắp.

o1 Preview giới hạn 30 lượt mỗi tuần, o1-mini giới hạn 50 lượt mỗi tuần.

Hạn chế nghiêm trọng, thậm chí không còn theo kiểu 3 giờ như trước nữa, mà là 30 lượt mỗi tuần — cũng phần nào cho thấy o1 đắt đến mức nào.

Đối với nhà phát triển, chỉ mở cho các nhà phát triển cấp 5 đã thanh toán 1.000 đô la Mỹ, giới hạn 20 lần mỗi phút.

Đều rất ít.

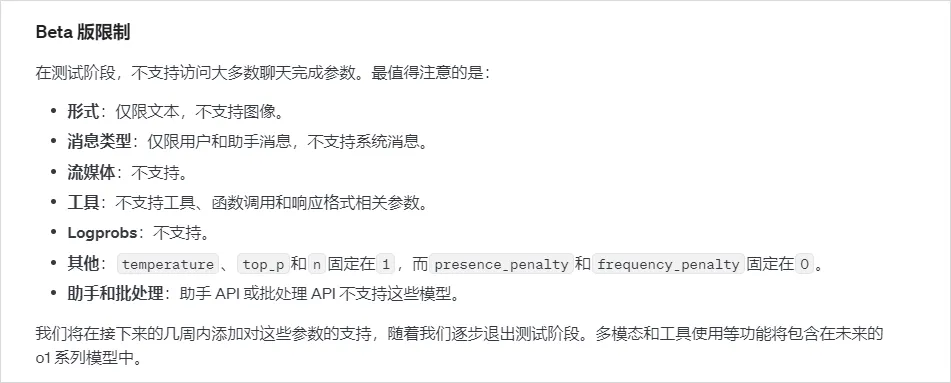

Và bị cắt giảm chức năng khá nhiều, nhưng vì đang ở giai đoạn đầu nên cũng thông cảm được.

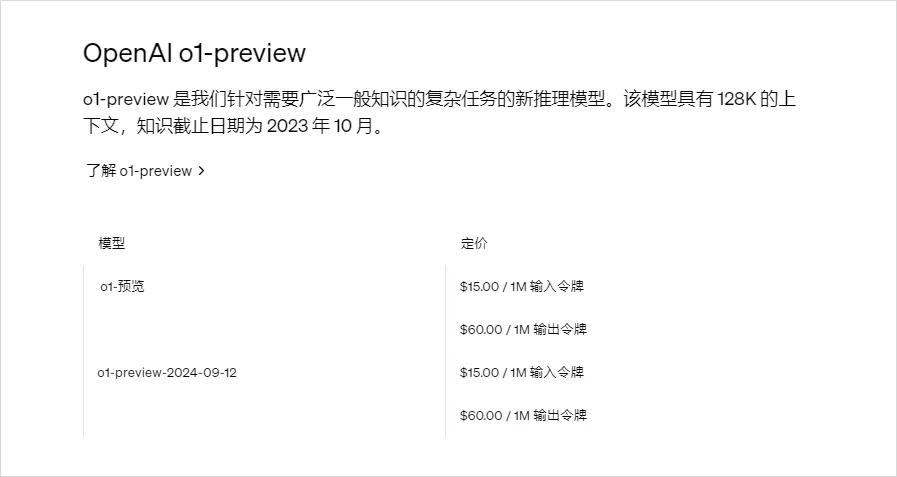

Về giá API, o1 Preview có giá 15 USD cho mỗi triệu token đầu vào, 60 USD cho mỗi triệu token đầu ra — chi phí suy luận này...

o1-mini rẻ hơn một chút, 3 USD cho mỗi triệu token đầu vào, 12 USD cho mỗi triệu token đầu ra.

Chi phí đầu ra đều gấp 4 lần chi phí đầu vào, so sánh với GPT-4o là 5 USD và 15 USD.

o1-mini vẫn còn chút hiệu quả kinh tế, nhưng mới chỉ là khởi đầu, chờ OpenAI giảm giá mạnh trong tương lai.

Vì đã nói o1 mở cho người dùng Plus, tôi lập tức kiểm tra tài khoản của mình, may quá, đã có quyền sử dụng.

Thì đương nhiên, phải thử ngay lập tức.

Hiện tại không hỗ trợ tất cả các chức năng trước đây, nghĩa là không có hiểu hình ảnh, tạo hình ảnh, trình thông dịch mã, tìm kiếm web, v.v., chỉ là một mô hình thuần đối thoại.

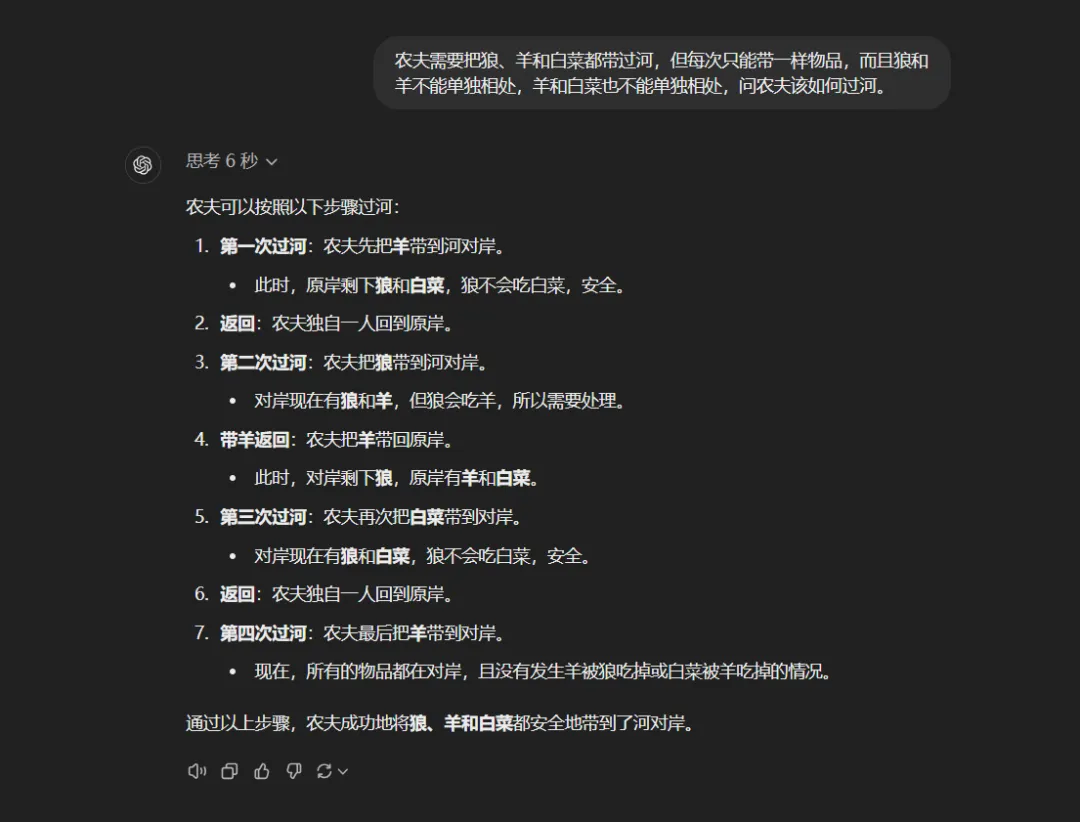

Tôi thử ngay một câu hỏi từng là điểm chết của mọi mô hình lớn:

"Nông dân cần chở sói, cừu và cải bắp qua sông, mỗi lần chỉ chở được một thứ, đồng thời sói không được ở riêng với cừu, cừu cũng không được ở riêng với cải bắp. Hỏi nông dân phải làm sao để qua sông?"

Sau 6 giây suy nghĩ, nó đưa ra câu trả lời hoàn hảo.

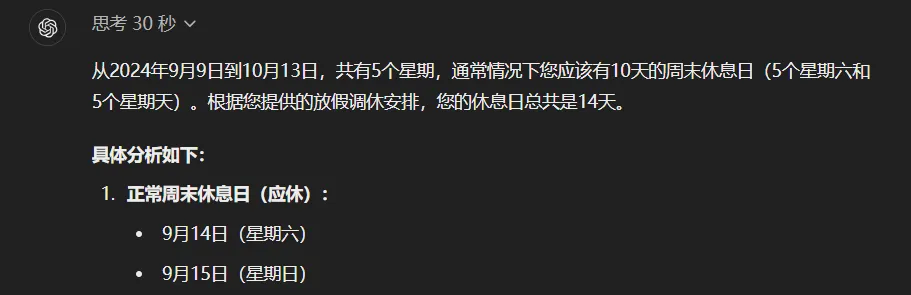

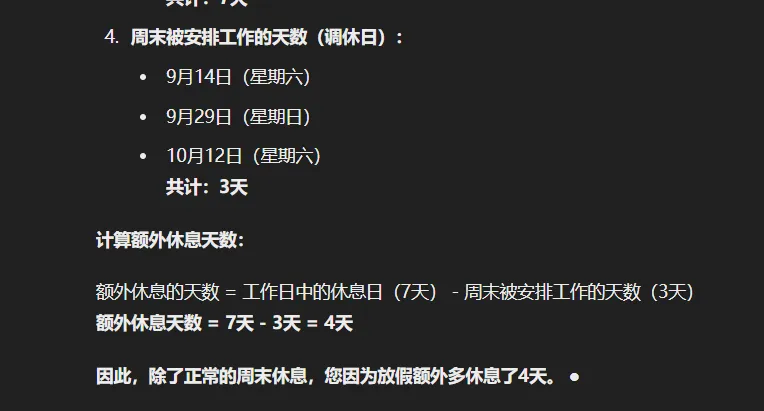

Rồi đến câu hỏi hoán đổi ngày nghỉ từng đánh bại mọi mô hình lớn:

"Đây là lịch nghỉ và điều chỉnh làm việc từ ngày 9 tháng 9 năm 2024 (thứ Hai) đến ngày 13 tháng 10: làm 6 nghỉ 3 làm 3 nghỉ 2 làm 5 nghỉ 1 làm 2 nghỉ 7 rồi làm 5 nghỉ 1.

Xin hãy cho tôi biết, ngoài các ngày nghỉ cuối tuần thông thường, tôi được nghỉ thêm mấy ngày nhờ lịch nghỉ lễ?"

Sau khi o1 suy nghĩ suốt 30 giây, nó đưa ra câu trả lời cực kỳ chính xác, không sai một ngày nào.

Bất bại, thực sự bất bại.

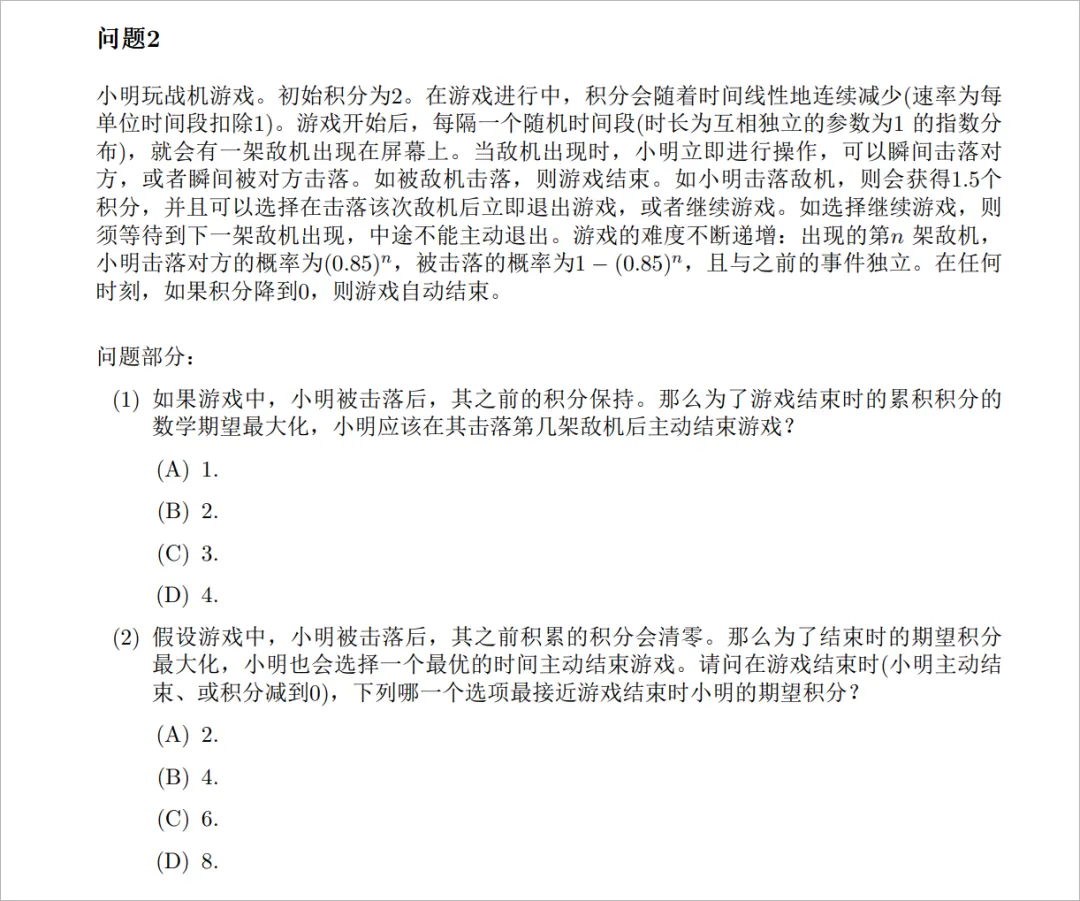

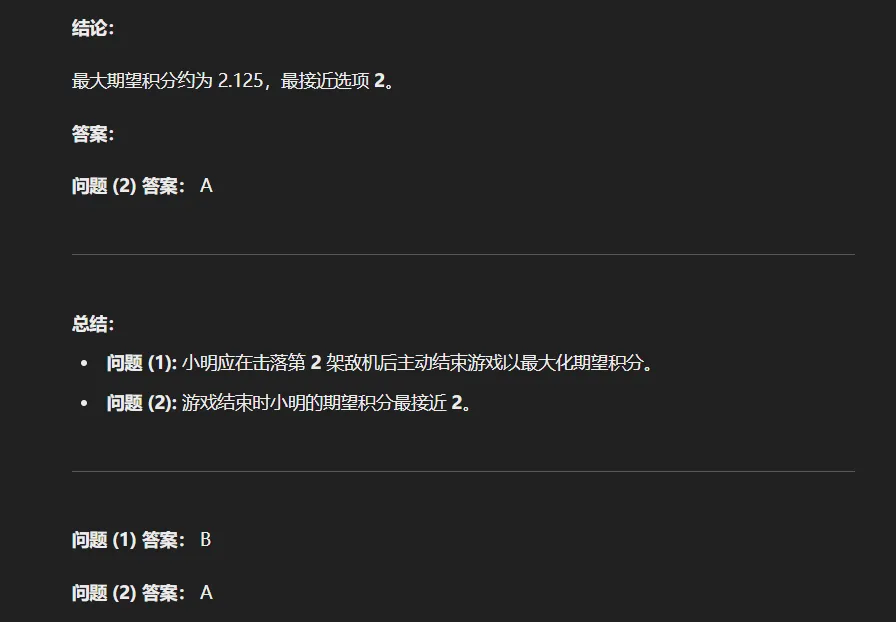

Thử tiếp một câu khó hơn, chính là bài toán Olympic toán học từng xuất hiện trong cuộc thi của Giang Bình:

Đừng hỏi tôi đề bài nghĩa là gì, tôi không hiểu, tôi là kẻ vô dụng. Câu này từng "giết sạch" mọi mô hình lớn. Lần này, chúng ta cho o1 thử xem sao.

Sau khi o1 suy nghĩ hơn một phút, nó đưa ra đáp án.

...

Toàn... bộ... đúng...

Tôi sụp đổ mất rồi.

Theo trải nghiệm cá nhân, tôi cảm thấy Prompt trong tương lai có lẽ cũng cần khám phá lại. Trong thời đại mô hình lớn suy nghĩ nhanh đại diện bởi GPT, chúng ta có rất nhiều thủ thuật như "hãy suy nghĩ từng bước", v.v., nhưng giờ đây tất cả đều vô hiệu, thậm chí còn gây tác dụng phụ cho o1.

OpenAI đưa ra cách viết tối ưu như sau:

-

Giữ prompt đơn giản và trực tiếp: Mô hình giỏi hiểu và phản hồi các chỉ dẫn ngắn gọn, rõ ràng, không cần hướng dẫn dài dòng.

-

Tránh prompt chuỗi suy nghĩ: Vì các mô hình này tự suy luận bên trong, nên không cần yêu cầu chúng "suy nghĩ từng bước" hay "giải thích lập luận của bạn".

-

Sử dụng dấu phân cách để tăng độ rõ ràng: Dùng ba dấu ngoặc kép, thẻ XML hoặc tiêu đề chương mục để phân biệt rõ các phần khác nhau trong đầu vào, giúp mô hình diễn giải chính xác từng phần.

-

Hạn chế ngữ cảnh bổ sung trong RAG (tăng cường truy xuất tạo sinh): Khi cung cấp thêm ngữ cảnh hoặc tài liệu, chỉ đưa vào thông tin liên quan nhất, tránh khiến mô hình làm phức tạp hóa phản hồi.

Cuối cùng, tôi muốn nói về thời gian suy nghĩ.

Hiện tại o1 suy nghĩ khoảng một phút, nhưng nếu thực sự là AGI, thật lòng mà nói, suy nghĩ càng chậm có thể càng kích thích.

Khi nó thực sự có thể chứng minh các định lý toán học, phát triển thuốc trị ung thư, hay nghiên cứu thiên văn?

Mỗi lần suy nghĩ có thể kéo dài hàng giờ, hàng ngày, thậm chí hàng tuần?

Kết quả cuối cùng có thể khiến mọi người kinh ngạc đến mức không thể tin nổi.

Hiện tại, không ai có thể hình dung được AI lúc đó sẽ là một dạng tồn tại như thế nào.

Và tương lai của o1, theo tôi thấy, tuyệt đối không chỉ là một ChatGPT bình thường.

Mà là viên gạch nền vĩ đại nhất để chúng ta bước sang thời đại tiếp theo.

"Trên con đường hướng tới AGI, chúng ta đã không còn bất kỳ trở ngại nào nữa."

Bây giờ, tôi tin chắc vào câu nói này mà không do dự.

Thời đại rực rỡ phía trước.

Ngày hôm nay.

Chính thức đã đến.

Chào mừng tham gia cộng đồng chính thức TechFlow

Nhóm Telegram:https://t.me/TechFlowDaily

Tài khoản Twitter chính thức:https://x.com/TechFlowPost

Tài khoản Twitter tiếng Anh:https://x.com/BlockFlow_News