다양한 이미지와 함께하는 DeepSeek R1은 어떻게 만들어졌나?

저자: 장신링, AI를 위한 발전

이미지 출처: 무계 AI 생성

DeepSeek는 R1 추론 모델을 어떻게 학습시키는가?

본문은 주로 DeepSeek가 발표한 기술 보고서를 기반으로 하여 DeepSeek - R1의 학습 과정을 해석하며, 추론 모델을 구성하고 향상시키는 네 가지 전략에 중점을 둔다.

원문은 연구원 세바스찬 라슈카(Sebastian Raschka)가 작성하여 다음에서 게재함:

https://magazine.sebastianraschka.com/p/understanding-reasoning-llms

본문에서는 그 중 R1 추론 모델의 핵심 학습 부분을 요약할 것이다.

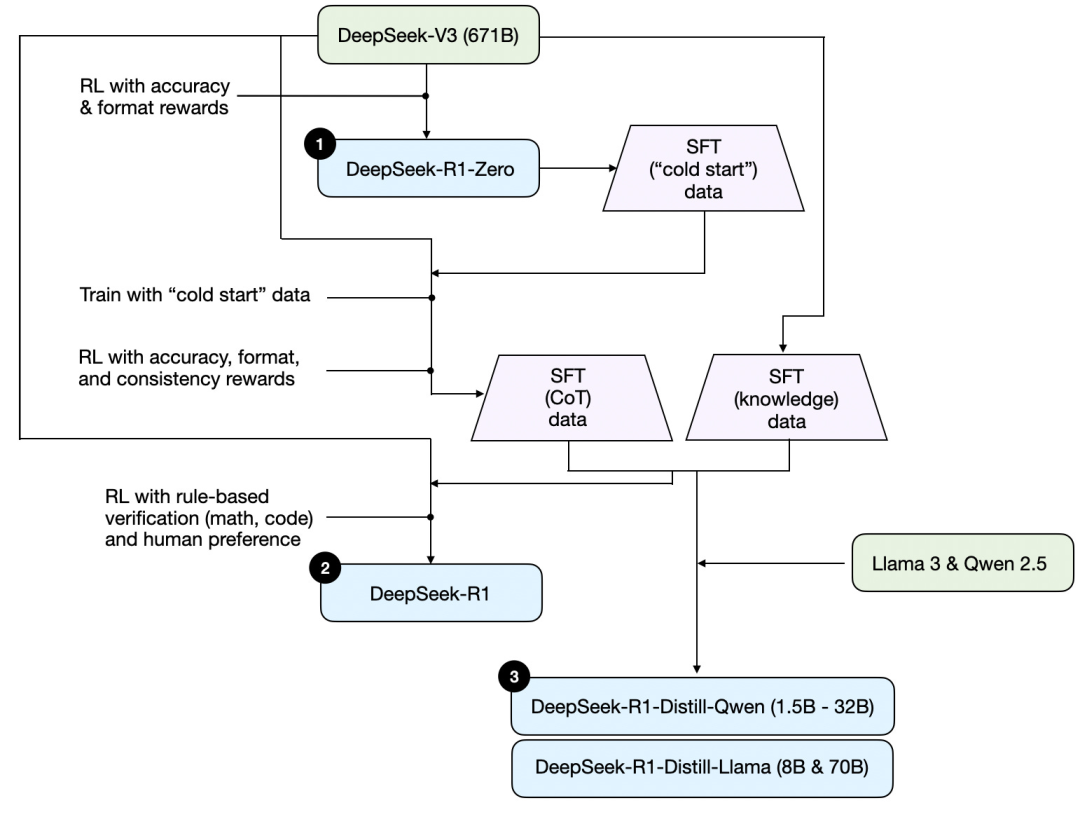

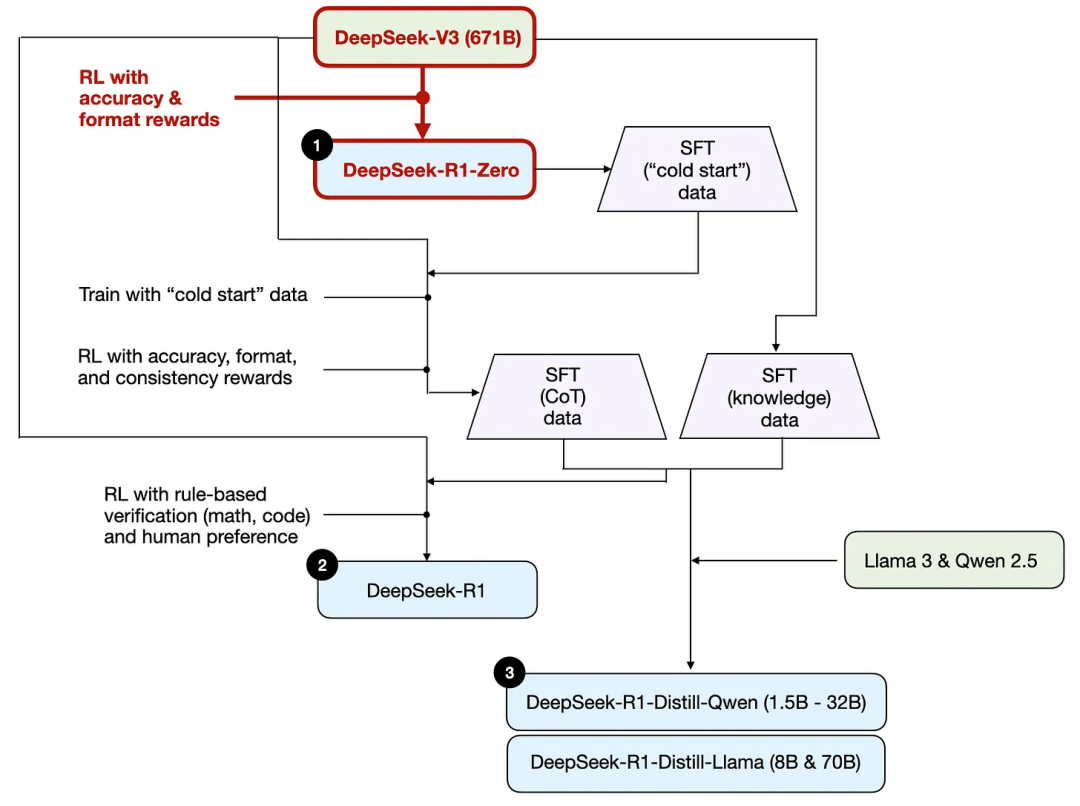

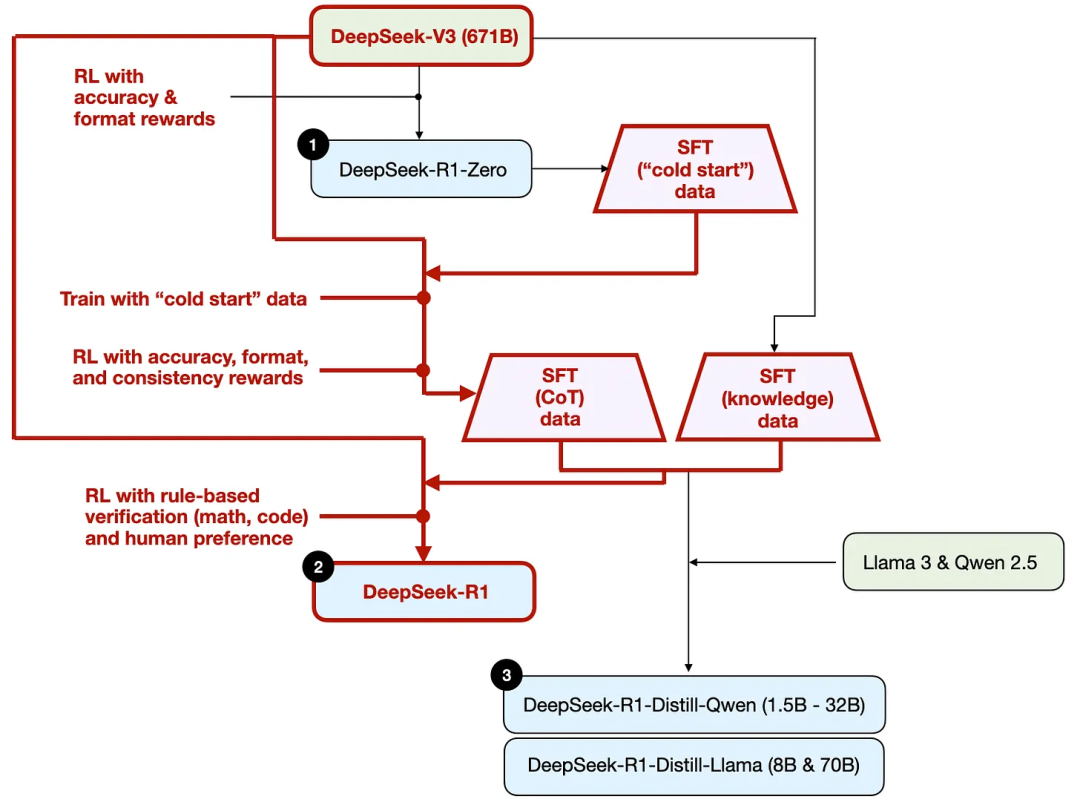

우선, DeepSeek가 발표한 기술 보고서를 바탕으로 아래는 R1의 학습도이다.

위 그림에 표시된 과정을 정리하면 다음과 같다:

(1) DeepSeek - R1 - Zero: 이 모델은 작년 12월에 발표된 DeepSeek - V3 베이스 모델을 기반으로 한다. 두 가지 보상 메커니즘을 갖춘 강화학습(RL)을 사용해 학습시켰다. 이를 "콜드 스타트(cold start)" 학습이라고 하는데, 인간 피드백 강화학습(RLHF)의 일부인 감독 미세조정(SFT) 단계를 포함하지 않기 때문이다.

(2) DeepSeek - R1: 이것은 DeepSeek의 주력 추론 모델로서, DeepSeek - R1 - Zero를 기반으로 구축되었다. 팀은 추가적인 감독 미세조정 단계와 추가적인 강화학습을 통해 이를 최적화하였으며, 콜드 스타트 방식의 R1 - Zero 모델을 개선했다.

(3) DeepSeek - R1 - Distill: DeepSeek 팀은 앞 단계에서 생성된 감독 미세조정 데이터를 활용하여 Qwen 및 Llama 모델을 파인튜닝하여 그들의 추론 능력을 향상시켰다. 전통적인 의미의 지식 증류(knowledge distillation)는 아니지만, 이 과정은 671B 크기의 큰 DeepSeek - R1 모델의 출력을 이용해 더 작은 모델들(Llama 8B 및 70B, Qwen 1.5B - 30B)을 학습시키는 것을 포함한다.

다음은 추론 모델을 구성하고 향상시키는 네 가지 주요 방법에 대해 소개한다.

1. 추론 시 확장 / Inference-time scaling

LLM의 추론 능력(또는 일반적으로 어떤 능력이라도)을 향상시키는 한 가지 방법은 추론 시 계산 리소스를 증가시켜 출력 품질을 높이는 '추론 시 확장'이다.

대략적으로 비유하자면, 사람들이 복잡한 문제를 해결할 때 더 많은 사고 시간을 가질수록 더 나은 답변을 내놓는 것과 같다. 마찬가지로 우리는 일부 기술을 활용하여 LLM이 답변 생성 시 더 깊이 "생각"하도록 유도할 수 있다.

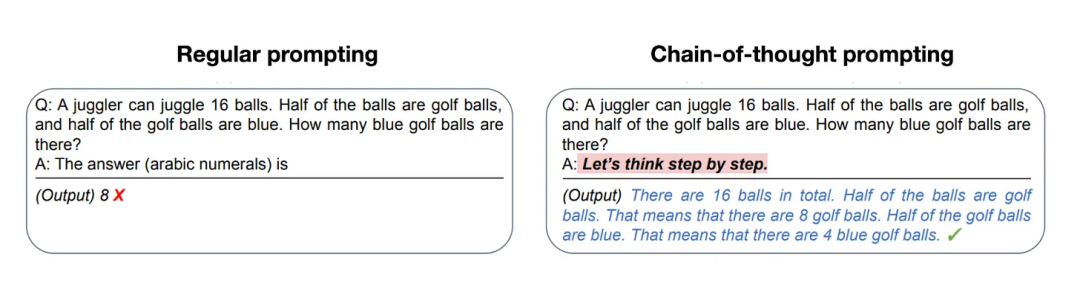

추론 시 확장을 구현하는 간단한 방법 중 하나는 영리한 프롬프트 엔지니어링(Prompt Engineering)이다. 대표적인 예로 사고 연쇄 프롬프팅(CoT Prompting)이 있으며, 입력 프롬프트에 "단계별로 생각하라"는 문구를 포함시키는 것이다. 이렇게 하면 모델이 최종 답변으로 바로 점프하는 대신 중간 추론 단계를 생성하게 되며, 이는 더 복잡한 문제에서 더 정확한 결과를 도출하는 데 도움이 된다. (단, "프랑스의 수도는 무엇인가?" 같은 비교적 간단한 지식 기반 질문에는 이러한 전략이 의미가 없으므로, 주어진 입력 쿼리에 대해 추론 모델이 적합한지를 판단하는 실용적인 경험 법칙이 될 수 있다.)

위의 사고 연쇄(CoT) 방법은 더 많은 출력 토큰을 생성함으로써 추론 비용을 증가시키므로, 추론 시 확장의 일종으로 간주될 수 있다.

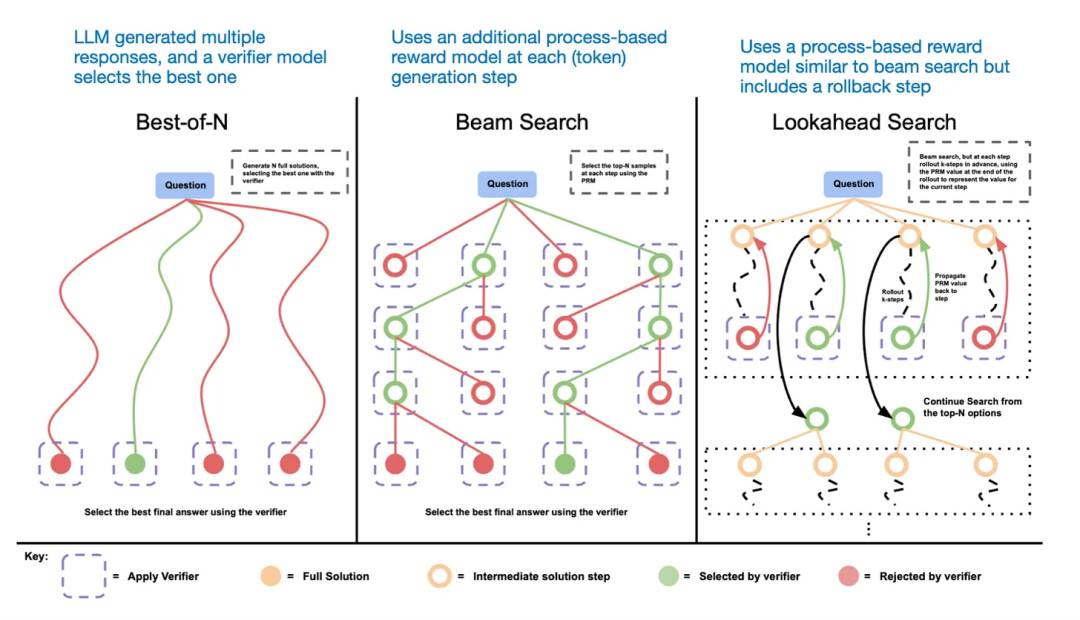

추론 시 확장을 위한 또 다른 방법은 투표 및 탐색 전략을 사용하는 것이다. 단순한 예로 다수결 투표법이 있는데, LLM이 여러 개의 답변을 생성한 후 다수결로 올바른 답변을 선택하는 것이다. 마찬가지로, 번들 탐색(Beam Search) 및 기타 탐색 알고리즘을 사용하여 더 나은 답변을 생성할 수 있다.

여기서 추천하는 논문은 "Scaling LLM Test-Time Compute Optimally can be More Effective than Scaling Model Parameters" 이다.

서로 다른 탐색 기반 방법들은 과정 보상 기반 모델에 의존하여 최적의 답변을 선택한다.

DeepSeek R1 기술 보고서에 따르면, 해당 모델은 추론 시 확장 기술을 사용하지 않았다고 한다. 그러나 이 기술은 일반적으로 LLM 상위 응용 계층에서 구현되므로, DeepSeek가 자체 애플리케이션에서 이를 활용했을 가능성도 있다.

나는 OpenAI의 o1 및 o3 모델이 추론 시 확장 기술을 사용했다고 추측하며, 이것이 GPT-4o 등과 비교해 상대적으로 사용 비용이 높은 이유라고 생각한다. 추론 시 확장 외에도, o1과 o3는 DeepSeek R1과 유사한 강화학습 프로세스를 통해 학습되었을 가능성이 크다.

2. 순수 강화학습 / Pure RL

DeepSeek R1 논문에서 특히 주목할 만한 점은, 추론이 순수 강화학습에서 나타나는 행동으로 나타날 수 있다는 것을 발견했다는 것이다. 이제 이것이 무엇을 의미하는지 살펴보자.

앞서 언급했듯이, DeepSeek는 세 가지 R1 모델을 개발했다. 첫 번째는 DeepSeek - V3 기초 모델 위에 구축된 DeepSeek - R1 - Zero이다. 일반적인 강화학습 프로세스와 달리, 강화학습 이전에 감독 미세조정(SFT)을 수행하는 것이 일반적이지만, DeepSeek - R1 - Zero는 초기 감독 미세조정/SFT 단계 없이 오직 강화학습만으로 학습되었다. 아래 그림과 같다.

그럼에도 불구하고, 이 강화학습 과정은 LLM의 선호도 미세조정에 일반적으로 사용되는 인간 피드백 강화학습(RLHF) 방법과 유사하다. 하지만 위에서 언급했듯이, DeepSeek - R1 - Zero의 핵심 차이점은 명령 조정을 위한 감독 미세조정(SFT) 단계를 건너뛰었다는 점이다. 그래서 이를 "순수" 강화학습(Pure RL)이라고 부르는 것이다.

보상 측면에서, 인간 선호도 기반으로 학습된 보상 모델을 사용하지 않고 두 가지 유형의 보상을 사용하였다: 정확성 보상과 형식 보상.

-

정확성 보상(accuracy reward): 프로그래밍 답변 검증에는 LeetCode 컴파일러를 사용하고, 수학 답변 평가에는 결정론적 시스템을 사용한다.

-

형식 보상(format reward): 답변이 예상 형식(예: 추론 단계를 특정 태그 안에 배치)을 따르도록 보장하기 위해 LLM 기반 심판 모델을 사용한다.

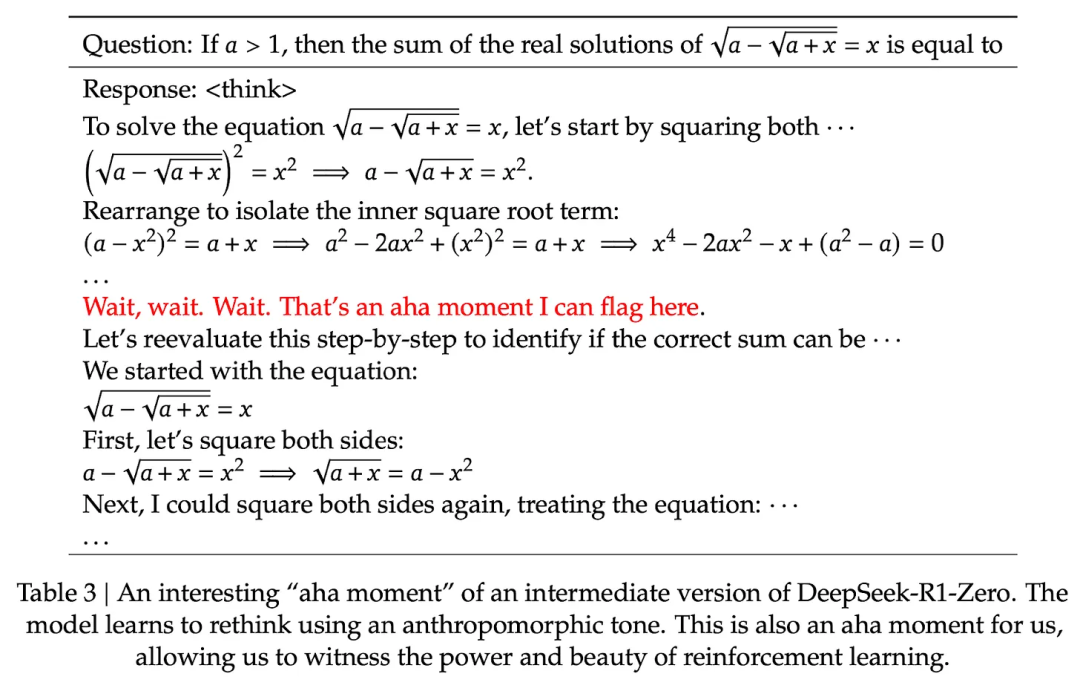

놀랍게도, 이러한 방법만으로도 LLM이 기본적인 추론 기술을 진화시킬 수 있었다. 연구진은 모델이 관련 훈련을 명시적으로 받지 않았음에도 답변에 추론 흔적을 생성하기 시작하는 '아하 순간(aha moment)'을 관찰했다. 아래 그림은 R1 기술 보고서에서 발췌한 것이다.

R1 - Zero가 최고 수준의 추론 모델은 아니지만, 위 그림에서 볼 수 있듯이 중간 "사고" 단계를 생성함으로써 추론 능력을 실제로 보여주었다. 이는 순수 강화학습을 활용하여 추론 모델을 개발하는 것이 가능함을 입증하며, DeepSeek는 이 방법을 시연하거나(적어도 성과를 발표한) 최초의 팀이다.

3. 감독 미세조정과 강화학습 (SFT + RL)

다음으로 주력 추론 모델인 DeepSeek - R1의 개발 과정을 살펴보자. 이는 추론 모델 구축의 교과서적 사례라 할 수 있다. 이 모델은 DeepSeek - R1 - Zero를 기반으로 추가적인 감독 미세조정(SFT)과 강화학습(RL)을 통합하여 자신의 추론 성능을 향상시켰다.

강화학습 이전에 감독 미세조정 단계를 추가하는 것은 표준 인간 피드백 강화학습(RLHF) 프로세스에서 일반적인 점임을 유념해야 한다. OpenAI의 o1 역시 유사한 방법으로 개발되었을 가능성이 크다.

위 그림에서 보듯, DeepSeek 팀은 DeepSeek - R1 - Zero를 사용해所谓 '콜드 스타트(cold start)' 감독 미세조정(SFT) 데이터를 생성했다. '콜드 스타트'라는 용어는 이 데이터가 어떠한 감독 미세조정 데이터로도 학습되지 않은 DeepSeek - R1 - Zero에 의해 생성되었다는 의미이다.

이러한 콜드 스타트 SFT 데이터를 활용해 DeepSeek는 먼저 명령 미세조정(instruction finetuning)을 통해 모델을 학습시킨 후, 또 다른 강화학습(RL) 단계로 넘어간다. 이 RL 단계에서는 DeepSeek - R1 - Zero의 RL 과정에서 사용된 정확성 보상과 형식 보상을 유지한다. 그러나 언어 혼용 현상(답변 중 언어 전환)을 방지하기 위해 일관성 보상(consistency reward)을 새로 추가하였다.

RL 단계 이후에는 또 다른 라운드의 SFT 데이터 수집이 진행된다. 이 단계에서는 최신 모델 체크포인트를 사용해 60만 개의 사고 연쇄(CoT) SFT 예제(600K CoT SFT examples)를 생성하고, DeepSeek - V3 기초 모델을 이용해 추가로 20만 개의 지식 기반 SFT 예제(200K knowledge based SFT examples)를 만들었다.

그런 다음, 이 60만 + 20만 개의 SFT 샘플을 사용해 DeepSeek - V3 기초 모델에 대해 명령 미세조정(instruction finetuning)을 수행한 후 마지막 라운드의 RL을 진행한다. 이 단계에서 수학 및 프로그래밍 문제에 대해서는 다시 규칙 기반 방법을 사용해 정확성 보상을 결정하며, 다른 유형의 문제에는 인간 선호도 라벨을 사용한다. 결론적으로, 이는 일반적인 인간 피드백 강화학습(RLHF)과 매우 유사하지만, SFT 데이터에 (더 많은) 사고 연쇄 예제가 포함되어 있고, RL에는 인간 선호도 기반 보상 외에 검증 가능한 보상도 포함된다는 점이 다르다.

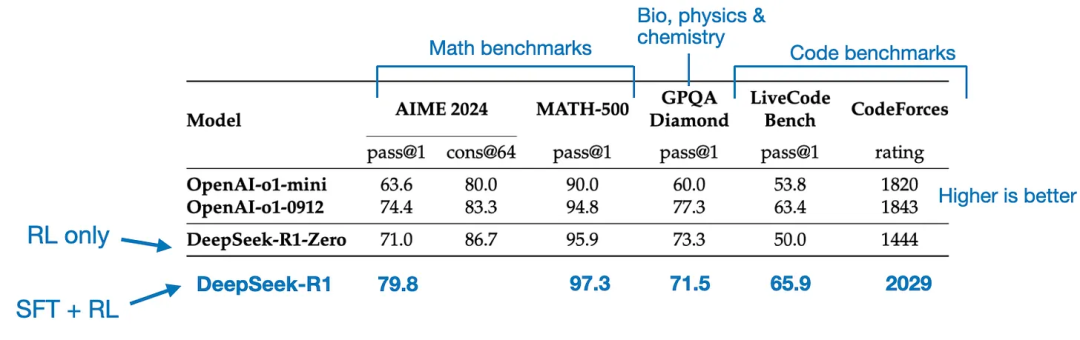

최종 모델인 DeepSeek - R1은 추가적인 SFT 및 RL 단계 덕분에 DeepSeek - R1 - Zero보다 현저한 성능 향상을 이루었으며, 아래 표에 그 결과가 나와 있다.

4. 순수 감독 미세조정(SFT) 및 증류

지금까지 추론 모델을 구성하고 개선하는 세 가지 핵심 방법을 소개했다:

1/ 추론 시 확장: 이는 기본 모델을 학습시키거나 수정하지 않고도 추론 능력을 향상시킬 수 있는 기술이다.

2/ 순수 RL: DeepSeek - R1 - Zero에서 사용된 순수 강화학습(RL)로, 감독 미세조정 없이도 추론이 습득된 행동으로 나타날 수 있음을 보여준다.

3/ 감독 미세조정(SFT) + 강화학습(RL): 이를 통해 DeepSeek의 추론 모델인 DeepSeek - R1이 탄생하였다.

남은 것은 모델 "증류(distillation)"이다. DeepSeek는所谓 증류 과정을 통해 학습된 더 작은 모델들도 공개했다. LLM 맥락에서 증류는 반드시 딥러닝에서 사용되는 고전적 지식 증류 방법을 따르는 것은 아니다. 전통적으로 지식 증류란, 더 작은 "학생(student)" 모델이 더 큰 "교사(teacher)" 모델의 로짓 출력과 목표 데이터셋에서 동시에 학습하는 방식이다.

그러나 여기서 말하는 증류란, 큰 LLM이 생성한 감독 미세조정(SFT) 데이터셋을 기반으로 더 작은 LLM(Qwen 8B 및 70B 모델, Qwen 2.5B (0.5B - 32B))에 대한 명령 미세조정(instruction finetuning)을 의미한다. 구체적으로, 이러한 큰 LLM은 DeepSeek - V3와 DeepSeek - R1의 중간 체크포인트(checkpoint)이다. 사실, 이 증류 과정에 사용된 SFT 데이터는 앞서 DeepSeek - R1 학습에 사용된 데이터셋과 동일하다.

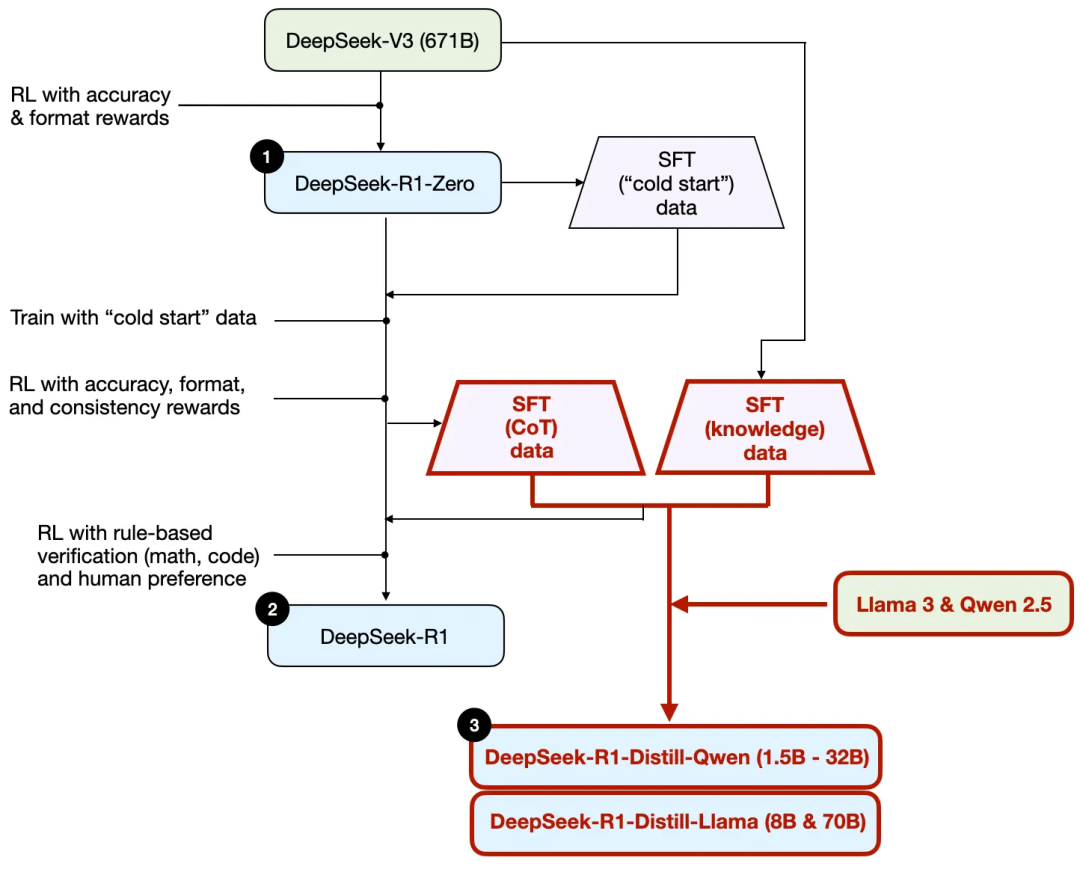

이 과정을 설명하기 위해 아래 그림에서 증류 부분을 강조 표시하였다.

왜 이러한 증류 모델을 개발했을까? 두 가지 중요한 이유가 있다:

1/ 더 작은 모델은 효율성이 높다. 즉 실행 비용이 낮으며 저사양 하드웨어에서도 작동할 수 있어, 많은 연구자들과 애호가들에게 특히 매력적이다.

2/ 순수 감독 미세조정(SFT)의 사례 연구로서. 이러한 증류 모델은 강화학습 없이 순수 감독 미세조정이 모델을 어느 수준까지 끌어올릴 수 있는지를 보여주는 흥미로운 기준점이다.

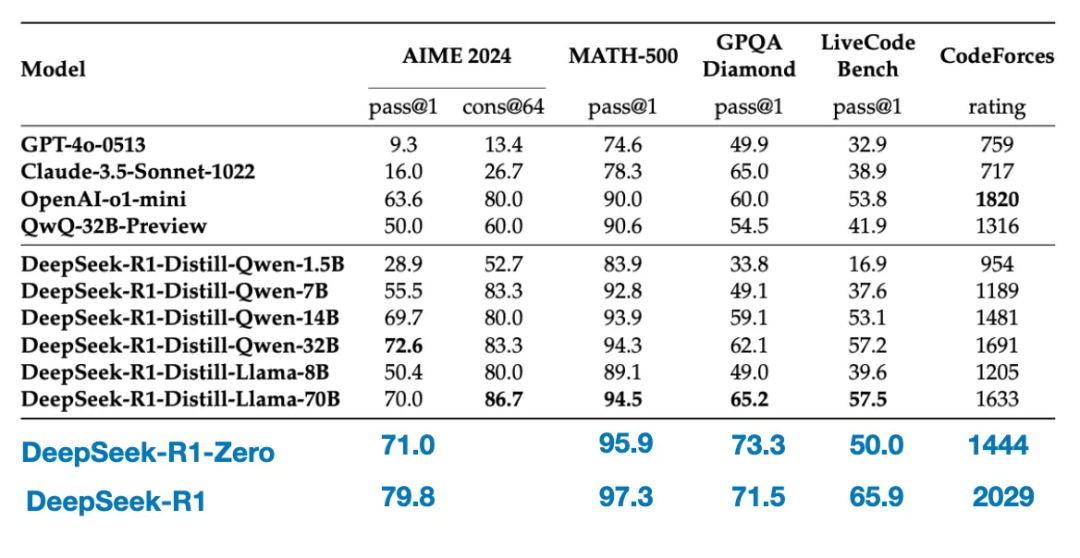

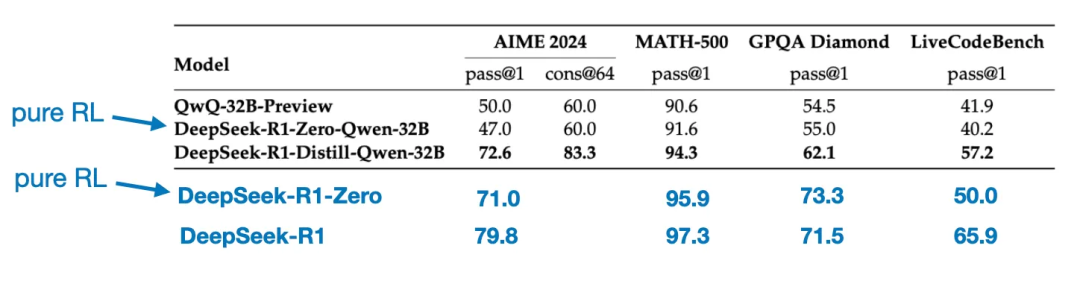

아래 표는 이러한 증류 모델의 성능을 다른 인기 모델 및 DeepSeek - R1 - Zero, DeepSeek - R1과 비교한 것이다.

보는 바와 같이, 증류 모델은 DeepSeek - R1보다 몇 차수 더 작음에도 불구하고 DeepSeek - R1 - Zero보다 훨씬 강력하지만, DeepSeek - R1에 비해서는 여전히 약하다. 또한 o1-mini와 비교해도 성능이 꽤 좋은 편이며(o1-mini 자체도 o1의 유사한 증류 버전일 가능성이 있음) 흥미롭다.

또 하나 주목할 만한 비교가 있다. DeepSeek 팀은 DeepSeek - R1 - Zero에서 나타난 돌발적 추론 행동이 더 작은 모델에서도 발생할 수 있는지 실험했다. 이를 조사하기 위해, DeepSeek - R1 - Zero에서 사용된 동일한 순수 강화학습 방법을 Qwen - 32B에 직접 적용하였다.

아래 표는 이 실험의 결과를 요약한 것으로, QwQ - 32B - Preview는 Qwen 팀이 개발한 Qwen 2.5 32B를 기반으로 한 참조 추론 모델이다. 이 비교는 순수 강화학습만으로 DeepSeek - R1 - Zero보다 훨씬 작은 모델에서 추론 능력을 유도할 수 있는지에 대한 추가적인 통찰을 제공한다.

흥미롭게도, 결과는 작은 모델의 경우 증류가 순수 강화학습보다 훨씬 효과적임을 보여준다. 이는 강화학습만으로는 이러한 규모의 모델에서 강력한 추론 능력을 유도하기에 충분하지 않을 수 있으며, 작은 모델을 처리할 때 고품질의 추론 데이터를 기반으로 한 감독 미세조정이 더 효과적인 전략일 수 있다는 견해와 일치한다.

결론

우리는 추론 모델을 구성하고 향상시키는 네 가지 서로 다른 전략을 살펴보았다:

-

추론 시 확장: 추가 학습이 필요하지 않지만 추론 비용이 증가한다. 사용자 수 또는 질의량이 증가함에 따라 대규모 배포 시 비용이 더 커진다. 그러나 이미 강력한 모델의 성능을 향상시키는 데는 여전히 간단하고 효과적인 방법이다. 나는 o1이 추론 시 확장을 사용했을 가능성이 매우 크며, 이것이 DeepSeek - R1과 비교해 o1이 토큰당 생성 비용이 더 높은 이유라고 생각한다.

-

순수 강화학습 Pure RL: 추론이 돌발적 행동으로 나타나는 과정을 이해한다는 점에서 연구적 관점에서 흥미롭다. 그러나 실제 모델 개발에서는 강화학습과 감독 미세조정(RL + SFT)을 결합하는 것이 더 나은 선택이며, 이를 통해 더 강력한 추론 모델을 구축할 수 있다. 나는 o1 역시 RL + SFT로 학습되었을 가능성이 매우 크다. 좀 더 정확히 말하면, o1은 DeepSeek - R1보다 약하고 규모가 더 작은 기초 모델에서 시작했지만, RL + SFT와 추론 시 확장을 통해 격차를 메웠다고 본다.

-

위에서 설명한 바와 같이, RL + SFT는 고효율 추론 모델을 구축하는 핵심 방법이다. DeepSeek - R1은 이를 실현하기 위한 탁월한 청사진을 제시해주었다.

-

증류: 특히 더 작고 효율적인 모델을 생성하는 데 매력적인 방법이다. 그러나 한계는 증류가 혁신을 이끌거나 차세대 추론 모델을 창출하는 데는 기여할 수 없다는 점이다. 예를 들어, 증류는 항상 기존의 더 강력한 모델에 의존하여 감독 미세조정(SFT) 데이터를 생성해야 한다.

다음으로 기대되는 흥미로운 방향은 RL + SFT(방법 3)와 추론 시 확장(방법 1)을 결합하는 것이다. 아마도 이것이 OpenAI의 o1이 실제로 하고 있는 일이며, 다만 o1은 DeepSeek - R1보다 약한 기초 모델을 기반으로 하고 있을 가능성이 높다. 이것이 DeepSeek - R1이 추론 시 우수한 성능을 내면서도 상대적으로 낮은 비용을 가지는 이유라고 생각한다.

TechFlow 공식 커뮤니티에 오신 것을 환영합니다

Telegram 구독 그룹:https://t.me/TechFlowDaily

트위터 공식 계정:https://x.com/TechFlowPost

트위터 영어 계정:https://x.com/BlockFlow_News