GitHub Copilot の有料化が、AI 業界最大の嘘を暴いた

TechFlow厳選深潮セレクト

GitHub Copilot の有料化が、AI 業界最大の嘘を暴いた

OpenAI、Anthropic、マイクロソフトが同時に赤字を出してあなたを養っているが、このゲームはもう長く続かない。

著者:エド・ジトロン

翻訳・編集:TechFlow

TechFlow 読者向け解説:マイクロソフトはついに限界に達した。GitHub Copilot の課金モデルが、従来の月額制からトークン単位課金へと移行する。これは製品のアップグレードではなく、OpenAI や Anthropic などが主導してきた「AI業界全体の補助金詐欺」の集団的破綻を意味する——彼らは月額料金という仕組みで実際のコストを隠蔽し、ユーザーが1ドル支払うたびに8〜13ドル分のコンピューティングリソースを燃やし尽くすという、そもそも持続不可能な利用習慣を育ててきたのだ。価格が現実へと回帰すれば、その「革命的」と称されたAIツールの多くは、単なる高価なおもちゃに過ぎないことが明らかになるだろう。

私は先日、OpenAIがOracleを駆逐しようとしている様子を描いた記事を書いたが、本稿ではその一部の素材を再利用している。これは私がこれまでに執筆した中でも最高の記事の一つであり、非常に誇りに思っている。

有料購読プランへの登録は、極めてコストパフォーマンスが高く、また私にとっては、こうした大規模かつ深掘りされた無料記事を毎週発信するための基盤となっている。

昨日の朝、GitHub Copilot ユーザーは、私が一週間前に報じていた通りのニュースを公式に確認した——2026年6月1日より、すべての GitHub Copilot プランが、使用量ベース(トークン単位)の課金へと移行する。

マイクロソフトは、これまではユーザーに一定数の「リクエスト回数」を提供していたが、今後はユーザーが実際に利用したモデルのコストに基づいて課金する。同社はこれを「……持続可能で信頼性の高いCopilot事業およびすべてのユーザー体験へと進む上で重要な一歩」と位置づけている。ユーザーが使える量は、支払ったサブスクリプション料金で購入できるトークン数に依存する(例:月額19ドルのプラン=19ドル分のトークンが利用可能)。

翻訳すると:「我々はGitHub Copilotユーザーへの補助を続けることはできない。さもないと、マイクロソフトCFOのエイミー・フッドが野球のバットで殴りかかってくるだろう。」

この発表自体が、こうした価格変更がいかに巧妙に包装されるかを示す興味深い予告編となっている:

Copilotは、すでに1年前の製品とはまったく異なるものとなった。それはもはやエディタ内に留まるアシスタントではなく、最新のモデルを活用してコードベース全体を反復的に探索しながら、長時間・多段階のコーディングセッションを自律的に実行する「エージェントプラットフォーム」へと進化した。エージェント型利用が標準となりつつあるなか、その計算負荷および推論コストは飛躍的に増大している。つまり、今や「短いチャット質問」と「数時間に及ぶ自律的コーディングセッション」に対して、ユーザーは同じ金額を支払っていたのだ。GitHubはこうした利用に伴う急増する推論コストをこれまで吸収してきたが、現在の「リクエスト回数ベース」の上級プランはもはや持続不能である。使用量ベース課金は、この問題を解決する。それは価格設定を実際の利用状況により正確に連動させ、長期的なサービス信頼性を維持するとともに、ヘビーユーザーに対する制限を減らすことを可能にする。

ご覧の通り、マイクロソフトが約200万人のユーザーのコンピューティングリソースを補助しているわけではない——AIがこれほど強力かつ複雑になり、事実上まったく別の製品になってしまったのだ!

確かにCopilotは「1年前の製品ではない」かもしれないが、根底にある経済的不整合はほとんど変わっていない:マイクロソフトは過去3年にわたり、ユーザーが月額料金を超えるトークンを消費することを黙認し続けてきた。『ウォールストリート・ジャーナル』2023年10月号の報道によれば:

個人ユーザーは、このAIアシスタントの利用のために月額10ドルを支払っている。関係筋の話では、今年初めの数か月間、同社はユーザー1人あたり平均で月額20ドル以上を赤字で負担しており、なかには1人あたり月額80ドルもかかるユーザーもいたという。

当然ながら、GitHub Copilot ユーザーは今や反乱を起こしており、「製品は死んだ」「完全に台無しになった」と声を上げている。

私は2年前の『サブプライムAI危機』という記事で、この日の到来をすでに予言していた:

ついにその日が来た。なぜなら、あなたが利用しているあらゆるAIサービスは、コンピューティングリソースを補助しており、それゆえすべてが赤字を抱えているからだ。

あなたがAIスタートアップのサービスに支払う料金——もちろんOpenAIやAnthropicも含む——は、AnthropicのClaudeであれば月額20ドル、100ドル、200ドル、Perplexityであれば月額20ドルまたは200ドル、OpenAIであれば月額8ドル、20ドル、200ドルといった定額サブスクリプションである。企業向けのケースでは、「ワークロード単位」の「クォータ」が与えられることもある。例えばLovableは、月額25ドルのサブスクリプションでユーザーに「月100クォータ」を提供し、さらにクラウドホスティング費用として25ドル(2026年第一四半期末まで)を負担している。クォータは翌月以降に繰り越しが可能だ。これらのサービスを利用する際、関係企業はAI研究所に対して「100万トークンあたり○○ドル」という単価で支払いを行ったり(AnthropicやOpenAIの場合は)、クラウドプロバイダーに対してGPUをレンタルしてモデルを実行するための費用を支払ったりしている。1トークンはおよそ3/4語に相当する。ユーザーとしてはトークンの消費量を直接意識することはなく、ただ入力し、出力を得るだけだ。AI研究所は「トークン」「メッセージ」あるいは「5時間あたり○○%」といった形のレート制限でサービスの実コストを隠蔽しており、ユーザーはそれが一体いくらかかるのかを実感できないままになっている。一方、バックエンドではAIスタートアップが猛烈な資金流出を続けている。つい最近までAnthropicは、ユーザーが1ドルのサブスクリプション料金を支払うごとに最大8ドル分のコンピューティングリソースを消費することを許容していた。OpenAIも同様の運用を行っていたが、具体的な金額は測定が難しい。

AIスタートアップとクラウドサービス大手は、補助・赤字によるサービス提供で十分なユーザー数を獲得でき、企業が価格を引き上げてもユーザーが乗り換えを拒否するほどに依存させられるだろうと考えていた。また、彼らはトークン単価が時とともに下がると信じ込んでいたが、実際には——いくつかのモデルの価格は低下したものの、より新しい「推論」モデルはより多くのトークンを消費するため、結果として推論コストはむしろ時間とともに上昇している。

この2つの前提はいずれも誤りであり、大規模言語モデル(LLM)を活用するあらゆるサービスにとって、月額サブスクリプションというモデルはそもそも成り立たない。

生成AIの核心的経済モデルはすでに崩壊している

こう考えてみてほしい。Uber(いや、これはUberとはまったく違う)が配車料金を引き上げ始めたとしても、その裏側にある経済的ロジックは変わらないし、乗客やドライバーが目にしているものも変わらない——乗客は1回の乗車に対して支払い、ドライバーは1回の乗車に対して報酬を得る。ドライバーは依然としてガソリン代、自動車保険、地方政府が要求する許可証、さらには車両のローン返済などのコストを負担しなければならないが、これらはUberによって補助されない。Uberの巨額の赤字は、補助金、終わりのないマーケティング費用、そして失敗が確定した自動運転車開発などの研究投資に起因している。

生成AIのサブスクリプションは、Uberとはまったく異なる

AIにおける価格設定の不適合の規模を説明するために、Uberがまったく異なるビジネスモデルを採用していた並行世界を想像してほしい。

生成AIのサブスクリプションは、たとえばUberが「月額20ドルで100回、100マイル以内の乗車を提供し、ガソリン代は1ガロン150ドル、しかもUberが全額負担する」というビジネスモデルを採用していたようなものだ。なぜなら誰かが「石油はいずれ計測する価値すらないほど安くなる」と固く信じ込んでいるからである。

最終的にUberは、ユーザーに月額料金を支払って乗車資格を得させ、さらにその利用分のガソリン代を別途徴収するという方針に切り替えるだろう。すると、ユーザーは「月額20ドルで100回乗れる」から、「月額20ドルの乗車資格+10マイル走行で26ドルのガソリン代」という構造へと突然変化する。ユーザーが不満を感じるのは当然である。

これはやや誇張に聞こえるかもしれないが、実際にはGitHub Copilotを含む生成AI業界が今まさに直面している状況を、極めて正確に比喩したものである。

GitHub Copilotの旧来の価格設定では、月額300回の「上級リクエスト」およびGPT-5 miniなどのモデルを利用した「無制限のチャットリクエスト」が許容されていた。ここで言う「リクエスト」とは(マイクロソフトの定義によれば)「Copilotに何かを実行してもらうためにユーザーが行うあらゆるインタラクション」であり、リクエストベースのシステムでは、より高価なモデルを使用するとリクエスト数を多く消費する。例えばClaude Opus 4.6は1回の使用で上級リクエストを3回分消費する。上級リクエストを使い切ると、Copilotは当該月の残り期間について、より安価なモデルの自由利用を許可する。

しかし、このような状況が常に続いたわけでは決してない。2025年5月までは、マイクロソフトはユーザーにモデルの無制限利用を認め、それでもユーザーは製品に何らかの制限があることに激しく怒っていた。

マイクロソフト——そしてすべてのAI企業と同様に——は、持続不能なサービスを販売することで顧客を欺いてきた。なぜなら、月額サブスクリプションという形でLLM駆動サービスを販売することは、そもそも全く合理的でないからだ。

トークン課金制のサービスがどれほど高額になるかを知りたいなら、GitHub Copilotのサブフォーラムのあるユーザーが、過去の1回の上級リクエストにかかるトークンコストが約11ドルであったことを突き止めている。なぜなら1回の「リクエスト」には、6万トークンのコンテキストウィンドウ利用、複数のツール呼び出し、および出力を生成するためにモデルが内部で行う多数の「ラウンド」(処理ステップ)が含まれていたからだ。

さらに、幻覚を起こしやすい大規模言語モデル(LLM)という根本的な信頼性の低さもある。1回の上級リクエストが無限ループに陥り、半端なコードを吐き出すのは確かに苛立たしいが、自分が実際に支払っているとなると、同じ障害はそう簡単に許せなくなるだろう。

ユーザーはまた、トークン課金制とはまったく異なる方法で製品を使うように訓練されており、多くの人が自分がどれだけの「トークン」を消費しているのか、あるいは特定のタスクにどれだけのトークンが必要なのかを、実際にはまったく理解していない。これは使用するモデルによって大きく変動する。

これはUberとはまったく異なる。そう主張する者は、悪質な行為を擁護しようとしているにすぎない。Uberは価格を引き上げたかもしれないが、プラットフォームの根本的な経済ロジックを劇的に変更する必要はなく、ユーザーも「ガソリン1ガロンあたりの課金が始まったから」という理由で製品の使い方を完全に変える必要はない。

月額AIサブスクリプションは、すべてがAI補助金詐欺の一環であり、生成AIをその実コストから意図的に分離しようとする試みである

LLM駆動サービスを経済的に持続可能な形で提供する唯一の方法は、ユーザーごとの実際のトークン消費量に応じて課金することであり、それ以外のあり方は存在しない——そして、こうした企業は顧客を欺く過程で、虚構のメリットと疑わしい投資収益率(ROI)を持つ製品を生み出してきたのだ。

これは長年にわたって明白であった。

経済学的には、コストが比較的固定されている場合のみ、月額サブスクリプションが成立する。ジムは会員制度を販売できる。なぜなら、設備の摩耗度、クラス運営コスト、電気・人件費・水道費など、特定の期間内にどれくらいの費用がかかるかを概ね把握できているからだ。

Google Workspaceの顧客——少なくともAI導入以前は——のコストは、ドキュメントへのアクセスや保存、Google Docsなどの継続的利用にかかる費用であった。デジタルストレージコストは比較的低く(しかもLLMとは異なり、Google Workspaceの計算負荷は高くない)、そのため、特にヘビーユーザーであっても、月額サブスクリプションの利益を侵食することはない。

しかし、こうしたサービスは意図的にトークン数や特定アクティビティのコストを隠蔽しているため、ユーザーはレート制限の意味を実感できず、その都度の変更に慌てて「自分はこのサービスで実際どれだけの作業ができるのか?」を必死に探らざるを得ない。

これは虐待的・操作的・欺瞞的な商慣行であり、その唯一の目的は、AnthropicやOpenAIなどのAI企業がユーザー基盤を拡大することにある。なぜなら、ほとんどのAIユーザーは、1ドルのサブスクリプション料金で8〜13.5ドル分のトークンを消費できるという視点を通して、その「真の」あるいは「想像上の」メリットを認識しているからだ。

この意図的な欺瞞行為にはただ一つの目的がある:大多数の人々が生成AIの実コストに触れることを永久に妨げることだ。『アトランティック』誌がClaude CodeをAnthropicの「ChatGPTモーメント」と呼んで熱狂的な論説を掲載したとき、その根拠は月額20ドルのサブスクリプションであり、Anthropicが実際にそれを提供するために費やしている裏側のトークンコストではなかった。その結果、著者はモデルが犯す「小さなミス」や、「より複雑なプログラミングタスクで行き詰まる」ことさえも許容してしまうのだ。

もし著者が自身の実際のトークン消費量に応じて支払っていたなら、そして1度の行き詰まりで15ドルのトークン費用が発生していたなら、彼女はこうした障害をそこまで寛容に受け入れることはなかっただろう。

だが、これはすべて詐欺の一部なのだ。

極めて重要だが、主流メディアでAIを扱う記者たちは、実際にはこうしたサービスがどれだけのコストを要するのかを理解していない。ChatGPTやClaude Codeといったサービスに関する主流メディアの記事は、ほぼすべて、個別のタスクがユーザーにどれだけの費用を負わせるかをまったく知らない人物によって書かれている。

忘れてはならない:生成AIサービスの多くは、他の現代ソフトウェアやハードウェアとはまったく異なる機能を持つ実験的製品である。人々は単にChatGPTやClaudeの前に行き、「仕事を始めろ」と命じることができないのだ。

もちろん、それは可能ではある。しかし、プロンプトが不適切だったり、その仕組みを理解していなかったり、入力した内容にミスがあったり、あるいはモデル自体が間違っていた場合、望ましくない出力を得ることになる。すると、再びプロンプトを送る必要が生じる。LLMは本質的に予測不能である。

LLMが特定の動作を実行することを保証できないし、現実に基づいた結果を提示することも保証できない。ある特定のタスク——たとえそれを過去何度もLLMで実行していたとしても——がどれだけの費用を要するかも確実には分からないし、モデルがいつ何を勝手に削除したり、何もしないのに「やった」と偽装したりするかもわからない。

ユーザーが実際のレートで支払うことを強いられた場合、多くの人は即座に製品を放棄するだろう。なぜなら、LLMの可能性を探るために試行錯誤を繰り返すだけで、容易に5ドル分のトークンを消費してしまうからだ。

余談だが、実はあなたは一度も望む結果を得ることなく、膨大な金額を失うことも可能だ。なぜならLLMは、そもそも「本当に人工知能」ではないからだ!その限界を正しく理解している人であれば、LLMに「技術的・経済的にまったく実現不可能な壮大なことをやれ」と説得しようと、30ドル、50ドル、あるいは100ドルを平気で使い果たすだろう。この現象には専門用語がある。「お世辞」(flattery)。LLMは通常、ユーザーを肯定するよう設計されており、たとえ危険な妄言を述べていたとしても例外ではない。それは「あなたがそんな壮大なことをやりたい?もちろんできますよ!」という応答にも及び、業界がこうしたコストを隠蔽しようとする動機を明瞭に示している——これはまさに「ぼったくり」だ!

私は、ほとんどのAIサブスクリプションがトークン課金制へと移行するのは避けられないと思う。実際、AnthropicやOpenAIはすでに企業向けにこの方式を導入している。

一般企業はトークン課金制への移行を負担できるのか?Anthropicの推定では、Claude Code利用者の1日あたりの費用は13〜30ドル(年間7,000ドル以上)、大規模組織では年間数十万〜数百万ドルに及ぶ

私が先週議論した通り、UberのCTOはある会議で、同社が2026年のAI予算を数か月で使い果たしてしまったと発言した。ゴールドマン・サックスは、一部の企業がAIトークンに人件費の10%相当を費やすと推定しており、今後数四半期で100%に達する可能性すら指摘している。

これは、各AIサービスの利用を最大限に促す一方で、その実コストを隠蔽するという戦略の直接的な結果である。すべての従業員に「AIをできる限りたくさん使え」と指示する大企業は、実際のトークン消費量を一切無視または完全に無視した上で、こうした命令を下している。企業が実コストを支払わざるを得なくなったときに、この技術への投資が経済的に正当化できるのか、私は甚だ疑問である。

もちろん、「エンジニアがコードをより速く納品できる」などという空虚な主張は聞くが、それは理解している。しかし、実際にはどれほど速くなったのか?それによってどれだけ儲けたのか、あるいは節約できたのか?もし人件費の10%をAIトークンに費やしているなら、その追加コストはどこか他の部分で相殺されているのか?私はそうだと断言できない。AIトークンに巨額を投じる企業が投資収益率(ROI)を得ているという証拠は、どのROI調査でも見つかっていない。

ほとんどの場合、生成AIの可能性について熱狂的に語っている人々は、その実コストを負担せずに体験している。Twitter上で「エンジニアチーム全員がClaude Codeを狂ったように使っている」と延々と書き散らす人たちが使っているのは、1人あたり月額125ドルのTeamsサブスクリプションであり、その利用制限はAnthropicの消費者向け月額100ドルプランとほぼ同等である。LinkedIn上で「Perplexityの製品を使って数分で数時間分の仕事を終えた」と断言する人々が支払っているのは、せいぜい月額200ドルのPerplexity Maxサブスクリプションにすぎない。

実際には、10人のチームで月額1,250ドルのTeamsサブスクリプションを契約している場合、API呼び出し費用として月額5,000ドル〜10,000ドル、あるいはそれ以上の金額を費やしている可能性が高い。Anthropicの成長責任者アモル・アワサレ氏は先週、Maxサブスクリプションは「ヘビーなチャット利用」を想定したものであり、「Claude CodeやCoworkで行われているような活動」には向いていないと明言し、「優れた体験を継続的に提供するためのさまざまな選択肢を検討中」であると述べている——言い換えれば、「いずれ価格を調整します」である。

人々がトークンがどれほど高価かを、特に大規模コードベースを頻繁に解析し、コーディングやインフラツールを大量に呼び出すプログラミングプロジェクトにおいては、実感していないのではないかと私は懸念している。月額200ドルの人が350ドル、400ドル、500ドルを負担できるのか?ある月にその額を超えてしまうのはどうなのか?予算オーバーしたらどうするのか?あるいは、そもそも仕事を完了するのに必要な費用を負担できない場合はどうするのか?

より現実的な例を挙げよう。今年4月初旬まで、Anthropic自身のClaude Code開発者ドキュメント(アーカイブ版)には、以下のように記載されていた。「[Claude Codeユーザー]の平均コストは、1人あたり1日6ドルであり、90%のユーザーは1日あたり12ドル未満に収まっている」。ところが、今週のドキュメントには次のように記述されている:

Claude CodeはAPIトークン消費量に応じて課金されます。サブスクリプションプラン(Pro、Max、Team、Enterprise)の価格についてはclaude.com/pricingをご覧ください。各開発者のコストは、使用するモデル、コードベースのサイズ、利用パターン(複数インスタンスの実行や自動化など)によって大きく異なります。企業導入の場合、平均コストは1人あたり1日あたり13ドル、1か月あたり150〜250ドルであり、90%のユーザーは1日あたり30ドル未満に収まっています。チームの支出を推定するには、まず小規模なパイロットグループから始め、以下のトラッキングツールを用いてベースラインを確立し、その後展開してください。

1か月の平均営業日数を21日と仮定すると、Claude Codeユーザーの平均コストは月額約273ドル、年間約3,276ドルとなる。1営業日あたり30ドルとすると、月額630ドル、年間7,560ドルとなる。

これらの数字は驚くべきものであり、さらに驚くべきは、Anthropicのより新しいモデルを使えば、1日30ドルで済ませることは不可能だということだ。Claude Opus 4.7の料金は、入力トークン100万トークンあたり5ドル、出力トークン100万トークンあたり25ドルである。100万トークンはおよそ5万行のコードに相当し、いわゆる最先端モデルを用いれば、少なくとも100万トークンは確実に消費される。特定のタスクにどのモデルを使うべきかを熟知していない場合、この数字は急激に跳ね上がる。

では、この30ドルという数字をもう少し掘り下げてみよう。

10人の開発チームの場合、年間コストは75,600ドル(営業日のみ)となる。

3か月間、1営業日あたりの平均コストが50ドルに上がれば、88,200ドルになる。

さらに1か月間、100ドルを超えると、年間で102,900ドルになる。

1日300ドルを費やせば、10人で年間756,000ドルになる。

これは資金豊富なスタートアップやMetaのような「バナナ共和国」的な備えを持つ企業の思考回路では可能かもしれないが、コストを重視する企業にとって、この「生産性向上」サービスに5桁または6桁の追加費用をかけることが、誰にも測定できないその「向上」を根拠に正当化できるとは到底思えない。

さて、私は現在の企業を以下の3種類に分類できると考えている:

SpotifyやUberのような大規模組織における企業導入で、AIに夢中なCEOが予算を無制限に許可しているケース。資金豊富な大規模スタートアップも同様である。

資金豊富な大規模スタートアップも同様である。

補助付きの「Teams」サブスクリプションを利用する中小規模のスタートアップ。

Claudeやその他のAIサブスクリプションを月額で利用する個人ユーザー。

大規模組織は依然として、「最も優秀なエンジニアは一切コードを書かない」という疑わしい恩恵を根拠に、ソフトウェアエンジニアに数百万ドルのAIトークンを費やしていると主張できる。

しかし、1度の酷い決算発表会議で、この物語は一変するだろう。ある時点で、投資家——AIバブルを煽り続けている馬鹿げた愚か者たちでさえ——は、収益成長が追いつかないなかで、不断に膨らむ研究開発コスト(AIトークン消費は通常ここに隠されている)に疑問を呈し始めるだろう。これは、Metaのようにコスト削減のためのさらなる人員削減を招き、最終的には「これらは本当に私たちの仕事をより速く・より良くしてくれているのか?」という問いかけによって縮小へと至るだろう。

また、私は、6か月以内に、AIトークンに人件費の10%以上を費やしているスタートアップが、投資家に対してその必要性を説得できるとは思わない。

全員がトークン課金制へと切り替わった後、生成AIに関する過剰な喧騒がどれほど続くかは、私には見通せない。

AIデータセンターおよびコンピューティングリソースの経済学は非現実的である

人々がAIデータセンターについて語る方法は、現実から完全に乖離しており、時代全体がいかに滑稽なものになってしまったかを、人々はまだ気づいていない。

AIデータセンターの建設・運用コストは極めて高く、実際の収益はわずかである

TD Cowenのジェローム・ダーリング氏によると、主要IT設備(GPUおよび関連ハードウェア)のコストは約3,000万ドル、1MWあたりのデータセンター容量コストは1,400万ドルである。データセンターの建設には1〜3年かかるのが一般的であり、これは電力供給が確保されているという前提での話である。

2028年末までに建設が予定されている114GWのデータセンターのうち、実際に工事中のものはわずか15.2GWに過ぎない。そして「工事中」という表現は、単に「地面に穴が空いている」状態を意味する可能性すらある。それは——そしてそうあるべきではない——その施設が提供する容量がすぐに利用可能になることを意味しない。

まずは単純に考えよう:「100MW」という数字を見たら、「44億ドル」と考えよ。その大部分はNVIDIA GPUに費やされる。

したがって、各AIデータセンターは、当初から数百万ドルの赤字を抱えることになり、6年間の減価償却計画を採用しても、損益分岐点に達するには長期間を要する……しかもNVIDIAの年次アップグレードサイクルを考えると、最初の顧客契約が終了した時点で、そのGPUはもはや大きな収益を生まない可能性が高い。

また、OpenAIやAnthropic以外にAIコンピューティングリソースの顧客が存在するのかは不明である。実際、両社の需要が建設中のAIデータセンターの50%を占めている。どちらか一方が支払い不能となれば、巨大なシステミックリスクが生じる。

いずれにせよ、こうしたデータセンターがどのような継続的レートで課金するのかは不明である。スポット価格はB200 GPUあたり1時間あたり約4.50ドルだが、長期契約の価格は通常ずっと低く、ある創業者(The Information紙報道)によると、1年間のコミットメントでGPU1台あたり1時間あたり約3.70ドルを支払っているという。

明確にしておくが、他人のサーバー上でランダムにGPUを起動する「スポットコスト」と、データセンターの資本支出の大部分を占める「契約型コンピューティングリソース」は区別しなければならない。多くのデータセンターは、1〜2社の大口顧客を想定して建設されており、それらの顧客はより安い混合レートを交渉することが可能である。

したがって、多くのデータセンターは1時間あたり3.70ドルよりも低い価格で課金しており、これは1MW(またはkW)あたりの価格で課金しているためである。

ここから経済学が崩壊し始める。

100MWデータセンターの崩壊経済学——1時間あたり2.55ドル、100%稼働率で粗利16%、債務負担により実質赤字

これは100MWデータセンターの初期コストである。100MWのデータセンターの実際の課金可能容量は85MW程度であり、超大規模データセンターの課金に詳しい情報源との議論を踏まえると、1MWあたりの収益は約1,250万ドル、年間収益は約10.63億ドルと予測される。

ここで明確にしておくが、あなたが知っているほとんどのデータセンター企業は、実際にはデータセンターを建設していない。建設はApplied Digitalのような企業に委託しており、これらは「ホスティングパートナー」とも呼ばれている。例えばCoreWeaveは、ノースダコタ州のApplied Digitalのデータセンターを利用するためのホスティング費用を支払っている。CoreWeaveはデータセンター内のすべてのGPUおよびその他の技術を管理している。

経済的不整合を説明するため、理論上のAIコンピューティングリソース企業に賃貸するデータセンターを例に取ろう。

このデータセンターのGPUはおそらくNVIDIAのBlackwellチップである。より可能性が高いのは、8基のB200 GPUを搭載したポッドであり、小売価格は1基あたり約45万ドル、すなわちGPU1基あたり56,250ドルである。85MWの主要IT負荷を前提とすると、1MWあたりの総資本支出は約3678万ドル、総IT資本支出は約31.26億ドル、そのうちGPUに費やされる金額は約26.7億ドルとなる。

このデータセンターがノースダコタ州エレンデールにあると仮定すると、産業用電力料金は1kWhあたり6.31セントであり、年間電気代は約5,540万ドルとなる。情報源との議論を踏まえると、保守・人件費・電源交換などの継続的コストは収益の約12%、すなわち年間約1.28億ドルと推定される。これにより、総コストは1.834億ドルとなる。

待ってほしい。主要IT設備に対するホスティング費用も支払う必要がある。Brightlio社によると、この費用は規模や場所に応じて1kWあたり月額180〜200ドル程度であり、私が読んだ中では最低130ドルという記述もあり、ここでは130ドルを採用する。これは年間約1.33億ドルに相当する。これにより、総コストは3.164億ドルとなる。

まだ10.6億ドルよりは少ないから、大丈夫だろう?

違う!31.26億ドルのIT機器の減価償却が必要であり、6年間で償却すると年間約5.21億ドルとなる。これにより、年間総コストは8.374億ドルとなり、年間利益は約1.686億ドル、すなわち粗利率は約16.7%となる……

……ただし、稼働率が100%を維持できた場合に限る!データセンターはGPUの設置や顧客の導入に1〜2か月を要し、その間は収益ゼロであり、ホスティング費・電気代・運営費などのコストは大幅に発生する。ただし、これらのコストは実際にはずっと低く(私は電気代を10%、ホスティング/運営費を15%とモデル化した)、1日あたり約327万ドルの損失を被ることになる。

この例では、稼働開始までにさらに1か月を要すると仮定する。つまり、すでに約1.02億ドルを支払い、二度と回収できないという状況になる。これにより、減価償却を含む年間総コストは9.394億ドル、粗利率は6.6%となる。

待って、まさかこのGPUを借金で買ったのではないだろうか?借金した?どれほどひどいことになっている?天哪——6年物のアセットバックドローンで、貸付価値比率(LTV)80%で28億ドルを6%の金利で借りたのだ。

銀行は永遠の寛大さを示し、12か月の据置期間(元金返済なし、利息のみ支払い)という取引をしてくれた——これにより、1年目の利息支払いは約1.68億ドルとなり、(遅延分1か月を公平に除外した)1年目の総コストは約10.05億ドルとなる……収益は10.6億ドルである。

これは5.19%の粗利率であり、まだ元金返済は始まっていない。これが発生すると、毎月5410万ドルのローン返済が必要となり、今後5年間で年間約6.49億ドル、合計約14.8億ドル、粗利率はマイナス40%となる。

明確にしておくが、これは100%の利用率が維持され、テナントが常に期日通りに支払いを行うという前提での話である。

Stargate Abileneは災難——GPU1台あたり1時間2.94ドル、年間収益100億ドル、完成が数年遅延、テナントは年間数十億ドルの赤字を抱える

データセンター史上で最も経済的に実行可能な単一プロジェクト——世界最大のAI企業のためにOracleが建設する大規模キャンパス——について語ろう。Oracleは数十年の歴史を持つ準超大規模企業であり、高価なデータベースおよび業務管理ソフトウェアを企業や政府に販売してきた実績を持つ。

ハッハッ、もちろん冗談だ。この場所はまさに地獄の業である。

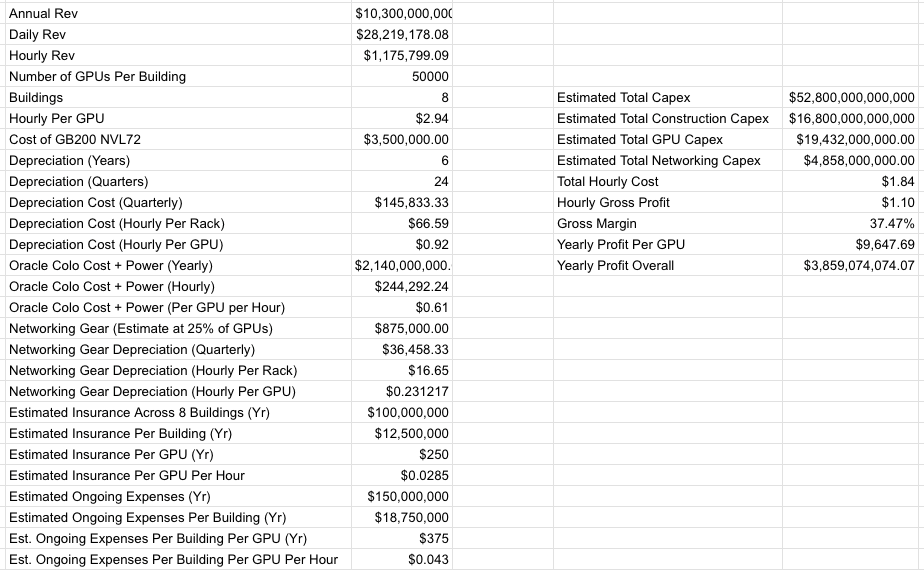

Stargate Abileneは、8棟の建物からなる1.2GWのデータセンター・キャンパスであり、主要IT負荷は約824MWである。2024年7月に初めて発表された。2026年4月27日時点では、2棟の建物のみが稼働し収益を上げており、3棟目にはほとんどIT機器が設置されていない。私の推定では、Stargate Abileneの総コストは約528億ドルである。

私の独自取材によると、OracleはStargate Abileneから年間約100億ドルの収益を得ると予測しており、私が推定するところでは、同社が1顧客(OpenAI)のために建設した7.1GWのデータセンター容量から得る総収益は約750億ドルに上る。また、私が報じた通り、Oracleは2024年にAbileneのホスティングおよび電気代として、土地開発業者Crusoe社に年間少なくとも21.4億ドルを支払うと見積もっている。

さらに付け加えると、OracleがAbileneの建設費用をすべて負担しているように見える。

私の計算および取材に基づくと、Abileneが全面稼働した場合の粗利率は約37.47%と推定される:

明確にしておくが、37.47%という粗利率は高すぎる可能性がある。なぜなら、Oracleの正確な保険料や人件費の数字は不明であり、当刊が閲覧した文書に基づく推定にすぎないからだ。また、OracleがStargate Abileneのようなプロジェクトに未来をすべて賭けており、数十億ドルの先行コストを発生させていることを明確にしておくべきだ。この事業は、OpenAIが期日通りにすべての支払いを行ったとしても、収益化には長期間を要する。

残念ながら、Abileneの建設費用のうち、どれだけが借金で賄われているかは特定できない。私が知っているのは、Oracleが2025年9月に7年〜40年の償還期間を持つさまざまな規模の債券を約180億ドル発行したこと、および直近の四半期決算で247億ドルのマイナスキャッシュフローを記録したという事実である。

私が確実に知っているのは、Oracleが開発業者Crusoeと15年間の賃貸契約を結んでおり、Oracleの将来はOpenAIが支払いを継続できるかどうかに大きく依存しているということだ。そしてそれは、OracleがStargate Abileneプロジェクトを完了できるかどうかにかかっている。

さらに明確にしておくが、年間38.5億ドルの利益は、OpenAIが期日通りに支払いを行い、Abileneに最速で導入され、すべてが計画通りに進行した場合にのみ実現可能である。

OpenAIが今後4年間に8520億ドルの収益・資金調達・借入金を調達できなければ、Stargateデータセンター・プロジェクトはOracleを破滅させる

残念ながら、まったく逆の事態が発生している:

DatacenterDynamicsの報道によると、最初の200MWの電力は「2025年」に投入される予定だった。その後、導入は2025年上半期から始まり、「2025年内に1GWに達する可能性」があり、2026年中盤には1.2GWの全容量が完成し、2026年中盤に通電され、2026年底前に64,000基のGPUが展開される予定だった。2025年9月30日時点では、「2棟の建物が稼働している」。2025年12月12日には、Oracle共同CEOのクレイ・マゴユアーク氏がAbileneは「計画通りに進行中」であり、「96,000基以上のNVIDIA Grace Blackwell GB200をすでに納入済み」と述べている。これは2棟の建物のGPU数である。それから4か月後の2026年4月22日、OracleはX(旧Twitter)で「……Abileneでは200MWが既に稼働中であり、8棟の建物からなるキャンパスの納入も計画通りに進行中です」と投稿している。現時点では、これが200MWの主要IT容量なのか、Abileneキャンパスの総可用電力なのかは不明である。いずれにせよ、これは2棟の建物を支えるに足るだけの容量であり、Oracleは決して「計画通りに進行中」ではない。

これは重大な問題である。OpenAIは実際に存在するコンピューティングリソースに対してのみ支払いを行うことができ、実際の収益を生む主要IT容量は206MWに過ぎない。3棟目の建物は、少なくとも1か月(あるいは1四半期)は稼働しないだろう。

しかし、Stargateデータセンター・プロジェクトには、さらに大きく根本的な問題がある——OpenAIがその馬鹿げた、漫画のような予測を実現できた場合にのみ、すべてが意味を持つのだ。

私が金曜日に議論した通り:

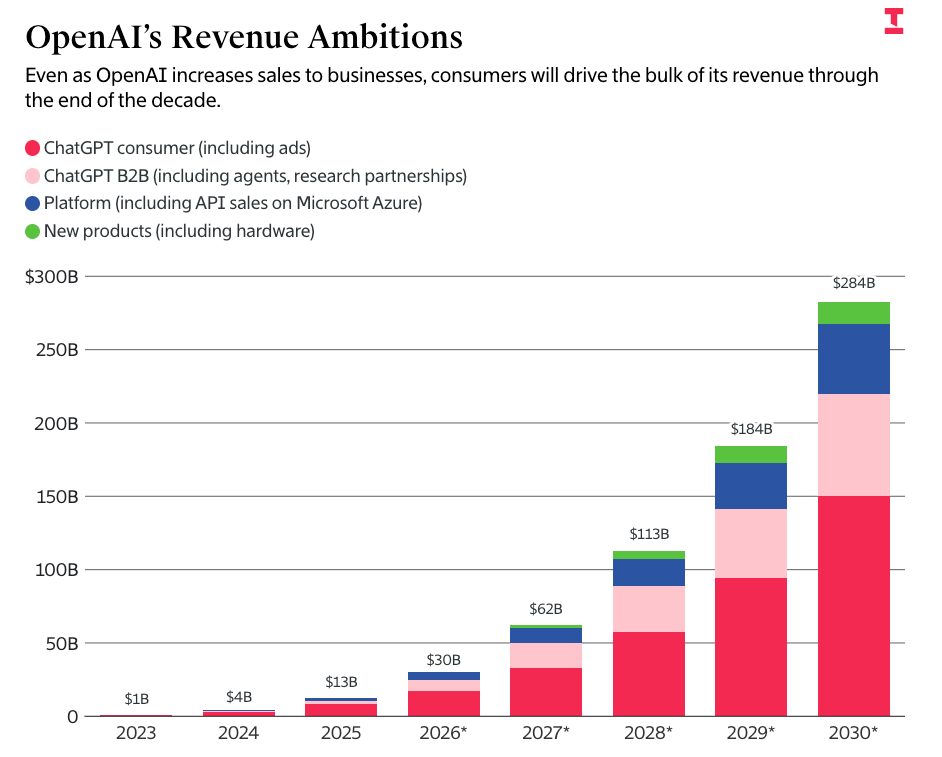

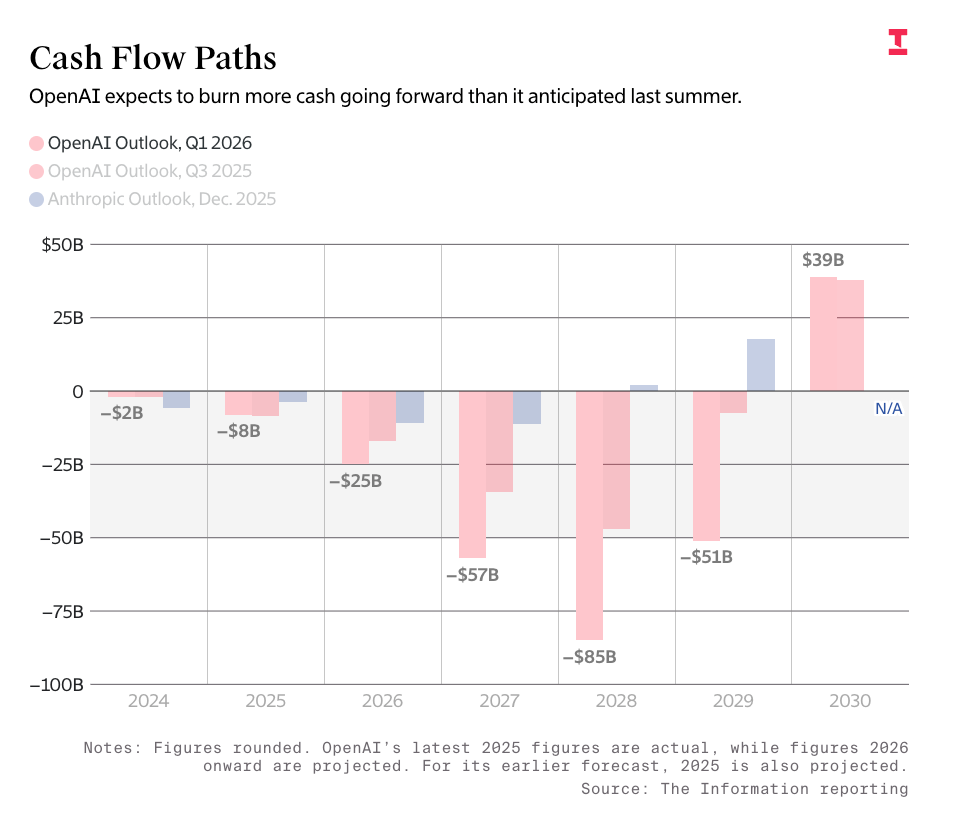

改めてこれらの数字を繰り返す:建設中の7.1GWのStargateデータセンターが完成すると、年間約750億ドルの収益を生むことになるが、総コストは3400億ドルを超える。Oracleのフリー・キャッシュフローはマイナス247億ドルであり、他の事業部門は停滞しており、このマイナスから低利益のクラウド事業が唯一の成長エンジンとなっている。Oracleとのコンピューティングリソース契約——アマゾン、マイクロソフト、CoreWeave、グーグル、ケルベロス、およびOracle自身との契約——を実際に履行するためには、OpenAIは4年間で8520億ドルの収益および/または資金調達を実現しなければならない。これは、同社の事業を年間250%以上成長させ、2030年末までに実質的に10倍に拡大させ、その時点でキャッシュフローをプラスに転換するという、極めて困難な目標を意味する。明確にしておくが、OpenAIの予測は、2030年末までに6730億ドルの収益を上げ、そのために2180億ドルを費やすというものである。これは極めて非収益性の高い事業であり、仮に黒字化したとしても、Oracleへの支払いを継続するには、現在よりもはるかに多くの収益を上げなければならない。

私は750億ドルという数字を、残りの4.64GWの主要IT容量に対して、Vera Rubin GPUが1MWあたり約1400万ドル(これはデータセンター業界に詳しい情報源と確認済み)の収益を得ると仮定して算出した。これは残りのStargateデータセンターの容量を構成すると予測されるものである。

OpenAIの数字は、The Information紙が報じたOpenAIの予測(燃費率および収益)の漏洩情報から直接引用したものであり、同社は2030年末までに6730億ドルの収益を上げ、そのために8520億ドルを費やすと予測している:

明確にしておくが、こうした数字を繰り返す記者で、それらがどれほど馬鹿げているかを指摘しない者は、少なからず羞恥心を抱くべきである。私の金曜日の有料コンテンツによれば:

言い換えれば、OpenAIは2年後にTSMCを上回る収益を上げ、3年後には年間収益がMetaに匹敵し、2030年末には年間収益がMicrosoft(過去12か月で約3000億ドル)に匹敵すると予測している。

もしOpenAIがこれらのコンピューティングリソースに支払えなければ、Oracleは倒産するだろう。なぜなら、OracleはStargateのデータセンター建設だけで約1150億ドルの債務を負っており、さらに1500億ドルを完成のために必要としているからだ:

Oracleは現在、年間収益約640億ドルの企業であり、直近四半期のフリー・キャッシュフローはマイナス247億ドルである。同社は2025年9月に180億ドルの債券を発行し、2026年2月には250億ドルの債券を発行し、3月のどこかで200億ドルの市場公募を実施した。いわゆる「完了」とされていたが、実際には最近になってウィスコンシン州およびシャッケルフォードのStargateプロジェクト融資として380億ドルが完了したように見える。また、Stargateミシガン州に関連する140億ドルのデータセンター債務も含めている。いずれにせよ、OracleはStargate Abileneを完成させるには資本が不足している。他社パートナーが約300億ドルのコストを負担するという前提でも、少なくとも1500億ドルをさらに必要とするだろう。正直に言って、それ以上が必要になる可能性すらある。

私は明確にしておくが、OracleはOpenAIなしではこの収益を得る他の手段を持っておらず、これらのプロジェクトはデータセンター自体の予想キャッシュフローで完全にファイナンスおよび支払いされるよう設計されている。

私だけがこの点を懸念しているわけではない。『ウォールストリート・ジャーナル』紙の報道によると、OpenAIのサラ・フライア氏は、新規ユーザーおよび収益目標を達成できなかったことから、同様の懸念を表明している:

OpenAIは最近、新規ユーザーおよび収益目標を達成できず、こうした挫折は一部の経営陣に、同社がデータセンターへの巨額支出を支えられるかどうかについて懸念を抱かせている。財務責任者(CFO)のサラ・フライア氏は、他の経営陣に対し、収益成長が十分に速くなければ、将来的なコンピューティング契約の支払いができなくなる可能性を懸念していると伝えたと、関係筋は語っている。また、取締役会メンバーは最近数か月、同社のデータセンター取引をより厳密に審査し、事業が減速しているにもかかわらず、さらに多くのコンピューティングリソースを獲得しようとするCEOサム・アルトマン氏の行動を疑問視していると、関係筋は語っている。

これがまだ心配でないなら、おそらくこれならそうなるだろう:

彼女は幹部および取締役会メンバーに対し、OpenAIが内部統制を改善する必要があると強調し、同社は上場企業が求められる厳格な報告基準を満たす準備がまだ整っていないと警告した。関係筋によると、アルトマン氏はより積極的なIPOスケジュールを好む傾向がある。

これは、2030年末までに8520億ドルを稼ぐことができる会社の姿か!

AnthropicもOpenAIと同様に深刻な状況——グーグルおよびアマゾンから最大10GW(年間収益1000億ドル超)のコンピューティングリソースを確保する約束

私はしばしばOpenAIの馬鹿げた約束を批判しているが、Anthropicも同様にひどく、グーグルおよびアマゾンからそれぞれ「最大」5GWの容量を確保するという約束をしている。この容量規模から、私は実際のコンピューティングリソース契約が約1000億ドルに上ると推定している。

ここで補足しておくが、グーグルとアマゾンはOracleよりも

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News