英偉達AIイベントGTCが開幕、最強AIチップBlackwell登場

TechFlow厳選深潮セレクト

英偉達AIイベントGTCが開幕、最強AIチップBlackwell登場

NVIDIAは、Blackwellのコストと消費電力の効率が前世代比で25倍改善され、世界最強のチップであると述べた。

執筆:李丹

出典:華爾街見聞

今年のグローバルトップクラスの人工知能(AI)分野の開発者会議と称されるNVIDIA 2024 GTC AIカンファレンスが、米東時間3月18日(月曜日)に開幕した。

今年は5年ぶりにNVIDIAが年次GTCを対面形式で再開するものであり、それまでの分析では「本物のものを披露する」と見られていたAIイベントでもあった。

現地時間の月曜午後、NVIDIA創業者兼CEOのジェンセン・フアン(黄仁勳)氏は、カリフォルニア州サンノゼのSAPセンターにて、「開発者のためのNo.1 AIサミット」(1# AI Conference for Developers)と題した基調講演を行った。

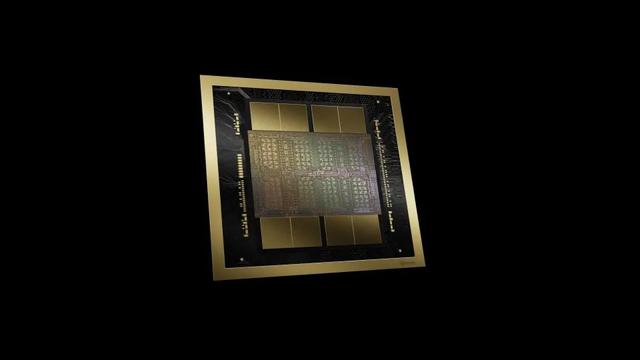

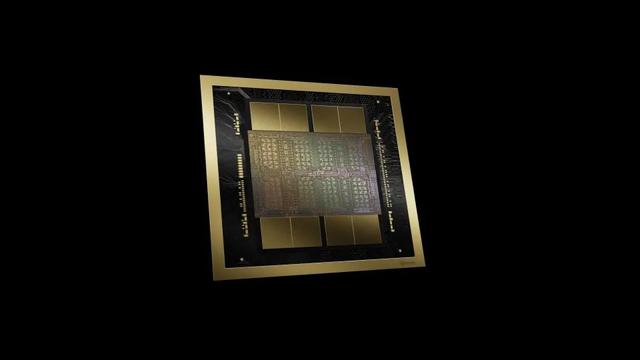

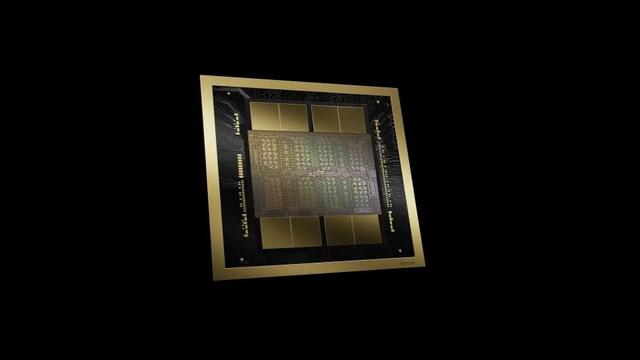

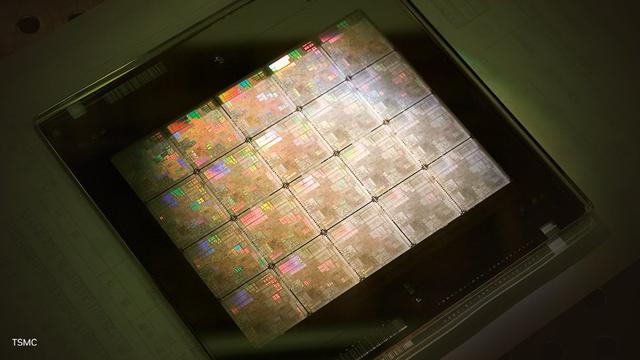

Blackwell、前世代比でコスト・消費電力25倍改善、世界最強チップ、TSMC 4nmプロセス

ジェンセン・フアン氏は、AIモデルを実行するための新世代チップおよびソフトウェアについて紹介した。NVIDIAは正式に、次世代AIグラフィックスプロセッサ(GPU)「Blackwell」を発表し、今年後半に出荷予定である。

Blackwellプラットフォームは、兆単位のパラメータを持つ大規模言語モデル(LLM)上でリアルタイム生成AIの構築と実行が可能となり、コストおよび消費電力を前世代比で最大25倍改善する。

NVIDIAによると、Blackwellは6つの画期的な技術を備えており、最大10兆パラメータのモデルにおけるAI学習およびリアルタイムLLM推論をサポートできる:

-

世界最強のチップ:BlackwellアーキテクチャGPUは2080億個のトランジスタからなり、カスタマイズされたTSMC 4ナノメートル(nm)プロセスで製造され、2つのreticle限界GPUダイを10TB/秒のチップ間リンクで接続し、単一の統合GPUとして動作する。

-

第2世代Transformerエンジン:Blackwell Tensor Core技術とTensorRT-LLM、NeMo Megatronフレームワークに搭載されたNVIDIAの高度な動的範囲管理アルゴリズムを組み合わせることで、新しい4ビット浮動小数点AIにより、計算能力とモデルサイズ推論能力を2倍に向上させる。

-

第5世代NVLink:数兆パラメータや混合エキスパートAIモデルの性能向上のため、最新のNVIDIA NVLinkは各GPUに対して画期的な1.8TB/sの双方向スループットを提供し、最大576台のGPU間での複雑なLLM間の高速シームレス通信を保証する。

-

RASエンジン:Blackwell搭載GPUには信頼性、可用性、保守性(RAS)を実現する専用エンジンが含まれる。さらに、BlackwellアーキテクチャはAIベースの予防保全機能を活用した診断および信頼性問題の予測といったチップレベル機能も追加しており、システム稼働時間を最大化し、大規模AI展開の弾力性を高め、数週間から数ヶ月にわたる連続運用を可能にするほか、運用コストの削減にも寄与する。

-

セキュアAI:高度な機密計算機能により、AIモデルおよび顧客データを性能低下なしに保護でき、医療や金融などプライバシーが極めて重要な業界にとって不可欠な新しいネイティブインターフェース暗号化プロトコルもサポートする。

-

デコンプレッションエンジン:専用の解凍エンジンが最新フォーマットに対応し、データベースクエリを高速化して、データ分析およびデータサイエンスにおいて最高のパフォーマンスを提供する。今後数年間で、企業が毎年数百億ドルを費やすデータ処理の領域において、GPUによるアクセラレーションがますます重要となる。

GB200 NVL72、H100比で推論性能最大30倍向上

NVIDIAは同時に、スーパーチップ「GB200 Grace Blackwell Superchip」を発表した。これは、900GB/sの超低消費電力NVLinkによって、2つのB200 Tensor Core GPUをNVIDIA Grace CPUに接続したものである。

最高のAIパフォーマンスを得るために、GB200搭載システムは同日に発表されたNVIDIA Quantum-X800 InfiniBandおよびSpectrum-X800イーサネットプラットフォームと接続でき、最大800Gb/sの高速ネットワークを提供する。

GB200は、NVIDIA GB200 NVL72の主要構成要素である。GB200 NVL72は、最も計算負荷の高いワークロード向けの多ノード、液体冷却、ラックスケールシステムであり、36個のGrace Blackwellスーパーチップ(72個のBlackwell GPUと36個のGrace CPU)を第5世代NVLinkで相互接続したものである。また、NVIDIA BlueField®-3 データプロセッシングユニット(DPU)も含み、クラウドネットワーキングのアクセラレーション、コンポーザブルストレージ、ゼロトラストセキュリティ、GPUコンピューティングの弾力性を実現する。

同数のH100 Tensor Core GPUと比較して、GB200 NVL72はLLM推論ワークロードにおいて最大30倍のパフォーマンス向上を達成し、コストおよび消費電力を最大25倍削減する。

GB200 NVL72プラットフォームは、1.4エクサFLOPSのAI性能と30TBの高速メモリを持つ単一GPUのように機能し、最新のDGX SuperPODの構築ブロックとなる。

NVIDIAはx86ベースの生成AIプラットフォームをサポートするために、NVLinkで8つのB200 GPUを接続するサーバーマザーボード「HGX B200」も発表した。HGX B200は、NVIDIA Quantum-2 InfiniBandおよびSpectrum-Xイーサネットネットワークプラットフォームを通じて最大400Gb/sのネットワーク速度をサポートする。

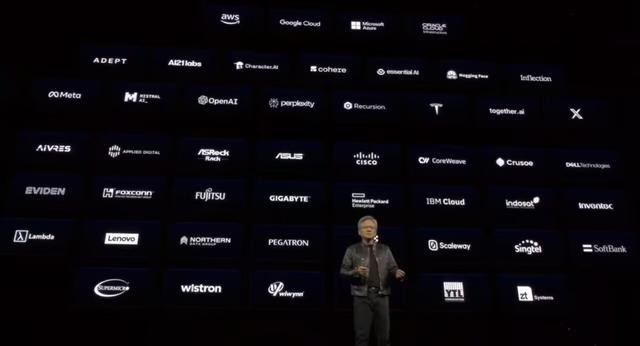

Amazon、Microsoft、Google、Oracleが初のBlackwell対応クラウドプロバイダーに

Blackwellチップは、Amazon、Microsoft、Googleといった世界最大のデータセンター事業者が新たなコンピュータやその他の製品を展開する基盤となる。Blackwellベースの製品は今年後半に登場する予定だ。

NVIDIAによれば、AWS、Google Cloud、Microsoft Azure、Oracle Cloud Infrastructure(OCI)が最初にBlackwell対応インスタンスを提供するクラウドサービスプロバイダーとなる。また、NVIDIAクラウドパートナープログラムに参加するApplied Digital、CoreWeave、Crusoe、IBM Cloud、Lambdaも初期のBlackwellインスタンス提供者となる。

主権AI(Sovereign AI)向けクラウドもBlackwellベースのクラウドサービスおよびインフラを提供する。これにはIndosat Ooredoo Hutchinson、Nebius、Nexgen Cloud、Oracle EUソブリンクラウド、Oracle米国・英国・オーストラリア政府クラウド、Scaleway、Singtel、Northern Data GroupのTaiga Cloud、Yotta Data ServicesのShakti Cloud、YTL Power Internationalなどが含まれる。

ジェンセン・フアン氏はこう述べた。「30年間、我々は加速コンピューティングを追求してきた。その目的はディープラーニングやAIにおける変革的な進歩を実現することだった。生成AIは、まさに我々の時代を定義する技術である。Blackwellは、この新たな産業革命を推進するエンジンだ。世界で最も活力ある企業と協力することで、あらゆる産業におけるAIの約束を実現していく。」

NVIDIAのプレスリリースでは、Blackwellを採用予定の組織としてMicrosoft、Amazon、Google、Meta、Dell、OpenAI、Oracle、マスク氏率いるTeslaおよびxAIなどが挙げられている。ジェンセン・フアン氏はこれらを含むさらなるパートナーについても紹介した。

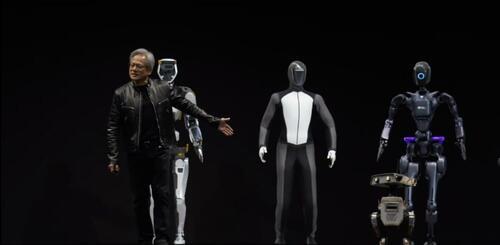

AIプロジェクト「Project GR00T」がヒューマノイドロボットを支援

ジェンセン・フアン氏は講演の中で、将来のヒューマノイドロボットを支援するマルチモーダルAIプロジェクト「Project GR00T」を発表した。このプロジェクトは汎用基礎モデルを採用し、ヒューマノイドロボットがテキスト、音声、動画、さらには現場でのデモンストレーションを入力として受け取り、処理し、特定の汎用操作を実行できるようにする。

Project GR00Tは、NVIDIA Isaacロボティクスプラットフォームのツール、特に強化学習用の新機能「Isaac Lab」を活用して開発された。

ジェンセン・フアン氏によれば、Project GR00Tプラットフォームによって支援されるロボットは、人間の行動を観察することで自然言語を理解し、動作を模倣できるように設計されており、これにより迅速に連携性、柔軟性、その他のスキルを学び、現実世界に適応し、相互作用することが可能になるという。そして、決してロボット反乱は起きない。

ジェンセン・フアン氏はこう語った。

「汎用ヒューマノイドロボットのための基礎モデルを構築することは、現在のAI分野で解決可能な最も刺激的な課題の一つです。この技術を融合させることで、世界中の最先端ロボット専門家が汎用ロボットの分野で大きな飛躍を遂げることができるのです。」

TSMCおよびSynopsysがNVIDIAの露光技術を採用

ジェンセン・フアン氏は、TSMCおよびSynopsysがNVIDIAの計算露光技術を採用すると発表した。両社はNVIDIAの計算露光プラットフォーム「CuLitho」を使用する。

TSMCおよびSynopsysはすでにNVIDIAのCulitho Wソフトウェアを統合済みであり、次世代Blackwell GPUを活用してAIおよびHPCアプリケーションを実現していく。

新ソフトウェアNIMにより、既存NVIDIA GPUでのAI推論が容易に

NVIDIAは同時に、「NVIDIA NIM」と呼ばれる推論用マイクロサービスを発表した。これは最適化されたクラウドネイティブマイクロサービスであり、生成AIモデルの市場投入までの時間を短縮し、クラウド、データセンター、GPUアクセラレーションワークステーション上での展開を簡素化することを目的としている。

NVIDIA NIMは、業界標準APIを用いてAIモデル開発およびプロダクションパッケージングの複雑さを抽象化することで、開発者層の拡大を図る。これはNVIDIA AI Enterpriseの一部であり、AI駆動型エンタープライズアプリケーションの開発およびAIモデルの本番環境への導入を簡素化する。

NIMにより、ユーザーは旧式のNVIDIA GPUを使って推論を行うことやAIソフトウェアを実行することが容易になり、企業顧客は既存のNVIDIA GPUを使い続けることが可能になる。推論に必要な計算リソースは、新しいAIモデルを最初に学習させる場合よりも少ない。NIMにより、企業はOpenAIなどの外部企業からAI成果を購入するのではなく、自社でAIモデルを実行できるようになる。

NVIDIAサーバーを導入している顧客は、NVIDIA AI Enterpriseに加入することでNIMを利用できる。ライセンス料は1GPUあたり年間4500米ドル。

NVIDIAはMicrosoft、Hugging FaceなどのAI企業と協力し、彼らのAIモデルがすべての互換性のあるNVIDIAチップ上で動作することを保証する。NIMを利用する開発者は、煩雑な設定手順を必要とせず、自社のサーバーまたはクラウド上のNVIDIAサーバーで効率的にモデルを実行できる。

評価によれば、NIMのようなソフトウェアはAIの展開をより容易にし、NVIDIAにとって収益源となるだけでなく、顧客が引き続きNVIDIAチップを使い続ける理由をさらに提供するものである。

TechFlow公式コミュニティへようこそ

Telegram購読グループ:https://t.me/TechFlowDaily

Twitter公式アカウント:https://x.com/TechFlowPost

Twitter英語アカウント:https://x.com/BlockFlow_News