Les personnes qui conçoivent des robots pour OpenAI voient un avenir effrayant

TechFlow SélectionTechFlow Sélection

Les personnes qui conçoivent des robots pour OpenAI voient un avenir effrayant

Lorsqu’une personne chargée de concevoir des robots démissionne par crainte que ces derniers ne tuent des êtres humains, ce fait en soi révèle déjà beaucoup de choses.

Auteur : Geek Friend

Le 7 mars 2026, en apprenant la démission de Caitlin Kalinowski, ma première réaction n’a pas été la stupéfaction, mais plutôt : « Enfin, quelqu’un agit concrètement. »

Kalinowski était responsable du matériel et de l’ingénierie robotique chez OpenAI. Elle avait rejoint l’entreprise en novembre 2024, soit moins d’un an et demi avant de quitter ses fonctions.

Son motif est direct et lourd : elle ne pouvait accepter les conséquences potentielles du contrat conclu par OpenAI avec le Département de la Défense américain, notamment en matière de surveillance intérieure et d’armes autonomes.

Il ne s’agit pas d’un simple départ de talent. C’est une personne ayant participé concrètement à la construction du « corps » de l’intelligence artificielle qui, par sa démission, dit au monde : « Je refuse d’assumer la responsabilité des actes que ce que j’ai moi-même créé pourrait commettre. »

Pour comprendre le départ de Kalinowski, il faut remonter à ce qui s’était produit environ une semaine plus tôt.

Le 28 février, Sam Altman a annoncé qu’OpenAI avait conclu un accord avec le Département de la Défense américain, autorisant le Pentagone à utiliser les modèles d’IA d’OpenAI sur ses réseaux classifiés. L’annonce a immédiatement provoqué une tempête médiatique.

Ce qui est intéressant, c’est que ce contrat a été explicitement calqué sur celui refusé peu auparavant par Anthropic, un concurrent direct.

En effet, Anthropic avait rejeté une proposition similaire du Pentagone, exigeant l’insertion de garde-fous éthiques nettement plus stricts dans le contrat. En réponse, le secrétaire à la Défense Pete Hegseth a publiquement critiqué Anthropic sur X (ex-Twitter), qualifiant son refus d’« exercice magistral d’arrogance et de trahison », et soutenant la décision de l’administration Trump de suspendre toute collaboration avec Anthropic.

OpenAI a ensuite repris ce contrat.

La réaction des utilisateurs a été extrêmement vive. Le 28 février, les désinstallations de ChatGPT ont bondi de 295 % par rapport à la veille ; le mouvement #QuitGPT s’est rapidement propagé sur les réseaux sociaux, rassemblant plus de 2,5 millions de partisans d’un boycott numérique en trois jours. Claude en a profité pour dépasser ChatGPT et devenir l’application gratuite la plus téléchargée aux États-Unis, occupant la première place sur l’App Store d’Apple.

Sous la pression, Altman a reconnu publiquement, le 3 mars, qu’il « n’aurait pas dû lancer ce contrat précipitamment », estimant qu’il « semblait opportuniste et mal réfléchi », et a annoncé une révision des termes du contrat afin de préciser explicitement que « les systèmes d’IA ne doivent pas être intentionnellement utilisés pour surveiller les citoyens et les personnels américains sur le territoire national ».

Or, ce mot-clé « intentionnellement » constitue en soi une faille. Un avocat de l’Electronic Frontier Foundation (EFF) l’a souligné sans ambages : les services de renseignement et les forces de l’ordre s’appuient fréquemment sur des données obtenues « fortuitement » ou via des achats commerciaux afin d’échapper à des protections renforcées de la vie privée — ajouter le terme « intentionnellement » ne signifie pas nécessairement une véritable restriction.

C’est précisément dans ce contexte que Kalinowski a présenté sa démission.

01 Ce qu’elle voit est bien plus concret que ce que nous imaginons

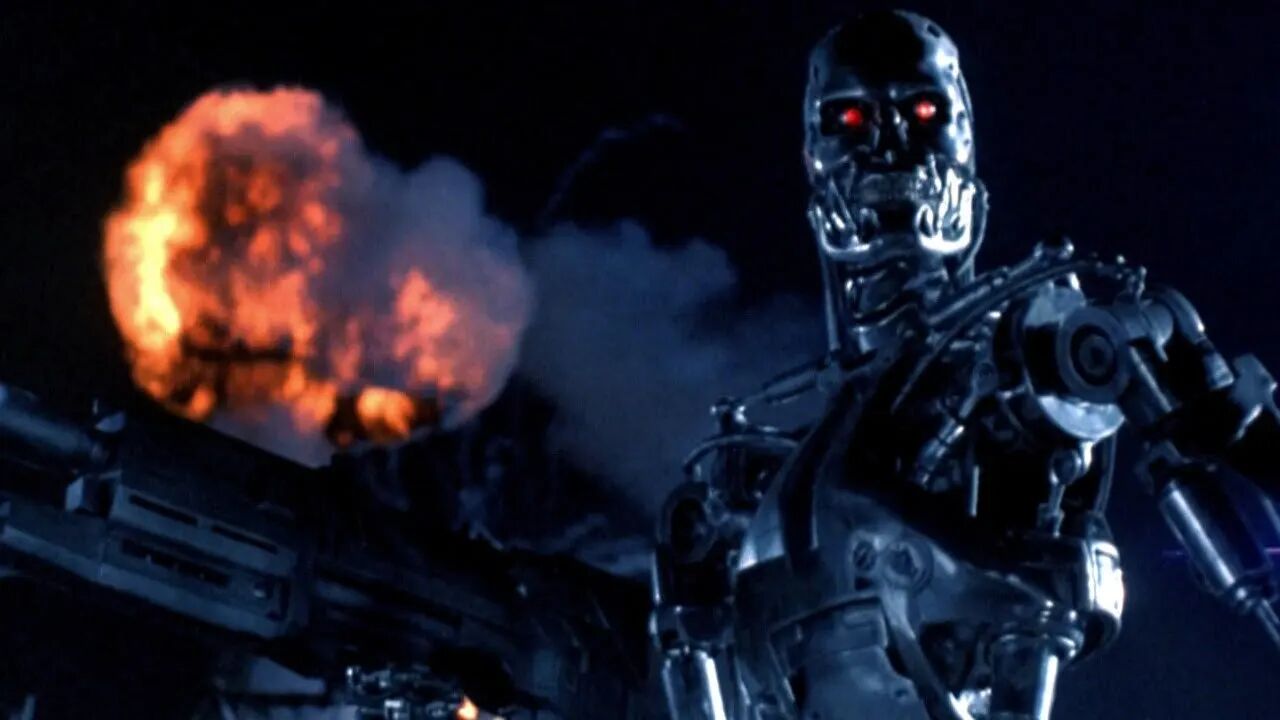

Alors que la plupart des gens discutent encore de savoir si OpenAI « fait des concessions au gouvernement », Kalinowski, elle, fait face à une question bien plus concrète et plus brutale : son équipe construit des robots.

L’ingénierie du matériel et des robots n’est pas un travail abstrait consistant à écrire du code ou à ajuster des paramètres. Il s’agit de doter l’IA de mains, de pieds et d’yeux. Lorsque la collaboration entre OpenAI et le Département de la Défense passe d’une simple « utilisation de modèles » à des applications militaires futures possibles d’IA incarnée (« embodied AI »), la nature même du travail de Kalinowski change radicalement.

Depuis longtemps, les chercheurs spécialisés dans les armes autonomes alertent sur cette éventualité.

Les politiques actuelles du Département de la Défense américain ne requièrent pas qu’une intervention humaine préalable soit obligatoire avant l’usage de la force par des armes autonomes. Autrement dit, le contrat signé par OpenAI ne bloque techniquement pas la possibilité que ses modèles fassent partie intégrante d’un système où « GPT décide de tuer quelqu’un ».

Cela n’est pas un simple discours alarmiste. Jessica Tillipman, enseignante en droit des marchés publics à l’université de Georgetown, a analysé le contrat révisé d’OpenAI et a clairement indiqué que ses termes « ne confèrent pas à OpenAI une marge de manœuvre similaire à celle d’Anthropic pour interdire des usages gouvernementaux légaux » : ils stipulent simplement que le Pentagone ne peut pas utiliser les technologies d’OpenAI en violation des « lois et politiques existantes » — or celles-ci présentent déjà un vide juridique considérable en matière de régulation des armes autonomes.

Des experts en gouvernance issus de l’université d’Oxford partagent ce jugement, estimant que l’accord d’OpenAI « est peu susceptible de combler » les lacunes structurelles de gouvernance laissées par les systèmes de surveillance intérieure pilotés par l’IA et les armes autonomes.

Le départ de Kalinowski est sa réponse personnelle à ce constat.

02 Ce qui se passe réellement au sein d’OpenAI

Kalinowski n’est ni la première, ni très probablement la dernière à quitter l’entreprise.

Des données disponibles montrent que le taux de départ au sein des équipes d’éthique et de sécurité IA d’OpenAI atteint déjà 37 %, et la raison invoquée par la majorité des démissionnaires est soit « un désaccord avec les valeurs de l’entreprise », soit « l’impossibilité d’accepter l’utilisation de l’IA à des fins militaires ». Le chercheur scientifique Aidan McLaughlin a ainsi écrit en interne : « Personnellement, je ne pense pas que cette transaction soit justifiée. »

Il est notable que cette vague de départs coïncide exactement avec une phase d’expansion accélérée du portefeuille commercial d’OpenAI. Juste avant et après le scandale du contrat avec le Département de la Défense, l’entreprise a annoncé l’extension de son accord existant avec AWS, passant de 38 milliards à 100 milliards de dollars supplémentaires sur huit ans ; elle a également revu ses objectifs de dépenses publiques, prévoyant désormais des revenus totaux supérieurs à 280 milliards de dollars d’ici 2030.

Accélération commerciale d’un côté, départs massifs au sein des équipes de sécurité de l’autre : cet écart croissant constitue l’axe le plus important pour comprendre la situation actuelle d’OpenAI.

Les valeurs d’une entreprise se mesurent finalement à ceux qu’elle réussit à retenir — et à ceux qu’elle ne parvient pas à garder. Lorsque les personnes les plus attentives à la question « À quoi servira réellement cette technologie ? » commencent à partir les unes après les autres, la direction vers laquelle glissera la structure organisationnelle restante ne laisse guère de place au doute.

Anthropic a choisi une autre voie dans cette confrontation : refuser le contrat, subir la colère du Département de la Défense, mais gagner la confiance d’un grand nombre d’utilisateurs. Durant cette période, les téléchargements de Claude ont augmenté contre toute attente, prouvant, dans une certaine mesure, qu’un « refus fondé sur des principes » n’est pas nécessairement une stratégie perdante sur le plan commercial.

Mais Anthropic a aussi payé un prix : exclue, du moins pour le moment, des cercles gouvernementaux.

Voilà précisément le dilemme fondamental : aucune option n’est parfaite.

Refuser, c’est risquer de perdre toute influence, voire d’être totalement exclu des instances de régulation. Accepter, c’est cautionner, par sa propre technologie, des actions dont on ne peut pas contrôler entièrement les conséquences.

Kalinowski a choisi une troisième voie : partir.

C’est l’acte le plus honnête qu’elle puisse accomplir.

03 La bataille pour l’âme de la Silicon Valley vient juste de commencer

Si l’on élargit le champ de vision, la portée de cet événement dépasse largement la simple démission d’une personne.

L’association entre l’IA et le secteur militaire est une question à laquelle toute l’industrie devra inévitablement répondre. Le Pentagone dispose d’un budget, d’un besoin impérieux et d’une capacité d’intégration technologique : il ne cessera pas de tendre la main aux entreprises d’IA. Et celles-ci — qu’il s’agisse d’OpenAI, poursuivant l’objectif de l’AGI (intelligence générale artificielle), d’Anthropic, qui met l’accent sur la sécurité, ou d’autres acteurs — devront toutes, tôt ou tard, répondre à cette question cruciale.

La stratégie d’Altman consiste à accepter la réalité commerciale tout en tentant de tracer une ligne rouge via les formulations contractuelles. Or, comme l’ont souligné plusieurs experts juridiques et en gouvernance, ces formulations ressemblent davantage à des protections de communication qu’à des contraintes techniques réelles.

Le problème plus fondamental réside dans le fait que, dès lors que les modèles d’IA sont déployés sur des réseaux classifiés et commencent à participer à des processus décisionnels militaires, le monde extérieur est incapable de vérifier si ces « garanties » sont effectivement appliquées.

L’absence de transparence constitue en soi le plus grand risque.

Kalinowski n’a passé chez OpenAI que moins d’un an et demi, mais elle a choisi de partir précisément à ce moment critique. Elle n’a publié aucun long communiqué, n’a nommé ni critiqué personne publiquement : elle s’est contentée d’agir, traçant ainsi sa propre ligne de démarcation.

Dans un certain sens, cet acte est plus puissant que n’importe quel article de politique publique.

L’ingénierie du matériel et des robots alimentés par l’IA était l’un des domaines les plus prometteurs et les plus passionnants de la Silicon Valley. En partant, Kalinowski n’emporte pas seulement un CV : elle laisse derrière elle une question essentielle à tous ceux qui continuent de travailler dans ce secteur —

Jusqu’où êtes-vous prêt à assumer la responsabilité de ce que vous créez ?

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News