Ce qui pourrait rapprocher GPT et Claude, ce serait-ils une opposition commune au Pentagone ?

TechFlow SélectionTechFlow Sélection

Ce qui pourrait rapprocher GPT et Claude, ce serait-ils une opposition commune au Pentagone ?

Cette fois, ils se sont tenus la main, mais cela n’a probablement duré que quelques heures.

Auteur : Kuli, TechFlow

Il y a quelques jours, une photo est devenue virale sur Internet.

L’Inde a organisé un sommet consacré à l’intelligence artificielle (IA), au cours duquel le Premier ministre Narendra Modi se tenait sur scène, flanqué d’une rangée de dirigeants californiens issus de la Silicon Valley. Lors de la prise de vue collective, Modi a saisi la main de la personne à ses côtés et l’a levée au-dessus de leur tête ; les autres ont suivi en se tenant également par la main, créant une image forte d’unité.

Mais deux personnes n’ont pas participé à ce geste.

Le PDG d’OpenAI et celui d’Anthropic — les dirigeants respectifs des sociétés derrière ChatGPT et Claude — se tenaient côte à côte, chacun brandissant un poing fermé.

Pas de contact main dans la main, pas de regard échangé : on aurait dit deux élèves forcés de s’asseoir côte à côte par leur professeur.

Ces deux entreprises se livrent depuis plusieurs années une concurrence féroce. Claude a été développé par une équipe ayant quitté OpenAI ; les deux sociétés se font une guerre sans merci pour conquérir les utilisateurs, les clients professionnels et les fonds d’investissement. Pendant le Super Bowl cette année, Anthropic a même acheté une publicité afin de railler ouvertement ChatGPT et son futur recours à la publicité.

Ainsi, refuser de se donner la main était tout à fait normal.

Toutefois, aujourd’hui, ils se sont donnés la main. À cause du Pentagone.

Voici comment les choses se sont déroulées.

Anthropic — la société derrière Claude — a signé l’année dernière un contrat avec le Département américain de la Défense pouvant atteindre 200 millions de dollars. Claude est ainsi devenu le premier modèle d’IA déployé sur les réseaux confidentiels de l’armée américaine, où il contribue notamment à l’analyse du renseignement et à la planification des opérations.

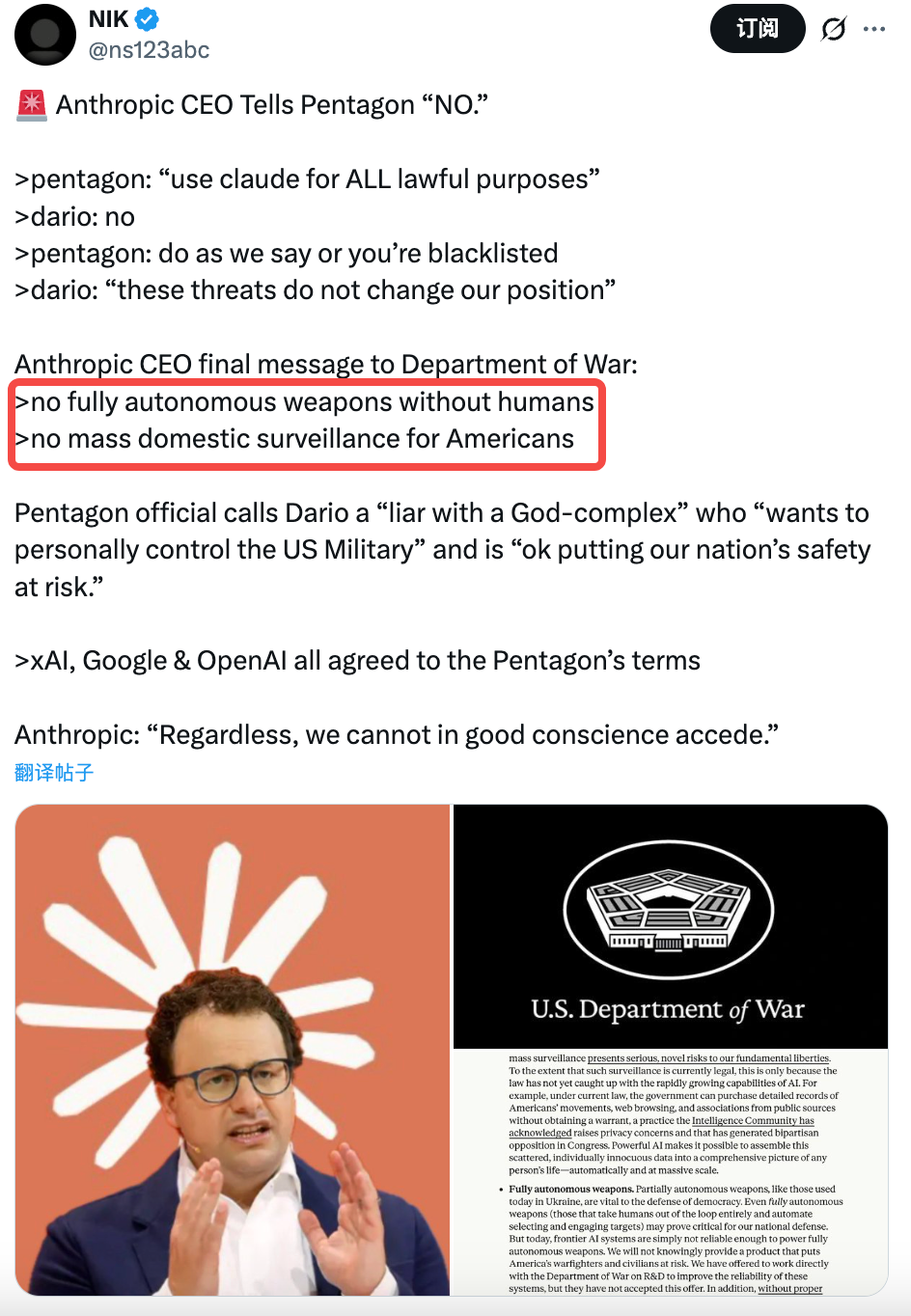

Cependant, Anthropic avait fixé deux lignes rouges contractuelles :

Claude ne sera pas utilisé pour la surveillance massive des citoyens américains, ni pour des armes autonomes dépourvues d’implication humaine. (Lire aussi : Les soixante-douze heures de crise identitaire d’Anthropic)

Le Pentagone, lui, n’a pas accepté ces conditions.

Son exigence se résume en quatre mots : « sans restriction ». Une fois qu’un outil est acquis, on doit pouvoir l’utiliser librement ; une entreprise technologique n’a pas à dicter au département militaire américain ce qu’il peut ou ne peut pas faire.

Mardi dernier, le secrétaire à la Défense, Pete Hegseth, a lancé un ultimatum personnel au PDG d’Anthropic : « Acceptez avant vendredi 17 heures 01, sinon vous en assumerez les conséquences. »

Anthropic n’a pas accepté.

Le PDG de la société a publié une déclaration publique expliquant que, bien qu’il reconnaisse pleinement l’importance stratégique de l’IA pour la défense américaine, celle-ci pourrait, dans certains cas, nuire plutôt que défendre les valeurs démocratiques. « Nous ne pouvons, en toute conscience, accepter cette exigence. »

Emil Michael, représentant du Pentagone chargé des négociations et sous-secrétaire à la Défense, a ensuite qualifié le PDG d’Anthropic de « menteur » sur les réseaux sociaux, l’accusant d’un « complexe divin » et de jouer avec la sécurité nationale.

Une poignée de main éphémère

Ensuite, un événement inattendu s’est produit.

Plus de 400 employés d’OpenAI et de Google ont signé une lettre ouverte commune intitulée « Nous ne nous laisserons pas diviser ».

Dans ce texte, ils affirment que le Pentagone mène actuellement des négociations individuelles avec différentes entreprises spécialisées en IA, cherchant à obtenir d’elles l’acceptation des conditions que refusait Anthropic, et tentant ainsi de les diviser par la peur.

Le PDG d’OpenAI a également envoyé un courrier interne à tous ses employés, confirmant que sa société partage les mêmes lignes rouges qu’Anthropic :

Pas de surveillance massive, pas d’armes létales autonomes.

Deux entreprises qui, quelques jours plus tôt, refusaient encore de se donner la main, se sont soudain retrouvées côte à côte face au Pentagone.

Cette solidarité, toutefois, n’a probablement duré que quelques heures.

Vendredi à 17 h 01, l’ultimatum du Pentagone a expiré. Anthropic n’a pas signé.

Une entreprise technologique américaine valorisée à 380 milliards de dollars a ainsi rejeté, au risque de voir annulé un contrat de 200 millions de dollars, une demande du Département américain de la Défense. Par le passé, un tel désaccord aurait simplement conduit à résilier le contrat et à changer de fournisseur. Cette fois, la réaction de Washington dépasse largement le cadre strictement commercial.

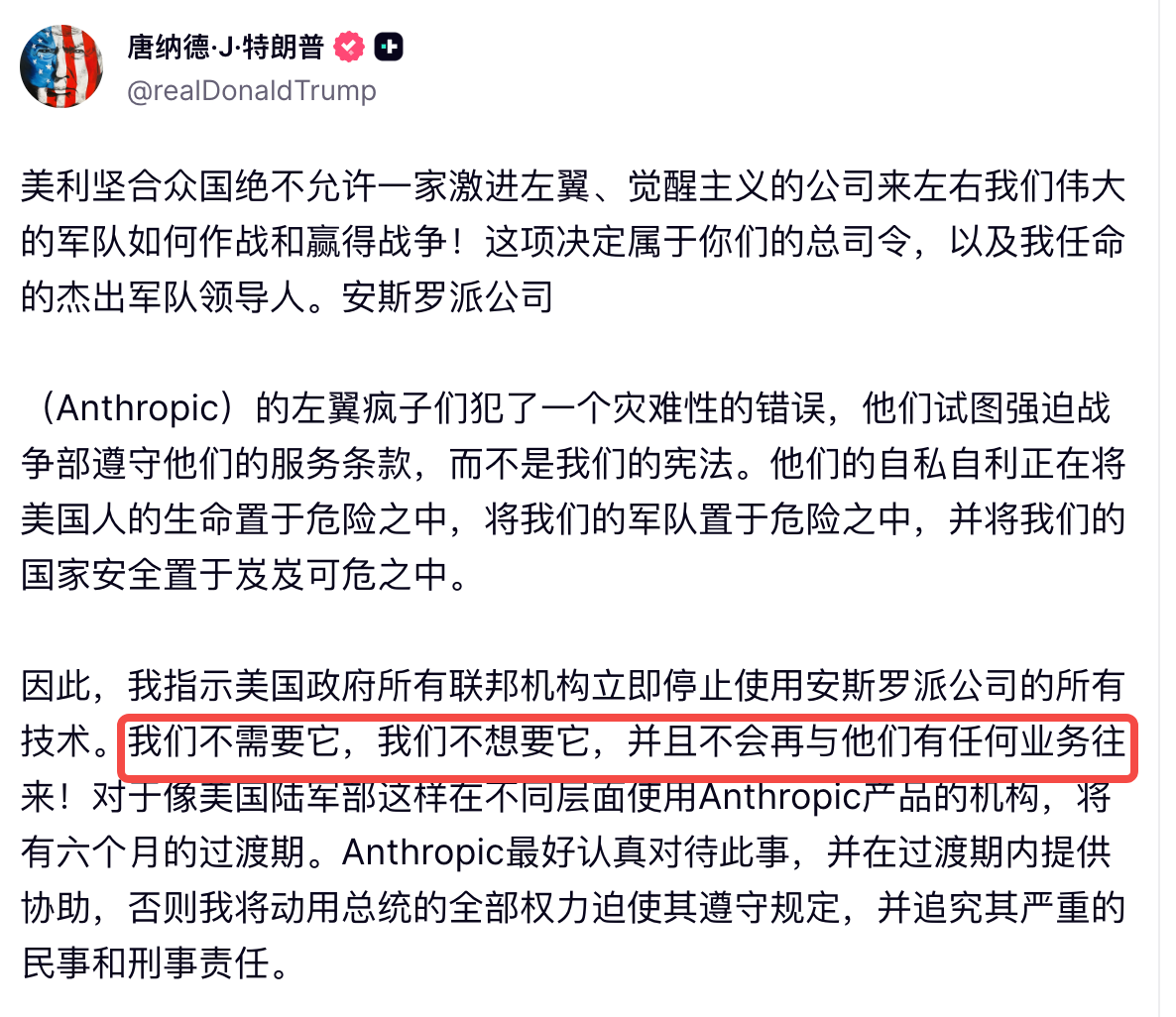

Donald Trump a publié environ une heure plus tard un message sur Truth Social qualifiant Anthropic de « fanatique gauchiste », l’accusant de vouloir se placer au-dessus de la Constitution et de jouer avec la vie des soldats américains.

Il a ordonné à toutes les agences fédérales de cesser immédiatement d’utiliser les technologies d’Anthropic.

Peu après, le secrétaire à la Défense Pete Hegseth a classé Anthropic comme « risque pour la sécurité de la chaîne d’approvisionnement ». Ce label est normalement réservé à des entreprises telles qu’Huawei. Son sens est clair : aucun entrepreneur travaillant pour l’armée américaine ne peut désormais utiliser les produits d’Anthropic.

Anthropic a annoncé qu’elle allait engager des procédures judiciaires.

Mais, ce même soir, OpenAI — qui, jusque-là, avait adopté une position identique — a conclu un accord avec le Pentagone.

Un enjeu idéologique

Que s’est-il donc passé ?

OpenAI a obtenu la place laissée vacante par Claude : devenir le fournisseur d’IA des réseaux confidentiels de l’armée américaine. Toutefois, OpenAI a imposé trois conditions au Pentagone : pas de surveillance massive, pas d’armes autonomes, et une intervention humaine obligatoire pour toute décision à haut risque.

Le Pentagone a répondu : « D’accord. »

Vous n’avez pas rêvé. Des conditions que le Pentagone avait refusé d’accepter pendant plusieurs semaines lorsqu’elles étaient formulées par Anthropic ont été approuvées en quelques jours dès lors qu’elles provenaient d’une autre entreprise ?

Bien entendu, les propositions ne sont pas strictement identiques.

Anthropic exigeait une garantie supplémentaire : elle considère que le droit actuel ne suit pas le rythme des capacités de l’IA. Par exemple, il est parfaitement licite d’acheter légalement vos données de géolocalisation, vos historiques de navigation et vos publications sur les réseaux sociaux, puis de les agréger légalement — ce qui revient pratiquement à une surveillance généralisée, bien que chaque étape soit légale.

Anthropic soutient que la simple mention « pas de surveillance » est inefficace tant que ce vide juridique n’est pas comblé. OpenAI, quant à elle, n’a pas insisté sur ce point et a accepté la position du Pentagone selon laquelle le cadre juridique actuel suffit.

Mais si vous pensez qu’il ne s’agit là que d’un désaccord mineur sur une clause, vous êtes bien naïf. Dès le départ, ces négociations n’ont jamais porté uniquement sur des clauses contractuelles.

David Sacks, « tsar » de l’IA à la Maison Blanche, a déjà critiqué publiquement Anthropic pour promouvoir une « IA woke » (une IA guidée par des impératifs idéologiques et politiquement corrects) ; un haut responsable du Pentagone a déclaré aux médias que le problème de Dario Amodei, PDG d’Anthropic, était d’ordre idéologique : « Nous savons très bien avec qui nous traitons. »

xAI, la société fondée par Elon Musk — concurrent direct d’Anthropic — a, cette semaine, multiplié les attaques contre Anthropic sur X, l’accusant de « haïr la civilisation occidentale ».

Par ailleurs, le PDG d’Anthropic n’a pas assisté à la cérémonie d’investiture de Donald Trump l’année dernière, tandis que le PDG d’OpenAI y était présent.

Faire un exemple

Passons donc en revue les faits.

Des principes identiques, des lignes rouges similaires : pourtant, Anthropic — parce qu’elle a exigé une garantie supplémentaire, choisi le mauvais camp et adopté la mauvaise posture — s’est vu attribuer la même étiquette de « menace pour la sécurité nationale américaine » que Huawei.

OpenAI, elle, a accepté une condition de moins et entretient de bonnes relations avec les autorités ; elle a décroché le contrat. Faut-il y voir une victoire des principes… ou leur prix marchand ?

Le rejet d’un contrat du Pentagone n’est pas non plus une première.

En 2018, plus de 4 000 employés de Google avaient signé une pétition, et plusieurs dizaines d’entre eux avaient démissionné, pour protester contre la participation de leur entreprise à un projet du Pentagone baptisé « Project Maven », visant à utiliser l’IA pour analyser les vidéos capturées par des drones afin d’identifier plus rapidement les cibles.

Google s’est finalement retirée du projet. Elle n’a pas renoué le contrat. Les employés avaient remporté la victoire.

Huit ans plus tard, le même débat resurgit — mais les règles ont totalement changé. Une entreprise américaine déclare qu’elle est prête à collaborer avec les forces armées, à condition de ne pas participer à deux activités précises. En réponse, le gouvernement américain la bannit purement et simplement de l’ensemble de son système fédéral.

Et l’étiquette de « risque pour la sécurité de la chaîne d’approvisionnement » a un impact bien plus grave que la simple perte d’un contrat de 200 millions de dollars.

Le chiffre d’affaires d’Anthropic devrait atteindre environ 14 milliards de dollars cette année : le contrat de 200 millions représente donc à peine une fraction négligeable. Or, cette étiquette signifie que toute entreprise travaillant avec l’armée américaine est interdite d’utiliser Claude.

Ces entreprises n’ont pas besoin d’adhérer à la position du Pentagone ; elles doivent simplement effectuer une analyse des risques : continuer à utiliser Claude pourrait leur coûter leurs contrats gouvernementaux, tandis que le passage à un autre modèle ne présenterait aucun inconvénient.

Le choix est évident. Voilà précisément le véritable message envoyé.

Peu importe si Anthropic tiendra le coup ou non. L’essentiel est de savoir si la prochaine entreprise osera encore résister. Elle examinera ce résultat, évaluera le coût de la défense de ses principes, puis prendra une décision parfaitement rationnelle.

Revenons sur cette photo indienne : tous les participants se tiennent par la main, bras levés vers le ciel — sauf deux d’entre eux, qui restent chacun avec un poing fermé.

Peut-être est-ce là la norme.

Les entreprises d’IA peuvent partager les mêmes principes, mais cela ne signifie pas nécessairement qu’elles se donneront la main.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News