DeepSeek bloque la capacité de calcul, les recherches universitaires en IA font face à un obstacle ?

TechFlow SélectionTechFlow Sélection

DeepSeek bloque la capacité de calcul, les recherches universitaires en IA font face à un obstacle ?

Huawei propose la meilleure solution en collaboration avec 15 universités.

Source de l'article :Xinzhiyuan

Crédit image : générée par Wujie AI

Un doctorant en apprentissage automatique dans un laboratoire d'une des 5 meilleures universités des États-Unis n'aurait même pas accès à un GPU capable de fournir une puissance de calcul importante ?

Ce post publié sur Reddit à la mi-2024 a immédiatement déclenché un vaste débat au sein de la communauté ——

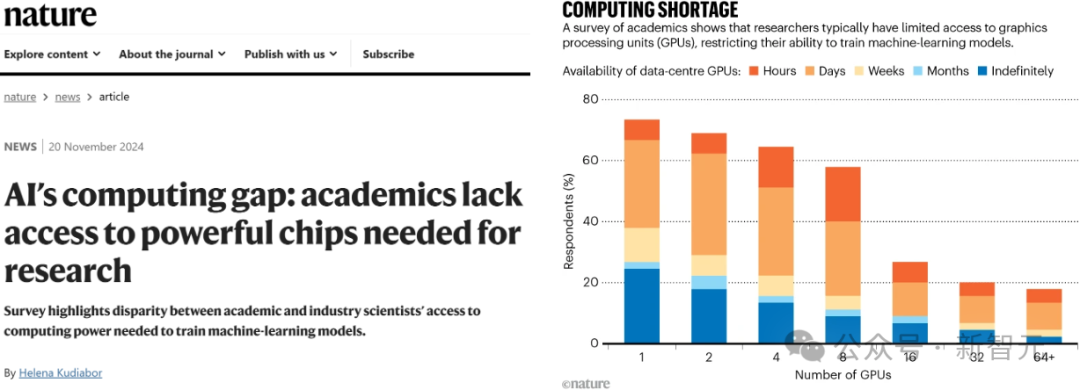

D’ailleurs, un article de Nature publié fin 2024 a révélé les graves difficultés rencontrées par le monde académique dans l'accès aux GPU —— les chercheurs doivent faire la queue pour obtenir du temps d'utilisation sur les clusters GPU universitaires.

De même, dans les laboratoires universitaires chinois, la pénurie sévère de GPU est également très répandue. Des cas absurdes ont même été rapportés, comme des universités exigeant que les étudiants apportent eux-mêmes leur propre puissance de calcul pour assister aux cours.

Il devient évident que la « puissance de calcul », ce goulot d'étranglement, transforme même l'IA elle-même en un cours extrêmement difficile d'accès.

Pénurie de talents IA et manque de puissance de calcul

Parallèlement, le développement rapide des technologies de pointe telles que les grands modèles et l'intelligence incarnée provoque actuellement une pénurie mondiale de talents qualifiés.

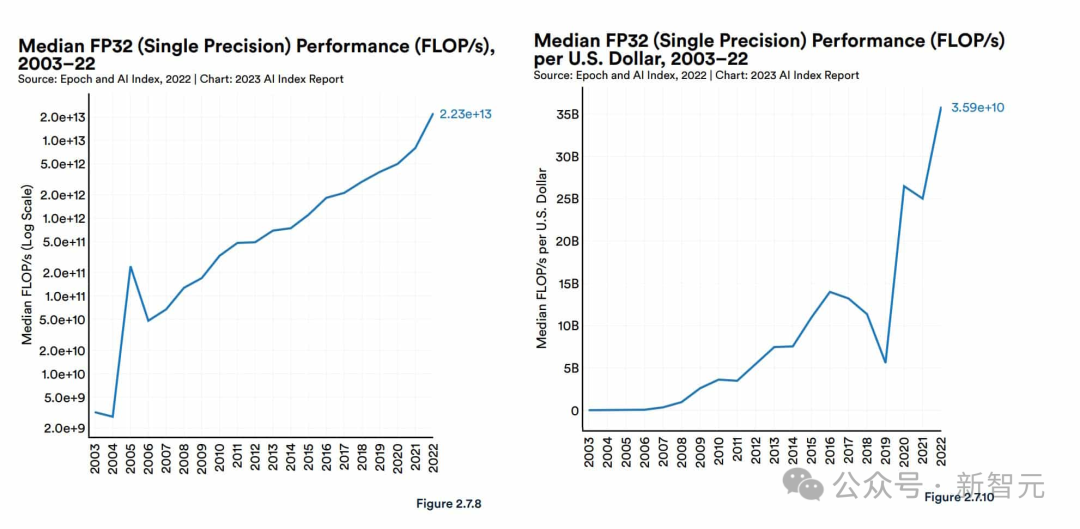

Selon les calculs d'un professeur de l'Université d'Oxford, aux États-Unis, la proportion d'emplois exigeant des compétences en IA a augmenté de 500 %.

À l’échelle mondiale, les postes liés à l’intelligence artificielle technologique (Tech-AI) ont crû de 900 %, tandis que ceux liés à l’IA au sens large (Broad-AI) ont bondi de 1 130 %.

Au cours de cette période, la croissance en Asie a été particulièrement marquée.

Bien que les universités du monde entier s'efforcent d'aider leurs étudiants à acquérir des compétences clés en IA, comme mentionné précédemment, la puissance de calcul est désormais devenue un véritable « luxe ».

Pour combler cet écart, la collaboration entre entreprises et universités est devenue un moyen crucial.

Les centres d'innovation scientifique et éducative Kunpeng Ascend lancent le déploiement universitaire

Heureusement, Huawei a déjà commencé à poser les bases afin de développer un système similaire d'innovation dans les universités chinoises !

Actuellement, Huawei a signé conjointement avec cinq universités d'excellence — Peking University, Tsinghua University, Shanghai Jiao Tong University, Zhejiang University et University of Science and Technology of China — un partenariat pour créer des « Centres d'excellence en innovation scientifique et éducative Kunpeng Ascend ».

En outre, Huawei collabore également simultanément avec dix autres universités — Fudan University, Harbin Institute of Technology, Huazhong University of Science and Technology, Xi’an Jiaotong University, Nanjing University, Beihang University, Beijing Institute of Technology, University of Electronic Science and Technology of China, Southeast University et Beijing University of Posts and Telecommunications — pour mettre en œuvre des « Centres d'incubation en innovation scientifique et éducative Kunpeng Ascend ».

La création de ces centres d’excellence et d’incubation constitue un modèle exemplaire d’intégration industrie-éducation :

-

L’intégration de l’écosystème Ascend compense la pénurie de puissance de calcul dans les universités, stimulant fortement la production de résultats de recherche ;

-

La réforme des cursus, pilotée par des projets de recherche, industriels ou de concours, permet de former des talents de haut niveau pour l’industrie du calcul ;

-

Le travail intensif sur l’architecture système, l’accélération du calcul, les algorithmes et les capacités systèmes vise à produire des innovations mondiales ;

-

Le développement de nombreuses disciplines croisées « IA+X » impulse l’évolution d’un écosystème intelligent.

Construire une puissance de calcul nationale entièrement autonome pour la recherche en IA

Aujourd'hui, l'importance de l'IA pour la science va de soi.

Selon une enquête récente de Google DeepMind, un chercheur postdoctoral sur trois utilise des grands modèles linguistiques pour aider à la revue bibliographique, à la programmation et à la rédaction d'articles.

Les prix Nobel de physique et de chimie de cette année ont tous deux été attribués à des chercheurs travaillant dans le domaine de l'IA.

On voit bien que, dans le processus d'assistance de la recherche par l'IA, les GPU sont devenus un précieux « or » grâce à leurs performances exceptionnelles dans les domaines nécessitant un calcul haute performance, ainsi qu'à leurs capacités puissantes pour l'entraînement et l'inférence des LLM. Ils sont donc avidement recherchés par des entreprises comme Microsoft, xAI et OpenAI.

Cependant, l'embargo américain sur les GPU entrave considérablement les progrès de la Chine dans les domaines de l'IA et de la recherche scientifique.

Pour franchir ce fossé, nous devons construire un écosystème indépendant, complet, puis le développer et l'étendre.

Au niveau de la puissance de calcul, les processeurs IA de la série Ascend de Huawei assument la mission cruciale de redéfinir la compétitivité nationale.

Mais au-dessus de cette puissance de calcul, nous avons aussi besoin d’un framework informatique auto-développé qui s’y adapte parfaitement afin d’exploiter pleinement les avantages des NPU/processeurs IA.

Comme on le sait, l’architecture CUDA, spécialement conçue pour les GPU NVIDIA, est couramment utilisée dans les domaines de l’IA et de la science des données.

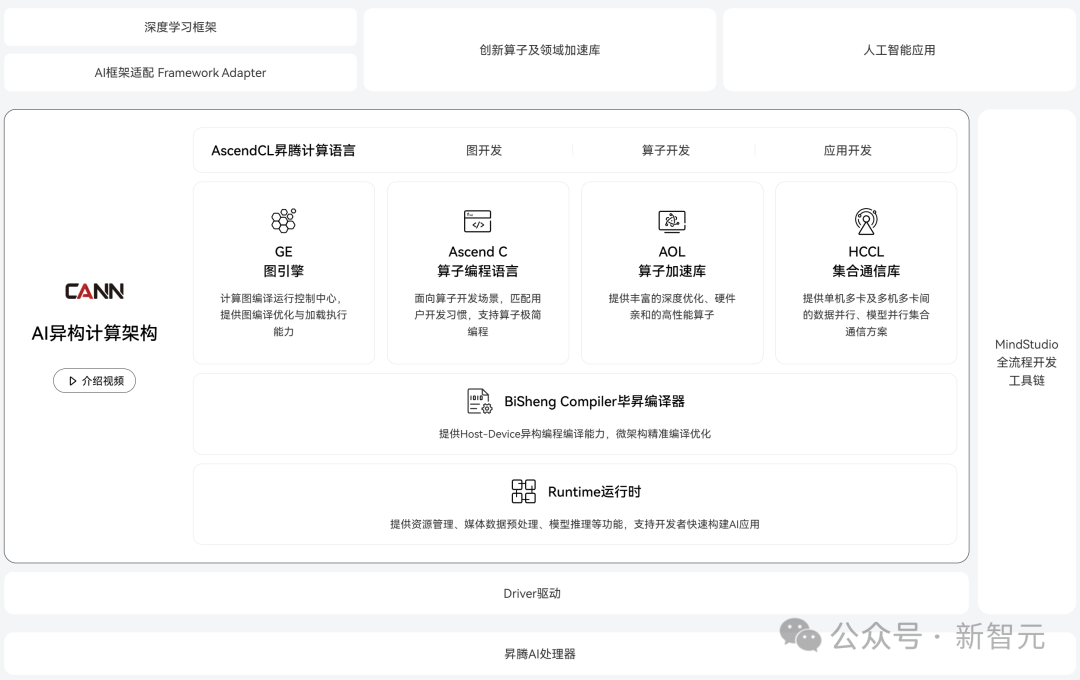

En Chine, la seule alternative véritablement concurrentielle à CUDA est CANN.

En tant qu’architecture de calcul hétérogène conçue par Huawei pour les scénarios d’IA, CANN prend en charge vers le haut les principaux frameworks IA du secteur tels que PyTorch, TensorFlow et MindSpore, tout en activant les processeurs IA Ascend vers le bas, servant ainsi de plateforme clé pour améliorer l’efficacité de calcul des processeurs IA Ascend.

C’est pourquoi CANN possède naturellement de nombreux avantages techniques, notamment une optimisation logicielle/matérielle plus poussée pour le calcul IA et une pile logicielle plus ouverte :

-

Tout d’abord, il prend en charge plusieurs frameworks IA, y compris MindSpore développé en interne, ainsi que PyTorch et TensorFlow tiers ;

-

Ensuite, il fournit plusieurs niveaux d’interfaces de programmation adaptés à divers scénarios d’application, permettant aux utilisateurs de construire rapidement des applications et services IA basés sur la plateforme Ascend ;

-

En outre, il inclut des outils de migration de modèles facilitant le transfert rapide des projets vers la plateforme Ascend.

À ce jour, CANN a déjà construit un écosystème initial. Sur le plan technique, CANN regroupe un grand nombre d'applications, d'outils et de bibliothèques, formant un écosystème technologique complet offrant aux utilisateurs une expérience de développement intégrée. Parallèlement, la communauté des développeurs s'appuyant sur la base technologique Ascend ne cesse de croître, créant un terrain fertile pour les futures innovations.

Au-dessus de l'architecture de calcul hétérogène CANN, nous avons besoin d'un framework de deep learning pour construire les modèles IA.

Pratiquement tous les développeurs IA ont besoin d'un framework de deep learning, et presque tous les algorithmes et applications DL doivent être implémentés via un tel framework.

Actuellement, des frameworks populaires tels que TensorFlow de Google et PyTorch de Meta dominent le marché et ont constitué un vaste écosystème.

À l'ère de l'entraînement des grands modèles, les frameworks de deep learning doivent être capables de former efficacement même à l'échelle de milliers d'ordinateurs.

Le framework de deep learning open source pour tous les scénarios — Huawei MindSpore — officiellement lancé en mars 2020, comble le vide national dans ce domaine et assure un contrôle et une autonomie totale.

MindSpore dispose de fonctionnalités clés telles que le déploiement multi-scénario (cloud, edge, terminal), un support natif pour l'entraînement des grands modèles, et la capacité d'associer IA et calcul scientifique. Il crée un environnement de développement natif, simplifié à tous les niveaux, accélérant ainsi l'innovation scientifique et les applications industrielles en Chine.

Notamment, en tant que partenaire idéal des processeurs IA Ascend, MindSpore prend en charge tous les scénarios (terminal, edge, cloud), permettant une architecture unifiée, un entraînement unique et un déploiement multiple.

Des simulations du système terrestre à l’autopilotage, en passant par la prédiction de la structure des protéines, tout peut être réalisé via MindSpore.

Pour qu’un framework de deep learning open source libère toute sa valeur, il lui faut un écosystème de développeurs largement répandu.

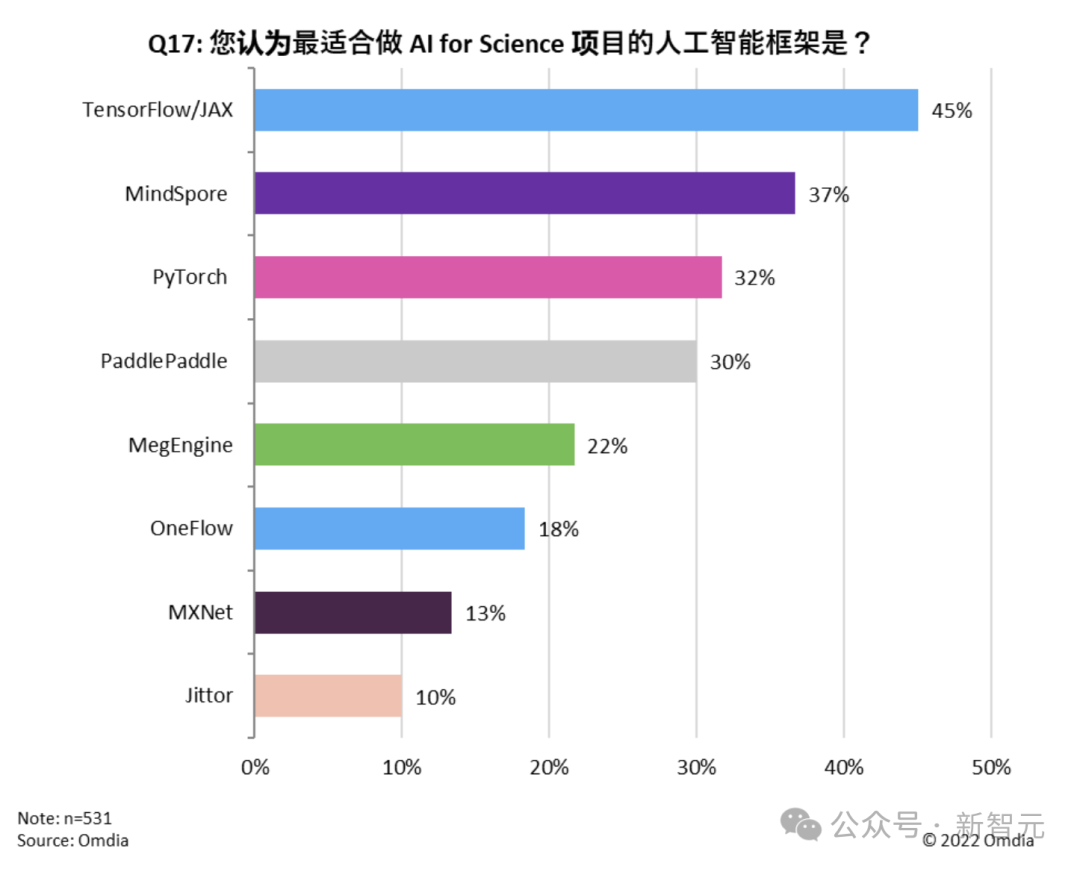

Le rapport de recherche de l’institut Omdia publié en 2023, « Rapport d’enquête sur le marché chinois des frameworks d’intelligence artificielle », montre que MindSpore a rejoint le premier groupe en termes d’utilisation, juste derrière TensorFlow.

En outre, ce sont les applications d'inférence dans tous les secteurs qui libèrent réellement la valeur de l'IA. Dans le contexte du développement accéléré de GenAI, tant les universités que les entreprises ont un besoin urgent de solutions pour accélérer l'inférence.

Par exemple, TensorRT, un compilateur d'optimisation haute performance, est un excellent outil pour améliorer les performances d'inférence des grands modèles. Grâce à la quantification et à la rareté, il réduit la complexité du modèle et optimise efficacement la vitesse d'inférence des modèles de deep learning. Mais le problème est qu’il ne prend en charge que les GPU NVIDIA.

De manière analogue, maintenant que nous disposons d’une architecture de calcul et d’un framework de deep learning, nous avons aussi besoin d’un moteur d’inférence adapté — Huawei MindIE Ascend.

MindIE est un moteur d'accélération d'inférence IA multi-scénario, intégrant les technologies d'accélération d'inférence les plus avancées du secteur, tout en héritant des caractéristiques de PyTorch open source.

Conçu pour allier flexibilité et praticité, il s'interconnecte sans heurt avec plusieurs frameworks IA majeurs, prend en charge différents types de processeurs IA Ascend et offre aux utilisateurs des interfaces de programmation à plusieurs niveaux.

Grâce à une optimisation intégrée de bout en bout et à une ouverture progressive des capacités IA, MindIE libère la puissance maximale du matériel Ascend, offrant aux utilisateurs des solutions d'inférence de deep learning rapides et efficaces. Il résout les problèmes liés à la complexité technique élevée et aux nombreuses étapes de développement, améliore le débit des modèles, raccourcit le temps de mise sur le marché des applications, active des centaines de modèles et répond aux besoins variés des activités IA.

On constate que les technologies innovantes autonomes telles que CANN, MindSpore et MindIE comblent non seulement le déficit national en matière de puissance de calcul, mais réalisent aussi des percées spectaculaires dans l'entraînement des modèles, la convivialité des frameworks et les performances d'inférence, rivalisant directement avec les meilleures technologies étrangères.

Construire des centres d'incubation de niveau mondial

Outre leurs avantages techniques, l'utilisation de la puissance de calcul Ascend correspond aussi mieux aux besoins nationaux pour les décennies à venir.

Seule une puissance de calcul auto-développée en Chine permettra de se soustraire aux aléas de l'environnement externe changeant et garantira la stabilité de la base de recherche.

Maintenant que la plateforme est prête, comment aider les enseignants et étudiants universitaires à apprendre à l'utiliser ?

Depuis le 6 septembre dernier, Huawei a organisé progressivement la première session du camp d'entraînement spécial Ascend AI dans quatre grandes universités : Peking University, Shanghai Jiao Tong University, Zhejiang University et University of Science and Technology of China. Parmi les centaines d’étudiants inscrits, 90 % étaient des étudiants de master ou doctorants. Le programme couvrait CANN, MindSpore, MindIE, MindSpeed, HPC et les outils de développement Kunpeng.

Dans ce camp, les étudiants peuvent non seulement approfondir les technologies clés, mais aussi bénéficier de sessions pratiques. Cette organisation correspond bien aux besoins des étudiants pour assimiler de nouvelles connaissances, progressant graduellement de manière structurée.

Par exemple, à la session de Shanghai Jiao Tong, le premier jour est consacré à la migration, permettant aux étudiants de découvrir les solutions matérielles et logicielles de base d'Ascend AI, des cas pratiques de développement natif Ascend de modèles Pytorch, ainsi que les caractéristiques et exemples de migration des solutions d'inférence MindIE.

Le deuxième jour porte sur l’optimisation, incluant l’architecture de calcul hétérogène Ascend, le développement d’opérateurs Ascend C, et des ateliers pratiques sur l’optimisation de l’inférence longue séquence pour les grands modèles.

La conception des modules sur migration et optimisation reflète une vision stratégique à long terme.

Il faut savoir que de nombreux cours pratiques dans les universités reposent actuellement sur des configurations CUDA/X86. Toutefois, sous l’effet des sanctions, la pénurie de puissance de calcul devient de plus en plus criante. Maîtriser les méthodes de migration permettrait alors de transférer les projets sur la plateforme Ascend, assurant ainsi la continuité des travaux académiques.

Une fois les bases acquises, les étudiants peuvent passer à la pratique. Des experts Huawei les accompagnent pas à pas, leur permettant d’apprendre la stack technologique Ascend à travers la quantification, l’inférence et la réalisation de codes Codelabs, et de vivre l’intégralité du processus d’inférence des grands modèles.

Après cette mise en pratique, les étudiants acquièrent une meilleure compréhension de l’écosystème Ascend, posant ainsi des fondations solides pour leurs futures carrières techniques.

Étudiants participant à la première session du camp pratique à Shanghai Jiao Tong

Outre les formations, Huawei organisera également un concours de défis d’opérateurs destiné aux développeurs universitaires, afin d’identifier les talents du développement d’opérateurs.

Le concours encourage les développeurs à innover profondément et à expérimenter en utilisant les ressources de calcul Ascend et les fonctionnalités de base de CANN, accélérant ainsi l’intégration de l’IA dans les secteurs professionnels et favorisant le développement des compétences des développeurs.

Par ailleurs, les centres d'incubation accordent également une grande importance aux résultats académiques.

Les étudiants menant des recherches académiques basées sur les technologies et outils clés Kunpeng ou Ascend peuvent demander une bourse d'études pour diplômés. S'ils publient leurs articles dans des conférences internationales prestigieuses ou des revues nationales de haut niveau, ils reçoivent également des récompenses spécifiques.

En outre, Huawei collabore avec ses partenaires de l'écosystème Kunpeng & Ascend pour lancer un programme de talents d'excellence.

Ce programme accompagne les étudiants du stade théorique vers la pratique, en les plongeant dans des environnements professionnels réels, tout en facilitant leur connexion précoce avec les entreprises.

Actuellement, ce programme couvre déjà 200 entreprises dans 15 villes, proposant plus de 2 000 postes techniques et permettant à plus de 10 000 étudiants d'être recrutés.

En résumé, grâce à ces programmes pédagogiques et incitatifs, l'engagement des étudiants augmente considérablement. Cela leur permet non seulement d'améliorer leur expérience académique et de produire des résultats de recherche, mais aussi d'enrichir leur parcours, ce qui constitue un atout sur le marché de l'emploi et attire plus facilement l'attention des entreprises leaders nationales et internationales.

Alors, après avoir maîtrisé les dernières technologies et leurs usages, comment cultiver de véritables percées scientifiques dans un domaine aussi évolutif que l’IA ?

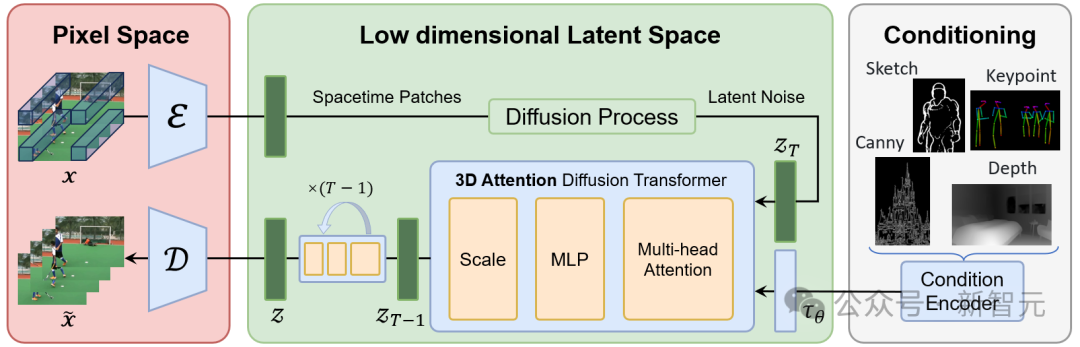

Depuis que Sora a déclenché la vague d’IA texte-vers-vidéo en 2024, de nouveaux grands modèles texte-vers-vidéo ont continué d’émerger. Le projet open source Open-Sora Plan, co-développé par Peking University et Tuzhan, a suscité un grand émoi dans le secteur.

En réalité, l’équipe avait déjà commencé à préparer une version open source de Sora dès sa sortie, mais faute de puissance de calcul et de données suffisantes, le projet avait été temporairement suspendu. Heureusement, la création conjointe par Peking University et Huawei du Centre d’excellence en innovation scientifique et éducative Kunpeng Ascend a rapidement fourni le soutien nécessaire en puissance de calcul.

L’équipe utilisait auparavant des GPU NVIDIA A100. Après la migration vers l’écosystème Ascend, elle a fait plusieurs découvertes positives :

Le support de CANN permet un calcul parallèle hautement efficace, accélérant nettement le traitement des grands ensembles de données ; les bibliothèques d’interfaces Ascend C simplifient le développement d’applications IA ; la bibliothèque d’accélération d’opérateurs optimise davantage les performances des algorithmes.

Plus important encore, l’écosystème Ascend ouvert permet une adaptation rapide des grands modèles et des applications.

Ainsi, bien que les membres de l’équipe aient débuté à zéro avec l’écosystème Ascend, ils ont pu s’y adapter rapidement en peu de temps.

Pendant les phases suivantes d’entraînement, l’équipe a continué à faire des découvertes agréables : par exemple, lors de l’utilisation de torch_npu pour le développement, l’ensemble du code peut être entraîné et inféré sans interruption sur les NPU Ascend.

Lorsqu’il s’agit de diviser les modèles, la suite d’accélération distribuée MindSpeed d’Ascend propose de nombreux algorithmes distribués avancés et stratégies de parallélisme pour les grands modèles.

En outre, lors d’entraînements à grande échelle, l’utilisation combinée de MindSpeed et du matériel Ascend présente une stabilité bien supérieure à celle des autres plates-formes, pouvant fonctionner sans interruption pendant une semaine complète.

Ainsi, en seulement un mois, Open-Sora Plan a été officiellement lancé, remportant une reconnaissance considérable dans le secteur.

Les images générées par Open-Sora Plan du jeu « Black Myth: Wukong » rivalisent avec des films cinématographiques, impressionnant des milliers d’internautes

Par ailleurs, orientée vers la puissance de calcul Ascend, Southeast University a développé un grand modèle multimodal de transport nommé MT-GPT.

Autrefois, le déploiement des grands modèles de transport était extrêmement difficile en raison de silos de données causés par différentes administrations publiques, de formats et normes de données non uniformisés, et de données hétérogènes provenant de multiples sources.

Pour résoudre ces problèmes, l’équipe a conçu un cadre conceptuel appelé MT-GPT (Multimodal Transportation Generative Pre-trained Transformer), visant à fournir une prise de décision multidimensionnelle et multi-niveaux basée sur les données pour les systèmes de transport multimodaux.

Toutefois, le développement et l’entraînement des grands modèles exigent une base de puissance de calcul extrêmement robuste.

Pour cela, l’équipe a choisi de tirer parti des capacités de l’IA Ascend afin d’accélérer le développement, l’entraînement, l’ajustement et le déploiement du grand modèle de transport.

Pendant la phase de développement, la suite de développement de grands modèles Transformer améliore conjointement la précision de compréhension des questions génératives multimodales grâce à des corpus multilingues hétérogènes et un codage des caractéristiques multimodales.

Pendant la phase d’entraînement, la suite d’accélération distribuée MindSpeed d’Ascend fournit des algorithmes d’accélération multidimensionnels, multimodaux et multiformes pour le grand modèle de transport.

Pendant la phase d’ajustement, la chaîne d’outils complète MindStudio d’Ascend combine l’affinage avec des connaissances spécifiques au domaine du transport.

Pendant la phase de déploiement, le moteur d’inférence MindIE d’Ascend permet une inférence simple et complète du grand modèle de transport, tout en prenant en charge l’analyse, le développement, le débogage et l’optimisation transurbains.

En résumé, on constate que Open-Sora de Peking University est un projet de migration visant à reproduire Sora, et en tant que projet open source, il permet aussi de mieux doter les développeurs mondiaux d’applications dans divers scénarios.

Quant au grand modèle multimodal MT-GPT de Southeast University, il illustre la capacité concrète d’Ascend à transformer les résultats de recherche en applications réelles, renforçant directement le secteur du transport urbain.

Ainsi, un cycle complet entre recherche, industrie et éducation est pleinement réalisé.

Ces résultats fructueux confirment davantage que les centres d’excellence / incubation ne fournissent pas seulement un terreau fertile pour la recherche académique et l’innovation scientifique dans les universités, mais forment aussi une grande quantité de talents d’élite en IA, permettant ainsi l’émergence de percées scientifiques de niveau mondial.

Par exemple, durant le développement d’Open-Sora Plan par l’équipe de Peking University, le professeur Yuan Li organisait chaque jour des séances de brainstorming avec les étudiants et l’équipe Ascend de Huawei autour du code et du développement algorithmique.

Au fil de ce processus expérimental, de nombreux étudiants de l’équipe de Peking University ont participé activement à une recherche pratique de haute qualité, faisant preuve d’une créativité scientifique remarquable.

Cette équipe, dont l’âge moyen est de 23 ans, est devenue un pilier essentiel du développement des applications vidéo IA made in China.

Dans ce processus, la communauté des jeunes adeptes de l’écosystème Kunpeng Ascend continue de s’agrandir.

Par conséquent, lorsque les universités mènent des recherches basées sur des plateformes et des puissances de calcul nationales, elles bénéficient non seulement de l’apport intellectuel de premier plan, mais contribuent aussi à l’expansion de l’écosystème technologique Huawei.

Quel système d'innovation la Chine devrait-elle construire ?

On voit bien que ce nouveau modèle de coopération entreprise-université, initié par Huawei, est désormais lancé.

Depuis la création de sa ligne produit informatique en 2019, Huawei a rapidement signé avec le ministère de l’Éducation, en 2020, un projet de coopération « Smart Base ». Ce partenariat couvre 72 grandes universités du pays, où des collaborations pédagogiques ont été mises en œuvre.

À cette époque, certaines connaissances techniques de Kunpeng/Ascend avaient déjà été intégrées dans des cours obligatoires de licence.

Cependant, l'investissement dans les universités est un processus de maturation à moyen et long terme. Seuls les étudiants et enseignants qui adoptent ces technologies tôt pourront en tirer pleinement parti dans les années à venir.

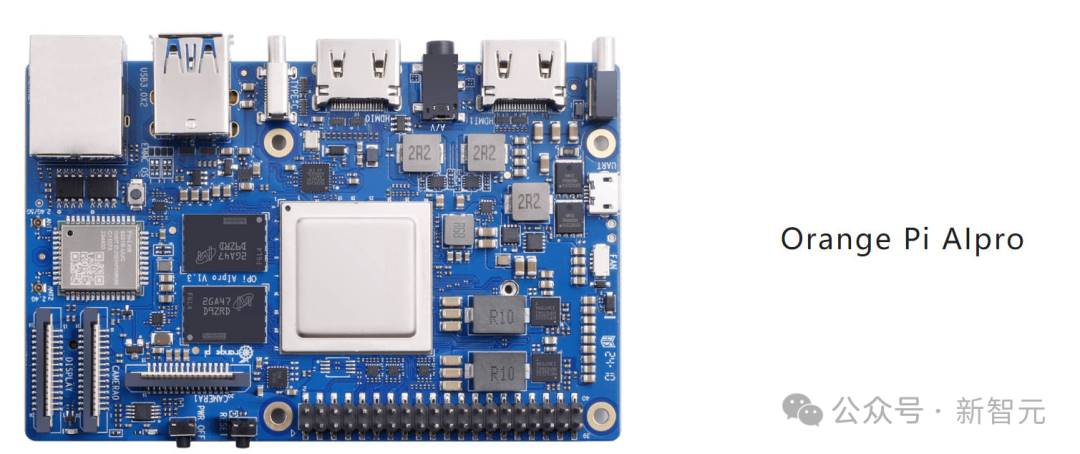

C’est pourquoi Huawei prévoit d’investir annuellement 1 milliard de yuans pour développer l’écosystème natif et les talents de Kunpeng et Ascend. Cette stratégie fournira aux talents universitaires et aux développeurs davantage de ressources et d’espaces de développement, lançant déjà un programme de don de 100 000 cartes de développement Kunpeng et de cartes d’inférence Ascend, afin d’encourager leur exploration et utilisation dans les expériences pédagogiques, concours et innovations technologiques.

Selon ce programme, enseignants et étudiants peuvent tester et utiliser directement les cartes de développement. Que ce soit pour l’enseignement ou la recherche, ils peuvent expérimenter librement leurs idées innovantes, stimulant ainsi de nouvelles inspirations.

La carte de développement OrangePi AIpro, co-développée par Orange Pi et Huawei Ascend, répond aux besoins de validation des prototypes d’algorithmes IA et de développement d’applications d’inférence. Elle convient largement au calcul en périphérie IA, à l’apprentissage en vision profonde, aux drones et au cloud computing, démontrant une puissance et une polyvalence remarquables

D’un autre côté, la situation particulière actuelle de la Chine — confrontée à des blocus technologiques externes — signifie que notre marge de temps est limitée. Nous devons impérativement disposer d’une stack technologique indépendante et maîtrisée.

Le développement natif est désormais incontournable. Seul le « Made in China » correspond pleinement aux grandes tendances futures du pays.

Avec la montée en puissance de l’autonomisation nationale, des stacks technologiques domestiques telles que Kunpeng/Ascend seront progressivement intégrées dans toutes les infrastructures informatiques.

Le lancement des centres d’excellence et d’incubation renforce de plus en plus la confiance du secteur.

On peut prévoir qu’après quelques années d’incubation, les talents scientifiques maîtrisant les bases technologiques nationales diffuseront largement les lignes directrices technologiques Kunpeng/Ascend, produisant des résultats de recherche suffisamment influents pour guider le monde.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News