Lors du salon GTC d'NVIDIA consacré à l'IA, la puce IA la plus puissante au monde, Blackwell, fait son apparition

TechFlow SélectionTechFlow Sélection

Lors du salon GTC d'NVIDIA consacré à l'IA, la puce IA la plus puissante au monde, Blackwell, fait son apparition

Nvidia affirme que Blackwell offre une amélioration de 25 fois en termes de coût et d'efficacité énergétique par rapport à la génération précédente, ce qui en fait la puce la plus puissante au monde.

Rédaction : Li Dan

Source : Wall Street Insights

La conférence annuelle des développeurs d'IA de NVIDIA, présentée comme l'événement phare mondial dans le domaine de l'intelligence artificielle cette année, a débuté le lundi 18 mars à 9 heures (heure de l'Est des États-Unis).

Cette édition marque le retour en présentiel du GTC après cinq ans d’absence, et selon les analyses précédentes, NVIDIA devait y présenter des innovations majeures.

Lundi après-midi, heure locale, Jensen Huang, fondateur et PDG de NVIDIA, a prononcé une allocution intitulée « La n°1 Conférence IA pour les développeurs » au SAP Center de San Jose, en Californie.

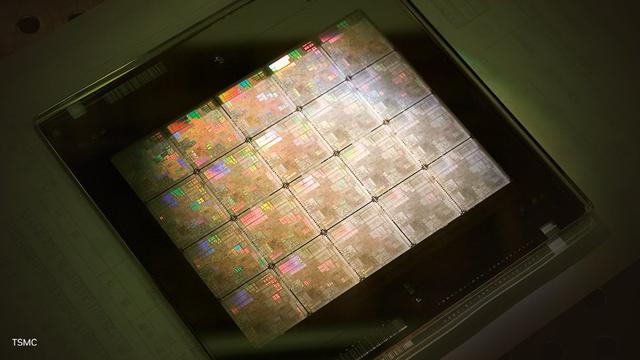

Blackwell réduit les coûts et la consommation énergétique de 25 fois par rapport à la génération précédente – Puce la plus puissante au monde, gravure TSMC en 4 nm

Jensen Huang a présenté les nouveaux processeurs et logiciels destinés à exécuter des modèles d’intelligence artificielle. NVIDIA a officiellement lancé Blackwell, sa nouvelle génération de GPU dédiés à l’IA, dont la livraison est prévue pour la fin de l’année.

La plateforme Blackwell permettra de construire et d’exécuter en temps réel des modèles génératifs d’IA dotés de paramètres au niveau du trillion, avec une amélioration de 25 fois en termes de coût et de consommation énergétique comparée à la génération précédente.

NVIDIA affirme que Blackwell intègre six technologies révolutionnaires capables de prendre en charge des modèles d’IA jusqu’à 10 000 milliards de paramètres pour l’apprentissage et l’inférence en temps réel :

-

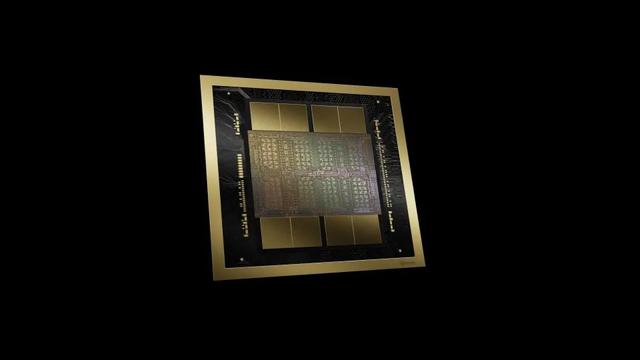

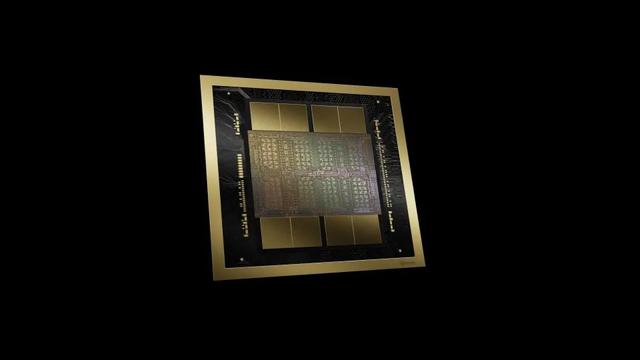

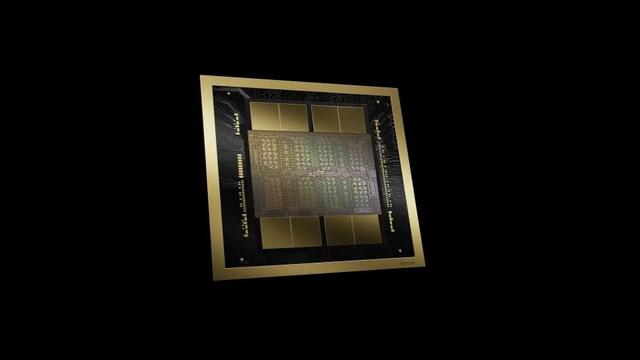

La puce la plus puissante au monde : Le GPU à architecture Blackwell regroupe 208 milliards de transistors, fabriqué sur un procédé personnalisé de 4 nanomètres par TSMC. Deux dies GPU atteignant la limite du reticle sont reliés via un lien inter-puces de 10 To/s pour former un seul GPU intégré.

-

Moteur Transformer de deuxième génération : Associant la technologie Tensor Core Blackwell aux algorithmes avancés de gestion dynamique de plage de NVIDIA dans TensorRT-LLM et au cadre NeMo Megatron, Blackwell doublera la capacité de calcul et d’inférence grâce à la prise en charge du format flottant 4 bits.

-

NVLink de cinquième génération : Pour optimiser les performances des modèles d’IA trillions de paramètres et des modèles experts hybrides, la dernière version de NVLink offre un débit bidirectionnel record de 1,8 To/s par GPU, assurant une communication ultrarapide entre jusqu’à 576 GPU pour les LLM les plus complexes.

-

Moteur RAS : Les GPU Blackwell incluent un moteur dédié garantissant fiabilité, disponibilité et maintenabilité. L’architecture ajoute également des fonctionnalités au niveau de la puce, utilisant une maintenance préventive basée sur l’IA pour diagnostiquer et anticiper les problèmes de fiabilité. Cela maximise le temps de fonctionnement du système, renforce la résilience de l’IA à grande échelle et réduit les coûts opérationnels, permettant un fonctionnement continu pendant des semaines voire des mois.

-

IA sécurisée : Des fonctions avancées de calcul confidentiel protègent les modèles d’IA et les données clients sans compromettre les performances, avec prise en charge d’un nouveau protocole de chiffrement natif, essentiel pour les secteurs sensibles comme la santé ou la finance.

-

Moteur de décompression : Un moteur dédié accélère la décompression des formats récents, améliore les requêtes de bases de données et assure les meilleures performances pour l’analyse de données et la science des données. Dans les années à venir, le traitement des données, qui coûte des dizaines de milliards de dollars par an aux entreprises, sera de plus en plus accéléré par les GPU.

Les performances d’inférence du GB200 NVL72 sont jusqu’à 30 fois supérieures à celles du H100

NVIDIA a également présenté le superpuce GB200 Grace Blackwell Superchip, qui relie deux GPU B200 Tensor Core à un CPU NVIDIA Grace via un NVLink ultra-performant et à très faible consommation de 900 Go/s.

Pour des performances d’IA maximales, les systèmes pilotés par GB200 peuvent être connectés aux plateformes annoncées ce jour, Quantum-X800 InfiniBand et Spectrum-X800 Ethernet de NVIDIA, offrant des vitesses réseau allant jusqu’à 800 Go/s.

Le GB200 est un composant clé du GB200 NVL72, un système à plusieurs nœuds, refroidi par liquide, dimensionné en rack, conçu pour les charges de travail les plus intensives. Il combine 36 superpuces Grace Blackwell, soit 72 GPU Blackwell et 36 CPU Grace interconnectés par NVLink de cinquième génération. Le GB200 NVL72 inclut également l’unité de traitement de données NVIDIA BlueField®-3, permettant une accélération du réseau cloud, un stockage composable, une sécurité Zero Trust et une résilience du calcul GPU dans les clouds d’IA à très grande échelle.

Par rapport à un nombre équivalent de GPU H100 Tensor Core, le GB200 NVL72 améliore les performances d’inférence LLM jusqu’à 30 fois, tout en réduisant les coûts et la consommation énergétique jusqu’à 25 fois.

La plateforme GB200 NVL72 agit comme un seul GPU avec une performance d’IA de 1,4 exaflops et 30 To de mémoire rapide, servant de bloc de construction pour le dernier DGX SuperPOD.

NVIDIA lance également la carte mère serveur HGX B200, reliant huit GPU B200 via NVLink pour supporter les plateformes génératives d’IA basées sur x86. L’HGX B200 prend en charge des vitesses réseau allant jusqu’à 400 Go/s via les plateformes réseau InfiniBand Quantum-2 et Ethernet Spectrum-X de NVIDIA.

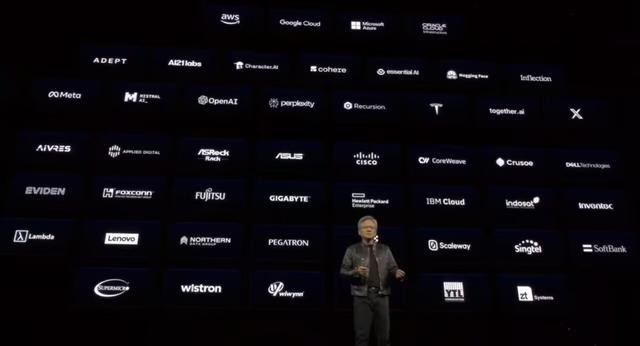

Amazon, Microsoft, Google et Oracle figurent parmi les premiers fournisseurs cloud proposant le support Blackwell

Les puces Blackwell serviront de base aux déploiements de nouveaux ordinateurs et produits par les plus grands exploitants de centres de données mondiaux comme Amazon, Microsoft et Google. Les produits basés sur Blackwell seront disponibles plus tard cette année.

NVIDIA indique qu’AWS, Google Cloud, Microsoft Azure et Oracle Cloud Infrastructure seront parmi les premiers fournisseurs de services cloud à proposer des instances compatibles Blackwell. Les membres du programme de partenaires cloud NVIDIA, notamment Applied Digital, CoreWeave, Crusoe, IBM Cloud et Lambda, feront également partie des premiers à proposer des instances Blackwell.

Des clouds souverains dédiés à l’IA souveraine (Sovereign AI) offriront également des services et infrastructures basés sur Blackwell, incluant Indosat Ooredoo Hutchinson, Nebius, Nexgen Cloud, Oracle Cloud Souverain UE, Oracle Cloud gouvernementaux pour les États-Unis, le Royaume-Uni et l’Australie, Scaleway, Singtel, Taiga Cloud du groupe Northern Data Group, Shakti Cloud de Yotta Data Services et YTL Power International.

Jensen Huang a déclaré : « Depuis trente ans, nous poursuivons l’informatique accélérée afin d’accomplir des percées transformatrices dans des domaines tels que l’apprentissage profond et l’IA. L’IA générative est la technologie déterminante de notre époque. Blackwell est le moteur de cette nouvelle révolution industrielle. En collaborant avec les entreprises les plus dynamiques du monde, nous tiendrons la promesse de l’IA dans tous les secteurs. »

Dans son communiqué, NVIDIA cite plusieurs organisations qui adopteront Blackwell, telles que Microsoft, Amazon, Google, Meta, Dell, OpenAI, Oracle, Tesla et xAI dirigées par Elon Musk. Huang a présenté davantage de partenaires, incluant ces entreprises.

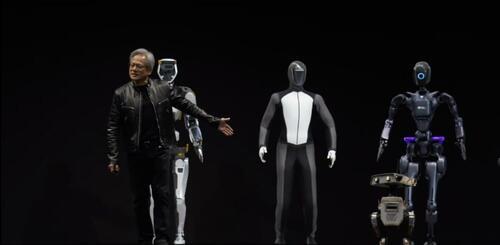

Le projet d’IA Project GR00T au service des robots humanoïdes

Durant son discours, Jensen Huang a révélé que NVIDIA lançait Project GR00T, un projet d’IA multimodal visant à propulser les futurs robots humanoïdes. Ce projet s’appuie sur un modèle fondamental universel permettant aux robots humanoïdes d’utiliser comme entrées du texte, de la parole, des vidéos ou même des démonstrations en direct, puis de traiter ces données pour effectuer des actions spécifiques et généralisées.

Project GR00T a été développé à l’aide de la plateforme robotique Isaac de NVIDIA, incluant le nouvel Isaac Lab dédié à l’apprentissage par renforcement.

Selon Huang, les robots alimentés par la plateforme Project GR00T seront conçus pour comprendre le langage naturel et imiter les gestes humains en observant leur comportement, leur permettant d’apprendre rapidement la coordination, la souplesse et d’autres compétences afin de s’adapter au monde réel et d’y interagir, sans jamais provoquer de révolte robotique.

Jensen Huang a ajouté :

« Construire un modèle fondamental pour les robots humanoïdes universels est aujourd’hui l’un des problèmes les plus passionnants pouvant être résolus en IA. En combinant ces technologies, les principaux experts mondiaux en robotique pourront réaliser d’immenses progrès dans le domaine des robots généraux artificiels. »

TSMC et Synopsys adoptent la technologie lithographique de NVIDIA

Jensen Huang a également mentionné que TSMC et Synopsys allaient adopter la technologie de lithographie computationnelle de NVIDIA, en utilisant la plateforme CuLitho de NVIDIA.

TSMC et Synopsys ont déjà intégré le logiciel Culitho W de NVIDIA. Ils utiliseront les prochaines GPU Blackwell de NVIDIA pour leurs applications d’IA et de calcul haute performance (HPC).

Le nouveau logiciel NIM facilite l’utilisation des GPU NVIDIA existants pour l’inférence IA

NVIDIA a également annoncé le lancement de NIM, des microservices d’inférence, des microservices natifs cloud optimisés destinés à raccourcir le délai de mise sur le marché des modèles d’IA génératifs et à simplifier leur déploiement dans le cloud, les centres de données et les stations de travail équipées de GPU.

NIM étend la base des développeurs en abstrayant la complexité du développement et de l’emballage des modèles d’IA grâce à des API standard du secteur. Faisant partie de NVIDIA AI Enterprise, il offre un chemin simplifié pour développer des applications d’entreprise pilotées par l’IA et déployer des modèles d’IA en production.

NIM rend plus facile pour les utilisateurs l'utilisation de GPU NVIDIA anciens pour l’inférence ou l’exécution de logiciels d’IA, permettant aux clients entreprises de continuer à exploiter leurs GPU NVIDIA existants. L’inférence nécessite moins de puissance de calcul que l’entraînement initial d’un nouveau modèle d’IA. NIM permet aux entreprises d’exécuter leurs propres modèles plutôt que d’acheter les résultats d’IA auprès de sociétés comme OpenAI.

Les clients disposant de serveurs NVIDIA peuvent utiliser NIM moyennant un abonnement à NVIDIA AI Enterprise, au tarif de 4 500 dollars par an et par GPU.

NVIDIA collaborera avec des entreprises leaders en IA comme Microsoft et Hugging Face pour garantir que leurs modèles soient exécutables sur tous les puces NVIDIA compatibles. Les développeurs utilisant NIM pourront exécuter efficacement leurs modèles sur leurs propres serveurs ou sur des serveurs cloud NVIDIA, sans processus de configuration fastidieux.

Les commentateurs soulignent que ce type de logiciel rend le déploiement de l’IA plus accessible, créant ainsi non seulement une source de revenus pour NVIDIA, mais offrant également aux clients une raison supplémentaire de rester fidèles aux puces NVIDIA.

Bienvenue dans la communauté officielle TechFlow

Groupe Telegram :https://t.me/TechFlowDaily

Compte Twitter officiel :https://x.com/TechFlowPost

Compte Twitter anglais :https://x.com/BlockFlow_News